Взгляд Anderson

Удаление объектов и людей из видео с помощью ИИ

Нет, ребенок не остается на картинке, если ИИ имеет что-то общее с этим.

Удаление людей и объектов из изображений и видео – это популярная подсистема исследований в литературе ИИ, ориентированной на VFX, с растущим количеством специальных наборов данных и фреймворков, решающих эту задачу. Последняя из них, из Института больших данных Университета Фудань в Китае, – это EffectErase, система удаления объектов видео, осведомленная об эффектах, которую, по мнению авторов, заметно улучшает состояние дел в тестах:

Собрано из материала на сайте проекта, примеры метода EffectErase (пожалуйста, обратите внимание, что хотя мы предоставляем ссылку, исходный сайт содержит много видео с высоким разрешением и неоптимизированных автозапусков, что может повлиять на стабильность вашего веб-браузера. Сопровождающее видео на YouTube – это более простой и полный справочник, и оно встроено в конце этой статьи). Источник

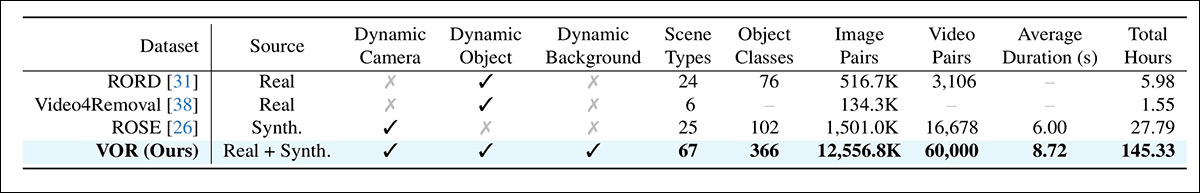

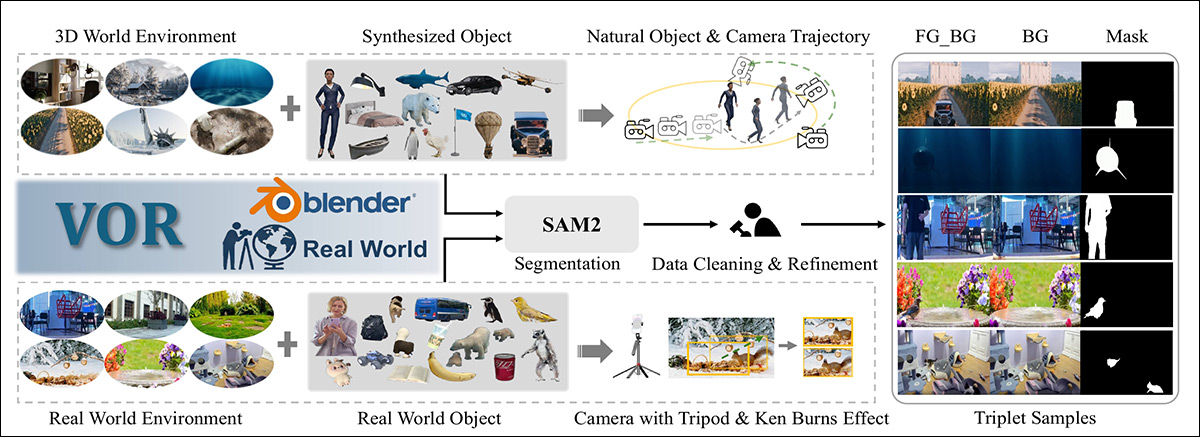

Новая работа включала создание/кураторство полуновального набора данных, состоящего из почти 350 оригинальных реальных и синтезированных сцен (с использованием публичных репозиториев*), либо снятых с помощью специального оборудования, либо полученных и перепрофилированных в рабочий процесс, построенный вокруг открытого фреймворка Blender 3D.

Гибридный набор данных Video Object Removal (VOR) является основой для самого приложения EffectErase, которое построено над системой генерации видео Wan2.1. Система также определяет два новых связанных эталона: VOR Eval и VOR Wild – соответственно, для образцов с и без грунтовой правды.

(Хотя у статьи есть сопровождающий сайт проекта, он довольно перегружен множеством видео с высоким разрешением, и его трудно загрузить; поэтому, пожалуйста, обратитесь к отрывкам, которые я подобрал в встроенном видео выше, если вы обнаружите, что сайт проекта трудно использовать)

Сравнение количеств по сравнимым предыдущим наборам данных, с учетом нового предложения. Источник

Исследователи утверждают, что их подход дает результаты на уровне состояния дел, как в количественных метриках, так и в качественных результатах, засвидетельствованных в исследовании с участием человека.

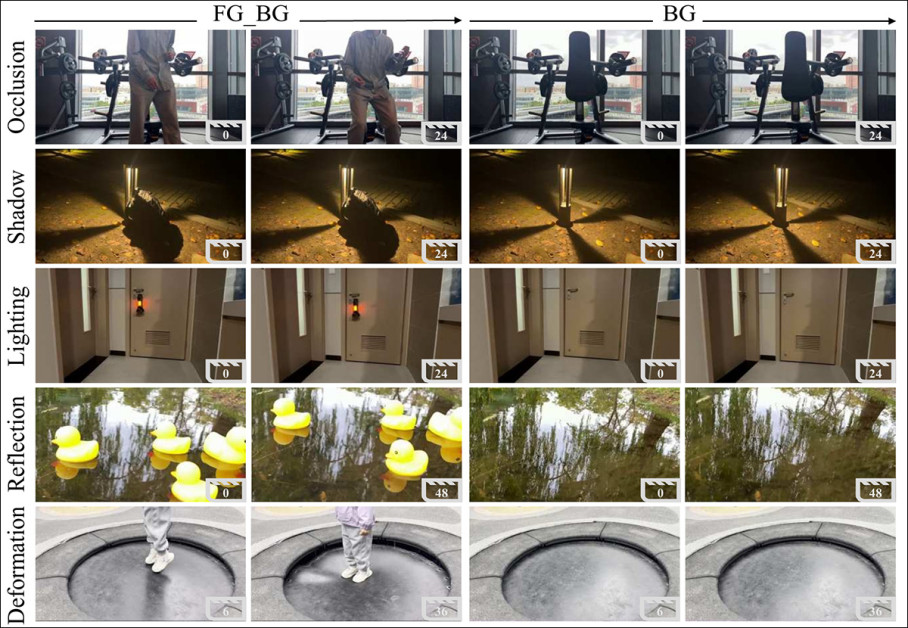

Они отмечают, что предыдущие работы не всегда смогли удалить сопутствующие эффекты объекта, такие как тени и отражения, и что их набор данных был тщательно создан для исправления этого недостатка:

Примеры предыдущих подходов, не смогших выйти за пределы объекта, подлежащего удалению, до вторичных указаний, таких как отражения и тени.

Новая статья озаглавлена EffectErase: Совместное удаление и вставка объектов видео для высококачественного удаления эффектов, и исходит от четырех исследователей из Колледжа компьютерных наук и искусственного интеллекта Университета Фудань.

Метод

Гибридный набор данных VOR был разработан для охвата широкого спектра сценариев, чтобы покрыть все последствия попытки удаления человека или объекта из видео:

Парные кадры из набора данных VOR иллюстрируют, как удаление объекта должно выходить за пределы видимого субъекта до его индуцированных эффектов, с примерами, показывающими оclusion, тень, сдвиги освещения, отражения и физическую деформацию, каждая представлена как вход (объект присутствует) рядом с соответствующим чистым фоном после удаления. Для дальнейших примеров обратитесь к сопровождающему видео на YouTube, встроенному в конце этой статьи.

Пять представительных типов “помех” для решения определяются авторами как окclusion, включая различные типы стеклянной и дымовой окluзи; тени; освещение (например, когда объект, подлежащий удалению, создает или изменяет путь света); отражение; и деформация (например, отпечаток пользователя на подушке, который не должен выжить после удаления человека).

Конвейер строительства набора данных VOR, объединяющий синтетические сцены, сгенерированные с помощью Blender, с реальными захватами, где синтетические данные строятся из отобранных 3D-сред, объектов и траекторий камеры, а реальные кадры записываются в различных сценах, дополненных движением Ken Burns. SAM2-сегментация и ручная доработка затем производят выровненные видеотриплеты фона и переднего плана с соответствующими масками.

Для реальных исходных данных исследователи использовали фиксированные камеры для записи сцен “с” и “без” объектов, покрывающих широкий спектр сред, времени суток и погодных условий.

Для синтетических данных были отображены несколько точек зрения, и были созданы многообъектные сценарии, в которых были представлены намеренно сложные и сложные типы движения камеры, такие как могут возникнуть в реальных кадрах; и исследователи отмечают, что этот подход более совершенен и трудоемок, чем тот, который используется для иначе подобного Удаление объектов с побочными эффектами в видео (ROSE) набора данных.

Чтобы увеличить разнообразие движения, был применен эффект Кена Бернса к парным кадрам, с камерой, добавляющей контролируемые панорамирования, масштабирование и незначительное ручное движение под четырнадцатью предварительно определёнными правилами, с пятью закономерностями движения, отобранными для каждой пары, сохраняя при этом кадр внутри исходной рамки.

Масштаб и разнообразие были дальнейшим расширены путем объединения синтетических объектов с несколькими установками камеры, маски были сгенерированы путем размещения ручных точечных подсказок на ключевых кадрах, распространения сегментации с помощью Segment Anything 2 (SAM2), очистки и доработки результатов, и сборки проверенных видеотриплетов фона и переднего плана для обучения.

Окончательная коллекция включает 145 часов видео по 60 000 парных видео, реальных и синтетических, покрывающих 366 классов объектов в 443 сценах.

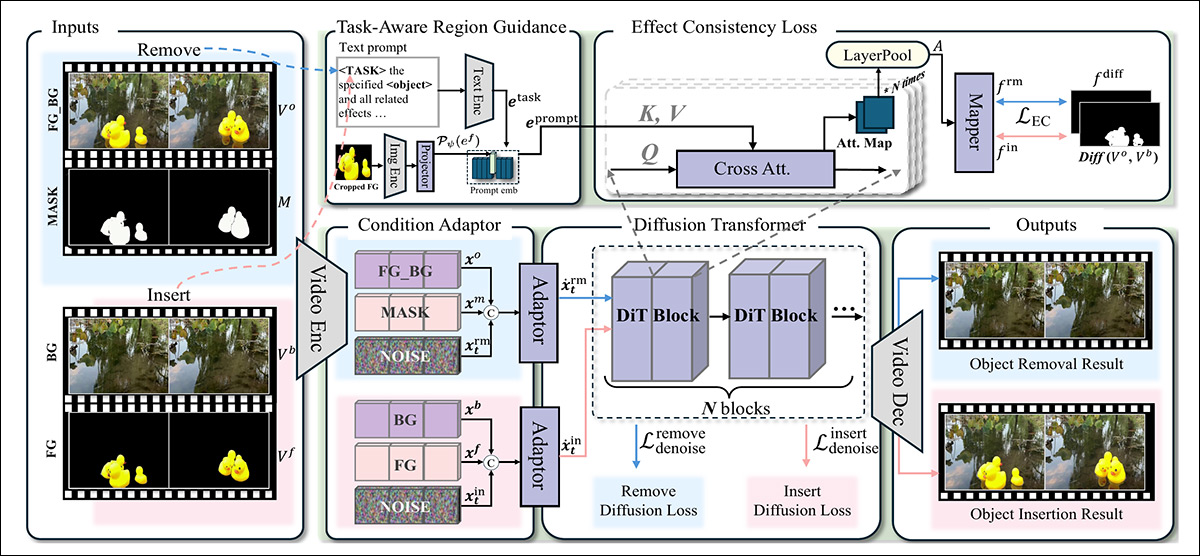

Сеть EffectErase сама по себе принимает материал через вариационный автокодировщик (VAE†), с латентным шумоподавлением, обрабатываемым Wan2.1. Над этой основой EffectErase работает Объединенное обучение удаления и вставки, которое обучает обе задачи вместе на одних и тех же регионах; Руководство по области, осведомленной о задаче (TARG), которое использует объектные и задачные токены с кросс-аттенцией для моделирования пространственно-временных связей между объектами и их эффектами и позволяет переключаться между задачами; и Потеря согласованности эффектов, которая выравнивает области эффектов, выровненные между удалением и вставкой задач:

Схема фреймворка EffectErase. Во время обучения парные видео кодируются в общее латентное пространство, объединяются с шумом и обрабатываются диффузионным трансформатором, управляемым осведомленной о задаче кросс-аттенцией, в то время как потеря согласованности эффектов выравнивает области удаления и вставки, чтобы обе задачи фокусировались на одной и той же области.

Само по себе процесс удаления и вставки обучается вместе, используя общий диффузионный бэкбон, так что модель учится фокусироваться на одних и тех же затронутых регионах и структурных подсказках.

Видео с объектами, видео фона только, и маски кодируются в латентное пространство; затем добавляется шум для диффузионного обучения, и модель учится восстанавливать чистые представления под задачеспецифическим руководством. Легкий адаптер затем объединяет шумные функции с условиями удаления или вставки, позволяя обеим задачам делиться надзором, оставаясь при этом контролируемыми.

Руководство по области, осведомленной о задаче создает задачеспецифический сигнал путем объединения языковых токенов с визуальными функциями, извлеченными из объекта переднего плана, используя CLIP, заменяя общий токен объекта на вложение, полученное из фактического содержания изображения. Это объединенное представление вводится в бэкбон через кросс-аттенцию, позволяя модели отслеживать, как объект и его визуальные эффекты эволюционируют во времени и пространстве, а также позволяет гибко переключаться между удалением и вставкой.

Потеря согласованности эффектов заставляет процессы удаления и вставки фокусироваться на одних и тех же измененных областях, поскольку обе задачи имеют дело с одним и тем же объектом и его визуальными эффектами. Аттенционные карты из каждого раздела затем объединяются в мягкие карты регионов и выравниваются с разницей карт, вычисленной из объектного и фонового видео, так что тонкие изменения, такие как освещение и тени, сохраняются. Этот дополнительный потеря помогает вставке руководить удалением и сохраняет обе задачи согласованными.

Данные и тесты

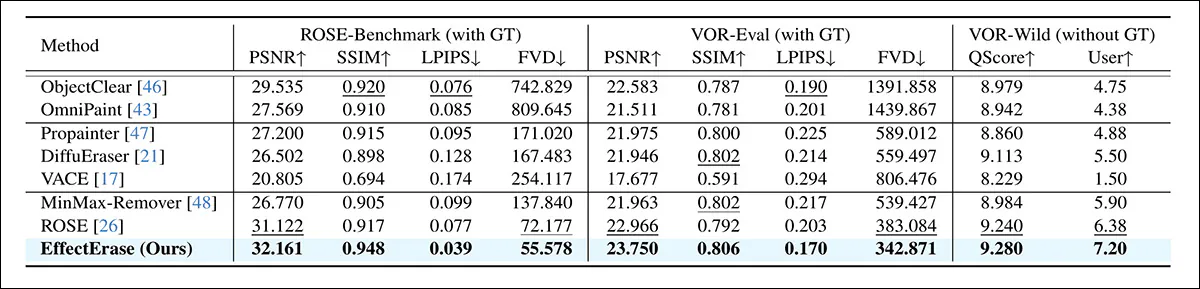

Исследователи протестировали свой подход против различных методов inpainting, видео inpainting и удаления объектов: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; и MiniMax-Remover.

Wan2.1 был дообучен с помощью LoRA†† с использованием набора данных VOR при разрешении 832x480px. 81 последовательный кадр (эффективный предел для WAN, после которого ошибки начинают возникать) был случайным образом отобран для обучения, которое проводилось в течение 129 000 итераций при размере партии 8 на восьми GPU H100, каждая с 80 ГБ видеопамяти. Скорость обучения была установлена на 1×102, а ранг LoRA – на 256.

Набор данных ROSE-Benchmark был единственным внешним набором данных, протестированным; два других были VOR-Eval, тестовый раздел VOR набора данных; и VOR-Wild, тестовый набор, состоящий из 195 реальных видео, собранных из интернета, в которых представлены “динамические объекты”.

Используемые метрики были Пиковая сигнал-шумовая отношение (PSNR); Индекс структурированного подобия (SSIM); Обученная перцептивная подобия изображений (LPIPS); и Фреймворк видео-расстояния (FVD). Также был проведен пользовательский тест 195 сгенерированных видео из VOR-Wild, с учетом усредненных рейтингов от 20 волонтеров.

Кроме того, авторы разработали QScore, метрику, использующую многомодельную модель Qwen-VL, чтобы оценить качество видео после удаления объектов, в плане остаточных артефактов или пропущенных удалений среды, таких как тени и эффекты освещения:

Количественное сравнение на ROSE и VOR эталонах, с лучшими и вторыми результатами, показанными в жирном и подчеркнутом виде соответственно.

Относительно этих результатов, авторы отмечают:

‘[Текущие] методы inpainting работают с отдельными кадрами, используя 2D-модели без временного моделирования, и поэтому не могут поддерживать временную согласованность в видео.

Недавние методы видео inpainting не могут явно моделировать побочные эффекты объекта, что приводит к неестественным результатам удаления. Существующие методы удаления объектов из видео не имеют моделирования пространственно-временной корреляции между объектом и его побочными эффектами, и, как следствие, часто производят артефакты и остаточные следы удаленных объектов.

‘В целом, EffectErase достигает результатов на уровне состояния дел во всех наборах данных и метриках оценки. Он получает лучшие баллы по метрике качества видео FVD, демонстрируя превосходную временную гладкость и согласованность сгенерированных видео.

‘Наш метод также достигает最高ого QScore и пользовательских рейтингов, что еще больше демонстрирует его эффективность в производстве визуально убедительных результатов удаления.’

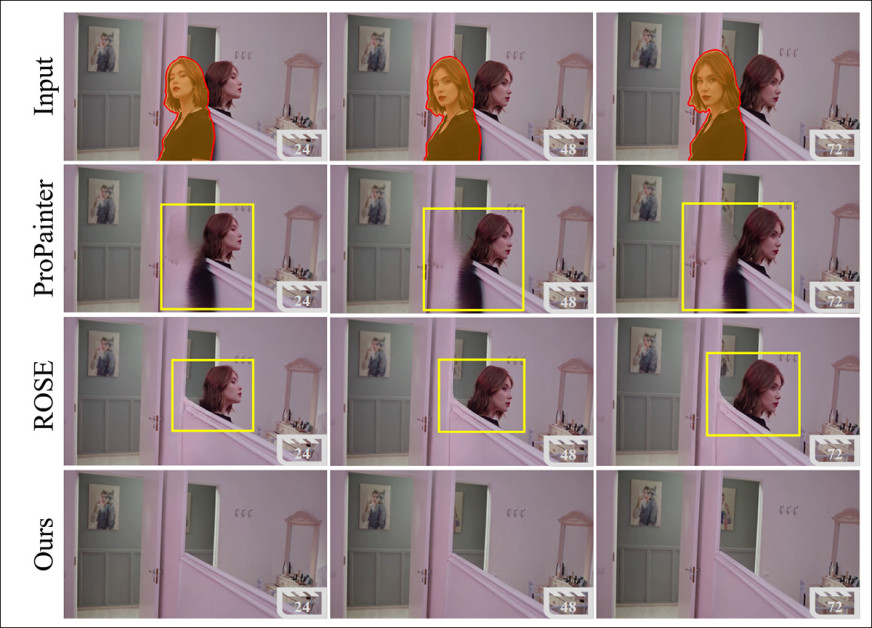

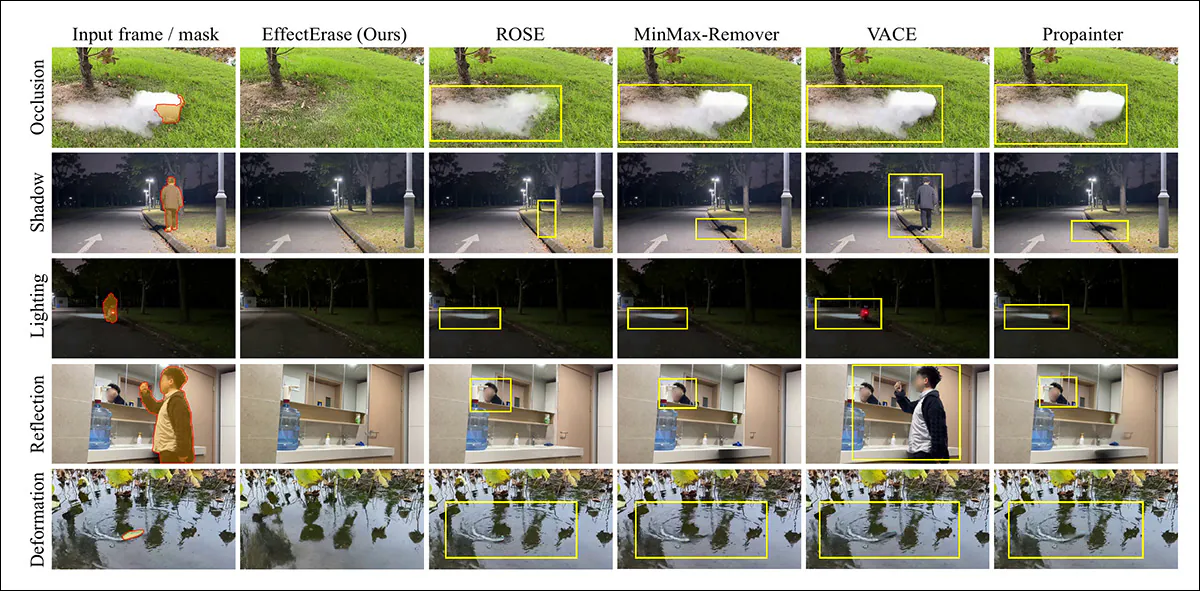

Для качественной оценки статические результаты предлагаются в статье (показаны) непосредственно ниже, а также движущиеся результаты доступны на сайте проекта и в сопровождающем видео на YouTube:

Качественное сравнение на VOR-Eval по случаям окluзи, тени, освещения, отражения и деформации. Методы inpainting испытывают трудности с удалением эффектов вне маски, в то время как модели удаления часто оставляют видимые артефакты. EffectErase удаляет как целевые объекты, так и их связанные эффекты более чисто. Пожалуйста, обратитесь к исходной статье для лучшего разрешения, и к сайту проекта для примеров видео.

Мы также направляем читателя к различным связанным примерам на сайте проекта, предварительно показанным ниже, а также к официальному видео на YouTube, встроенному в конце этой статьи:

Нажмите, чтобы воспроизвести. Пример сравнения с сайта проекта EffectErase. Пожалуйста, обратитесь к сайту для лучшего разрешения (с вышеуказанными оговорками) и для дальнейших примеров.

Авторы комментируют:

‘Методы видео inpainting часто производят артефакты в маскированных регионах и не могут полностью удалить побочные эффекты, вызванные удаленными объектами. Предыдущие подходы к удалению объектов, такие как [ROSE] и [MinMax-Remover], работают хорошо при удалении целевых объектов, но все еще испытывают трудности с побочными эффектами, особенно в случаях окluзи, тени, освещения, отражения и деформации.

‘Напротив, EffectErase эффективно удаляет как целевые объекты, так и их связанные эффекты, в результате чего получаются чистые, согласованные и высококачественные результаты.’

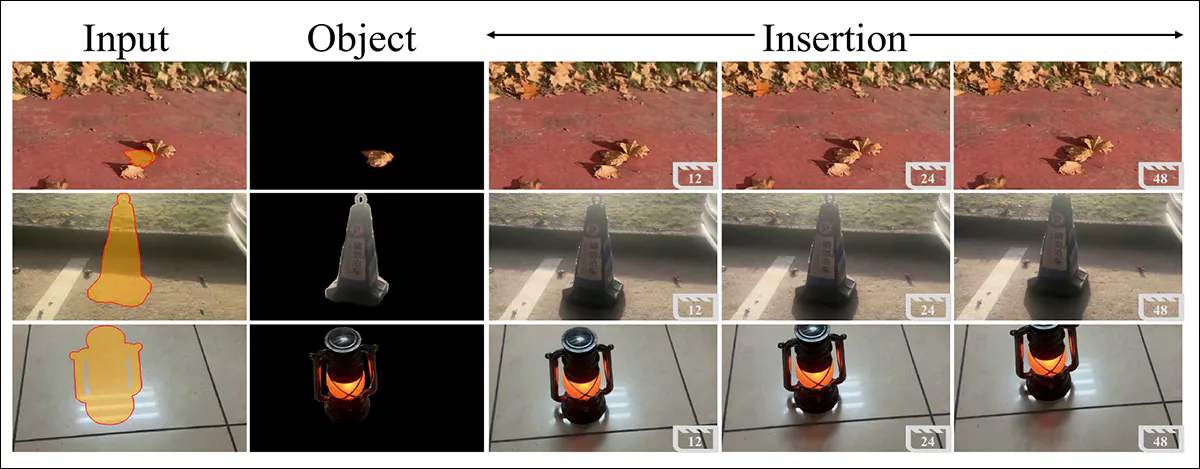

В заключение, исследователи отмечают, что их метод также может быть адаптирован для вставки объектов, а не для удаления, без необходимости дополнительного обучения:

Результаты вставки объектов видео. EffectErase вставляет объекты, сохраняя фоновый контент и генерируя согласованные эффекты, индуцированные объектом, такие как тени и отражения, на протяжении кадров.

Видео-результаты для задачи вставки можно увидеть в (времязависимом) видео на YouTube примерах (также встроенном без временных меток в конце статьи).

Вывод

Взгляд на подобные проекты в литературе показывает, что многие из них все еще надеются, что универсальные модели VFX в конечном итоге смогут включить эту функциональность в общую “инструментальную” модель, предназначенную для широкого спектра эффектов, а не только для этой конкретной задачи.

Однако, исходя из принципа “джек-оф-олл-тредс”, кажется разумным предположить, что специализированные системы, такие как EffectErase, будут продолжать поддерживать преимущество над более общими подходами; с оговоркой, что разрыв может в конечном итоге сократиться достаточно, чтобы сделать разницу не стоит дополнительных усилий по обучению дискретной модели.

* Было бы желательно, с растущими проблемами вокруг вопросов, связанных с правами интеллектуальной собственности, что все такие источники будут процитированы; но если доступные материалы из новой работы перечисляют источник 3D-моделей, я не смог найти эту ссылку.

† Ссылка, предоставленная, кажется, является общим объяснительным текстом 2013 года, с конкретным VAE не детализированным.

†† Взятое из статьи, это семантически неясное описание, поскольку дообучение и LoRA – это разные процессы с совершенно разными требованиями.

Опубликовано впервые в субботу, 21 марта 2026 г.