Искусственный интеллект

MagicDance: Реалистичная Генерация Видео Человеческого Танца

Компьютерное зрение является одной из наиболее обсуждаемых областей в индустрии ИИ, благодаря ее потенциальным приложениям в широком диапазоне задач в реальном времени. В последние годы компьютерные модели зрения быстро продвинулись вперед, и современные модели теперь способны анализировать черты лица, объекты и многое другое в реальных сценариях. Несмотря на эти возможности, передача движения человека остается сложной задачей для моделей компьютерного зрения. Эта задача включает в себя перенос выражений лица и движений тела из исходного изображения или видео на целевое изображение или видео. Передача движения человека широко используется в моделях компьютерного зрения для стилизации изображений или видео, редактирования мультимедийного контента, цифрового синтеза человека и даже генерации данных для основанных на восприятии рамок.

В этой статье мы сосредоточимся на MagicDance, модели на основе диффузии, предназначенной для революционизации передачи движения человека. Фреймворк MagicDance специально направлен на перенос 2D выражений лица и движений человека на сложные видео танца человека. Его цель – генерировать новые последовательности поз, управляемые танцевальными видео для конкретных целевых идентификаторов, сохраняя при этом исходную идентификацию. Фреймворк MagicDance использует двухэтапную стратегию обучения, ориентированную на дезентанглирование движения человека и факторы внешности, такие как тон кожи, выражения лица и одежда. Мы углубимся в фреймворк MagicDance, изучая его архитектуру, функциональность и производительность по сравнению с другими передовыми фреймворками передачи движения человека. Давайте погрузимся.

MagicDance : Реалистичная Передача Движения Человека

Как упоминалось ранее, передача движения человека является одной из самых сложных задач компьютерного зрения из-за огромной сложности, связанной с переносом движений и выражений человека из исходного изображения или видео на целевое изображение или видео. Традиционно фреймворки компьютерного зрения достигали передачи движения человека, обучая модель генерации, специфичную для задачи, включая GAN или Генеративные Соперничающие Сети на целевых наборах данных для выражений лица и поз тела. Хотя обучение и использование моделей генерации дают удовлетворительные результаты в некоторых случаях, они обычно страдают от двух основных ограничений.

- Они сильно полагаются на компонент искажения изображения, в результате чего они часто испытывают трудности с интерполяцией частей тела, невидимых в исходном изображении, либо из-за изменения перспективы, либо из-за самоокключения.

- Они не могут обобщаться на другие изображения, полученные из внешних источников, что ограничивает их применение, особенно в реальных сценариях.

Современные модели диффузии продемонстрировали исключительные возможности генерации изображений в различных условиях, и модели диффузии теперь способны представлять мощные визуальные эффекты в ряде задач, таких как генерация видео и inpainting изображений, обучаясь на веб-наборах данных изображений. Благодаря своим возможностям, модели диффузии могут быть идеальным выбором для задач передачи движения человека. Хотя модели диффузии можно реализовать для передачи движения человека, они имеют некоторые ограничения, либо в плане качества сгенерированного контента, либо в плане сохранения идентификации или страдают от временных несоответствий в результате ограничений конструкции и стратегии обучения модели. Кроме того, модели диффузии не демонстрируют значительного преимущества над фреймворками GAN в плане обобщаемости.

Чтобы преодолеть препятствия, с которыми сталкиваются модели диффузии и GAN в задачах передачи движения человека, разработчики ввели MagicDance, новый фреймворк, целью которого является использование потенциала моделей диффузии для передачи движения человека, демонстрируя беспрецедентный уровень сохранения идентификации, превосходного визуального качества и доменной обобщаемости. В своей основе фундаментальная концепция фреймворка MagicDance заключается в разделении проблемы на два этапа: контроль внешности и контроль движения, две способности, необходимые фреймворкам диффузии для обеспечения точной передачи движения.

Вышеуказанная фигура дает краткий обзор фреймворка MagicDance, и как можно увидеть, фреймворк использует Стабильную Диффузию, и также развертывает два дополнительных компонента: Модель Контроля Внешности и Pose ControlNet, где первая обеспечивает руководство по внешности для модели SD из справочного изображения через внимание, а вторая обеспечивает руководство по выражению/позе для модели диффузии из условного изображения или видео. Фреймворк также использует многоэтапную стратегию обучения для эффективного обучения этих подмодулей для дезентанглирования контроля позы и внешности.

Вкратце, фреймворк MagicDance – это

- Новый и эффективный фреймворк, состоящий из дезентанглированного контроля позы и предварительного обучения контроля внешности.

- Фреймворк MagicDance способен генерировать реалистичные выражения лица и движения человека под контролем условных входных данных позы и справочных изображений или видео.

- Фреймворк MagicDance направлен на генерацию контента человека, согласованного с внешностью, введя Модуль Внимания с Множественным Источником, который обеспечивает точное руководство для фреймворка Stable Diffusion UNet.

- Фреймворк MagicDance также может быть использован как удобное расширение или плагин для фреймворка Stable Diffusion, и обеспечивает совместимость с существующими весами модели, поскольку не требует дополнительной настройки параметров.

Кроме того, фреймворк MagicDance демонстрирует исключительные возможности обобщения как для внешности, так и для движения.

- Обобщение Внешности: Фреймворк MagicDance демонстрирует превосходные возможности при генерации различных внешностей.

- Обобщение Движения: Фреймворк MagicDance также имеет возможность генерировать широкий диапазон движений.

MagicDance : Цели и Архитектура

Для заданного справочного изображения, либо реального человека, либо стилизованного изображения, основной целью фреймворка MagicDance является генерация выходного изображения или видео, условного на входе и входных данных позы {P, F}, где P представляет скелет позы человека, а F представляет ориентиры лица. Сгенерированное выходное изображение или видео должно сохранять внешность и идентификацию человека, участвующего в нем, а также фоновый контент, присутствующий в справочном изображении, сохраняя при этом позу и выражения, определяемые входными данными позы.

Архитектура

Во время обучения фреймворк MagicDance обучается как задача реконструкции кадра для реконструкции фактического выходного изображения с справочным изображением и входными данными позы, полученными из одного и того же справочного видео. Во время тестирования для достижения передачи движения входные данные позы и справочное изображение получаются из разных источников.

Общая архитектура фреймворка MagicDance может быть разделена на четыре категории: Предварительный этап, Предварительное обучение контроля внешности, Дезентанглированный контроль позы и Модуль движения.

Предварительный Этап

Модели диффузии в латентном пространстве или LDM представляют собой уникально разработанные модели диффузии для работы в латентном пространстве, облегченном с помощью автоэнкодера, и фреймворк Stable Diffusion является заметным примером LDM, который использует Векторно-Квантованный-Вариационный автоэнкодер и временную архитектуру U-Net. Фреймворк Stable Diffusion использует трансформер на основе CLIP в качестве текстового кодировщика для обработки текстовых входных данных, преобразуя текстовые входные данные в вложения. Фаза обучения фреймворка Stable Diffusion подвергает модель текстовому условному входному сигналу и входному изображению, причем процесс включает в себя кодирование изображения в латентное представление и подвергает его заранее определенной последовательности шагов диффузии, направляемой гауссовским методом. Результатная последовательность дает шумное латентное представление, обеспечивающее стандартное нормальное распределение, и основной целью обучения фреймворка Stable Diffusion является денойзинг шумных латентных представлений итеративно в латентные представления.

Предварительное Обучение Контроля Внешности

Одной из основных проблем с исходным фреймворком ControlNet является его неспособность контролировать внешность среди пространственно изменяющихся движений последовательно, хотя он и генерирует изображения с позами, близкими к тем, что в входном изображении, при этом общая внешность влияется в основном текстовыми входными данными. Хотя этот метод работает, он не подходит для задач передачи движения, включающих задачи, где не текстовые входные данные, а справочное изображение служит основным источником информации о внешности.

Модуль предварительного обучения контроля внешности в фреймворке MagicDance разработан как вспомогательная ветвь для обеспечения руководства по контролю внешности в подходе слоя за слоем. Вместо того, чтобы полагаться на текстовые входные данные, общий модуль фокусируется на использовании атрибутов внешности из справочного изображения с целью улучшить способность фреймворка генерировать характеристики внешности точно, особенно в сценариях, включающих сложную динамику движения. Кроме того, только Модель Контроля Внешности является обучаемой во время предварительного обучения контроля внешности.

Дезентанглированный Контроль Позы

Наивное решение для контроля позы в выходном изображении заключается в интеграции предварительно обученной модели ControlNet с предварительно обученной Моделью Контроля Внешности напрямую без дообучения. Однако интеграция может привести к тому, что фреймворк будет испытывать трудности с контролем позы, независимым от внешности, что может привести к расхождению между входными позами и сгенерированными позами. Чтобы решить эту проблему, фреймворк MagicDance дообучает модель Pose ControlNet совместно с предварительно обученной Моделью Контроля Внешности.

Модуль Движения

Когда они работают вместе, Дезентанглированный Контроль Позы и Модель Контроля Внешности могут достичь точной и эффективной передачи изображения в движение, хотя это может привести к временной несогласованности. Чтобы обеспечить временную согласованность, фреймворк интегрирует дополнительный модуль движения в основную архитектуру Stable Diffusion UNet.

MagicDance : Предварительное Обучение и Наборы Данных

Для предварительного обучения фреймворк MagicDance использует набор данных TikTok, который состоит из более 350 видео танцев разной длины между 10 и 15 секундами, захватывающих одного человека, танцующего, причем большинство этих видео содержат лицо и верхнюю часть тела человека. Фреймворк MagicDance извлекает каждое отдельное видео с частотой 30 кадров в секунду и запускает OpenPose на каждом кадре отдельно, чтобы сделать вывод о скелете позы, позах рук и ориентирах лица.

Для предварительного обучения модель контроля внешности предварительно обучается с размером партии 64 на 8 NVIDIA A100 GPU за 10 тысяч шагов с размером изображения 512 x 512, за которым следует совместное дообучение модели контроля позы и модели контроля внешности с размером партии 16 за 20 тысяч шагов. Во время обучения фреймворк MagicDance случайным образом выбирает два кадра в качестве целевого и справочного соответственно, причем изображения обрезаются в одном и том же положении и по одной и той же высоте. Во время оценки модель обрезает изображение по центру вместо случайной обрезки.

MagicDance : Результаты

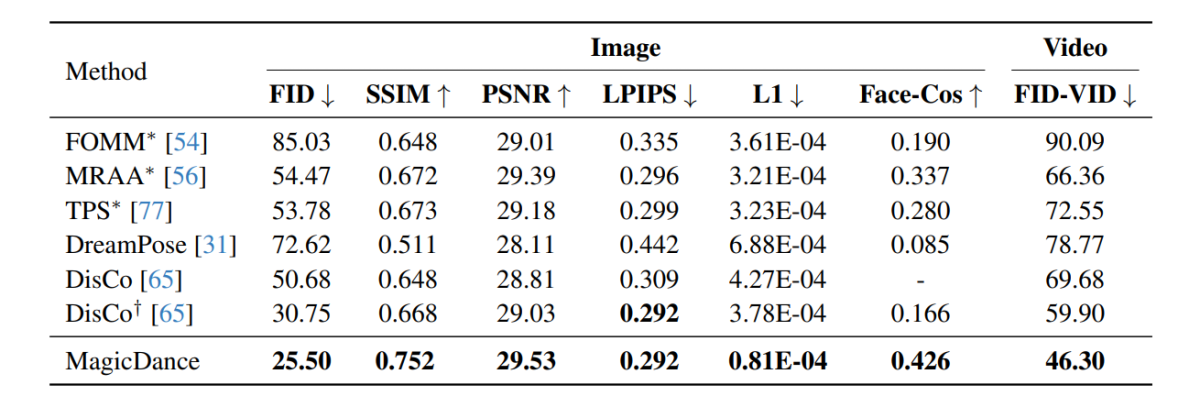

Экспериментальные результаты, проведенные на фреймворке MagicDance, продемонстрированы на следующем изображении, и как можно увидеть, фреймворк MagicDance превосходит существующие фреймворки, такие как Disco и DreamPose, для передачи движения человека во всех метриках. Фреймворки, состоящие из символа “*” перед именем, используют целевое изображение напрямую в качестве входных данных и включают больше информации по сравнению с другими фреймворками.

Интересно отметить, что фреймворк MagicDance достигает балла Face-Cos 0,426, что представляет собой улучшение на 156,62% по сравнению с фреймворком Disco и почти на 400% по сравнению с фреймворком DreamPose. Результаты указывают на прочную способность фреймворка MagicDance сохранять информацию об идентификации и заметный прирост производительности указывает на превосходство фреймворка MagicDance над существующими передовыми методами.

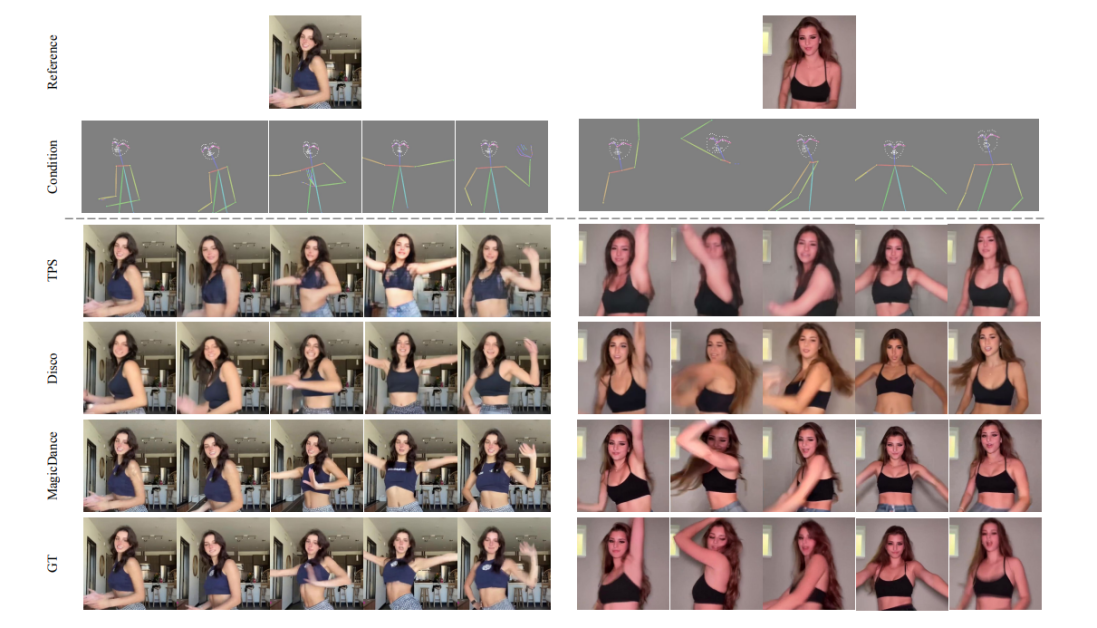

Следующие фигуры сравнивают качество генерации видео человека между фреймворками MagicDance, Disco и TPS. Как можно наблюдать, результаты, сгенерированные фреймворками GT, Disco и TPS, страдают от несоответствия идентификации позы человека и выражений лица.

Кроме того, следующее изображение демонстрирует визуализацию передачи выражения лица и позы человека на наборе данных TikTok, и фреймворк MagicDance способен генерировать реалистичные и яркие выражения и движения под различными ориентирами лица и входными данными скелета позы, сохраняя при этом информацию об идентификации из справочного входного изображения.

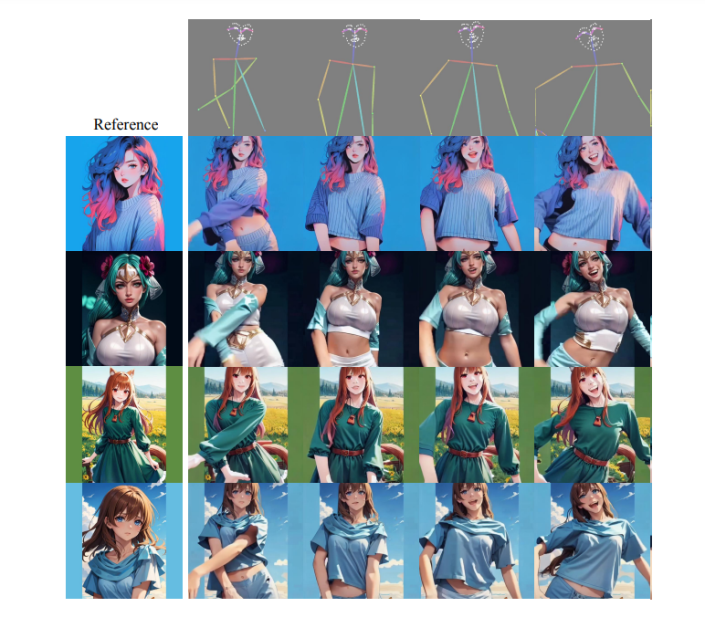

Стоит отметить, что фреймворк MagicDance обладает исключительными возможностями обобщения для изображений-источников из-за области с незнакомыми позами и стилями с впечатляющей контролем внешности даже без дополнительной настройки на целевую область, и результаты продемонстрированы на следующем изображении.

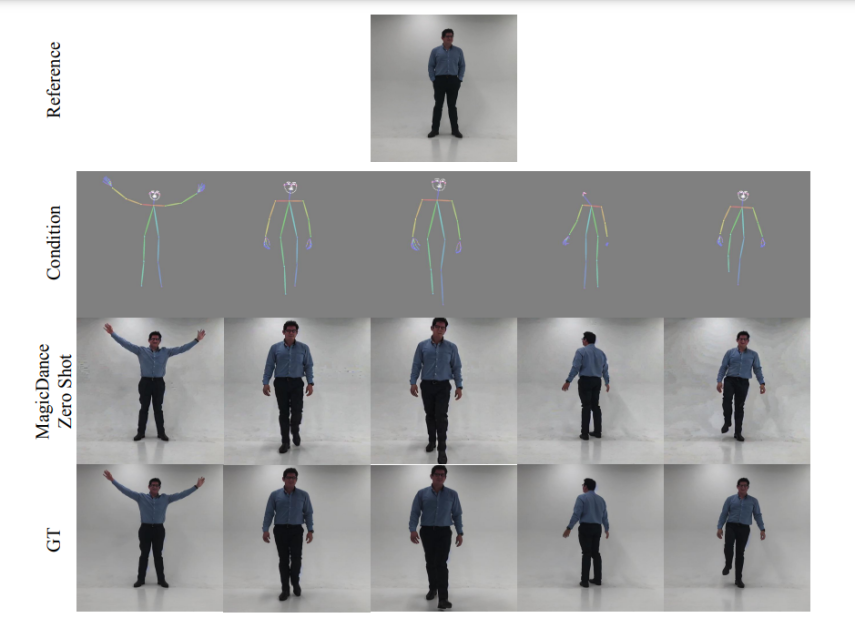

Следующие изображения демонстрируют возможности визуализации фреймворка MagicDance в плане передачи выражения лица и нулевой выстрел человеческого движения. Как можно увидеть, фреймворк MagicDance обобщается до движений человека в дикой природе идеально.

MagicDance : Ограничения

OpenPose является важным компонентом фреймворка MagicDance, поскольку он играет решающую роль в контроле позы, влияя на качество и временную согласованность сгенерированных изображений значительно. Однако фреймворк MagicDance все еще находит это немного сложным для обнаружения ориентиров лица и скелета позы точно, особенно когда объекты на изображениях частично видны или показывают быстрое движение. Эти проблемы могут привести к артефактам в сгенерированном изображении.

Вывод

В этой статье мы говорили о MagicDance, модели на основе диффузии, целью которой является революционизация передачи движения человека. Фреймворк MagicDance пытается перенести 2D выражения лица и движения человека на сложные видео танца человека с конкретной целью генерации новых последовательностей поз, управляемых видео танца человека для конкретных целевых идентификаторов, сохраняя при этом идентификацию постоянной. Фреймворк MagicDance является двухэтапной стратегией обучения для дезентанглирования движения человека и внешности, такой как тон кожи, выражения лица и одежда.

MagicDance – это новый подход к генерации реалистичного видео человека, включающий передачу выражения лица и движения, и обеспечивающий последовательную анимацию в дикой природе без необходимости дополнительной настройки, демонстрирующий значительный прогресс над существующими методами. Кроме того, фреймворк MagicDance демонстрирует исключительные возможности обобщения над сложными последовательностями движений и разнообразными идентификациями человека, устанавливая фреймворк MagicDance в качестве лидера в области передачи движения и генерации видео, ассистируемой ИИ.