Ângulo de Anderson

O Futuro da Geração de Imagens com RAG

Modelos de difusão gerativos, como Stable Diffusion, Flux e modelos de vídeo como Hunyuan, dependem do conhecimento adquirido durante uma única sessão de treinamento intensivo em recursos, utilizando um conjunto de dados fixo. Qualquer conceito introduzido após este treinamento – referido como o corte de conhecimento – está ausente do modelo, a menos que seja suplementado por meio de ajuste fino ou técnicas de adaptação externas, como Adaptação de Baixo Ranco (LoRA).

Seria ideal, portanto, se um sistema gerador que produz imagens ou vídeos pudesse acessar fontes online e incorporá-las no processo de geração conforme necessário. Dessa forma, por exemplo, um modelo de difusão que não sabe nada sobre o último lançamento da Apple ou da Tesla ainda poderia produzir imagens contendo esses novos produtos.

Em relação a modelos de linguagem, a maioria de nós está familiarizada com sistemas como Perplexity, Notebook LM e ChatGPT-4o, que podem incorporar informações externas novas em um modelo de Geração Aumentada por Recuperação (RAG).

Os processos RAG tornam as respostas do ChatGPT 4o mais relevantes. Source: https://chatgpt.com/

No entanto, essa é uma facilidade incomum quando se trata de gerar imagens, e o ChatGPT confessará suas próprias limitações nesse aspecto:

O ChatGPT 4o fez uma boa suposição sobre a visualização de um lançamento de relógio totalmente novo, com base na linha geral e nas descrições que interpretou; mas não pode ‘absorver’ e integrar novas imagens em uma geração baseada no DALL-E.

Incorporar dados recuperados externamente em uma imagem gerada é desafiador porque a imagem de entrada deve primeiro ser dividida em tokens e incorporações, que são então mapeadas para o conhecimento de domínio mais próximo do modelo.

Embora esse processo funcione efetivamente para ferramentas de pós-treinamento, como ControlNet, essas manipulações permanecem em grande parte superficiais, essencialmente canalizando a imagem recuperada por um pipeline de renderização, mas sem integrá-la profundamente na representação interna do modelo.

Como resultado, o modelo carece da capacidade de gerar perspectivas novas da maneira como os sistemas de renderização neural, como NeRF, podem, que constroem cenas com compreensão espacial e estrutural verdadeira.

Lógica Madura

Uma limitação semelhante se aplica a consultas baseadas em RAG em Modelos de Linguagem Grandes (LLMs), como Perplexity. Quando um modelo desse tipo processa dados recuperados externamente, ele funciona muito como um adulto desenhando em uma vida de conhecimento para inferir probabilidades sobre um tópico.

No entanto, assim como uma pessoa não pode integrar retroativamente novas informações no quadro cognitivo que moldou sua visão de mundo fundamental – quando seus preconceitos e pressuposições ainda estavam se formando – um LLM não pode mesclar perfeitamente novos conhecimentos em sua estrutura pré-treinada.

Em vez disso, ele só pode ‘impactar’ ou justapor os novos dados contra seu conhecimento internalizado, usando princípios aprendidos para analisar e conjecturar, em vez de sintetizar no nível fundamental.

Essa falta de equivalência entre justaposto e geração internalizada é provável que seja mais evidente em uma imagem gerada do que em uma geração baseada em linguagem: as conexões de rede mais profundas e a criatividade aumentada da ‘geração nativa’ (em vez de baseada em RAG) foram estabelecidas em vários estudos.

Riscos Ocultos da Geração de Imagens com RAG

Mesmo que fosse tecnicamente viável integrar imagens da internet recuperadas em novas imagens sintetizadas de maneira RAG, limitações relacionadas à segurança apresentariam um desafio adicional.

Muitos conjuntos de dados usados para treinar modelos gerativos foram curados para minimizar a presença de conteúdo explícito, racista ou violento, entre outras categorias sensíveis. No entanto, esse processo é imperfeito, e associações residuais podem persistir. Para mitigar isso, sistemas como DALL·E e Adobe Firefly dependem de mecanismos de filtragem secundários que verificam tanto os prompts de entrada quanto as saídas geradas para conteúdo proibido.

Como resultado, um simples filtro NSFW – que bloqueia principalmente conteúdo explícito – seria insuficiente para avaliar a aceitabilidade dos dados baseados em RAG recuperados. Tal conteúdo ainda poderia ser ofensivo ou prejudicial de maneiras que caem fora dos parâmetros de moderação pré-definidos do modelo, potencialmente introduzindo material que o AI carece de consciência contextual para avaliar adequadamente.

A descoberta de uma vulnerabilidade recente no DeepSeek produzido pelo CCP, projetado para suprimir discussões de conteúdo político proibido, destacou como caminhos de entrada alternativos podem ser explorados para contornar as salvaguardas éticas de um modelo; argumenta-se que isso também se aplica a dados novos e arbitrários recuperados da internet, quando destinados a ser incorporados em uma nova geração de imagens.

RAG para Geração de Imagens

Apesar desses desafios e aspectos políticos espinhosos, vários projetos surgiram que tentam usar métodos baseados em RAG para incorporar dados novos em gerações visuais.

ReDi

O projeto Retrieval-based Diffusion (ReDi) de 2023 é um framework de aprendizado livre que acelera a inferência do modelo de difusão, recuperando trajetórias semelhantes de uma base de conhecimento pré-computada.

Valores de um conjunto de dados podem ser ‘emprestados’ para uma nova geração em ReDi. Source: https://arxiv.org/pdf/2302.02285

No contexto de modelos de difusão, uma trajetória é o caminho passo a passo que o modelo segue para gerar uma imagem a partir de ruído puro. Normalmente, esse processo ocorre gradualmente ao longo de muitos passos, com cada passo refinando a imagem um pouco mais.

ReDi acelera isso, pulando um monte desses passos. Em vez de calcular cada passo, ele recupera uma trajetória semelhante do passado de um banco de dados e pula para um ponto posterior no processo. Isso reduz o número de cálculos necessários, tornando a geração de imagens baseada em difusão muito mais rápida, mantendo a qualidade alta.

ReDi não modifica os pesos do modelo de difusão, mas usa a base de conhecimento para pular etapas intermediárias, reduzindo assim o número de estimativas de função necessárias para amostragem.

Claro, isso não é o mesmo que incorporar imagens específicas à vontade em uma solicitação de geração; mas relaciona-se a tipos semelhantes de geração.

Lançado em 2022, o ano em que os modelos de difusão latente capturaram a imaginação do público, ReDi parece ser uma das primeiras abordagens baseadas em difusão para confiar em uma metodologia RAG.

Embora deva ser mencionado que, em 2021, a Facebook Research lançou Instance-Conditioned GAN, que buscava condicionar imagens GAN em novos dados de imagem, esse tipo de projeção no espaço latente é extremamente comum na literatura, tanto para GANs quanto para modelos de difusão; o desafio é tornar tal processo livre de treinamento e funcional em tempo real, como os métodos RAG focados em LLMs.

RDM

Outra incursão precoce na geração de imagens aumentada por RAG é Retrieval-Augmented Diffusion Models (RDM), que introduz uma abordagem semi-paramétrica para síntese de imagens gerativas. Enquanto modelos de difusão tradicionais armazenam todo o conhecimento visual aprendido dentro de seus parâmetros de rede neural, RDM confia em um banco de dados de imagens externo:

Vizinhos mais próximos recuperados em uma consulta ilustrativa pseudo em RDM*.

Durante o treinamento, o modelo recupera vizinhos mais próximos (imagens visual ou semanticamente semelhantes) do banco de dados externo para guiar o processo de geração. Isso permite que o modelo condicione suas saídas em instâncias visuais do mundo real.

O processo de recuperação é alimentado por incorporações CLIP, projetadas para forçar as imagens recuperadas a compartilhar semelhanças significativas com a consulta, e também para fornecer informações novas para melhorar a geração.

Isso reduz a dependência de parâmetros, facilitando modelos menores que alcançam resultados competitivos sem a necessidade de conjuntos de dados de treinamento extensivos.

A abordagem RDM suporta modificações pós-hoc: os pesquisadores podem trocar o banco de dados no momento da inferência, permitindo adaptação zero-shot para novos estilos, domínios ou até mesmo tarefas completamente diferentes, como síntese condicional de classe ou estilização.

Na parte inferior, vemos os vizinhos mais próximos desenhados no processo de difusão em RDM*.

Uma vantagem-chave de RDM é sua capacidade de melhorar a geração de imagens sem retreinar o modelo. Apenas alterando o banco de dados de recuperação, o modelo pode generalizar para novos conceitos nos quais nunca foi explicitamente treinado. Isso é particularmente útil para aplicações em que deslocamentos de domínio ocorrem, como a geração de imagens médicas com base em conjuntos de dados em evolução, ou adaptar modelos de texto-para-imagem para aplicações criativas.

Negativamente, métodos de recuperação desse tipo dependem da qualidade e relevância do banco de dados externo, o que torna a cura de dados um fator importante para alcançar gerações de alta qualidade; e essa abordagem permanece longe de um equivalente de síntese de imagem baseada em RAG dos tipos de interações RAG típicas em LLMs comerciais.

ReMoDiffuse

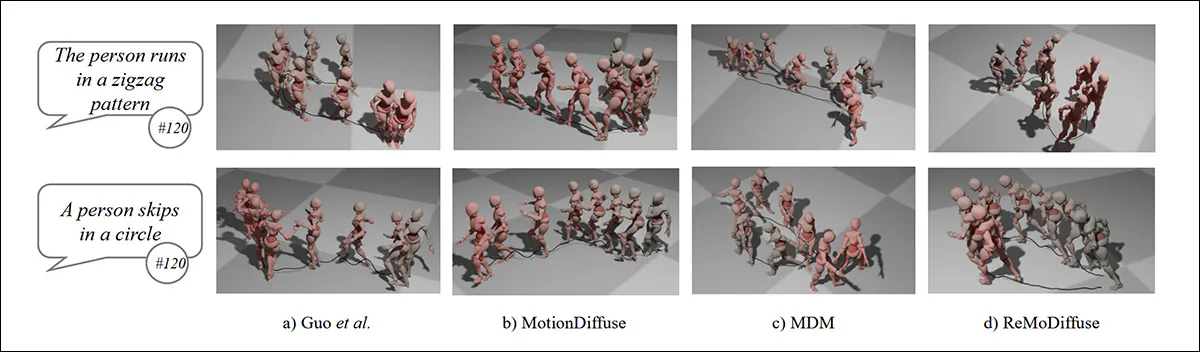

ReMoDiffuse é um modelo de difusão de movimento aumentado por recuperação projetado para geração de movimento humano 3D. Diferentemente de modelos de geração de movimento tradicionais que dependem puramente de representações aprendidas, ReMoDiffuse recupera amostras de movimento relevantes de um grande conjunto de dados de movimento e as integra no processo de desruído, em um esquema semelhante ao RDM (acima).

Comparação do ReMoDiffuse baseado em RAG (à direita) com métodos anteriores. Source: https://arxiv.org/pdf/2304.01116

Isso permite que o modelo gere sequências de movimento projetadas para ser mais naturais e diversificadas, bem como semanticamente fiéis aos prompts de texto do usuário.

ReMoDiffuse usa um mecanismo de recuperação híbrido inovador, que seleciona sequências de movimento com base em semelhanças semânticas e cinemáticas, com a intenção de garantir que os movimentos recuperados sejam não apenas tematicamente relevantes, mas também fisicamente plausíveis quando integrados na nova geração.

O modelo então refina essas amostras recuperadas usando um Transformador Modulado por Semântica, que incorpora seletivamente conhecimento das amostras recuperadas, mantendo as qualidades características da sequência gerada:

Esquema para o pipeline do ReMoDiffuse.

A técnica Mistura de Condição do projeto melhora a capacidade do modelo de generalizar para diferentes prompts e condições de recuperação, equilibrando amostras de movimento recuperadas com prompts de texto durante a geração e ajustando o peso que cada fonte recebe a cada etapa.

Isso pode ajudar a prevenir saídas irrealistas ou repetitivas, mesmo para prompts raros. Também aborda o problema de sensibilidade de escala que frequentemente surge nas técnicas de orientação de classificador livre comumente usadas em modelos de difusão.

RA-CM3

O modelo Retrieval-Augmented Multimodal Language Modeling (RA-CM3) de 2023 da Stanford permite que o sistema acesse informações do mundo real no momento da inferência:

O modelo de Linguagem Multimodal Aumentado por Recuperação (RA-CM3) da Stanford usa imagens recuperadas da internet para aumentar o processo de geração, mas permanece um protótipo sem acesso público. Source: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integra texto e imagens recuperadas no pipeline de geração, melhorando tanto a síntese de texto-para-imagem quanto a imagem-para-texto. Usando CLIP para recuperação e um Transformador como gerador, o modelo se refere a documentos multimodais pertinentes antes de compor uma saída.

Os benchmarks no MS-COCO mostram melhorias notáveis sobre DALL-E e sistemas semelhantes, alcançando uma redução de 12 pontos na Distância de Inception de Fréchet (FID), com um custo computacional muito menor.

No entanto, como em outras abordagens baseadas em recuperação, RA-CM3 não internaliza perfeitamente seu conhecimento recuperado. Em vez disso, ele superpõe novos dados contra sua rede pré-treinada, muito como um LLM aumenta respostas com resultados de busca. Embora esse método possa melhorar a precisão factual, não substitui a necessidade de atualizações de treinamento em domínios onde síntese profunda é necessária.

Além disso, uma implementação prática desse sistema não parece ter sido lançada, mesmo em uma plataforma baseada em API.

RealRAG

Um lançamento recente da China, e o que provocou esta olhada nos sistemas geradores de imagem com RAG, é chamado Geração de Imagem Realista Aumentada por Recuperação (RealRAG).

Imagens externas desenhadas no RealRAG (meio inferior). Source: https://arxiv.o7rg/pdf/2502.00848

RealRAG recupera imagens reais de objetos relevantes de um banco de dados curado a partir de conjuntos de dados publicamente disponíveis, como ImageNet, Stanford Cars, Stanford Dogs e Oxford Flowers. Em seguida, ele integra as imagens recuperadas no processo de geração, abordando lacunas de conhecimento no modelo.

Um componente-chave de RealRAG é o aprendizado de contraste auto-reflexivo, que treina um modelo de recuperação para encontrar imagens de referência informativas, em vez de apenas selecionar visualmente semelhantes.

Os autores afirmam:

‘Nossa principal percepção é treinar um recuperador que recupera imagens que permanecem fora do espaço de geração do gerador, mas próximas à representação dos prompts de texto.

‘Para isso, primeiro geramos imagens a partir dos prompts de texto dados e, em seguida, utilizamos as imagens geradas como consultas para recuperar as imagens mais relevantes no banco de dados baseado em objetos reais. Essas imagens mais relevantes são utilizadas como negativos reflexivos.’

Essa abordagem garante que as imagens recuperadas contribuam conhecimento perdido para o processo de geração, em vez de reforçar vieses existentes no modelo.

À esquerda, a imagem de referência recuperada; centro, sem RAG; à direita, com o uso da imagem recuperada.

No entanto, a dependência da qualidade da recuperação e da cobertura do banco de dados significa que sua eficácia pode variar dependendo da disponibilidade de referências de alta qualidade. Se uma imagem relevante não existe no conjunto de dados, o modelo ainda pode lutar com conceitos desconhecidos.

RealRAG é uma arquitetura muito modular, oferecendo compatibilidade com várias outras arquiteturas gerativas, incluindo U-Net baseado, DiT baseado e modelos autoregressivos.

Em geral, a recuperação e processamento de imagens externas adicionam sobrecarga computacional, e o desempenho do sistema depende de como bem o mecanismo de recuperação generaliza em diferentes tarefas e conjuntos de dados.

Conclusão

Esta é uma visão geral representativa, em vez de exaustiva, de sistemas geradores multimodais que recuperam imagens. Alguns sistemas desse tipo usam recuperação apenas para melhorar a compreensão da visão ou a cura de conjuntos de dados, entre outros motivos diversos, em vez de buscar gerar imagens. Um exemplo é Internet Explorer.

Muitos dos outros projetos baseados em RAG na literatura permanecem sem lançamento. Protótipos, com apenas pesquisa publicada, incluem Re-Imagen, que – apesar de sua proveniência do Google – só pode acessar imagens de um banco de dados personalizado local.

Além disso, em novembro de 2024, a Baidu anunciou Geração Aumentada por Recuperação de Imagens (iRAG), uma nova plataforma que usa imagens recuperadas ‘de um banco de dados’. Embora iRAG seja relatado como disponível na plataforma Ernie, não parece haver mais detalhes sobre o processo de recuperação, que parece depender de um banco de dados local (ou seja, local para o serviço e não diretamente acessível ao usuário).

Além disso, o artigo de 2024 Geração de Imagem de Texto Unificada e Recuperação oferece mais um método baseado em RAG para usar imagens externas para aumentar os resultados no momento da geração – novamente, de um banco de dados local, em vez de fontes ad hoc da internet.

O entusiasmo em torno da ampliação baseada em RAG na geração de imagens provavelmente se concentrará em sistemas que possam incorporar imagens provenientes da internet ou carregadas pelo usuário diretamente no processo gerativo e que permitam que os usuários participem das escolhas ou fontes de imagens.

No entanto, isso é um desafio significativo por pelo menos duas razões; primeiro, porque a eficácia de tais sistemas geralmente depende de relações profundamente integradas formadas durante um processo de treinamento intensivo em recursos; e segundo, porque preocupações sobre segurança, legalidade e restrições de direitos autorais, como mencionado anteriormente, tornam essa uma característica improvável para um serviço baseado em API e para implantação comercial em geral.

* Source: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Publicado pela primeira vez na terça-feira, 4 de fevereiro de 2025