Vigilância

Rostos Sintéticos ‘Degradados’ Podem Ajudar a Melhorar o Reconhecimento de Imagens Faciais

Pesquisadores da Universidade Estadual de Michigan criaram uma maneira para que rostos sintéticos possam tirar um tempo da cena de deepfakes e fazer o bem no mundo – ajudando os sistemas de reconhecimento de imagens a se tornarem mais precisos.

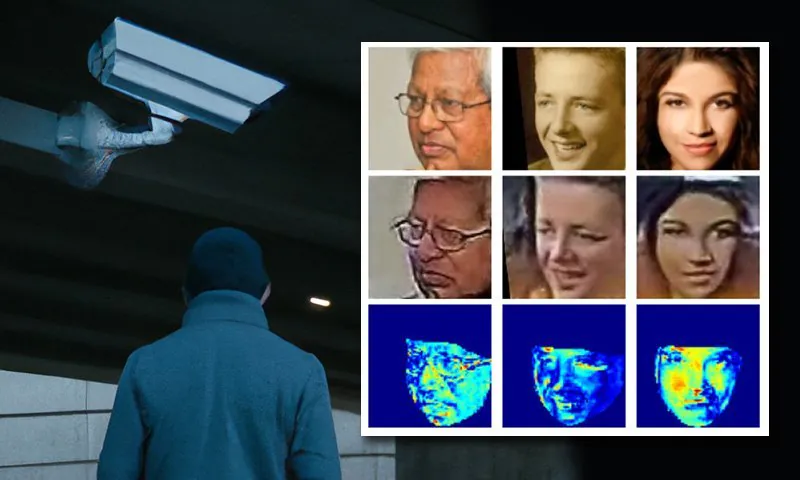

O novo módulo de síntese de faces controlável (CFSM) que eles criaram é capaz de regenerar faces no estilo de footage de vigilância de vídeo do mundo real, em vez de confiar nas imagens de qualidade uniformemente mais alta usadas em conjuntos de dados de código aberto populares de celebridades, que não refletem todos os defeitos e limitações dos sistemas de CCTV genuínos, como borramento facial, baixa resolução e ruído do sensor – fatores que podem afetar a precisão do reconhecimento.

Arquitetura conceitual para o Módulo de Síntese de Faces Controlável (CFSM). Fonte: http://cvlab.cse.msu.edu/pdfs/Liu_Kim_Jain_Liu_ECCV2022.pdf

CFSM não é destinado especificamente a simular autenticamente poses de cabeça, expressões ou todos os outros traços usuais que são o objetivo dos sistemas de deepfakes, mas sim para gerar uma variedade de vistas alternativas no estilo do sistema de reconhecimento de destino, usando transferência de estilo.

O sistema é projetado para imitar o domínio de estilo do sistema de destino e adaptar sua saída de acordo com a resolução e a gama de ‘excentricidades’ existentes. O caso de uso inclui sistemas legados que não são prováveis de serem atualizados devido ao custo, mas que atualmente podem contribuir pouco para a nova geração de tecnologias de reconhecimento facial, devido à baixa qualidade da saída que pode ter sido de ponta uma vez.

Testando o sistema, os pesquisadores descobriram que ele fez ganhos notáveis no estado da arte em sistemas de reconhecimento de imagens que têm que lidar com esse tipo de dados ruidosos e de baixa qualidade.

Treinando os modelos de reconhecimento facial para se adaptar às limitações dos sistemas de destino. Fonte: http://cvlab.cse.msu.edu/pdfs/Liu_Kim_Jain_Liu_ECCV2022_supp.pdf

Eles também descobriram um subproduto útil do processo – que os conjuntos de dados de destino agora podiam ser caracterizados e comparados entre si, tornando a comparação, benchmarking e geração de conjuntos de dados personalizados para sistemas de CCTV variados mais fáceis no futuro.

Além disso, o método pode ser aplicado a conjuntos de dados existentes, realizando de facto adaptação de domínio e tornando-os mais adequados para sistemas de reconhecimento facial.

O novo artigo é intitulado Síntese de Faces Controlável e Orientada para Reconhecimento Facial Irrestrito, é apoiado em parte pelo Escritório do Diretor de Inteligência Nacional dos EUA (ODNI, no IARPA), e vem de quatro pesquisadores do Departamento de Ciência e Engenharia de Computação da MSU.

Conteúdo em Destaque

O reconhecimento de faces de baixa qualidade (LQFR) se tornou uma área de estudo notável nos últimos anos. Porque as autoridades civis e municipais construíram sistemas de vigilância de vídeo para serem resilientes e duradouros (não querendo realocar recursos para o problema periodicamente), muitas redes de vigilância ‘legadas’ se tornaram vítimas de dívida técnica, em termos de sua adaptabilidade como fontes de dados para aprendizado de máquina.

Níveis variados de resolução facial em uma variedade de sistemas de vigilância de vídeo históricos e mais recentes. Fonte: https://arxiv.org/pdf/1805.11519.pdf

Felizmente, este é uma tarefa que os modelos de difusão e outros modelos baseados em ruído são excepcionalmente bem adaptados para resolver. Muitos dos sistemas de síntese de imagens mais populares e eficazes dos últimos anos realizam upscale de imagens de baixa resolução como parte de seu pipeline, enquanto isso também é absolutamente essencial para técnicas de compressão neural (métodos para salvar imagens e filmes como dados neurais em vez de dados bitmap).

Parte do desafio do reconhecimento facial é obter a precisão máxima possível a partir do número mínimo de recursos que podem ser extraídos das imagens de baixa resolução menores e menos promissoras. Essa restrição existe não apenas porque é útil ser capaz de identificar (ou criar) uma face em baixa resolução, mas também devido a limitações técnicas sobre o tamanho das imagens que podem passar pelo espaço latente emergente de um modelo que está sendo treinado em qualquer VRAM disponível em uma GPU local.

Nesse sentido, o termo ‘recursos’ é confuso, desde que tais recursos também podem ser obtidos a partir de um conjunto de dados de bancos de parque. No setor de visão computacional, ‘recursos’ se refere às características distintivas obtidas a partir de imagens – qualquer imagem, seja a linha de um templo, uma montanha ou a disposição de recursos faciais em um conjunto de dados de faces.

Como os algoritmos de visão computacional agora são hábeis em upscale de imagens e vídeos, vários métodos foram propostos para ‘melhorar’ material de vigilância legado degradado ou de baixa resolução, ao ponto que pode ser possível usar tais aumentos para fins legais, como colocar uma pessoa específica em uma cena, em relação a uma investigação de crime.

Além da possibilidade de erro de identificação, que ocasionalmente reuniu manchetes, na teoria não deve ser necessário hiper-resolver ou transformar imagens de baixa resolução para fazer uma identificação positiva de um indivíduo, desde que um sistema de reconhecimento facial que se concentra em recursos de baixo nível não precise daquele nível de resolução e clareza. Além disso, tais transformações são caras na prática e levantam questões adicionais, recorrentes sobre sua validade e legalidade potenciais.

A Necessidade de Mais ‘Celebrities de Baixo Nível’

Seria mais útil se um sistema de reconhecimento facial pudesse derivar recursos (ou seja, recursos de aprendizado de máquina de recursos humanos) a partir da saída de sistemas legados como estão, entendendo melhor a relação entre ‘alta resolução’ de identidade e as imagens degradadas que estão disponíveis em estruturas de vigilância de vídeo implacáveis e frequentemente irremovíveis.

O problema aqui é um de padrões: conjuntos de dados comuns coletados na web, como MS-Celeb-1M e WebFace260M (entre vários outros), foram fixados pela comunidade de pesquisa porque fornecem benchmarks consistentes contra os quais os pesquisadores podem medir seu progresso incremental ou significativo em relação ao estado atual da arte.

Exemplos do conjunto de dados MS-Celeb1m popular da Microsoft. Fonte: https://www.microsoft.com/en-us/research/project/ms-celeb-1m-challenge-recognizing-one-million-celebrities-real-world/

No entanto, os autores argumentam que algoritmos de reconhecimento facial (FR) treinados nesses conjuntos de dados são material inadequado para os ‘domínios’ visuais da saída de muitos sistemas de vigilância mais antigos.

O artigo afirma*:

‘[Estado da arte] (SoTA) modelos FR não funcionam bem em imagens de vigilância do mundo real (irrestritas) devido ao problema de mudança de domínio, ou seja, os grandes conjuntos de dados de treinamento (semi-restritos) obtidos via faces de celebridades coletadas na web carecem de variações in situ, como ruído inerente do sensor, baixa resolução, borramento de movimento, efeito de turbulência, etc.

‘Por exemplo, a precisão de verificação 1:1 relatada por um dos modelos SoTA no conjunto de dados IJB-S irrestrito é cerca de 30% menor do que no conjunto de dados LFW semi-restrito.

‘Uma solução potencial para essa lacuna de desempenho é montar um grande conjunto de dados de faces irrestritas. No entanto, construir tal conjunto de dados de treinamento com dezenas de milhares de sujeitos é proibitivamente difícil com alto custo de rotulagem manual.’

O artigo relata vários métodos anteriores que tentaram ‘combinar’ os tipos variados de saídas de sistemas de vigilância históricos ou de baixo custo, mas nota que esses lidaram com ‘aumentos cegos’. Em contraste, o CFSM recebe feedback direto da saída do mundo real do sistema de destino durante o treinamento e se adapta por meio de transferência de estilo para imitar esse domínio.

A atriz Natalie Portman, não estranha ao punhado de conjuntos de dados que dominam a comunidade de visão computacional, é apresentada entre as identidades neste exemplo do CFSM realizando adaptação de domínio estilo-matched com base no feedback do domínio do modelo de destino real.

A arquitetura projetada pelos autores utiliza o Método de Sinal de Gradiente Rápido (FGSM) para individuar e ‘importar’ os estilos e características obtidos a partir da saída real do sistema de destino. A parte do pipeline dedicada à geração de imagens subsequentemente melhorará e se tornará mais fiel ao sistema de destino com o treinamento. Esse feedback do espaço de estilo de baixa dimensionalidade do sistema de destino é de natureza de baixo nível e corresponde aos descritores visuais derivados mais amplos.

Os autores comentam:

‘Com o feedback do modelo FR, as imagens sintetizadas são mais benéficas para o desempenho do FR, levando a capacidades de generalização significativamente melhoradas dos modelos FR treinados com elas.’

Testes

Os pesquisadores usaram o trabalho anterior da MSU como um modelo para testar seu sistema. Com base nos mesmos protocolos experimentais, eles usaram o MS-Celeb-1m, que consiste exclusivamente em fotografias de celebridades coletadas na web, como o conjunto de dados de treinamento rotulado. Para justiça, eles também incluíram o MS1M-V2, que contém 3,9 milhões de imagens com 85.700 classes.

Os dados de destino foram o conjunto de dados WiderFace, da Universidade Chinesa de Hong Kong. Este é um conjunto de imagens particularmente diverso projetado para tarefas de detecção de faces em situações desafiadoras. 70.000 imagens deste conjunto foram usadas.

Para avaliação, o sistema foi testado contra quatro benchmarks de reconhecimento facial: IJB-B, IJB-C, IJB-S e TinyFace.

O CFSM foi treinado com ∼10% dos dados de treinamento do MS-Celeb-1m, cerca de 0,4 milhão de imagens, por 125.000 iterações com um tamanho de lote de 32 sob o otimizador Adam com uma taxa de aprendizado muito baixa de 1e-4.

O modelo de reconhecimento facial de destino usou uma modificação do ResNet-50 para a espinha dorsal, com a função de perda ArcFace habilitada durante o treinamento. Além disso, um modelo foi treinado com o CFSM como uma ablação e exercício comparativo (notado como ‘ArcFace’ na tabela de resultados abaixo).

Os autores comentam sobre os resultados principais:

‘O modelo ArcFace supera todos os benchmarks em tarefas de identificação e verificação de faces e alcança um novo desempenho SoTA.’

A capacidade de extrair domínios das várias características de sistemas de vigilância legados ou subespecificados também permite que os autores comparem e avaliem a similaridade de distribuição entre esses frameworks e apresentem cada sistema em termos de um estilo visual que poderia ser aproveitado em trabalhos subsequentes.

Os autores observam adicionalmente que seu sistema poderia fazer uso proveitoso de algumas tecnologias que, até o momento, foram vistas apenas como problemas a serem resolvidos pela comunidade de pesquisa e visão:

‘[CFSM] mostra que a manipulação adversária pode ir além de ser um atacante e servir para aumentar a precisão do reconhecimento em tarefas de visão. Enquanto isso, definimos uma métrica de similaridade de conjunto de dados com base nas bases de estilo aprendidas, que capturam as diferenças de estilo de uma maneira agnóstica de rótulo ou preditor.’

‘Acreditamos que nossa pesquisa apresentou o poder de um modelo de síntese de faces controlável e orientado para reconhecimento facial irrestrito e forneceu uma compreensão das diferenças de conjunto de dados.’

* Minha conversão das citações em linha dos autores para links.

Publicado pela primeira vez em 1º de agosto de 2022.