Inteligência artificial

Um Cartel de Conjuntos de Dados Influentes Está Dominando a Pesquisa de Aprendizado de Máquina, Sugere um Novo Estudo

Um novo artigo da Universidade da Califórnia e da Google Research descobriu que um pequeno número de conjuntos de dados de “referência” de aprendizado de máquina, em grande parte de instituições ocidentais influentes, e frequentemente de organizações governamentais, estão cada vez mais dominando o setor de pesquisa de IA.

Os pesquisadores concluem que essa tendência de “padrão” para conjuntos de dados de código aberto altamente populares, como ImageNet, levanta uma série de preocupações práticas, éticas e até políticas.

Entre suas descobertas – baseadas em dados centrais do projeto comunitário liderado pelo Facebook Papers With Code (PWC) – os autores argumentam que ‘conjuntos de dados amplamente utilizados são introduzidos por apenas um punhado de instituições de elite’, e que essa ‘consolidação’ aumentou para 80% nos últimos anos.

‘[Nós] descobrimos que há uma crescente desigualdade no uso de conjuntos de dados globalmente, e que mais de 50% de todos os usos de conjuntos de dados em nossa amostra de 43.140 correspondem a conjuntos de dados introduzidos por doze instituições de elite, principalmente ocidentais.’

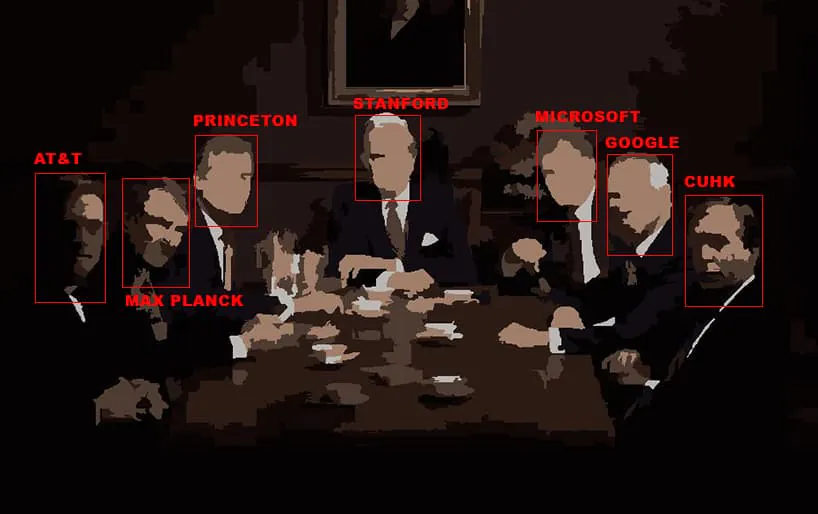

Um mapa de usos de conjuntos de dados não específicos de tarefa nos últimos dez anos. Critérios para inclusão são onde a instituição ou empresa representa mais de 50% dos usos conhecidos. À direita, é mostrado o coeficiente de Gini para a concentração de conjuntos de dados ao longo do tempo para instituições e conjuntos de dados. Fonte: https://arxiv.org/pdf/2112.01716.pdf

As instituições dominantes incluem a Universidade de Stanford, Microsoft, Princeton, Facebook, Google, o Instituto Max Planck e AT&T. Quatro das dez principais fontes de conjuntos de dados são instituições corporativas.

O artigo também caracteriza o crescente uso desses conjuntos de dados de elite como ‘um veículo para a desigualdade na ciência’. Isso ocorre porque as equipes de pesquisa que buscam aprovação da comunidade estão mais motivadas a alcançar resultados de estado-da-arte (SOTA) contra um conjunto de dados consistente do que a gerar conjuntos de dados originais que não têm esse status, e que exigiriam que os pares se adaptassem a novas métricas em vez de índices padrão.

Em qualquer caso, como o artigo reconhece, criar o próprio conjunto de dados é uma empreitada proibitivamente cara para instituições e equipes menos bem equipadas.

‘A prima facie validade científica concedida pela avaliação de referência SOTA é genericamente confundida com a credibilidade social que os pesquisadores obtêm ao mostrar que podem competir em um conjunto de dados amplamente reconhecido, mesmo que um benchmark mais específico de contexto possa ser tecnicamente mais apropriado.

‘Nós defendemos que essas dinâmicas criam um “Efeito Mateus” (ou seja, “os ricos ficam mais ricos e os pobres ficam mais pobres”) onde benchmarks bem-sucedidos, e as instituições de elite que os introduzem, ganham estatura desproporcional dentro do campo.

O artigo é intitulado Reduzido, Reutilizado e Reciclado: A Vida de um Conjunto de Dados em Pesquisa de Aprendizado de Máquina, e vem de Bernard Koch e Jacob G. Foster da UCLA, e Emily Denton e Alex Hanna da Google Research.

O trabalho levanta uma série de questões com a tendência crescente de consolidação que documenta, e foi recebido com aprovação geral na Open Review. Um revisor do NeurIPS 2021 comentou que o trabalho é ‘extremamente relevante para qualquer pessoa envolvida em pesquisa de aprendizado de máquina.’ e previu sua inclusão como leitura obrigatória em cursos universitários.

De Necessidade a Corrupção

Os autores observam que a cultura atual de ‘superar o benchmark’ surgiu como uma solução para a falta de ferramentas de avaliação objetiva que causou o colapso do interesse e do investimento em IA pela segunda vez há mais de trinta anos, após o declínio do entusiasmo empresarial em relação a novas pesquisas em ‘Sistemas Especialistas’:

‘Benchmarks tipicamente formalizam uma tarefa específica por meio de um conjunto de dados e uma métrica quantitativa de avaliação. A prática foi originalmente introduzida à pesquisa de aprendizado de máquina após o “Inverno de IA” dos anos 80 por financiadores governamentais, que buscavam avaliar mais precisamente o valor recebido em subvenções.’

O artigo argumenta que as vantagens iniciais dessa cultura informal de padronização (reduzindo barreiras à participação, métricas consistentes e oportunidades de desenvolvimento mais ágeis) estão começando a ser superadas pelas desvantagens que naturalmente ocorrem quando um corpo de dados se torna poderoso o suficiente para efetivamente definir seus ‘termos de uso’ e escopo de influência.

Os autores sugerem, em linha com muito pensamento recente da indústria e da academia sobre o assunto, que a comunidade de pesquisa não mais apresenta problemas novos se esses não puderem ser abordados por meio de conjuntos de dados de referência existentes.

Eles também observam que a adesão cega a esse pequeno número de ‘conjuntos de dados de ouro’ encoraja os pesquisadores a alcançar resultados que são superajustados (ou seja, que são específicos do conjunto de dados e não têm probabilidade de funcionar quase tão bem em dados do mundo real, em novos conjuntos de dados acadêmicos ou originais, ou mesmo necessariamente em diferentes conjuntos de dados no ‘padrão de ouro’).

‘Dada a alta concentração de pesquisa em um pequeno número de conjuntos de dados de referência, acreditamos que diversificar formas de avaliação é especialmente importante para evitar o superajuste a conjuntos de dados existentes e a má representação do progresso no campo.’

Influência do Governo na Pesquisa de Visão Computacional

De acordo com o artigo, a pesquisa de Visão Computacional é notavelmente mais afetada pela síndrome que descreve do que outros setores, com os autores observando que a pesquisa de Processamento de Linguagem Natural (NLP) é muito menos afetada. Os autores sugerem que isso pode ocorrer porque as comunidades de NLP são ‘mais coerentes’ e maiores em tamanho, e porque os conjuntos de dados de NLP são mais acessíveis e fáceis de curar, bem como menores e menos intensivos em recursos em termos de coleta de dados.

Na Visão Computacional, e particularmente em relação a conjuntos de dados de Reconhecimento Facial (RF), os autores argumentam que os interesses corporativos, estatais e privados frequentemente colidem:

‘Instituições corporativas e governamentais têm objetivos que podem entrar em conflito com a privacidade (por exemplo, vigilância), e o peso dessas prioridades é provavelmente diferente daquele mantido por acadêmicos ou partes interessadas mais amplas da IA.’

Para tarefas de reconhecimento facial, os pesquisadores encontraram que a incidência de conjuntos de dados puramente acadêmicos cai dramaticamente em relação à média:

‘[Quatro] dos oito conjuntos de dados (33,69% do total de usos) foram exclusivamente financiados por corporações, o exército dos EUA ou o governo chinês (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). O MS-Celeb-1M foi finalmente retirado devido à controvérsia em torno do valor da privacidade para diferentes partes interessadas.’

Os principais conjuntos de dados usados nas comunidades de pesquisa de Geração de Imagens e Reconhecimento Facial.

Nesse gráfico, como os autores observam, também vemos que o campo relativamente recente de Geração de Imagens (ou Síntese de Imagens) depende fortemente de conjuntos de dados existentes e muito mais antigos que não foram destinados a esse uso.

De fato, o artigo observa uma tendência crescente para a ‘migração’ de conjuntos de dados para longe de seu propósito pretendido, questionando sua adequação para as necessidades de novos ou setores de pesquisa externos, e a extensão com que as restrições orçamentárias podem estar ‘genéricas’ no escopo das ambições dos pesquisadores para o quadro mais estreito fornecido tanto pelos materiais disponíveis quanto por uma cultura tão obcecada com classificações de benchmark ano a ano que conjuntos de dados novos têm dificuldade em ganhar tração.

‘Nossas descobertas também indicam que conjuntos de dados regularmente se transferem entre diferentes comunidades de tarefas. No extremo mais extremo, a maioria dos conjuntos de dados de referência em circulação para algumas comunidades de tarefas foi criada para outras tarefas.’

Quanto aos luminares do aprendizado de máquina (incluindo Andrew Ng) que têm cada vez mais defendido mais diversidade e curadoria de conjuntos de dados nos últimos anos, os autores apoiam o sentimento, mas acreditam que esse tipo de esforço, mesmo que bem-sucedido, pode potencialmente ser prejudicado pela dependência atual da cultura em resultados SOTA e conjuntos de dados estabelecidos:

‘Nossa pesquisa sugere que simplesmente chamar os pesquisadores de ML para desenvolver mais conjuntos de dados, e alterar as estruturas de incentivo para que o desenvolvimento de conjuntos de dados seja valorizado e recompensado, pode não ser suficiente para diversificar o uso de conjuntos de dados e as perspectivas que estão, em última análise, moldando e definindo as agendas de pesquisa de MLR.

‘Além de incentivar o desenvolvimento de conjuntos de dados, defendemos intervenções políticas orientadas para a equidade que priorizem um financiamento significativo para pessoas em instituições menos equipadas para criar conjuntos de dados de alta qualidade. Isso diversificaria — de uma perspectiva social e cultural — os conjuntos de dados de referência usados para avaliar métodos de ML modernos.’

6 de dezembro de 2021, 16h49min GMT+2 – Corrigido possessivo no título. – MA