Inteligência artificial

MINT-1T: Escalando Dados Multimodais de Código Aberto por 10x

O treinamento de grandes modelos multimodais (LMMs) de ponta requer conjuntos de dados em larga escala com sequências entrelaçadas de imagens e texto em forma livre. Embora os LMMs de código aberto tenham evoluído rapidamente, ainda há uma grande falta de conjuntos de dados multimodais entrelaçados em escala que sejam de código aberto. A importância desses conjuntos de dados não pode ser superestimada, pois eles formam a base para a criação de sistemas de IA avançados capazes de entender e gerar conteúdo em diferentes modalidades. Sem um suprimento suficiente de conjuntos de dados entrelaçados abrangentes, o potencial para desenvolver LMMs mais sofisticados e capazes é significativamente prejudicado. Esses conjuntos de dados permitem que os modelos aprendam com uma ampla gama de entradas, tornando-os mais versáteis e eficazes em várias aplicações. Além disso, a escassez de tais conjuntos de dados apresenta um desafio para a comunidade de código aberto, que depende de recursos compartilhados para impulsionar a inovação e a colaboração.

Os LMMs de código aberto fizeram grandes progressos nos últimos anos, mas seu crescimento é prejudicado pela limitada disponibilidade de conjuntos de dados multimodais entrelaçados em larga escala. Para superar esse obstáculo, esforços concertados são necessários para curar, anotar e liberar conjuntos de dados mais abrangentes que possam apoiar o desenvolvimento e aprimoramento contínuo de modelos multimodais. Além disso, a criação e disseminação desses conjuntos de dados envolvem superar várias barreiras técnicas e logísticas. A coleta de dados deve ser extensiva e representativa dos contextos diversos nos quais os LMMs serão implantados. A anotação requer consideração cuidadosa para garantir que as sequências entrelaçadas de imagens e texto estejam alinhadas de maneira que melhore as capacidades de aprendizado do modelo. Além disso, garantir que os conjuntos de dados sejam de código aberto envolve lidar com considerações legais e éticas relacionadas à privacidade de dados e direitos de uso. Expandir a disponibilidade de conjuntos de dados multimodais entrelaçados de alta qualidade e em larga escala é essencial para o futuro da pesquisa e desenvolvimento de IA. Ao abordar a escassez atual, a comunidade de IA pode fomentar uma maior inovação e colaboração, levando à criação de LMMs mais poderosos e versáteis capazes de lidar com problemas complexos e do mundo real.

Partindo dessa nota, MINT-1T, o maior e mais diverso conjunto de dados multimodais entrelaçados de código aberto até o momento. MINT-1T: Uma escala 10x maior, incluindo um trilhão de tokens de texto e 3,4 bilhões de imagens do que os conjuntos de dados de código aberto existentes. O conjunto de dados MINT-1T também introduz fontes nunca expostas, como arquivos PDF e artigos do ArXiv. Como os conjuntos de dados multimodais entrelaçados não escalonam facilmente, é importante que o conjunto de dados MINT-1T compartilhe o processo de cura de dados para que outros também possam realizar experimentos com essas variantes ricas em informações. O conjunto de dados MINT-1T demonstra que seu método; modelos de linguagem treinados em MINT-1T são competitivos (embora um pouco) com o estado da arte anterior, OBELICS.

MINT-1T: Um Conjunto de Dados Multimodal com Um Trilhão de Tokens

Conjuntos de dados de pré-treinamento de código aberto em larga escala foram fundamentais para a comunidade de pesquisa em explorar a engenharia de dados e treinar modelos transparentes e de código aberto. No domínio do texto, trabalhos iniciais como C4 e The Pile desempenharam papéis cruciais ao permitir que a comunidade treinasse o primeiro conjunto de modelos de linguagem grandes de código aberto, como GPT-J, GPT-Neo e outros. Esses esforços fundamentais também pavimentaram o caminho para melhorias subsequentes nos métodos de filtragem de dados e escalonamento. Da mesma forma, no espaço de imagem e texto, conjuntos de dados de código aberto em larga escala impulsionaram inovações em métodos de cura de dados melhores, como redes de filtragem de dados e T-MARS. Há uma mudança notável das laboratórios de ponta para o treinamento de grandes modelos multimodais (LMMs) que requerem conjuntos de dados multimodais entrelaçados extensivos compostos por sequências livres de imagens e texto. À medida que as capacidades dos modelos de ponta avançam rapidamente, uma lacuna significativa está surgindo nos dados de treinamento multimodal entre modelos de código aberto e fechado. Os conjuntos de dados multimodais entrelaçados de código aberto atuais são menores e menos diversificados do que seus contrapartes apenas de texto, sendo principalmente extraídos de documentos HTML, o que limita a amplitude e variedade dos dados. Essa limitação impede o desenvolvimento de LMMs de código aberto robustos e cria uma disparidade entre as capacidades dos modelos de código aberto e fechado.

Para abordar essa lacuna, MINT-1T foi criado como o maior e mais diverso conjunto de dados multimodais entrelaçados de código aberto até o momento. MINT-1T contém um total de um trilhão de tokens de texto e três bilhões de imagens, extraídos de origens diversas, como HTML, PDFs e ArXiv. Antes de MINT-1T, o maior conjunto de dados de código aberto nessa área era OBELICS, que incluía 115 bilhões de tokens de texto e 353 milhões de imagens, todas extraídas de HTML.

As contribuições de MINT-1T são as seguintes:

- Engenharia de Dados: Escalonar esses dados multimodais entrelaçados apresenta mais um desafio de engenharia do que construir conjuntos de dados apenas de texto ou pares de imagem e texto. Lidar com tamanhos de documentos muito maiores e preservar a ordem original de imagens e texto é crucial.

- Diversidade: MINT-1T é o primeiro no espaço de dados multimodais entrelaçados a reunir documentos multimodais de alta qualidade em larga escala de fontes como CommonCrawl PDFs e ArXiv.

- Experimentos de Modelo: Experimentos mostram que LMMs treinados em MINT-1T não apenas igualam, mas potencialmente superam o desempenho de modelos treinados no melhor conjunto de dados de código aberto existente, OBELICS, enquanto oferecem um aumento de dez vezes na escala.

MINT-1T: Construindo o Conjunto de Dados

MINT-1T cura um conjunto de dados de código aberto em larga escala que utiliza fontes mais diversificadas de documentos entrelaçados, como PDFs e artigos do ArXiv. Esta seção detalha os métodos de MINT-1T para fontes de documentos multimodais, filtragem de conteúdo de baixa qualidade, deduplicação de dados e remoção de material não seguro para o trabalho ou NSFW e indesejável. O conjunto de dados final compreende 922 bilhões (B) de tokens HTML, 106B de tokens PDF e 9B de tokens ArXiv.

Fontes de Grande Quantidade de Documentos Multimodais

Pipeline HTML

MINT-1T segue o método de OBELICS para extrair documentos multimodais entrelaçados de arquivos WARC do CommonCrawl, analisando a árvore DOM de cada entrada WARC. Embora OBELICS tenha processado apenas documentos de dumps do CommonCrawl de fevereiro de 2020 a fevereiro de 2023, MINT-1T expandiu o pool de documentos para incluir documentos HTML de maio de 2017 a abril de 2024 (com dumps completos de outubro de 2018 a abril de 2024 e dumps parciais de anos anteriores). Semelhante a OBELICS, MINT-1T filtra documentos que contenham nenhuma imagem, mais de trinta imagens ou qualquer imagem com URLs que incluam substrings inapropriados, como logo, avatar, porn ou xxx.

Pipeline PDF

MINT-1T obtém documentos PDF de arquivos WAT do CommonCrawl de dumps de fevereiro de 2023 a abril de 2024. Inicialmente, todos os links de PDF são extraídos desses dumps. MINT-1T então tenta baixar e ler PDFs usando PyMuPDF, descartando PDFs com mais de 50MB (provavelmente contendo imagens grandes) e aqueles com mais de 50 páginas. Páginas sem texto são excluídas e uma ordem de leitura é estabelecida para as páginas restantes. A ordem de leitura é determinada encontrando a caixa delimitadora de todos os blocos de texto em uma página, agrupando os blocos com base em colunas e ordenando-os de cima para baixo. Imagens são integradas à sequência com base em sua proximidade com blocos de texto na mesma página.

Pipeline ArXiv

MINT-1T constrói documentos entrelaçados do ArXiv a partir do código-fonte LaTeX, usando TexSoup para encontrar tags de figura e entrelaçar imagens com o texto do artigo. Para artigos de vários arquivos, MINT-1T identifica o arquivo Tex principal e substitui tags de entrada com o conteúdo de seus arquivos. O código LaTeX é limpo removendo imports, bibliografia, tabelas e tags de citação. Como o ArXiv já é uma fonte de dados altamente curada, nenhuma filtragem e deduplicação adicionais são realizadas.

Filtragem de Qualidade de Texto

MINT-1T evita usar heurísticas baseadas em modelo para filtragem de texto, seguindo práticas estabelecidas por RefinedWeb, Dolma e FineWeb. Inicialmente, documentos não em inglês são eliminados usando o modelo de identificação de idioma Fasttext (com um limiar de confiança de 0,65). Documentos com URLs que contenham substrings NSFW também são removidos para excluir conteúdo pornográfico e indesejado. Métodos de filtragem de texto de RefinedWeb são aplicados, especificamente removendo documentos com n-gramas duplicados excessivos ou aqueles identificados como de baixa qualidade usando regras do MassiveText.

Filtragem de Imagem

Depois de curar PDFs e arquivos HTML, MINT-1T tenta baixar todas as URLs de imagem no conjunto de dados HTML, descartando links não recuperáveis e removendo documentos com nenhum link de imagem válido. Imagens menores que 150 pixels são descartadas para evitar imagens barulhentas, como logotipos e ícones, e imagens maiores que 20.000 pixels também são removidas, pois geralmente correspondem a imagens fora do tópico. Para documentos HTML, imagens com uma proporção de aspecto maior que dois são removidas para filtrar imagens de baixa qualidade, como banners de anúncios. Para PDFs, o limiar é ajustado para três para preservar figuras científicas e tabelas.

A figura acima representa como MINT-1T inclui exclusivamente dados de PDFs e artigos do ArXiv além de fontes HTML.

Filtragem de Segurança

- Filtragem de Imagem NSFW: MINT-1T aplica um detector de imagem NSFW a todas as imagens no conjunto de dados. Se um documento contém uma única imagem NSFW, o documento inteiro é descartado.

- Remoção de Informações de Identificação Pessoal: Para mitigar o risco de vazamento de dados pessoais, endereços de e-mail e IPs nos dados de texto são anonimizados. Endereços de e-mail são substituídos por modelos, como “[email protected]”, e IPs por IPs não funcionais gerados aleatoriamente.

Deduplicação

MINT-1T realiza deduplicação de parágrafo e documento de texto dentro de cada instantâneo do CommonCrawl e deduplicação de imagem para remover imagens repetitivas e não informativas, como ícones e logotipos. Todas as etapas de deduplicação são realizadas separadamente para cada fonte de dados.

Deduplicação de Parágrafo e Documento

Seguindo a metodologia de Dolma, MINT-1T usa um Filtro Bloom para deduplicação de texto eficiente, definindo a taxa de falso positivo para 0,01 e deduplicando parágrafos de 13-gramas (indicados por delimitadores de nova linha dupla) de cada documento. Se mais de 80% dos parágrafos de um documento forem duplicados, o documento inteiro é descartado.

Remoção de Texto de Caldeira Comum

Após a deduplicação de parágrafo, MINT-1T remove frases de caldeira curtas comuns em documentos HTML, como “Pule para o conteúdo” ou “Arquivo do Blog”. Isso é feito executando deduplicação de parágrafo exata em 2% de cada instantâneo do CommonCrawl, em linha com as práticas do CCNet, garantindo principalmente a remoção de texto de caldeira comum.

A figura acima demonstra o processo de filtragem para MINT-1T e mostra como os tokens são removidos ao longo do pipeline de dados para HTML, PDFs e artigos do ArXiv.

Deduplicação de Imagem

Dentro de cada instantâneo do CommonCrawl, MINT-1T remove imagens frequentemente ocorrentes com base em hashes SHA256. Em vez de deduplicação estrita, apenas imagens que aparecem mais de dez vezes dentro de um instantâneo são removidas, seguindo práticas do Multimodal-C4. Consistente com OBELICS, imagens repetidas dentro de um único documento são removidas, mantendo apenas a primeira ocorrência.

Infraestrutura

Ao longo do processamento de dados, MINT-1T teve acesso a uma média de 2.350 núcleos CPU de uma mistura de nós com 190 processadores e 90 processadores. Ao todo, aproximadamente 4,2 milhões de horas de CPU foram usadas para construir esse conjunto de dados.

Comparando a Composição de Documentos em MINT-1T com OBELICS

Ao avaliar a composição de conjuntos de dados entrelaçados, duas características-chave são examinadas: a distribuição de tokens de texto por documento e o número de imagens por documento. Para essa análise, 50.000 documentos foram amostrados aleatoriamente de ambos OBELICS e cada fonte de dados em MINT-1T. GPT-2’s tokenizer foi usado para calcular o número de tokens de texto. Valores atípicos foram removidos, excluindo documentos que caíam fora do intervalo interquartil de 1,5 para o número de tokens de texto e imagens. Como mostrado na figura a seguir, o subconjunto HTML de MINT-1T se alinha estreitamente com a distribuição de tokens vista em OBELICS. No entanto, documentos extraídos de PDFs e ArXiv tendem a ser mais longos do que os documentos HTML, em média, destacando os benefícios de obter dados de fontes diversificadas. A Figura 5 examina a densidade de imagem em todos os documentos, revelando que PDFs e artigos do ArXiv contêm mais imagens em comparação com documentos HTML, com amostras do ArXiv sendo as mais densas em imagens.

Como Diferentes Fontes de Dados Melhoram a Diversidade de Documentos?

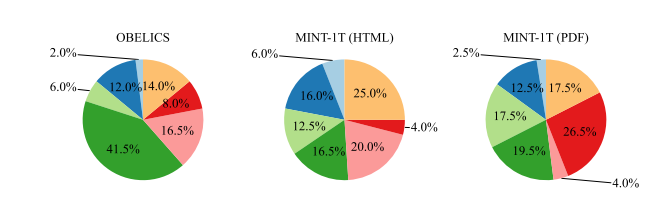

Uma motivação importante para expandir o pool de documentos multimodais além de HTML é a melhoria da cobertura de domínio. Para quantificar a diversidade e profundidade dessa cobertura, um modelo LDA foi treinado em 100.000 documentos amostrados do conjunto de dados OBELICS, do subconjunto HTML de MINT-1T e do subconjunto PDF (excluindo ArXiv) de MINT-1T para obter 200 tópicos. GPT-4 foi então usado para classificar o conjunto de palavras para identificar os domínios dominantes – como Saúde e Medicina, Ciência, Negócios, Humanidades, História, etc. – com base nos domínios MMMU. A análise revela tendências distintas na distribuição de domínio:

- OBELICS: Esse conjunto de dados mostra uma concentração acentuada em “Humanidades e Ciências Sociais”. Isso pode ser atribuído ao seu processo de construção de dados, que envolve filtrar documentos que não se assemelham a artigos da Wikipedia, potencialmente alterando a distribuição para conteúdo mais geral e focado em humanidades.

- Subconjunto HTML de MINT-1T: Em contraste com OBELICS, o subconjunto HTML de MINT-1T não está fortemente inclinado para nenhum domínio específico, sugerindo uma representação de domínio mais ampla e equilibrada.

- Subconjunto PDF de MINT-1T: Há uma proporção maior de documentos de “Ciência e Tecnologia” dentro dos documentos PDF de MINT-1T. Essa tendência é provavelmente devido à natureza da comunicação científica, onde os PDFs são o formato preferido para compartilhar relatórios de pesquisa e relatórios técnicos detalhados.

MINT-1T: Resultados e Experimentos

Para todos os experimentos, MINT-1T treina o modelo em 50% de lotes de legendagem de imagem e texto e 50% de lotes de dados multimodais entrelaçados. Um máximo de 2048 tokens multimodais é amostrado de cada documento entrelaçado e 340 tokens de cada amostra de imagem e texto. Semelhante a Flamingo, um token “fim” é adicionado para indicar o fim de uma sequência de imagem e texto adjacente. Durante o treinamento, 50% dos documentos de imagem única entrelaçados são aleatoriamente descartados para amostrar documentos de múltiplas imagens. O conjunto de dados de imagem e texto é composto por uma mistura de conjuntos de dados de legendagem internamente curados. A capacidade do modelo de raciocinar sobre sequências multimodais entrelaçadas é avaliada por meio de suas capacidades de aprendizado em contexto e desempenho de raciocínio de múltiplas imagens.

A figura acima ilustra o percentual de documentos de cada domínio em MMMU para OBELICS e subconjuntos de MINT-1T.

Aprendizado em Contexto: Os modelos são avaliados no desempenho de aprendizado em contexto de quatro tiros e oito tiros em vários benchmarks de legendagem (COCO (teste Karpathy) e TextCaps (validação)) e conjuntos de dados de perguntas e respostas visuais (VQAv2 (validação), OK-VQA (validação), TextVQA (validação) e VizWiz (validação)). Demonstrações são amostradas aleatoriamente do conjunto de treinamento. As pontuações são médias de várias execuções de avaliação, com demonstrações aleatorizadas para levar em conta a sensibilidade às prompts escolhidas. Diferentes prompts são abolidos para cada tarefa para selecionar os que melhor se saem.

Raciocínio de Múltiplas Imagens: Modelos são avaliados em MMMU (contendo tanto perguntas de imagem única quanto de múltiplas imagens) e Mantis-Eval (todas perguntas de múltiplas imagens) para sondar habilidades de raciocínio de múltiplas imagens além das avaliações de aprendizado em contexto.

Treinamento em Documentos HTML

Inicialmente, a porção HTML de MINT-1T é comparada a OBELICS, pois OBELICS é o conjunto de dados entrelaçado líder anterior, também curado a partir de documentos HTML. Dois modelos são treinados nas porções HTML de MINT-1T e OBELICS por um total de 10B tokens multimodais. Seu desempenho de aprendizado em contexto é avaliado. A tabela a seguir apresenta o desempenho de quatro tiros e oito tiros em benchmarks comuns; o modelo treinado na porção HTML de MINT-1T se sai melhor do que OBELICS em tarefas de VQA, mas pior em benchmarks de legendagem. Em média, OBELICS se sai ligeiramente melhor do que MINT-1T (HTML).

Adicionando Documentos PDF e ArXiv

Subsequentemente, o treinamento é realizado no conjunto de dados completo de MINT-1T, com uma mistura de documentos HTML, PDF e ArXiv. Os documentos entrelaçados são amostrados com 50% de HTML, 45% de PDFs e 5% de ArXiv. O modelo é treinado por um total de 10B tokens multimodais. Como visto na tabela acima, o modelo treinado na mistura completa de dados de MINT-1T supera OBELICS e MINT-1T (HTML) na maioria dos benchmarks de aprendizado em contexto. Em benchmarks de raciocínio multimodal mais complexos, o modelo MINT-1T supera OBELICS em MMMU, mas se sai pior em Mantis-Eval.

Tendências Detalhadas

Como o Desempenho de Aprendizado em Contexto Escala com Demonstrações?

O desempenho de aprendizado em contexto é avaliado quando solicitado com uma a oito demonstrações. Uma única tentativa por contagem de tiros é executada para cada benchmark de avaliação. Como mostrado na figura a seguir, o modelo treinado em MINT-1T supera o modelo treinado na porção HTML de MINT-1T e OBELICS em todos os tiros. O modelo MINT-1T (HTML) se sai ligeiramente pior do que OBELICS.

Desempenho em Tarefas de Legendagem e Perguntas e Respostas Visuais

A figura a seguir apresenta o desempenho médio de aprendizado em contexto em benchmarks de legendagem e perguntas e respostas visuais. OBELICS supera todos os variantes de MINT-1T nos benchmarks de legendagem de quatro tiros e se sai ligeiramente pior em MINT-1T nos benchmarks de legendagem de oito tiros. No entanto, MINT-1T supera significativamente ambos os benchmarks em tarefas de VQA. MINT-1T (HTML) também supera OBELICS em tarefas de VQA.

Desempenho em Diferentes Domínios

Incluir domínios diversificados em MINT-1T visa melhorar a generalização do modelo. A figura anterior quebra o desempenho em MMMU para cada domínio. Exceto pelo domínio de Negócios, MINT-1T supera OBELICS e MINT-1T (HTML). O aumento de desempenho nos domínios de Ciência e Tecnologia para MINT-1T é atribuído à preponderância desses domínios em artigos do ArXiv e documentos PDF.

Pensamentos Finais

Neste artigo, falamos sobre MINT-1T, o maior e mais diverso conjunto de dados multimodais entrelaçados de código aberto até o momento. MINT-1T: Uma escala 10x maior, incluindo um trilhão de tokens de texto e 3,4 bilhões de imagens do que os conjuntos de dados de código aberto existentes. O conjunto de dados MINT-1T também introduz fontes nunca expostas, como arquivos PDF e artigos do ArXiv. Como os conjuntos de dados multimodais entrelaçados não escalonam facilmente, é importante que o conjunto de dados MINT-1T compartilhe o processo de cura de dados para que outros também possam realizar experimentos com essas variantes ricas em informações. O conjunto de dados MINT-1T demonstra que seu método; modelos de linguagem treinados em MINT-1T são competitivos (embora um pouco) com o estado da arte anterior, OBELICS.