Inteligência artificial

Roteadores de Modelos e a Armadilha de Feedback: Como a IA Aprende com Ela Mesma

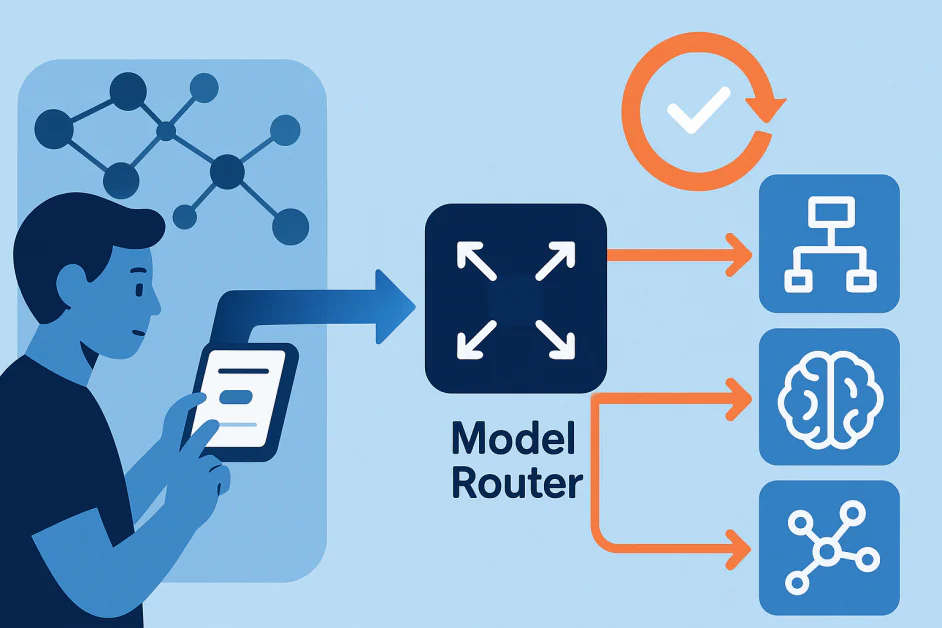

Os sistemas de IA modernos não são mais construídos em torno de um único modelo que lida com todas as tarefas. Em vez disso, eles confiam em coleções de modelos, cada um projetado para propósitos específicos. No centro dessa configuração está o roteador de modelos, um componente que interpreta uma solicitação do usuário e decide qual modelo deve lidar com ela. Por exemplo, em sistemas como OpenAI’s GPT-5, um roteador pode enviar uma consulta simples para um modelo leve para velocidade, enquanto roteia tarefas de raciocínio complexas para um modelo mais avançado.

Os roteadores não são apenas gerenciadores de tráfego. Eles aprendem com o comportamento do usuário, como quando as pessoas alternam entre modelos ou preferem certas respostas. Isso cria um ciclo: o roteador atribui a consulta, o modelo produz uma resposta, as reações do usuário fornecem feedback e o roteador atualiza suas decisões. Quando esses ciclos operam silenciosamente em segundo plano, eles podem formar loops de feedback ocultos. Tais loops podem amplificar vieses, reforçar padrões defeituosos ou reduzir gradualmente o desempenho de maneiras difíceis de detectar.

Este artigo examina como os roteadores de modelos funcionam, como os loops de feedback surgem e quais riscos eles representam à medida que os sistemas de IA continuam a evoluir.

Entendendo Roteadores de Modelos em IA

Um roteador de modelos é a camada de tomada de decisão em um sistema de IA de multi-modelos. Seu papel é determinar qual modelo é o melhor para uma tarefa. A escolha depende de fatores como complexidade da consulta, intenção do usuário, contexto e compromissos entre custo, precisão e velocidade.

Ao contrário dos sistemas que seguem regras fixas, a maioria dos roteadores de modelos são sistemas de aprendizado de máquina em si. Eles são treinados em sinais do mundo real e se adaptam ao longo do tempo. Eles podem aprender com o comportamento do usuário, como alternar entre modelos, avaliar respostas ou reescrever prompts, bem como de avaliações automatizadas que medem a qualidade da saída.

Essa adaptabilidade torna os roteadores poderosos, mas também arriscados. Eles melhoram a eficiência e fornecem uma melhor experiência do usuário, mas os mesmos processos de feedback que refinam suas decisões também podem criar loops de reforço. Com o tempo, esses loops podem afetar não apenas as estratégias de roteamento, mas também como o sistema de IA maior se comporta.

Como os Loops de Feedback se Formam

Um loop de feedback ocorre quando a saída de um sistema influencia os dados que ele aprende posteriormente. Um exemplo simples é um sistema de recomendação: se você clica em um vídeo esportivo, o sistema mostra mais conteúdo esportivo, o que molda o que você assiste em seguida. Com o tempo, o sistema reforça seus próprios padrões. Outro exemplo para entender o loop de feedback é a polícia preditiva. Um algoritmo pode prever mais crimes em certos bairros, o que pode levar a mais patrulhas. Patrulhas aumentadas descobrem mais incidentes, que então confirmam a previsão do algoritmo. O sistema parece preciso, mas os dados são distorcidos por sua própria influência. Os loops de feedback podem ser diretos ou ocultos. Loops diretos são fáceis de reconhecer, como um sistema de recomendação retreinando em suas próprias sugestões. Loops ocultos são mais sutis porque surgem quando diferentes partes de um sistema influenciam indiretamente umas às outras.

Os roteadores de modelos podem criar loops semelhantes. A decisão de um roteador molda qual modelo produz a resposta. Essa resposta molda o comportamento do usuário, que se torna feedback para o roteador. Com o tempo, o roteador pode começar a reforçar padrões que funcionaram no passado, em vez de escolher consistentemente o melhor modelo. Esses loops são difíceis de detectar e podem silenciosamente empurrar os sistemas de IA em direções não intencionais.

Por que os Loops de Feedback nos Roteadores São Arriscados

Embora os loops de feedback ajudem os roteadores a melhorar na correspondência de tarefas, eles também carregam riscos que podem distorcer o comportamento do sistema. Um risco é reforçar vieses iniciais. Se um roteador repetidamente envia um certo tipo de consulta para o Modelo A, a maioria do feedback virá das saídas do Modelo A. O roteador pode então supor que o Modelo A é sempre o melhor, colocando o Modelo B de lado, mesmo se ele pudesse às vezes realizar melhor. Esse uso desigual pode se tornar auto-reforçado. Modelos que performam bem em tarefas roteadas atraem mais solicitações, o que reforça suas forças. Modelos subutilizados recebem menos chances de melhorar, criando desequilíbrio e reduzindo a diversidade.

Os vieses também podem vir dos modelos de avaliação usados para julgar a correção. Se o modelo “juiz” tiver pontos cegos, seus vieses são passados diretamente para o roteador, que então otimiza para os valores do juiz em vez das necessidades reais do usuário. O comportamento do usuário adiciona outra camada de complexidade. Se um roteador tende a retornar certos estilos de respostas, os usuários podem adaptar suas consultas para corresponder a esses padrões, reforçando-os ainda mais. Com o tempo, isso pode estreitar tanto o comportamento do usuário quanto as respostas do sistema. Os roteadores também podem aprender a associar certos padrões de consulta ou demografia com modelos específicos. Isso pode levar a experiências sistematicamente diferentes entre grupos, potencialmente reforçando e ampliando vieses societais existentes.

Outra preocupação-chave é o desvio de longo prazo. As decisões que um roteador toma hoje influenciam os dados de treinamento usados amanhã. Se os modelos forem retreinados em saídas influenciadas pelo roteamento, eles podem aprender as preferências do roteador em vez de abordagens independentes. Isso pode tornar as respostas entre os modelos mais uniformes e incorporar vieses que persistem ao longo do tempo.

Estratégias para Quebrar o Ciclo

Reduzir os riscos de loops ocultos requer design ativo e supervisão. O treinamento deve usar fontes de dados diversificadas, não apenas cliques ou alternâncias do usuário. O roteamento aleatório ocasional também pode prevenir que um modelo monopolize um tipo de tarefa. A monitorização é essencial. Auditorias regulares podem revelar se um roteador está se desviando em direção a certos padrões ou se está dependendo demais de um modelo. A transparência nas decisões do roteador ajuda os pesquisadores a detectar vieses precocemente.

Os roteadores também devem ser retreinados periodicamente com dados frescos e equilibrados, para que os vieses antigos não sejam travados. A incorporação de supervisão humana, especialmente em domínios sensíveis, adiciona outra camada de responsabilidade. Os humanos podem identificar quando um roteador sistematicamente favorece um modelo ou mal classifica certas consultas.

A chave é tratar o roteador como um modelo sujeito a feedback, e não como um componente fixo ou neutro. Ao reconhecer como os roteadores são moldados pelos dados que criam, os pesquisadores e desenvolvedores podem projetar sistemas que permanecem justos, adaptáveis e confiáveis ao longo do tempo.

O Resumo

Os roteadores de modelos oferecem benefícios claros em eficiência e adaptabilidade, mas também carregam riscos ocultos. Os loops de feedback dentro desses sistemas podem silenciosamente amplificar vieses, limitar a diversidade de respostas e travar os modelos em padrões de comportamento estreitos. À medida que essas arquiteturas se tornam mais comuns, reconhecer e abordar esses riscos precocemente será fundamental para construir sistemas de IA que permanecem justos, confiáveis e genuinamente adaptáveis.