Ângulo de Anderson

Introduzindo Imagens Geradas por IA à Luz com HDR

Imagens e vídeos gerados por IA podem ser impressionantes, mas não atendem ao padrão ‘profissional’ – um problema que um novo projeto de pesquisa busca resolver.

Na comunidade audiovisual profissional, uma das objeções mais frequentes à invasão da IA é a falta atual de padrões profissionais de reprodução de imagens e vídeos. Não menos importante é a capacidade de trabalhar com imagens e vídeos em High Dynamic Range (HDR).

As imagens HDR são o equivalente moderno de uma prática fotográfica do século XIX/XX chamada bracketing, onde a mesma foto é tirada várias vezes com quantidades crescentes de luz permitidas para atingir o emulsionamento do filme:

Acima, uma sequência curta de imagens bracketadas. Inserida abaixo, a alta gama dinâmica que pode ser extrapolada dessas fotos em uma única imagem. Fonte

Na fotografia tradicional, isso resultou em várias fotos que, com alguma expertise e esforço, poderiam ser compostas em uma única impressão que se beneficiasse de todos os diferentes níveis de detalhe disponíveis na faixa de exposições. Mas não foi um processo trivial.

Esses dias, uma sequência de imagens ‘auto-bracketada’ pode produzir várias imagens ou ser combinada em uma única imagem HDR – efetivamente, uma multiplicidade de exposições em uma imagem, que aplicações de edição de imagem compatíveis com HDR, como o Photoshop, podem iterar e permitir que o fotógrafo orquestre em uma imagem de saída ideal.

Se você está se perguntando por que deve se importar, ou como isso afeta sua própria fotografia, a ilustração para este artigo pretende demonstrar isso de uma maneira familiar:

Acima, à esquerda, vemos um exemplo típico de uma imagem sRGB (ou seja, não HDR). Apenas clarear (mostrado à direita) não mostra o monstro no armário, porque esse detalhe foi jogado fora quando o fotógrafo e os processos automatizados da câmera decidiram o que priorizar na foto:

Abaixo é uma indicação (à esquerda) de como o primeiro plano estaria ‘lavado’ no momento da exposição para registrar o monstro no armário em uma foto não HDR, e (à direita) como o monstro é mergulhado na escuridão quando a exposição é feita para o primeiro plano iluminado:

Abaixo, vemos o tipo de detalhe que pode ser ‘resgatado’ de uma imagem ou sequência HDR. Nesse caso, o monstro estava ‘escondido’ nos registros visuais mais baixos da sequência HDR, em um nível onde o restante do conteúdo estaria ‘queimado’ em branco (acima, à esquerda). Ao especificar que uma ampla faixa de níveis de brilho deve ser expressa, seletivamente, na mesma imagem, esses elementos dissonantes podem ser compostos em uma imagem racional:

Uma imagem não HDR é conhecida como imagem referenciada para exibição, e uma imagem HDR de alta gama é conhecida como imagem referenciada para cena.

O vídeo HDR também existe, e esse tipo de versatilidade e ductilidade tonal realmente dá aos criadores de filmes alguma latitude para resgatar, gradar e interpretar imagens de forma criativa e consistente; não é surpreendente, então, que os criativos sejam relutantes em trabalhar com a saída ‘achatada’ sRGB típica da maioria dos quadros generativos de IA.

HDR em IA

Naturalmente, a cena de pesquisa está interessada em trazer frameworks gerados por IA para a era HDR. No entanto, não é uma tarefa trivial, tanto devido à arquitetura fundamental dos sistemas generativos de difusão, quanto porque bons dados HDR ocupam muito espaço em disco, tornando as coleções desajeitadas; consequentemente, conjuntos de dados adequados para a tarefa são escassos.

Não obstante, uma colaboração entre uma universidade em Cingapura e a Adobe Research está oferecendo um método de produzir sequências de imagens HDR, em uma metodologia que pode ser aplicada teoricamente a vídeos, bem como a imagens fixas:

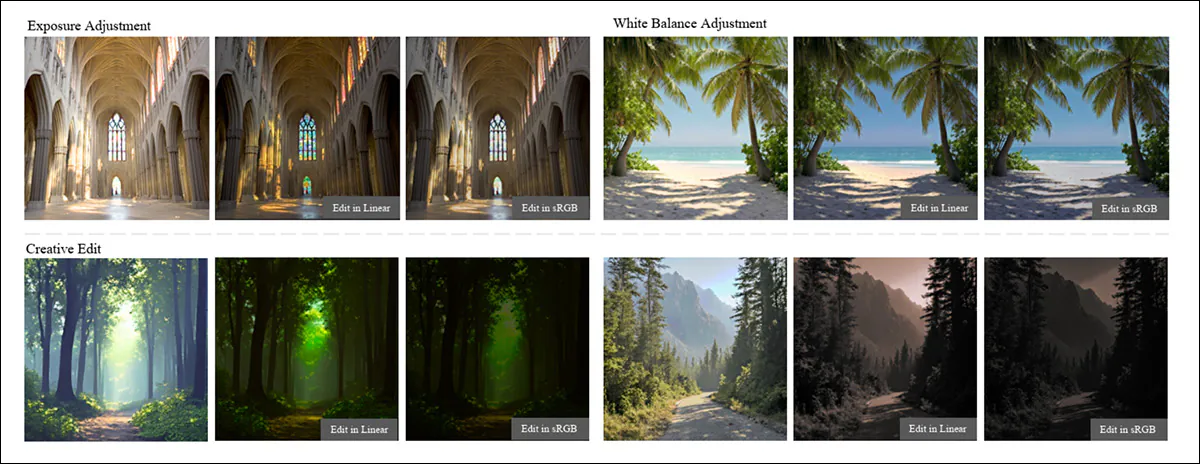

Do site do projeto para o novo trabalho, exemplos de saída de imagem de texto ‘bracketada’. Fonte

O novo sistema gera várias versões alinhadas da mesma imagem em diferentes níveis de brilho e aprende quão brilhante a cena realmente era, então combina essas em um único resultado que mantém detalhes em sombras e highlights, permitindo que edições posteriores de exposição ou cor se comportem mais como ajustes a uma captura de câmera real, em vez de ajustes frágeis a uma imagem totalmente processada.

O sistema aproveita uma diversidade de diferentes modelos para a tarefa, incluindo variantes de Qwen e Flux:

Exemplos do novo artigo, mostrando como o sistema pode gerar múltiplas versões de exposição da mesma cena, mantendo a estrutura subjacente fixa. A partir de um mapa de bordo simples, o modelo produz imagens consistentes em configurações muito escuras a muito claras, seja a prompt descreva luz da lua, luz do sol, pôr do sol ou até mesmo um objeto pequeno como um balão, com o assunto e a composição permanecendo estáveis, enquanto apenas a iluminação muda. O método pode variar a luminosidade de forma controlada, como uma câmera, em vez de derivar ou inventar novo conteúdo à medida que a exposição muda. Fonte

Os autores afirmam:

‘Gerar imagens lineares é desafiador, pois VAEs pré-treinados em modelos de difusão latente lutam para preservar simultaneamente highlights e sombras extremas devido à maior gama dinâmica e profundidade de bits.

‘Para isso, representamos uma imagem linear como uma sequência de exposições, cada uma capturando uma porção específica da gama dinâmica, e propomos uma arquitetura de fluxo de correspondência baseada em DiT para geração de exposição condicionada por texto.

‘Além disso, demonstramos aplicações downstream, incluindo edição de imagem linear orientada por texto e geração condicionada por estrutura via ControlNet.’

O novo trabalho é intitulado Geração de Imagem Linear por Síntese de Exposições, e vem de quatro autores da S-Lab na Universidade Tecnológica de Nanyang, Adobe NextCam e Adobe Research. Além da página do projeto e do vídeo do YouTube que acompanha o lançamento, há também um repositório GitHub (atualmente escasso) e a promessa de um lançamento de conjunto de dados.

Embora os autores forneçam muitos exemplos de saída do sistema na página do projeto associado, os leitores precisarão de um monitor compatível com HDR para realmente distinguir as características da saída HDR apresentada. No entanto, encontre o vídeo de visão geral dos pesquisadores no final deste artigo – mas esteja ciente de que as diferenças entre os exemplos mostrados podem não ser claras em um monitor não HDR.

Método e Dados

Os autores enfatizam a extensão com que a coleta de dados é um desafio nessa busca particular:

‘Adquirir um grande número de imagens lineares é extremamente desafiador na prática. Além disso, a maioria dos conjuntos de dados HDR públicos é panorâmica (portanto, se concentra quase exclusivamente em conteúdo de cena em grande escala) ou não fornece imagens lineares reais, tornando-as inadequadas para nossos propósitos.

‘Portanto, usamos principalmente conjuntos de dados de imagem RAW como base para o treinamento.’

Os pesquisadores fizeram um uso criativo das poucas opções disponíveis, aproveitando o conjunto de dados RAISE como dados de treinamento reais e o conjunto de dados MIT-Adobe FiveK como dados de avaliação*.

Para construir dados de treinamento HDR utilizáveis, os pesquisadores executaram os arquivos de câmera RAW por meio de um pipeline padronizado para remover peculiaridades específicas da câmera, convertendo as imagens em um formato linear consistente e referenciado para cena:

Esquema para o fluxo de trabalho dos autores: o sistema começa com ruído representando quatro níveis de exposição da mesma cena, juntamente com uma prompt de texto e um token de brilho, e processa-os por meio de blocos de transformador empilhados que mantêm as diferentes exposições alinhadas, enquanto ajusta a iluminação. Em seguida, prevê tanto o conjunto de imagens de exposição quanto uma escala de brilho geral e, subsequentemente, decodifica e combina-os em uma imagem de cena referenciada única, mantendo detalhes em sombras e highlights.

Isso envolveu reconstruir RGB completo a partir de dados do sensor, aplicar correção de cor, normalizar o balanço de branco e brevemente mover para um espaço de cor perceptual para desruído antes de retornar a um sinal linear limpo. A luz real na cena foi então recuperada usando as configurações de exposição da câmera, para que cada pixel refletisse a luminosidade real em vez de uma aproximação pronta para exibição.

Como esses valores podem variar amplamente, os dados foram então estabilizados escalando cada imagem com base em sua própria distribuição de brilho, usando estatísticas de meio-tom e highlight para evitar imagens lavadas e highlights queimados, finalmente obtendo uma imagem linear normalizada que preservava a faixa real de luz na cena, enquanto permanecia estável o suficiente para treinamento.

Rótulos de texto para as imagens foram criados com o modelo Qwen2.5-VL 7B, com prompts criados para corresponder às características do modelo Flux que seriam usados no momento da geração.

Cada imagem foi dividida em ‘fatias’ de exposição e passada por um codificador VAE compartilhado, convertendo todas as exposições em um espaço latente comum projetado para capturar a faixa completa de brilho. Os latentes foram então refinados a partir do ruído e decodificados de volta em imagens, permitindo uma reconstrução consistente em regiões escuras e claras, sem colapsá-las em uma única exposição ‘achatada’.

Ajuste fino LoRA foi usado para adaptar a estrutura pré-treinada Flux a dados de imagem linear com parâmetros extras mínimos, ajudando o modelo Single-Diffusion Transformers (single-DiT) a permanecer estável, mesmo à medida que a luminosidade variava entre exposições.

Atenção auto-modulada por exposição (coluna central na ilustração do esquema acima) foi introduzida para processar conjuntamente todas as exposições, permitindo que a luminância fosse ajustada por exposição, mantendo a estrutura e o detalhe fino alinhados.

Incorporação de posição rotatória 3D (3D-R[o]PE) foi usada para codificar tanto a posição espacial quanto a identidade de exposição, para que o modelo pudesse distinguir a qual exposição cada token pertencia, enquanto preservava a consistência espacial, permitindo uma separação limpa da variação de brilho do conteúdo da cena.

Visão geral do conjunto de dados usado no estudo, mostrando como as imagens são distribuídas por tipo de conteúdo e cenas internas versus externas, ao lado da distribuição de valores de brilho nos dados processados. Os histogramas plotam a luminância e a escala de radiação no espaço log, ilustrando como a luminosidade do mundo real pode variar amplamente, com valores de radiação mais altos correspondendo a cenas fisicamente mais brilhantes e destacando a forte gama dinâmica que o modelo é treinado para lidar.

3D-RoPE separou onde um recurso estava e ‘de qual exposição ele vem’ em sinais separados, para que a variação de brilho pudesse ser ajustada independentemente, sem corromper o detalhe espacial.

Testes

Os pesquisadores usaram Flux-dev como o framework generativo, com o treinamento ocorrendo em quatro GPUs NVIDIA A100, cada uma com 80GB de VRAM. O tamanho do lote foi definido em 4 (por GPU), durante 10.000 iterações.

Ajuste fino LoRA usou um rank de 64. O otimizador AdamW foi usado em uma taxa de aprendizado de 2×102 (para o aspecto de modulação de exposição).

Os autores observam que, embora haja dois trabalhos anteriores semelhantes em escopo, nenhum deles foi um candidato óbvio para uma fase de teste. O trabalho de 2022 liderado pelo Max Planck GlowGAN é limitado a gerar categorias de imagens específicas, enquanto o Bracket Diffusion de 2025 (também liderado pelo Max Planck Institute) pode gerar apenas uma imagem HDR em 256x256px e leva vários minutos para fazê-lo.

Do artigo original GlowGAN, imagens LDR típicas perdem detalhes em sombras e highlights, enquanto o modelo aprende a produzir versões HDR que retêm detalhes em todos os níveis de brilho e permitem a recuperação de regiões saturadas por meio de mapeamento de tom inverso. Fonte

Portanto, na ausência de linhas de base diretas para geração de imagens lineares, os autores compararam seu método com versões adaptadas de modelos existentes, em vez de alternativas projetadas especificamente.

Um conjunto de experimentos (‘T2I Fine-Tuning’) ajustou finamente o modelo de difusão de imagem para texto Flux usando LoRA, treinando-o para gerar imagens lineares diretamente e avaliando como um modelo T2I de estado da arte se adaptou a esse domínio.

Uma segunda comparação (‘T2V fine-tuning’) usou o modelo de vídeo para texto Wan 2.1, cujo VAE comprime várias frames em uma representação latente compartilhada; nesse setup, quatro exposições foram codificadas em uma representação latente única e, em seguida, decodificadas de volta, testando se uma pipeline de vídeo poderia modelar a variação de exposição.

O terceiro conjunto de experimentos (‘T2I Model Inflation’) comparou contra CameraCtrl e Generative Photography, que ambos estendem modelos de difusão de imagem por meio de módulos temporais, para produzir saídas multi-frame. Esses também foram ajustados finamente nos mesmos dados, para uma comparação consistente.

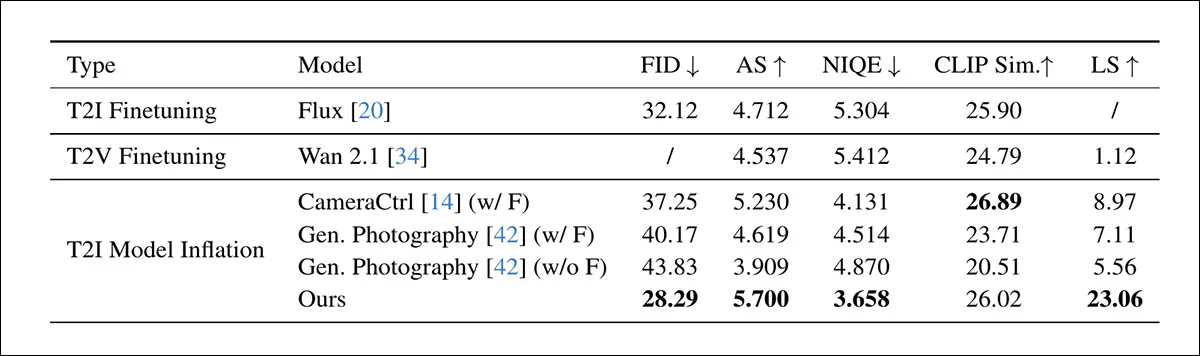

As métricas usadas foram Fréchet Inception Distance (FID); Aesthetic Score (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim score; e Luminance Similarity (LS):

Uma comparação do método dos autores contra várias linhas de base adaptadas para gerar imagens lineares referenciadas para cena. Modelos de imagem para texto (Flux) e de vídeo para texto (Wan 2.1) são ajustados finamente com LoRA para testar como sistemas generativos existentes lidam com essa configuração, enquanto CameraCtrl e Generative Photography estendem modelos de difusão com componentes temporais. Algumas pontuações estão faltando, porque certos modelos não podem produzir consistentemente exposições consistentes, que são necessárias para recuperar a faixa dinâmica completa. Ao longo das métricas relatadas, o novo método alcança os resultados globais mais fortes, particularmente em medidas relacionadas à qualidade da imagem e à reconstrução precisa de brilho.

Quanto a esses resultados, os autores afirmam:

‘Devido à ampla distribuição de imagens lineares, ajustar finamente o modelo T2I diretamente em dados lineares torna difícil equilibrar detalhes de sombras e highlights. Métodos de inflação do modelo T2I sofrem de limitada faixa dinâmica e degradação significativa da qualidade da imagem, mesmo após o ajuste fino.

‘Para o ajuste fino T2V, a redução de 4× no tempo do Wan 2.1 entrelaça as quatro exposições em uma representação latente única, causando uma discordância de distribuição severa que não pode ser resolvida apenas com ajuste fino.

‘Ao modelar diretamente as propriedades referenciadas para cena usando exposições, nosso método alcança qualidade visual e faixa dinâmica superiores em todas as linhas de base.’

Uma comparação com Flux e Wan 2.1 ajustados com LoRA, ilustrando como cada método lida com mudanças de exposição nas mesmas cenas. Abordagens concorrentes tendem a perder detalhes em regiões muito escuras ou muito claras, enquanto o método proposto mantém estrutura consistente e recupera detalhes úteis em toda a faixa de exposições. Por favor, consulte o artigo de origem e o site do projeto para exemplos de resultados de melhor qualidade.

Por favor, consulte a seção de experimentos estendidos e materiais suplementares do artigo de origem para testes adicionais.

Conclusão

Para profissionais de mídia, como aqueles que trabalham na produção de filmes e TV, a mesma saída que capturou a imaginação (e, cada vez mais, a ira) do mundo os deixou impassíveis, desde que quase todos os seus pipelines dependem de alguma forma de capturas HDR.

Portanto, este é um projeto oportuno, representando uma funcionalidade que se espera se tornar um padrão opcional em novos frameworks – embora seja certo que pelo menos dobrará os tempos de renderização; claramente, também, a latência precisará ser seriamente abordada se o conteúdo HDR da IA não for relegado à categoria ’em pós-produção’ em vez de em câmera.

* Normalmente mostraríamos exemplos, mas como o leitor pode não ter um monitor compatível com HDR, omitimos esses neste caso.

Publicado pela primeira vez no domingo, 26 de abril de 2026