Ângulo de Anderson

Dados "desonestos" que poluem o desempenho da IA generativa

Um novo estudo constata que muitos conjuntos de dados de imagens populares usados para treinar modelos de IA estão contaminados com imagens de teste ou quase duplicatas, permitindo que os modelos trapaceiem memorizando respostas em vez de aprender. O vazamento é generalizado, mas geralmente não detectado, inflando discretamente as pontuações e dando vantagens injustas aos modelos treinados com dados em escala web.

Ao fazer um teste de direção, normalmente não é informado com antecedência quais estradas serão usadas. Se você fez isso (e se mostrou um pouco inseguro), pode "otimizar" para o teste praticando repetidamente naquela rota, em vez de desenvolver habilidades de direção mais amplas que possam lidar com qualquer rota razoavelmente bem.

No treinamento de modelos de aprendizado de máquina, esta é uma analogia razoável para um teste de divisão – uma divisão dos dados do conjunto de treinamento entre (geralmente) uma divisão de 70% para os dados que serão usados para treinar o modelo, com os 30% restantes usados como dados "in the wild".

Como os dados in-the-wild nunca foram vistos pelo modelo, se o modelo tiver um bom desempenho nesses dados, pode-se presumir que é eficaz e eficiente; caso contrário, o modelo pode ter superajustado em um conjunto bem equilibrado – ou então os dados precisariam de curadoria e definição extras.

De qualquer maneira, não Avaliar modelos com base em seus dados de treinamento é a base do método atual em pesquisa e desenvolvimento de IA.

O mesmo de novo, por favor

De acordo com um novo artigo de pesquisa do Japão, o setor de pesquisa em visão computacional e IA generativa não correspondeu remotamente ao esforços de pesquisadores de LLM para garantir que os dados de teste não poluam os dados de treinamento; em testes, os pesquisadores descobriram que cada conjunto de dados de visão em hiperescala que eles estudaram, incluindo aqueles que alimentam alguns dos maiores sistemas de IA generativa atuais, permitiu até certo ponto que seus dados de teste cruzassem com seus dados de treinamento - o que significa que benchmarks e relatórios de desempenho para modelos treinados nessas divisões não serão mais precisos do que um resultado de exame de alguém que escondeu uma farsa na sala de exames e não refletirão o desempenho do mundo real em dados genuinamente novos.

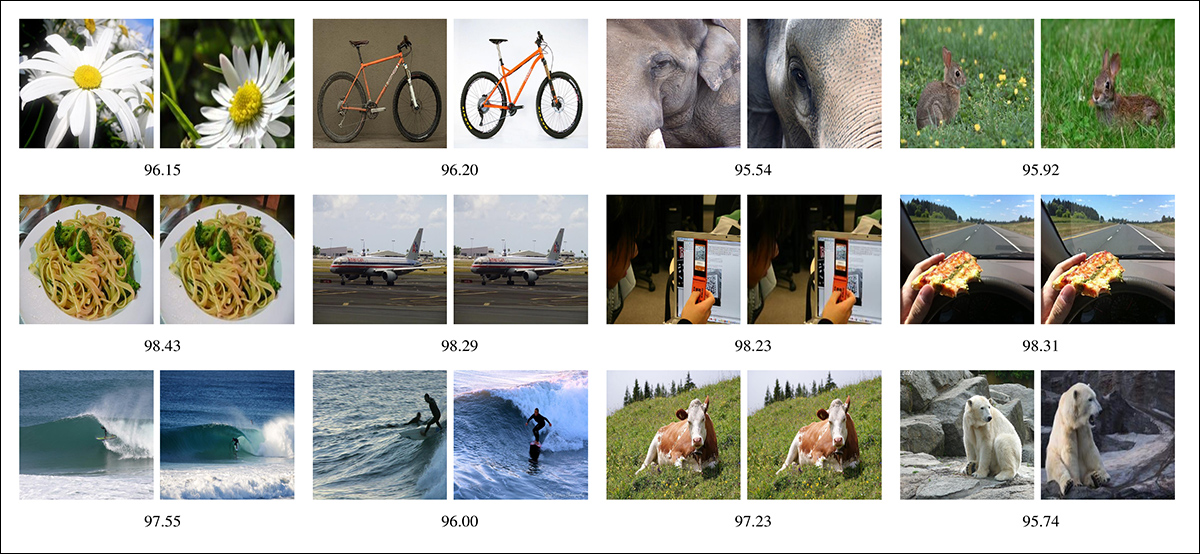

Exemplos de contaminação cruzada de dados encontrados pelos pesquisadores, onde existem pontos de dados duplicados ou quase duplicados nos dados de treinamento e de teste. Fonte: https://arxiv.org/pdf/2508.17416

Na imagem acima, do novo artigo, vemos exemplos de pontos de dados duplicados ou quase duplicados encontrados nos dados de treinamento principais e nos dados de teste de uma variedade de modelos - o suficiente para invalidar o desempenho do modelo nesses dados e inflar levemente suas pontuações gerais em todos os aspectos, facilitando o aparecimento de um nível de generalização que o modelo pode não ter realmente alcançado.

Para complicar ainda mais a situação, a contaminação parece ocorrer numa diversidade de cenários possíveis, incluindo 'Pré treino', onde o pesos of modelos ancestrais mais antigos são usados para "dar o pontapé inicial" em um novo modelo. Se o modelo anterior, mais antigo, tiver alguns dos mesmos dados que o conjunto de dados mais recente que está sendo pré-treinado, a contaminação cruzada pode ocorrer mesmo que a divisão 70/30 ou 80/20 esteja limpa.

Efeito cumulativo

É quase certo que isso ocorrerá mesmo nos conjuntos de dados mais recentes: o escopo dos conjuntos de dados de visão/linguagem cresceu enormemente nos últimos cinco anos, absorvendo não apenas os dados de imagens mais recentes na web, mas também coletando novamente muitos dos mesmos dados que povoavam aqueles conjuntos de dados históricos mais antigos.

Além disso, as rotinas automatizadas concebidas para rastrear e filtrar milhares de milhões de imagens em busca de duplicados e quase duplicados enfrentam agora uma tarefa tão onerosa que a própria curadoria – o seu custo em termos de tempo e dinheiro – deve agora ser considerada no contexto das limitações orçamentais.

Enquanto isso, a duplicação de imagens é uma consequência inevitável do tipo de ad hoc busca na web por coleções massivas como Rastreio comum, devido à prática comum de republicar e recomprimir imagens e aplicar edições como cortes e até mesmo inversão (para evitar detecção, quando a imagem pode ter sido usada sem permissão, por exemplo).

Os autores observam*:

O vazamento de dados é um problema generalizado, prevalente na maioria dos conjuntos de dados visuais. O vazamento pode obscurecer a capacidade de generalização dos modelos, o que é particularmente problemático ao comparar modelos treinados em conjuntos de dados diferentes, levando a comparações injustas.

"Instamos os projetistas de conjuntos de dados a considerarem cuidadosamente as implicações dessas avaliações. Para uma avaliação mais justa do modelo, recomendamos o uso de detectores de duplicatas que considerem vazamentos severos e suaves.

'O ideal é que as imagens vazadas sejam removidas do conjunto de treinamento e, se não for possível, pelo menos sejam removidas do conjunto de teste.'

O artigo detalha uma série de testes que os pesquisadores conduziram em conjuntos de dados enormes e populares — cada um dos quais demonstrou algum nível de contaminação.

O processo de novo papel é intitulado Vazamento de dados em conjuntos de dados visuais, e vem de três pesquisadores da Universidade de Osaka.

Forma

Os autores do artigo definem vazamento em termos de três dimensões: modalidade, cobertura e grau.

Modalidade distingue se apenas as imagens vazam ou se tanto as imagens quanto os rótulos são expostos; cobertura identifica se a sobreposição ocorre dentro do mesmo conjunto de dados ou em conjuntos de dados diferentes; e grau define se o conteúdo duplicado é exatamente o mesmo ou apenas adjacente.

Em relação ao vazamento, os dois cenários considerados no trabalho são vazamento intraconjunto de dados (onde as imagens de avaliação reaparecem na divisão de treinamento do mesmo conjunto de dados) e vazamento entre conjuntos de dados (onde as imagens de avaliação de um conjunto de dados estão presentes em um diferente conjunto de dados usado para treinamento).

Em relação ao grau, os dois níveis definidos são vazamento suave (onde as imagens não são idênticas, mas apresentam pequenas variações) e vazamento forte (onde as imagens são exatamente as mesmas no treinamento e na avaliação).

Os pesquisadores abordam a detecção de vazamentos em termos de recuperação de imagem, usando codificadores de imagem para representar cada imagem como uma vetor de característica. O conjunto de consultas são os dados de avaliação, enquanto o coleção é o conjunto de treinamento.

Para conjuntos de dados menores, cada vetor de consulta foi comparado diretamente a todos os vetores de treinamento usando similaridade de cosseno. Para conjuntos de dados maiores, um Índice de Faiss foi construído para permitir um processamento mais rápido, Vizinhos mais próximos (KNN) pesquisa.

Como o codificador precisa capturar informações visuais suficientes para detectar semelhanças sutis, mas ainda permanecer eficiente diante de volumes muito altos de dados, os autores confiaram em métodos pré-computados CLIP recursos disponibilizados pelos criadores de conjuntos de dados, no caso da coleção LAION que sustenta a Stable Diffusion e projetos posteriores.

Os autores observam que permitir que o CLIP usasse seu entendimento destilado do conjunto de dados (em vez de pesquisar os arquivos reais em escala) acelerou o processo consideravelmente e ofereceu consistência aprimorada nas comparações.

Dados e testes

O codificador de imagem CLIP usado nos testes para o novo trabalho foi o padrão CLIP ViT-B/32 originalmente usado para peneirar LAION. Para estabelecer se imagens diversas estavam relacionadas entre si, o KNN foi usado sob AutoFaiss.

Os conjuntos de dados foram agrupados em três tipos: Pré treino conjuntos de dados – grandes coleções coletadas na web usadas para treinar modelos generalistas; treinamento conjuntos de dados – coleções menores, geralmente anotadas, destinadas ao ajuste direto do modelo; e referência conjuntos de dados – anotados manualmente e usados exclusivamente para avaliação.

A análise abrangeu vinte divisões em sete conjuntos de dados: Microsoft COCO foi usado como um conjunto de treinamento e avaliação, incorporando as divisões de treinamento, validação, teste e não rotuladas; Flickr30k serviu exclusivamente como referência; e a Legendas conceituais do Google A coleção (GCC) foi tratada como uma fonte de pré-treinamento, com sua parte de validação também usada para avaliação.

Além disso, IMAGEnet foi usado tanto para treinamento quanto para avaliação comparativa, enquanto o LAION-400M O conjunto de dados foi usado apenas para pré-treinamento.

OpenImages v4 contribuiu com dados de treinamento e benchmark, e Letras maiúsculas de texto forneceu divisões de treinamento e teste para avaliação.

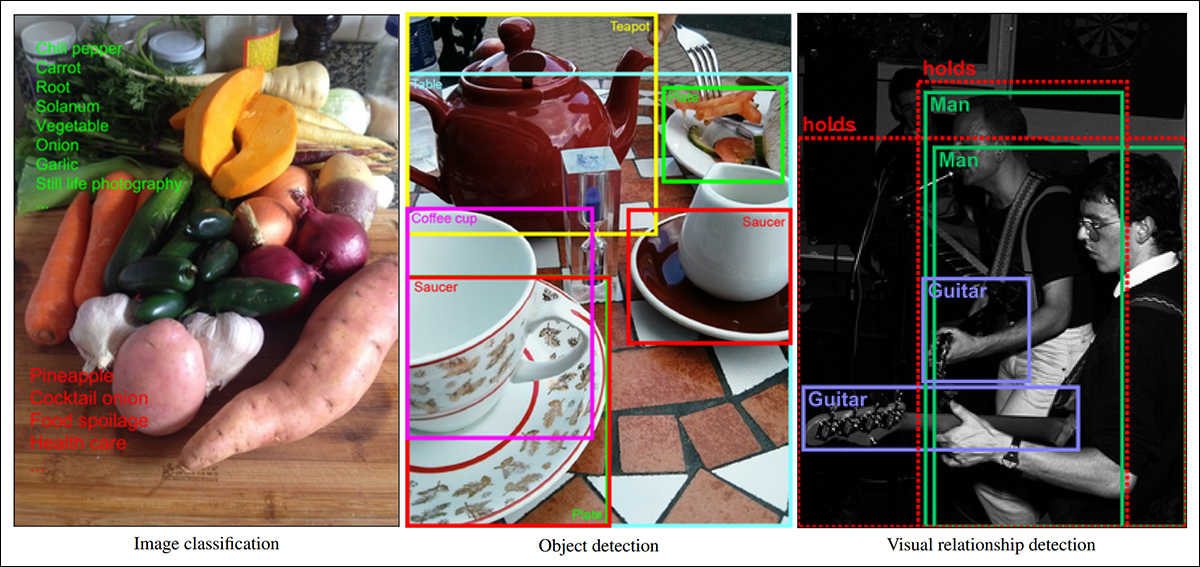

Exemplos de anotações de imagens do conjunto de dados Open Images do Google, examinados no novo trabalho. Fonte: https://arxiv.org/pdf/1811.00982

Para avaliar o quão bem o método pode detectar vazamentos quando as imagens foram sutilmente alterado por meio de redimensionamento, corte ou transformações não semânticas semelhantes, os autores testaram no Flickr30k, selecionando aleatoriamente 5,000 imagens como consultas e usando todo o conjunto de dados como coleção de referência.

Cada imagem de consulta foi transformada antes de ser codificada (ou seja, submetida a uma modificação não semântica, como redimensionamento ou corte) e, então, correspondida ao item mais semelhante na coleção usando similaridade de cosseno; uma correspondência era contada somente se a imagem original fosse recuperada como o resultado principal.

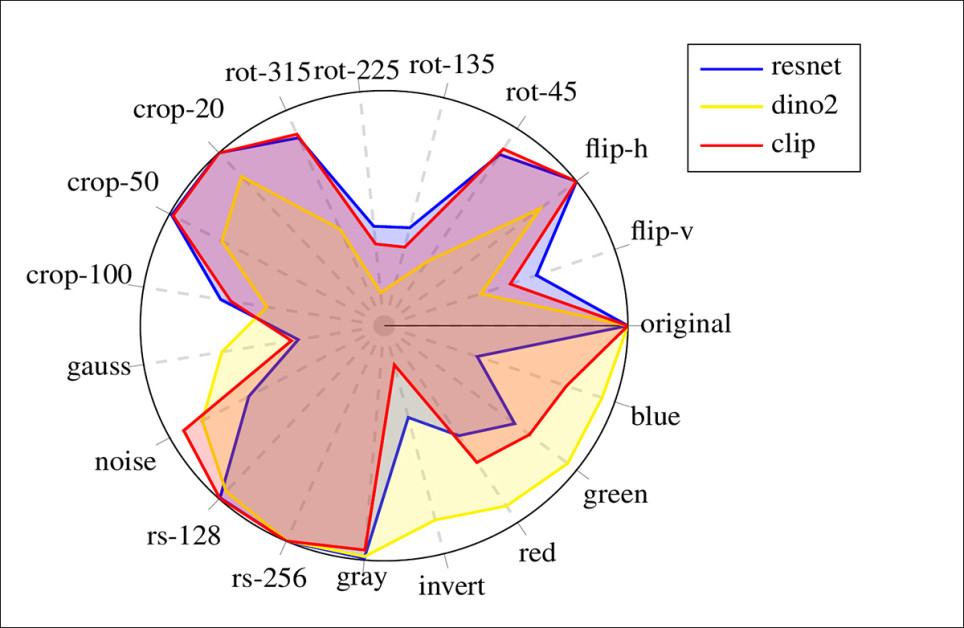

Os três codificadores comparados foram ResNet-152; DINOv2 ViT-B/14; e CLIP ViT-B/32.

Foram usados quatro tipos de transformações de imagem não semânticas: geométricas (inversões e rotações); corte (remoção de 20, 50 ou 100 pixels de cada borda); pixelização (desfoque gaussiano, ruído adicionado ou redução da resolução para 128 ou 256 pixels); e cor (escala de cinza, inversão ou sobreposições de vermelho, verde ou azul).

Do material suplementar, exemplos de transformações aplicadas aos dados – rotinas típicas também no pré-processamento de aumento de dados.

Os autores então testaram o vazamento na recuperação de imagens:

Precisão de detecção de vazamento em 5,000 imagens de consulta do Flickr30k submetidas a várias transformações não semânticas.

Todos os três codificadores obtiveram desempenho perfeito em imagens inalteradas, e o CLIP permaneceu confiável em cortes, inversões horizontais, ruído e redimensionamento, superando o ResNet em alterações de cor e nível de pixel.

O DINOv2 demonstrou forte resiliência a transformações de cores (provavelmente devido ao seu design autossupervisionado, opinam os autores), mas foi notavelmente mais fraco em edições geométricas e cortes — ambos comuns em conjuntos de dados duplicados.

Como o LAION já inclui incorporações CLIP, e dada sua robustez e velocidade consistentes, o CLIP foi escolhido como o codificador padrão para a análise principal.

Vazamento Duro e Suave

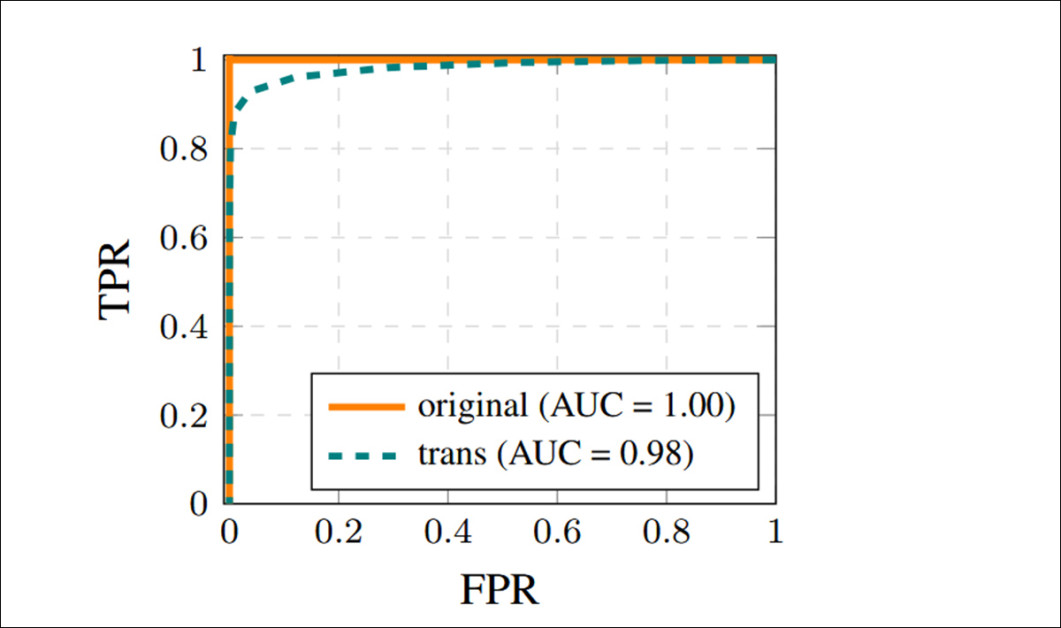

O desempenho foi avaliado em diferentes limiares de similaridade de cosseno para distinguir entre imagens exatas e quase duplicadas (vazamento forte e suave).

Um limite de 0.98 foi selecionado para definir vazamento severo, resultando em nenhum falso positivo e detecção perfeita de imagens idênticas.

Para o vazamento suave, foi escolhido um limite de 0.95, permitindo a recuperação de mais duplicatas quase completas, mantendo uma taxa de falsos positivos próxima de zero. A precisão foi priorizada em detrimento da recuperação, e os resultados foram, portanto, estimados de forma conservadora:

Curvas características de operação do receptor foram utilizadas para orientar a seleção de limiares rígidos e flexíveis para detecção de vazamentos. Altos escores de AUC, tanto em condições transformadas quanto não transformadas, demonstram que imagens quase duplicadas podem ser distinguidas de forma confiável de imagens não relacionadas, mesmo com alterações mínimas.

Vazamento intraconjunto de dados

O vazamento intraconjunto de dados foi calculado identificando a sobreposição de imagens entre as divisões de treinamento e avaliação dentro do mesmo conjunto de dados. Apenas conjuntos de dados com divisões de benchmark e de treinamento ou pré-treinamento foram elegíveis, restringindo a análise a COCO, GCC, ImageNet, OpenImages e TextCaps.

Para COCO, o conjunto de teste foi comparado com o conjunto de treinamento, conjunto de avaliação e subconjuntos não rotulados, e o conjunto de validação com os subconjuntos de treinamento e não rotulados.

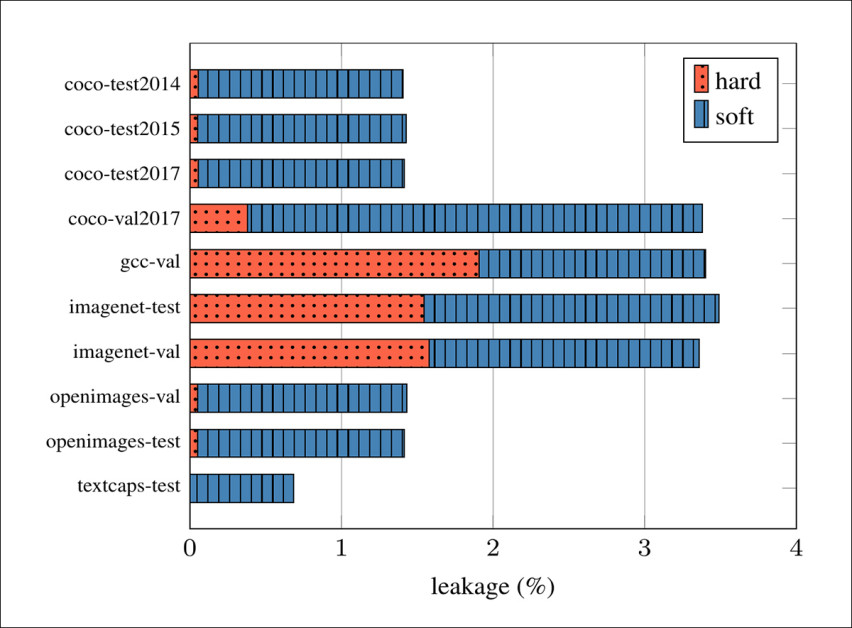

As maiores taxas de vazamento intraconjunto de dados foram observadas nas divisões de teste e validação do ImageNet, com vazamentos rígidos atingindo até 1.58% e vazamentos suaves pouco abaixo de 2%. GCC e COCO seguiram, com COCO val2017 apresentando um vazamento suave de 3% e suas divisões de teste variando entre 1.35% e 1.38%. O OpenImages apresentou baixo vazamento rígido, de 0.05%, mas o vazamento suave excedeu 1.3% nos conjuntos de teste e validação. TextCaps apresentou o menor vazamento geral, de 0.69%, sem vazamento rígido detectado:

Taxas de vazamento intraconjunto de dados, mostrando a proporção de cada divisão de avaliação que se sobrepõe aos dados de treinamento associados.

Em relação a esses resultados, os autores afirmam†:

'Esses resultados mostram que o vazamento intraconjunto de dados ocorre em todos os os conjuntos de dados analisados, seja em seu grau rígido ou suave.

'Dado que o vazamento de dados pode comprometer a avaliação do modelo e que os conjuntos de dados são projetados especificamente para esse propósito, o vazamento intraconjunto de dados é um risco que por design não deveria existir.

'No entanto, identificamos múltiplas instâncias em todos os conjuntos de dados.'

Vazamento entre conjuntos de dados

Para medir o vazamento entre conjuntos de dados (onde um modelo é treinado em um conjunto de dados e avaliado em outro), quatro conjuntos de dados foram usados como fontes de dados de treinamento: trem GCC, Trem ImageNet, Trem OpenImages, e LAION.

Eles foram comparados com dados de avaliação extraídos do teste e divisão de validação do COCO 2014, Flickr30K, teste TextCaps, teste e divisão de validação do OpenImages e teste e divisão de validação do ImageNet.

Os embeddings do CLIP ViT-B/32 foram extraídos para todos os conjuntos de dados, exceto o LAION, que fornece seus próprios embeddings pré-computados. No entanto, como esses embeddings diferem ligeiramente daqueles gerados usando a implementação oficial do CLIP, as imagens de consulta foram redimensionadas de acordo com o método usado no repositório de recuperação de clips para garantir a compatibilidade.

A recuperação foi realizada usando uma busca KNN, embora a escala do LAION exigisse o particionamento em blocos de milhões de imagens, com cada um indexado separadamente:

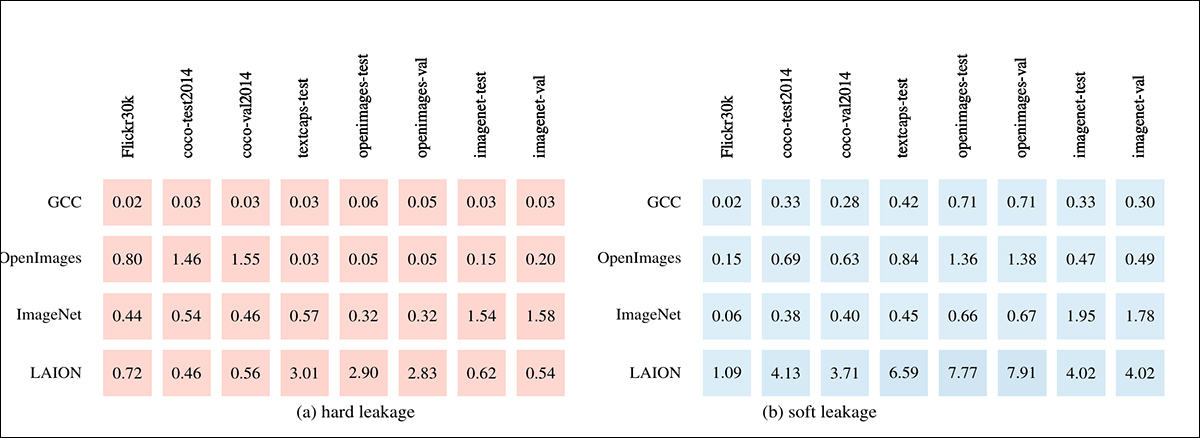

Vazamento entre conjuntos de dados, entre conjuntos de dados de referência (colunas) e conjuntos de dados de pré-treinamento (linhas). À esquerda, vemos vazamento "rígido" (imagens idênticas) e, à direita, vazamento "leve" (quase duplicatas).

Vazamentos entre conjuntos de dados foram observados em todos os conjuntos de dados de referência, com graus variados de gravidade. O LAION apresentou as maiores taxas de vazamentos graves (imagens idênticas), especialmente para dados de teste do OpenImages e do TextCaps, cada um excedendo 3%. O OpenImages também contribuiu com uma quantidade menor de vazamentos graves para o COCO.

Embora menos grave, o ImageNet ainda continha duplicatas rígidas de todos os benchmarks examinados; e o GCC apresentou o menor vazamento rígido geral, permanecendo abaixo de 1%.

O vazamento suave (quase duplicatas) foi mais disseminado: o LAION novamente produziu as maiores taxas, com sobreposição de até 7.9% para certos benchmarks; o OpenImages e o TextCaps foram os benchmarks mais afetados no geral; e o Flickr30k apresentou o menor vazamento.

Embora tais sobreposições possam representar apenas uma pequena parte dos conjuntos de avaliação, os autores observam que a sua presença pode permitir memorização e validade do teste de compromisso:

Exemplos de imagens vazadas. À esquerda, estão os casos de vazamento "grave", em que as imagens são idênticas dentro de um conjunto de dados (acima) ou entre conjuntos de dados (abaixo); à direita, os casos de vazamento "leve", em que as imagens são visualmente quase idênticas.

Efeito na avaliação a jusante

O artigo considera a seguir como o vazamento de dados afeta as avaliações posteriores (ou seja, o desempenho em tarefas padrão quando modelos pré-treinados são testados em benchmarks que contêm dados de treinamento duplicados).

Três tarefas foram consideradas: classificação de tiro zero; classificação supervisionada; e recuperação de texto e imagem.

Para cada tarefa, o desempenho do modelo foi avaliado em um conjunto de dados de referência para o qual amostras vazadas já haviam sido identificadas nos dados de pré-treinamento. Os resultados foram comparados em quatro subconjuntos: o benchmark completo; um subconjunto de amostras vazadas; um subconjunto de amostras sem vazamento; e um subconjunto selecionado aleatoriamente do mesmo tamanho do grupo vazado (usado como controle).

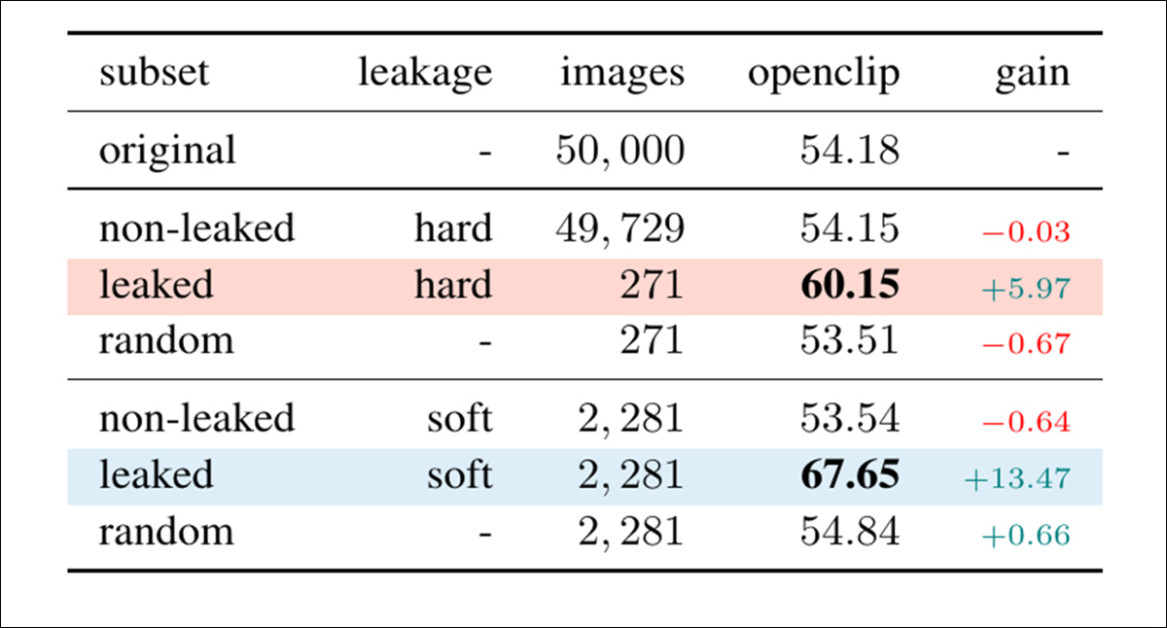

O efeito do vazamento de dados em três tarefas posteriores foi medido usando subconjuntos de benchmark conhecidos por conterem imagens vazadas. Na classificação de disparo zero, um modelo pré-treinado no LAION obteve precisão notavelmente maior em imagens vazadas do conjunto de avaliação do ImageNet, confirmando que a exposição a duplicatas quase idênticas durante o treinamento oferece uma vantagem mensurável:

Precisão da classificação de disparo zero no conjunto de validação do ImageNet em subconjuntos com e sem vazamento. A coluna final relata os ganhos de precisão em relação ao conjunto completo, e as linhas destacadas correspondem aos subconjuntos com vazamento.

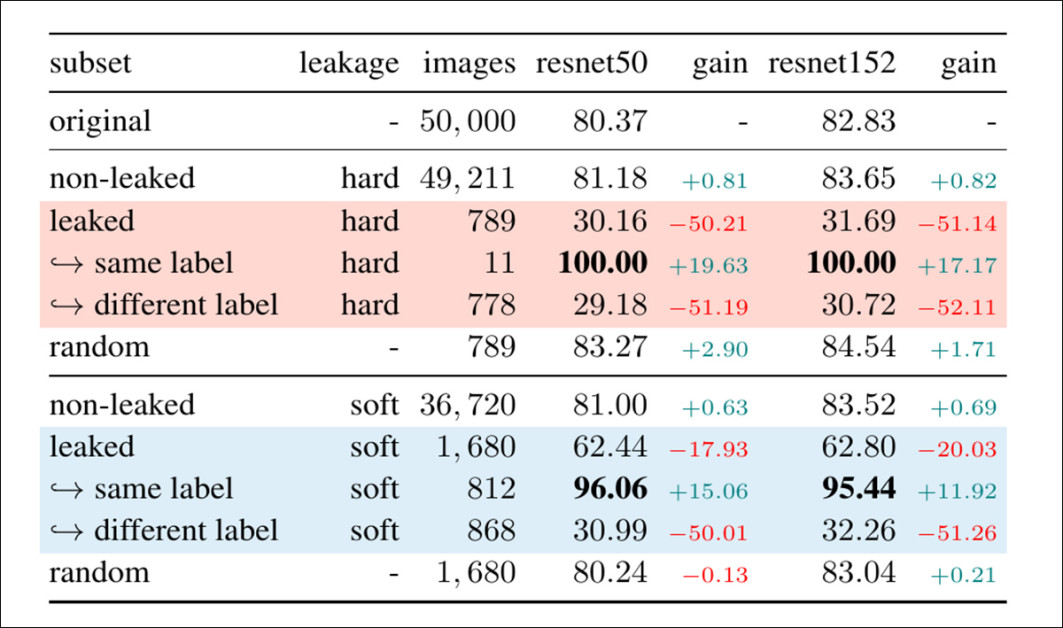

Para classificação supervisionada, o vazamento no ImageNet causou uma queda drástica no desempenho – a menos que a imagem vazada tivesse o mesmo rótulo em ambas as divisões, caso em que o modelo atingiu uma precisão quase perfeita, revelando um forte efeito de memorização:

Precisão de classificação supervisionada no conjunto de validação do ImageNet para subconjuntos, com e sem vazamento. As colunas de ganho mostram a variação em relação ao conjunto completo. Os subconjuntos com vazamento são destacados.

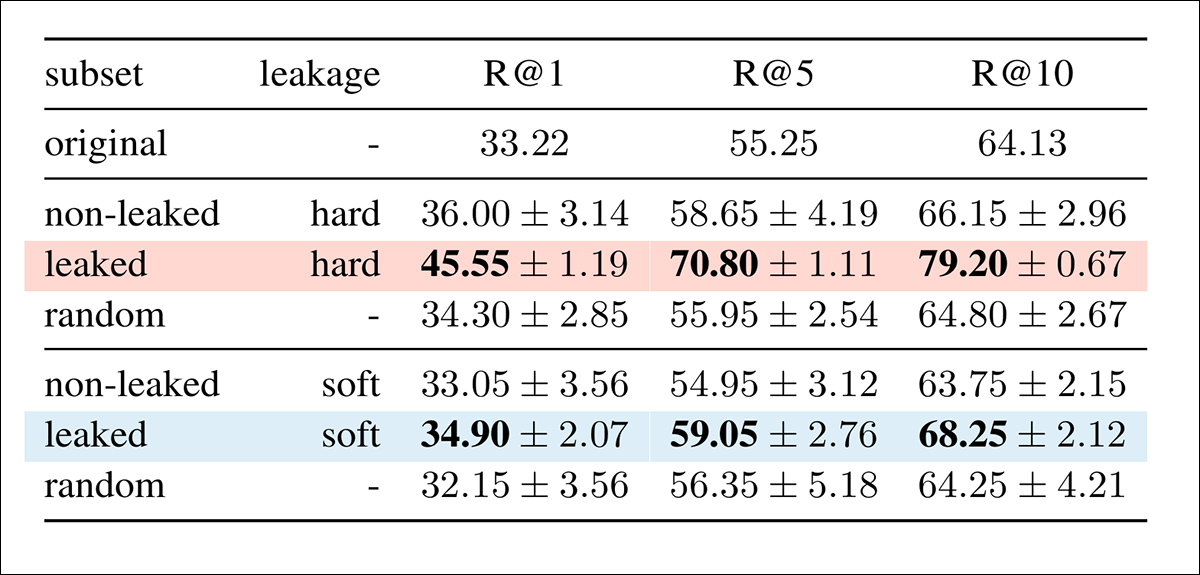

Na recuperação de imagem para texto, o desempenho melhorou novamente para amostras vazadas, com vazamentos rígidos e suaves levando a uma maior recuperação, e com subconjuntos vazados também produzindo resultados mais consistentes em todas as execuções:

Desempenho de recuperação de imagem para texto no Flickr30k em subconjuntos com e sem vazamento, com subconjuntos vazados destacados.

Os autores concluem:

'No geral, [mostramos] evidências consistentes de que o vazamento representa uma séria ameaça à avaliação justa de modelos em conjuntos de dados visuais, comprometendo um dos princípios mais fundamentais do aprendizado de máquina: não avaliar modelos com base em seus dados de treinamento.'

Conclusão

Um aspecto chocante do artigo, embora não seja nenhuma novidade, é o relato da necessidade de usar o CLIP para obter incorporações para a vasta montanha de dados de imagem no LAION, representando uma escala que não pode mais ser abordada de nenhuma outra forma além de agregada, lidando com metadados tokenizados em vez de características mais detalhadas que podem ser inspecionadas quando um conjunto de dados é mais gerenciável.

É uma ilustração clara de até que ponto o treinamento de modelos de visão e linguagem excedeu definitivamente os limites e capacidades da supervisão humana ou qualquer tipo de curadoria manual além de subamostras representativas.

* Talvez de forma um pouco confusa, o problema da duplicação é definido no artigo como "vazamento".

† Ênfase dos autores.

Primeira publicação terça-feira, 26 de agosto de 2025