Ângulo de Anderson

Imagens de anúncios geradas por IA que segmentam seu público-alvo – e, eventualmente, você?

Os anunciantes buscam personalizar os anúncios para cada espectador, visando aumentar os cliques. Embora a criação de anúncios sob medida para cada pessoa seja atualmente inviável, novas pesquisas sugerem que imagens geradas por IA poderão em breve ser direcionadas com eficácia a grupos demográficos específicos.

A publicidade personalizada apresentada no filme de ação e ficção científica de Steven Spielberg, de 2002. Minority Report deixou uma marca duradoura, impressão até mesmo assombrosa sobre a cultura, com sua representação vívida de outdoors publicitários proativos que reconhecem pessoas em meio à multidão e exibem mensagens promocionais diretamente para elas.

Muitos grupos de consumidores podem considerar esse nível de reconhecimento do público como um sinal de sucesso. como um pesadeloE embora o progresso nesse sentido tenha sido retardado pelas consequências do escândalo da Cambridge Analytica. escândaloO ideal de engajamento direto e altamente segmentado continua sendo um objetivo valioso na publicidade.

Na verdade, sistemas que conseguem analisar em detalhes as características de um espectador específico. permanecem em constante desenvolvimento – embora, nesses casos, a pesquisa corporativa tenha que tomar medidas respeitar as leis em torno de informações de identificação pessoal (PII); leis que foram reforçadas na Europa na última década, com essas proteções aprimoradas disseminadas em outros lugares por meio de o Efeito Bruxelas.

Ei você!

Agora que os anúncios e o conteúdo de marketing são gerados por IA, e guarante que os mesmos estão em ascensãoNo entanto, os anunciantes devem estar cientes do custo potencial dos anúncios de IA direcionados a indivíduos específicos, nos quais as imagens e o texto são gerados de forma oportunista e instantânea.

Por exemplo, mesmo que uma imagem personalizada pudesse ser gerada muito rapidamente, os custos em grande escala seriam significativos. Além disso, a automação processos de leilão de anúncios online Operam em intervalos de tempo críticos, na ordem de milissegundos, o que torna o conteúdo de imagem personalizado para o usuário um desafio, pelo menos por enquanto; e o conteúdo de vídeo uma perspectiva ainda mais distante.

No entanto, os obstáculos técnicos envolvidos na abordagem de níveis mais elevados grupos de coortes demográficas Em um público conectado à internet (via laptops, celulares, smart TVs, etc.), os impactos não são tão severos – e uma nova colaboração internacional entre a academia e a indústria está propondo uma maneira de criar imagens publicitárias distintas para diferentes grupos demográficos, levando em consideração fatores como idade e localização:

Do novo trabalho: exemplos de geração de anúncios personalizados, onde um único produto é apresentado em estilos diferentes para diferentes grupos de espectadores. A primeira linha mostra as imagens originais do produto. As três linhas seguintes mostram versões adaptadas para três tipos distintos de público por produto, com base em diferenças em características como idade, estilo de vida ou preferência estética. Esses tipos de grupo não são predefinidos, mas descobertos automaticamente. fonte

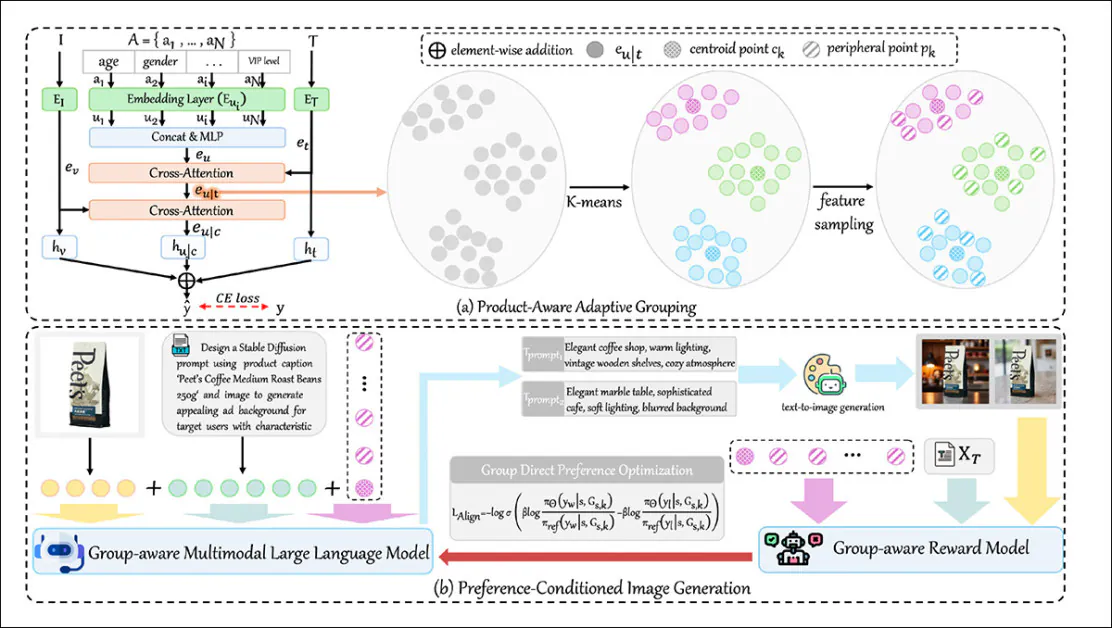

A nova estrutura – intitulada Tamanho único, serve para várias pessoas (OSMF) – visa preencher a lacuna entre a publicidade de amplo alcance e a personalização excessivamente granular, gerando imagens de anúncios diferentes para grupos de público-alvo descobertos automaticamente, utilizando agrupamento com reconhecimento de produto alinhar o conteúdo visual com as preferências de cliques de diferentes grupos demográficos.

Os autores declaram:

'[Nós] apresentamos uma estrutura unificada que alinha diversas preferências de cliques em grupo na geração de imagens publicitárias em larga escala.

'O OSMF começa com o agrupamento adaptativo com reconhecimento de produto, que organiza dinamicamente os usuários com base em seus atributos e características do produto, representando cada grupo com ricas características de preferência coletiva.'

Testados em comparação com estruturas semelhantes, os autores afirmam ter obtido resultados de última geração.

Embora o estudo identifique diversos grupos de coortes, o artigo não especifica quais características demográficas são representadas por cada um. G agrupamento, embora estes pareçam provavelmente corresponder ao tradicional grupos de segmentação de mercado.

Portanto, com base nos vários exemplos apresentados no artigo principal e no apêndice, não é fácil afirmar com certeza por que determinados planos de fundo ou iluminação seriam mais atraentes para um grupo do que para outro, uma vez que não conhecemos as características de nenhum grupo:

Não existem padrões consistentes de "azul para meninos, rosa para meninas", etc., em estilos de imagem específicos para cada grupo, que possam revelar a qual grupo pertence cada tipo de pessoa – as definições, como evidenciado pela literatura existente, são muito mais complexas e sutis.

O que talvez seja mais preocupante, para aqueles que desconfiam das práticas de segmentação de anúncios, é a possibilidade de explorar informações específicas de cada usuário na geração de imagens específicas em anúncios**.

O novo papel é intitulado Um tamanho, várias opções: alinhando preferências de cliques de grupos diversos na geração de imagens publicitárias em larga escala.e é fruto do trabalho de 17 pesquisadores do Laboratório Nacional de Reconhecimento de Padrões em Pequim; da 'Escola de IA da UCAS'**; da empresa chinesa de comércio eletrônico JINGDONG; da Universidade de Ciência e Tecnologia de Hong Kong em Guangzhou; e do Laboratório de Reconhecimento de Padrões da Universidade de Ciência e Tecnologia de Nanjing.

Forma

O sistema usa clustering adaptativo (um método que encontra agrupamentos naturais ao relacionar características do usuário com a forma como ele reage a diferentes produtos) para agrupar usuários com base em como suas características moldam as preferências visuais em um determinado contexto de produto. A implementação dessa abordagem pelos autores é chamada de Agrupamento adaptativo com reconhecimento de produto (PAAG).

Esses agrupamentos não são fixos de antemão, mas são descobertos a partir de padrões nos dados.

Um gerador de imagens condicional, intitulado Geração de imagens condicionada por preferências (PCIG), e então usa o perfil de cada grupo para criar imagens publicitárias que correspondam aos prováveis gostos do grupo:

A estrutura OSMF agrupa os usuários de acordo com a forma como suas características influenciam as preferências de produtos e, em seguida, usa esses perfis de grupo para gerar imagens de anúncios que correspondam aos gostos de cada grupo. O PAAG lida com o agrupamento e o PCIG cria as imagens usando instruções e feedbacks personalizados para cada grupo.

O gerador de imagens utiliza uma versão não especificada de Difusão Estável, juntamente com um apropriado Conjunto de ferramentas ControlNet (este último, para ajudar a manter a consistência entre as várias gerações da coorte).

No fluxo de trabalho, o PAAG primeiro codifica a relação entre os recursos do usuário e os aspectos de texto e imagem do produto, usando um conjunto de codificadores dedicados e um atenção cruzada mecanismo para fundi-los em uma preferência unificada embutindo que reflete a probabilidade de um usuário clicar em um anúncio específico.

O PAAG então modela como diferentes combinações de atributos do usuário interagem com os títulos e imagens dos produtos. Os recursos de texto e imagem são extraídos usando CLIP e ResNetcodificadores baseados em - e características do usuário, como gênero, local, idade, ou dispositivo são passados por um MLP, que permite a atenção cruzada sobre as características de texto e imagem do produto.

A incorporação resultante representa o de cada usuário probabilidade de clique para um produto específico em um contexto visual específico. Uma vez obtidas essas representações de preferências do usuário em relação ao produto, o PAAG utiliza Agrupamento K-means Agrupar usuários que respondem de forma semelhante a um determinado produto.

O PAAG seleciona o número ideal de grupos de usuários para cada produto, verificando o grau de separação entre os clusters. Em vez de usar apenas um ponto médio por grupo, ele amostra vários pontos a diferentes distâncias para capturar uma gama mais ampla de preferências.

Esses perfis de grupo são então passados como tokens para o modelo de linguagem grande multimodal com reconhecimento de grupo (G-MLLM), que os utiliza para gerar imagens de anúncios personalizadas para cada grupo.

Geração de imagens com base nas preferências do usuário

Do lado do usuário, o G-MLLM aprende a prever quais membros do grupo provavelmente clicarão em seguida e como descrever características comuns em linguagem natural. Do lado do produto, ele aprende a resumir o produto mostrado em uma imagem e a gerar legendas no estilo de anúncios que correspondam tanto ao item quanto ao grupo.

Para refletir o comportamento real do usuário, o modelo é estendido para um modelo de recompensa com consciência de grupo (GRM). O GRM é treinado pelos próprios pesquisadores. Preferência de imagem de publicidade agrupada (GAIP), conjunto de dados† (ver abaixo) para comparar pares de imagens do mesmo produto e identificar qual delas funcionou melhor com um determinado grupo, usando dados reais de cliques.

Esse sinal de recompensa é então usado para sintonia fina G-MLLM com Grupo-DPO, um método que ensina a priorizar estímulos que levam a um melhor engajamento em nível de grupo.

Dados e testes

Desenvolvendo o GAIP

Observando a falta histórica de conjuntos de dados relacionados às preferências de publicidade baseadas em grupos, e que coleções anteriores como Sopas Personalizadas e CG4CTR Como os dados eram de escala muito pequena ou pouco especificados, os pesquisadores desenvolveram sua própria coleção, a já mencionada GAIP, derivada dos 'registros de publicidade industrial' de uma plataforma de comércio eletrônico não especificada.

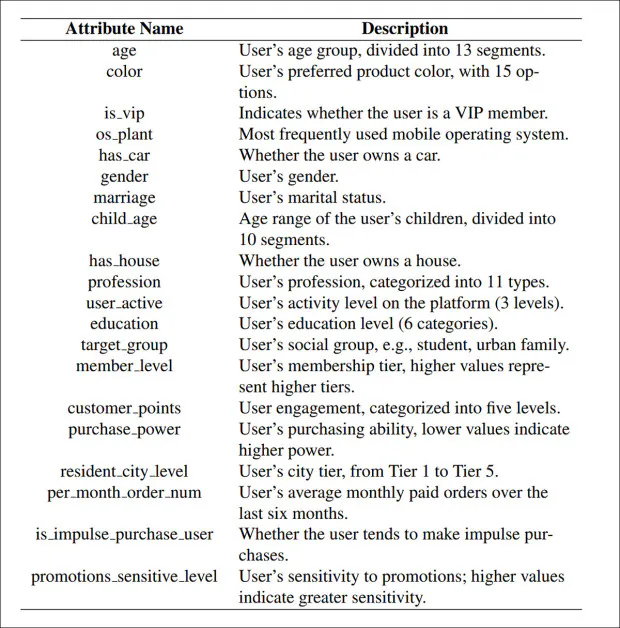

Os registros foram coletados ao longo de um período de três semanas, com cada entrada contendo a imagem e o título do produto, o perfil do visualizador (incluindo idade, nível de gastos e sensibilidade às promoções), e se o anúncio foi clicado.

O conjunto de dados inclui mais de 40 milhões de usuários, 2 milhões de produtos e quase 10 milhões de imagens publicitárias, com grande variedade visual entre os itens.

Os usuários foram agrupados por PAAG em clusters distintos para cada produto, e a taxa de cliques (CTR) foi calculada por imagem dentro de cada grupo:

A partir do material suplementar do novo artigo, uma pequena amostra de alguns dos critérios que definem a GAIT (Análise da Marcha).

O GAIP é então formado como um conjunto de tuplas (imagem publicitária, título do produto, incorporação de grupo, CTR específico do grupo) combinando cada imagem e título com sua CTR e o embedding do grupo que a visualizou.

Para garantir a confiabilidade, apenas os produtos com exposição suficiente são mantidos, resultando em um conjunto de dados de 610,172 amostras em nível de grupo.

O GAIP é substancialmente maior do que os conjuntos de dados anteriores: enquanto a maioria dos benchmarks anteriores envolve menos de dez grupos de usuários, o GAIP inclui quase 600,000 registros de preferências reais por grupo, oferecendo insights mais profundos sobre as preferências em nível de grupo.

Testes

Para treinar o pipeline PCIG, os pesquisadores extraíram características de imagem e texto usando ResNet e o codificador de texto CLIP, mapeando-as em embeddings de 128 dimensões por meio de aprendizado de máquina. camadas linearesPara manter a eficiência, o PAAG foi limitado a cinco grupos de usuários por produto.

Os embeddings de grupo foram construídos usando uma estratégia de amostragem baseada em percentis, extraindo múltiplos pontos dos percentis 15, 55 e 95, para capturar tanto as preferências centrais quanto as periféricas.

LLaVA foi usado como base para o G-MLLM, e o pré-treinamento foi realizado ao longo de dez anos. épocas com um aprendizado de cosseno cronograma em taxa de Aprendizagem de 2e-6, exigindo um formidável cinco dias de treinamento em um cluster de oito GPUs NVIDIA H100, cada uma com 80 GB de VRAM.

O GRM foi treinado reconstruindo o GAIP com pares de imagens de produtos correspondentes e, em seguida, inicializado com os mesmos pesos do G-MLLM. Durante o estágio final do Group-DPO, o GRM foi congeladoe G-MLLM ajustado usando LoRA por três épocas – novamente, com uma taxa de aprendizado de 2e-5, no mesmo cluster NVIDIA.

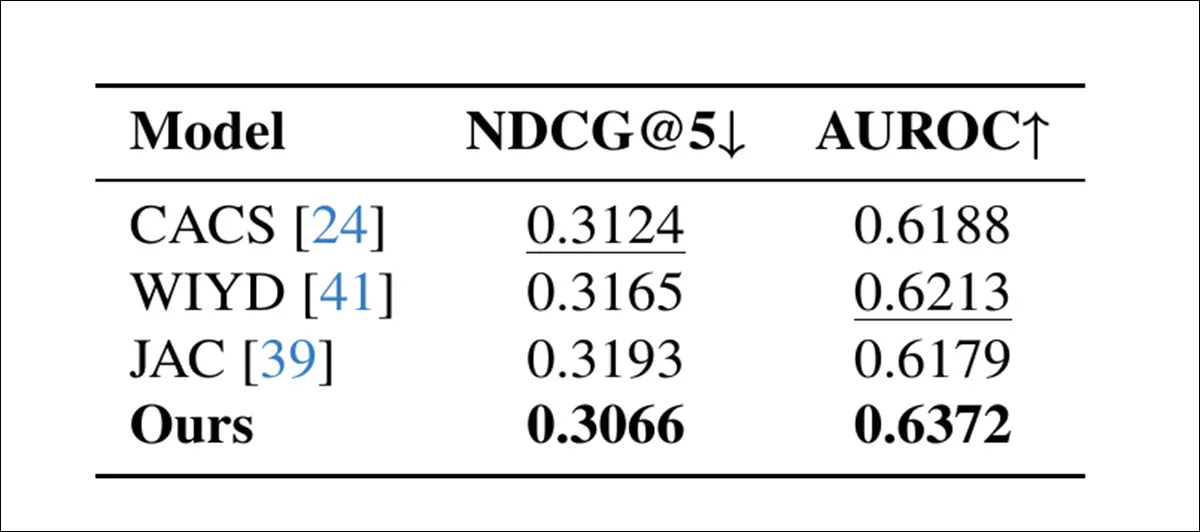

As métricas utilizadas para a primeira avaliação foram: NDCG@5 e AUROCO NDCG@5 mediu o quão diferente cada grupo classificou o mesmo conjunto de imagens de anúncios, com valores mais baixos indicando uma separação mais clara nas preferências; e a AUROC foi usada para avaliar o quão bem cada modelo distinguiu o conteúdo clicado do conteúdo não clicado.

Todas as métricas foram calculadas com base nos resultados de agrupamento de 1,000 produtos, totalizando cerca de 100,000 amostras, e foram usadas para comparar o PAAG com três sistemas anteriores: CACS; WIYD; e JAC:

Resultados da modelagem de preferências comparados a métodos anteriores. Valores mais baixos de NDCG@5 e valores mais altos de AUROC indicam melhor desempenho. As melhores pontuações estão em negrito e as segundas melhores, sublinhadas.

Destes resultados, os autores comentam:

Nosso método alcança desempenho superior em ambas as métricas. Concretamente, o PAAG atinge o menor NDCG@5 (0.3066), superando a melhor linha de base (CACS), indicando padrões de preferência intergrupal mais distintos para geração eficaz de publicidade em grupo.

Além disso, o PAAG alcança a maior AUROC (0.6372), melhorando em 0.0159 em relação à linha de base mais forte (WIYD).

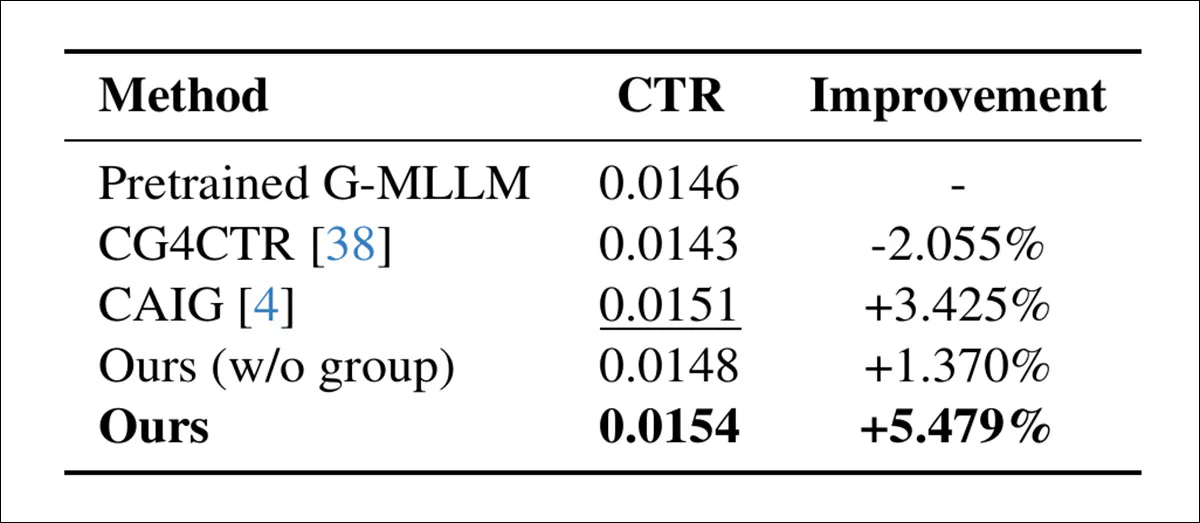

Uma segunda rodada de testes verificou se o sistema conseguia direcionar melhor os anúncios aos grupos de usuários corretos:

Comparação online de CTR mostrando que a geração personalizada em grupo ('Nossa') supera todas as linhas de base, incluindo CAIG e G-MLLM pré-treinado.

Neste estudo, o PCIG apresentou taxas de cliques mais altas do que modelos mais antigos, como o CAIG e o G-MLLM, com uma melhoria de 5.5%. O GRM também foi testado offline, verificando se conseguia escolher corretamente o melhor anúncio em um par, com base nas preferências do grupo. Ele superou todos os modelos de referência, incluindo modelos de uso geral, com um ganho de 4.7% em relação ao CAIG.

Um teste qualitativo final foi realizado para avaliar se o PCIG conseguia refletir as preferências de cada grupo no estilo das imagens geradas. Como mostra a figura abaixo, o mesmo produto foi renderizado de forma diferente para cada grupo, com alterações na paleta de cores, tonalidade e composição visual:

Resultados completos dos testes qualitativos, apresentados anteriormente neste artigo.

Essas variações, argumentam os autores, alinharam-se com as preferências de cliques inferidas para cada grupo, demonstrando que o PCIG poderia produzir resultados estilisticamente distintos, preservando a relevância e o apelo. Os autores afirmam:

"[A PCIG] garante imagens estilisticamente diversas para atender às preferências de cliques de diferentes grupos de usuários, demonstrando assim sua forte capacidade de adaptar a geração às demandas heterogêneas dos usuários e capturar diferenças sutis e refinadas de preferências entre diversos grupos de usuários, destacando seu potencial para a geração de imagens publicitárias com reconhecimento de grupo em larga escala."

Conclusão

Talvez o aspecto mais intrigante deste projeto seja a correlação desconhecida entre os estilos de saída em imagens direcionadas a grupos específicos para o mesmo produto (das quais existem várias páginas a mais de exemplos nos materiais suplementares do artigo do que podemos reproduzir aqui).

Podemos assumir que urbano A formação está relacionada à idade, ou seja, aos graduados que estão começando suas carreiras, e isso rural Os ambientes são voltados para os tipos mais prósperos da Geração X, que identificam a estrada aberta como uma espécie de "liberdade definitiva"? Poderíamos analisar esses resultados de testes de Rorschach o dia todo.

O potencial desses sistemas reside em dois fatores: percepção e latência. A percepção depende da capacidade dos sistemas de rastreamento emergentes de extrair informações relevantes suficientes dos usuários para viabilizar publicidade eficaz baseada em grupos, ao mesmo tempo que prepara o terreno para anúncios mais precisos e direcionados individualmente no futuro.

A latência representa um desafio ainda maior, já que essas imagens de anúncios personalizados precisam ser geradas e entregues quase instantaneamente; embora alguns modelos recentes de conversão de texto em imagem consigam produzir resultados em apenas alguns segundos, mesmo esse atraso pode ser muito longo para leilões de anúncios em tempo real.

Uma possível solução é produzir as imagens localmente. na GPU do navegador, evitando viagens de ida e volta na rede; ou para criar uma série de imagens preventivamente, pré-armazenadas em cache no cliente.

** Esse aspecto é omitido no novo artigo, assim como o potencial de abuso de deepfakes em novas estruturas de IA é frequentemente atenuado pelo uso de figuras de animais fofinhos (em vez de pornografia gerada por IA) em novos estudos. Contudo, o tipo de imagem apresentado no trabalho representa os anunciantes em seu melhor comportamento, em vez de retratar o quão personalizados os anúncios visuais poderão se tornar, à medida que os métodos de segmentação de consumidores se unem à IA generativa de resposta rápida.

** Não consigo identificar essa instituição, já que 'UCAS' geralmente se refere a uma conhecida central de informações sobre candidaturas a universidades do Reino Unido. Agradeceria qualquer esclarecimento.

† Que os pesquisadores prometem divulgar em breve. repositório GitHub associado.

Primeira publicação quinta-feira, 5 de fevereiro de 2026