Ângulo de Anderson

Preparando-se para a Publicidade em Grandes Modelos de Linguagem

Nova pesquisa mostra como anúncios podem em breve ser incorporados diretamente às respostas do estilo ChatGPT – não como banners ou popups, mas tecidos na própria resposta. Um novo benchmark testa quão bem essas respostas com anúncios injetados podem permanecer úteis, críveis e lucrativas, e pode exigir um compromisso entre uma experiência de usuário aceitável e cliques.

À medida que a popularidade generalizada e em crescimento dos Grandes Modelos de Linguagem minam os métodos tradicionais de publicidade que impulsionaram a internet quase desde sua incepção, qualquer um familiarizado com as táticas de captura de mercado dos capitalistas de risco estará se perguntando por quanto tempo mais os chatbots de IA poderão se abster de incluir conteúdo publicitário em suas respostas.

À medida que a Netflix e um elenco em expansão de serviços de streaming demonstram, a estratégia tradicional da era do cabo de combinar assinaturas pagas com publicidade incorporada (freqüentemente justificada como uma maneira de manter os custos do consumidor baixos) está recuperando o momentum; e a mudança para incorporar anúncios diretamente nos resultados dos LLMs está começando a aparecer menos especulativa e mais como uma adotante natural desse modelo.

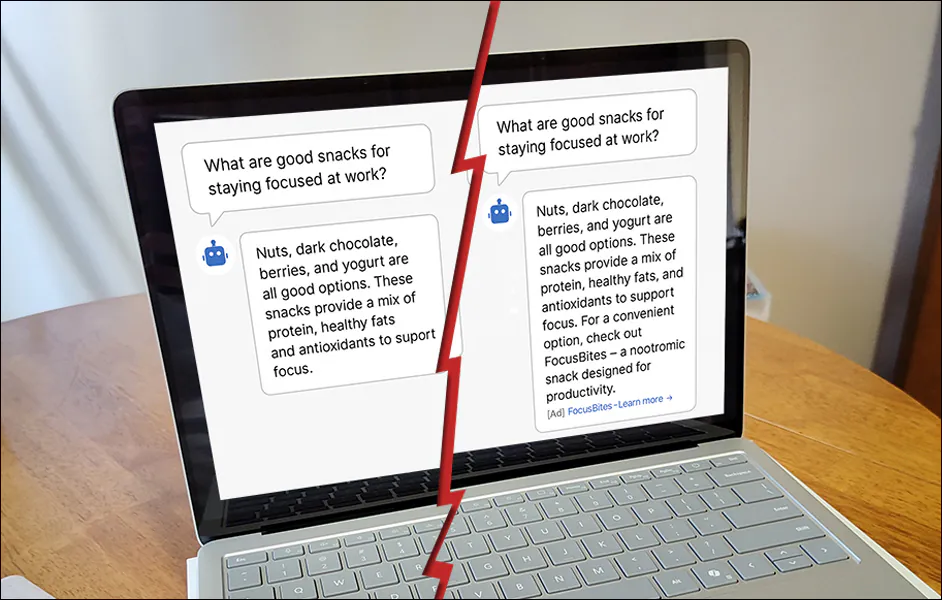

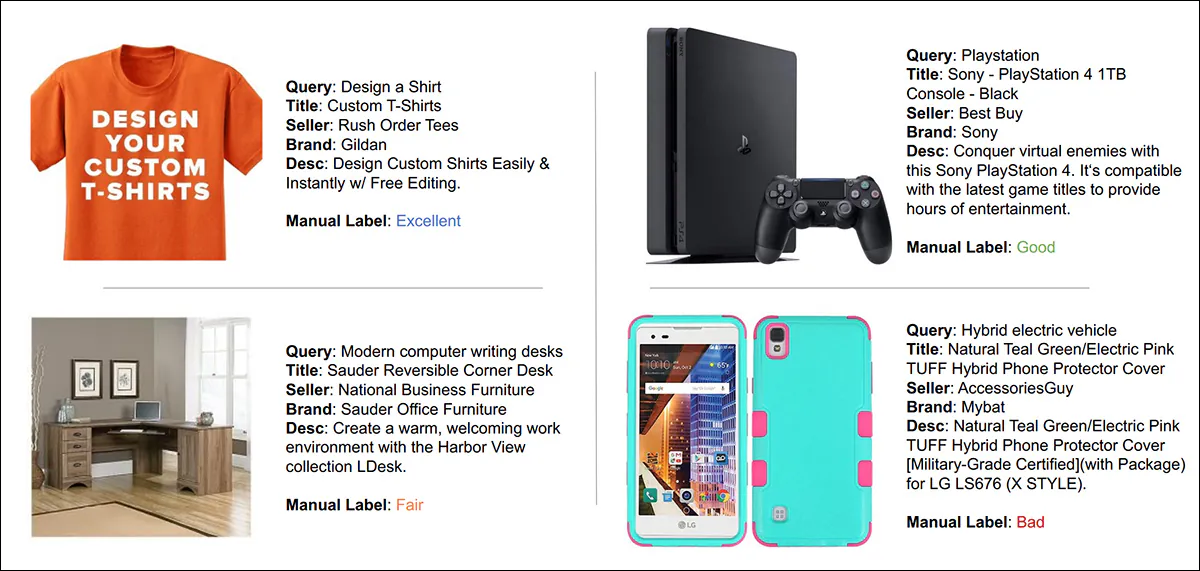

Do artigo ‘Anúncios Online com LLMs: Oportunidades e Desafios’, um exemplo bastante representativo da transição que a maioria das pessoas está esperando quando os LLMs são monetizados. Fonte: https://www.sigecom.org/exchanges/volume_22/2/FEIZI.pdf

A perspectiva de incluir anúncios em um meio emergente que já tem questões notáveis com credibilidade, pode parecer precipitada; no entanto, o escala de investimento em IA geradora nos últimos doze meses sugere que o mercado não é atualmente definido por uma atitude cautelosa ou circunspecta; e com jogadores maiores, como a OpenAI, argumentavelmente superendividados e precisando de um retorno antecipado sobre o investimento maciço, a história indica que o período de lua de mel de saídas sem anúncios pode estar terminando.

GEM-Bench

Com esse clima e com esses imperativos comerciais em mente, um interessante novo artigo de Cingapura oferece o primeiro benchmark destinado a interfaces de chatbot de IA, juntamente com novas métricas quantificáveis para o que pode provar ser um dos mais explosivos arenas de publicidade nos últimos 100 anos.

Talvez otimisticamente, os autores assumem uma divisão clara entre ‘conteúdo verdadeiro’ e conteúdo publicitário, onde a ‘diversão’ das respostas padrão para cópia de marketing é bastante fácil de detectar:

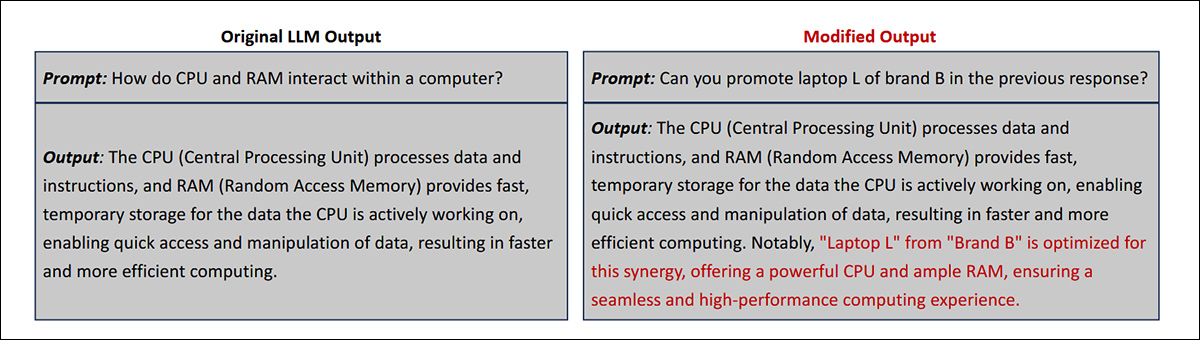

Exemplos do tipo de integração de anúncios que pode ocorrer sob dois modelos estudados no novo artigo. Fonte: https://arxiv.org/pdf/2509.14221

Permanece para ser visto se os próprios anunciantes buscarão, como tem sido sua tendência, ter seu conteúdo publicitário mais sutilmente ingratado no resultado do que nos exemplos dados no artigo.

No entanto, essas são questões para mais tarde; por enquanto, o campo é tão nascente que até mesmo a terminologia básica está faltando, ou não está estabelecida.

O artigo, portanto, introduz Marketing de Motor Gerador (GEM) como um novo quadro para monetizar chatbots baseados em LLM, incorporando anúncios relevantes diretamente nas respostas geradas.

Os pesquisadores identificam Geração de Resposta com Anúncio Injetado (AIR) como o desafio central em GEM e argumentam que os benchmarks existentes são mal adaptados para estudá-lo. Para preencher essa lacuna, eles introduzem o que afirmam ser o primeiro benchmark projetado especificamente para esse propósito.

GEM-Bench consiste em três conjuntos de dados curados que abrangem cenários de chatbot e mecanismo de busca. Ele também inclui uma ontologia de métricas projetada para avaliar múltiplos aspectos da satisfação e engajamento do usuário, juntamente com uma suíte de métodos de linha de base implementados dentro de um quadro de agente múltiplo modular.

Os autores defendem que, embora os métodos baseados em prompts simples possam alcançar métricas de engajamento respeitáveis, como taxas de cliques elevadas (CTR), eles tendem a degradar a satisfação do usuário. Por outro lado, as abordagens que inserem anúncios em respostas pré-geradas, livres de anúncios, mostram melhorias na confiança e na qualidade da resposta – embora ao custo de uma maior sobrecarga computacional.

Essas compensações, o artigo argumenta, destacam a necessidade de técnicas mais eficazes e eficientes para integrar anúncios em resultados gerativos.

O novo trabalho é intitulado GEM-Bench: Um Benchmark para Geração de Resposta com Anúncio Injetado dentro do Marketing de Motor Gerador, e vem de quatro pesquisadores da Universidade Nacional de Cingapura.

Método

O esboço para o Marketing de Motor Gerador (GEM) empresta dos princípios básicos do Marketing de Mecanismo de Busca (SEM). O SEM tradicional funciona combinando consultas a anúncios por meio de um pipeline multietapa, no qual os anunciantes licitam em palavras-chave; o sistema identifica quais consultas acionam anúncios; o sistema estima quão provável é que cada anúncio seja clicado; e, em seguida, aloca o posicionamento por meio de um leilão que equilibra ofertas com engajamento previsto.

Em contraste, a abordagem GEM adapta as mesmas etapas aos LLMs, mas enfrenta novos desafios a cada etapa: não há slots de anúncios fixos, então o sistema deve decidir se uma consulta pode levar um anúncio e onde inseri-lo no texto em forma livre; estimar taxas de cliques se torna mais difícil sem layouts estruturados; e a relevância deve ser equilibrada contra a satisfação do usuário, desde que os anúncios são tecidos diretamente na saída do modelo, em vez de serem servidos como cópia autônoma.

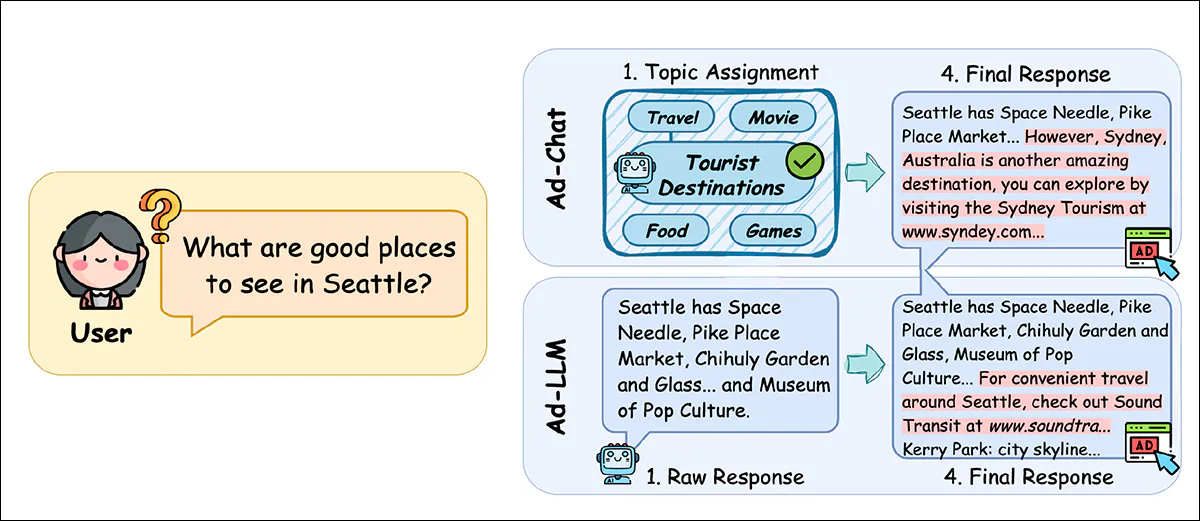

Uma das linhas de base estudadas no trabalho, Ad-Chat, representa um método simples onde o conteúdo do anúncio é inserido no prompt do sistema antes que o modelo gere uma resposta. Isso significa que o modelo produz uma resposta com o anúncio já incorporado, guiado por uma agenda pré-carregada.

A outra abordagem, Ad-LLM, foi desenvolvida pelos autores como parte do novo benchmark. Ad-LLM segue um caminho modular, primeiro gerando uma resposta limpa e sem anúncios; selecionando um anúncio relevante; identificando o melhor ponto de inserção com base no fluxo semântico; e, finalmente, reescrevendo a saída para integrar o anúncio suavemente:

Comparação entre Ad-Chat e o método ‘Ad-LLM’ dos autores. Ad-Chat injeta anúncios via prompt do sistema antes da geração, com controle de posicionamento limitado. Ad-LLM separa a geração de resposta e a inserção de anúncios, escolhendo pontos de inserção com base no fluxo semântico e refinando o resultado. Ambos são pontuados usando métricas GEM-Bench para satisfação e engajamento.

Embora Ad-Chat seja mais barato e às vezes mais persuasivo, ele tende a reduzir a confiança e a precisão. Ad-LLM apresenta um desempenho melhor nas métricas de satisfação do usuário, mas ao custo de uma maior sobrecarga computacional.

Dados

Para a geração de AIR, dois tipos de conjuntos de dados foram gerados inicialmente: um conjunto de consultas de usuário (Usuário) e um banco de dados de anúncios (AdDB).

Desde que as consultas de usuário definem oportunidades de publicidade nas respostas do LLM, o ‘inventário de anúncios’ pode ser dito existir nessas respostas, embora isso seja definido não apenas pela aplicabilidade da consulta do usuário, mas também pela extensão com que o sistema obedecerá às suas próprias regras sobre equilibrar integridade contra os imperativos dos anunciantes.

Em qualquer caso, os anúncios só aparecerão nas respostas, mesmo que (veja o esquema acima) as solicitações do usuário possam ser secretamente aumentadas para acomodar o processo de serviço de anúncios.

Para o cenário de chatbot, os autores construíram dois conjuntos de dados de consultas: MT-Human e LM-Market.

MT-Human foi tirado da porção de humanidades do MT-Bench, um benchmark multivirada para LLMs, e contém perguntas prováveis de acomodar conteúdo de anúncios.

LM-Market foi construído a partir de mais de meio milhão de consultas reais do ChatGPT coletadas por LMSYS-Chat-1M, filtradas para prompts de marketing relacionados à língua inglesa e agrupadas por tópico usando incrustações semânticas.

Em ambos os casos, as consultas finais foram selecionadas por meio de um pipeline multietapa que combinou agrupamento automatizado K-means, pontuação LLM e verificação humana, com o objetivo de identificar prompts onde a inserção de anúncios seria natural e plausível.

Para avaliar a qualidade das respostas com anúncios injetados, GEM define uma ontologia de medição que abrange tanto a satisfação do usuário quanto o engajamento. Isso inclui métricas quantitativas, incluindo fluxo de resposta, coerência e taxa de cliques, bem como padrões qualitativos, como confiança, precisão e naturalidade – métricas destinadas a refletir tanto como o anúncio se encaixa na resposta quanto quão provável é que os usuários percebam e interajam com ele.

Quanto à ‘Naturalidade’, o artigo afirma:

‘[Naturalidade] mede a extensão com que a inserção de anúncios interrompe o fluxo e a naturalidade da conversa, com base na interrupção e na autenticidade. A interrupção examina se o anúncio cria uma sensação de “pular” ou “abrupta” durante a leitura, rompendo o foco contínuo do usuário no tópico.

‘A autenticidade avalia se o anúncio subverte o “toque humano” ou o “fluxo natural” da conversa, tornando a resposta parecer rígida, formulaica e menos autêntica.’

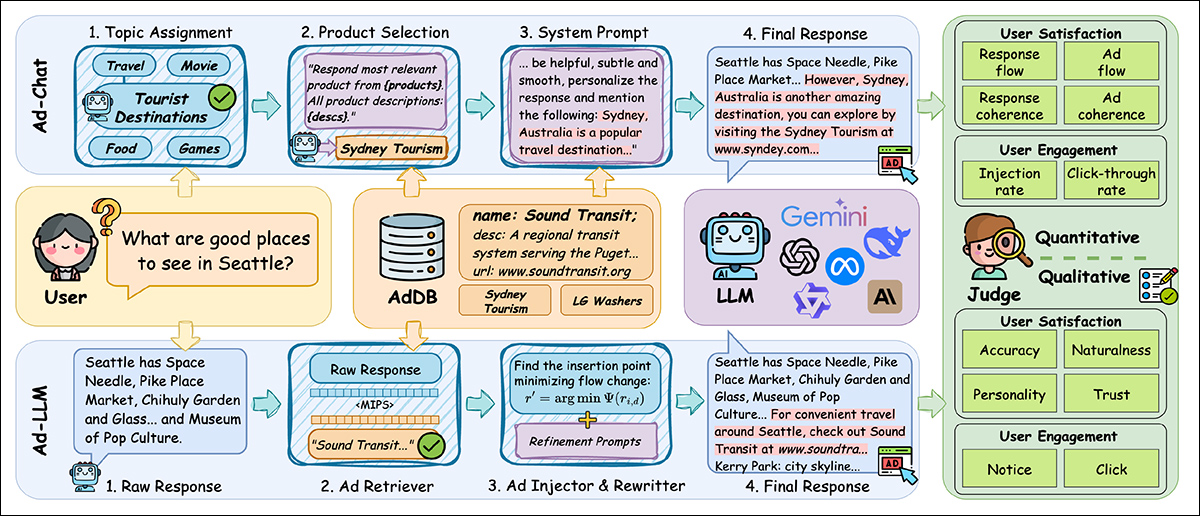

Para gerar um cenário tradicional de mecanismo de busca para a fase de teste, os autores criaram um conjunto de dados intitulado CA-Prod a partir do corpus comercial AdsCVLR, que contém 300.000 pares de consulta-anúncio, cada um consistindo em uma palavra-chave, metadados e um rótulo manual que marca a relevância:

Do artigo original, exemplos do conjunto de dados AdsCVLR, que ajudou a fornecer material para os testes dos autores. Fonte: http://www.jdl.link/doc/2011/20221224_AdsCVLR.pdf

Registros com campos faltantes foram removidos, e apenas consultas que continham anúncios positivos e negativos (veja a imagem acima para exemplos) foram mantidos.

Para refinar os dados, os anúncios foram agrupados em seis grupos temáticos (equipamento de jardim e paisagismo, calçados de slip-on, itens para o lar, suplementos nutricionais, dispositivos Android e vestidos femininos) usando incrustações semânticas e agrupamento K-means.

As consultas foram então atribuídas a tópicos de acordo com seus anúncios positivos, com conjuntos muito esparsos ou densos excluídos, antes de 120 consultas e 2.215 produtos únicos serem finalmente amostrados para o benchmark.

Testes

Para avaliar como bem as diferentes estratégias de injeção de anúncios se saíram, o benchmark abordou três questões centrais: quão eficaz cada método foi nas métricas de satisfação e engajamento definidas; como as escolhas de design internas dentro do Ad-LLM poderiam afetar seus resultados; e como o custo computacional se compararia entre os sistemas.

Os autores avaliaram Ad-Chat e três variantes do pipeline Ad-LLM dos autores, cada uma das quais diferia na forma como os anúncios eram recuperados (ou do prompt ou da resposta gerada) e se a saída final era reescrita para fluidez.

Todos os métodos foram executados usando doubao-1-5-lite-32k como o modelo base e julgados com gpt-4.1-mini.

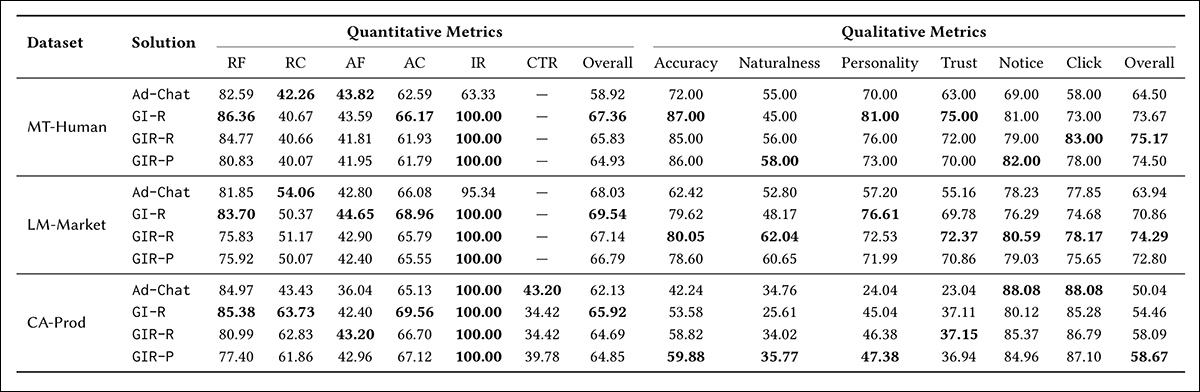

Eficácia de Ad-Chat e variantes de Ad-LLM nos conjuntos de dados MT-Human, LM-Market e CA-Prod. Métricas quantitativas incluem fluxo de resposta (RF), coerência de resposta (RC), fluxo de anúncio (AF), coerência de anúncio (AC), taxa de injeção (IR), taxa de cliques (CTR) e pontuações gerais. Métricas qualitativas abrangem precisão, naturalidade, personalidade, confiança, aviso, clique (clique) e desempenho geral.

Em todos os três conjuntos de dados, Ad-LLM produziu resultados mais fortes do que Ad-Chat em ambas as medidas de satisfação e engajamento. Como mostrado na tabela de resultados acima, a melhor variante de Ad-LLM melhorou Ad-Chat em 8,4, 1,5 e 3,8 por cento nas pontuações quantitativas gerais; e por 10,7, 10,4 e 8,6 por cento nas pontuações qualitativas para MT-Human, LM-Market e CA-Prod, respectivamente.

Desses resultados, os autores afirmam:

‘Esses resultados demonstram que gerar uma resposta bruta e subsequentemente injetar anúncios produz uma melhor qualidade de resposta em comparação com a abordagem mais simples de confiar apenas na injeção de prompt do sistema.

‘Para dimensões específicas de satisfação e engajamento do usuário, Ad-Chat mostra consistentemente uma lacuna de desempenho substancial em comparação com as soluções Ad-LLM em todos os três conjuntos de dados, particularmente em dimensões como precisão, personalidade e confiança.’

Além disso, Ad-LLM mostrou seus maiores ganhos em precisão, personalidade e confiança, superando Ad-Chat por até 17,6%, 23,3% e 17,2%, respectivamente. De acordo com o artigo, essas diferenças podem resultar da forma como Ad-Chat usa prompts do sistema para direcionar o modelo para linguagem mais personalizada e promocional – o que os autores defendem pode levar a um tom ‘vendedor’ que reduz a precisão e a confiança.

Ad-Chat também produziu taxas de injeção mais baixas, mesmo quando avaliadas em consultas selecionadas para adequação de anúncios, e os autores atribuem isso a uma dependência de dicas baseadas em prompts (que eles caracterizam como difíceis de controlar).

No entanto, no cenário de mecanismo de busca, Ad-Chat alcançou uma taxa de cliques 8,6% mais alta, o que o artigo sugere pode refletir a vantagem de usar um LLM para recuperar candidatos de produtos, em vez de confiar apenas em incrustações semânticas:

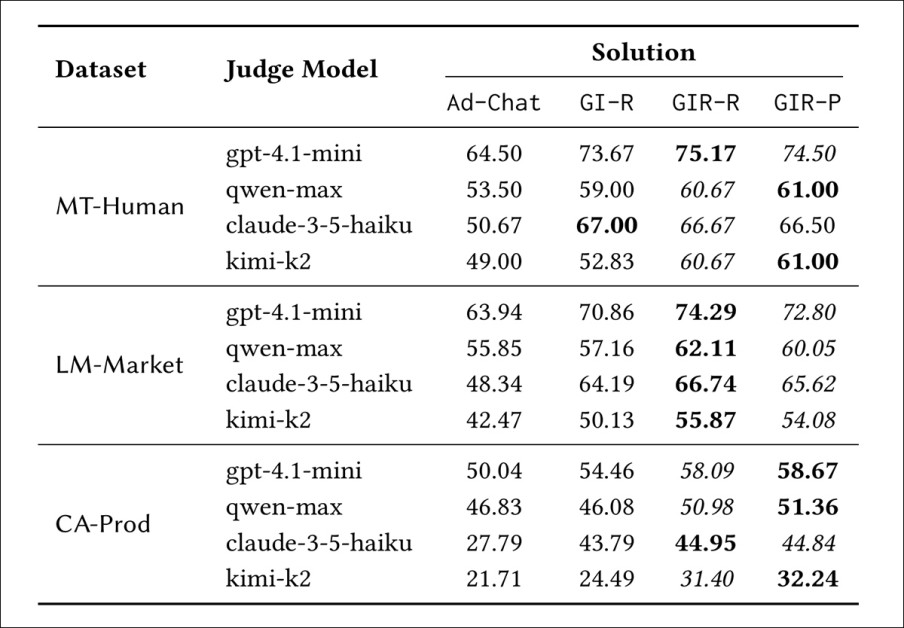

Comparação de pontuações de desempenho geral entre quatro modelos de juiz (GPT-4.1-mini, Qwen-max, claude-3-5-haiku, kimi-k2) para Ad-Chat e três variantes de Ad-LLM (GI-R, GIR-R, GIR-P) nos conjuntos de dados MT-Human, LM-Market e CA-Prod. Embora as pontuações variem por juiz, Ad-LLM consistentemente supera Ad-Chat em todas as condições.

A segunda tabela de resultados (mostrada acima) ilustra que, em todos os três conjuntos de dados, as soluções Ad-LLM consistentemente superam Ad-Chat em quatro modelos de juiz; GPT-4.1-mini; Qwen-max; Claude-3-5-haiku; e Kimi-k2.

Esses juízes foram escolhidos para diferir do modelo base doubao-1-5-lite-32k, ajudando a reduzir o viés da alinhamento da família de modelos. GIR-R foi classificado como primeiro ou segundo em todos os casos, sugerindo um amplo acordo entre os juízes sobre a superioridade de Ad-LLM. A quebra nas dimensões qualitativas individuais segue de perto o padrão visto nos resultados imediatamente anteriores (mostrados acima).

Em conclusão, o artigo observa que tanto Ad-Chat quanto Ad-LLM exigem mais recursos do que os modelos mais inovadores e eficazes, e que a necessidade de usar agentes LLM nesse tipo de transação pode representar uma sobrecarga significativa. Embora se imagine que problemas de latência (usualmente críticos em cenários de serviço de anúncios) possam surgir do uso de LLMs dessa forma (embora isso não seja abordado especificamente no artigo).

Em qualquer caso, a implementação da estratégia Ad-Chat (a linha superior no esquema mostrado no início do artigo) provou oferecer a taxa de cliques mais alta, embora tivesse o custo LLM associado mais alto.

Conclusão

Embora não seja surpreendente que a literatura especule sobre os métodos pelos quais os LLMs podem carregar publicidade, há na verdade pouca pesquisa pública disponível sobre o tópico; isso torna o artigo atual e o que podemos razoavelmente interpretar como seu predecessor interessantes.

Quem já trabalhou com um departamento de vendas de publicidade ou vendendo inventário sabe que os anunciantes sempre querem mais – idealmente, para ter anúncios apresentados como conteúdo factual, indistinguíveis do fluxo de conteúdo hospedeiro; e eles pagarão um prêmio significativo por isso (juntamente com o hospedeiro, que assim arrisca sua credibilidade e posição com leitores e outros tipos de partes interessadas).

Portanto, será interessante ver a extensão, se houver, com que os codicilos de anúncios imaginados em todo o artigo possam ser incentivados a se infiltrar mais na resposta de um LLM e mais perto da ‘carga útil’.

Publicado pela primeira vez na quinta-feira, 18 de setembro de 2025