Ângulo de Anderson

A Verbosidade Diminui a Precisão em Grandes Modelos de Linguagem

Pesquisa nova descobre que forçar os Grandes Modelos de Linguagem a darem respostas mais curtas melhora notavelmente a precisão e a qualidade de suas respostas.

Qualquer pessoa que já tentou parar um chatbot de “tagarelar” reconhecerá as conclusões de uma nova pesquisa: forçar a IA a dar respostas mais curtas a torna mais precisa.

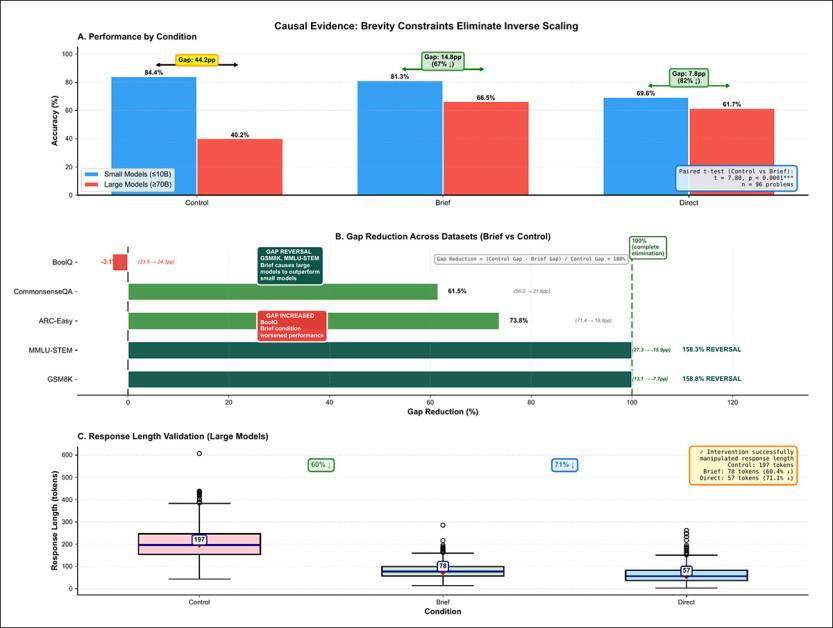

Investigando os motivos pelos quais os chatbots de IA maiores performam pior nesse aspecto do que os menores, em certos casos (conhecidos como inverse scaling), a pesquisa encontrou que forçar 31 modelos populares de linguagem grande (LLMs) a darem respostas mais curtas causou uma melhoria de até 26,3% na precisão de suas respostas:

‘Os resultados fornecem evidências causais convincentes: as restrições de brevidade melhoraram a precisão do modelo grande em 26,3 pontos percentuais e reduziram a lacuna de escala inversa em 67% (de 44,2% para 14,8%, teste t pareado: t = 7,80, p < 0,0001).'

A verbosidade excessiva é uma queixa frequente entre os usuários finais, não menos entre aqueles que usam modelos comerciais, como o ChatGPT, onde os fóruns de suporte apresentam esse tópico frequentemente.

O domínio mais afetado pela cura da verbosidade nas respostas é matemática, onde os AIs testados foram limitados a responder em 50 palavras ou menos. Para compreensão de leitura, eles foram restringidos a apenas 10 palavras em suas respostas.

O artigo define a tendência da IA para a verbosidade como pensamento excessivo, onde a mensagem central não é apenas obscurecida pela verbiagem, mas às vezes até adversamente afetada por ela. Quanto menor o modelo, observa o artigo, menos essa solução é necessária, ou funciona.

A pesquisa conclui que não há nada arquitetônico que precise ser abordado para aplicar essa solução sistematicamente. No entanto, em uma sessão de chat de um usuário, uma diretriz para a brevidade provavelmente precisaria ser repetida, enquanto um prompt de sistema globalmente aplicado – que precisaria ser implementado como um padrão de engenharia em plataformas como o ChatGPT – poderia tornar respostas mais curtas o comportamento padrão.

Ventos Tempestuosos

Nada disso explica exatamente por que os modelos maiores tendem à verbosidade, já que isso afeta também os modelos de código aberto. O artigo sugere que os protocolos e práticas comuns em Técnicas de Aprendizado por Reforço com Feedback Humano (RLHF) poderiam oferecer uma explicação*:

‘Uma origem plausível é o treinamento de alinhamento RLHF, onde os anotadores humanos recompensam a exaustividade desproporcionalmente em modelos maiores com maior capacidade de atuar em sinais de recompensa de comprimento–consistente com as diferenças de verbosidade sendo maiores em variantes de modelo de instrução do que nas versões base.

‘Trabalhos anteriores documentam viés sistemático de comprimento em modelos de recompensa, onde os anotadores confundem comprimento com qualidade.

‘Modelos maiores, tendo maior capacidade de atender a sinais de recompensa de comprimento, podem internalizar a geração verbosa mais profundamente do que os modelos menores, produzindo o superpensamento dependente de escala que observamos.’

Em humanos, a verbosidade pode ocorrer para preencher um silêncio, ou para mascarar sentimentos de desconforto, devido a doenças mentais, ou para ocultar uma falta de conhecimento. Em efeito, uma IA só poderia ser influenciada por esses fatores através da absorção de dados de treinamento que refletem/manifestam esses traços.

Em corpora de dados, outras motivações existem para respostas prolixas, como o incentivo de SEO para produzir conteúdo de texto mais longo, por exemplo em posts de receitas, onde o comprimento se torna (muitas vezes erroneamente) associado à autoridade.

O que não pode ser inteiramente descartado é que as plataformas baseadas em API, incentivadas a empurrar os usuários para um nível de assinatura mais alto e mais caro, ou encorajam ou não supervisionam a verbosidade, já que isso aumenta o uso de tokens quite barato, sem a necessidade de raciocínio excessivo ou chamadas RAG†.

O novo artigo é intitulado Restrições de Brevidade Invertem Hierarquias de Desempenho em Modelos de Linguagem, e vem do Departamento de Ciência da Computação do Instituto Politécnico da Suécia em Chattogram, em Bangladesh.

Método

Para testar as teorias do artigo, 31 modelos de linguagem foram avaliados – muitos para listar em forma de texto aqui, mas ilustrados na imagem abaixo:

Os Grandes Modelos de Linguagem (LLMs) testados em várias partes dos testes para o novo artigo.

Os modelos foram avaliados contra cinco coleções de benchmarks: GSM8K, para raciocínio matemático; BoolQ, para compreensão de leitura; CommonsenseQA, para raciocínio de senso comum; ARC-Easy, cobrindo perguntas científicas; e MMLU-STEM, também para conhecimento científico.

As respostas foram geradas usando decodificação gananciosa para garantir saídas determinísticas, então extraídas com regras específicas de tarefa, com precisão medida como a parcela de respostas corretas contra verdade fundamentada.

Os modelos foram divididos por tamanho, com aqueles com dez bilhões de parâmetros ou menos tratados como ‘pequenos’, e aqueles acima de setenta bilhões como ‘grandes’, com base em lacunas de desempenho observadas.

A escala inversa foi quantificada comparando o desempenho desses grupos em cada problema, marcando casos onde os modelos menores superaram os maiores; o tamanho do efeito estatístico foi usado para confirmar que essas lacunas refletiam diferenças consistentes e significativas, e não ruído.

Excluindo Recuperação

Para descartar a possibilidade de que os modelos estivessem simplesmente recuperando dados de treinamento, três verificações separadas foram realizadas, examinando como variadas as respostas eram; como muito seu comprimento flutuava; e como os erros eram feitos. Se os modelos estivessem confiando em padrões memorizados, as respostas tenderiam a repetir ou seguir modelos fixos; em vez disso, as respostas provaram ser em sua maioria únicas entre os modelos, com variação notável no comprimento, de uma resposta para outra.

Os erros também foram inspecionados diretamente, com a maioria dos fracassos tomando a forma de explicações longas e incorretas, em vez de respostas curtas e evasivas – indicando que os modelos estavam gerando raciocínio real, em vez de recuperar respostas armazenadas.

Dados e Testes

Testando para perguntas individuais em vez de pontuações de cabeçalho, uma grande parcela de tarefas de benchmark se revelou não informativa, com 27,1% falhando em separar os modelos, porque ou todos os sistemas tiveram sucesso ou todos os sistemas falharam, deixando nenhum sinal real sobre o desempenho relativo:

A quebra por nível de problema em cinco benchmarks mostrou que uma parcela substancial de tarefas falhou em distinguir entre os modelos, enquanto uma porção menor, mas consistente, exibiu escala inversa, onde os modelos menores superaram os maiores. A distribuição geral em 1.485 problemas indica que 7,7% exibem escala inversa. Fonte

Entre as perguntas que realmente diferenciaram os modelos, a maioria se comportou como esperado, com sistemas maiores performando melhor, mas um grupo menor mostrando o padrão oposto, com os modelos menores saindo à frente. Em todos os problemas, a escala inversa apareceu em 7,7% dos casos, indicando que o efeito não é marginal.

Emergência da Escala Inversa

Em todos os cinco benchmarks, 115 problemas foram encontrados onde os modelos menores superaram os maiores, compreendendo 7,7% de todas as 1.485 tarefas, indicando que a escala inversa não é algum tipo de ocorrência rara ou marginal nesse contexto.

Na verdade, o efeito apareceu em todos os conjuntos de dados: mais fortemente em BoolQ, e mais fracamente em CommonsenseQA, ARC-Easy, GSM8K e MMLU-STEM, indicando que é generalizada, mas varia por tarefa:

A escala inversa apareceu em todos os benchmarks, variando de 3,9% em MMLU-STEM a 11,3% em BoolQ, com 115 problemas no total. As lacunas de desempenho favoreceram os modelos menores em 28,4 pontos percentuais em média. A precisão declinou à medida que o tamanho do modelo aumentou, com os modelos menores atingindo 66,1%, em comparação com 41,5% para os maiores.

O tamanho da lacuna provou ser substancial, com os modelos menores à frente em 28,4 pontos percentuais em média, e todos os casos mostrando a mesma direção de vantagem, apontando para uma queda consistente no desempenho, em vez de erros ocasionais ou ad hoc.

O mesmo padrão se manteve em diferentes famílias de modelos, incluindo Llama, Qwen, Gemma e Mistral, onde as versões maiores subperformaram as menores, com a precisão tendendo a cair à medida que o tamanho do modelo aumentava nesses problemas.

A lacuna entre os modelos pequenos e grandes era grande o suficiente para que a chance fosse improvável para explicá-la; e porque o mesmo padrão apareceu em diferentes benchmarks, tarefas e famílias de modelos, a escala inversa emergiu como um efeito consistente, em vez de aleatório.

Olhando dentro de cada família de modelos, as versões maiores repetidamente performaram pior do que as menores nesses problemas, sugerindo que a queda pode estar ligada à escala em si, em vez de às diferenças de design.

Os resultados também apontam para um limite para cada tarefa, onde o aumento do tamanho do modelo começa a prejudicar o desempenho, mostrando que os modelos maiores não sempre levam a melhores resultados.

Examinando o Superpensamento

Tendo estabelecido que os modelos maiores às vezes performam pior em certos domínios, a análise se voltou para por que isso acontece, propondo que o problema não é a falta de capacidade, mas a explicação excessiva – ou seja, casos onde respostas mais longas começam a ocultar o raciocínio correto.

Em todo o conjunto de dados, respostas mais longas foram vinculadas a uma menor precisão nesses problemas difíceis, mesmo que os modelos grandes e pequenos produzissem aproximadamente o mesmo número de etapas de raciocínio, sugerindo que o problema não é quanto raciocínio é feito, mas como ele é expresso:

Respostas mais curtas melhoraram o desempenho do modelo grande e reduziram a lacuna com os modelos menores, cortando a diferença de 44,2 pontos percentuais para 14,8 (e em alguns casos revertendo-a completamente), enquanto os formatos de resposta direta estreitaram ainda mais. Os ganhos mais fortes apareceram em GSM8K e MMLU-STEM, onde as classificações se invertiam a favor dos modelos maiores, e as verificações de comprimento de resposta confirmaram que a intervenção funcionou, com as saídas caindo de cerca de 197 tokens para menos de 80, vinculando a verbosidade reduzida à precisão melhorada.

Quando as respostas foram forçadas a ser mais curtas, os modelos maiores melhoraram acentuadamente, reduzindo uma lacuna de desempenho considerável, e, em alguns casos, quase eliminando-a. Em contraste, os modelos menores mudaram muito pouco, indicando que a verbosidade estava ativamente prejudicando os sistemas maiores.

O efeito provou variar por tarefa, com alguns benchmarks se beneficiando fortemente de respostas mais curtas, e outros exigindo um grau de explicação; mas em vários casos, a classificação entre os modelos menores e maiores se reverteu completamente uma vez que a verbosidade foi restringida, revelando que os modelos maiores tinham uma capacidade oculta que estava sendo mascarada pela elaboração excessiva.

Análises adicionais mostraram que os modelos maiores tendiam a produzir saídas mais longas em geral, apesar de usar ligeiramente menos etapas de raciocínio explícito, indicando um estilo de raciocínio mais difuso e menos estruturado.

Em contraste, os modelos menores deram respostas mais curtas e diretas, sugerindo que a forma como o raciocínio é expresso, em vez da quantidade de raciocínio em si, impulsiona a queda no desempenho.

Os autores concluem em geral que as restrições de brevidade trazem benefícios de precisão, e consideram que isso poderia se tornar uma característica fundamental nos modelos de linguagem, em vez de uma restrição repetitiva e aplicada pelo usuário que não sobrevive às sessões; e eles afirmam:

‘As restrições [de brevidade] ajudam os modelos grandes dramaticamente, enquanto afetam pouco os modelos menores.

‘Se a verbosidade fosse incidental e não causal, mudanças uniformes de precisão seriam esperadas em ambas as categorias de tamanho. A resposta diferencial confirma que o superpensamento é um modo de falha específico da escala, e não um efeito de dificuldade da tarefa.’

Conclusão

Além das versões de código aberto testadas pelos pesquisadores, o problema da verbosidade parece, anecdoticamente, com alguma frequência em muitos modelos principais além do ChatGPT, incluindo Claude, Gemini e Grok.

Se essas plataformas estão ignorando o problema da verbosidade porque isso aumenta o uso de tokens e incentiva um nível de assinatura mais alto e mais caro†, não parece razoável que elas aceitem a queda na precisão que acompanha essa ‘incentivação’.

Seria interessante ver se algum método empírico poderia determinar com certeza de onde vem a tendência para a verbosidade. Qualquer pessoa que já tentou fazer um chatbot realmente conversar, em vez de ‘blogar’ respostas verbosas e multietapas para o usuário, terá percebido que o modelo foi gravemente impresso com ‘guias de usuário de tudo-em-um’ e ‘soluções aceitas’ em seus dados de treinamento.

Portanto, seria muito interessante ver se um modelo treinado especificamente em conversas passo a passo poderia realmente se afastar da tendência verbosa e resumidora. No entanto, parece provável que algumas restrições ou filtros precisariam ser colocados no peso que o modelo é treinado para dar à ‘resposta decidida’, para que ele treine diretamente também no material precedente – essencialmente, o raciocínio explícito explícito em conversas baseadas em turnos.

Como os dados apropriados parecem ser provavelmente raros, talvez a única maneira de avançar com essa abordagem seja por meio de dados sintéticos, onde as ‘conclusões compostas’ finais são desmontadas conversacionalmente – ironicamente, de maneira semelhante às podcasts de IA que o Google NotebookLM pode interpretar a partir de entrada de texto simples.

* Minha conversão das citações inline dos autores para links hiper.

† Mas sejamos honestos, a falta entre os custos reais de provisão de IA e as taxas de assinatura é atualmente tão grande que isso apenas danificaria a reputação da base de usuários sem resolver a grave economia subjacente a essa fase da ‘conversão’ e ‘convergência’ da IA.

Publicado pela primeira vez no domingo, 5 de abril de 2026