Kąt Andersona

Przywożenie obrazów generowanych przez AI do światła z HDR

Obrazy i filmy AI mogą być imponujące, ale nie są na poziomie “profesjonalnym” – problem, który nowy projekt badawczy stara się rozwiązać.

W profesjonalnej społeczności audio-wizualnej jednym z najczęstszych zastrzeżeń dotyczących wkroczenia AI jest obecny brak profesjonalnych standardów odtwarzania obrazu i filmu. Nie jest to najmniej istotne, ale możliwość pracy z obrazami i filmami o wysokim zakresie dynamycznym (HDR).

Obrazy HDR są nowoczesnym odpowiednikiem 19- i 20-wiecznej praktyki fotograficznej zwanej bracketingiem, gdzie to samo zdjęcie jest robione wielokrotnie z coraz większą ilością światła docierającego do emulsji filmu:

Powyżej, krótki ciąg zdjęć z bracketingu. Poniżej, wysoki zakres dynamiczny, który można wywnioskować z tych zdjęć w jeden obraz. Źródło

W tradycyjnej fotografii wynikiem było wiele zdjęć, które mogły, przy pewnym doświadczeniu i wysiłku, zostać złożone w jeden wydruk, który mógł skorzystać z wszystkich różnych poziomów szczegółów dostępnych w całym zakresie narażeń. Ale nie było to trywialne ani łatwe zadanie.

Te dni sekwencja obrazu ‘auto-bracketed’ może wyprodukować wiele obrazów lub zostać połączona w jeden obraz HDR – skutecznie wielość narażeń w jednym obrazie, który aplikacje edycji obrazu obsługujące HDR, takie jak Photoshop, mogą iterować i pozwolić fotografowi na orchestrację w jeden, idealny obraz wyjściowy.

Jeśli zastanawiasz się, dlaczego powinieneś się tym przejmować, lub jak to wpływa na Twoją własną fotografię, ilustracja do tego artykułu ma na celu zademonstrować to w sposób znajomy:

Powierzchnia, po lewej stronie, widzimy typowy przykład obrazu sRGB (tj. nie-HDR). Po prostu rozjaśnienie (pokazane na prawej stronie) nie pokazuje potwora w szafie, ponieważ ten szczegół został odrzucony, gdy fotograf i automatyczne procesy kamery zdecydowały, co ma pierwszeństwo w zdjęciu:

Poniżej jest wskazanie (po lewej stronie) tego, jak “wypłukany” przedni plan musiałby być w chwili ekspozycji, aby zarejestrować potwora w szafie w zdjęciu nie-HDR, i (po prawej stronie) jak potwór zostaje zanurzony w ciemności, gdy ekspozycja jest wykonana dla dobrze oświetlonych osób na pierwszym planie:

Poniżej widzimy rodzaj szczegółów, które można “uratować” z obrazu HDR lub sekwencji obrazu. W tym przypadku potwór “ukrywał się” w bardzo niskich rejestrach wizualnych sekwencji HDR, na poziomie, na którym reszta treści byłaby “zdmuchnięta” w bliską biel (powyżej, po lewej stronie). Poprzez określenie, że szeroki zakres poziomów jasności powinien być wyrażony selektywnie w tym samym obrazie, te sprzeczne elementy mogą być złożone w jeden racjonalny obraz:

Obraz nie-HDR nazywany jest obrazem odniesionym do wyświetlacza, a obraz HDR o wysokim gamucie nazywany jest obrazem odniesionym do sceny.

Film HDR również istnieje, a ten rodzaj giętkości i elastyczności tonalnej daje filmowcom pewną swobodę w ratowaniu, gradacji i interpretowaniu ujęć w wielu kreatywnych i spójnych sposobach; niezaskakująco, więc twórcy są niechętni do pracy z “spłaszczonym” wyjściem sRGB, typowym dla większości ramowych AI.

HDR w AI

Naturalnie, scena badawcza jest zainteresowana przywożeniem ramowych AI do ery HDR. Jednak nie jest to trywialne zadanie, zarówno ze względu na podstawową architekturę systemów generatywnych opartych na dyfuzji, jak i dlatego, że dobre dane HDR zajmują dużo miejsca na dysku, co sprawia, że kolekcje są nieporęczne; w związku z tym, zestawy danych odpowiednie do tego zadania są rzadkie.

Pomimo tego, współpraca między uniwersytetem w Singapurze a Adobe Research oferuje metodę generowania sekwencji obrazów HDR, w metodzie, która teoretycznie może być stosowana do filmów, a także do obrazów statycznych:

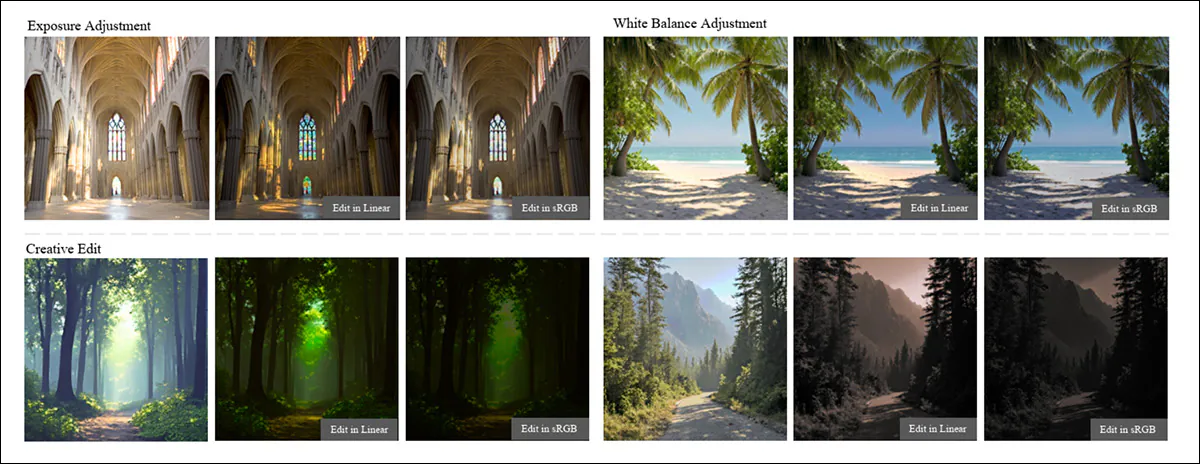

Z witryny projektu nowej pracy, przykłady ‘bracketed’ tekst-to-image output. Źródło

Nowy system generuje kilka wersji tego samego obrazu w różnych poziomach jasności i uczy się, jak jasna jest scena, a następnie łączy je w jeden wynik, który zachowuje szczegóły w cieniach i światłach, umożliwiając późniejsze edycje ekspozycji lub koloru, które zachowują się jak dostosowania do prawdziwego uchwycenia kamery, a nie jak delikatne poprawki do w pełni przetworzonego obrazu.

System wykorzystuje różnorodność modeli do tego zadania, w tym warianty Qwen i Flux:

<img class="size-full wp-image-414262" src="https://www.unite.ai/wp-content/uploads/2026/04/figure-15.jpg" alt="Przykłady z nowego artykułu, pokazujące, jak system może generować wiele wersji ekspozycji tej samej sceny, zachowując podstawową strukturę. Rozpoczynając od prostego mapy krawędzi, model produkuje spójne obrazy w bardzo ciemnych i bardzo jasnych ustawieniach, niezależnie od tego, czy podpowiedź opisuje światło księżycowe, słoneczne, zachód słońca, czy nawet mały obiekt, taki jak balon, z podmiotem i kompozycją, która pozostaje stabilna, podczas gdy tylko oświetlenie się zmienia. Metoda może zmieniać jasność w kontrolowany, camera-like sposób, a nie dryfować lub wymyślać nową treść, gdy ekspozycja się zmienia. Źródło

Autorzy stwierdzają:

‘Generowanie liniowych obrazów jest trudne, ponieważ wstępnie wytrenowane VAE w modelach dyfuzji mają trudności z jednoczesnym zachowaniem ekstremalnych świateł i cieni ze względu na wyższy zakres dynamiczny i głębię bitową.

‘W tym celu reprezentujemy liniowy obraz jako sekwencję ekspozycji, każda przechwytująca określoną część zakresu dynamicznego, i proponujemy architekturę DiT-based flow-matching dla generacji ekspozycji warunkowanej tekstem.

‘Ponadto demonstrujemy zastosowania downstream, w tym edycję liniowego obrazu pod kątem tekstu i generację warunkowaną strukturą za pomocą ControlNet.’

Nowa praca nowy artykuł nosi tytuł Generowanie liniowych obrazów przez synteza ekspozycji, i pochodzi od czterech autorów z S-Lab na Nanyang Technological University, Adobe NextCam i Adobe Research. Poza wspomnianą stroną projektu i filmem wideo na YouTube, towarzyszącym wydaniu, istnieje również (obecnie pusty) repozytorium GitHub, i obietnica wydania zestawu danych.

Mimo że autorzy dostarczają wiele przykładów wyjścia z systemu na stronie projektu, widzowie będą musieli mieć monitor HDR, aby naprawdę odróżnić cechy wyjścia HDR przedstawionego. Niemniej jednak, proszę znaleźć przegląd badaczy film wideo na YouTube osadzony na końcu tego artykułu – ale bądźcie świadomi, że różnice między pokazanymi przykładami mogą nie być wyraźne na monitorze nie-HDR.

Metoda i Dane

Autorzy podkreślają zakres, w jakim gromadzenie danych jest wyzwaniem w tym konkretnym przypadku:

‘Zbieranie dużej liczby liniowych obrazów jest niezwykle trudne w praktyce. Ponadto, większość publicznych zestawów danych HDR jest albo panoramiczna (tj. koncentruje się prawie wyłącznie na zawartości sceny na dużą skalę) lub nie dostarcza prawdziwych liniowych obrazów, co sprawia, że są one niewłaściwe do naszych celów.

‘Dlatego głównie używamy zestawów danych obrazów RAW jako podstawy do szkolenia.’

Badacze dokonali kreatywnego wykorzystania nielicznych opcji, wykorzystując zestaw danych RAISE jako rzeczywiste dane szkoleniowe, a zestaw danych MIT-Adobe FiveK jako dane oceny*.

Aby zbudować użyteczne dane szkoleniowe HDR, badacze przepuścili pliki kamery RAW przez standaryzowaną linię, aby usunąć specyficzne dla kamery sztuczki, konwertując obrazy w spójny, liniowy format:

Schemat dla przepływu pracy autorów: system zaczyna się od szumu reprezentującego cztery poziomy ekspozycji tej samej sceny, wraz z podpowiedzią tekstu i tokenem jasności. Następnie przetwarza je przez warstwy transformera, które utrzymują różne ekspozycje wyrównane, dostosowując do oświetlenia. System następnie przewiduje zarówno zestaw obrazów ekspozycji, jak i ogólną skalę jasności, i następnie dekoduje i łączy je w jeden obraz odniesiony do sceny, zachowując szczegóły w cieniach i światłach.

To wymagało odtworzenia pełnego RGB z danych sensorycznych, zastosowania korekcji koloru, normalizacji balansu bieli i krótkiego przejścia do przestrzeni kolorów percepcyjnych do redukcji szumu, zanim powróci do czystego sygnału liniowego. Rzeczywiste światło w scenie zostało następnie odzyskane przy użyciu ustawień ekspozycji kamery, tak aby każdy piksel odzwierciedlał rzeczywistą jasność, a nie gotową do wyświetlenia aproksymację.

Ponieważ takie wartości mogą się znacznie różnić, dane zostały następnie ustabilizowane przez skalowanie każdego obrazu na podstawie jego własnego rozkładu jasności, przy użyciu statystyk średniego i najjaśniejszego poziomu, aby uniknąć zarówno wypłukanych obrazów, jak i przypalonych świateł, ostatecznie uzyskując znormalizowany liniowy obraz, który zachował prawdziwy zakres światła w scenie, podczas gdy pozostawał wystarczająco stabilny do szkolenia.

Etykiety tekstowe dla obrazów zostały następnie utworzone przy użyciu modelu Qwen2.5-VL 7B, z podpowiedziami opracowanymi w celu dopasowania do cech modelu Flux, który miałby być użyty w czasie generacji.

Każdy obraz został podzielony na “ekspozycyjne plasterki” i przeszedł przez wspólny VAE encoder, konwertując wszystkie ekspozycje w wspólną przestrzeń latentną zaprojektowaną do przechwycenia pełnego zakresu jasności. Latentne zostały następnie udoskonalone z szumu i odkodowane z powrotem w obrazy, umożliwiając spójną rekonstrukcję w ciemnych i jasnych regionach, bez kolapsu w jedną “spłaszczoną” ekspozycję.

LoRA fine-tuning został użyty do adaptacji wstępnie wytrenowanego modelu Flux do liniowych danych obrazu z minimalnymi dodatkowymi parametrami, pomagając modelowi Single-Diffusion Transformers (single-DiT) pozostać stabilnym, nawet gdy jasność się zmieniała w ekspozycyjnych plasterkach.

Ekspozycyjna Modulacja Self-Attention (środkowa kolumna w ilustracji schematu powyżej) została wprowadzona w celu wspólnego przetwarzania wszystkich plasterków, umożliwiając regulację luminancji dla każdej ekspozycji, podczas gdy struktura i szczegóły były wyrównane.

3D Rotary Positional Embedding (3D-R[o]PE) zostało użyte do zakodowania zarówno położenia przestrzennego, jak i tożsamości ekspozycji, aby model mógł odróżnić, do którego plasterka należy każdy token, podczas zachowania spójności przestrzennej, umożliwiając czyste rozdzielenie zmiany jasności od zawartości sceny.

Przegląd zestawu danych użytego w badaniu, pokazujący, jak obrazy są rozłożone w różnych typach zawartości i scenach wewnętrznych i zewnętrznych, wraz z rozkładem wartości jasności w przetworzonych danych. Histogramy wykresu luminancji i skali promieniowania w logarytmicznym przestrzeni, ilustrując, jak szeroko może się zmieniać rzeczywista jasność, z wyższymi wartościami promieniowania odpowiadającymi fizycznie jaśniejszym scenom i podkreślając silny zakres dynamiczny, jaki model jest w stanie obsłużyć.

3D-RoPE rozdzieliło gdzie cecha była i ‘z której ekspozycji pochodzi’ w oddzielne sygnały, aby jasność mogła być regulowana niezależnie, bez uszkadzania szczegółów przestrzennych.

Testy

Badacze użyli Flux-dev jako ramy generatywnej, z szkoleniem, które odbywało się na czterech procesorach NVIDIA A100, każdy z 80GB pamięci VRAM. Rozmiar partii został ustalony na 4 (na procesor), przez 10 000 iteracji.

LoRA fine-tuning użył rangę 64. Optymalizator AdamW został użyty przy stopy uczenia 2×102 (dla aspektu modulacji ekspozycji).

Autorzy zauważają, że chociaż istnieją dwie poprzednie prace o podobnym zakresie, żadna z nich nie była oczywistym kandydatem do fazy testowej. Praca z 2022 roku pod przewodnictwem Max Planck GlowGAN jest ograniczona do generowania konkretnych kategorii obrazów, podczas gdy Bracket Diffusion z 2025 roku (ponownie pod przewodnictwem Max Planck Institute) może generować tylko obraz HDR o rozdzielczości 256x256px i zajmuje kilka minut, aby to zrobić.

Z oryginalnego artykułu GlowGAN, typowe obrazy o niskim zakresie dynamicznym (LDR) tracą szczegóły w cieniach i światłach, podczas gdy model uczy się produkować wersje HDR, które zachowują szczegóły w całym zakresie jasności i umożliwiają odzyskanie nasycanych obszarów za pomocą odwrotnej mapy tonalnej. Źródło

W związku z tym, w braku bezpośrednich linii bazowych dla generowania liniowych obrazów, autorzy porównali swoją metodę z dostosowanymi wersjami silnych istniejących modeli, a nie specjalnie opracowanymi alternatywami.

Jedna seria eksperymentów (‘T2I Fine-Tuning’) dostosowywała model dyfuzji obrazu-tekstu Flux przy użyciu LoRA, szkoląc go do generowania liniowych obrazów bezpośrednio i oceniając, jak model T2I o wysokiej wydajności dostosowuje się do tego domeny.

Porównanie (‘T2V fine-tuning’) użyło modelu tekst-tekst Wan 2.1, którego VAE kompresuje wiele klatek w wspólną reprezentację latentną; w tym ustawieniu, cztery plasterki ekspozycji zostały zakodowane w jedną reprezentację latentną, a następnie odkodowane z powrotem, testując, czy pipeline w stylu wideo może modelować zmiany ekspozycji.

Trzeci zestaw eksperymentów (‘T2I Model Inflation’) porównał się z CameraCtrl i Generative Photography, które oba rozszerzają modele dyfuzji obrazu za pomocą modułów czasowych, aby wyprodukować wyjścia wieloklatkowe. Te również zostały dostosowane do tych samych danych, w celu uzyskania spójnego porównania.

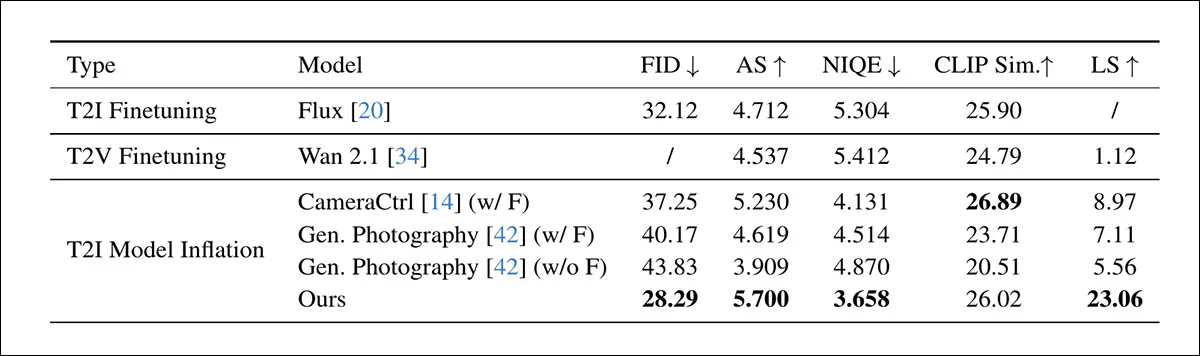

Współczynniki użyte to Fréchet Inception Distance (FID); Aesthetic Score (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim score; i Luminance Similarity (LS):

Porównanie metody autorów z kilkoma dostosowanymi liniami bazowymi do generowania liniowych, odniesionych do sceny obrazów. Modele tekst-tekst (Flux) i tekst-wideo (Wan 2.1) są dostosowywane z LoRA, aby przetestować, jak dobrze istniejące systemy generatywne radzą sobie w tym ustawieniu, podczas gdy CameraCtrl i Generative Photography rozszerzają modele dyfuzji o składniki czasowe. Niektóre wyniki są brakujące, ponieważ niektóre modele nie mogą wiernie produkować spójnych plasterków ekspozycji, które są wymagane do odzyskania pełnego zakresu dynamicznego. Przez wszystkie raportowane metryki, nowa metoda osiąga najmocniejsze wyniki ogółem, szczególnie w przypadku miar związanych z jakością obrazu i dokładnym odwzorowaniem jasności.

Co się tyczy tych wyników, autorzy stwierdzają:

‘Ze względu na szeroki rozkład liniowych obrazów, bezpośrednie dostosowanie modelu T2I do liniowych danych sprawia, że trudno jest zbalansować szczegóły cieni i świateł. Metody T2I Model Inflation cierpią zarówno z powodu ograniczonego zakresu dynamicznego, jak i znacznego pogorszenia jakości obrazu, nawet po dostosowaniu.

‘Dla T2V Fine-tuning, 4-krotna czasowa próbka Wan 2.1 splata 4 plasterki ekspozycji w jedną reprezentację latentną, powodując poważne niezgodność rozkładu, której nie można rozwiązać za pomocą samodzielnego dostosowania.

‘Poprzez bezpośrednie modelowanie właściwości odniesionych do sceny przy użyciu plasterków ekspozycji, nasza metoda osiąga wyższą jakość wizualną i zakres dynamiczny w porównaniu ze wszystkimi liniami bazowymi.’

Porównanie z LoRA-dostosowanym Flux i Wan 2.1, ilustrujące, jak każda metoda radzi sobie ze zmianami ekspozycji w tej samej scenerii. Konkurujące podejścia mają tendencję do traconia szczegółów w bardzo ciemnych lub bardzo jasnych obszarach, podczas gdy proponowana metoda utrzymuje spójną strukturę i odzyskuje użyteczne szczegóły w całym zakresie ekspozycji. Proszę odnieść się do oryginalnego artykułu i strony projektu, aby uzyskać lepsze przykłady wyników.

Proszę odnieść się do sekcji dodatkowych eksperymentów i uzupełniających materiałów oryginalnego artykułu, aby uzyskać dalsze testy.

Wnioski

Dla profesjonalistów medialnych, takich jak ci, którzy pracują w produkcji filmowej i telewizyjnej, ten sam wyjście, które zdobyło wyobraźnię (i, coraz częściej, gniew) świata, pozostawiło ich obojętnymi, ponieważ wszystkie niemal ich potoki zależą w jakimś stopniu od uchwycenia HDR.

Dlatego jest to projekt na czas, reprezentujący funkcjonalność, która powinna stać się opcjonalnym standardem w nowych ramach – chociaż jest pewne, że co najmniej podwoi czasy renderowania; wyraźnie, również, opóźnienie musi być poważnie rozwiązane, jeśli treści AI HDR nie mają być zarezerwowane dla “w postprodukcji”, a nie “w kamerze” kategorii.

* Zwykle pokazywalibyśmy przykłady, ale ponieważ czytelnik może nie mieć monitora HDR, pomijamy je w tym przypadku.

Po raz pierwszy opublikowany w niedzielę, 26 kwietnia 2026