Sztuczna inteligencja

Jak Szkolić i Używać Modeli LoRA Hunyuan Video

Ten artykuł pokaże Ci, jak zainstalować i używać oprogramowania zainstalowanego na Windows, które może szkolić modele LoRA Hunyuan video, umożliwiając użytkownikowi generowanie niestandardowych osobowości w modelu podstawowym Hunyuan Video:

Kliknij, aby odtworzyć. Przykłady z niedawnego wybuchu sławy LoRów Hunyuan z społeczności civit.ai.

W tym momencie dwa najpopularniejsze sposoby generowania modeli LoRA Hunyuan lokalnie to:

1) ramowa framework diffusion-pipe-ui oparta na Dockerze, która opiera się na podsystemie Windows dla Linuksa (WSL) do obsługi niektórych procesów.

2) Musubi Tuner, nowy dodatek do popularnej architektury szkoleniowej Kohya ss. Musubi Tuner nie wymaga Docker i nie zależy od WSL ani innych proxy Linuksa – ale może być trudny do uruchomienia na Windows.

Dlatego ten przebieg koncentruje się na Musubi Tuner i na zapewnieniu całkowicie lokalnego rozwiązania do szkolenia i generowania LoRA Hunyuan, bez użycia stron internetowych opartych na API lub komercyjnych procesów wynajmu GPU, takich jak Runpod.

Kliknij, aby odtworzyć. Przykłady z treningu LoRA w Musubi Tuner dla tego artykułu. Wszystkie pozwolenia udzielone przez osobę przedstawioną, w celu ilustracji tego artykułu.

WYMAGANIA

Instalacja wymaga co najmniej komputera z systemem Windows 10 i karty graficznej NVIDIA serii 30+/40+ z co najmniej 12 GB pamięci VRAM (choć 16 GB jest zalecane). Instalacja użyta do tego artykułu została przetestowana na maszynie z 64 GB pamięci systemowej i kartą graficzną NVIDIA 3090 z 24 GB pamięci VRAM. Została przetestowana na dedykowanym systemie testowym z czystą instalacją systemu Windows 10 Professional, na partycji z ponad 600 GB wolnej przestrzeni dyskowej.

OSTRZEŻENIE

Instalacja Musubi Tuner i jego wymagań obejmuje również instalację oprogramowania i pakietów skierowanych do deweloperów bezpośrednio na główną instalację systemu Windows komputera. Biorąc pod uwagę instalację ComfyUI w późniejszych etapach, to projekt wymaga około 400-500 gigabajtów miejsca na dysku. Chociaż przetestowałem procedurę bez incydentów kilka razy w nowo zainstalowanych środowiskach testowych systemu Windows 10, ani ja, ani Unite.ai nie ponoszą odpowiedzialności za jakiekolwiek uszkodzenia systemu wynikające z postępowania zgodnie z tymi instrukcjami. Zalecam wykonywanie kopii zapasowych wszelkich ważnych danych przed próbą tej procedury instalacji.

Rozważania

Czy ta metoda jest nadal ważna?

Scena sztucznej inteligencji generatywnej rozwija się bardzo szybko, a możemy oczekiwać lepszych i bardziej zunifikowanych metod frameworków LoRA Hunyuan Video w tym roku.

…lub nawet w tym tygodniu! Podczas pisania tego artykułu, twórca Kohya/Musubi wydał musubi-tuner-gui, zaawansowane GUI Gradio dla Musubi Tuner:

Oczywiście, przyjazne GUI jest preferowane w stosunku do plików BAT, których używam w tej funkcji – raz musubi-tuner-gui działa. Podczas pisania, został on opublikowany tylko pięć dni temu, i nie mogę znaleźć żadnego opisu kogoś, kto z powodzeniem go użył.

Zgodnie z postami w repozytorium, nowe GUI ma być włączone bezpośrednio do projektu Musubi Tuner, co spowoduje zakończenie jego obecnej egzystencji jako samodzielnego repozytorium GitHub.

Opierając się na obecnych instrukcjach instalacji, nowe GUI jest klonowane bezpośrednio do istniejącego środowiska wirtualnego Musubi; i pomimo wielu wysiłków, nie mogę sprawić, by działało wraz z istniejącą instalacją Musubi.

Gdy GUI zostanie zintegrowane z Musubi Tuner, problemy tego rodzaju na pewno zostaną rozwiązane. Chociaż autor przyznaje, że nowy projekt jest ‘bardzo surowy’, jest optymistyczny co do jego rozwoju i integracji bezpośrednio w Musubi Tuner.

Biorąc pod uwagę te problemy (oraz domyślne ścieżki w czasie instalacji i użycie pakietu Pythona UV, które komplikują pewne procedury w nowym wydaniu), prawdopodobnie będziemy musieli trochę poczekać na bardziej zunifikowane doświadczenie szkolenia LoRA Hunyuan Video. To jednak wygląda bardzo obiecująco!

Ale jeśli nie możesz czekać i jesteś gotowy trochę się napocić, możesz uruchomić szkolenie LoRA Hunyuan video lokalnie już teraz.

Zacznijmy.

Dlaczego instalować cokolwiek na gołym metalu?

(Pomiń ten akapit, jeśli nie jesteś zaawansowanym użytkownikiem)

Użytkownicy zaawansowani zapytają, dlaczego wybrałem instalację tak dużej ilości oprogramowania na gołym metalu instalacji systemu Windows 10, zamiast w środowisku wirtualnym. Powodem jest to, że istotna wersja systemu Windows pakietu Triton opartego na Linuksie jest znacznie trudniejsza do uruchomienia w środowisku wirtualnym. Wszystkie pozostałe instalacje na gołym metalu w tym samouczku nie mogły być zainstalowane w środowisku wirtualnym, ponieważ muszą komunikować się bezpośrednio z lokalnym sprzętem.

Instalowanie pakietów i programów wstępnych

Dla programów i pakietów, które muszą być początkowo zainstalowane, kolejność instalacji ma znaczenie. Zacznijmy.

1: Pobierz Microsoft Redistributable

Pobierz i zainstaluj pakiet Microsoft Redistributable z https://aka.ms/vs/17/release/vc_redist.x64.exe.

Jest to prosta i szybka instalacja.

2: Zainstaluj Visual Studio 2022

Pobierz edycję Community programu Microsoft Visual Studio 2022 z https://visualstudio.microsoft.com/downloads/?cid=learn-onpage-download-install-visual-studio-page-cta

Uruchom pobrany instalator:

Nie potrzebujemy każdego dostępnego pakietu, co byłoby ciężką i długą instalacją. Na początkowej stronie Workloads, która się otwiera, zaznacz Desktop Development with C++ (zobacz poniższe zdjęcie).

Teraz kliknij zakładkę Individual Components w lewym górnym rogu interfejsu i użyj pola wyszukiwania, aby znaleźć ‘Windows SDK’.

Domyślnie tylko Windows 11 SDK jest zaznaczone. Jeśli używasz systemu Windows 10 (ta procedura instalacji nie została przeze mnie przetestowana na systemie Windows 11), zaznacz najnowszą wersję systemu Windows 10, wskazaną na poniższym zdjęciu.

Wyszukaj ‘C++ CMake’ i sprawdź, czy C++ CMake tools for Windows jest zaznaczone.

Ta instalacja zajmie co najmniej 13 GB miejsca.

Gdy Visual Studio zostanie zainstalowane, będzie próbował uruchomić się na Twoim komputerze. Pozwól mu się w pełni otworzyć. Gdy pełnoekranowy interfejs Visual Studio jest w końcu widoczny, zamknij program.

3: Zainstaluj Visual Studio 2019

Niektóre z późniejszych pakietów dla Musubi oczekują starszej wersji Microsoft Visual Studio, podczas gdy inne potrzebują nowszej.

Dlatego też pobierz bezpłatną edycję Community programu Visual Studio 2019 albo z Microsoft (https://visualstudio.microsoft.com/vs/older-downloads/ – wymagane konto) albo Techspot (https://www.techspot.com/downloads/7241-visual-studio-2019.html).

Zainstaluj go z tymi samymi opcjami co dla Visual Studio 2022 (zobacz powyższą procedurę, z wyjątkiem tego, że Windows SDK jest już zaznaczone w instalatorze Visual Studio 2019).

Zobaczysz, że instalator Visual Studio 2019 jest już świadomy nowszej wersji podczas instalacji:

Gdy instalacja zostanie ukończona, a Ty otworzyłeś i zamknąłeś zainstalowany program Visual Studio 2019, otwórz okno poleceń systemu Windows (wpisz CMD w polu wyszukiwania Start) i wpisz i wykonaj:

where cl

Wynik powinien wyświetlić znane lokalizacje zainstalowanych edycji Visual Studio.

Jeśli zamiast tego otrzymasz INFO: Could not find files for the given pattern(s), zobacz sekcję Sprawdź ścieżki w tym artykule poniżej i postępuj zgodnie z tymi instrukcjami, aby dodać odpowiednie ścieżki Visual Studio do środowiska systemu Windows.

Zapisz wszelkie zmiany dokonane zgodnie z sekcją Sprawdź ścieżki poniżej, a następnie ponownie wypróbuj polecenie where cl.

4: Zainstaluj CUDA 11 + 12 Toolkits

Różne pakiety zainstalowane w Musubi wymagają różnych wersji NVIDIA CUDA, które przyspieszają i optymalizują szkolenie na kartach graficznych NVIDIA.

Powodem, dla którego zainstalowaliśmy wersje Visual Studio wcześniej, jest to, że instalatorzy NVIDIA CUDA wyszukują i integrują się z istniejącymi instalacjami Visual Studio.

Pobierz pakiet instalacji serii 11+ CUDA z:

https://developer.nvidia.com/cuda-11-8-0-download-archive?target_os=Windows&target_arch=x86_64&target_version=11&target_type=exe_local (pobierz ‘exe (lokalny)’)

Pobierz pakiet instalacji serii 12+ CUDA Toolkit z:

https://developer.nvidia.com/cuda-downloads?target_os=Windows&target_arch=x86_64

Proces instalacji jest identyczny dla obu instalatorów. Ignoruj wszelkie ostrzeżenia dotyczące istnienia lub nieistnienia ścieżek instalacji w zmiennych środowiskowych systemu Windows – zajmiemy się tym ręcznie później.

Zainstaluj NVIDIA CUDA Toolkit V11+

Uruchom instalator serii 11+ CUDA Toolkit.

W Opcjach instalacji wybierz Custom (Advanced) i przejdź dalej.

Odznacz opcję NVIDIA GeForce Experience i kliknij Dalej.

Pozostaw Wybór lokalizacji instalacji w ustawieniach domyślnych (jest to ważne):

Kliknij Dalej i pozwól instalacji dojść do końca.

Ignoruj wszelkie ostrzeżenia lub uwagi, które instalator podaje dotyczące Nsight Visual Studio integracji, której nie potrzebujemy w naszym przypadku.

Zainstaluj NVIDIA CUDA Toolkit V12+

Powtórz cały proces dla oddzielnego instalatora narzędzi 12+ NVIDIA:

Proces instalacji jest identyczny jak powyżej (dla wersji 11+), z wyjątkiem jednego ostrzeżenia dotyczącego ścieżek środowiskowych, które możesz zignorować:

Gdy instalacja wersji 12+ CUDA zostanie ukończona, otwórz okno poleceń systemu Windows i wpisz i wykonaj:

nvcc --version

To powinno potwierdzić informacje o zainstalowanej wersji sterownika:

Aby sprawdzić, czy karta jest rozpoznawana, wpisz i wykonaj:

nvidia-smi

5: Zainstaluj GIT

GIT będzie odpowiedzialny za instalację repozytorium Musubi na Twoim komputerze. Pobierz instalator GIT z:

https://git-scm.com/downloads/win (’64-bitowy instalator Git dla systemu Windows’)

Uruchom instalator:

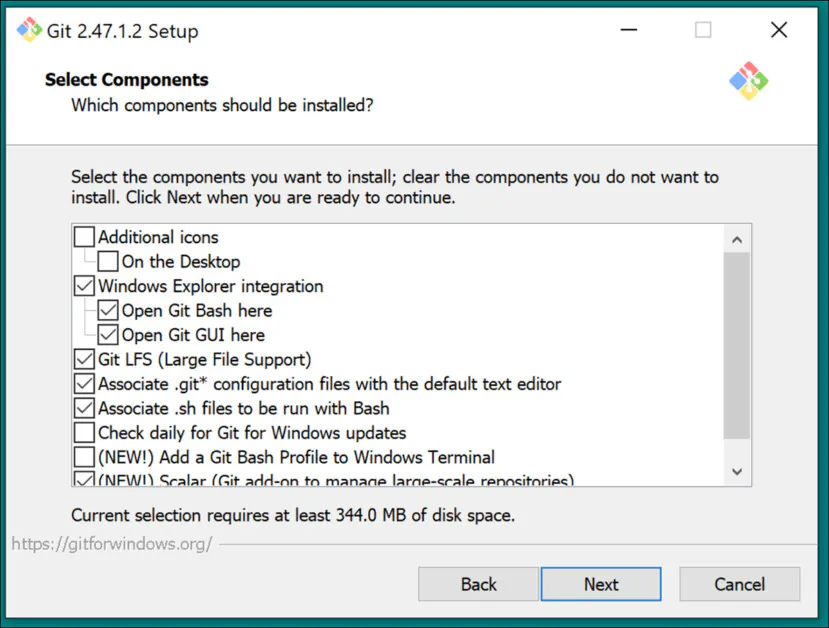

Użyj ustawień domyślnych dla Wybór składników:

Pozostaw edytor domyślny jako Vim:

Pozwól GITowi decydować o nazwach gałęzi:

Użyj zalecanych ustawień dla Ścieżka środowiska:

Użyj zalecanych ustawień dla SSH:

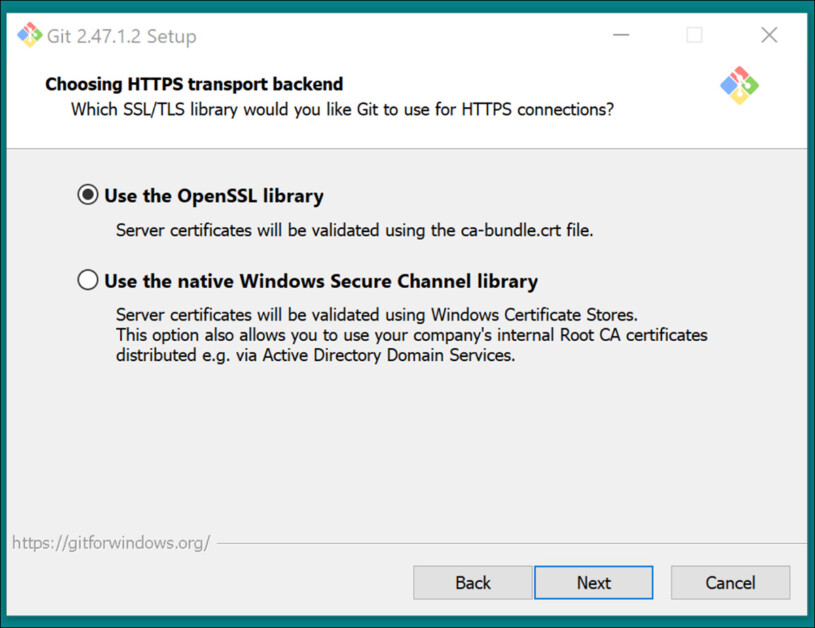

Użyj zalecanych ustawień dla Transportu HTTPS:

Użyj zalecanych ustawień dla konwersji końcówek wierszy:

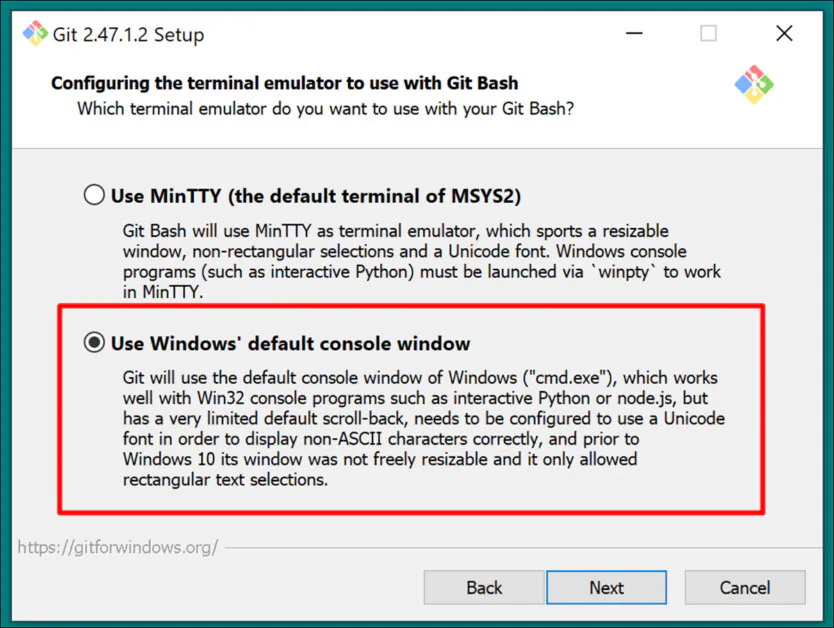

Wybierz domyślny terminal systemu Windows jako emulator terminala:

Użyj ustawień domyślnych (Fast-forward lub scal) dla Git Pull:

Użyj menedżera poświadczeń Git (ustawienie domyślne) dla pomocy poświadczeń:

W Konfigurowaniu dodatkowych opcji pozostaw Włącz buforowanie systemu plików zaznaczone, a Włącz linki symboliczne odznaczone (chyba że jesteś użytkownikiem zaawansowanym, który używa linków twardych do scentralizowanego repozytorium modeli).

Zakończ instalację i przetestuj, czy GIT jest zainstalowany poprawnie, otwierając okno poleceń i wpisując i wykonując:

git --version

Logowanie do GitHub

Później, gdy będziesz próbował sklonować repozytoria GitHub, możesz zostać poproszony o Twoje poświadczenia GitHub. Aby to przewidzieć, zaloguj się do swojego konta GitHub (utwórz je, jeśli to konieczne) na dowolnym przeglądarce zainstalowanej w systemie Windows.

W ten sposób metoda uwierzytelniania 0Auth (okno podręczne) powinna zająć jak najmniej czasu.

Po tym początkowym wyzwaniu powinieneś pozostać uwierzytelniony automatycznie.

6: Zainstaluj CMake

CMake 3.21 lub nowszy jest wymagany do części procesu instalacji Musubi. CMake to architektura rozwoju cross-platform, która może orchestrować różne kompilatory i skompilować oprogramowanie z kodu źródłowego.

Pobierz go z:

https://cmake.org/download/ (‘Windows x64 Installer’)

Uruchom instalator:

Upewnij się, że Dodaj CMake do zmiennej środowiskowej jest zaznaczone.

Kliknij Dalej.

Wpisz i wykonaj to polecenie w oknie poleceń systemu Windows:

cmake --version

Jeśli CMake zainstalował się pomyślnie, powinno wyświetlić coś takiego:

cmake version 3.31.4

CMake suite maintained and supported by Kitware (kitware.com/cmake).

7: Zainstaluj Python 3.10

Interpretator Python jest centralny dla tego projektu. Pobierz wersję 3.10 (najlepszy kompromis między różnymi wymaganiami pakietów Musubi) z:

https://www.python.org/downloads/release/python-3100/ (‘Instalator systemu Windows (64-bit)’)

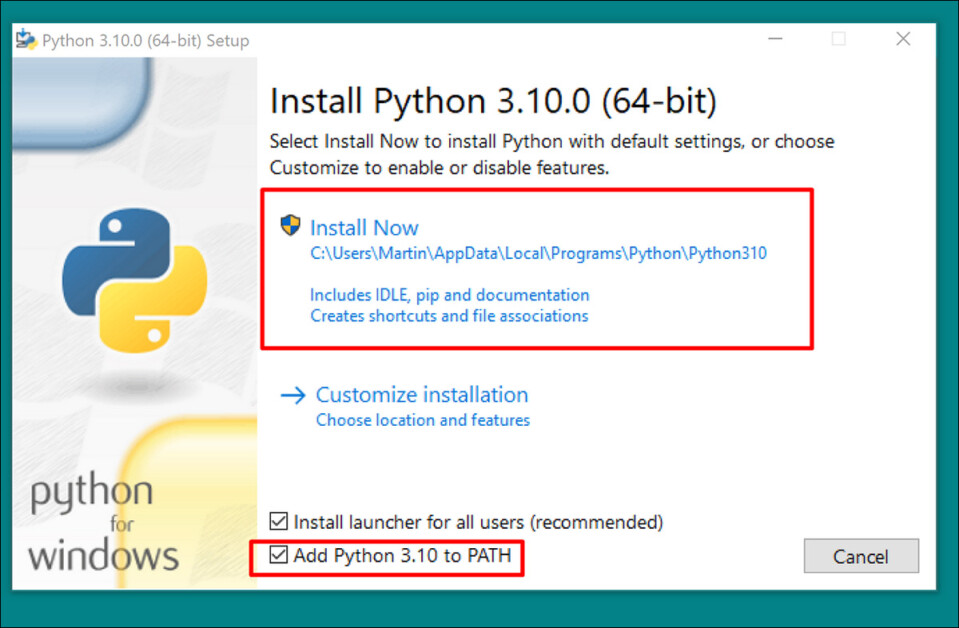

Uruchom pobrany instalator i pozostaw ustawienia domyślne:

Na końcu procesu instalacji kliknij Wyłącz limit długości ścieżki (wymaga potwierdzenia administracyjnego UAC):

W oknie poleceń systemu Windows wpisz i wykonaj:

python --version

To powinno wynikować w Python 3.10.0

Sprawdź ścieżki

Klonowanie i instalacja frameworków Musubi, a także ich normalne działanie po instalacji, wymaga, aby ich składniki wiedziały o ścieżce do kilku ważnych składników zewnętrznych w systemie Windows, szczególnie CUDA.

Zatem musimy otworzyć środowisko i sprawdzić, czy wszystkie wymagania są tam.

Szybki sposób, aby uzyskać dostęp do kontroli środowiska systemu Windows, to wpisanie Edytuj zmienne środowiskowe systemu w pasku wyszukiwania systemu Windows.

Kliknięcie tego otworzy panel sterowania Właściwości systemu. W dolnej prawej części Właściwości systemu kliknij przycisk Zmienne środowiskowe, a następnie otworzy się okno o nazwie Zmienne środowiskowe. W panelu Zmienne systemowe w dolnej połowie tego okna przewiń w dół do Ścieżka i kliknij ją dwukrotnie. To otworzy okno o nazwie Edytuj zmienne środowiskowe. Przeciągnij szerokość tego okna, aby zobaczyć pełną ścieżkę zmiennych:

Tu ważne wpisy to:

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\libnvvp

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\libnvvp

C:\Program Files (x86)\Microsoft Visual Studio\2019\Community\VC\Tools\MSVC\14.29.30133\bin\Hostx64\x64

C:\Program Files\Microsoft Visual Studio\2022\Community\VC\Tools\MSVC\14.42.34433\bin\Hostx64\x64

C:\Program Files\Git\cmd

C:\Program Files\CMake\bin

W większości przypadków poprawne zmienne środowiskowe powinny być już obecne.

Dodaj brakujące ścieżki, klikając Nowy w lewym oknie Edytuj zmienną środowiskową i wklejając poprawną ścieżkę:

Nie kopiuj i nie wklejaj bezpośrednio ze wskazanych powyżej ścieżek; sprawdź, czy każda odpowiednia ścieżka istnieje w Twojej własnej instalacji systemu Windows.

Jeśli istnieją niewielkie różnice w ścieżkach (szczególnie z instalacjami Visual Studio), użyj powyższych ścieżek, aby znaleźć odpowiednie foldery docelowe (tj. x64 w Host64 w Twojej własnej instalacji). Następnie wklej te ścieżki do okna Edytuj zmienną środowiskową.

Po tym restartuj komputer.

Instalowanie Musubi

Upgrade PIP

Użycie najnowszej wersji instalatora PIP może ułatwić niektóre etapy instalacji. W oknie poleceń systemu Windows z uprawnieniami administratora (zobacz Podniesienie uprawnień poniżej) wpisz i wykonaj:

pip install --upgrade pip

Podniesienie uprawnień

Niektóre polecenia mogą wymagać podniesionych uprawnień (tj. muszą być uruchomione jako administrator). Jeśli otrzymasz komunikaty o błędach dotyczących uprawnień w następnych etapach, zamknij okno poleceń i ponownie otwórz je w trybie administratora, wpisując CMD w pasku wyszukiwania systemu Windows, klikając prawym przyciskiem myszy Polecenie i wybierając Uruchom jako administrator:

Instalacja Torch

W Powershell wpisz i wykonaj:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Bądź cierpliwy, podczas gdy wiele pakietów jest instalowanych.

Gdy instalacja zostanie ukończona, możesz potwierdzić instalację GPU-enabled PyTorch, wpisując i wykonując:

python -c "import torch; print(torch.cuda.is_available())"

To powinno wynikować w:

C:\WINDOWS\system32>python -c "import torch;

print(torch.cuda.is_available())"

True

Instalacja Triton dla systemu Windows

Następnie instalacja składnika Triton dla systemu Windows. W podniesionym Powershell wpisz (w jednej linii):

pip install https://github.com/woct0rdho/triton-windows/releases/download/v3.1.0-windows.post8/triton-3.1.0-cp310-cp310-win_amd64.whl

(Instalator triton-3.1.0-cp310-cp310-win_amd64.whl działa zarówno dla procesorów Intel, jak i AMD, o ile architektura jest 64-bitowa i środowisko odpowiada wersji Python)

Po uruchomieniu to powinno wynikować w:

Successfully installed triton-3.1.0

Możemy sprawdzić, czy Triton działa, importując go w Pythonie. Wpisz i wykonaj to polecenie:

python -c "import triton; print('Triton is working')"

To powinno wyświetlić:

Triton is working

Aby sprawdzić, czy Triton jest włączony dla GPU, wpisz i wykonaj:

python -c "import torch; print(torch.cuda.is_available())"

To powinno wynikować w True:

Utwórz środowisko wirtualne dla Musubi

Od tego momentu zainstalujemy wszelkie dalsze oprogramowanie w środowisku wirtualnym Pythona (lub venv). To oznacza, że wszystko, co będziesz musiał zrobić, aby odinstalować całe oprogramowanie, to przeciągnąć folder instalacji venv do kosza.

Zacznijmy od utworzenia folderu instalacji: utwórz folder o nazwie Musubi na pulpicie. Poniższe przykłady zakładają, że ten folder istnieje: C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\.

W Powershell przejdź do tego folderu, wpisując i wykonując:

cd C:\Users\[Twoja nazwa profilu]\Desktop\Musubi

Chcemy, aby środowisko wirtualne miało dostęp do tego, co zainstalowaliśmy już (szczególnie Triton), więc użyjemy flagi --system-site-packages. Wpisz i wykonaj to:

python -m venv --system-site-packages musubi

Zaczekaj, aż środowisko zostanie utworzone, a następnie aktywuj je, wpisując i wykonując:

.\musubi\Scripts\activate

Od tego momentu możesz powiedzieć, że jesteś w aktywnym środowisku wirtualnym, ponieważ (musubi) pojawia się na początku wszystkich Twoich poleceń.

Klonuj repozytorium

Przejdź do nowo utworzonego folderu musubi (który znajduje się w folderze Musubi na pulpicie):

cd musubi

Teraz, gdy jesteśmy w odpowiednim miejscu, wpisz i wykonaj to polecenie:

git clone https://github.com/kohya-ss/musubi-tuner.git

Zaczekaj, aż klonowanie zostanie ukończone (nie zajmie to dużo czasu).

Instalowanie wymagań

Przejdź do folderu instalacji:

cd musubi-tuner

Wpisz i wykonaj to:

pip install -r requirements.txt

Zaczekaj, aż wiele instalacji zostanie ukończonych (to zajmie trochę czasu).

Automatyzacja dostępu do venv Hunyuan Video

Aby łatwo aktywować i uzyskać dostęp do nowego venv w przyszłych sesjach, wklej poniższy tekst do Notepad i zapisz go pod nazwą activate.bat, zapisując go z opcją Wszystkie pliki (zobacz poniższe zdjęcie).

@echo off

call C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\Scripts\activate

cd C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner

cmd

(Zamień [Twoja nazwa profilu] na swoją prawidłową nazwę folderu profilu systemu Windows)

Nie ma to znaczenia, w jakim miejscu zapiszesz ten plik.

Od tego momentu możesz kliknąć dwukrotnie activate.bat i rozpocząć pracę natychmiast.

Używanie Musubi Tuner

Pobieranie modeli

Proces szkolenia LoRA Hunyuan Video wymaga pobrania co najmniej siedmiu modeli, aby obsłużyć wszystkie możliwe opcje optymalizacji do przedpobierania i szkolenia LoRA Hunyuan Video.

Aktualne instrukcje dotyczące ich pobierania można znaleźć pod adresem https://github.com/kohya-ss/musubi-tuner?tab=readme-ov-file#model-download

Jednak te są instrukcjami pobierania w momencie pisania:

clip_l.safetensors

llava_llama3_fp16.safetensors

llava_llama3_fp8_scaled.safetensors

mogą być pobrane z:

https://huggingface.co/Comfy-Org/HunyuanVideo_repackaged/tree/main/split_files/text_encoders

mp_rank_00_model_states.pt

mp_rank_00_model_states_fp8.pt

mp_rank_00_model_states_fp8_map.pt

mogą być pobrane z:

https://huggingface.co/tencent/HunyuanVideo/tree/main/hunyuan-video-t2v-720p/transformers

pytorch_model.pt

może być pobrany z:

https://huggingface.co/tencent/HunyuanVideo/tree/main/hunyuan-video-t2v-720p/vae

Chociaż możesz umieścić je w dowolnym katalogu, dla spójności z późniejszymi skryptami, umieść je w:

C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\modele\

To jest spójne z układem katalogów do tego punktu. Nie zapomnij zastąpić [Twoja nazwa profilu] swoją prawidłową nazwą folderu profilu systemu Windows.

Przygotowanie zbioru danych

Ignorując kontrowersje społeczne na ten temat, można powiedzieć, że będziesz potrzebować gdzieś między 10 a 100 zdjęć do zbioru danych szkoleniowych dla Twojego LoRA Hunyuan.

Bardzo dobre wyniki można uzyskać nawet z 15 zdjęciami, o ile zdjęcia są zrównoważone i mają dobrą jakość.

LoRA Hunyuan może być szkolony zarówno na zdjęciach, jak i bardzo krótkich i niskich klipach wideo, lub nawet mieszaninie obu – chociaż używanie klipów wideo jako danych szkoleniowych jest wyzwaniem, nawet dla karty 24 GB.

Jednak klipy wideo są użyteczne tylko wtedy, gdy Twoja postać porusza się w sposób nietypowy, o którym model podstawowy Hunyuan Video może nie wiedzieć, lub nie może go odgadnąć.

Przykłady obejmują Rogera Rabbita, ksenomorf, Maska, Spider-Mana lub inne postacie, które posiadają unikalne cechy ruchu.

Ponieważ Hunyuan Video już wie, jak poruszają się zwykli mężczyźni i kobiety, klipy wideo nie są konieczne do uzyskania przekonującej postaci LoRA Hunyuan Video. Więc użyjemy statycznych obrazów.

Przygotowanie obrazu

Lista

Wersja TLDR:

Najlepiej jest używać obrazów, które wszystkie mają ten sam rozmiar w zbiorze danych, lub użyć podziału 50/50 między dwa różne rozmiary, np. 10 obrazów o rozmiarze 512×768 px i 10 o rozmiarze 768×512 px.

Szkolenie może przebiec dobrze, nawet jeśli nie zrobisz tego – LoRA Hunyuan Video mogą być zaskakująco wyrozumiałe.

Dłuższa wersja

Jak w przypadku LoRów Kohya-ss dla statycznych systemów generatywnych, takich jak Stable Diffusion, bucketing jest używany do rozłożenia obciążenia na różne rozmiary obrazów, umożliwiając używanie większych obrazów bez powodowania błędów braku pamięci w czasie szkolenia (tj. bucketing ‘rozcina’ obrazy na kawałki, które GPU może obsłużyć, zachowując semantyczną integralność całego obrazu).

Dla każdego rozmiaru obrazu, który umieścisz w zbiorze danych szkoleniowych (tj. 512×768 px), utworzony zostanie bucket lub ‘podzadanie’. Więc jeśli masz następujący rozkład obrazów:

2x 512x768px obrazy

7x 768x512px obrazy

1x 1000x600px obraz

3x 400x800px obrazy

Możemy zobaczyć, że uwaga bucket jest nierównomiernie podzielona między te obrazy:

Dlatego albo trzymaj się jednego formatu, albo staraj się utrzymać rozkład różnych rozmiarów względnie równy.

W każdym przypadku unikaj bardzo dużych obrazów, ponieważ może to spowolnić szkolenie, bez znaczącej korzyści.

Dla prostoty użyłem 512×768 px dla wszystkich zdjęć w moim zbiorze danych.

Odwołanie: Model (osoba) użyty w zbiorze danych dał mi pełne pozwolenie na użycie tych zdjęć do tego celu, i zaakceptował wszystkie dane AI oparte na jego podobieństwie przedstawione w tym artykule.

Mój zbiór danych składa się z 40 obrazów w formacie PNG (chociaż JPG jest również w porządku). Moje obrazy zostały przechowywane w C:\Users\Martin\Desktop\DATASETS_HUNYUAN\examplewoman

Powinieneś utworzyć folder cache wewnątrz folderu ze zbiorami danych:

Teraz utwórz specjalny plik, który będzie konfigurował szkolenie.

Pliki TOML

Proces szkolenia i przedpobierania LoRów Hunyuan Video otrzymuje ścieżki plików z płaskiego pliku tekstowego z rozszerzeniem .toml.

Dla mojego testu plik TOML znajduje się w C:\Users\Martin\Desktop\DATASETS_HUNYUAN\training.toml

Zawartość mojego pliku szkoleniowego TOML wygląda tak:

[general]

resolution = [512, 768]

caption_extension = ".txt"

batch_size = 1

enable_bucket = true

bucket_no_upscale = false

[[datasets]]

image_directory = "C:\\Users\\Martin\\Desktop\\DATASETS_HUNYUAN\\examplewoman"

cache_directory = "C:\\Users\\Martin\\Desktop\\DATASETS_HUNYUAN\\examplewoman\\cache"

num_repeats = 1

(Podwójne back-slashy dla katalogów obrazów i pamięci podręcznej nie są zawsze konieczne, ale mogą pomóc uniknąć błędów w przypadku, gdy w ścieżce jest spacja. Szkoliłem modele z plikami .toml, które używały pojedynczych forward-slash i pojedynczych back-slash)

Widzimy w sekcji resolution, że dwa rozmiary będą brane pod uwagę – 512 px i 768 px. Możesz również pozostawić to na 512, i nadal uzyskać dobre wyniki.

Podpisy

Hunyuan Video jest tekstowo+wizyjnym modelem podstawowym, więc potrzebujemy opisowych podpisów dla tych obrazów, które będą brane pod uwagę w czasie szkolenia. Proces szkolenia zakończy się niepowodzeniem bez podpisów.

Istnieje wiele otwartych systemów podpisów, których możemy użyć do tego zadania, ale utrzymajmy prostotę i użyjmy systemu taggui. Chociaż jest przechowywany w GitHub, i chociaż pobiera kilka bardzo ciężkich modeli głębokiego uczenia w pierwszym uruchomieniu, przychodzi w postaci prostego pliku wykonywalnego systemu Windows, który ładuje biblioteki Pythona i prosty interfejs użytkownika.

Po uruchomieniu Taggui użyj Plik > Załaduj katalog, aby przejść do folderu ze zbiorami danych, i opcjonalnie umieść token identyfikatora (w tym przypadku examplewoman), który zostanie dodany do wszystkich podpisów:

(Uprzednio upewnij się, że Wczytaj w 4-bitach jest wyłączone, gdy Taggui po raz pierwszy otworzy się – może to spowodować błędy podczas podpisów)

Zaznacz obraz w lewej kolumnie podglądu i naciśnij CTRL+A, aby zaznaczyć wszystkie obrazy. Następnie naciśnij przycisk Rozpocznij automatyczne podpisywanie po prawej stronie:

Zobaczysz, jak Taggui pobiera modele w małym oknie CLI w prawej kolumnie, ale tylko wtedy, gdy jest to pierwsze uruchomienie. W przeciwnym razie zobaczysz podgląd podpisów.

Teraz każde zdjęcie ma odpowiadający mu plik .txt z opisem zawartości obrazu:

Możesz kliknąć Opcje zaawansowane w Taggui, aby zwiększyć długość i styl podpisów, ale to wykracza poza zakres tego samouczka.

Wyjdź z Taggui i przejdź do…

Przedpobieranie latentne

Aby uniknąć nadmiernego obciążenia GPU w czasie szkolenia, konieczne jest utworzenie dwóch rodzajów plików przedpobieranych – jednego, aby reprezentować latentny obraz pochodzący z samych obrazów, i innego, aby ocenić kodowanie tekstu dotyczące zawartości podpisu.

Aby uprościć wszystkie trzy procesy (2x cache + szkolenie), możesz użyć interaktywnych plików .BAT, które poproszą Cię o pytania i wykonają procesy, gdy dasz niezbędne informacje.

Dla przedpobierania latentnego skopiuj poniższy tekst do Notepad i zapisz go jako plik .BAT (tj. nazwij go czymś takim jak latent-precache.bat), tak jak wcześniej, upewniając się, że typ pliku w menu rozwijanym Zapisz jako to Wszystkie pliki (zobacz poniższe zdjęcie):

@echo off

REM Aktywuj środowisko wirtualne

call C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\Scripts\activate.bat

REM Pobierz dane od użytkownika

set /p IMAGE_PATH=Podaj ścieżkę do katalogu ze zdjęciami:

set /p CACHE_PATH=Podaj ścieżkę do katalogu pamięci podręcznej:

set /p TOML_PATH=Podaj ścieżkę do pliku TOML:

echo Wprowadziłeś:

echo Ścieżka obrazu: %IMAGE_PATH%

echo Ścieżka pamięci podręcznej: %CACHE_PATH%

echo Ścieżka pliku TOML: %TOML_PATH%

set /p CONFIRM=Czy chcesz kontynuować przedpobieraniem latentnym (t/n)?

if /i "%CONFIRM%"=="t" (

REM Uruchom skrypt przedpobierania

python C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\cache_latents.py --dataset_config %TOML_PATH% --vae C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\models\pytorch_model.pt --vae_chunk_size 32 --vae_tiling

) else (

echo Operacja anulowana.

)

REM Pozostaw okno otwarte

pause

(Zamień [Twoja nazwa profilu] na swoją prawidłową nazwę folderu profilu systemu Windows)

Teraz możesz uruchomić plik .BAT dla automatycznego przedpobierania latentnego:

Gdy zostaniesz poproszony o odpowiedzi na różne pytania przez plik .BAT, wklej lub wpisz ścieżkę do folderu ze zbiorami danych, folderu pamięci podręcznej i pliku TOML.

Przedpobieranie tekstu

Utwórz drugi plik .BAT, tym razem dla przedpobierania tekstu.

@echo off

REM Aktywuj środowisko wirtualne

call C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\Scripts\activate.bat

REM Pobierz dane od użytkownika

set /p IMAGE_PATH=Podaj ścieżkę do katalogu ze zdjęciami:

set /p CACHE_PATH=Podaj ścieżkę do katalogu pamięci podręcznej:

set /p TOML_PATH=Podaj ścieżkę do pliku TOML:

echo Wprowadziłeś:

echo Ścieżka obrazu: %IMAGE_PATH%

echo Ścieżka pamięci podręcznej: %CACHE_PATH%

echo Ścieżka pliku TOML: %TOML_PATH%

set /p CONFIRM=Czy chcesz kontynuować przedpobieraniem wyjścia kodera tekstu (t/n)?

if /i "%CONFIRM%"=="t" (

REM Użyj wykonywalnego pythona z środowiska wirtualnego

python C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\cache_text_encoder_outputs.py --dataset_config %TOML_PATH% --text_encoder1 C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\models\llava_llama3_fp16.safetensors --text_encoder2 C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\models\clip_l.safetensors --batch_size 16

) else (

echo Operacja anulowana.

)

REM Pozostaw okno otwarte

pause

Zamień swoją nazwę folderu profilu systemu Windows i zapisz to jako text-cache.bat (lub dowolną inną nazwę), w dowolnej dogodnej lokalizacji, zgodnie z procedurą poprzedniego pliku .BAT.

Uruchom ten nowy plik .BAT, postępuj zgodnie z instrukcjami, a niezbędne pliki zakodowane tekstowo pojawią się w folderze cache:

Szkolenie LoRA Hunyuan

Szkolenie samego LoRA zajmie znacznie więcej czasu niż te dwa procesy przygotowawcze.

Chociaż istnieją również wiele zmiennych, o które możemy się martwić (takich jak rozmiar partii, powtórzenia, epoki i czy używać pełnych czy kwantyzowanych modeli, między innymi), oszczędźmy te rozważania na inny dzień i głębsze spojrzenie na niuanse tworzenia LoRA.

Dla teraz pozwólmy sobie uprościć wybory i przeszkolimy LoRA na ‘median’ ustawieniach.

Utwórz trzeci plik .BAT, tym razem do zainicjowania szkolenia. Skopiuj poniższy tekst do Notepad i zapisz go jako plik .BAT, tak jak wcześniej, jako training.bat (lub dowolną inną nazwę):

@echo off

REM Aktywuj środowisko wirtualne

call C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\Scripts\activate.bat

REM Pobierz dane od użytkownika

set /p DATASET_CONFIG=Podaj ścieżkę do pliku konfiguracyjnego zbioru danych:

set /p EPOCHS=Podaj liczbę epok do szkolenia:

set /p OUTPUT_NAME=Podaj nazwę wyjściowego modelu (np. example0001):

set /p LEARNING_RATE=Wybierz szybkość uczenia (1 dla 1e-3, 2 dla 5e-3, domyślnie 1e-3):

if "%LEARNING_RATE%"=="1" set LR=1e-3

if "%LEARNING_RATE%"=="2" set LR=5e-3

if "%LEARNING_RATE%"=="" set LR=1e-3

set /p SAVE_STEPS=Jak często (w krokach) zapisywać podglądy:

set /p SAMPLE_PROMPTS=Jaka jest lokalizacja pliku z podpowiedziami dla podglądów szkolenia?

echo Wprowadziłeś:

echo Plik konfiguracyjny zbioru danych: %DATASET_CONFIG%

echo Liczba epok: %EPOCHS%

echo Nazwa wyjściowa: %OUTPUT_NAME%

echo Szybkość uczenia: %LR%

echo Zapisz podglądy co %SAVE_STEPS% kroków.

echo Plik z podpowiedziami: %SAMPLE_PROMPTS%

REM Przygotuj polecenie

set CMD=accelerate launch --num_cpu_threads_per_process 1 --mixed_precision bf16 ^

C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\hv_train_network.py ^

--dit C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\models\mp_rank_00_model_states.pt ^

--dataset_config %DATASET_CONFIG% ^

--sdpa ^

--mixed_precision bf16 ^

--fp8_base ^

--optimizer_type adamw8bit ^

--learning_rate %LR% ^

--gradient_checkpointing ^

--max_data_loader_n_workers 2 ^

--persistent_data_loader_workers ^

--network_module=networks.lora ^

--network_dim=32 ^

--timestep_sampling sigmoid ^

--discrete_flow_shift 1.0 ^

--max_train_epochs %EPOCHS% ^

--save_every_n_epochs=1 ^

--seed 42 ^

--output_dir "C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\Modele wyjściowe" ^

--output_name %OUTPUT_NAME% ^

--vae C:/Users/[Twoja nazwa profilu]/Desktop/Musubi/musubi/musubi-tuner/models/pytorch_model.pt ^

--vae_chunk_size 32 ^

--vae_spatial_tile_sample_min_size 128 ^

--text_encoder1 C:/Users/[Twoja nazwa profilu]/Desktop/Musubi/musubi/musubi-tuner/models/llava_llama3_fp16.safetensors ^

--text_encoder2 C:/Users/[Twoja nazwa profilu]/Desktop/Musubi/musubi/musubi-tuner/models/clip_l.safetensors ^

--sample_prompts %SAMPLE_PROMPTS% ^

--sample_every_n_steps %SAVE_STEPS% ^

--sample_at_first

echo Poniższe polecenie zostanie wykonane:

echo %CMD%

set /p CONFIRM=Czy chcesz kontynuować szkoleniem (t/n)?

if /i "%CONFIRM%"=="t" (

%CMD%

) else (

echo Operacja anulowana.

)

REM Pozostaw okno otwarte

cmd /k

Zamień wszystkie wystąpienia [Twoja nazwa profilu] na swoją prawidłową nazwę folderu profilu systemu Windows.

Upewnij się, że folder C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\Modele wyjściowe\ istnieje i utwórz go w tej lokalizacji, jeśli nie.

Podglądy szkolenia

Istnieje bardzo podstawowa funkcja podglądu szkolenia, która została niedawno włączona dla Musubi Trainer, która pozwala Ci zmusić model szkoleniowy do zatrzymania i wygenerowania obrazów na podstawie podpowiedzi, które zapisałeś. Zapisywane są one w automatycznie utworzonym folderze o nazwie Próbki, w tym samym katalogu, w którym zapisywane są przeszkolone modele.

Aby włączyć tę funkcję, będziesz musiał zapisać co najmniej jedną podpowiedź w pliku tekstowym. Plik .BAT szkolenia, który utworzyliśmy, poprosi Cię o podanie lokalizacji tego pliku; dlatego możesz nazwać plik podpowiedzi dowolną nazwą i zapisać go w dowolnej dogodnej lokalizacji.

Oto kilka przykładów podpowiedzi dla pliku, który wygeneruje trzy różne obrazy, gdy zostanie zażądane przez rutynę szkolenia:

Jak widać w przykładzie powyżej, możesz umieścić flagi na końcu podpowiedzi, które wpłyną na wygenerowane obrazy:

–w jest szerokość

–h jest wysokość

–f jest liczba klatek. Jeśli jest ustawione na 1, generowany jest obraz; więcej niż jeden, generowany jest film.

–d jest nasienie. Jeśli nie jest ustawione, jest losowe; ale powinieneś ustawić je, aby zobaczyć jedną podpowiedź ewoluującą.

–s jest liczba kroków w generowaniu, domyślnie 20.

Zobacz oficjalną dokumentację dla dodatkowych flag.

Chociaż podglądy szkolenia mogą szybko ujawnić niektóre problemy, które mogą spowodować anulowanie szkolenia i ponowne rozważenie danych lub ustawień, pamiętaj, że każda dodatkowa podpowiedź spowalnia szkolenie nieco więcej.

Ponadto im większy rozmiar obrazu podglądu (ustawiony w powyższych flagach), tym bardziej spowolni szkolenie.

Uruchom swój plik .BAT szkolenia.

Pytanie #1 to ‘Podaj ścieżkę do pliku konfiguracyjnego zbioru danych’. Wklej lub wpisz poprawną ścieżkę do Twojego pliku TOML.

Pytanie #2 to ‘Podaj liczbę epok do szkolenia’. To zmienna prób i błędów, ponieważ jest ona wpływana przez ilość i jakość obrazów, a także podpisów i innych czynników. Ogólnie najlepiej jest ustawić ją zbyt wysoko niż zbyt nisko, ponieważ zawsze możesz przerwać szkolenie za pomocą Ctrl+C w oknie szkolenia, jeśli czujesz, że model jest wystarczająco zaawansowany. Ustaw ją na 100 w pierwszej instancji i zobacz, jak to idzie.

Pytanie #3 to ‘Podaj nazwę wyjściowego modelu’. Nazwij swój model! Najlepiej jest trzymać się krótkiej i prostej nazwy.

Pytanie #4 to ‘Wybierz szybkość uczenia’, która domyślnie jest ustawiona na 1e-3 (opcja 1). To dobry punkt wyjścia, biorąc pod uwagę dalsze doświadczenia.

Pytanie #5 to ‘Jak często (w krokach) zapisywać podglądy’. Jeśli ustawisz to zbyt nisko, zobaczysz niewielki postęp między zapisami podglądów, i to spowolni szkolenie.

Pytanie #6 to ‘Jaka jest lokalizacja pliku z podpowiedziami dla podglądów szkolenia?’. Wklej lub wpisz ścieżkę do Twojego pliku z podpowiedziami.

Plik .BAT wyświetli Ci polecenie, które zostanie wysłane do modelu Hunyuan, i poprosi, czy chcesz kontynuować, t/n.

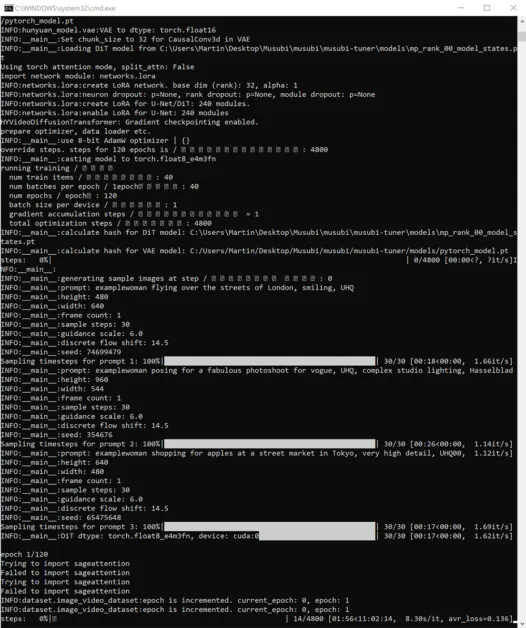

Przejdź do szkolenia:

Podczas tego czasu, jeśli sprawdzisz sekcję GPU w zakładce Wydajność Menedżera zadań systemu Windows, zobaczysz, że proces zajmuje około 16 GB pamięci VRAM.

To może nie być przypadkowa liczba, ponieważ jest to ilość pamięci VRAM dostępna na dość dużej liczbie kart graficznych NVIDIA, i kod źródłowy mógł zostać zoptymalizowany, aby zmieścić te zadania w 16 GB dla korzyści tych, którzy posiadają takie karty.

To powiedziawszy, jest bardzo łatwo zwiększyć to użycie, wysyłając bardziej ekstrawaganckie flagi do polecenia szkolenia.

Podczas szkolenia zobaczysz w dolnej prawej części okna poleceń liczbę, która wskazuje, ile czasu upłynęło od rozpoczęcia szkolenia, i szacowany czas szkolenia (który będzie się znacznie różnił w zależności od flag, ustawień, ilości danych i innych czynników).

Typowy czas szkolenia wynosi około 3-4 godzin na ustawieniach mediany, w zależności od dostępnego sprzętu, liczby obrazów, ustawień flag i innych czynników.

Używanie przeszkolonych modeli LoRA w Hunyuan Video

Wybór punktów kontrolnych

Gdy szkolenie zostanie zakończone, będziesz miał punkt kontrolny dla każdej epoki szkolenia.

Ta częstotliwość zapisywania może być zmieniona przez użytkownika, aby zapisywać częściej lub rzadziej, poprzez zmianę --save_every_n_epochs [N] w pliku .BAT szkolenia. Jeśli dodałeś niską liczbę zapisów na krok, gdy ustawiałeś szkolenie z plikiem .BAT, będzie wiele zapisanych plików punktów kontrolnych.

Jaki punkt kontrolny wybrać?

Jak wcześniej wspomniano, najwcześniejsze przeszkolone modele będą najbardziej elastyczne, podczas gdy późniejsze punkty kontrolne mogą oferować najwięcej szczegółów. Jedynym sposobem, aby to sprawdzić, jest uruchomienie niektórych LoRów i wygenerowanie kilku filmów. W ten sposób możesz dowiedzieć się, które punkty kontrolne są najbardziej produktywne i reprezentują najlepszy balans między elastycznością a wiernością.

ComfyUI

Najpopularniejszym (choć nie jedynym) środowiskiem do używania LoRów Hunyuan Video w tym momencie jest ComfyUI, edytor oparty na węzłach z zaawansowanym interfejsem Gradio, który działa w Twojej przeglądarce internetowej.

Źródło: https://github.com/comfyanonymous/ComfyUI

Instrukcje instalacji są proste i dostępne w oficjalnym repozytorium GitHub (dodatkowe modele muszą być pobrane).

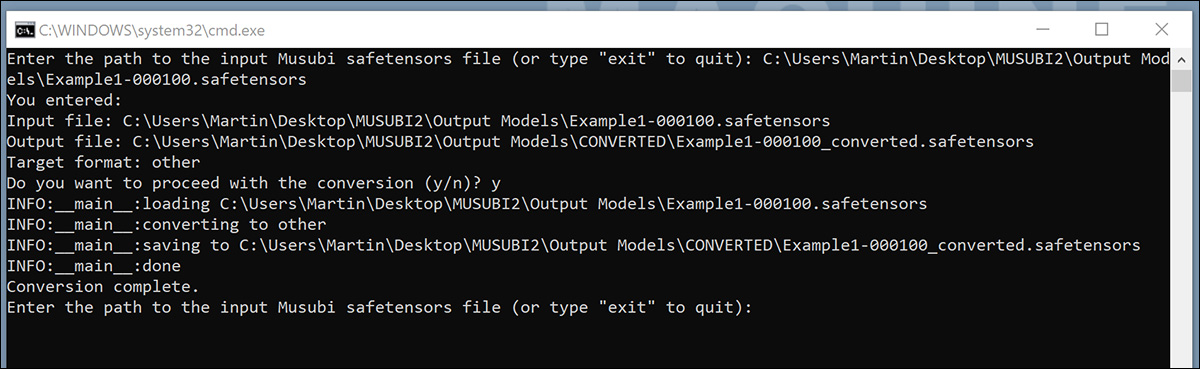

Konwertowanie modeli na ComfyUI

Twoje przeszkolone modele są zapisane w formacie (diffusers), który nie jest kompatybilny z większością implementacji ComfyUI. Musubi może przekonwertować model do formatu kompatybilnego z ComfyUI. Utwórzmy plik .BAT, aby to zrobić.

Przed uruchomieniem tego pliku .BAT utwórz folder C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\Przekonwertowane\, który skrypt oczekuje.

@echo off

REM Aktywuj środowisko wirtualne

call C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\Scripts\activate.bat

:START

REM Pobierz dane od użytkownika

set /p INPUT_PATH=Podaj ścieżkę do pliku wejściowego Musubi safetensors (lub wpisz "exit", aby wyjść):

REM Wyjdź, jeśli użytkownik wpisze "exit"

if /i "%INPUT_PATH%"=="exit" goto END

REM Wyodrębnij nazwę pliku z ścieżki wejściowej i dodaj 'przekonwertowane' do niej

for %%F in ("%INPUT_PATH%") do set FILENAME=%%~nF

set OUTPUT_PATH=C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\Modele wyjściowe\CONVERTED\%FILENAME%_przekonwertowane.safetensors

set TARGET=other

echo Wprowadziłeś:

echo Plik wejściowy: %INPUT_PATH%

echo Plik wyjściowy: %OUTPUT_PATH%

echo Format docelowy: %TARGET%

set /p CONFIRM=Czy chcesz kontynuować konwersją (t/n)?

if /i "%CONFIRM%"=="t" (

REM Uruchom skrypt konwersji z poprawnie cytowanymi ścieżkami

python C:\Users\[Twoja nazwa profilu]\Desktop\Musubi\musubi\musubi-tuner\convert_lora.py --input "%INPUT_PATH%" --output "%OUTPUT_PATH%" --target %TARGET%

echo Konwersja zakończona.

) else (

echo Operacja anulowana.

)

REM Wróć do startu dla innego pliku

goto START

:END

REM Pozostaw okno otwarte

echo Wyjście ze skryptu.

pause

Zapisz skrypt jako ‘Wszystkie pliki’ z Notepad, nazwij go convert.bat (lub dowolną inną nazwą).

Gdy zapiszesz, możesz kliknąć dwukrotnie nowy plik .BAT, który poprosi Cię o podanie lokalizacji pliku do konwersji.

Wklej lub wpisz ścieżkę do przeszkolonego pliku, który chcesz przekonwertować, kliknij t, i naciśnij enter.

Po zapisaniu przekonwertowanego LoRA do folderu Przekonwertowane, skrypt poprosi, czy chcesz przekonwertować inny plik. Jeśli chcesz przetestować wiele punktów kontrolnych w ComfyUI, przekonwertuj wybraną liczbę modeli.

Gdy przekonwertujesz wystarczającą liczbę punktów kontrolnych, zamknij okno poleceń.

Możesz teraz skopiować przekonwertowane modele do folderu modele\loras w swojej instalacji ComfyUI.

Zazwyczaj poprawna lokalizacja to coś takiego:

C:\Users\[Twoja nazwa profilu]\Desktop\ComfyUI\models\loras\

Tworzenie LoRów Hunyuan Video w ComfyUI

Chociaż node-based workflows ComfyUI mogą wydawać się skomplikowane początkowo, ustawienia innych, bardziej doświadczonych użytkowników mogą być ładowane, przeciągając obraz (utworzony przez ComfyUI) bezpośrednio do okna ComfyUI.

Źródło: https://github.com/ltdrdata/ComfyUI-Manager

Aby załadować jeden z workflow, użytych do generowania filmów z modelami w tym samouczku, pobierz ten plik JSON i przeciągnij go do okna ComfyUI (chociaż dostępne są znacznie lepsze przykłady workflow w różnych społecznościach Reddit i Discord, które przyjęły Hunyuan Video, i mój jest oparty na jednym z nich).

To nie jest miejsce na obszerny samouczek dotyczący użycia ComfyUI, ale warto wspomnieć o kilku kluczowych parametrach, które wpłyną na Twoje dane wyjściowe, jeśli pobierzesz i użyjesz powyższego układu JSON.

1) Szerokość i wysokość

Im większy Twój obraz, tym dłużej potrwa generowanie, i tym większe ryzyko błędu braku pamięci (OOM).

2) Długość

To jest liczba klatek. Jak wiele sekund to dodaje, zależy od częstotliwości klatek (ustawionej na 30 klatek na sekundę w tym układzie). Możesz przekonwertować sekundy na klatki na podstawie częstotliwości klatek na Omnicalculator.

3) Rozmiar partii

Im wyższy rozmiar partii, tym szybciej wynik, ale tym większe obciążenie pamięci VRAM. Ustaw to zbyt wysoko, a możesz otrzymać błąd OOM.

4) Kontrola po generowaniu

To kontroluje losowy seed. Opcje dla tego węzła to stały, inkrementuj, dekrementuj i losuj. Jeśli pozostawisz to na stałym, i nie zmienisz podpowiedzi, otrzymasz ten sam obraz każdym razem. Jeśli zmienisz podpowiedź, obraz zmieni się w ograniczonym stopniu.

5) Nazwa LoRA

Będziesz musiał wybrać swój własny zainstalowany model tutaj, zanim będziesz mógł spróbować wygenerować.

6) Token

Jeśli przeszkoliłeś swój model, aby wyzwolić pojęcie za pomocą tokenu (np. example-person), umieść słowo wyzwalające w swojej podpowiedzi.

7) Klatki

To reprezentuje, ile kroków system będzie stosował do procesu dyfuzji. Wyższe klatki mogą dać lepsze szczegóły, ale jest limit skuteczności tego podejścia, i ten próg może być trudny do znalezienia. Typowy zakres kroków to około 20-30.

8) Rozmiar płytek

To definiuje, ile informacji jest obsługiwanych jednocześnie w czasie generowania. Ustawione jest na 256 domyślnie. Zwiększenie tego może przyspieszyć generowanie, ale zwiększenie go zbyt wysoko może skutkować szczególnie frustrującym błędem OOM, ponieważ pojawia się on na końcu długiego procesu.

9) Nachylenie czasowe

Generowanie postaci Hunyuan Video może prowadzić do ‘zjawiska ghostingu’, lub nieprzekonującego ruchu, jeśli to ustawione zbyt nisko. Ogólnie mądrze jest ustawić to na wyższą wartość niż liczba klatek, aby wyprodukować lepszy ruch.

Podsumowanie

Chociaż dalsze eksplorowanie użycia ComfyUI wykracza poza zakres tego artykułu, doświadczenie społeczności na Reddit i Discord, które przyjęły Hunyuan Video, może ułatwić naukę krzywej, i istnieją przewodniki online, które wprowadzają podstawy.

Pierwotnie opublikowane w czwartek, 23 stycznia 2025