Kąt Andersona

Dodawanie dialogu do prawdziwych filmów wideo za pomocą sztucznej inteligencji

Nowy framework AI może przepisać, usunąć lub dodać słowa osoby w filmie wideo bez potrzeby ponownego nagrywania, w jednym systemie końcowym.

Trzy lata temu internet byłby zaskoczony każdą z 20-30 frameworków AI do modyfikacji filmów wideo, które są publikowane w portalach akademickich co tydzień; jak jest teraz, ten popularny kierunek badań stał się tak płodny, że niemal stanowi odrębną gałąź ‘AI Slop’, a ja relacjonuję znacznie mniej takich wydawnictw niż robiłem dwa lub trzy lata temu.

Jednak jeden z obecnych wydawnictw w tym kierunku zwrócił moją uwagę: zintegrowany system, który może interweniować w prawdziwych klipach wideo i wprowadzać nowe słowa do istniejącego filmu wideo (zamiast tworzenia całego generatywnego klipu z twarzy lub ramki, co jest znacznie bardziej powszechne).

W poniższych przykładach, które edytowałem z wielu dostępnych przykładowych filmów wideo na stronie internetowej wydawnictwa projektu, najpierw widzimy oryginalny klip źródłowy, a poniżej, nałożone słowa AI w środku klipu, w tym syntezę głosu i synchronizację ust:

Kliknij, aby odtworzyć.Edycja lokalna z szyciem – jeden z kilku trybów oferowanych przez FacEDiT. Proszę odwiedzić stronę źródłową, aby uzyskać lepszą rozdzielczość.Źródło – https://facedit.github.io/

Ten podejście jest jednym z trzech opracowanych dla nowej metody, nazwanej ‘edycja lokalna z szyciem’, i jest tym, które najbardziej interesuje autorów (także i mnie). Podstawowo klip jest rozszerzany przez użycie jednego z klatek środkowych jako punktu startowego dla nowej interpretacji AI, a następującej (rzeczywistej) klatki jako cel, do którego wstawiony klip generatywny powinien dążyć. W powyższych klipach te ‘nasienne’ i ‘celowe’ klatki są reprezentowane przez górny film wideo, który zatrzymuje się, podczas gdy zmieniony film wideo poniżej zapewnia generatywne wypełnienie.

Autorzy przedstawiają ten podejście syntezy twarzy i głosu jako pierwszą w pełni zintegrowaną metodę końcową do edycji filmów wideo AI tego rodzaju, obserwując potencjał w pełni rozwiniętego frameworku tego rodzaju dla produkcji telewizyjnej i filmowej:

‘Twórcy filmowi i producenci medialni często muszą zmieniać określone części nagranych filmów wideo – być może słowo było wypowiedziane niepoprawnie lub scenariusz został zmieniony po nagraniu. Na przykład w ikonicznej scenie z Titanic (1997), gdzie Rose mówi, “I’ll never let go, Jack,” reżyser mógł później zdecydować, że powinno to być “I’ll never forget you, Jack”.

‘Tradycyjnie, takie zmiany wymagają ponownego nagrywania całej sceny, co jest kosztowne i czasochłonne. Synteza mówiącej twarzy oferuje praktyczną alternatywę, automatycznie modyfikując ruch twarzy, aby dopasować go do zmienionego słowa, eliminując potrzebę ponownego nagrywania.’

Chociaż interwencje AI tego rodzaju mogą napotkać kulturowy lub przeciwny przemysł, mogą one również stanowić nowy rodzaj funkcjonalności w systemach i narzędziach VFX prowadzonych przez ludzi. W każdym razie, na razie wyzwania są ściśle techniczne.

Oprócz rozszerzania klipu przez dodanie nowych słów AI, nowy system może również zmieniać istniejące słowa:

Kliknij, aby odtworzyć.Przykład zmiany istniejącego dialogu zamiast wprowadzania dodatkowych słów. Proszę odwiedzić stronę źródłową, aby uzyskać lepszą rozdzielczość.

Stan techniki

Obecnie nie ma systemów końcowych, które oferują tego rodzaju możliwości syntezy; chociaż rosnąca liczba platform AI generatywnych, takich jak seria Veo od Google, może generować audio, a różne inne frameworki mogą tworzyć deepfaked audio, obecnie trzeba stworzyć dość skomplikowaną linię różnych architektur i sztuczek, aby interferować z prawdziwymi nagraniami w sposób, w jaki nowy system – nazwany FacEDiT – może to osiągnąć.

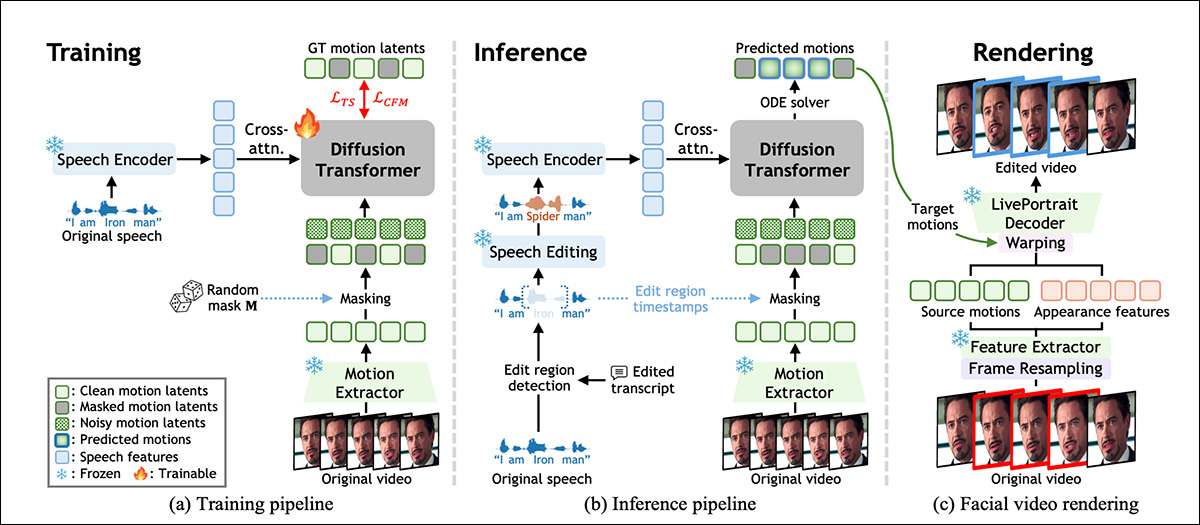

System wykorzystuje Diffusion Transformers (DiT) w połączeniu z Flow Matching, aby tworzyć ruchy twarzy warunkowane przez otaczające (kontekstowe) ruchy i zawartość audio. System wykorzystuje istniejące popularne pakiety, które zajmują się rekonstrukcją twarzy, w tym LivePortrait (niedawno przejęty przez Kling).

Ponadto, ponieważ ich podejście jest pierwszym, które integruje te wyzwania w jednym rozwiązaniu, autorzy stworzyli nową bazę danych nazwaną FacEDiTBench, wraz z kilkoma całkowicie nowymi metrykami oceny, odpowiednimi dla tego konkretnego zadania.

Nowa praca nowa praca nosi tytuł FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling i pochodzi od czterech badaczy z Korei z Pohang University of Science and Technology (POSTECH), Korea Advanced Institute of Science & Technology (KAIST) oraz The University of Texas at Austin.

Metoda

FacEDiT jest szkolony, aby odtwarzać ruch twarzy, ucząc się, jak wypełniać brakujące części oryginalnej prezentacji aktora, na podstawie otaczającego ruchu i audio. Jak pokazano w poniższym schemacie, ten proces pozwala modelowi działać jako wypełniacz luk podczas szkolenia, przewidując ruchy twarzy, które odpowiadają głosowi, pozostając spójnym z oryginalnym filmem wideo:

Przegląd systemu FacEDiT, pokazujący, jak ruch twarzy jest uczony przez samo-nadzorowaną wypełnianie luk podczas szkolenia, kierowaną przez edytowane słowa podczas wnioskowania, a następnie renderowaną z powrotem do filmu wideo przez ponowne wykorzystanie wyglądu oryginalnego filmu wideo, podczas gdy tylko celowy ruch jest zastępowany. Źródło

W czasie wnioskowania ta sama architektura obsługuje dwa różne dane wyjściowe, w zależności od tego, jak duża część filmu wideo jest maskowana: edycje częściowe, gdzie tylko fraza jest zmieniana, a reszta pozostaje nietknięta; lub generacja pełnych zdań, gdzie nowy ruch jest syntetyzowany całkowicie od podstaw.

Model jest szkolony za pomocą flow matching, który traktuje edycje filmu wideo jako rodzaj ścieżki między dwiema wersjami ruchu twarzy.

Zamiast uczyć się, jak zgadnąć, jak powinna wyglądać edytowana twarz od podstaw, flow matching uczy się, jak stopniowo i gładko przechodzić między zajmowanym miejscem a poprawnym ruchem. Aby to ułatwić, system reprezentuje ruch twarzy jako zbiór liczb wyprowadzonych z każdej klatki przy użyciu wersji wspomnianego systemu LivePortrait (patrz schemat powyżej).

Te wektory ruchu są zaprojektowane, aby opisać wyrażenia i pozycję głowy bez splątania tożsamości, tak aby zmiany słów mogły być zlokalizowane bez wpływu na ogólny wygląd osoby.

Szkolenie FacEDiT

Aby przeszkolić FacEDiT, każdy klip filmu wideo został podzielony na serię migawek ruchu twarzy, a każda klatka została połączona z odpowiadającym kawałkiem audio. Losowe części danych ruchu były następnie ukryte, a model poproszono o zgadnięcie, jak te brakujące ruchy powinny wyglądać, przy użyciu zarówno słów, jak i otaczającego niezamaskowanego ruchu jako kontekstu.

Ponieważ zamaskowane fragmenty i ich pozycje różnią się od jednego przykładu szkoleniowego do drugiego, model stopniowo uczy się, jak radzić sobie zarówno z małymi edycjami wewnętrznymi, jak i dłuższymi lukami, do pełnej generacji sekwencji, w zależności od ilości informacji, które otrzymuje.

System Diffusion Transformer uczy się odzyskiwać zamaskowany ruch, poprawiając wejścia szumowe w czasie. Zamiast podawać słowa i ruch do modelu wszystko naraz, audio jest wprowadzane do każdego bloku przetwarzania przez cross-attention, pomagając systemowi dopasować ruchy ust do słów audio bardziej precyzyjnie.

Aby zachować realizm przez edycje, uwaga jest ukierunkowana na sąsiednie klatki, a nie na całą linię czasu, zmuszając model do skupienia się na ciągłości lokalnej i zapobiegając migotaniu lub skokom ruchu na krawędziach zmienionych obszarów. Wstawienia pozycyjne (które mówią modelowi, gdzie każda klatka pojawia się w sekwencji) pomagają również modelowi utrzymać naturalny przepływ czasowy i kontekst.

Podczas szkolenia system uczy się przewidywać brakujący ruch twarzy, odtwarzając zamaskowane fragmenty na podstawie słów i niezamaskowanego ruchu. W czasie wnioskowania ten sam układ jest ponownie wykorzystywany, ale teraz maski są kierowane przez edycje w słowach.

Gdy słowo lub fraza są wstawiane, usuwane lub zmieniane, system lokalizuje dotknięty obszar, maskuje go i regeneruje ruch, który odpowiada nowemu audio. Pełna generacja sekwencji jest traktowana jako specjalny przypadek, gdzie cały obszar jest maskowany i syntetyzowany od podstaw.

Dane i testy

Kręgosłup systemu składa się z 22 warstw dla Diffusion Transformer, z 16 głowami uwagi i wymiarami feedforward 1024 i 2024px. Cechy ruchu i wyglądu są wyprowadzane przy użyciu zamrożonych składników LivePortrait, a słowa są kodowane za pomocą WavLM i modyfikowane za pomocą VoiceCraft.

Specjalna warstwa projekcyjna mapuje 786-wymiarowe cechy słów do przestrzeni latentnej DiT, z tylko DiT i modułami projekcyjnymi szkolonymi od podstaw.

Szkolenie odbywało się pod optymalizatorem AdamW z docelową szybkością uczenia 1e-4, przez milion kroków, na dwóch A6000 GPU (każdy z 48GB VRAM), przy łącznej wielkości partii ośmiu.

FacEDiTBench

Zestaw danych FacEDiTBench zawiera 250 przykładów, z których każdy składa się z klipu filmu wideo oryginalnego i edytowanego słowa, oraz transkryptów dla obu. Filmy wideo pochodzą z trzech źródeł, z 100 klipów z HDTF, 100 z Hallo3 i 50 z CelebV-Dub. Każdy z nich został ręcznie sprawdzony, aby potwierdzić, że zarówno audio, jak i film wideo są wystarczająco klarowne do oceny.

GPT-4o został wykorzystany do zmiany każdego transkryptu, aby utworzyć gramatycznie poprawne edycje. Te zmienione transkrypty, wraz z oryginalnymi słowami, zostały przekazane do VoiceCraft, aby wyprodukować nowe audio; a na każdym etapie zarówno transkrypt, jak i wygenerowane słowa były ręcznie sprawdzane pod kątem jakości.

Każdy próbek został oznaczony typem edycji, czasem zmiany i długością zmienionego fragmentu, a edycje zostały sklasyfikowane jako wstawienia, usunięcia lub zamiany. Liczba zmienionych słów wahała się od krótkich edycji 1-3 słów, edycji średnich 4-6 słów i dłuższych edycji 7-10 słów.

Trzy niestandardowe metryki zostały zdefiniowane, aby ocenić jakość edycji. Ciągłość fotometryczna, aby zmierzyć, jak dobrze oświetlenie i kolor edytowanego fragmentu łączą się z otaczającym filmem wideo, porównując różnice na poziomie pikseli na granicach; ciągłość ruchu, aby ocenić spójność ruchu twarzy, mierząc zmiany przepływu optycznego między edytowanymi i nieedytowanymi klatkami; i zachowanie tożsamości, aby oszacować, czy wygląd osoby pozostaje spójny po edycji, porównując osadzenia twarzy z oryginalnych i wygenerowanych sekwencji przy użyciu modelu rozpoznawania twarzy ArcFace.

Testy

Model testowy został przeszkolony na materiałach z trzech wymienionych powyżej zestawów danych, łącznie około 200 godzin filmów wideo, w tym vlogów i filmów, a także filmów wideo z wysoką rozdzielczością z YouTube.

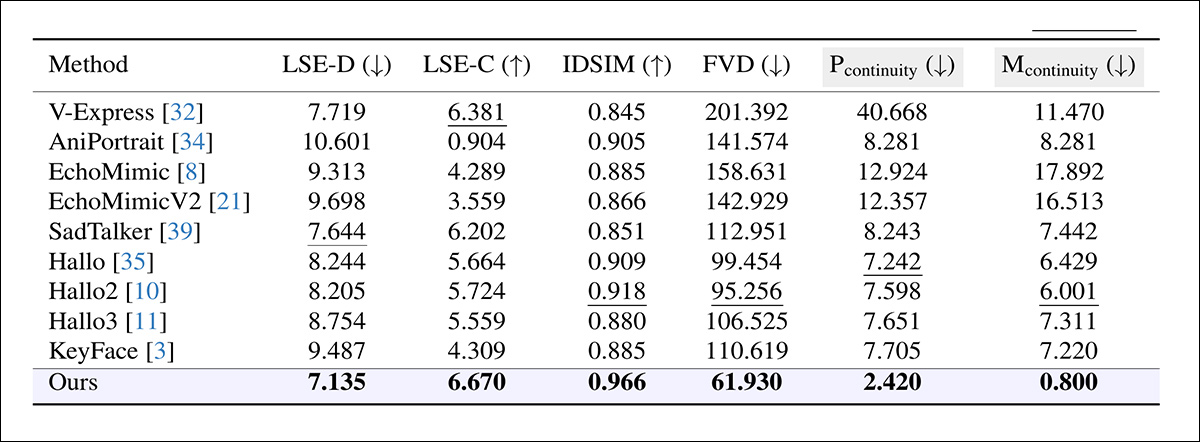

Aby ocenić edycję twarzy, wykorzystano FacEDiTBench, oprócz testowego podziału HDTF, który stał się standardem benchmarkowym dla tego zestawu zadań.

Ponieważ nie było bezpośrednio porównywalnych systemów, które mogłyby objąć tego rodzaju funkcjonalność końcową, autorzy wybrali szereg frameworków, które odtwarzały co najmniej część funkcjonalności docelowej i mogły działać jako punkty odniesienia; mianowicie, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; i SadTalker.

Kilka ustanowionych metryk zostało również wykorzystanych do oceny jakości generacji i edycji, z dokładnością synchronizacji ust ocenianą za pomocą SyncNet, raportując zarówno absolutny błąd między ruchami ust i audio (LSE-D), jak i wynik ufności (LSE-C); Fréchet Video Distance (FVD) ilustrujący, jak realistycznie wygląda film wideo; oraz Learned Perceptual Similarity Metrics (LPIPS), mierzące podobieństwo percepcyjne między wygenerowanymi i oryginalnymi klatkami.

Dla edycji wszystkie metryki, z wyjątkiem LPIPS, były stosowane tylko do zmienionego fragmentu; dla generacji cały film wideo był oceniany, z wyłączeniem ciągłości granic.

Każdy model został zmuszony do wygenerowania pasującego fragmentu filmu wideo, który został następnie wstawiony do oryginalnego klipu (badacze zauważają, że ta metoda często wprowadzała widoczne nieciągłości, gdzie edytowany fragment spotykał się z otaczającym filmem wideo). Zastosowano również drugie podejście, w którym cały film wideo został wygenerowany ponownie z edytowanego audio – ale to nieuchronnie nadpisało nieedytowane obszary i nie zachowało oryginalnej prezentacji:

Porównanie wyników edycji w systemach pierwotnie zaprojektowanych do generacji twarzy, z FacEDiT, który przewyższa wszystkie punkty odniesienia we wszystkich metrykach, osiągając niższy błąd synchronizacji ust (LSE-D), wyższy wynik ufności synchronizacji (LSE-C), silniejsze zachowanie tożsamości (IDSIM), większą realizm (FVD) i gładkiej przejścia przez granice edycji (Pcontinuity, Mcontinuity). Kolumny wypełnione szaro podkreślają kluczowe kryteria oceny jakości granic; wartości pogrubione i podkreślone wskazują najlepsze i drugie najlepsze wyniki, odpowiednio

W odniesieniu do tych wyników autorzy komentują:

‘[Nasz] model znacznie przewyższa istniejące metody w zadaniu edycji. Osiąga silne ciągłość granic i wysokie zachowanie tożsamości, demonstrując swoją zdolność do utrzymania spójności czasowej i wizualnej podczas edycji. Ponadto jego lepsza dokładność synchronizacji ust i niski FVD odzwierciedlają realizm wygenerowanego filmu wideo.’

Kliknij, aby odtworzyć.Wyniki, zmontowane przez tego autora z opublikowanych filmów wideo na stronie internetowej projektu. Proszę odwiedzić stronę źródłową, aby uzyskać lepszą rozdzielczość.

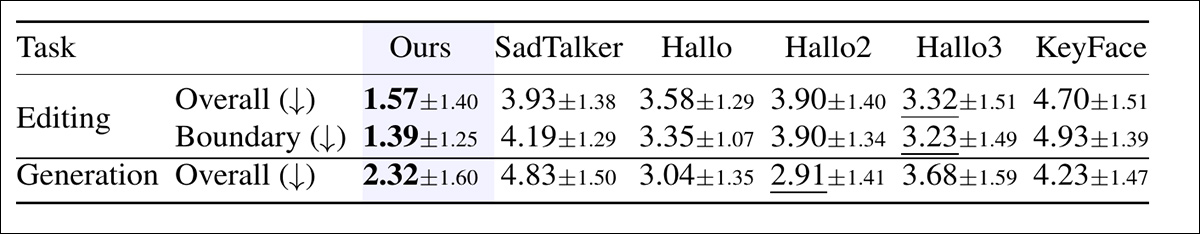

Ponadto przeprowadzono badanie z udziałem ludzi, aby ocenić postrzeganą jakość zarówno edycji, jak i generacji.

Dla każdego porównania uczestnicy oglądali sześć filmów wideo i oceniali je według ogólnej jakości, biorąc pod uwagę dokładność synchronizacji ust, naturalność i realizm ruchu głowy:

Średnie oceny przyznane przez oceniających ludzi, gdzie niższa ocena jest lepsza. W przypadku edycji i generacji oceniany był, jak naturalny i zsynchronizowany wygląda każdy film wideo. Dla edycji oceniano również gładkość przejścia między edytowanymi i nieedytowanymi fragmentami słów. Wartości pogrubione i podkreślone wskazują najlepsze i drugie najlepsze wyniki, odpowiednio.

W badaniu FacEDiT został konsekwentnie sklasyfikowany jako najlepszy z wyraźną przewagą, zarówno pod względem jakości edycji, jak i gładkości przejścia; otrzymał również wysokie oceny w przypadku generacji, co sugeruje, że jego mierzone przewagi przekładają się na preferencje percepcyjne.

Ze względu na brak miejsca, odsyłamy czytelnika do oryginalnego artykułu, aby uzyskać więcej szczegółów na temat badań i dodatkowych testów, które zostały przeprowadzone i opisane w nowej pracy.

Wnioski

Nawet w przypadku wnioskowania systemy takie mogą wymagać znacznych zasobów obliczeniowych, co utrudnia użytkownikom końcowym – tutaj prawdopodobnie firmom VFX – utrzymanie pracy na miejscu. Dlatego też podejścia, które mogą być dostosowane do realistycznych zasobów lokalnych, zawsze będą preferowane przez dostawców, którzy są zobowiązani do ochrony danych klientów i ogólnie do ochrony własności intelektualnej.

To nie oznacza, że nowa oferta jest gorsza, może ona działać idealnie pod warunkiem kwantyzacji wag lub innych optymalizacji, i jest pierwszą ofertą tego rodzaju, która przyciągnęła moją uwagę od dłuższego czasu.

Pierwotnie opublikowane w środę, 17 grudnia 202. Zredagowane 20:10 EET, tego samego dnia, dla dodatkowej przestrzeni w pierwszym akapicie.