Kąt Andersona

Kasowanie obiektów i osób z filmów wideo za pomocą sztucznej inteligencji

Nie, dziecko nie pozostaje na zdjęciu, jeśli sztuczna inteligencja ma coś do powiedzenia.

Usuwanie ludzi i obiektów z obrazów i filmów wideo jest popularnym podobszarem badań w literaturze sztucznej inteligencji zorientowanej na VFX, z rosnącą liczbą dedykowanych zbiorów danych i ram, które zajmują się tym wyzwaniem. Najnowszy z nich, z Instytutu Dużych Danych na Uniwersytecie Fudan w Chinach, to EffectErase, system usuwania obiektów z filmów wideo “świadomy efektów”, który, zdaniem autorów, znacznie poprawia stan sztuki w testach:

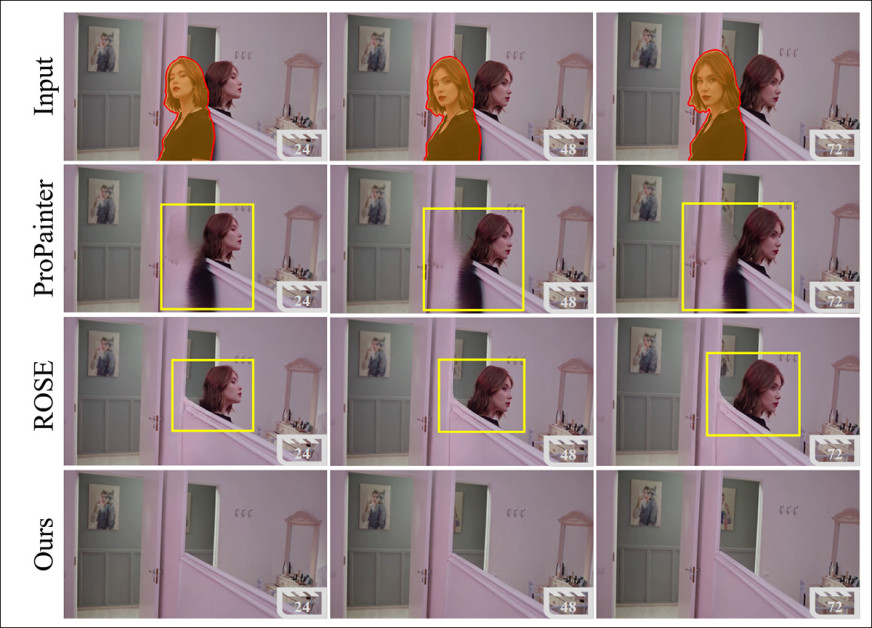

Zestawione z materiału na stronie projektu, przykłady metody EffectErase (proszę zauważyć, że podczas gdy zapewniamy link, strona źródłowa zawiera wiele filmów w wysokiej rozdzielczości i niezoptymalizowanych, które mogą wpłynąć na stabilność przeglądarki. Towarzyszący film na YouTube jest łatwiejszym i pełniejszym odniesieniem i jest osadzony na końcu tego artykułu). Źródło

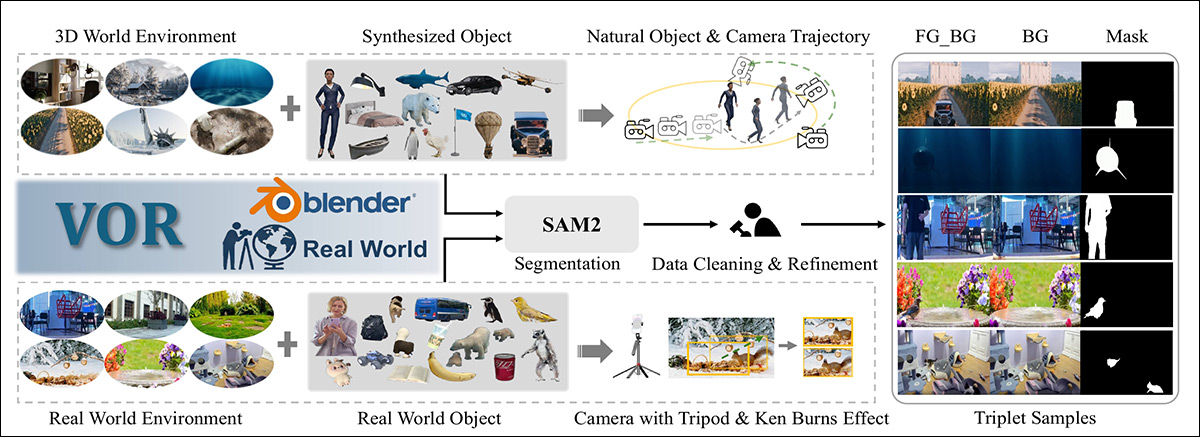

Nowa praca obejmowała stworzenie/zebranie półnowego zestawu danych składającego się z niemal 350 oryginalnych scen z prawdziwego świata i syntetycznych (wykorzystując publiczne repozytoria*), które zostały nagrane za pomocą dedykowanego sprzętu lub pozyskane i przekształcone w workflow oparty o otwarty framework Blender 3D.

Hybrydowy zestaw Video Object Removal (VOR) stanowi podstawę dla samej aplikacji EffectErase, która jest zbudowana na systemie generowania filmów wideo Wan2.1. System definiuje również dwa nowe powiązane benchmarki: VOR Eval i VOR Wild – odpowiednio, dla próbek z i bez ground truth.

(Chociaż artykuł ma towarzyszącą stronę projektu, jest dość obciążona wieloma filmami w wysokiej rozdzielczości, i trudna do załadowania; więc proszę odnosić się do wybranych przeze mnie fragmentów w osadzonym powyżej filmie, jeśli znajdzie Pan/Pani stronę projektu trudną do użycia)

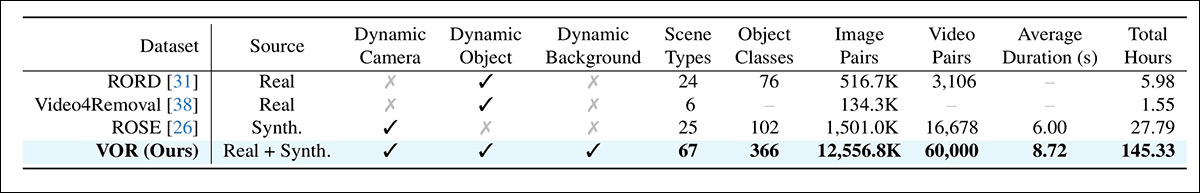

Porównanie ilości między porównywalnymi poprzednimi zestawami danych, w odniesieniu do nowej oferty. Źródło

Badacze twierdzą, że ich podejście daje najlepsze wyniki, zarówno w ilościowych miarach, jak i w jakościowych wynikach, ocenianych przez badanie ludzkie.

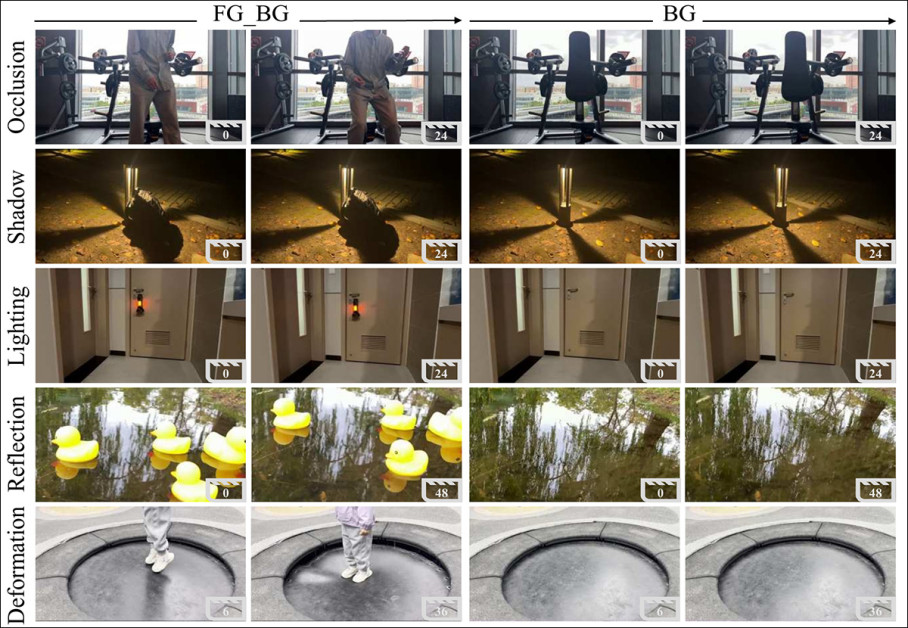

Zauważają, że poprzednie prace nie zawsze powiodły się w usuwaniu efektów towarzyszących obiektom, takich jak cienie i odbicia, i że ich zestaw danych został starannie stworzony, aby naprawić tę wadę:

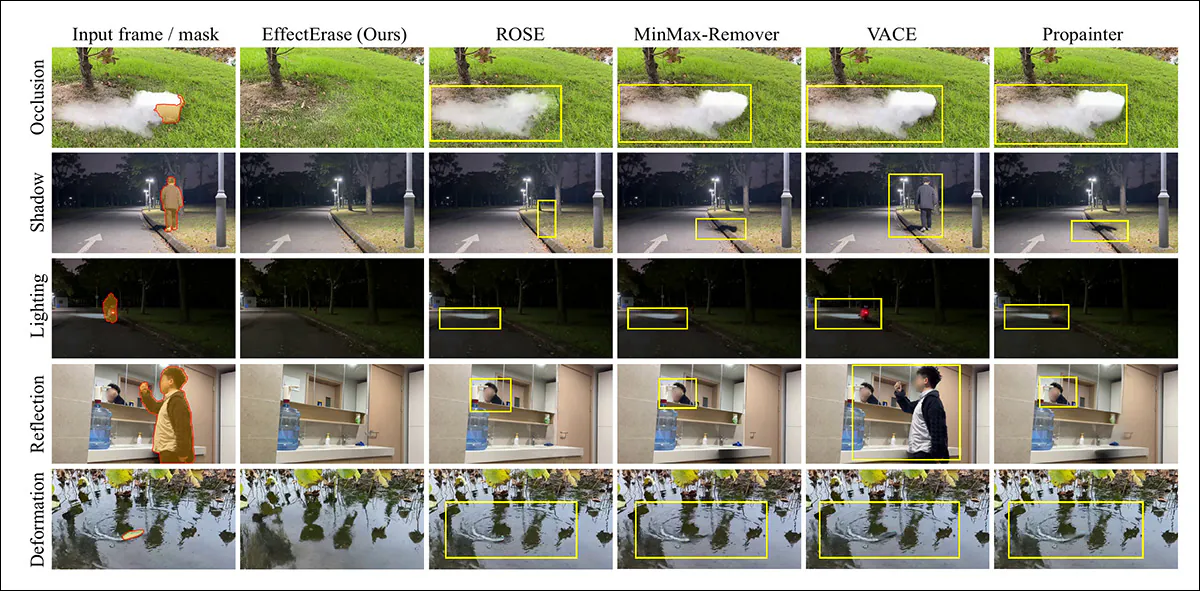

Przykłady niepowodzeń poprzednich podejść w usuwaniu efektów, takich jak cienie i odbicia.

Nowy artykuł nosi tytuł EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing i pochodzi od czterech badaczy z Wydziału Informatyki i Sztucznej Inteligencji Uniwersytetu Fudan.

Metoda

Hybrydowy zestaw VOR został zaprojektowany, aby objąć wystarczająco szeroki zakres scenariuszy, aby objąć wszystkie implikacje próby usunięcia osoby lub obiektu z filmu wideo:

Para klatek z zestawu VOR ilustruje, jak usunięcie obiektu musi wykraczać poza widoczny przedmiot, aby objąć jego wywołane efekty, z przykładami pokazującymi zakrycie, cienie, zmiany oświetlenia, odbicia i deformację fizyczną, każdy przedstawiony jako wejście (obiekt obecny) obok odpowiedniego czystego tła po usunięciu. Dla dalszych przykładów, proszę odnosić się do towarzyszącego filmu na YouTube osadzonego na końcu tego artykułu.

Pięć reprezentatywnych typów “zakłóceń” do rozwiązania zostało zdefiniowanych przez autorów jako zakrycie, w tym różne typy zakrycia szkła i dymu; cienie; oświetlenie (na przykład, gdy obiekt do usunięcia tworzy lub zmienia ścieżkę światła); odbić; i deformacja (na przykład, odcisk użytkownika na poduszce, który nie powinien przetrwać usunięcia osoby).

Potok budowy zestawu VOR, łączący syntetyczne sceny wygenerowane przez Blender z nagraniami z prawdziwego świata, gdzie dane syntetyczne są budowane z wyselekcjonowanych środowisk 3D, obiektów i trajektorii kamery, a nagrania z prawdziwego świata są rejestrowane w różnych scenach, wzbogacone o ruch Ken Burns. Segmentacja SAM2 i ręczne udoskonalenie następnie produkują wyrównane triplety filmów wideo z odpowiednimi maskami.

Dla danych z prawdziwego świata, badacze użyli stałych kamer, aby nagrać sceny “z” i “bez” obiektów, pokrywając szeroki zakres środowisk, pory dnia i warunków pogodowych.

Dla danych syntetycznych, wielu punktów widzenia zostało wyrenderowanych, a scenariusze z wieloma obiektami zostały stworzone, zawierające celowo złożone i wymagające typy ruchu kamery, takie jak mogą wystąpić w filmach wideo z prawdziwego świata; i badacze zauważają, że to podejście jest bardziej zaawansowane i wymagające niż to, które zostało użyte dla innych podobnych zestawów danych, takich jak Remove Objects with Side Effects in Videos (ROSE).

Aby zwiększyć różnorodność ruchu, efekt Ken Burns został zastosowany do par kamer, dodając kontrolowane panoramy, zoomy i lekkie ruchy ręki pod czternastoma zdefiniowanymi regułami, z pięcioma wzorcami ruchu próbkowanymi na parę, przy zachowaniu kadru wewnątrz oryginalnego kadru.

Rozmiar i różnorodność zostały dalej rozszerzone przez połączenie obiektów syntetycznych z wieloma ustawieniami kamery, maski zostały wygenerowane przez umieszczenie punktowych wskazówek na kluczowych klatkach, propagując segmentację za pomocą Segment Anything 2 (SAM2), czyszczenie i udoskonalanie wyników, oraz montowanie zwalidowanych tripli przednich, tylnych i masek do szkolenia.

Ostateczna kolekcja obejmuje 145 godzin filmów wideo w 60 000 parach filmów wideo, rzeczywistych i syntetycznych, obejmujących 366 klas obiektów w 443 scenach.

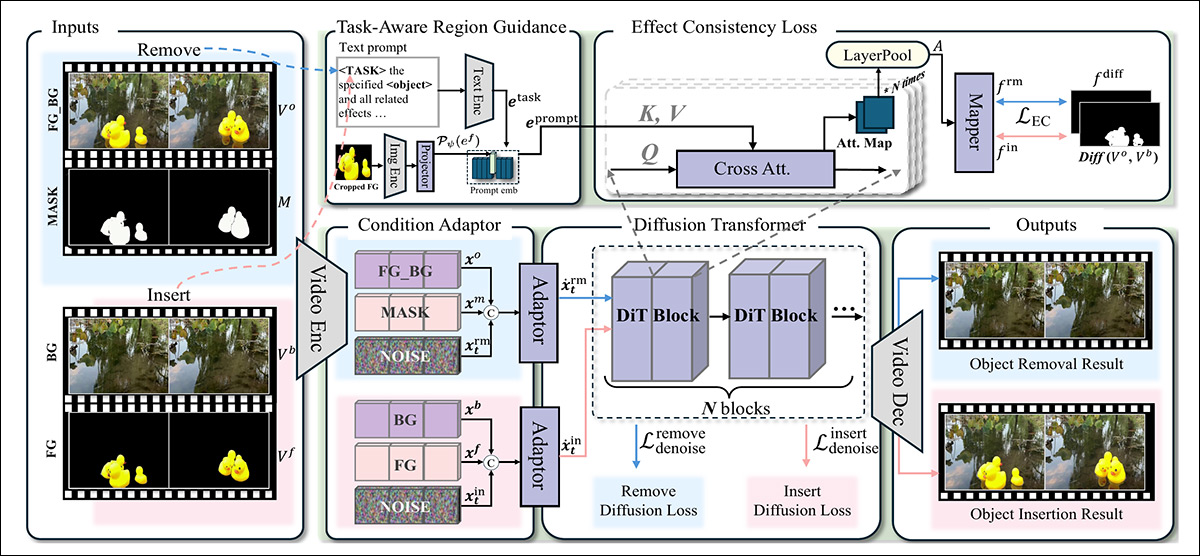

Sieć EffectErase sama wchłania materiał za pomocą Auto-Encodera Variational (VAE†), z szumem usuwanym przez Wan2.1. Nad tym szkieletem EffectErase działa Removal-Insertion Joint Learning, który trenuje oba zadania razem na tych samych obszarach; Task-Aware Region Guidance (TARG), który używa tokenów obiektów i zadań z cross-attention, aby modelować łącza przestrzenno-czasowe między obiektami a ich efektami i umożliwić przełączanie zadań; i Effect Consistency Loss, który wyrównuje obszary efektów wyrównane w zadaniach usuwania i wstawiania:

Schemat ramy EffectErase. Podczas szkolenia, pary filmów wideo są kodowane do wspólnej przestrzeni latentnej, łączone z szumem i przetwarzane przez transformator dyfuzji kierowany przez cross-attention zorientowany na zadanie, podczas gdy strata spójności efektu wyrównuje obszary usuwania i wstawiania, aby oba zadania koncentrowały się na tym samym obszarze.

Same procesy usuwania i wstawiania są trenowane razem, używając wspólnej podstawy dyfuzji, aby model nauczył się koncentrować na tych samych obszarach i wskazówkach strukturalnych.

Filmy wideo z obiektami, filmy wideo tylko z tłem i maski są najpierw kodowane do przestrzeni latentnej; następnie dodawany jest szum do szkolenia dyfuzji, a model uczy się odzyskiwać czyste reprezentacje pod kierunkiem specyficznym dla zadania. Lekki adapter następnie łączy szumy funkcji z warunkami usuwania lub wstawiania, umożliwiając obu zadań dzielenie nadzoru, przy zachowaniu sterowalności.

Task-Aware Region Guidance tworzy sygnał specyficzny dla zadania, łącząc tokeny językowe z cechami wizualnymi wyodrębnionymi z obiektu przedniego, używając CLIP, zastępując token obiektu ogólnego tokenem pochodzącym z rzeczywistej zawartości obrazu. Ta połączona reprezentacja jest wstrzykiwana do podstawy przez cross-attention, umożliwiając modelowi śledzenie, jak obiekt i jego efekty wizualne ewoluują w przestrzeni i czasie, umożliwiając elastyczne przełączanie między usuwaniem i wstawianiem.

Effect Consistency Loss zmusza procesy usuwania i wstawiania do koncentrowania się na tych samych zmienionych obszarach, ponieważ oba zadania dotyczą tego samego obiektu i jego efektów wizualnych. Mapy uwagi z każdej gałęzi są następnie łączone w miękkie mapy regionów i wyrównane z mapą różnicy obliczoną z filmów wideo obiektu i tła, aby zachować delikatne zmiany, takie jak oświetlenie i cienie. Ta dodatkowa strata pomaga wstawianiu kierować usuwaniem i utrzymuje oba zadania spójne.

Dane i testy

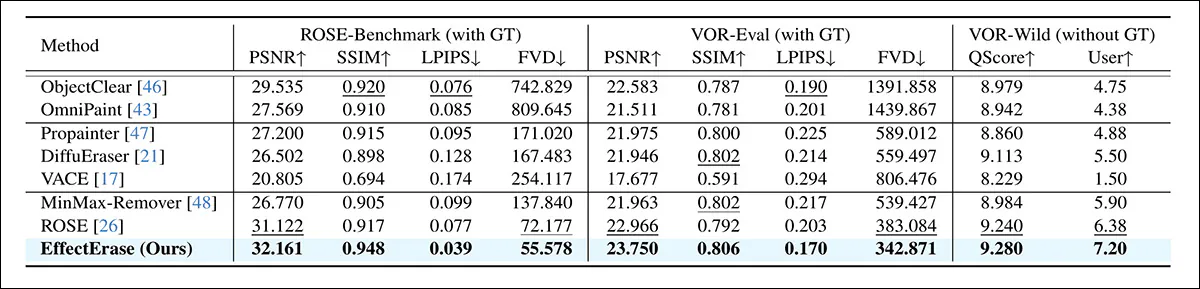

Badacze przetestowali swoje podejście wobec różnych metod inpainting, inpainting filmów wideo i usuwania obiektów: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; i MiniMax-Remover.

Wan2.1 został dostrojony z LoRA†† przy użyciu zestawu VOR w rozdzielczości 832x480px. 81 kolejnych klatek (limit skuteczny dla WAN, poza którym błędy mają tendencję do występowania) zostało losowo wybranych do szkolenia, które odbywało się przez 129 000 iteracji przy rozmiarze partii 8, na ośmiu procesorach GPU H100, każdy z 80 GB pamięci VRAM. Stawka uczenia została ustalona na 1×102, a rang LoRA na 256.

Zestaw ROSE-Benchmark syntetyczny był jedynym zewnętrznym zestawem danych, który został przetestowany; dwa pozostałe to VOR-Eval, zestaw testowy VOR podział; i VOR-Wild, zestaw testowy składający się z 195 filmów wideo zebranych z Internetu, zawierających “dynamiczne obiekty”.

Współczynniki użyte to Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Learned Perceptual Image Patch Similarity (LPIPS); i Fréchet Video Distance (FVD). Przeprowadzono również badanie użytkowników 195 wygenerowanych filmów wideo z VOR-Wild, z uwzględnieniem średnich ocen od 20 wolontariuszy.

Dodatkowo autorzy opracowali QScore, miarę wykorzystującą model multimodalny Qwen-VL, w celu oceny jakości filmów wideo po usunięciu obiektu, pod względem pozostałych artefaktów lub pominiętych usuwań środowiskowych, takich jak cienie i efekty oświetlenia:

Porównanie ilościowe na benchmarkach ROSE i VOR, z najlepszymi i drugimi wynikami pokazanymi w postaci pogrubionej i podkreślonej, odpowiednio.

W odniesieniu do tych wyników, autorzy zauważają:

‘[Aktualne] metody inpainting obrazu działają na pojedynczych klatkach, używając modeli 2D bez modelowania czasowego, i dlatego nie są w stanie utrzymać spójności czasowej w filmach wideo.

Metody inpainting filmów wideo nie modelują jawnie efektów ubocznych obiektów, w wyniku czego powstają nienaturalne wyniki usuwania. Istniejące metody usuwania obiektów z filmów wideo nie posiadają modelowania korelacji przestrzenno-czasowej między obiektem a jego efektami ubocznymi, i w wyniku często produkują artefakty i pozostałości usuniętych obiektów.

‘Ogólnie, EffectErase osiąga najlepsze wyniki we wszystkich zestawach danych i miarach oceny. Uzyskuje najlepsze wyniki w metryce jakości filmu wideo FVD, demonstrując wyższą gładkość czasową i spójność wygenerowanych filmów wideo.

‘Nasza metoda również osiąga najwyższy QScore i oceny użytkowników, co dalej potwierdza jej skuteczność w produkcji wizualnie przekonywających wyników usuwania.’

Do oceny jakościowej, wyniki statyczne są oferowane w artykule (pokazane) bezpośrednio poniżej, a wyniki ruchome są dostępne na stronie projektu i w towarzyszącym filmie na YouTube:

Porównanie jakościowe na VOR-Eval w przypadku zakrycia, cienia, oświetlenia, odbicia i deformacji. Metody inpainting mają trudności z usuwaniem efektów poza maską, podczas gdy modele usuwania często pozostawiają widoczne artefakty. EffectErase usuwa zarówno celowe obiekty, jak i ich powiązane efekty w sposób bardziej czysty. Proszę odnosić się do oryginalnego artykułu, aby uzyskać lepszą rozdzielczość, i do strony projektu, aby uzyskać przykłady filmów wideo.

Zwracamy również uwagę na różne powiązane przykłady na stronie projektu, zapowiedziane poniżej, a także oficjalny film na YouTube osadzony na końcu tego artykułu:

Kliknij, aby odtworzyć. Przykład porównawczy z EffectErase’s strony projektu. Proszę odnosić się do strony, aby uzyskać lepszą rozdzielczość (z powyższymi zastrzeżeniami) i uzyskać dalsze przykłady.

Autorzy komentują:

‘Metody inpainting filmów wideo często produkują artefakty w maskowanych obszarach i nie są w stanie całkowicie usunąć efektów ubocznych powodowanych przez usunięte obiekty. Poprzednie podejścia do usuwania obiektów, takie jak [ROSE] i [MinMax-Remover], radzą sobie dobrze w usuwaniu obiektów docelowych, ale nadal mają trudności z efektami ubocznymi, szczególnie w przypadku zakrycia, cienia, oświetlenia, odbicia i deformacji.

‘Natomiast EffectErase skutecznie usuwa zarówno celowe obiekty, jak i ich powiązane efekty, w wyniku czego powstają czyste, spójne i wysokiej jakości wyniki.’

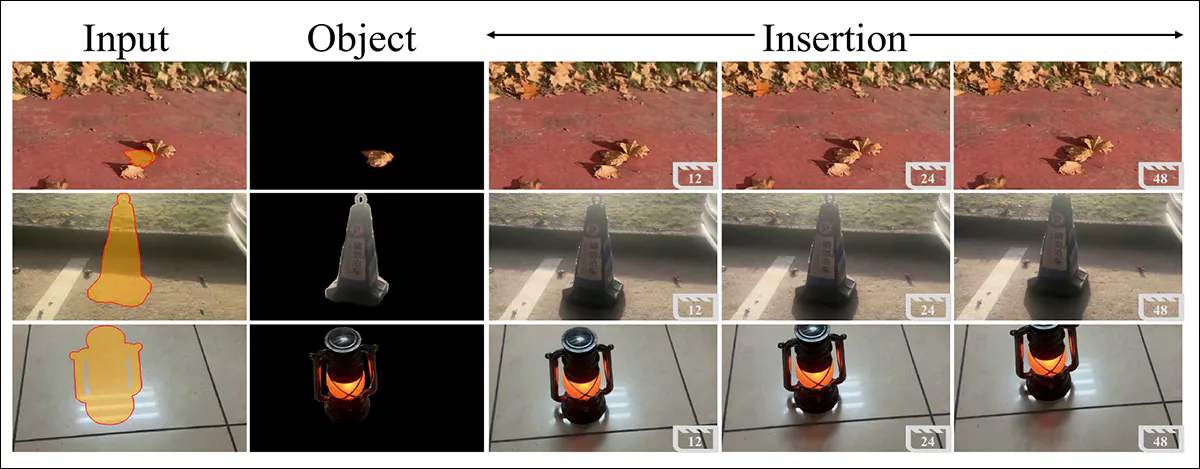

W podsumowaniu, badacze zauważają, że ich metoda może być również dostosowana do zadań wstawiania zamiast usuwania, bez potrzeby dodatkowego szkolenia:

Wyniki wstawiania obiektów z filmów wideo. EffectErase wstawia obiekty, zachowując zawartość tła i generując spójne efekty wywołane przez obiekt, takie jak cienie i odbicia, w całym filmie wideo.

Wyniki filmów wideo dla zadania wstawiania są dostępne w (konkretnym) filmie na YouTube (również osadzonym bez znaczników czasowych na końcu artykułu).

Podsumowanie

Spojrzenie na podobne projekty w literaturze ujawnia, że wiele z nich nadal liczy na to, że ogólne modele VFX w końcu będą w stanie zintegrować tego typu funkcjonalność do ogólnego modelu “narzędziowego” zaprojektowanego do szeregu efektów, a nie tylko do tego konkretnego zadania.

Jednakże, na zasadzie “wszystko lub nic”, wydaje się rozsądne założyć, że dedykowane systemy, takie jak EffectErase, będą nadal utrzymywać przewagę nad bardziej ogólnymi podejściami; z zastrzeżeniem, że luka ta może ostatecznie skurczyć się na tyle, aby różnica nie była warta dodatkowego wysiłku wytrenowania oddzielnego modelu.

* Byłoby się spodziewać, że wszystkie takie źródła będą cytowane; ale jeśli dostępne materiały z nowej pracy wymieniają źródło modeli 3D, nie byłem w stanie znaleźć tej referencji.

† Podany link wydaje się być ogólnym tekstem wyjaśniającym z 2013 roku, z konkretnym VAE nieopisany.

†† Pobrany z artykułu, jest to opis semantycznie niejasny, ponieważ dostrojenie i LoRA to różne procesy z bardzo różnymi wymaganiami.

Pierwotnie opublikowane w sobotę, 21 marca 2026