Kąt Andersona

AI Wideo Doskonale Zdjęcie Kota

Często generatory wideo AI dają wyniki, które są bliskie, ale nie całkowicie spełniają oczekiwań, jeśli chodzi o dostarczanie tego, co użytkownik chce uzyskać za pomocą podanego tekstu. Ale nowe, wysokopoziomowe rozwiązanie sprawia, że wszystko się zmienia.

Systemy generatywne wideo często mają trudności z tworzeniem filmów, które są naprawdę kreatywne lub dzikie, i często nie spełniają oczekiwań użytkowników co do ich tekstowych podpowiedzi.

Część powodu tego stanu rzeczy jest związana z splątaniem – faktem, że modele widzenia/języka muszą podejmować kompromis co do czasu, przez jaki są szkolone na danych źródłowych. Za mało szkolenia, a pojęcia są elastyczne, ale nie w pełni ukształtowane – za dużo, a pojęcia są dokładne, ale nie są już wystarczająco elastyczne, aby można było je włączyć w nowe kombinacje.

Można zrozumieć to, patrząc na film umieszczony poniżej. Po lewej stronie jest rodzaj kompromisu pół-etatu, jaki wiele systemów AI dostarcza w odpowiedzi na wymagającą podpowiedź (podpowiedź jest na górze filmu we wszystkich czterech przykładach), która prosi o jakąś konfrontację elementów, która jest zbyt fantastyczna, aby mogła być prawdziwym przykładem szkoleniowym. Po prawej stronie jest wyjście AI, które znacznie lepiej trzyma się podpowiedzi:

Kliknij, aby odtworzyć (bez dźwięku). Po prawej stronie widzimy ‘rozczłonkowany’ WAN 2.2, który naprawdę spełnia podpowiedzi, w porównaniu z mglistymi interpretacjami ‘waniliowego’ Wan 2.2. na lewej stronie. Proszę odnieść się do plików wideo źródłowych, aby uzyskać lepszą rozdzielczość i więcej przykładów, chociaż kuratorowane wersje widoczne tutaj nie istnieją na stronie projektu i zostały zmontowane na potrzeby tego artykułu. Źródło

Czytelnik może wybaczyć kaczce brawurowców (!), ale jest jasne, że przykłady po prawej stronie znacznie lepiej spełniają oryginalną tekstową podpowiedź niż te po lewej stronie.

Co ciekawe, obie architektury są podstawowo takie same – popularne i bardzo zdolne Wan 2.2, chińskie wydanie, które zyskało znaczną popularność w społecznościach open source i hobbystycznych w tym roku.

Różnica polega na tym, że drugi generatywny potok jest rozczłonkowany, co w tym przypadku oznacza, że duży model językowy (LLM) został użyty do ponownej interpretacji pierwszego (inicjalnego) klatki wideo, tak aby było znacznie łatwiej dla systemu dostarczyć to, o co użytkownik prosi.

To “anchorowanie wizualne” obejmuje wstrzyknięcie obrazu stworzonego z tego LLM-u wzmocnionego podpowiedzi do potoku generatywnego jako “klatkę startową” i użycie LoRA modelu interpretacyjnego, aby pomóc włączyć “intruz” klatkę do procesu tworzenia wideo.

Wyniki, jeśli chodzi o wierność podpowiedzi, są dość godne uwagi, szczególnie dla rozwiązania, które wydaje się dość eleganckie:

Kliknij, aby odtworzyć (bez dźwięku). Kolejne przykłady ‘rozczłonkowanych’ generacji wideo, które naprawdę trzymają się scenariusza. Proszę odnieść się do plików wideo źródłowych, aby uzyskać lepszą rozdzielczość i więcej przykładów, chociaż kuratorowane wersje widoczne tutaj nie istnieją na stronie projektu i zostały zmontowane na potrzeby tego artykułu.

To rozwiązanie przychodzi w postaci nowego artykułu Factorized Video Generation: Decoupling Scene Construction and Temporal Synthesis in Text-to-Video Diffusion Models, i jego wideo-obfitującej strony projektu.

Podczas gdy wiele obecnych systemów próbuje poprawić dokładność podpowiedzi, używając modeli językowych do przepisywania niejasnych lub niedookreślonych tekstów, nowa praca twierdzi, że ta strategia nadal prowadzi do niepowodzenia, gdy wewnętrzna reprezentacja sceny modelu jest wadliwa.

Nawet z szczegółową przepisaną podpowiedzią, modele text-to-video często źle komponują kluczowe elementy lub generują niezgodne stanów początkowych, które łamią logikę animacji. Tak długo, jak pierwsza klatka nie odzwierciedla tego, co opisuje podpowiedź, wynikowy film nie może się odzyskać, niezależnie od tego, jak dobry jest model ruchu.

Artykuł stwierdza*:

‘[Text-to-video] modele często produkują rozproszone klatki, a jednak osiągają [wyniki oceny] porównywalne do I2V modeli, co wskazuje, że ich modelowanie ruchu pozostaje racjonalnie naturalne, nawet gdy wierność sceny jest względnie słaba.

‘[Image-to-Video] modele wykazują komplementarne zachowanie, silne [wyniki oceny] z dokładnymi scenami początkowymi i słabszą spójnością czasową, podczas gdy I2V+tekst równoważy oba aspekty.

‘To kontrast sugeruje strukturalne niezgodność w obecnych modelach T2V: zakotwiczenie sceny i synteza czasowa korzystają z odrębnych indukcyjnych uprzedzeń, a istniejące architektury próbują uczyć się obu jednocześnie w ramach jednego modelu.’

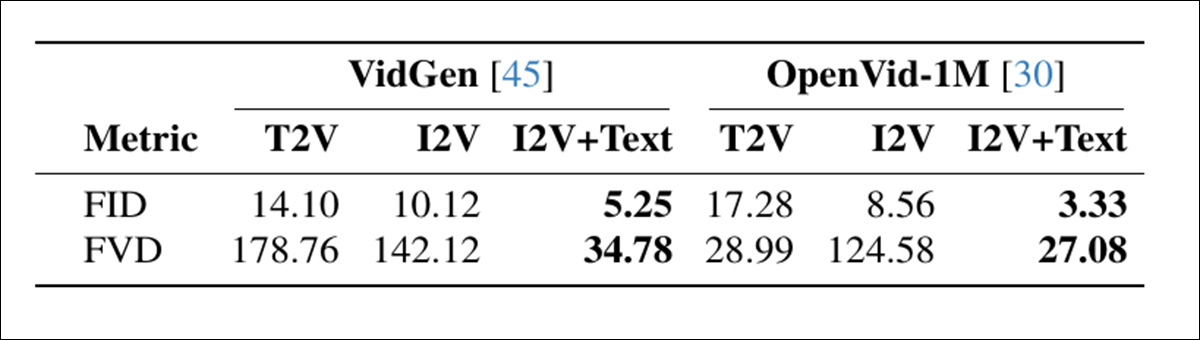

Porównanie diagnostyczne trybów generacji wykazało, że modele bez jawnych zakotwień sceny uzyskały dobre wyniki w ruchu, ale często kompromitowały układ sceny:

Porównanie trybów generacji wideo na dwóch zbiorach danych, pokazujące, że I2V+tekst osiąga najlepszą jakość klatki (FID) i spójność czasową (FVD), podkreślając korzyść z rozdzielenia konstrukcji sceny od ruchu. Źródło

Te wyniki wskazują, że bieżące modele próbują uczyć się układu sceny i animacji w jednym czasie, nawet jeśli te dwie zadania wymagają różnych rodzajów indukcyjnego uprzedzenia, i są lepiej obsługiwane oddzielnie.

Być może najbardziej interesujące jest to, że ten “trick” może potencjalnie być zastosowany do lokalnych instalacji modeli, takich jak Wan 2.1 i 2.2, oraz podobnych modeli dyfuzyjnych wideo, takich jak Hunyuan Video. Anegdotycznie, porównując jakość wyjścia hobbystów do komercyjnych portali generatywnych, takich jak Kling i Runway, większość głównych dostawców API poprawia oferty open source, takie jak WAN, z LoRAs, i – wydaje się – z trickami tego rodzaju, jak te widoczne w nowym artykule. Dlatego ten konkretny podejście może reprezentować dogonienie dla kontyngentu FOSS.

Testy przeprowadzone dla tej metody wskazują, że ten prosty i modułowy podejście oferuje nowy stan sztuki na T2V-CompBench benchmark, znacznie poprawiając wszystkie przetestowane modele. Autorzy zauważają, że ich system radykalnie poprawia wierność, ale nie rozwiązuje (ani nie jest przeznaczony do rozwiązania) dryfu tożsamości, który jest obecnie plagą badań nad generatywnym AI.

Nowy artykuł pochodzi od czterech badaczy z Ecole Polytechnique Fédérale de Lausanne (EPFL) w Szwajcarii.

Metoda i Dane

Centralną propozycją nowej techniki jest to, że modele dyfuzyjne text-to-video (T2V) muszą być “zakotwiczone” w klatkach startowych, które naprawdę pasują do pożądanej tekstowej podpowiedzi.

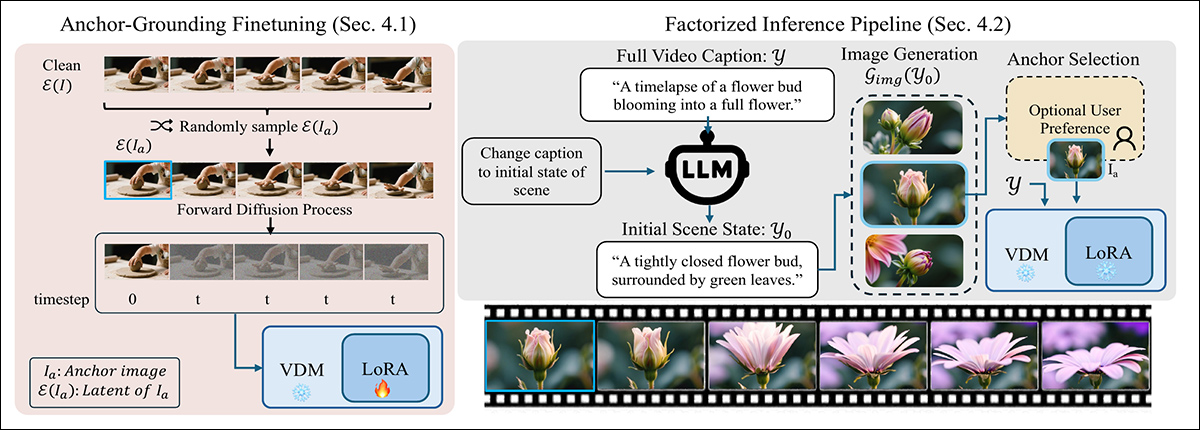

Aby upewnić się, że model szanuje klatkę startową, nowa metoda zakłóca standardowy proces dyfuzyjny przez wstrzyknięcie czystego latentu z kotwicy obrazu w czasie zerowym, zastępując jeden z zwykłych hałaśliwych wejść. To nieznane wejście dezorientuje model na początku, ale z minimalnym LoRA dostrojeniem, uczy się traktować wstrzykniętą klatkę jako stałą wizualną kotwicę, a nie część trajektorii hałasu:

Dwuetapowa metoda zakotwiczenia generacji wideo z wizualną kotwicą: Po lewej, model jest dostrojony przy użyciu lekkiego LoRA, aby traktować wstrzyknięty czysty latent jako stałe ograniczenie sceny. Po prawej, podpowiedź jest podzielona na podpowiedź pierwszej klatki, która jest używana do wygenerowania kotwicy obrazu, który prowadzi wideo.

Podczas inferencji metoda przepisuje podpowiedź, aby opisać tylko pierwszą klatkę, używając LLM do wyodrębnienia prawdopodobnego stanu sceny początkowej, skupiając się na układzie i wyglądzie.

Przepisana podpowiedź jest przekazywana do generatora obrazu, aby wyprodukować kandydującą klatkę kotwicy (która może być opcjonalnie udoskonalona przez użytkownika). Wybrana klatka jest zakodowana w latent i wstrzykiwana do procesu dyfuzyjnego, zastępując pierwszy krok czasowy, pozwalając modelowi wygenerować resztę wideo będąc zakotwiczone w scenie początkowej – proces, który działa bez wymagania zmian w podstawowej architekturze.

Proces ten został przetestowany przez stworzenie LoRAs dla Wan2.2-14B, Wan2.1-1B i CogVideo1.5-5B. Szkolenie LoRA odbyło się w rang 256, na 5000 losowo wybranych klipach z UltraVideo kolekcji.

Szkolenie trwało 6000 kroków i wymagało 48 godzin GPU dla Wan-1B i CogVideo-5B, oraz 96 godzin GPU dla Wan-14B. Autorzy zauważają, że Wan-5B rodzinnie obsługuje text-only i text-image warunkowanie (które są w tym przypadku narzucane na starsze ramy), i dlatego nie wymagały żadnego dostrojenia.

Testy

W eksperymentach przeprowadzonych dla tego procesu, każda tekstowa podpowiedź została najpierw udoskonalona przy użyciu Qwen2.5-7B-Instruct, który użył wyniku do wygenerowania szczegółowej “seed image” podpowiedzi zawierającej opis całej sceny. Następnie została ona przekazana do QwenImage, który został poproszony o wygenerowanie “magicznej” klatki, która ma być wstrzyknięta do procesu dyfuzyjnego.

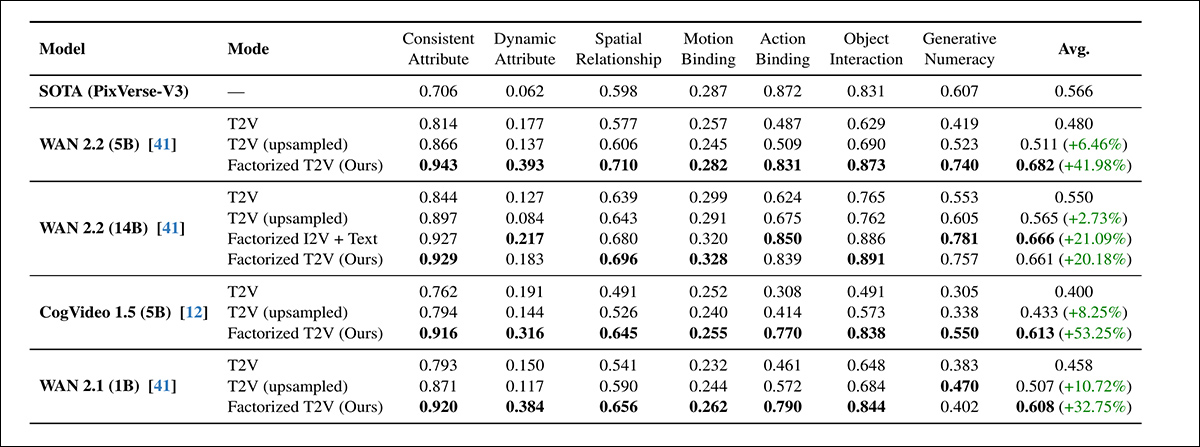

Benchmarki użyte do oceny systemu obejmowały wspomniany T2V-CompBench, do testowania zrozumienia kompozycyjnego, oceniając, jak dobrze modele zachowują obiekty, atrybuty i działania w spójnej scenie; oraz VBench 2.0, do oceny szerszego rozumowania i spójności w 18 metrykach, pogrupowanych w kreatywność, zdrowy rozsądek, kontrola, ludzka wierność i fizyka:

Przez wszystkie siedem kategorii oceny T2V-CompBench, metoda T2V rozczłonkowanego wykonała lepiej niż standardowe i podwyższone podstawy T2V dla każdego testowanego modelu, z zyskami sięgającymi do 53,25%. Najlepsze warianty często dopasowywały lub przewyższały benchmark PixVerse-V3.

Co się tyczy tej pierwszej rundy testów, autorzy stwierdzają*:

‘[Wszystkie] modele, dodanie obrazu kotwicy poprawia wydajność kompozycyjną. Wszystkie mniejsze modele rozczłonkowane (CogVideo 5B, Wan 5B i Wan 1B) przewyższają większy model T2V Wan 14B.

‘Nasza wersja rozczłonkowana Wan 5B również przewyższa komercyjną linię bazową PixVerse-V3, która jest najlepszym znanym modelem na tym benchmarku. To pokazuje, że kotwiczenie wizualne znacznie poprawia zrozumienie sceny i działania, nawet w mniejszych modelach.

‘W ramach każdej rodziny modeli, wersja rozczłonkowana przewyższa oryginalny model. Godne uwagi jest to, że nasza lekka kotwica LoRA na Wan 14B osiąga wyniki porównywalne do wersji I2V 14B (0,661 vs. 0,666), pomimo braku pełnego przeszkolenia.’

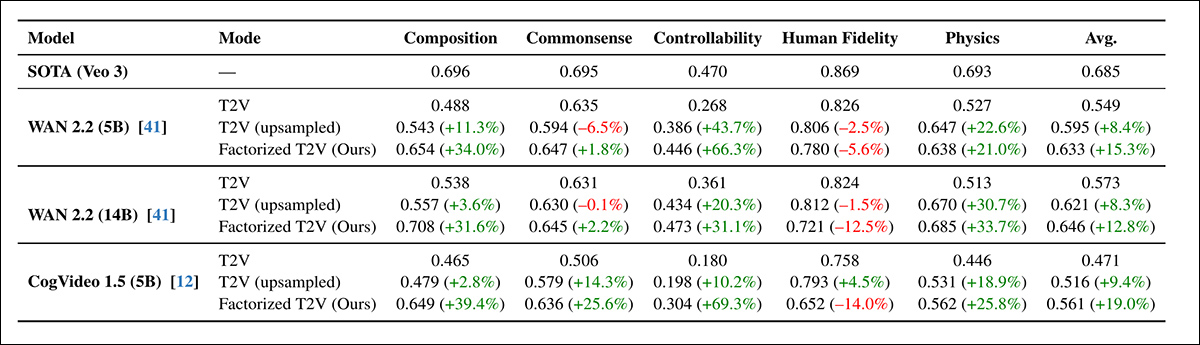

Następnie przyszedł VBench2.0:

Metoda T2V rozczłonkowanego poprawia wydajność VBench 2.0 we wszystkich kategoriach, z zyskami przekraczającymi 60% – chociaż ludzka wierność pozostała poniżej linii bazowej Veo 3.

Przez wszystkie architektury, podejście rozczłonkowane zwiększyło wyniki we wszystkich kategoriach VBench, z wyjątkiem ludzkiej wierności, która nieznacznie spadła, nawet z podpowiedzią podwyższoną. Wan 5B przewyższył większy Wan 14B, wzmacniając wcześniejsze wyniki T2V-CompBench, że kotwiczenie wizualne przyczyniało się bardziej niż skala.

Chociaż zyski na VBench były spójne, były mniejsze niż te widoczne na T2V-CompBench, a autorzy przypisują to surowej binarnej ocenie VBench.

Dla testów jakościowych, artykuł dostarcza statyczne obrazy, ale odsyłamy czytelnika do skomponowanych filmów wideo umieszczonych w tym artykule, aby uzyskać jaśniejszy pomysł, z zastrzeżeniem, że źródłowe filmy wideo są liczniejsze i bardziej różnorodne, a także posiadają większą rozdzielczość i szczegóły. Znajdź je tutaj. Co się tyczy wyników jakościowych, artykuł stwierdza:

‘Filmy z kotwicą wykazują konsekwentnie bardziej dokładną kompozycję sceny, silniejsze powiązanie obiektu-atrybutu i jaśniejszy postęp czasowy.’

Metoda rozczłonkowana pozostała stabilna, nawet gdy liczba kroków dyfuzyjnych została obcięta z 50 do 15, pokazując prawie żadnej utraty wydajności na T2V-CompBench. W przeciwieństwie do tego, oba podstawy tekstowe i podwyższone uległy znacznemu pogorszeniu w tych samych warunkach.

Chociaż redukcja kroków mogłaby teoretycznie potroić szybkość, pełny potok generacji stał się tylko 2,1-krotnie szybszy w praktyce, ze względu na stałe koszty związane z generowaniem obrazu kotwicy. Niemniej, wyniki wskazują, że kotwiczenie nie tylko poprawia jakość próbek, ale także stabilizuje proces dyfuzyjny, wspierając szybszą i bardziej wydajną generację bez utraty dokładności.

Strona projektu zapewnia przykłady porównań między generacjami z podpowiedzią a nową metodą, z których kilka (o niższej rozdzielczości) edytowanych przykładów przedstawiamy tutaj:

Kliknij, aby odtworzyć (bez dźwięku). Porównanie źródłowych klatek startowych z podejściem rozczłonkowanym.

Autorzy kończą:

‘Nasze wyniki sugerują, że poprawione kotwiczenie, a nie tylko zwiększona pojemność, może być równie ważne. Ostatnie postępy w T2V dyfuzyjnym opierały się głównie na zwiększaniu rozmiaru modelu i danych szkoleniowych, jednak nawet duże modele często mają trudności z inferencją spójnej sceny początkowej z samego tekstu.

‘To kontrastuje z dyfuzyjnym modelem obrazu, gdzie skalowanie jest względnie proste; w modelach wideo, każda poprawa architektury musi działać nad dodatkową wymiarem czasowym, co sprawia, że skalowanie jest znacznie bardziej zasobożerne.

‘Nasze ustalenia wskazują, że poprawione kotwiczenie może uzupełnić skalę, rozwiązując inny wąski gardło: ustanowienie prawidłowej sceny przed rozpoczęciem syntezy ruchu.

‘Przez rozczłonkowanie generacji wideo na konstrukcję sceny i modelowanie czasowe, łagodzimy kilka typowych trybów awaryjnych bez potrzeby znacznie większych modeli. Uważamy to za komplementarny zasadę projektową, który może prowadzić przyszłe architektury w kierunku bardziej niezawodnej i ustrukturyzowanej syntezy wideo.’

Wnioski

Chociaż problemy związane ze splątaniem są bardzo realne i mogą wymagać dedykowanych rozwiązań (takich jak poprawiona kuracja i ocena dystrybucji przed szkoleniem), było to odkrywcze, aby zobaczyć, jak rozczłonkowanie “rozluźnia” kilka upartych i “zablokowanych” układów podpowiedzi w znacznie bardziej dokładne renderowania – z tylko umiarkowaną warstwą LoRA dostrojenia i interwencją znacznie poprawionego obrazu startowego.

Przepaść w zasobach między lokalną inferencją hobbystów a komercyjnymi rozwiązaniami może nie być tak ogromna, jak się wydaje, biorąc pod uwagę, że prawie wszystkie dostawcy starają się racjonalizować swoje znaczne wydatki na zasoby GPU dla konsumentów.

Wnioski tego rodzaju mogą pomóc w dalszym zamykaniu tej luki, w kontekście sceny wydawniczej, w której Chińczycy zdają się być zdeterminowani (niekoniecznie z altruistycznych lub idealistycznych powodów), aby udemokratyzować AI gen, podczas gdy zachodnie interesy biznesowe mogą wolać, aby zwiększający się rozmiar modelu i regulacje ostatecznie odizolowały najlepsze modele za API i wieloma warstwami filtrów treści.

* Akcenty autorów, nie moje.

† Artykuł nie określa, jaki GPU został wybrany, ani ile ich zostało użytych.

†† Chociaż trasa LoRA jest bardziej prawdopodobna, zarówno ze względu na ekonomiczną łatwość użycia, jak i dlatego, że pełne wagi, a nie kwantyzowane wagi, nie są zawsze dostępne.

Pierwotnie opublikowane w piątek, 19 grudnia 2025