Kąt Andersona

Cenzurowanie modeli AI nie działa dobrze, ujawnia studium

Próby cenzurowania generatorów obrazów AI przez kasowanie zabronionych treści (takich jak pornografia, przemoc lub chronione prawem autorskim style) z wytrenowanych modeli nie powiodły się: nowe badanie wykazuje, że obecne metody kasowania pojęć pozwalają “zabronionym” atrybutom na przenikanie do niezwiązanych obrazów i nie powstrzymują blisko spokrewnionych wersji rzekomo “usuniętej” treści od pojawiania się.

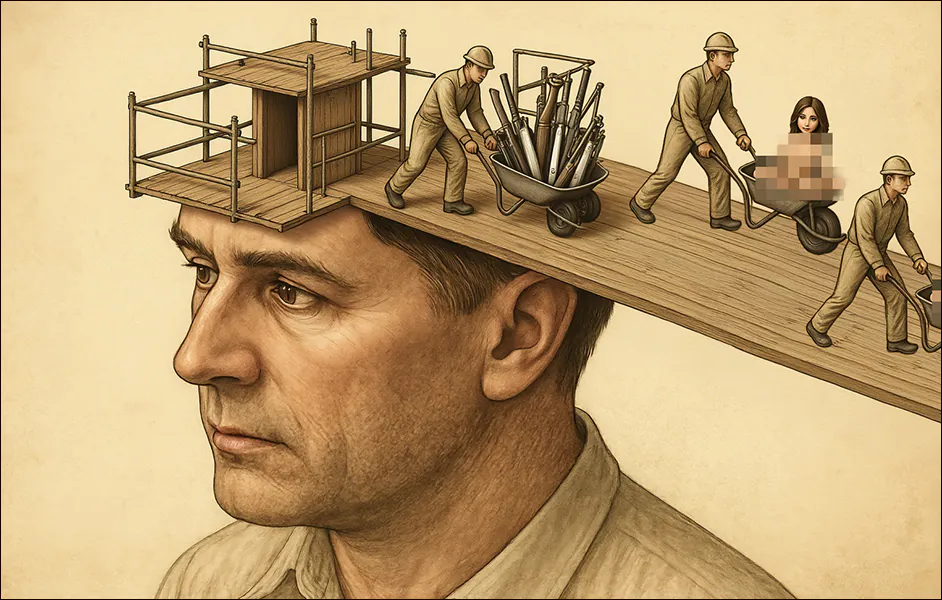

Jeśli firmy, które produkują podstawowe modele AI, nie mogą powstrzymać ich przed używaniem do tworzenia obraźliwych lub nielegalnych materiałów, ryzykują prześladowaniem i/lub zamknięciem. Odwrotnie, dostawcy, którzy udostępniają swoje modele tylko za pośrednictwem interfejsu API, jak na przykład Adobe’s Firefly generatywny silnik, są w sytuacji, w której nie muszą martwić się o to, co ich modele mogą tworzyć, ponieważ zarówno prompty użytkownika, jak i wynikowy wyjście są inspekcjonowane i oczyszczane:

System Adobe’s Firefly, używany w narzędziach takich jak Photoshop, czasami odmawia generatywnego żądania od razu, blokując prompty przed utworzeniem czegokolwiek. Czasami generuje obraz, ale następnie blokuje wynik po przeglądzie. Ten rodzaj odmowy w trakcie procesu może również wystąpić w ChatGPT, gdy model zaczyna odpowiedź, ale przerywa ją po rozpoznaniu naruszenia polityki – i okazjonalnie można zobaczyć przerwany obraz przez krótki czas podczas tego procesu.

Jednak filtry API tego rodzaju można zwykle neutralizować przez użytkowników na lokalnie zainstalowanych modelach, w tym modele językowo-wizualne (VLM), które użytkownik może chcieć dostosować za pomocą lokalnego szkolenia na niestandardowych danych.

W większości przypadków wyłączanie takich operacji jest trywialne i polega na zakomentowaniu wywołania funkcji w Pythonie (chociaż takie haczyki muszą zwykle być powtarzane lub ponownie wymyślane po aktualizacjach frameworka).

Z punktu widzenia biznesu trudno zrozumieć, jak to może być problem, ponieważ podejście API maksymalizuje korporacyjną kontrolę nad przepływem pracy użytkownika. Z punktu widzenia użytkownika jednak zarówno koszt modeli tylko API, jak i ryzyko błędnego lub nadmiernego cenzurowania jest prawdopodobnie skłaniać ich do pobierania i dostosowywania lokalnych instalacji alternatywnych oprogramowań open source – przynajmniej tam, gdzie licencjonowanie FOSS jest korzystne.

Ostatni znaczący model, który został wydany bez żadnej próby wprowadzenia samocenzury, był Stable Diffusion V1.5, prawie trzy lata temu. Później, ujawnienie, że jego korpusy szkoleniowe zawierały dane CSAM, doprowadziło do rosnących wezwań do zakazu ich dostępności i usunięcia z repozytorium Hugging Face w 2024 roku.

Wyciąć to!

Cynicy twierdzą, że zainteresowanie cenzurowaniem lokalnie instalowalnych generatywnych modeli AI opiera się wyłącznie na obawach o ekspozycji prawnej, jeśli ich ramy staną się publicznie znane za ułatwianie nielegalnych lub obraźliwych treści.

W istocie niektóre “lokalnie przyjazne” modele open source nie są tak trudne do odcenzurowania (jak Stable Diffusion 1.5 i DeepSeek R1).

Przez kontrast, niedawne wydanie Black Forest Lab’s Flux Kontext model series było charakterystyczne dla zaangażowania firmy w znaczące oczyszczanie całej serii Kontext, co zostało osiągnięte zarówno przez staranną kurację danych, jak i ukierunkowane dostosowanie po szkoleniu, zaprojektowane w celu usunięcia wszelkich pozostałych tendencji do treści NSFW lub zabronionych.

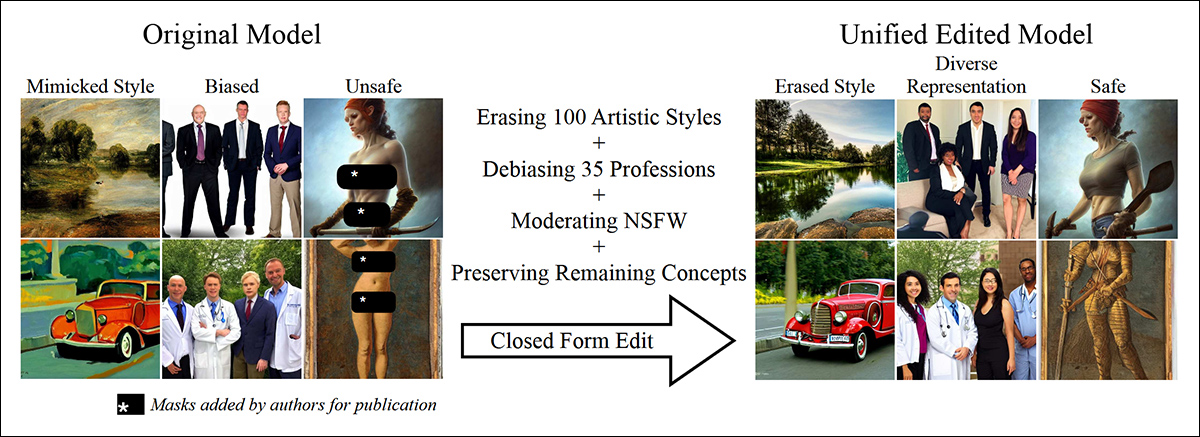

To jest miejsce, w którym locus działania był w scenie badawczej przez ostatnie 2-3 lata: z naciskiem na naprawę modeli z niedokładnymi danymi. Oferty tego rodzaju obejmują Unified Concept Editing in Diffusion Models (UCE); Reliable and Efficient Concept Erasure of Text-to-Image Diffusion Models (RECE); Mass Concept Erasure in Diffusion Models (MACE); i concept-Semi-Permeable structure is injected as a Membrane (SPM):

The 2024 paper ‘Unified Concept Editing in Diffusion Models’ offered closed-form edits to attention weights, enabling efficient editing of multiple concepts in text-to-image models. But does the method stand up to scrutiny? Source: https://arxiv.org/pdf/2308.14761

Chociaż jest to wydajne podejście (hiperskale kolekcje takie jak LAION są zbyt duże, aby ręcznie kuratywne), nie jest to koniecznie skuteczne podejście: według nowego amerykańskiego badania, żadna z wymienionych procedur edycyjnych – które reprezentują stan sztuki w modyfikacji modeli AI po szkoleniu – nie działa naprawdę dobrze.

Autorzy stwierdzili, że te Techniki Kasowania Pojęć (CET) mogą zwykle być łatwo obejściowe, a nawet tam, gdzie są one skuteczne, mają znaczne skutki uboczne:

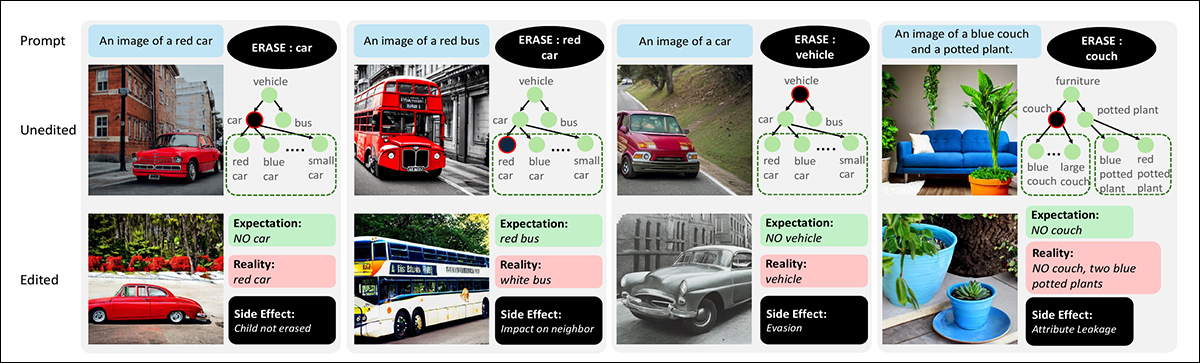

Effects of concept erasure on text-to-image models. Each column shows a prompt and the concept marked for erasure, along with generated outputs before and after editing. Hierarchies indicate parent-child relations between concepts. The examples highlight common side effects, including failure to erase child concepts, suppression of neighboring concepts, evasion through rewording, and transfer of erased attributes to unrelated objects. Source: https://arxiv.org/pdf/2508.15124

Autorzy stwierdzili, że wiodące obecne techniki kasowania pojęć nie blokują compositional prompts (na przykład red car lub small wooden chair); często pozwalają na prześlizgnięcie się podklas, nawet po usunięciu klasy nadrzędnej (takiej jak car lub bus, które nadal pojawiają się po usunięciu vehicle); i wprowadzają nowe problemy, takie jak przeciekanie atrybutów (gdzie, na przykład, usunięcie blue couch może spowodować, że model wygeneruje niezwiązany obiekt, taki jak blue chair).

W ponad 80% przypadków testowych usunięcie szerokiej koncepcji, takiej jak vehicle, nie powstrzymało modelu od generowania bardziej szczegółowych instancji vehicle, takich jak samochody lub busy.

Edycja, obserwuje praca, powoduje również attention maps (części modelu, które decydują, gdzie się skoncentrować w obrazie), aby rozproszyć, osłabiając jakość wyjścia.

Interesująco, praca stwierdza, że kasowanie pokrewnych wytrenowanych pojęć jeden po drugim działa lepiej niż próba usunięcia ich wszystkich na raz – chociaż nie usuwa wszystkich wad badanych metod edycyjnych:

Comparison of progressive and all-at-once erasure strategies. When all variants of ‘teddy bear’ are erased simultaneously, the model continues to generate bear-like objects. Erasing the variants step by step is more effective, leading the model to suppress the target concept more reliably.

Chociaż badacze nie mogą obecnie zaoferować rozwiązania problemów, które praca przedstawia, opracowali nowy zestaw danych i benchmark, który może pomóc w późniejszych projektach badawczych w zrozumieniu, czy ich własne “cenzurowane” modele działają zgodnie z oczekiwaniami.