Kąt Andersona

‘Rogue’ Dane Polluting Generative AI Performance

Nowe badanie wykazało, że wiele popularnych zbiorów danych obrazów używanych do szkolenia modeli AI jest zanieczyszczonych obrazami testowymi lub near-duplikatami, co pozwala modelom oszukiwać, memorując odpowiedzi zamiast uczyć się. Przecieki są powszechne, ale geralnie niewykrywalne, cicho nadmuchując wyniki i dając niesprawiedliwe przewagi modelom szkolonym na danych w skali sieci.

Gdy podejmujesz test na prawo jazdy, zwykle nie jesteś informowany z wyprzedzeniem o dokładnych drogach, które będą używane do testu. Jeśli tak (i masz nieco brakującej uczciwości), możesz “optymalizować” test, ćwicząc powtarzalnie na tej trasie, zamiast rozwijać szersze umiejętności jazdy, które mogą radzić sobie z dowolną trasą w miarę dobrze.

W treningu modeli machine learning, jest to uzasadniona analogia do test split – podziału danych zestawu szkoleniowego między (zwykle) 70% podziału dla danych, które będą używane do szkolenia modelu, a pozostałe 30% używane jako “w terenie” dane.

Ponieważ dane “w terenie” nie były nigdy widziane przez model, jeśli model działa dobrze na tych danych, można założyć, że jest skuteczny i wydajny; jeśli nie, model może przeuczyć na dobrze zbalansowanym zestawie – lub też dane potrzebują dodatkowej kuracji i definicji.

W każdym przypadku nie ocenianie modeli na ich danych szkoleniowych jest kamieniem węgielnym bieżącej metody w badaniach i rozwoju AI.

To samo jeszcze raz

Zgodnie z nowym artykułem badawczym z Japonii, sektor badań nad sztuczną inteligencją i generatywną AI nie zbliżył się nawet do wysiłków badaczy LLM, aby upewnić się, że dane testowe nie zanieczyszczają danych szkoleniowych; w testach, badacze stwierdzili, że każdy hiperskalowy zestaw wizji, który badali, w tym te, które napędzają niektóre z największych obecnych systemów generatywnej AI, pozwolił w pewnym stopniu na przeniknięcie danych testowych do danych szkoleniowych – co oznacza, że benchmarki i raporty o wydajności modeli szkolonych na tych podziałach nie będą bardziej dokładne niż wynik egzaminu od kogoś, kto wślizgnął się do sali egzaminacyjnej, i nie będą odzwierciedlać rzeczywistej wydajności w przypadku prawdziwie nowych danych.

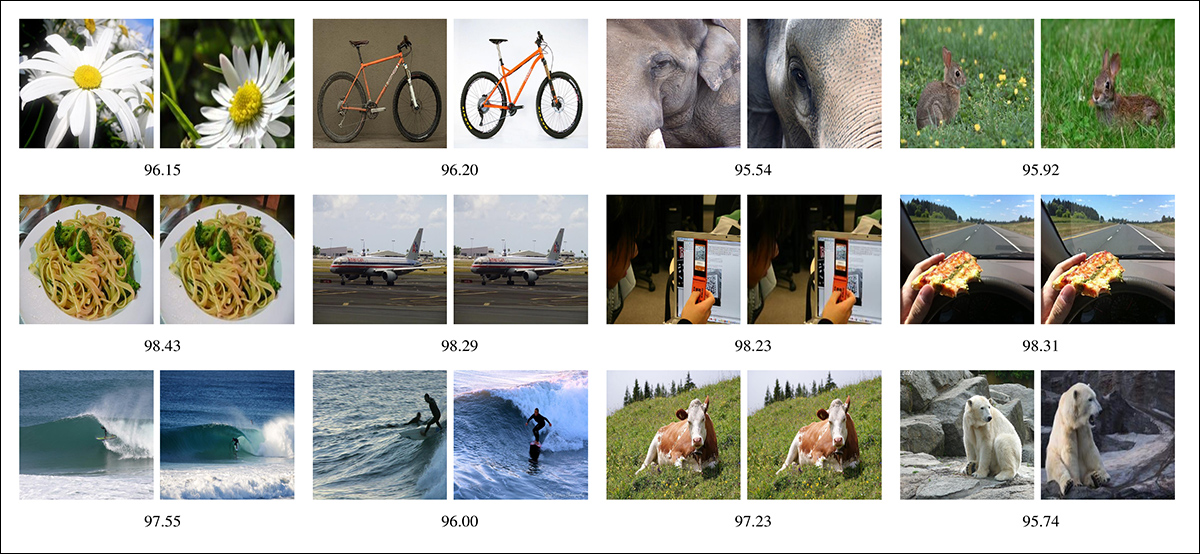

Przykłady skażeń danych znalezionych przez badaczy, gdzie punkty danych duplikatów lub near-duplikatów istnieją zarówno w danych szkoleniowych, jak i testowych. Źródło: https://arxiv.org/pdf/2508.17416

Na powyższym obrazie, z nowego artykułu, widzimy przykłady albo duplikatów, albo near-duplikatów punktów danych znalezionych w danych szkoleniowych i testowych różnych modeli – wystarczająco, aby unieważnić wydajność modelu na tych danych i lekko nadmuchnąć ogólne wyniki, ułatwiając pojawienie się poziomu uogólnienia, którego model może nie rzeczywiście osiągnąć.

Aby sprawy były bardziej skomplikowane, zanieczyszczenie wydaje się występować w różnych możliwych scenariuszach, w tym ‘pre-szkolenie‘, gdzie wagi starszych modeli przodków są używane do “rozpoczęcia” nowego modelu. Jeśli model przodków ma niektóre z tych samych danych, co nowy zestaw danych, który jest pre-szkolony, to zanieczyszczenie może wystąpić, nawet jeśli podział 70/30 lub 80/20 jest czysty.

Kumulatywny efekt

To jest prawie pewne, że wystąpi to nawet w najnowszych zestawach danych: zakres zestawów wizji/języka wzrósł ogromnie w ciągu ostatnich pięciu lat, obejmując nie tylko najnowsze dane obrazowe w sieci, ale także ponowne zbieranie dużej części tych samych danych, które zaludniały te starsze, historyczne zestawy danych.

Ponadto, automatyczne rutyny zaprojektowane do przeczesywania i filtrowania miliardów obrazów w celu wykrycia duplikatów i near-duplikatów są teraz skonfrontowane z takim ciężkim zadaniem, że sama kuracja – jej koszt w czasie i pieniądzu – musi być teraz brana pod uwagę w kontekście ograniczeń budżetowych

Tymczasem duplikowanie obrazu jest nieuniknioną konsekwencją rodzaju ad hoc przeczesywania sieci za pomocą ogromnych kolekcji, takich jak Common Crawl, ze względu na powszechną praktykę ponownego publikowania i rekompresowania obrazów, oraz stosowania edycji, takich jak przycinanie, i nawet odwracanie (aby uniknąć wykrycia, gdy obraz może być użyty bez pozwolenia, na przykład).

Autorzy obserwują*:

‘Przecieki danych są powszechnym problemem, występującym w większości zestawów wizji. Przecieki mogą zaciemnić zdolność uogólniania modeli, co jest szczególnie problematyczne, gdy porównujemy modele szkolone na różnych zestawach danych, prowadząc do niesprawiedliwych porównań.

‘Nalegamy, aby projektanci zestawów danych starannie rozważyli implikacje tych ocen. Dla uczciwszej oceny modelu zalecamy użycie wykrywaczy duplikatów, które uwzględniają zarówno twarde, jak i miękkie przecieki.

‘Idealnie, przeciekłe obrazy powinny być usunięte z zestawu szkoleniowego, a jeśli to nie jest możliwe, powinny być przynajmniej usunięte z zestawu testowego.’

Artykuł wyjaśnia szereg testów, które badacze przeprowadzili na ogromnych i popularnych zestawach danych – każdy z nich wykazał pewien poziom zanieczyszczenia.

Nowy artykuł nowy artykuł nosi tytuł Przecieki danych w zestawach wizji, i pochodzi od trzech badaczy z Uniwersytetu w Osace.

Metoda

Autorzy artykułu definiują przecieki w trzech wymiarach: modalność, zakres i stopień.

Modalność rozróżnia, czy tylko obrazy są przeciekłe, czy zarówno obrazy, jak i etykiety są narażone; zakres identyfikuje, czy nachylenie występuje w tym samym zestawie danych, czy między różnymi zestawami; i stopień definiuje, czy zduplikowany zawartość jest identyczny, czy tylko sąsiedni.

W odniesieniu do przecieków, dwie sytuacje są brane pod uwagę w pracy: wewnątrz-zestawowe przecieki (gdzie obrazy oceny pojawiają się w podziale szkoleniowym tego samego zestawu), i między-zestawowe przecieki (gdzie obrazy oceny z jednego zestawu są obecne w innym zestawie używanym do szkolenia).

W odniesieniu do stopnia, dwa poziomy są zdefiniowane: miękkie przecieki (gdzie obrazy nie są identyczne, ale wykazują niewielkie zmiany), i twarde przecieki (gdzie obrazy są identyczne w szkoleniu i ocenie).

Badacze zajmują się wykrywaniem przecieków w zakresie przeszukiwania obrazu, używając kodera obrazu do reprezentowania każdego obrazu jako wektor cech. Zestaw zapytań to dane oceny, a zbiór to zestaw szkoleniowy.

Dla mniejszych zestawów danych, każdy wektor zapytania był porównywany bezpośrednio z wszystkimi wektorami szkoleniowymi przy użyciu podobieństwa cosinusoidalnego. Dla większych zestawów danych, Faiss index został zbudowany, aby umożliwić szybsze K-Nearest Neighbors (KNN) wyszukiwanie.

Ponieważ koder potrzebuje do przechwycenia wystarczającej ilości informacji wizualnych, aby wykryć subtelne podobieństwa, ale jednocześnie pozostać wydajnym w obliczu bardzo dużej ilości danych, autorzy polegali na pre-komputowanych CLIP cechach udostępnionych przez twórców zestawu danych, w przypadku kolekcji LAION, która podtrzymuje Stable Diffusion, i późniejszych projektów.

Autorzy zauważają, że pozwolenie CLIP na używanie jego destylowanego zrozumienia zestawu danych (zamiast głosowania rzeczywistych plików w skali) znacznie przyspieszyło proces i zapewniło lepszą spójność porównań.

Dane i testy

Koder obrazu CLIP użyty w testach dla nowej pracy był domyślnym CLIP ViT-B/32 oryginalnie używanym do przesiania LAION. Aby ustalić, czy różne obrazy są ze sobą powiązane, KNN został użyty pod AutoFaiss.

Zestawy danych zostały pogrupowane w trzy typy: pre-szkolenie zestawów danych – duże, z sieci wyłuskane kolekcje używane do szkolenia modeli ogólnych; szkolenie zestawów danych – mniejsze, często opatrzonych adnotacjami kolekcje, przeznaczone do bezpośredniego dostrajania modelu; i benchmark zestawów danych – ręcznie opatrzonych adnotacjami, i używanych wyłącznie do oceny.

Analiza objęła dwadzieścia podziałów w siedmiu zestawach danych: Microsoft COCO został użyty jako zestaw szkoleniowy i oceny, obejmując podziale treningowe, walidacyjne, testowe i nieoznaczone; Flickr30k służył wyłącznie jako benchmark; i kolekcja Google Conceptual Captions (GCC) została potraktowana jako źródło pre-szkolenia, z częścią walidacyjną również używaną do oceny.

Ponadto ImageNet został użyty do szkolenia i benchmarkingu, podczas gdy zestaw danych LAION-400M został użyty wyłącznie do pre-szkolenia.

OpenImages v4 wniósł wkład w dane szkoleniowe i benchmarkowe, a TextCaps dostarczył zarówno podziale treningowe, jak i testowe do oceny.

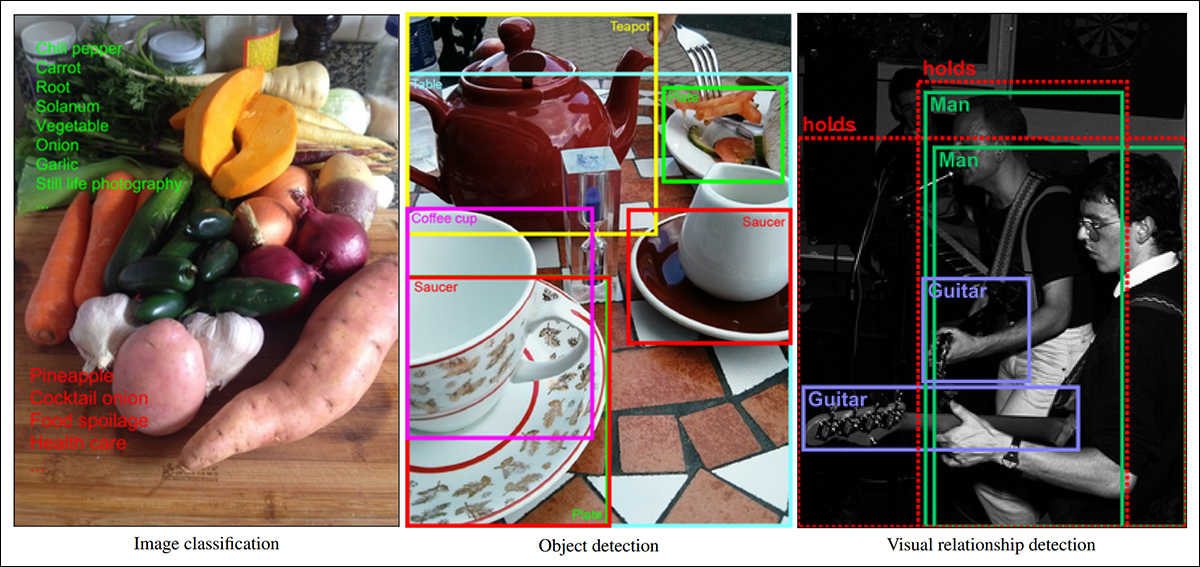

Przykłady adnotacji obrazu z zestawu danych Open Images, badanego w nowej pracy. Źródło: https://arxiv.org/pdf/1811.00982

Aby ocenić, jak dobrze metoda może wykryć przecieki, gdy obrazy zostały delikatnie zmienione przez zmianę rozmiaru, przycinanie lub podobne nie-semantyczne transformacje, autorzy przetestowali na Flickr30k, losowo wybierając 5 000 obrazów jako zapytania, i używając całego zestawu jako kolekcji odniesienia.

Każdy obraz zapytania został przekształcony przed zakodowaniem (tj. poddany nie-semantycznej modyfikacji, takiej jak zmiana rozmiaru lub przycinanie), a następnie dopasowany do najbardziej podobnego elementu w kolekcji przy użyciu podobieństwa cosinusoidalnego; dopasowanie zostało policzone tylko wtedy, gdy oryginalny obraz został wybrany jako najwyższy wynik.

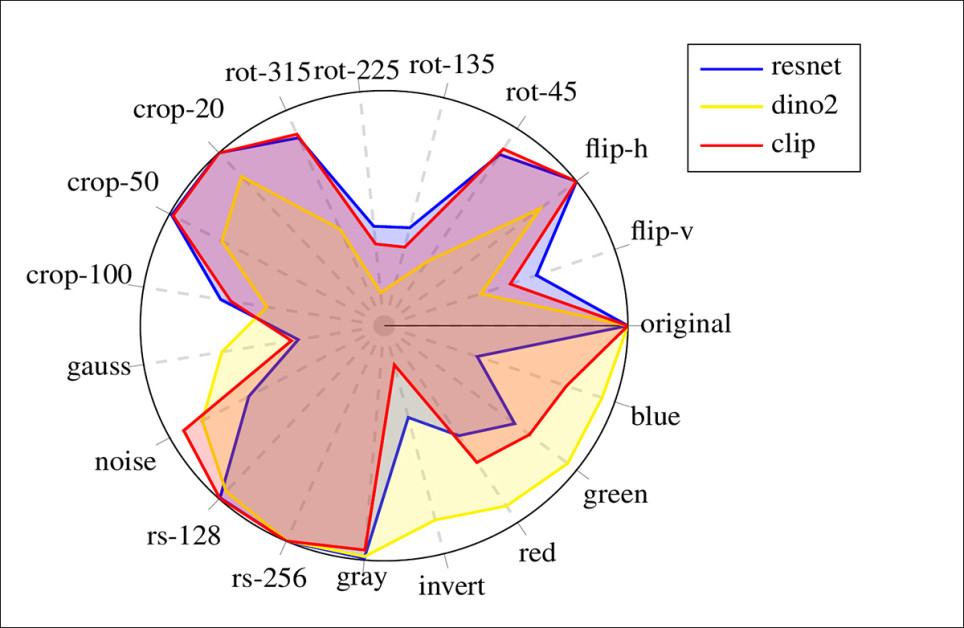

Trzy kodery porównywane były: ResNet-152; DINOv2 ViT-B/14; i CLIP ViT-B/32.

Cztery typy nie-semantycznych transformacji obrazu zostały użyte: geometryczne (odwrócenia i obroty); przycinanie (usunięcie 20, 50 lub 100 pikseli z każdej krawędzi); pikselizacja (rozmazanie Gaussa, dodanie szumu lub zmniejszenie do 128 lub 256 pikseli); i kolor (odwrócenie kolorów, odwrócenie lub nałożenie czerwonego, zielonego lub niebieskiego koloru).

Z materiału uzupełniającego, przykłady transformacji zastosowanych do danych – typowe rutyny również w preprocessingu danych.

Następnie autorzy przetestowali na wykrywanie przecieków w wyszukiwaniu obrazu:

Dokładność wykrywania przecieków na 5 000 obrazach zapytań Flickr30k poddanych różnym nie-semantycznym transformacjom.

Wszystkie trzy kodery osiągnęły idealną wydajność na niezmienionych obrazach, a CLIP pozostał niezawodny w przypadku przycinania, odwrócenia poziomego, szumu i zmiany rozmiaru, przewyższając ResNet na poziomie pikseli i zmianach koloru.

DINOv2 wykazał silną odporność na transformacje koloru (prawdopodobnie ze względu na jego samouczący się projekt, autorzy twierdzą), ale był znacznie słabszy w przypadku edycji geometrycznych i przycinania – obie są powszechne w zduplikowanych zestawach danych.

Ponieważ LAION już zawiera wbudowane cechy CLIP, a biorąc pod uwagę jego spójną wydajność i szybkość, CLIP został wybrany jako domyślny koder do głównej analizy.

Twarde i miękkie przecieki

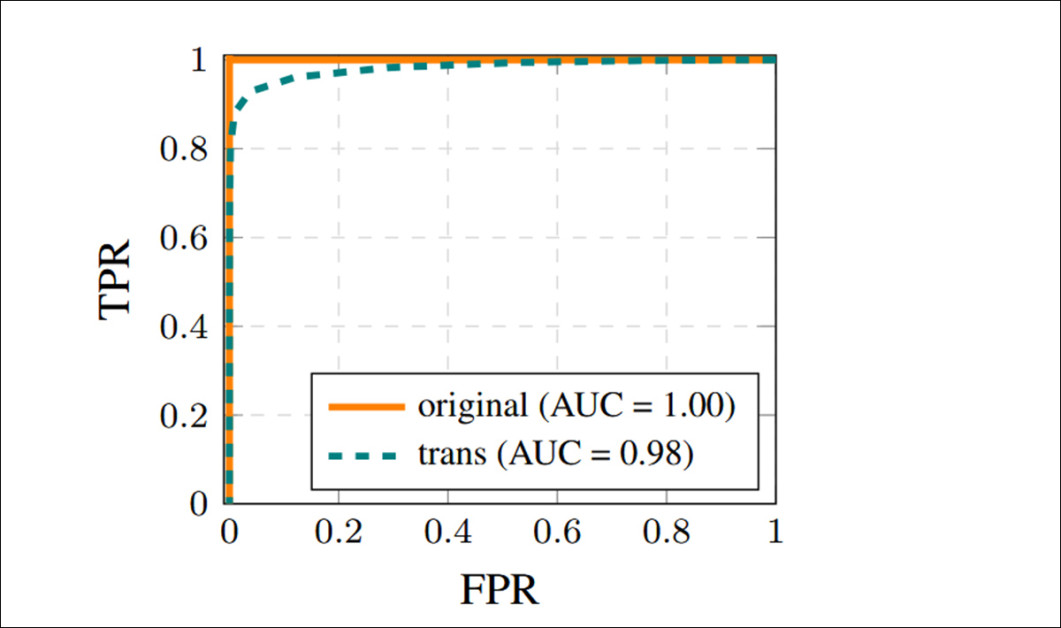

Wydajność została oceniona w różnych progach podobieństwa cosinusoidalnego, aby rozróżnić między identycznymi a near-duplikatami obrazów (twarde i miękkie przecieki).

Próg 0,98 został wybrany do definicji twardych przecieków, w wyniku czego nie wystąpiły fałszywe pozytywy i idealne wykrywanie identycznych obrazów.

Dla miękkich przecieków próg 0,95 został wybrany, umożliwiając wykrywanie większej liczby near-duplikatów, przy zachowaniu prawie zerowego poziomu fałszywych pozytywów. Priorytet został nadany precyzji nad recall, a wyniki zostały zatem konserwatywnie oszacowane:

Krzywe charakterystyki odbioru były używane do przewodzenia wyboru progów twardych i miękkich przecieków. Wysokie wyniki AUC w warunkach przekształconych i nieprzekształconych dowodzą, że near-duplikaty mogą być niezawodnie rozróżnione od niezwiązanych obrazów, nawet gdy minimalne zmiany są obecne.

Wewnątrz-zestawowe przecieki

Wewnątrz-zestawowe przecieki zostały obliczone przez identyfikację nakładania się obrazów między podziałami szkoleniowymi i oceny w tym samym zestawie danych. Tylko zestawy danych z podziałami benchmarkowymi i szkoleniowymi lub pre-szkoleniowymi były dopuszczone, ograniczając analizę do COCO, GCC, ImageNet, OpenImages i TextCaps.

Dla COCO, zestaw testowy został porównany z zestawem szkoleniowym, zestawem oceny i nieoznaczonymi podziałami, a zestaw walidacyjny został porównany z zestawem szkoleniowym i nieoznaczonymi podziałami.

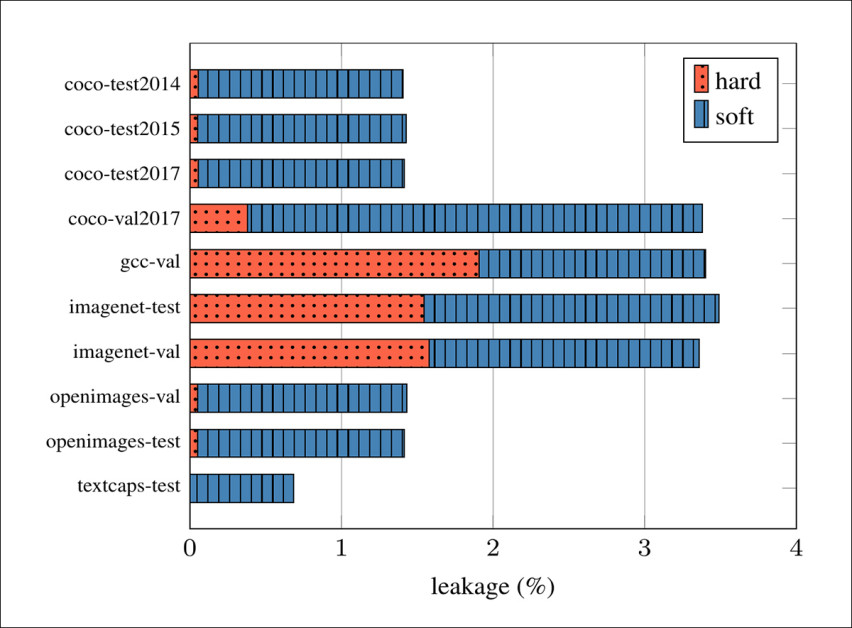

Najwyższe stawki wewnątrz-zestawowych przecieków zostały zaobserwowane w zestawie testowym i walidacyjnym ImageNet, z twardymi przeciekami sięgającymi do 1,58% i miękkimi przeciekami nieco poniżej 2%. GCC i COCO następowały, z COCO val2017 wykazującym miękkie przecieki na poziomie 3% i jego zestawami testowymi wahaającymi się między 1,35% a 1,38%. OpenImages wykazał niskie twarde przecieki na poziomie 0,05%, ale miękkie przecieki przekroczyły 1,3% w zestawach testowych i walidacyjnych. TextCaps wykazał najniższe ogólne przecieki, na poziomie 0,69%, bez wykrycia twardych przecieków:

Stawki wewnątrz-zestawowych przecieków, pokazujące udział każdego podziału oceny, który nakłada się na powiązane dane szkoleniowe.

W odniesieniu do tych wyników, autorzy stwierdzają†:

‘Te wyniki pokazują, że wewnątrz-zestawowe przecieki występują we wszystkich analizowanych zestawach danych, albo w stopniu twardym, albo miękkim.

‘Ponieważ przecieki danych mogą naruszyć ocenę modelu i że zestawy danych są specjalnie zaprojektowane do tego celu, wewnątrz-zestawowe przecieki są ryzykiem, które z założenia nie powinno istnieć.

‘Jednakże, zidentyfikowaliśmy wiele przypadków we wszystkich zestawach danych.’

Między-zestawowe przecieki

Aby zmierzyć między-zestawowe przecieki (gdzie model jest szkolony na jednym zestawie danych i oceniany na innym), cztery zestawy danych zostały użyte jako źródła danych szkoleniowych: GCC trening, ImageNet trening, OpenImages trening, i LAION.

Te zostały dopasowane do danych oceny pobranych z zestawu testowego COCO 2014, Flickr30K, TextCaps test, zestawu testowego OpenImages i zestawu testowego ImageNet.

Cechy CLIP ViT-B/32 zostały wyodrębnione dla wszystkich zestawów danych z wyjątkiem LAION, który zapewnia własne pre-komputowane cechy. Jednakże, ponieważ te cechy różnią się nieco od tych wygenerowanych przy użyciu oficjalnej implementacji CLIP, obrazy zapytań zostały przeskalowane zgodnie z metodą używaną w repozytorium clip-retrieval, aby zapewnić kompatybilność.

Wyszukiwanie zostało przeprowadzone przy użyciu wyszukiwania KNN, chociaż skala LAION wymagała podziału na bloki po milionie obrazów, z każdym zaindeksowanym oddzielnie:

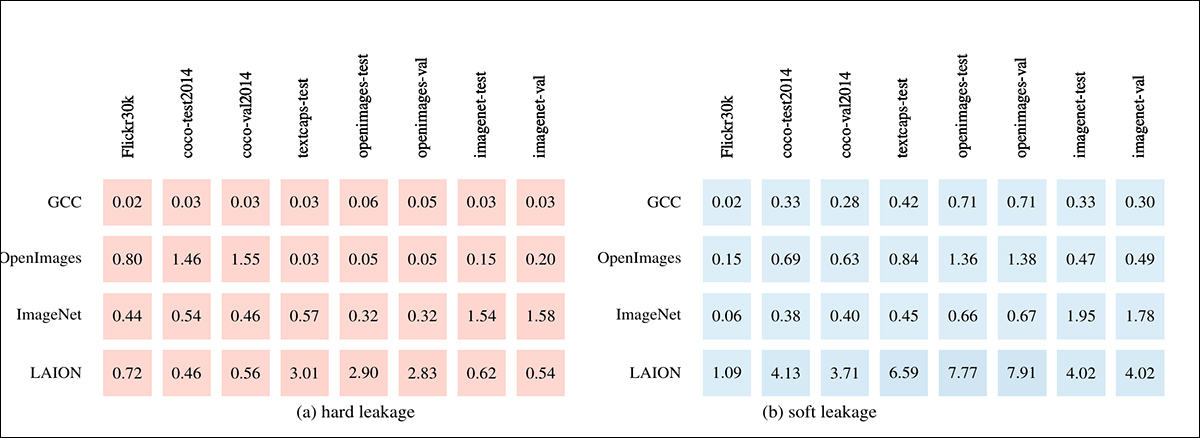

Między-zestawowe przecieki między zestawami benchmarkowymi (kolumny) a zestawami pre-szkoleniowymi (wiersze). Po lewej stronie widzimy ‘twarde’ przecieki (identyczne obrazy), a po prawej stronie ‘miękkie’ przecieki (near-duplikaty).

Przecieki między zestawami danych zostały zaobserwowane we wszystkich zestawach benchmarkowych, z różnymi stopniami nasilenia. LAION wykazał najwyższe stawki twardych przecieków (identyczne obrazy), szczególnie dla OpenImages i TextCaps testowych danych, każdy przekraczający 3%. OpenImages również przyczynił się do mniejszej ilości twardych przecieków do COCO.

Chociaż mniej dotkliwe, ImageNet nadal zawierał twarde duplikaty z każdego zestawu benchmarkowego; i GCC wykazał najniższe ogólne twarde przecieki, poniżej 1%.

Miękkie przecieki (near-duplikaty) były bardziej rozpowszechnione: LAION ponownie wyprodukował najwyższe stawki, z maksymalnym nakładem się 7,9% dla pewnych benchmarków; OpenImages i TextCaps były najbardziej dotkniętymi benchmarkami ogółem; i Flickr30k wykazał najmniejsze przecieki.

Chociaż takie nakładania się mogą stanowić tylko niewielką część zestawów oceny, autorzy zauważają, że ich obecność może pozwolić na pamiętanie i skompromitować ważność testu:

Przykłady przeciekłych obrazów. Po lewej stronie są przypadki ‘twardych’ przecieków, gdzie obrazy są identyczne w zestawie (góra) lub między zestawami (dół); po prawej stronie, przypadki ‘miękkich’ przecieków, gdzie obrazy są wizualnie bardzo podobne.

Wpływ na późniejszą ocenę

Artykuł następnie rozważa, w jaki sposób przecieki danych wpływają na późniejsze oceny (tj. wydajność w standardowych zadaniach, gdy modele pre-szkolone są testowane na benchmarkach, które zawierają zduplikowane dane szkoleniowe).

Trzy zadania zostały rozważone: klasyfikacja zero-shot; klasyfikacja nadzorowana; i wyszukiwanie obrazu-tekstu.

Dla każdego zadania, wydajność modelu została oceniona na zestawie benchmarkowym, dla którego już zidentyfikowano przeciekłe próbki w danych pre-szkoleniowych. Wyniki zostały porównane w czterech podzbiórach: pełnym benchmarku; podzbiór przeciekłych próbek; podzbiór nieprzeciekłych próbek; i losowo wybrany podzbiór o tym samym rozmiarze, co zbiór przeciekłych (użyty jako kontrola).

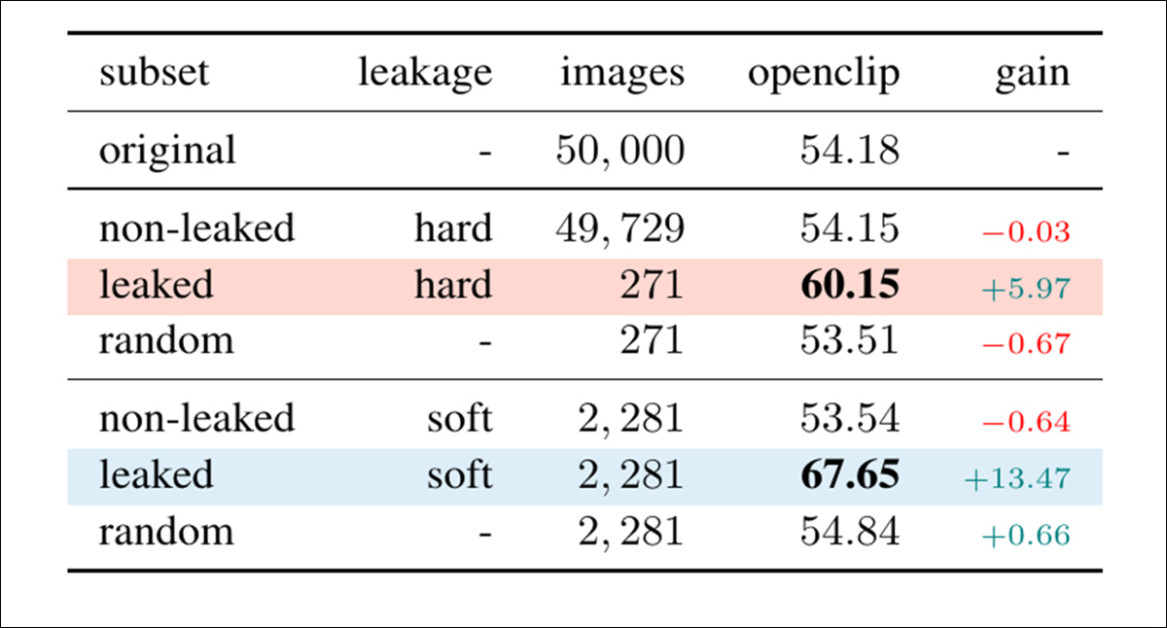

Wpływ przecieków danych na trzy późniejsze zadania został zmierzony przy użyciu podzbiorów benchmarkowych, znanych z zawierania przeciekłych próbek. W klasyfikacji zero-shot, model pre-szkolony na LAION osiągnął znacznie wyższą dokładność na przeciekłych obrazach z zestawu oceny ImageNet, potwierdzając, że narażenie nawet na near-duplikaty podczas szkolenia zapewnia wymierną przewagę:

Dokładność klasyfikacji zero-shot na zestawie walidacyjnym ImageNet w podzbiorach z i bez przecieków. Ostatnia kolumna raportuje zysk względem pełnego zestawu, a wyróżnione wiersze odpowiadają podzbiorom przeciekłym.

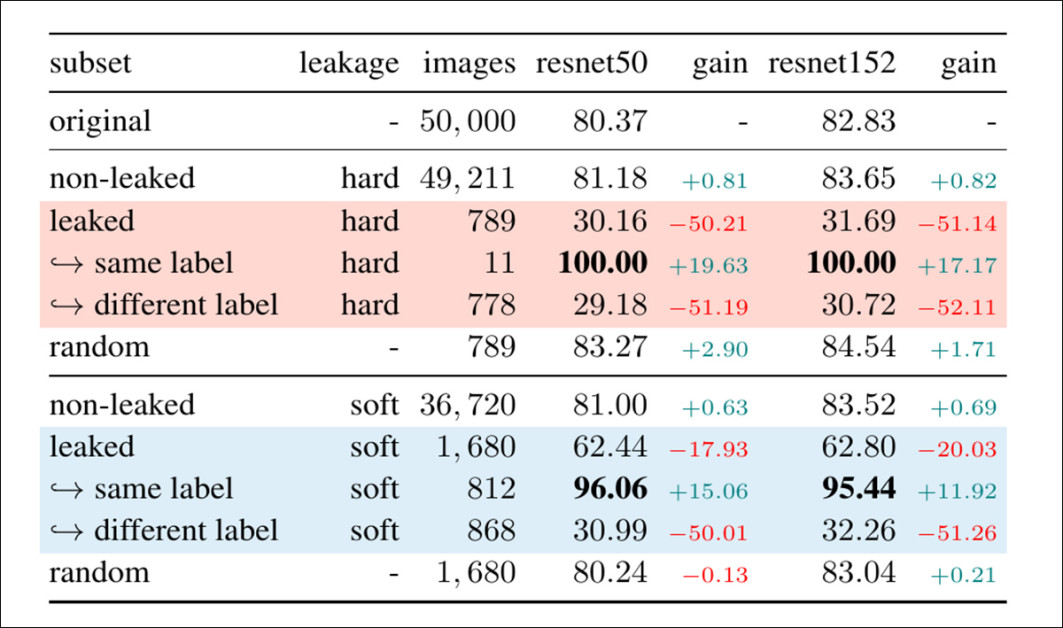

Dla klasyfikacji nadzorowanej, przecieki w ImageNet spowodowały dramatyczny spadek wydajności – chyba że przeciekły obraz miał ten sam etykietę w obu podziałach, w którym to przypadku model osiągnął niemal idealną dokładność, ujawniając silny efekt pamiętania:

Dokładność klasyfikacji nadzorowanej na zestawie walidacyjnym ImageNet dla podzbiorów z i bez przecieków. Kolumny zysku pokazują zmianę względem pełnego zestawu. Podzbiorom przeciekłym są wyróżnione.

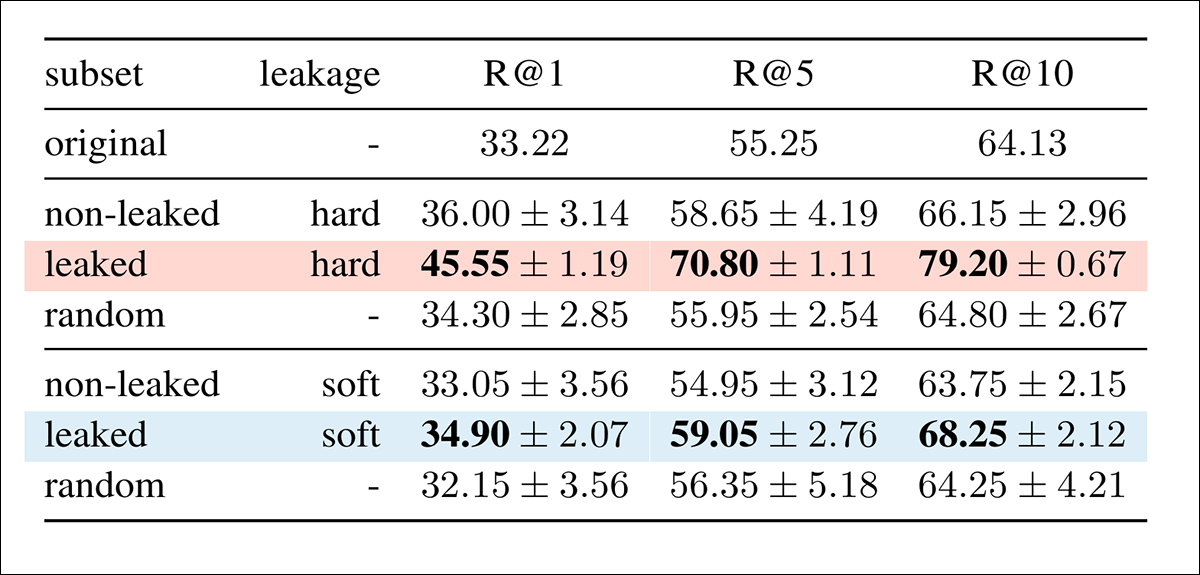

W wyszukiwaniu obrazu-tekstu, wydajność ponownie poprawiła się dla przeciekłych próbek, z zarówno twardymi, jak i miękkimi przeciekami prowadzącymi do wyższego odzyskania, a także przeciekłym podzbiorom dając większą spójność wyników w różnych przebiegach:

Wydajność wyszukiwania obrazu-tekstu na Flickr30k w podzbiorach z i bez przecieków, z przeciekłymi podzbiorami wyróżnionymi.

Autorzy kończą:

‘Ogólnie, pokazujemy spójne dowody, że przecieki stanowią poważne zagrożenie dla uczciwej oceny modeli w zestawach wizji, kompromitując jeden z najbardziej fundamentalnych zasad machine learning: nie oceniaj modeli na ich danych szkoleniowych.’

Podsumowanie

Jednym szokującym aspektem artykułu, choć nie jest to nowość, jest opis potrzeby użycia CLIP do uzyskania cech dla ogromnej góry danych obrazowych w LAION, reprezentującej skalę, która już nie może być adresowana w żaden inny sposób niż agregatowy, zajmując się metadanymi zamiast bardziej szczegółowych cech, które mogą być zbadane, gdy zestaw danych jest bardziej zarządzalny.

Jest to wyraziste ilustracja stopnia, w jakim szkolenie modeli wizji-języka definitywnie przekroczyło granice i możliwości nadzoru ludzkiego, lub jakiegokolwiek rodzaju ręcznej kuracji poza reprezentatywnymi podzbiorami.

* Być może nieco myląco, problem duplikacji jest zdefiniowany w artykule jako ‘przecieki’.

† Autorzy kładą nacisk.

Pierwotnie opublikowane we wtorek, 26 sierpnia 2025