Sztuczna inteligencja

Osobista analiza trendów w literaturze z zakresu komputerowego widzenia w 2024 roku

Od około pięciu lat nieprzerwanie śledzę scenę badań nad komputerowym widzeniem (CV) i syntezą obrazu na Arxiv i gdzie indziej, więc trendy stają się widoczne w czasie, a zmieniają się w nowe kierunki co roku.

Dlatego też, gdy 2024 rok dobiega końca, uznałem, że warto przyjrzeć się nowym lub ewoluującym cechom w zgłoszeniach do sekcji Computer Vision and Pattern Recognition section. Te obserwacje, choć poinformowane przez setki godzin spędzonych na studiowaniu tej dziedziny, są ściśle anegdotyczne.

Nadal rosnąca popularność Azji Wschodniej

Do końca 2023 roku zauważyłem, że większość literatury w kategorii “synteza głosu” pochodziła z Chin i innych regionów Azji Wschodniej. Na koniec 2024 roku muszę stwierdzić (anegdotycznie), że to samo dotyczy również sceny badań nad syntezą obrazu i wideo.

Nie oznacza to, że Chiny i sąsiednie kraje zawsze produkują najlepsze prace (w rzeczywistości istnieją dowody przeciwne); ani nie bierze pod uwagę wysokiej prawdopodobieństwa, że w Chinach (podobnie jak na Zachodzie) niektóre z najbardziej interesujących i potężnych nowych systemów są własnościowe i wykluczone z literatury badawczej.

Jednakże sugeruje to, że Azja Wschodnia bije Zachód pod względem ilości, w tym zakresie. To, co to znaczy, zależy od stopnia, w jakim wierzysz w skuteczność Edisonowskiej wytrwałości, która zwykle okazuje się nieskuteczna w obliczu niepokonalnych przeszkód.

Istnieją wiele takich przeszkód w generatywnym AI, i nie jest łatwo powiedzieć, które z nich można rozwiązać, adresując istniejące architektury, a które będą wymagać ponownego rozważenia od zera.

Chociaż badacze z Azji Wschodniej wydają się produkować większą liczbę prac z dziedziny komputerowego widzenia, zauważyłem wzrost częstotliwości projektów w stylu “Frankensteina” – inicjatyw, które stanowią połączenie wcześniejszych prac, przy czym dodają ograniczoną nowość architektoniczną (lub może tylko inny rodzaj danych).

W tym roku znacznie większa liczba prac azjatyckich (głównie chińskich lub współpracy z Chinami) wydawała się być napędzana przez ilość, a nie jakość, znacznie zwiększając stosunek sygnału do szumu w już przeludnionej dziedzinie.

Jednocześnie większa liczba prac azjatyckich również zwróciła moją uwagę i uznanie w 2024 roku. Więc jeśli to wszystko jest grą liczb, to nie zawodzi – ale nie jest tanie.

Rozwój liczby zgłoszeń

Liczba prac, we wszystkich krajach pochodzenia, wyraźnie wzrosła w 2024 roku.

Najpopularniejszy dzień publikacji zmienia się w ciągu roku; obecnie jest to wtorek, kiedy liczba zgłoszeń do sekcji Computer Vision and Pattern Recognition często wynosi około 300-350 w ciągu jednego dnia, w “szczycie” okresach (maj-sierpień i październik-grudzień, czyli sezon konferencji i “sezon limitu rocznego”, odpowiednio).

Poza moim własnym doświadczeniem, Arxiv sam raportuje rekordową liczbę zgłoszeń w październiku 2024 roku, z 6000 nowymi zgłoszeniami, a sekcja Computer Vision była drugą najczęściej zgłaszana sekcją po Machine Learning.

Jednakże, ponieważ sekcja Machine Learning na Arxiv jest często używana jako “dodatkowa” lub agregowana super-kategoria, to sugeruje, że Computer Vision i Pattern Recognition są w rzeczywistości najczęściej zgłaszanej kategorią Arxiv.

Własne statystyki Arxiv pokazują wyraźnie, że informatyka jest liderem w zgłoszeniach:

Informatyka (CS) dominuje statystyki zgłoszeń na Arxiv w ciągu ostatnich pięciu lat. Źródło: https://info.arxiv.org/about/reports/submission_category_by_year.html

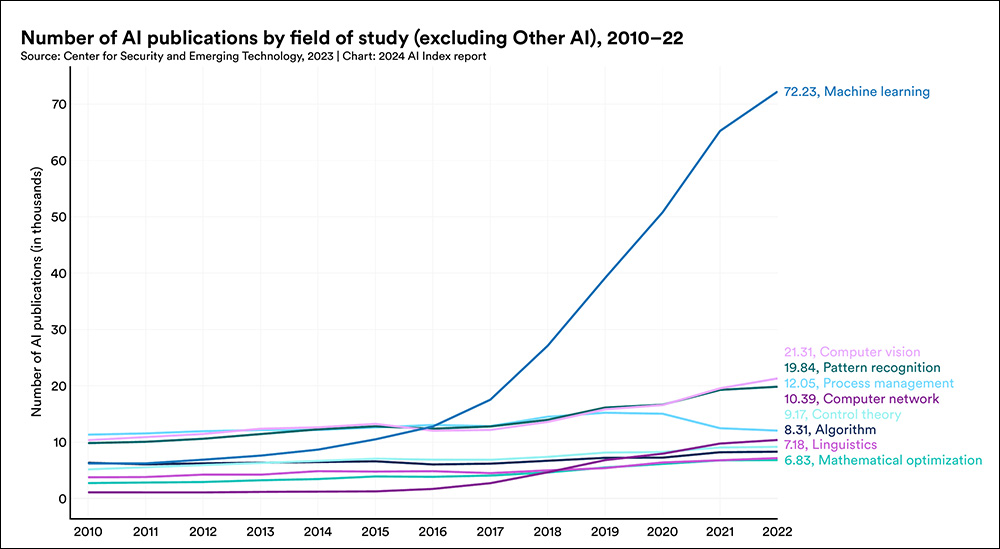

Raport 2024 AI Index Uniwersytetu Stanforda, choć nie jest w stanie raportować o najnowszych statystykach, również podkreśla znaczny wzrost liczby zgłoszeń prac akademickich związanych z uczeniem maszynowym w ostatnich latach:

Pomimo braku danych za 2024 rok, raport Stanforda pokazuje wyraźnie wzrost liczby zgłoszeń prac związanych z uczeniem maszynowym. Źródło: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Rozwój ram Diffusion>Mesh

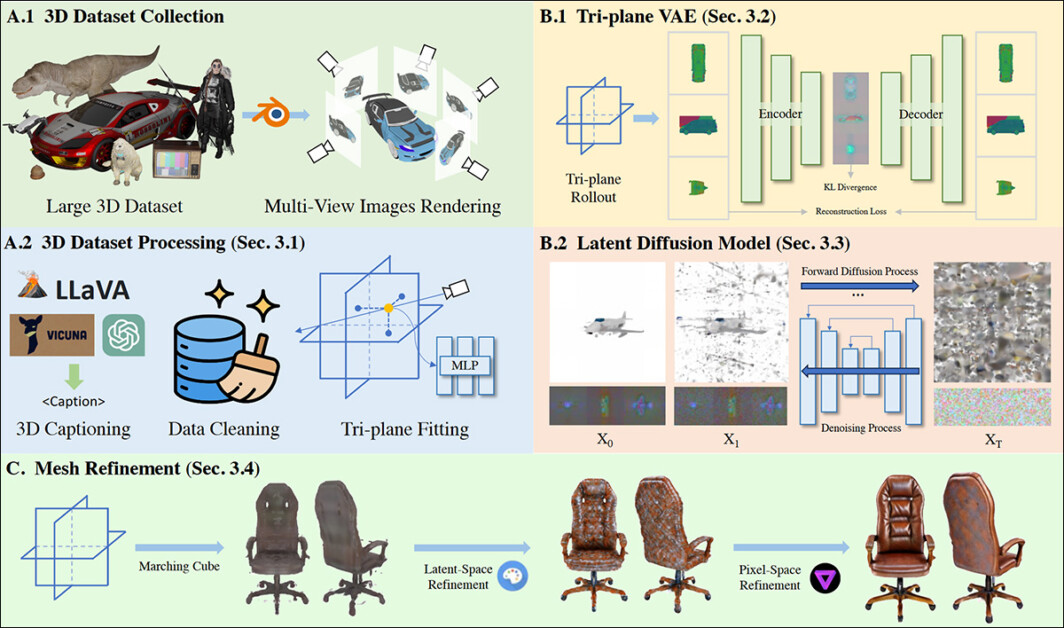

Inną wyraźną tendencją, która pojawiła się dla mnie, był duży wzrost liczby prac, które zajmują się wykorzystaniem Modeli Latentnej Dyfuzji (LDM) jako generatorów modeli CGI opartych na siatce.

Przykłady takich projektów obejmują InstantMesh3D, 3Dtopia, Diffusion2, V3D, MVEdit i GIMDiffusion, wśród wielu innych.

Generowanie i ulepszanie siatki za pomocą procesu opartego na dyfuzji w 3Dtopia. Źródło: https://arxiv.org/pdf/2403.02234

Ta nowa gałąź badań może być postrzegana jako niejawne przyznanie się do ciągłej niepokonalności systemów generatywnych, takich jak modele dyfuzji, które zaledwie dwa lata temu były uważane za potencjalny zamiennik dla wszystkich systemów, które teraz są uzupełniane przez modele dyfuzji>siatki.

Stability.ai, twórcy otwartego modelu Stable Diffusion, właśnie wydali Stable Zero123, który może, między innymi, wykorzystywać Neural Radiance Fields (NeRF) jako mostek do tworzenia wyraźnego, opartego na siatce modelu CGI, który może być użyty w środowiskach CGI, takich jak Unity, w grach wideo, rzeczywistości rozszerzonej i innych platformach, które wymagają wyraźnych współrzędnych 3D, w przeciwieństwie do ukrytych współrzędnych funkcji ciągłych.

Kliknij, aby odtworzyć. Obrazy wygenerowane w Stable Diffusion mogą być przekonwertowane na racjonalne siatki CGI. Tutaj widzimy wynik przepływu obrazu>CGI przy użyciu Stable Zero 123. Źródło: https://www.youtube.com/watch?v=RxsssDD48Xc

Semantyka 3D

Przestrzeń generatywnego AI rozróżnia pomiędzy systemami 2D i 3D wdrażanymi wizji i systemów generatywnych. Na przykład, ramy twarzowe, chociaż reprezentują obiekty 3D (twarze) we wszystkich przypadkach, nie wszystkie koniecznie obliczają adresowalne współrzędne 3D.

Popularny system FANAlign, powszechnie używany w architekturach deepfake z 2017 roku (i innych), może obsługiwać oba te podejścia:

Powyżej, punkty orientacyjne 2D są generowane na podstawie rozpoznanych linii i cech twarzy. Poniżej, są one uzasadnione w przestrzeni 3D X/Y/Z. Źródło: https://github.com/1adrianb/face-alignment

Więc, tak jak “deepfake” stało się niejednoznacznym i przejętym terminem, “3D” również stało się mylącym terminem w badaniach nad komputerowym widzeniem.

Dla konsumentów oznaczało to zwykle medio z włączoną stereoskopią (takie jak filmy, do których widzowie muszą nosić specjalne okulary); dla specjalistów od efektów wizualnych i modelowania oznacza to różnicę pomiędzy dziełem 2D (takim jak szkice koncepcyjne) a modelami opartymi na siatce, które mogą być manipulowane w “programie 3D” takim jak Maya lub Cinema4D.

Jednak w komputerowym widzeniu oznacza to po prostu, że układ współrzędnych kartezjańskich istnieje gdzieś w przestrzeni latentnej modelu – nie oznacza to, że może być adresowany lub bezpośrednio manipulowany przez użytkownika; przynajmniej nie bez systemów interpretacyjnych CGI opartych na trzecich stronach, takich jak 3DMM lub FLAME.

Dlatego pojęcie dyfuzja>3D jest nieprecyzyjne; nie tylko każdy rodzaj obrazu (w tym zdjęcie) może być użyty jako dane wejściowe do wygenerowania modelu CGI, ale mniej dwuznaczny termin “siatka” jest bardziej odpowiedni.

Jednakże, aby spotęgować niejasność, dyfuzja jest potrzebna do interpretacji zdjęcia źródłowego w siatkę, w większości projektów. Więc lepszym opisem mogłoby być obraz>siatka, podczas gdy obraz>dyfuzja>siatka jest jeszcze bardziej precyzyjnym opisem.

Ale to trudna sprzedaż na spotkaniu zarządu lub w komunikacie prasowym zaprojektowanym w celu zaangażowania inwestorów.

Dowody martwych punktów architektonicznych

Even w porównaniu z 2023 rokiem, tegoroczna seria prac wykazuje rosnącą desperację wokół usuwania twardych praktycznych ograniczeń generatywnych systemów opartych na dyfuzji.

Kluczowym kamieniem milowym pozostaje generowanie narracyjnie i czasowo spójnych filmów wideo, oraz utrzymanie spójnego wyglądu postaci i obiektów – nie tylko w różnych klipach wideo, ale nawet w krótkim czasie trwania jednego wygenerowanego klipu wideo.

Ostatnia epokowa innowacja w syntezie opartej na dyfuzji była pojawieniem się LoRA w 2022 roku. Chociaż nowsze systemy, takie jak Flux, poprawiły niektóre problemy, takie jak wcześniejsza niezdolność Stable Diffusion do odtworzenia treści tekstowych w wygenerowanym obrazie, oraz ogólna jakość obrazu uległa poprawie, większość prac, które studiowałem w 2024 roku, była po prostu przestawianiem jedzenia na talerzu.

Te martwe punkty wystąpiły wcześniej, z Sieciami Generatywnymi Przeciwstawianymi (GAN) i Polami Promieniowania Neuronalnego (NeRF), które obie nie spełniły swojego początkowego potencjału – i obie są coraz częściej wykorzystywane w bardziej konwencjonalnych systemach (takich jak użycie NeRF w Stable Zero 123, patrz powyżej). Wydaje się, że to samo dzieje się z modelami dyfuzji.

Badania nad Gaussian Splatting

Wydawało się, że na koniec 2023 roku metoda rastrowania 3D Gaussian Splatting (3DGS), która zadebiutowała jako technika obrazowania medycznego na początku lat 90., miała zaskoczyć systemy oparte na autoencoderach w wyzwaniach związanych z syntezą obrazu ludzi (takich jak symulacja i odtworzenie twarzy, a także transfer tożsamości).

Praca z 2023 roku ASH obiecywała pełne ciało 3DGS ludzi, podczas gdy Gaussian Avatars oferowały znacznie lepsze szczegóły (w porównaniu z autoencoderami i innymi metodami konkurencyjnymi), wraz z imponującym ponownym użyciem.

Jednak w tym roku było relatywnie niewiele przełomowych momentów dla syntezowania ludzi 3DGS; większość prac, które zajmowały się tym problemem, były pochodnymi powyższych prac lub nie przewyższały ich możliwości.

Zamiast tego, nacisk na 3DGS został położony na poprawę jego podstawowej wykonalności architektonicznej, co doprowadziło do lawiny prac, które oferują lepsze środowiska zewnętrzne 3DGS. Szczególną uwagę zwrócono na podejścia SLAM (Localizacja i Mapowanie) 3DGS, w projektach takich jak Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, wśród wielu innych.

Te projekty, które próbowały kontynuować lub rozszerzyć syntezę ludzi opartą na 3DGS, obejmowały MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM i Topo4D. Chociaż jest ich więcej, żadne z tych wystąpień nie dorównały początkowemu wpływowi prac, które pojawiły się pod koniec 2023 roku.

Epoka Weinstein jest w powolnym odwrocie

Badania z Azji Południowo-Wschodniej, a w szczególności z Chin, często zawierają przykłady testowe, które są problematyczne do ponownego opublikowania w artykule przeglądowym, ponieważ zawierają materiał, który jest nieco “pikantny”.

Czy jest to dlatego, że naukowcy w tej części świata szukają zwrócenia uwagi na swoje wyniki, jest kwestią dyskusyjną; jednak w ciągu ostatnich 18 miesięcy coraz więcej prac związanych z generatywnym AI (syntezą obrazu i/lub wideo) używa młodych i skąpo ubranych kobiet i dziewcząt w przykładach projektowych. Przykłady te obejmują UniAnimate, ControlNext i nawet bardzo “suche” prace, takie jak Evaluating Motion Consistency by Fréchet Video Motion Distance (FVMD).

To następuje w ogólnym trendzie subredditorów i innych społeczności, które gromadzą się wokół Modeli Latentnej Dyfuzji (LDM), gdzie reguła 34 nadal obowiązuje.

Bitwa o twarz

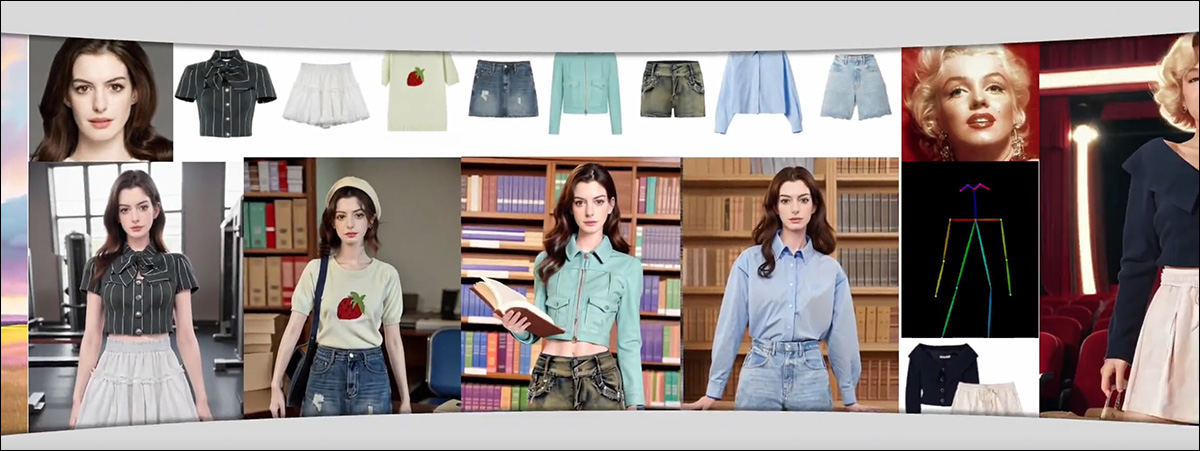

Ten rodzaj nieodpowiednich przykładów pokrywa się z rosnącym uznaniem, że procesy AI nie powinny arbitralnie wykorzystywać podobieństw celebrytów – szczególnie w badaniach, które niekrytycznie wykorzystują przykłady z udziałem atrakcyjnych celebrytów, często kobiet, i umieszczają je w wątpliwych kontekstach.

Jednym z przykładów jest AnyDressing, który, poza tym, że zawiera bardzo młode postacie w stylu anime, również swobodnie wykorzystuje tożsamości klasycznych celebrytów, takich jak Marilyn Monroe, oraz obecnych, takich jak Anne Hathaway (która głośno potępiła tego rodzaju użycie).

Arbitralne użycie bieżących i “klasycznych” celebrytów jest nadal dość powszechne w pracach z Azji Południowo-Wschodniej, chociaż ta praktyka jest nieco w odwrocie. Źródło: https://crayon-shinchan.github.io/AnyDressing/

W zachodnich pracach ta konkretna praktyka jest zauważalnie w odwrocie w ciągu 2024 roku, pod przewodnictwem większych wydawnictw z FAANG i innych wysokopoziomowych jednostek badawczych, takich jak OpenAI. Świadome potencjalnego ryzyka przyszłych pozwów, te wielkie korporacyjne podmioty wydają się coraz mniej skłonne do reprezentowania nawet fikcyjnych fotorealistycznych ludzi.

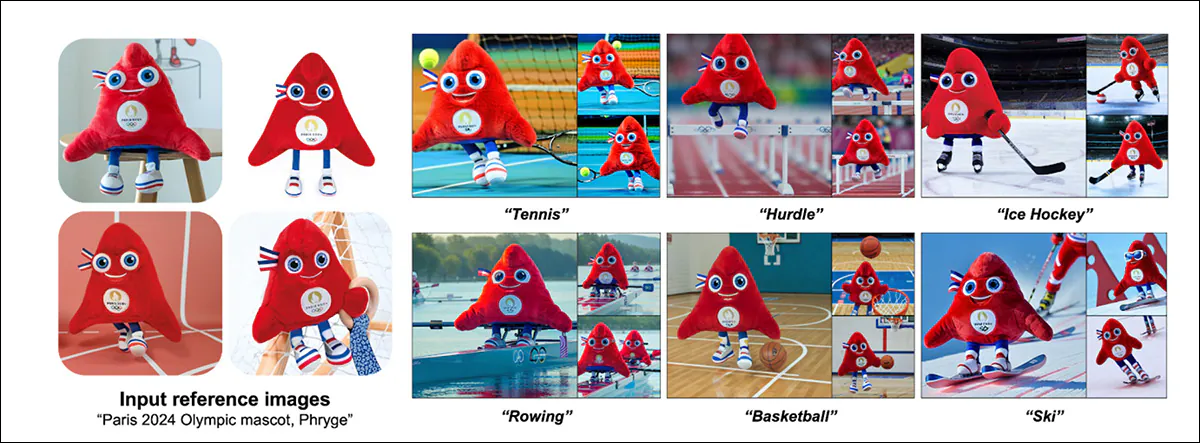

Chociaż systemy, które tworzą (takie jak Imagen i Veo2), są wyraźnie w stanie wyprodukować tego rodzaju dane wyjściowe, przykłady z zachodnich projektów AI generatywnych teraz skłaniają się ku “słodkim”, disneyowskim i ekstremalnie “bezpiecznym” obrazom i filmom wideo.

Pomimo chwalenia możliwości Imagen do tworzenia “fotorealistycznych” danych wyjściowych, przykłady promowane przez Google Research są zwykle fantastyczne, “rodzinne” – fotorealistyczne ludzie są starannie unikani lub minimalne przykłady są dostarczane. Źródło: https://imagen.research.google/

Mycie twarzy

W literaturze zachodniej CV, ten nieuczciwy podejście jest szczególnie widoczny w systemach personalizacji – metodach, które są w stanie tworzyć spójne podobieństwa określonej osoby w wielu przykładach (tj. takich jak LoRA i starszy DreamBooth).

Przykłady obejmują ortogonalne wstawienie wizualne, LoRA-Composer, InstructBooth Google, i wiele innych.

InstructBooth Google podnosi wskaźnik słodyczy do 11, chociaż historia sugeruje, że użytkownicy są bardziej zainteresowani tworzeniem fotorealistycznych ludzi niż puszystych lub pluszowych postaci. Źródło: https://sites.google.com/view/instructbooth

Jednakże wzrost “przykładów słodyczy” jest widoczny w innych obszarach badań CV i syntetyzowania, w projektach takich jak Comp4D, V3D, DesignEdit, UniEdit, FaceChain (która uznaje bardziej realistyczne oczekiwania użytkowników na swojej stronie GitHub), i DPG-T2I, wśród wielu innych.

Łatwość, z jaką takie systemy (takie jak LoRAs) mogą być tworzone przez użytkowników domowych z względnie skromnym sprzętem, doprowadziła do eksplozji swobodnie pobieralnych modeli celebrytów w domenie civit.ai i społeczności. Takie nielegalne użycie pozostaje możliwe dzięki otwartemu źródłu architektur, takich jak Stable Diffusion i Flux.

Chociaż często jest możliwe przełamanie zabezpieczeń systemów generatywnych obrazu i wideo, aby wyprodukować materiał zabroniony przez warunki użytkowania platformy, przepaść pomiędzy ograniczonymi możliwościami najlepszych systemów (takich jak RunwayML i Sora), a nieograniczoną zdolnością systemów wydajnych (takich jak Stable Video Diffusion, CogVideo i lokalne wdrożenia Hunyuan), nie jest tak naprawdę zamykana, jak wielu uważa.

Zamiast tego, te systemy własnościowe i otwarte, odpowiednio, zagrażają staniem się równie bezużytecznymi: drogie i hiperskalične systemy T2V mogą stać się nadmiernie ograniczone z powodu obaw o pozwania, podczas gdy brak infrastruktury licencyjnej i nadzoru nad zbiorami danych w systemach otwartych może całkowicie wykluczyć je z rynku, gdy będą wprowadzane surowsze regulacje.

Pierwotnie opublikowane we wtorek, 24 grudnia 2024