Kąt Andersona

Wirtualna próba nowych ubrań za pomocą sztucznej inteligencji

Model sztucznej inteligencji może teraz przekształcić pojedyncze zdjęcie i obrazy ubrań w poruszony film osoby noszącej nowe stroje, unikając błędów charakterystycznych dla starszych, dwuetapowych systemów.

Kategoria ‘wirtualnej próby’ (VTON) w badaniach nad widzeniem komputerowym jest jedną z najlepiej finansowanych i najbardziej owocnych dziedzin w literaturze – głównie dlatego, że, jak można się dowiedzieć z częstych współprac pomiędzy przemysłem i akademickimi publikacjami każdego roku, ten cel otrzymuje znaczne finansowanie od zamożnego przemysłu modowego:

Z pracy ‘Image-Based Virtual Try-On: A Survey’, przykłady typów reprezentacji osób i niektóre z etapów filtrowania i doskonalenia, których nawet podstawowe obrazy muszą przejść w celu wirtualnej próby (VTON). Źródło

Istnieje wiele wariacji tego celu, takich jak wyodrębnianie ubrań z obrazów ludzi oraz dostosowanie do pełnej sylwetki, gdy jest to konieczne. Niektóre systemy oparte na obrazach zostały już wdrożone komercyjnie na platformach takich jak veesual.ai, wanna.fashion i fashn.ai.

Dla filmów eksperymentalna aplikacja Doppl od Google Labs eksperymentowała z tą funkcjonalnością, uruchamiając zeszłego lata:

Proszę kliknąć, aby odtworzyć, jeśli film nie jest automatycznie odtwarzany. Fragmenty porzuconego projektu wirtualnej próby Google Doppl. Źródło

Jednak Doppl został wyłączony w kwietniu 2026 r. po przeciętnej reakcji, a teraz widzowie są kierowani do usługi try-on firmy, obsługującej tylko obrazy†:

Program try-on firmy Google, do którego użytkownicy są kierowani z porzuconej platformy Doppl. Źródło

Chociaż istnieje niewielka liczba platform oferujących wirtualną próbę z filmem, żadna z nich nie wydaje się być związana z konkretnym sklepem; wszystkie są one “na granicy” i często “wątpliwe” produkty oparte na tokenach.

Podczas gdy istnieje wiele interesujących prób z sektora badawczego, są to tradycyjnie złożone architektury, które są trudne do wdrożenia z niską latencją i wysoką jakością:

Proszę kliknąć, aby odtworzyć, jeśli film nie jest automatycznie odtwarzany. Z projektu Fashion-VDM z 2024 r., przykład ‘bezgłowego’ przenoszenia ubrań. Źródło

Prawdą jest, że zadanie dostosowania ubrań do prawdziwej osoby, bez zniekształcania ani ubrań, ani osoby, przy jednoczesnym utrzymaniu jakiegoś rodzaju użytecznego demonstracyjnego ruchu (który dokładnie pokazuje tył produktu, gdy osoba odwraca się tyłem), jest ogromnym wyzwaniem dla obecnego stanu techniki.

Vanast

To wyzwanie, które nowy artykuł z Korei próbuje pokonać, stosując nowe i całkowicie zintegrowane rozwiązanie do analizy ubrań + osoby + ruchu:

Proszę kliknąć, aby odtworzyć, jeśli film nie jest automatycznie odtwarzany. Przykłady ze strony uzupełnień projektu Vanast. Źródło

Nowy system, zatytułowany Vanast, wykorzystuje specjalnie przygotowany zestaw danych, zawierający połączenie i orchestrację wszystkich trzech czynników niezbędnych do wykonania zadania: ubrań; osoby; i ruchu:

Kliknij, aby odtworzyć. Więcej przykładów ze strony projektu Vanast.

System wykorzystuje ramy tak różnorodne jak Flux, Qwen i ChatGPT, aby wygenerować zestaw danych “potrójny”, który może poinformować architekturę końcową:

Z nowego artykułu, przykłady punktów danych zestawu użytych do generacji i szkolenia. Źródło –

Nowy artykuł zatytułowany Vanast: Wirtualna próba z animacją obrazu ludzkiego za pomocą syntetycznej nadzoru potrójnego, pochodzi od czterech badaczy z Uniwersytetu Narodowego w Seulu. Istnieje również strona projektu wideo.

Metoda

Stwierdzone cele autorów w pracy polegają na połączeniu trzech wymienionych wyżej aspektów w ramach jednej fazy – nie tylko dlatego, że proces byłby dyskretny, ale także dlatego, że daje różnym aspektom więcej możliwości wzajemnego oddziaływania i interakcji podczas szkolenia, z myślą o bardziej spójnej generacji:

Vanast łączy pojedyncze zdjęcie ludzkie, oddzielne obrazy ubrań i film odniesienia ruchu, aby wygenerować sekwencję filmową, w której ta sama osoba nosi nowy strój, z prowadzeniem pozycji, aby zapewnić spójny ruch, podczas gdy tożsamość i szczegóły ubrań są zachowane na przestrzeni klatek.

Aby to osiągnąć, system pobiera obrazy celowych przedmiotów ubrań; zdjęcie osoby noszącej inne ubrania; film odniesienia ruchu, określający, jak osoba powinna się poruszać; i tekstowy komunikat opisujący działanie i ustawienie; i produkuje pełną sekwencję filmową, w której ta sama osoba wydaje się nosić nowy strój, podczas gdy wykonuje nałożony ruch, z każdą klatką wizualnie spójną w czasie.

Zamiast dzielić ubieranie i animację na różne etapy – co było podejściem w większości podobnych poprzednich prac – Vanast obsługuje ubrania, tożsamość i ruch razem w jednym procesie, pozwalając tym elementom na interakcję podczas generacji i zmniejszając rodzaj niezgodności i niestabilności widocznych w poprzednich metodach.

Zestaw danych

Szkolenie dla projektu opiera się na połączonych przykładach obrazu osoby, odpowiednich przedmiotów ubrań i filmu, na którym osoba porusza się, nosząc te ubrania, z ruchem wyodrębnionym za pomocą poprzedniej architektury, aby zapewnić stabilne prowadzenie pozycji na przestrzeni klatek.

W przypadku braku publicznie dostępnego zestawu danych spełniającego wymagania projektu, dane zostały pobrane z (niesprecyzowanych) platform sklepowych online, zapewniając bufor filmów z różnorodnymi ubraniami. Jednak zadanie wymagało filmów tej samej osoby noszącej wiele strojów, co jest rzadkim znaleziskiem w dzikich danych i wymagało stworzenia syntetycznych danych.

Trzyetapowy proces obejmował wybór odpowiednich kandydujących klatek z pobranych filmów, obsługiwanych za pomocą modelu Qwen2.5-VL, z odpowiednim przycinaniem i oceną przydatności (tj. brak zakryć, temat w prawidłowej pozycji itp.); oraz tworzenie odpowiednich maski wypełniania, aby izolować dotknięte obszary – co (zgodnie z poprzednią pracą PERSE) jest obsługiwane przez model dyfuzji SDXL.

Przegląd potoku Vanast, w którym obraz ludzki, celowe obrazy ubrań i film prowadzenia ruchu są zakodowane i przetwarzane w zjednoczonym modelu dyfuzji wideo. System generuje animację, która zachowuje tożsamość, podąża za sekwencją pozycji i stosuje celowe ubrania, podczas gdy syntetyczna generacja potrójna wspiera szkolenie, a projekt modułu podwójnego oddziela animację od transferu ubrań, aby utrzymać spójność.

W trzecim etapie Qwen ponownie pełni służbę, aby klasyfikować obrazy według płci, a popularna rama dyfuzji obrazu Flux jest następnie używana do tworzenia modyfikacji ubrań na obrazie (ponieważ Flux jest w stanie łączyć wiele elementów wejściowych). Tekstowe komunikaty wypełniania zostały opracowane przez ChatGPT (wersja niespecyfikowana).

Aby dalej zwiększyć różnorodność pozycji i tła, wprowadzono potok do konstruowania zestawów szkoleniowych z filmów z natury, używając zestawu danych HumanVid. Ten sam proces został użyty do wygenerowania zachowującego tożsamość obrazu ludzkiego.

Ponieważ nie istnieje samodzielny obraz ubrania w tych filmach, obrazy ubrań zostały syntetyzowane bezpośrednio z filmu. Klatki zostały pobrane z każdego filmu, a Qwen został użyty do oceny ich pod kątem widoczności frontalnej, zanim wybrano najbardziej odpowiedni kandydata, w oparciu o widoczność całości ciała, klarowność obrazu, minimalne zakrycie, jakość oświetlenia i ogólny układ.

Górna część ubrania została wyodrębniona za pomocą SegFormer, a tło zostało usunięte, aby izolować ubranie.

Aby uniknąć pozycyjnej predyspozycji, obszar ubrania został losowo przesunięty wewnątrz jego pola, a Qwen został ponownie użyty do odfiltrowania niepewnych segmentacji. Ten proces wytworzył syntetyczne obrazy ubrań sparowane z ruchem i tożsamością, umożliwiając konstrukcję potrójną w dużym stopniu z niesklasyfikowanych danych wideo, przy jednoczesnym poprawieniu wytrzymałości w różnych warunkach świata rzeczywistego.

Architektura

Wprowadzono architekturę dwumodułową, aby rozwiązać powolne zbieżność i słabą równowagę kontroli widoczną w tych poprzednich metodach, które próbowały połączyć wszystkie warunki. Podejście to wykorzystywało transformator dyfuzji tekstu-wideo z Wan, i również opierał się na projekcie VACE (patrz poniżej).

Model został podzielony na Moduł animacji ludzkiej (HAM), który obsługiwał ruch i tożsamość z ludzkich i pozycyjnych wejść; oraz Moduł transferu ubrań (GTM), który obsługiwał ubrania z obrazów ubrań. Oba moduły dzieliły dostęp do trzonu, przy jednoczesnym integrowaniu funkcji w sposób rozproszony i kaskadowy, aby poprawić warunki.

Szkolenie zostało przeprowadzone przez zamrożenie trzonu i optymalizację tylko parametrów HAM i GTM, z ich wkładem zrównoważonym podczas integracji funkcji. Wejścia z syntetycznego zestawu danych potrójnych zostały przekonwertowane w przedstawienia latentne za pomocą autoenkodera VAE Wan.

Świadomy ruch kontekstu został wytworzony przez połączenie informacji ludzkiej i pozycyjnej w czasie, podczas gdy funkcje ubrań były przetwarzane oddzielnie i wyrównywane za pomocą projekcji do tokenowych wektorów.

Model został również rozbudowany, aby obsługiwać interpolację ubrań. Tutaj reprezentacje dwóch ubrań zostały połączone, aby wygenerować gładkie przejścia, umożliwiając spójne i spójne mieszanie między przedmiotami ubrań, bez dodatkowej optymalizacji.

Dane i testy

Model został przeszkolony na 9 135 filmach, o długościach wahających się od trzech do dziesięciu sekund, pochodzących z wymienionych wcześniej “sklepów internetowych”; własnego zestawu danych autorów; oraz zestawu danych HumanVid.

Z tych danych utworzono dwa zestawy danych oceny: “zestaw internetowy”, zawierający filmy i obrazy produktów ze sklepów; oraz oficjalny zestaw testowy zestawu danych ViViD od Alibaba.

Ponieważ dane ViViD nie zawierają twarzy (patrz powyższy film, jako przykład, który jest bardzo powszechny w literaturze wirtualnej próby), zostały one dodane za pomocą wypełniania Flux.

Użyte metryki to L1 loss; Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Learned Perceptual Image Patch Similarity (LPIPS); Fréchet Inception Distance (FID); oraz Fréchet Video Distance†† (FVD)

Systemy testowane na transfer ubrań to OOTDiffusion; CatVTON; OmniTry; oraz Any2AnyTryon. Modele generujące obrazy z podmiotu testowane to VisualCloze; MOSAIC; oraz UNO od ByteDance.

Dla drugiego etapu animacji obrazu ludzkiego ramy StableAnimator i DisPose zostały użyte.

W mniejszym kontekście (ponieważ nie wspiera bezpośrednio celu) VACE został również przetestowany, z pewnymi wysiłkami, aby zrównoważyć brakującą funkcjonalność:

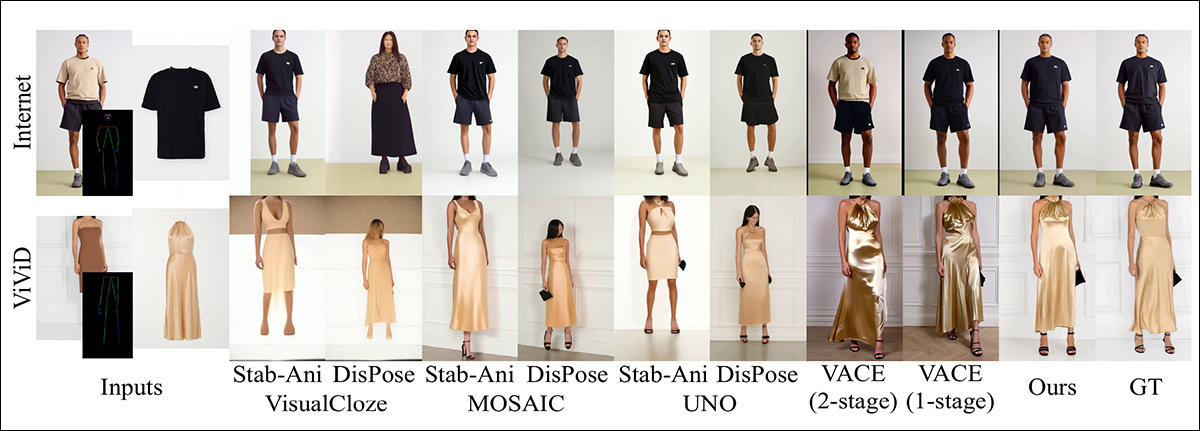

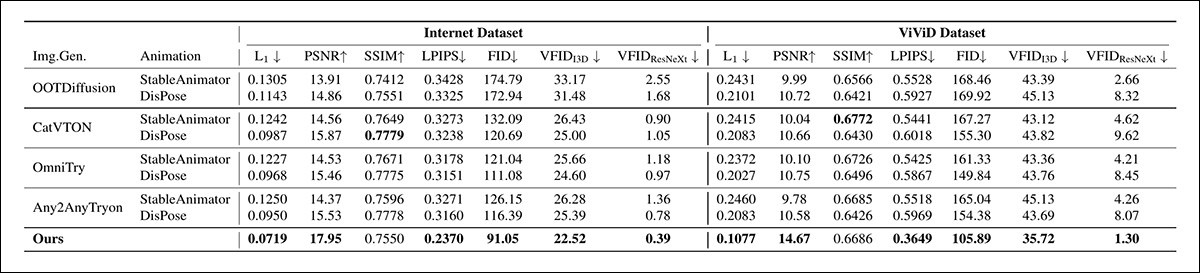

Porównanie ilościowe z połączeniami modeli generujących obrazy z podmiotu i modeli animacji na zestawach danych Internet i ViViD, gdzie proponowana metoda osiągnęła najlepszą wydajność we wszystkich raportowanych metrykach. Wartości pogrubione wskazują najlepszy wynik w każdej kolumnie.

Z początkowych wyników autorzy stwierdzają:

‘[Nasza] metoda osiąga najlepszą wydajność we wszystkich metrykach w porównaniu z połączeniami modeli generujących obrazy z podmiotu i modeli animacji.

‘Wyniki jakościowe [pokazane poniżej] potwierdzają dodatkowo, że nasze podejście produkuje najbardziej dokładne śledzenie pozycji i transfer ubrań, przy jednoczesnym zachowaniu tożsamości w sposób bardziej wierny niż wszystkie podstawy oparte na generowaniu obrazów z podmiotu.’

Porównanie jakościowe na zestawach danych Internet i ViViD z podstawami generowania obrazów z podmiotu i animacji, gdzie proponowana metoda, zdaniem autorów, oferuje bardziej dokładne wyrównywanie pozycji i transfer ubrań, przy jednoczesnym zachowaniu tożsamości w sposób bardziej spójny niż VisualCloze, MOSAIC, UNO i VACE.

Dla drugiej kategorii testów, gdzie przetestowano połączenia modeli wirtualnej próby na obrazach i modeli animacji, nowa praca była w stanie osiągnąć najwyższy wynik:

Porównanie ilościowe z połączeniami modeli wirtualnej próby na obrazach i modeli animacji na zestawach danych Internet i ViViD. Proponowana metoda osiągnęła najlepszą ogólną wydajność we wszystkich metrykach, przy czym SSIM pozostała porównywalna do najsilniejszej podstawy. Wartości pogrubione oznaczają najwyższy wynik.

Autorzy dodają:

‘Porównania jakościowe [pokazane poniżej] potwierdzają, że nasze wyniki najbardziej przypominają dane odniesienia wśród wszystkich podstaw opartych na wirtualnej próbie.’

Testy jakościowe z podstawami utworzonymi przez połączenie modeli wirtualnej próby na obrazach i modeli animacji.

Wnioski

Chociaż projekt Vanast osiąga rozwiązanie końcowe, brak szczegółów wokół wymagań szkolenia i inferencji wskazuje, że to może nie być najbardziej zwinne rozwiązanie. Prawdą jest, że samo wyzwanie jest ogromnie trudne do osiągnięcia, nawet w systemie nieoptymalizowanym – a tym bardziej w wdrożeniu komercyjnym, które wymagałoby niskiej latencji i opłacalności w skali.

Wirtualna próba jest jednym z celów “księżycowych” sztucznej inteligencji, gdzie obecny stan techniki, rozpowszechniony przez różne nagłówki i starannie wybrane wyniki, zaciemnia rzeczywistą trudność zadania, które być może ostatecznie zostanie rozwiązane przez późniejsze i lżejsze technologie niż Transformatory.

† Dostępne w USA, zablokowane w wielu innych regionach, jeśli nie we wszystkich.

†† Autorzy odnoszą się do ‘VFID’, ale łączą tylko do artykułu ViViD, który nie uzasadnia odniesienia, jak mogłem to ustalić, z ograniczonym czasem na śledzenie. Założyłem, że tak naprawdę mieli na myśli Fréchet Video Distance (FVD), i również mieli ograniczony czas. Proszę skontaktuj się ze mną w celu wprowadzenia zmian, jeśli to konieczne.

Pierwotnie opublikowane w środę, 8 kwietnia 2026