Sztuczna inteligencja

Uwikłana definicja ‘Deepfake’

Porywające nowe badanie z Niemiec krytykuje definicję terminu ‘deepfake’ w EU AI Act jako zbyt mglistą, szczególnie w kontekście manipulacji cyfrowych obrazów. Autorzy twierdzą, że nacisk Aktu na treści przypominające prawdziwe osoby lub wydarzenia – a jednocześnie potencjalnie wyglądające na fałszywe – brakuje wyjaśnienia.

Autorzy zwracają również uwagę, że wyjątki Aktu dla ‘standardowego edytowania’ (tj. rzekomo nieznacznych modyfikacji obrazów z użyciem sztucznej inteligencji) nie uwzględniają zarówno wszechobecnego wpływu sztucznej inteligencji w aplikacjach konsumenckich, jak i subiektywnego charakteru konwencji artystycznych, które poprzedzają pojawienie się sztucznej inteligencji.

Niedokładne ustawodawstwo w tych kwestiach prowadzi do dwóch głównych ryzyk: ‘chilling effect’, gdzie szeroki zakres interpretacyjny prawa tłumi innowacje i wdrożenie nowych systemów; oraz ‘scofflaw effect’, gdzie prawo jest lekceważone jako zbyt daleko idące lub niewłaściwe.

W obu przypadkach niejasne prawa skutecznie przerzucają odpowiedzialność za ustalenie praktycznych definicji prawnych na przyszłe orzeczenia sądowe – ostrożne i ryzykowne podejście do ustawodawstwa.

Technologie manipulacji obrazu oparte na sztucznej inteligencji pozostają zauważalnie przed prawem, wydaje się. Na przykład, jeden godny uwagi przykład rosnącej elastyczności pojęcia sztucznie napędzanego ‘automatycznego’ post-procesowania, obserwuje się w funkcji ‘Scene Optimizer’ w niedawnych kamerach Samsung, które mogą zastąpić zdjęcia księżyca wykonane przez użytkownika (trudny temat), z obrazem ‘uzupełnionym’ za pomocą sztucznej inteligencji:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

W dolnej lewej części powyższego obrazu widzimy dwa obrazy księżyca. Ten po lewej to zdjęcie wykonane przez użytkownika Reddit. Tutaj obraz został celowo rozmyty i zmniejszony przez użytkownika.

Po jego prawej stronie widzimy zdjęcie tego samego zdegradowanego obrazu wykonanego za pomocą kamery Samsung z włączonym przetwarzaniem obrazu z użyciem sztucznej inteligencji. Kamera automatycznie ‘uzupełniła’ rozpoznanie obiektu ‘księżyc’, nawet jeśli nie był to prawdziwy księżyc.

Artykuł kieruje głębszą krytykę w stronę Best Take funkcji zintegrowanej z niedawnymi smartfonami Google – kontrowersyjnej funkcji sztucznej inteligencji, która edytuje najlepsze części zdjęcia grupowego, skanując wiele sekund sekwencji fotograficznej, tak aby uśmiechy były przesunięte do przodu lub do tyłu w czasie, jeśli to konieczne – i nikt nie jest pokazany w środku mrugania.

Artykuł utrzymuje, że tego rodzaju kompozytowy proces ma potencjał, aby źle przedstawić wydarzenia:

‘[W] typowym ustawieniu zdjęcia grupowego, przeciętny widz prawdopodobnie nadal uzna wynikowe zdjęcie za autentyczne. Uśmiech, który został wstawiony, istniał w ciągu kilku sekund od reszty zdjęcia.

‘Z drugiej strony, dziesięciosekundowy czas trwania funkcji best take jest wystarczający do zmiany nastroju. Osoba mogła przestać się uśmiechać, podczas gdy reszta grupy śmieje się z żartu na jej koszt.

‘W konsekwencji, zakładamy, że taki fotografia grupowa może dobrze stanowić deep fake.’

Nowy artykuł nosi tytuł Czym jest Deep Fake? Niejasna granica między uzasadnionym przetwarzaniem a manipulacją w ramach EU AI Act, i pochodzi od dwóch badaczy z Computational Law Lab na Uniwersytecie w Tybindze i Saarland University.

Stare sztuczki

Manipulowanie czasem w fotografii jest o wiele starsze niż sztuczna inteligencja na poziomie konsumenckim. Autorzy nowego artykułu zwracają uwagę na istnienie znacznie starszych technik, które mogą być uznane za ‘nieautentyczne’, takich jak łączenie wielu sekwencyjnych obrazów w High Dynamic Range (HDR) zdjęcie lub ‘uszycie’ panoramicznego zdjęcia.

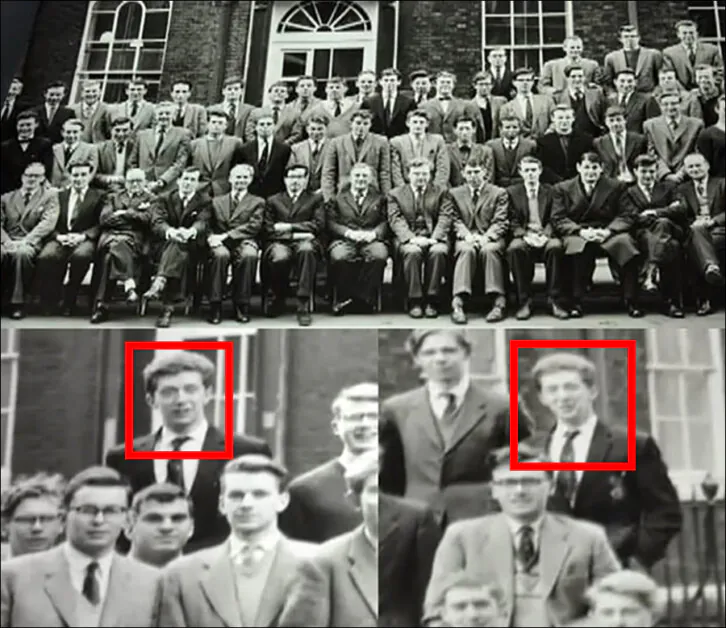

W istocie, niektóre z najstarszych i najzabawniejszych fałszywych zdjęć były tradycyjnie tworzone przez uczniów, którzy biegali z jednego końca szkoły na drugi, przed trajektorią specjalnych panoramicznych kamer, które kiedyś były używane do fotografii sportowej i szkolnej – umożliwiając uczniowi pojawienie się dwa razy na tym samym zdjęciu:

Podczas gdy zachęta do oszukania panoramicznych kamer podczas zdjęć grupowych była zbyt wielka, aby ją odpuścić, dla wielu uczniów, którzy byli skłonni ryzykować złą sesję w biurze dyrektora, aby ‘sklonować’ siebie na zdjęciach szkolnych. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Chyba że wykonasz zdjęcie w trybie RAW, który po prostu zrzutuje czujnik soczewki kamery do bardzo dużego pliku bez jakiejkolwiek interpretacji, twoje cyfrowe zdjęcia nie są całkowicie autentyczne. Systemy kamery rutynowo stosują ‘poprawiające’ algorytmy, takie jak ostrość obrazu i balans bieli, domyślnie – i robią to od początków fotografii cyfrowej na poziomie konsumenckim.

Autorzy nowego artykułu twierdzą, że nawet te starsze typy cyfrowej augmentacji zdjęć nie reprezentują ‘rzeczywistości’, ponieważ takie metody są zaprojektowane, aby uczynić zdjęcia bardziej przyjemnymi, a nie bardziej ‘rzeczywistymi’.

Studium sugeruje, że EU AI Act, nawet z późniejszymi poprawkami, takimi jak recitals 123–27, umieszcza wszystkie zdjęcia w dowodowym ramach nieodpowiednich dla kontekstu, w którym zdjęcia są produkowane, w przeciwieństwie do (nominalnie obiektywnej) natury nagrywania zabezpieczeń lub fotografii sądowej. Większość zdjęć objętych AI Act jest bardziej prawdopodobna, aby pochodzić z kontekstów, w których producenci i platformy online aktywnie promują kreatywną interpretację zdjęć, w tym użycie sztucznej inteligencji.

Badacze sugerują, że zdjęcia ‘nigdy nie były obiektywnym przedstawieniem rzeczywistości’. Uwzględnienia, takie jak położenie kamery, wybrana głębia pola lub wybór oświetlenia, wszystkie przyczyniają się do tego, że fotografia jest głęboko subiektywna.

Artykuł obserwuje, że rutynowe ‘czyszczenie’ – takie jak usuwanie kurzu z czujnika lub niechcianych linii energetycznych z inaczej dobrze skomponowanego sceny – były tylko połowicznie zautomatyzowane przed pojawieniem się sztucznej inteligencji: użytkownicy musieli ręcznie wybrać obszar lub zainicjować proces, aby osiągnąć pożądany wynik.

Dziś te operacje są często wyzwalane przez tekstowe polecenia użytkownika, szczególnie w narzędziach takich jak Photoshop. Na poziomie konsumenckim takie funkcje są coraz częściej zautomatyzowane bez interwencji użytkownika – wynik, który jest oczywiście uważany przez producentów i platformy za ‘oczywiście pożądany’.

Rozmyty znaczenie ‘Deepfake’

Głównym wyzwaniem dla ustawodawstwa wokół obrazów zmienionych lub wygenerowanych za pomocą sztucznej inteligencji jest niejasność terminu ‘deepfake’, który miał swoje znaczenie znacznie rozszerzone w ciągu ostatnich dwóch lat.

Pierwotnie terminy odnosiły się tylko do danych wideo z autoencoder-based systems, takich jak DeepFaceLab i FaceSwap, oba pochodzące z anonimowego kodu opublikowanego na Reddit pod koniec 2017 roku.

Od 2022 roku pojawienie się Latent Diffusion Models (LDMs), takich jak Stable Diffusion i Flux, a także systemów text-to-video, takich jak Sora, pozwoliłoby również na zamianę tożsamości i dostosowanie, przy poprawionej rozdzielczości, elastyczności i wierności. Teraz było możliwe stworzenie modeli dyfuzji, które mogłyby przedstawiać celebrytów i polityków. Ponieważ termin ‘deepfake’ był już skarbem nagłówków dla producentów mediów, został on rozszerzony, aby objąć te systemy.

Później, zarówno w mediach, jak i literaturze badawczej, termin ten obejmował również impersonację opartą na tekście. W tym momencie oryginalne znaczenie ‘deepfake’ było niemal całkowicie utracone, podczas gdy jego rozszerzone znaczenie ewoluowało w sposób ciągły i coraz bardziej rozmyty.

Jednakże, ponieważ słowo było tak wybuchowe i galwanizujące, i było już potężnym punktem odniesienia politycznym i medialnym, okazało się niemożliwe, aby je porzucić. Przyciągało czytelników do stron internetowych, fundusze dla badaczy i uwagę polityków. Ta niejasność leksykalna jest głównym celem nowych badań.

Jak autorzy obserwują, artykuł 3(60) EU AI Act określa cztery warunki, które definiują ‘deepfake’.

1: Prawdziwy Księżyc

Po pierwsze, treść musi być wygenerowana lub zmodyfikowana, tj. albo stworzona od podstaw za pomocą sztucznej inteligencji (generacja) lub zmodyfikowana z istniejących danych (modyfikacja). Artykuł podkreśla trudność w odróżnieniu ‘akceptowalnych’ wyników edycji obrazu i manipulacyjnych deepfakes, biorąc pod uwagę, że cyfrowe zdjęcia są w każdym przypadku nieprawdziwym przedstawieniem rzeczywistości.

Artykuł utrzymuje, że Samsung-wygenerowany księżyc jest słusznie autentyczny, ponieważ księżyc jest mało prawdopodobny, aby zmienić wygląd, a ponieważ treść wygenerowana przez sztuczną inteligencję, przeszkolona na prawdziwych obrazach księżyca, jest zatem prawdopodobnie dokładna.

Jednak autorzy również stwierdzają, że ponieważ system Samsung został pokazany, aby wygenerować ‘uzupełniony’ obraz księżyca w przypadku, gdy obraz źródłowy nie był księżycem, byłby to ‘deepfake’.

Byłoby niewykonalne, aby stworzyć kompleksową listę różnych przypadków użycia wokół tego rodzaju ad hoc funkcjonalności. Dlatego też ciężar definicji wydaje się przechodzić, ponownie, do sądów.

2: TextFakes

Po drugie, treść musi być w postaci obrazu, audio lub wideo. Treść tekstowa, chociaż podlega innym obowiązkom transparentności, nie jest uważana za deepfake w ramach AI Act. To nie jest objęte szczegółowo w nowym badaniu, chociaż może mieć znaczący wpływ na skuteczność wizualnych deepfakes (patrz poniżej).

3: Rzeczywiste Problemy

Po trzecie, treść musi przypominać istniejące osoby, obiekty, miejsca, podmioty lub wydarzenia. Ten warunek ustanawia połączenie z rzeczywistym światem, co oznacza, że czysto sfabrykowane obrazy, nawet jeśli są fotorealistyczne, nie kwalifikują się jako deepfake. Recital 134 EU AI Act podkreśla aspekt ‘podobieństwa’ przez dodanie słowa ‘znacznie’ (wyraźne odniesienie do późniejszych orzeczeń sądowych).

Autorzy, cytując wcześniejsze prace, rozważają, czy wygenerowany przez sztuczną inteligencję obraz twarzy musi należeć do prawdziwej osoby, czy też musi być tylko wystarczająco podobny do prawdziwej osoby, aby spełnić tę definicję.

Na przykład, jak można określić, czy sekwencja fotorealistycznych obrazów przedstawiających polityka Donalda Trumpa ma na celu jego podszywanie się, jeśli obrazy (lub dołączone teksty) nie wymieniają go specjalnie? Rozpoznawanie twarzy? Ankiety użytkowników? Definicja ‘zdrowego rozsądku’ sędziego?

Wracając do kwestii ‘TextFakes’ (patrz powyżej), słowa często stanowią znaczną część aktu wizualnego deepfake. Na przykład, można wziąć (niezmienione) zdjęcie lub wideo ‘osoby a’‘, i powiedzieć, w podpisie lub na portalu społecznościowym, że obraz jest ‘osoby b’‘ (zakładając, że dwie osoby są do siebie podobne).

W takim przypadku nie jest potrzebna sztuczna inteligencja, a wynik może być szczególnie skuteczny – ale czy taki niskotechnologiczny podejście również stanowi ‘deepfake’?

4: Retusz, Przebudowa

Wreszcie, treść musi wyglądać autentycznie lub prawdziwie dla osoby. Ten warunek podkreśla percepcję ludzkich obserwatorów. Treść, która jest rozpoznawana jako reprezentująca prawdziwą osobę lub obiekt tylko przez algorytm, nie jest uważana za deepfake.

Istnieją wyraźne trudności w osiągnięciu porozumienia w sprawie tak subiektywnego przepisu. Autorzy obserwują, na przykład, że różne osoby, a także różne typy osób (takie jak dzieci i dorośli), mogą być różnie skłonne uwierzyć w konkretny deepfake.

Autorzy dodatkowo zauważają, że zaawansowane możliwości sztucznej inteligencji w narzędziach takich jak Photoshop wyzywają tradycyjne definicje ‘deepfake’. Chociaż te systemy mogą zawierać podstawowe zabezpieczenia przed kontrowersyjną lub zabronioną treścią, dramatycznie rozszerzają one pojęcie ‘retuszu’. Użytkownicy mogą teraz dodawać lub usuwać obiekty w sposób bardzo przekonywujący i fotorealistyczny, osiągając profesjonalny poziom autentyczności, który definiuje granice manipulacji obrazem.

Autorzy stwierdzają:

‘Uważamy, że obecna definicja deep fakes w AI Act i odpowiadające im obowiązki nie są wystarczająco określone, aby rozwiązać wyzwania stawiane przez deep fakes. Analizując cykl życia cyfrowego zdjęcia od czujnika kamery do funkcji edycyjnych, stwierdzamy, że:

‘(1.) Deep fakes są niejasno zdefiniowane w EU AI Act. Definicja pozostawia zbyt wiele miejsca na to, czym jest deep fake.

‘(2.) Nie jest jasne, jak funkcje edycyjne, takie jak funkcja „best take” Google, mogą być uważane za wyjątek od obowiązków transparentności.

‘(3.) Wyjątek dla znacznie zmodyfikowanych obrazów podnosi pytania o to, co stanowi istotną edycję treści i czy edycja ta musi być zauważalna przez osobę fizyczną.’

Robienie wyjątku

EU AI Act zawiera wyjątki, które, jak twierdzą autorzy, mogą być bardzo permissive. Artykuł 50(2), stwierdzają, oferuje wyjątek w przypadkach, gdy większość oryginalnego obrazu źródłowego nie jest zmieniona. Autorzy zauważają:

‘Co można uznać za treść w rozumieniu artykułu 50(2) w przypadku cyfrowego audio, obrazów i wideo? Na przykład, w przypadku obrazów, czy musimy brać pod uwagę przestrzeń pikseli czy widoczną przestrzeń postrzeganą przez ludzi? Istotne manipulacje w przestrzeni pikseli mogą nie zmieniać percepcji ludzkiej, a z drugiej strony, niewielkie perturbacje w przestrzeni pikseli mogą dramatycznie zmieniać percepcję.’

Badacze podają przykład dodania pistoletu do zdjęcia osoby, która wskazuje na kogoś. Poprzez dodanie pistoletu, zmienia się tylko 5% obrazu; jednak znaczenie zmienionej części jest znaczące. Dlatego wydaje się, że ten wyjątek nie uwzględnia żadnego ‘zdroworozsądkowego’ zrozumienia wpływu, jaki mała szczegół może mieć na ogólne znaczenie obrazu.

Artykuł 50(2) pozwala również na wyjątki dla ‘funkcji asystującej do standardowego edytowania’. Ponieważ Akt nie definiuje, co oznacza ‘standardowe edytowanie’, nawet funkcje post-procesowania tak ekstremalne, jak Best Take Google, wydają się być chronione przez ten wyjątek, obserwują autorzy.

Wnioski

Stwierdzone zamiary nowej pracy mają zachęcić do międzydyscyplinarnych badań nad regulacją deepfakes oraz posłużyć jako punkt wyjścia do nowych dialogów między naukowcami komputerowymi i prawnikami.

Jednak sam artykuł ulega tautologii w kilku punktach: często używa terminu ‘deepfake’, jakby jego znaczenie było oczywiste, podczas gdy atakuje EU AI Act za niezdefiniowanie, co tak naprawdę stanowi deepfake.

Pierwotnie opublikowane w poniedziałek, 16 grudnia 2024