Liderzy opinii

Praktyczny podręcznik dla obronnych danych wyjściowych LLM

Istnieje cicha założenie, która przenika przez większość wdrożeń przedsiębiorstw GenAI: jeśli dane wyjściowe wyglądają prawidłowo, są prawidłowe. W środowiskach o niskim ryzyku jest to rozsądne skrócenie. W branżach regulowanych, takich jak opieka zdrowotna, finanse, farmaceutyka i zapewnienie jakości, jest to potencjalne ryzyko, które może się ujawnić.

W momencie, gdy dane wyjściowe LLM wpływają na decyzję kliniczną, rekord finansowy lub dokument zgodności, płynność przestaje być wskaźnikiem niezawodności. I kiedy auditor, organ regulacyjny lub zespół prawny pyta, jakie dane zostały wykorzystane, jakie reguły zostały zastosowane i kto je zatwierdził, “model powiedział tak” nie jest odpowiedzią, którą można zaakceptować.

Jest to luka odpowiedzialności, na którą większość zespołów GenAI nie projektuje. Oto jak ją zamknąć.

Dlaczego “wygląda prawidłowo” to błędny standard

Tradycyjna ocena AI koncentruje się na dokładności, opóźnieniu i koszcie. Te czynniki są ważne. Jednak środowiska regulowane wprowadzają czwarty wymiar, który nie może być zastąpiony przez pozostałe: audytowalność.

EU AI Act, który obecnie obowiązuje, wymaga, aby systemy AI o wysokim ryzyku utrzymywały dokumentację techniczną, rejestry śledzenia i dowody nadzoru ludzkiego w całym cyklu ich życia. Pierwszy projekt wytycznych FDA dotyczących AI w rozwoju leków i biologicznych wskazuje ten sam kierunek dla nauk o życiu. Te ramy nie oceniają płynności. Wymagają systemów, które mogą być odtwarzane, inspekcjonowane i bronione.

Dane wyjściowe LLM, które można obronić, to takie, które mogą być śledzone wstecz przez weryfikowalny łańcuch dowodów: jakie dane zostały wykorzystane, jakie ograniczenia je ukształtowały, kto je przeglądał i co zostało zachowane do przyszłej inspekcji. Bez tego łańcucha nawet poprawne dane wyjściowe są nieobronne.

To zmienia to, co “gotowe do produkcji” oznacza naprawdę dla AI w środowiskach zarządzanych.

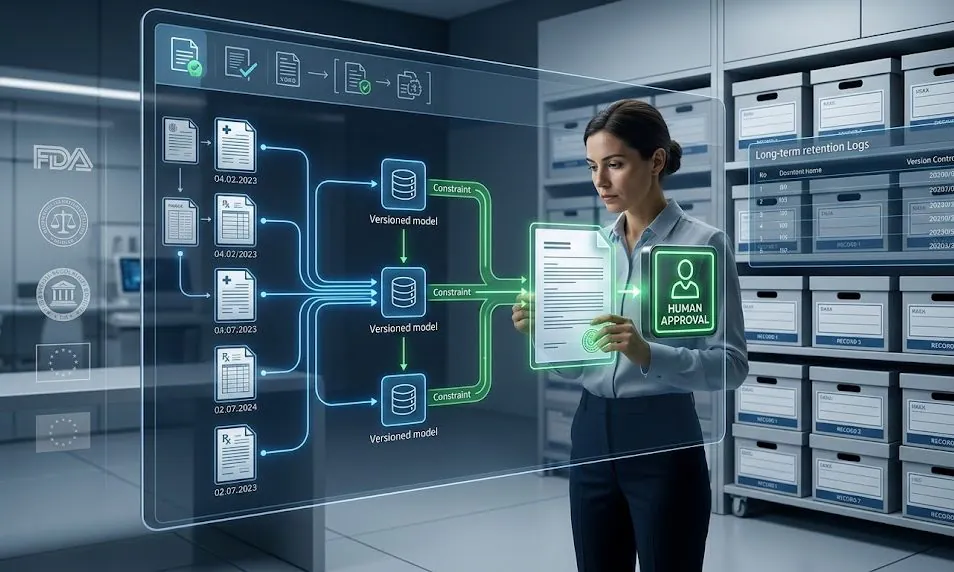

Cztery filary gotowych do audytu GenAI

Budowanie systemów LLM, które można obronić, sprowadza się do czterech wymagań inżynieryjnych. Nie są to abstrakcyjne zasady – są to decyzje dotyczące infrastruktury, które determinują, czy system może przetrwać kontrolę.

1. Pochodzenie: Kontroluj, skąd model pobiera informacje

Najczęstszy sposób awarii w przedsiębiorstwach AI jest również najmniej widoczny: modele korzystające z ogólnej wiedzy lub luźno zdefiniowanych źródeł danych. Gdy nie ma kontrolowanego granicznego obszaru wiedzy, dane wyjściowe nie mogą być śledzone do żadnego audytowalnego źródła, a odtworzenie staje się niemożliwe.

Praktyczne rozwiązanie polega na ustanowieniu zatwierdzonego granicznego obszaru wiedzy: wersjonowanych, należących do dokumentów i zbiorów danych, których system jest wyraźnie upoważniony do korzystania. Każda odpowiedź powinna zawierać minimalny pakiet dowodów: identyfikator źródła z wersją i datą obowiązywania, rejestr pobierania pokazujący, co zostało zapytane i wybrane, oraz cytaty w tekście. Przydatna reguła operacyjna: brak cytatu, brak twierdzenia.

To przekształca system z pamięciowego generowania w oparty na dowodach.

2. Ograniczenia: Zamień improwizację na kontrolowane zachowanie

LLM są budowane, aby być przekonywujące. Bez ograniczeń optymalizują one pod względem prawdopodobieństwa, a prawdopodobieństwo w środowisku regulowanym to miejsce, gdzie żyje ryzyko.

Ograniczenia są mechanizmem, który zmienia probabilistyczny generator tekstu w ograniczony komponent wykonawczy. W praktyce oznacza to:

- Generowanie związane ze źródłem: Każde twierdzenie wymaga zatwierdzonego, wersjonowanego źródła. Brak źródła oznacza brak odpowiedzi — tylko odmowa lub eskalacja.

- Schematy danych wyjściowych: Odpowiedzi są zgodne z zdefiniowanymi formatami, które maszyny i audytorzy mogą zwalidować, a nie tylko przeczytać.

- Wymuszanie granicy zaufania: Pobrany zawartość jest traktowany jako dane wejściowe, bezpośrednio rozwiązując ryzyko wstrzyknięcia podpowiedzi, które mogą podważyć zarówno bezpieczeństwo, jak i audytowalność.

- Dostęp z najniższymi uprawnieniami: Model współdziała tylko z danymi i narzędziami, których naprawdę potrzebuje, utrzymując czyste ślady audytu.

Ograniczenia nie są polem do zgodności. Są to decyzje architektoniczne, które determinują, czy system może być audytowany w ogóle.

3. Przegląd: Uczynienie nadzoru ludzkiego formalną warstwą kontroli

W regulowanym AI przegląd ludzki nie może być przypadkowy. Musi być stratyfikowany pod względem ryzyka (wyższe ryzyko wywołuje surowszą weryfikację) i wyzwalany zdarzeniami, aktywowany, gdy zaufanie modelu jest niskie, źródła są nieobecne lub wykryte są anomalie.

EU AI Act wyraźnie wymaga, aby ludzie mogli interpretować, zastępować i zatrzymywać decyzje napędzane przez AI w przypadkach o wysokim ryzyku. Spełnienie tego wymogu oznacza, że rekordy przeglądu muszą zawierać, kto zatwierdził dane wyjściowe, w jakich warunkach i z jakim poziomem kontroli. “Ktoś to sprawdził” nie jest kontrolą. Zadokumentowany, opatrzony znacznikiem czasowym rekord przeglądu jest.

To podnosi przegląd z ręcznej kontroli jakości do formalnej warstwy zarządzania, co jest dokładnie tym, jak regulacje zaczynają go traktować.

4. Przechowywanie: Uczynienie odpowiedzialności trwałą

Bez rejestrów nie ma śladu audytu. Bez śladu audytu odpowiedzialność jest teoretyczna.

W tym samym czasie przechowywanie wszystkiego tworzy własne ryzyko, szczególnie tam, gdzie wrażliwe dane zdrowotne lub finansowe podlegają wymogom minimalizacji w ramach ram, takich jak GDPR lub HIPAA.

Praktyczne podejście to model warstwowy. Zawsze przechowuj metadane modelu i wersji, identyfikatory źródła, decyzje polityczne i znaczniki czasowe. Przechowuj zawartość interakcji (podpowiedzi, dane wyjściowe i pełne ślady) wybiórczo, na podstawie klasyfikacji ryzyka, z odpowiednimi kontrolami dostępu i redakcją. Celem jest umożliwienie odtworzenia dowolnych danych wyjściowych bez nadmiernej kolekcji danych, które tworzą narażenie na ryzyko.

Wygląda to w praktyce

Rozważ, jak to ma zastosowanie w naukach o życiu, gdzie CFR 21 Part 11 wymaga, aby elektroniczne rekordy były przypisywalne, czytelne, współczesne, oryginalne i dokładne. LLM generujący dokumentację regulacyjną musi spełnić wszystkie pięć kryteriów — nie tylko produkować czytelny tekst.

W tym kontekście cztery filary nie są opcjonalnymi ulepszeniami. Są to minimalna bariera dla zgodnego systemu. Pochodzenie zapewnia, że dane wyjściowe są przypisywalne i oryginalne. Ograniczenia zapewniają, że pozostają w określonych granicach. Przegląd zapewnia, że są współczesne z nadzorem ludzkim. Przechowywanie zapewnia, że są czytelne i inspekcyjne.

Ta sama logika ma zastosowanie w usługach finansowych, gdzie MiFID II wymaga rekordów decyzji i uzasadnienia, oraz w opiece zdrowotnej, gdzie systemy wspomagania decyzji klinicznych są coraz bardziej poddawane kontroli nad wyjaśnialnością i stronniczością.

Większa zmiana

GenAI przechodzi z eksperymentowania do infrastruktury operacyjnej. Ten przejście podnosi standard tego, jak wyglądają akceptowalne systemy.

Użyteczne dane wyjściowe nie są już wystarczające. Organizacje potrzebują danych wyjściowych, które mogą być wyjaśnione, śledzone i obronione pod kontrolą, ponieważ AI jest proszona o robienie rzeczy, które niosą prawdziwe konsekwencje.

Zespoły, które projektują systemy z myślą o obronności od samego początku, będą miały możliwość bezpiecznego skalowania AI i utrzymania zaufania regulacyjnego. Te, które tego nie robią, będą ostatecznie stawać przed tym samym momentem: audytem, prostym pytaniem o konkretny wynik i nic do pokazania.

Budowanie gotowych do audytu systemów AI nie polega na spowolnieniu. Polega na budowaniu czegoś, co może przetrwać.