Sztuczna inteligencja

Dlaczego systemy generatywne wideo nie mogą tworzyć pełnometrażowych filmów?

Pojawienie się i postęp generatywnego sztucznego inteligentnego wideo spowodowało, że wielu niezorientowanych obserwatorów przewiduje, że uczenie maszynowe będzie oznaczać śmierć przemysłu filmowego, jaki znamy – zamiast tego, pojedynczy twórcy będą mogli tworzyć hollywoodzkie blockbustery w domu, na lokalnych lub opartych na chmurze systemach GPU.

Czy jest to możliwe? Nawet jeśli jest to możliwe, czy jest to nieuniknione, jak wielu ludzi sądzi?

To, że osoby fizyczne będą w końcu mogły tworzyć filmy, w takiej formie, jaką znamy, z ciągłymi postaciami, spójnością narracyjną i całkowitą fotorealizmem, jest całkiem możliwe – i być może nawet nieuniknione.

Jednakże istnieją kilka podstawowych powodów, dlaczego nie jest to prawdopodobne w przypadku systemów wideo opartych na modelach dyfuzyjnych.

Ten ostatni fakt jest ważny, ponieważ w tej chwili ta kategoria obejmuje każdy popularny system tekstu-do-wideo (T2) i obrazu-do-wideo (I2V), w tym Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (i, jak możemy stwierdzić, przyszłą funkcjonalność wideo Adobe Firefly); wśród wielu innych.

Tutaj rozważamy perspektywę prawdziwych auteur pełnometrażowych produkcji generatywnych AI, tworzonych przez osoby fizyczne, z ciągłymi postaciami, operatorstwem i efektami wizualnymi co najmniej na poziomie obecnego stanu sztuki w Hollywood.

Zobaczmy niektóre z największych praktycznych przeszkód na drodze do tych wyzwań.

1: Nie możesz uzyskać dokładnego następnego ujęcia

Niespójność narracyjna jest największą z tych przeszkód. Fakt jest taki, że żaden obecnie dostępny system generatywnego wideo nie może utworzyć prawdziwie dokładnego “następnego ujęcia”.

Jest to dlatego, że model dyfuzyjny w sercu tych systemów opiera się na losowym szumie, a ten podstawowy założenie nie jest podatny na reinterpretację dokładnie tego samego treści dwukrotnie (tj. z różnych kątów lub rozwijając poprzednie ujęcie w następne ujęcie, które utrzymuje spójność z poprzednim ujęciem).

Gdzie są używane podpowiedzi tekstowe, samodzielnie lub wraz z przesłanymi “nasionowymi” obrazami (wielomodalny wprowadzany), tokeny pochodzące z podpowiedzi będą wywoływać semantycznie odpowiednią treść z ukrytej przestrzeni modelu.

Jednakże, dalej utrudnione przez “losowy szum” czynnik, nigdy nie zrobi tego samego sposobem dwukrotnie.

To oznacza, że tożsamości osób w filmie będą tendencję do zmiany, a obiekty i środowiska nie będą odpowiadać początkowemu ujęciu.

To dlatego, że wirusowe klipy przedstawiające nadzwyczajne wizualizacje i hollywoodzki poziom wyjścia mają tendencję do bycia albo pojedynczymi ujęciami, albo “showcase montażem” możliwości systemu, gdzie każde ujęcie przedstawia różne postacie i środowiska.

Fragmenty z generatywnego AI montażu Marco van Hylckama Vlieg – źródło: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Implikacja w tych kolekcjach ad hoc generacji wideo (które mogą być nieuczciwe w przypadku systemów komercyjnych) jest taka, że podstawowy system może tworzyć ciągłe i spójne narracje.

Analogia jest tu wykorzystywana, jak w przypadku zwiastunu filmu, który zawiera tylko minutę lub dwie fragmentów filmu, ale daje widzom powód, by uwierzyć, że cały film istnieje.

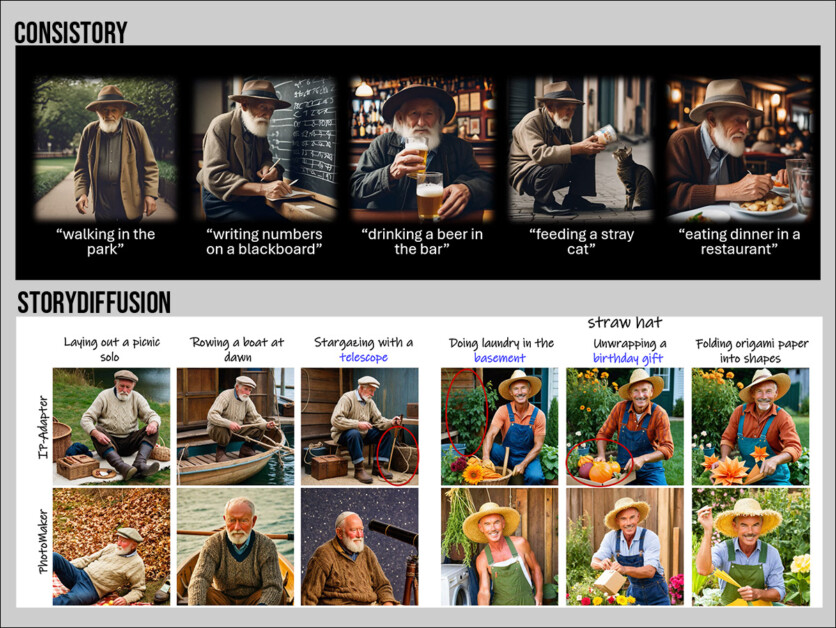

Jedynymi systemami, które obecnie oferują spójność narracyjną w modelu dyfuzyjnym, są te, które produkują statyczne obrazy. Należą do nich ConsiStory od NVIDIA, oraz różne projekty w literaturze naukowej, takie jak TheaterGen, DreamStory i StoryDiffusion.

Dwa przykłady ‘statycznej’ spójności narracyjnej, z niedawnych modeli:: Źródła: https://research.nvidia.com/labs/par/consistory/ i https://arxiv.org/pdf/2405.01434

W teorii, można by użyć lepszej wersji takich systemów (żaden z powyższych nie jest prawdziwie spójny), aby utworzyć serię obrazów-do-wideo, które mogłyby być łączone w sekwencję.

W obecnym stanie sztuki ten podejście nie daje wiarygodnych następnego ujęcia; i, w każdym razie, już odeszliśmy od auteur marzenia, dodając warstwę złożoności.

Możemy również użyć Low Rank Adaptation (LoRA) modeli, specjalnie wytrenowanych na postacie, rzeczy lub środowiska, aby utrzymać lepszą spójność między ujęciami.

Jednakże, jeśli postać chce pojawić się w nowym kostiumie, zwykle trzeba wytrenować nowy LoRA, który uosabia postać ubraną w ten strój (chociaż podpojęcia, takie jak “czerwona sukienka”, mogą być wytrenowane w poszczególne LoRA, wraz z odpowiednimi obrazami, nie zawsze są łatwe do pracy).

To dodaje znacznej złożoności, nawet do otwierającej sceny w filmie, gdzie osoba wstaje z łóżka, ubiera się w szlafrok, ziewa, spogląda przez okno sypialni i idzie do łazienki, aby umyć zęby.

Taka scena, zawierająca około 4-8 ujęć, może być nakręcona w jeden poranek przy użyciu konwencjonalnych procedur filmowych; w obecnym stanie sztuki w generatywnym AI, potencjalnie reprezentuje tygodnie pracy, wiele wytrenowanych LoRAs (lub innych systemów pomocniczych) i znaczne ilości post-produkcji

Alternatywnie, można użyć wideo-do-wideo, gdzie nudne lub CGI nagrania są przekształcane za pomocą podpowiedzi tekstowych w alternatywne interpretacje. Runway oferta takiego systemu, na przykład.

CGI (po lewej) z Blender, interpretowany w eksperymencie Runway video-to-video z pomocą tekstu przez Mathieu Visnjevec – Źródło: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Istnieją dwa problemy: już musisz tworzyć podstawowe nagranie, więc już robisz film dwukrotnie, nawet jeśli używasz syntetycznego systemu, takiego jak UnReal’s MetaHuman.

Jeśli tworzysz modele CGI (jak w powyższym klipie) i używasz ich w transformatce wideo-do-obrazu, ich spójność między ujęciami nie może być polegana.

To dlatego, że modele dyfuzyjne wideo nie widzą “dużej pictures” – raczej, tworzą nowy klatkę na podstawie poprzedniej klatki/i, i, w niektórych przypadkach, biorą pod uwagę pobliską przyszłą klatkę; ale, aby porównać proces do gry w szachy, nie mogą myśleć “dziesięć ruchów do przodu”, i nie mogą pamiętać dziesięciu ruchów wstecz.

Po drugie, model dyfuzyjny nadal będzie miał trudności z utrzymaniem spójnego wyglądu między ujęciami, nawet jeśli uwzględnisz wiele LoRAs dla postaci, środowiska i stylu oświetlenia, z powodów wymienionych na początku tego rozdziału.

2: Nie możesz łatwo edytować ujęcie

Jeśli przedstawiasz postać idącą ulicą przy użyciu starych metod CGI, i chcesz zmienić jakiś aspekt ujęcia, możesz dostosować model i ponownie go wyrenderować.

Jeśli jest to nagranie w świecie rzeczywistym, po prostu resetujesz i kręcisz je ponownie, z odpowiednimi zmianami.

Jednakże, jeśli wyprodukujesz ujęcie generatywnego AI, które kochasz, ale chcesz zmienić jeden aspekt z niego, możesz to osiągnąć tylko przy użyciu bolesnych metod post-produkcji opracowanych w ciągu ostatnich 30-40 lat: CGI, rotoskopia, modelowanie i matowanie – wszystkie są pracochłonne i drogie, czasochłonne procedury.

Sposób, w jaki modele dyfuzyjne działają, po prostu zmieniając jeden aspekt podpowiedzi tekstowej (nawet w wielomodalnej podpowiedzi, gdzie dostarczasz pełne źródłowe nasiono-obraz), zmieni wiele aspektów wygenerowanego wyjścia, prowadząc do gry “młotek na kacza”.

3: Nie możesz polegać na prawach fizyki

Tradycyjne metody CGI oferują różnorodne algorytmiczne, fizycznie oparte modele, które mogą symulować takie rzeczy, jak dynamika płynów, ruch gazowy, kinematyka odwrotna (dokładne modelowanie ruchu ludzi), dynamika tkanin, wybuchy i różne inne zjawiska świata rzeczywistego.

Jednakże, metody oparte na dyfuzyjnych, jak widzieliśmy, mają krótką pamięć, i również ograniczony zakres priorytetów ruchu (przykłady takich działań, zawarte w zbiorze treningowym) do dyspozycji.

W wcześniejszej wersji strony internetowej OpenAI dla wyróżnionego systemu generatywnego Sora, firma przyznała, że Sora ma ograniczenia w tym zakresie (chociaż ten tekst został od tego czasu usunięty):

‘[Sora] może mieć trudności z symulacją fizyki złożonej sceny i może nie zrozumieć konkretnych przypadków przyczyny i skutku (na przykład: ciastko nie może pokazać śladu po ugryzieniu przez postać).

‘Model może również pomieszać szczegóły przestrzenne zawarte w podpowiedzi, takie jak rozróżnianie lewej i prawej strony, lub mieć trudności z dokładnymi opisami zdarzeń, które rozgrywają się w czasie, jak konkretna trajektoria kamery.’

Praktyczne zastosowanie różnych API-opartych systemów generatywnego wideo ujawnia podobne ograniczenia w przedstawianiu dokładnej fizyki. Jednak pewne powszechne zjawiska fizyczne, takie jak wybuchy, wydają się być lepiej reprezentowane w ich zbiorach treningowych.

Niektóre osadzania priorytetów ruchu, albo wytrenowane w modelu generatywnym, albo wprowadzane z źródłowego wideo, trwają jakiś czas (tak jak osoba wykonująca złożoną i niepowtarzalną sekwencję taneczną w ozdobnym kostiumie) i, raz jeszcze, krótkowzroczna szyba uwagi modelu dyfuzyjnego prawdopodobnie przekształci treść (identyfikacja twarzy, szczegóły kostiumu itp.) do czasu, gdy ruch zostanie zakończony. Jednak LoRA mogą złagodzić to, do pewnego stopnia.

Naprawienie w postprodukcji

Istnieją inne niedociągnięcia czystej “jednego użytkownika” generatywnej produkcji wideo AI, takie jak trudności w przedstawianiu szybkich ruchów, oraz ogólny i znacznie pilniejszy problem uzyskania spójności czasowej w wyjściowym wideo.

Ponadto tworzenie konkretnych występów twarzy jest praktycznie sprawą szczęścia w generatywnym wideo, tak jak jest to w przypadku synchronizacji ust do dialogu.

W obu przypadkach korzystanie z systemów pomocniczych, takich jak LivePortrait i AnimateDiff, staje się coraz bardziej popularne w społeczności VFX, ponieważ pozwala to na przeniesienie co najmniej ogólnych wyrażeń twarzy i synchronizacji ust do istniejącego wygenerowanego wyjścia.

Przykład transferu wyrażenia (prowadzące wideo w lewym dolnym rogu) nałożonego na wideo docelowe z LivePortrait. Wideo pochodzi z Generative Z TunisiaGenerative. Zobacz pełną wersję w lepszej jakości na https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Dalej, wiele złożonych rozwiązań, w tym narzędzi takich jak Stable Diffusion GUI ComfyUI i profesjonalna aplikacja komponowania i manipulowania Nuke, a także manipulacja przestrzenią latentną, pozwalają praktykom VFX AI uzyskać większą kontrolę nad wyrazem twarzy i dyspozycją.

Chociaż opisuje proces animacji twarzy w ComfyUI jako “mękę”, specjalista VFX Francisco Contreras opracował taki proces, który pozwala na nałożenie fonemów ust i innych aspektów wyrazu twarzy/głowy

Stable Diffusion, wspomagany przez przepływ pracy ComfyUI zasilany przez Nuke, pozwolił specjaliście VFX Francisco Contreras na niezwykłą kontrolę nad aspektami twarzy. Pełne wideo, w lepszej rozdzielczości, dostępne na https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Podsumowanie

Żaden z powyższych nie wróży dobrze na perspektywę pojedynczego użytkownika generującego spójne i fotorealistyczne, pełnometrażowe filmy w stylu blockbusterów, z realistycznym dialogiem, synchronizacją ust, występami, środowiskami i ciągłością.

Ponadto przeszkody opisane tutaj, przynajmniej w odniesieniu do modeli generatywnego wideo opartych na dyfuzyjnych, nie są koniecznie rozwiązywalne “za minutę”, pomimo komentarzy na forum i uwagi medialnej, które twierdzą, że tak jest. Ograniczenia opisane tutaj wydają się być wewnętrzne dla architektury.

W badaniach nad syntezą AI, jak we wszystkich badaniach naukowych, genialne pomysły okazjonalnie olśniewają nas swoim potencjałem, tylko po to, by dalsze badania ujawniły ich fundamentalne ograniczenia.

W przestrzeni generatywnej/syntetycznej to już się wydarzyło z Sieciami Generatywnymi Przeciwnikami (GAN) i Neural Radiance Fields (NeRF), które ostatecznie okazały się bardzo trudne do instrumentalizacji w wydajne systemy komercyjne, pomimo lat badań akademickich w tym kierunku. Te technologie pojawiają się teraz najczęściej jako składniki pomocnicze w alternatywnych architekturach.

Podobnie, studia filmowe mogą mieć nadzieję, że szkolenie na legalnie licencjonowanych katalogach filmowych mogłoby wyeliminować artystów VFX, AI jest tak naprawdę dodając role do siły roboczej w tej chwili.

Czy systemy generatywne wideo oparte na dyfuzyjnych mogą być naprawdę przekształcone w narracyjnie spójne i fotorealistyczne generatory filmowe, czy cała sprawa jest po prostu kolejnym pościgiem alchemicznym, powinno się okazać w ciągu najbliższych 12 miesięcy.

Może się okazać, że potrzebujemy całkowicie nowego podejścia; lub może Gaussian Splatting (GSplat), który został opracowany na początku lat 90. i który ostatnio zyskał na popularności w przestrzeni syntezowania obrazu, reprezentuje potencjalną alternatywę dla generatywnego wideo opartego na dyfuzyjnych.

Ponieważ GSplat potrzebował 34 lat, aby dojść do głównego nurtu, jest również możliwe, że starsi kandydaci, tacy jak NeRF i GAN, a nawet modele dyfuzyjne latentne, jeszcze mają swoje najlepsze dni przed sobą.

* Chociaż funkcja AI Storyboard Kaiber oferuje taką funkcjonalność, wyniki, które widziałem, nie są w jakości produkcyjnej.

Martin Anderson jest byłym szefem treści badawczych w metaphysic.ai

Po raz pierwszy opublikowane w poniedziałek, 23 września 2024