Andersonの視点

AIを用いた肥満の利点

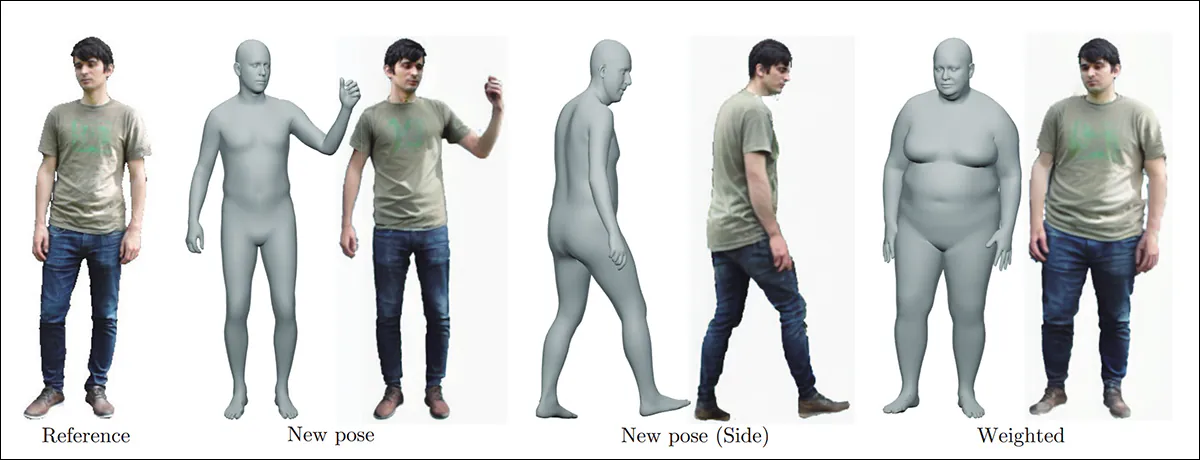

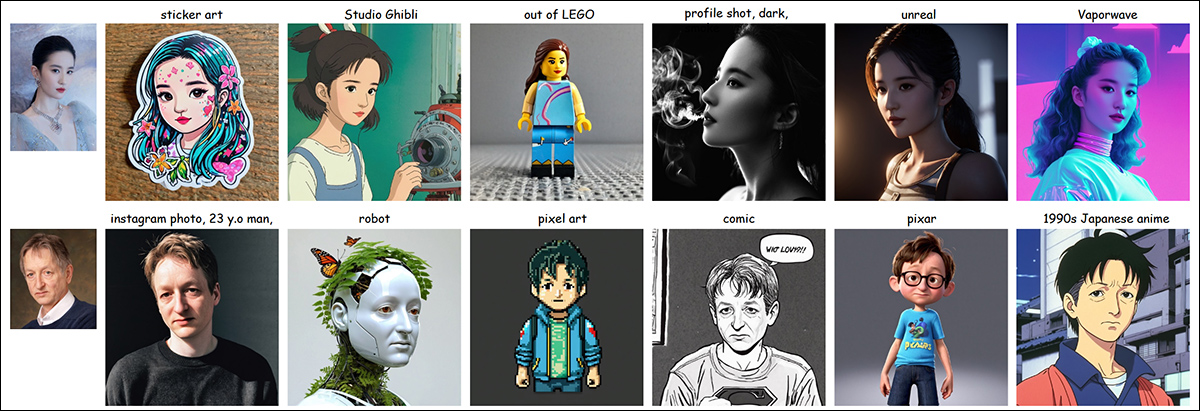

新しいAIシステムは、写真の中の人の体をリアルに変形させることができ、太ったり、細ったり、または筋肉質になったりすることができますが、顔、服、背景は変更されません。このシステムは、各アイデンティティを複数の体のタイプで示す完全に合成されたデータセットでトレーニングされています。

また、AIを使用してソーシャルネットワークで体の形を整える方法としての使用や、VFX目的のために体のタイプを変更するための使用が増えてきているほか、機械学習を使用して個人の外見を変更することは、より重要な機能を果たすことができます。食べ物の障害を持つ個人が自分の外見に対する自己認識を理解するのを助けたり、一般的なスポーツやフィットネスの目的のための潜在的な動機付けツールを提供したりすることができます。

From the paper ‘Body size estimation in women with anorexia nervosa and healthy controls using 3D avatars’, a GUI to visualize body shape changes. Individuals with body dysmorphia may struggle to associate a realistic interpretation of their body with a similar image, thus giving clinicians a metric for dysmorphic responses, among other purposes. Source: https://www.nature.com/articles/s41598-017-15339-z.pdf

さらに、コンピュータビジョン研究におけるファッショントライオンのサブストランドも、さまざまな体の形状に対して正確な視覚化を提供することに興味があります。 한편、2024年の日本の筑波大学のDiffBodyオファーなどのフレームワークは、この分野で目を見張るような機能を生み出しています。

Some of the transformations possible using the prior DiffBody technique. Source: https://arxiv.org/pdf/2401.02804

AIの基礎モデルは、従来の美しいまたは一般的な体の形状に向けて最適化されているため、通常のモデルでは「肥満」というような特殊なサイズは利用できないか、または偏見が伴います。

ペアの必要性

人の体を写真の中でリアルに変形させるAIシステムを作成する上で最大の課題の1つは、個人のアイデンティティ、環境、または服を変更せずに、体に脂肪や筋肉を加えたり減らしたりすることです。これには、ペアトレーニングが必要です。ここで、AIシステムは、モデルが実行する変換を定義する「前」と「後」の画像を効果的に学習します。

この種のトレーニングは、Black Forest LabsのKontextシリーズの画像編集モデルでの成功により、夏に再び注目されるようになりました。ここでは、この種のペアデータを使用して、モデルにさまざまな変換を教えることができました。

From the Flux Kontext site, an example of a transformation that reflects the kind of source data needed to train a model capable of retaining image integrity when imposing major changes. Source: https://bfl.ai/models/flux-kontext

明らかに、人の外見を大幅に変更するモデル(画像全体を再構築せずに)を開発するには、現実世界では不可能なものが必要です。つまり、わずか数秒の差で撮影された「前」と「後」の写真です。

唯一の解決策は、合成データを使用することです。この種のプロジェクトの一部は、Photoshopで手動で作成された個々の、高度なコントラストのペアを使用しました。ただし、これは大規模なプロジェクトでは実現不可能です。自動化された、または半自動化された、AI駆動のペア生成プロセスが現在、より好ましいと考えられています。

GANベースのアプローチや、SMPL/Xベースのアプローチ(仮想のCGIフィギュアを、実際の画像と望ましい変換の間の交換メカニズムとして使用するアプローチ)などの問題は、背景やアイデンティティが変換プロセスで損なわれる可能性があることです。

Parametric, vector-based CGI models such as SMPL and SMPL-X (among others), provide defined conventional physical 3D coordinates which can be interpreted and incorporated into computer vision frameworks. Source: https://files.is.tue.mpg.de/black/papers/SMPL2015.pdf

体の特定の側面のみを変更するようにAIが学習する必要があるため、背景やその他の不必要なエラーを歪曲したり複製したりするのではなく、体の変化のみを学習する必要があります。現在、完璧な解決策に到達したシステムはありません。

しかし、インドから最近発表された論文では、古いFlux拡散モデルフレームワークを使用し、優れたペアデータセットを可能にする二次的なアプローチを組み合わせることで、最先端の技術に大幅な進歩を提案しています。

Dataset examples from the new project. Source: https://arxiv.org/pdf/2508.13065

このプロジェクトには、新しい包括的なペアデータセット;Odo、このデータでトレーニングされた生成拡散モデル;および、人間の形状編集のパフォーマンスを量的に評価するための新しいベンチマークが含まれます。テストでは、著者は、同等のモデルと比較して著しい進歩を主張しています。

新しい論文は、Odo: Depth-Guided Diffusion for Identity-Preserving Body Reshapingと題され、インドのバンガロールにあるFast Code AI Pvt. Ltd.の3人の研究者によって書かれています。

データと方法

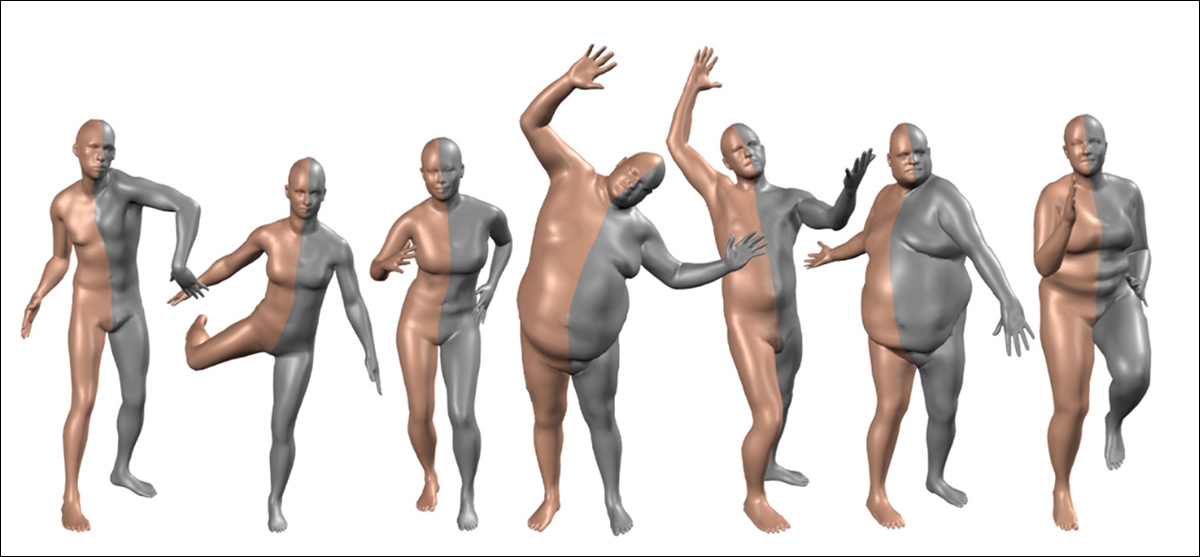

研究者によって作成されたデータセットには、各ターゲット体のタイプ(太い、細い、筋肉質)ごとに7,615個の高解像度(960x1280px)の画像が含まれています。

最初の1,523人の人間の顔は、12億パラメータの拡散モデルFLUX.1-devを介して生成されました。ただし、PexelsとUnsplashからの特定の数のライセンスフリーの参照顔画像を利用して、多様性を高めるために使用されました。

これらの顔画像を組み込んだフルボディ画像を生成するために、研究者は、2024年のByteDanceのオファーであるPuLIDを使用しました。これは、ベースのFluxを微調整し、顔のアイデンティティを変換プロセス中に保存するのに役立つ、対比ID損失を備えたものです。

Examples from the PuLID project. Source: https://arxiv.org/pdf/2404.16022

モデルは、顔画像と、性別、服、ポーズ、シーン、および太い、細い、または筋肉質な体のタイプを要求する標準化されたプロンプトを受け取りました。

各アイデンティティの3つの体のタイプの画像は、拡散モデルの確率的な動作により、背景の配置や主体のサイズの認識にわずかな違いが生じることがありました。ここで、各生成は新しいノイズシードから開始されます。プロンプトのわずかな変更、たとえば体のタイプの説明の変更は、潜在的な空間でモデルの軌道に影響を与え、視覚的な漂移を引き起こす可能性があります。

この変動を修正するために、4段階の自動ポストプロセスパイプラインが適用されました。各トリプレットの細い画像が参照として選択されました。なぜなら、その小さなシルエットがより多くの背景を露出させたからです。

人物検出は、RT-DETRv2を使用して実行され、SAM 2.1を使用してセグメンテーションが行われ、すべての3つの体のタイプの主体マスクを抽出します。細い参照画像は、背景をインペイントするために、より新しい画像編集システムであるFLUX.1 Kontext Proに渡され、主体を除いたクリーンなシーンのバージョンが生成されます。

太いと筋肉質のバリアントは、細い参照マスクの高さに一致するように、均一なスケーリングを使用してサイズ変更され、同じ下部の配置でクリーンな背景に合成され、すべての画像に一貫したフレーミングが保証されました。

著者は次のように述べています:

‘結果として得られる変換のトリプレット(細い、太い、筋肉質)は、同じ背景と一貫した主体のスケールを持っています。これにより、後のトレーニングや評価に悪影響を与える可能性のある不必要な変動が除去されます。’

各トリプレットの細い、太い、筋肉質の画像は、6つの可能な変換ペアを許可し、7,615のアイデンティティ全体で45,690の理論的な組み合わせが得られました。

不一致のある服、自然でないポーズ、歪んだ肢体、アイデンティティのドリフト、または最小限の形状の変更がある例をフィルタリングした後、18,573の高品質のペアが保持されました。いくつかの小さなポーズの違いは残ったものの、モデルはこれらの変動に対して頑健であることが証明されました。

トレーニングとテスト

結果として得られた画像は、Odoモデルをトレーニングするために使用されました。これは、Skinned Multi-Person Linear Model(SMPL、つまり中間のCGI)マップを使用する、人間を変形させるための拡散ベースのアプローチです。

2024年のNeural Localizerの方法に基づいて、データは個々のアイデンティティごとにSMPLフィギュアに適合され、生成された最適化パラメータは、後に変更された画像を生成するための深度マップを生成することができました。

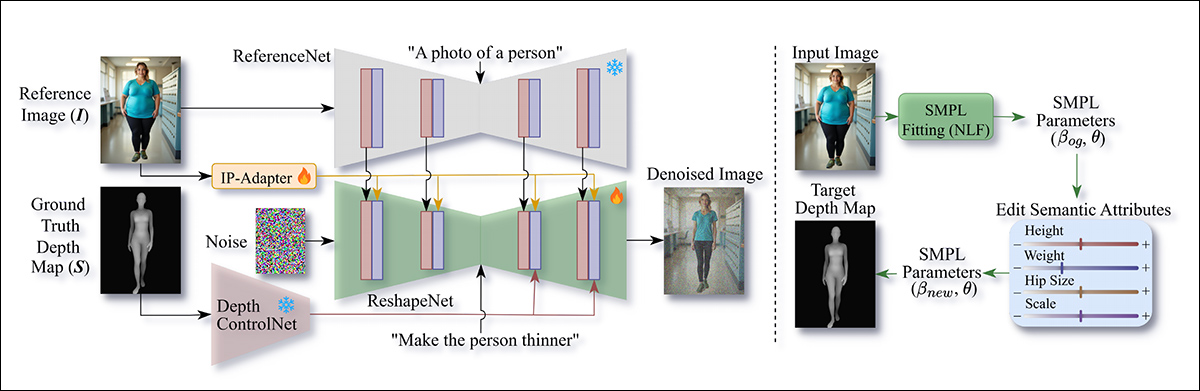

Schema for the training pipeline. The left side shows the training setup, where SMPL depth maps from the target image guide ReshapeNet via ControlNet to perform body transformation. Features from the source image are extracted by ReferenceNet and merged into ReshapeNet using spatial self-attention. The right side shows inference, where SMPL parameters are estimated from the input image, modified by semantic attributes, and rendered into a target depth map that conditions ReshapeNet during denoising, to produce the final transformed image.

モデル(上のスキーマを参照)は、ReshapeNetモジュールで構成されており、ReferenceNet、IP-Adapterモジュール、およびdepth-based ControlNetモジュールの3つの補助モジュールでサポートされています。

ReferenceNetは、背景、服、アイデンティティなどの詳細な特徴を入力画像から抽出し、ReshapeNetに渡します。IP-Adapterは、高レベルの特徴ガイダンスを提供し、Depth ControlNetは、SMPLベースの条件付けを適用して体の変換をガイドします。以前の作品や作品と同様に、SDXLベースのフリーズUNetが、中間特徴を抽出するために使用されました。

IP-Adapterモジュールについては、入力画像をCLIPを介してエンコードし、生成された埋め込みを、クロスアテンションを介してReshapeNetに統合します。

Depth ControlNetモジュールについては、ReshapeNetの中間およびデコーダーレイヤーを、残差接続を使用してガイドします。次に、SMPLパラメータからレンダリングされた深度マップを取り、ターゲット画像と一致させます。

ReshapeNetは、SDXL UNetに基づいており、Odoのコアネットワークです。トレーニング中、ターゲット画像は、変分オートエンコーダーを使用して潜在的な空間にエンコードされ、時間の経過とともにノイズが加えられ、そしてReshapeNetによってノイズが除去されます。ここで、ControlNetとReferenceNetからの特徴を使用してノイズが除去されます。

カテゴリ固有のテキストプロンプト(「太くしてください」、「細くしてください」、「筋肉質にしてください」など)は、変換を導くために追加されました。深度マップは、筋肉の定義などの変更に必要なセマンティック詳細を提供することで、変換の精度とリアリズムを高めることができます。

トレーニングの実装

Odoは、プロジェクトの合成データセットと、DeepFashion-MultiModalデータセットのサブセットの組み合わせでトレーニングされ、合計20,000の画像ペアが生成されました。

DeepFashion-MultiModalデータは、服や顔の特徴の多様性を提供し、画像はトレーニング中にそれ自体に対してペア化されました。すべてのSMPL深度マップは効率のために事前に計算され、トレーニングは80GBのVRAMを備えた単一のNVIDIA A100 GPUで60エポック実行されました。

入力画像は768×1024にリサイズされ、Adamオプティマイザが使用され、学習率は1×10⁻⁵でした。ReshapeNetは、SDXL UNetの重みで初期化され、IP-Adapterと共同で微調整されました。

ReferenceNetは、SDXLの重みで初期化され、凍結されました。Depth ControlNetは、事前トレーニング済みの重みを使用し、凍結されたままです。

最終的なモデルには約23GBのGPUメモリが必要で、単一の画像の推論には18秒かかりました。

新しいメトリック

この種のプロジェクトに必要なデータセットの欠如により、既存のメトリックはこの課題に十分に対応していません。したがって、著者は、3,600の画像ペアで構成される新しいベンチマークを設計しました。これには、実際の顔画像と背景の説明、およびさまざまな体の形状の変化が含まれています。

他の使用されたメトリックには、構造類似性指数(SSIM);ピーク信号対雑音比(PSNR);学習された感覚画像パッチ類似性(LPIPS);および、スケール補正された頂点ごとのユークリッド誤差(中立的ポーズ)(PVE-T-SC)が含まれます。

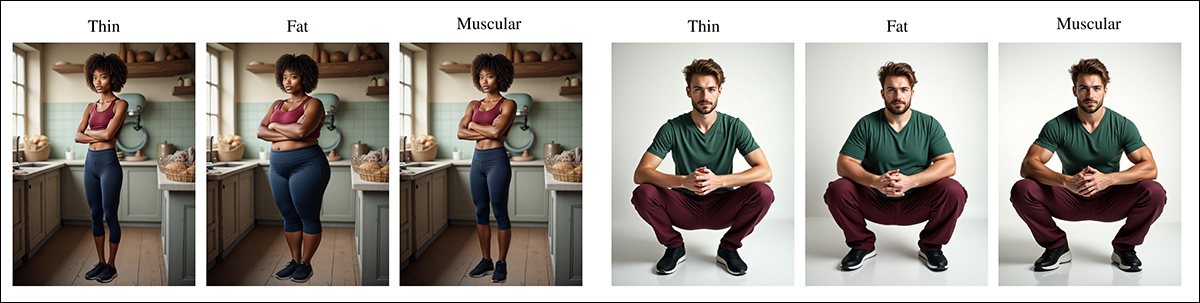

まず、著者は、トレーニング中にモデルに表示されなかった実世界の画像に対して、方法を質的にもテストしました。

Qualitative tests. The examples show conversions from the original image to thinner, overweight, and muscular body types across different poses, including sitting and standing. Please refer to the source paper for better definition and detail.

これらの結果について、論文では次のように述べられています:

‘[私たちの]方法は、多様なポーズ、背景、衣類を扱いながら、人物のアイデンティティを保持します。 ‘

‘SMPLターゲット形状に加えて、変換を明示的に導くためにテキストプロンプト(「太くしてください」、「細くしてください」、「筋肉質にしてください」など)を提供します…’

‘…'[下の画像]は、さらに私たちのモデルの、さまざまな形状の変換を実行する能力を示しています。モデルの結果は、SMPL深度マップに従って、参照画像からのさまざまなバージョンの細いものと太いものを生成することができます。’

<img class=" wp-image-222141" src="https://www.unite.ai/wp-content/uploads/2025/08/figure-1-3.jpg" alt="Further qualitative tests covering the range of target body types. Please refer to the source paper for better definition and detail.

” width=”934″ height=”239″ /> Further qualitative tests covering the range of target body types. Please refer to the source paper for better definition and detail.

著者はさらに次のように述べています:

‘結果は、ターゲットの重量に応じて、より現実的な変換を示しています。私たちのモデルは、全体的な体の形状、四肢の比例、衣類を同時に調整するため、解剖学的に一貫性があり、視覚的に説得力のある変更が行われます。’

量的テストのために、著者は、システムをオープンソースのFlux Kontext [dev]モデル、FLUX.1、および2022年のオファーであるStructure-Aware Flow Generation for Human Body Reshapingと比較しました。

FLUX.1 Kontext [dev]の場合、プロンプトは「太くしてください」、「細くしてください」、「筋肉質にしてください」というように設計され、ターゲットの重量が指定されました。ただし、微調整された制御の欠如はパフォーマンスを制限しました。

![Comparison of Odo with Structure-Aware Flow Generation for Human Body Reshaping and FLUX.1 Kontext [dev] on the test set, along with ablation results for models trained without prompt conditioning in ReshapeNet, without ReferenceNet (using only IP-Adapter), and with training restricted to the BR-5K dataset. The table also includes material related to ablation studies (BR-5K), which we are not covering here.](https://www.unite.ai/wp-content/uploads/2025/08/table-2-1.jpg)

Comparison of Odo with Structure-Aware Flow Generation for Human Body Reshaping and FLUX.1 Kontext [dev] on the test set, along with ablation results (not covered in this article) for models trained without prompt conditioning in ReshapeNet, without ReferenceNet (using only IP-Adapter), and with training restricted to the BR-5K dataset.

結論

この年、Flux Kontextの登場と、さらに最近、Qwen Image Editの非量子化された重みのリリースは、ペア画像データをコミュニティの前面に再び引き出しました。生成的なAIの精度に対する批判と不満が高まる中、入力ソース画像への忠実度が高いモデルは、より高い精度を目指して設計されています(ただし、小規模なモデルは、特定のトレーニング目標によって制限されることがあります)。

この場合、体の形状を変更するシステムの有用性は、心理学、医学、ファッションなどの分野にあると思われます。ただし、この種のシステムがより高いレベルの普及を達成し、よりカジュアルで、潜在的に懸念される使用法になる可能性もあります。

2025年8月25日月曜日初めて発行