Andersonの視点

AIによって生成された画像をHDRで明るくする

AI画像やビデオは印象的ですが、まだ『プロフェッショナル』スタンダードには達していません – これは、新しい研究プロジェクトが解決しようとしている問題です。

プロフェッショナルオーディオビジュアルコミュニティでは、AIの進出に対する最も頻繁な反対意見の1つは、現在のプロフェッショナルスタンダードの欠如です。画像やビデオの再生におけるこれらのスタンダードの1つは、High Dynamic Range(HDR)画像やビデオを扱う能力です。

HDR画像は、19世紀/20世紀の写真技術であるブラケット撮影の現代版です。ここでは、同じ写真を複数回、フィルムに達する光の量を増やして撮影します:

上、短いブラケットシーケンス。下、写真から抽出できる高ダイナミックレンジ。 ソース

伝統的な写真では、これにより複数の写真ができました。これらは、ある程度の専門知識と労力で、すべての露出レベルで利用可能な詳細のすべてを活用できる単一のプリントに組み込むことができました。しかし、これは簡単なプロセスではありませんでした。

これらの日々では、‘オートブラケット’画像シーケンスは、複数の画像を生成するか、単一のHDR画像に結合できます。実際には、1つの画像に複数の露出を組み込んだものです。HDR対応の画像編集アプリケーションであるPhotoshopなどのアプリケーションは、これらの画像を繰り返し処理し、写真家が1つの理想的な出力画像に編成できるようになります。

あなたが気づいていない場合は、あなた自身の写真撮影にどのように影響するか、またはなぜ気にする必要があるかを疑問に思うかもしれません。この記事のイラストは、このことを 친숙な方法で示しています:

上、左側には、典型的なsRGB(つまり、非HDR)画像が表示されます。ただし、明るくする(右側に表示)だけでは、クローゼットの中のモンスターは表示されません。なぜなら、写真家とカメラの自動化されたプロセスが写真の優先順位を決定したときに、その詳細は放棄されたからです。

以下は、非HDR写真でクローゼットモンスターを登録するために、前景がどれだけ『白飛び』していた必要があるか(左側)、および、代わりに前景の明るさに適した露出で撮影した場合、モンスターがどれだけ暗くなるか(右側)を示しています。

以下に、HDR画像または画像シーケンスから『救出』できる詳細を示します。この場合、モンスターはHDRシーケンスの最も低い視覚レジスターに『隠れて』いました。ここでは、他のコンテンツは『白飛び』に近いレベルになっていたでしょう。選択的に同じ画像内のさまざまな明るさレベルを表現することで、これらの不協和な要素を1つの論理的な画像に組み込むことができます。

非HDR画像は、表示参照画像として知られています。一方、ハイガムUT HDR画像は、シーン参照画像として知られています。

HDRビデオもあります。また、このようなトナルバースタイルと導管性は、映画製作者にフッテージを救い、グレードし、さまざまな創造的な方法で解釈するための多くの自由度を与えます。したがって、創造者がほとんどの生成AIフレームワークで一般的な『平坦化された』sRGB出力を扱うことを躊躇するのは驚くことではありません。

HDR in AI

自然に、研究シーンはAI生成フレームワークをHDR時代に導入しようとしています。しかし、これは、拡散ベースの生成システムの基本的なアーキテクチャと、良いHDRデータが多くのディスクスペースを占めるため、扱いにくいコレクションになるという2つの理由で、容易なタスクではありません。したがって、タスクに適したデータセットは希少です。

しかし、シンガポールの大学とAdobe Researchの共同研究により、HDR画像シーケンスを生成する方法が提案されています。この方法論は理論的にビデオにも適用できます。

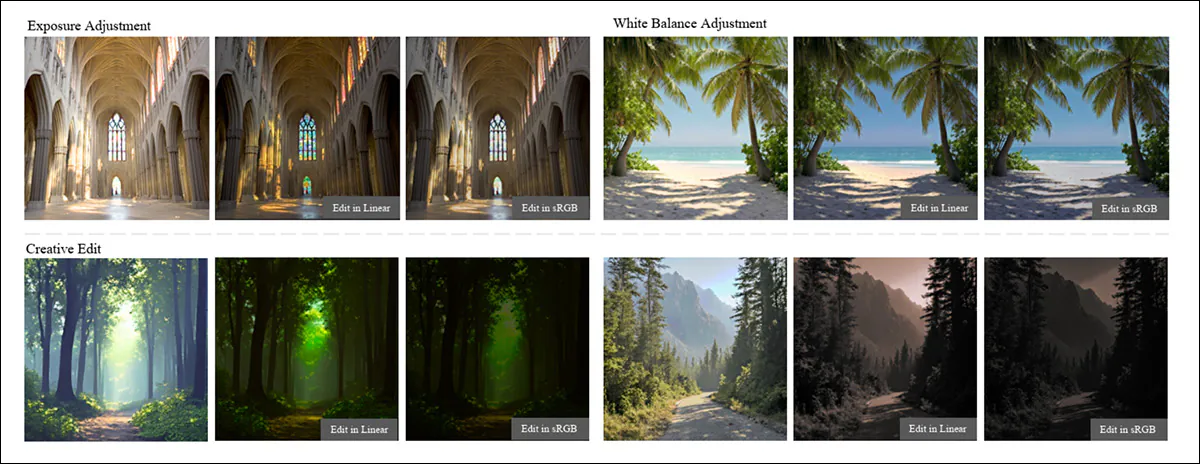

新しい研究のプロジェクトサイトからの、テキストから画像への『ブラケット化』出力の例。 ソース

新しいシステムは、同じ画像の異なる明るさレベルで複数の整列バージョンを生成し、シーンが実際にどれほど明るいかを学習し、これらを1つの結果に組み合わせて、後で露出や色の編集を実行できるようにします。実際のカメラキャプチャへの調整のように動作し、完全に処理された画像への繊細な調整のように動作しません。

システムは、QwenやFluxのバリアントを含む、さまざまなモデルを利用しています。

新しい論文からの例、同じシーンの複数の露出バージョンを生成する方法を示しています。シンプルなエッジマップから開始して、モデルは非常に暗いから非常に明るい設定まで、一貫した画像を生成します。モンスター、日光、日没、または小さな物体のようなバルーンを含む、プロンプトが記述するものに関係なく、主題と構成は明るさが変化しても安定しています。方法は、カメラのように制御された方法で明るさを変化させることができます。新しいコンテンツを発明したり漂白したりするのではなく、露出が変化するにつれて。 ソース

著者は次のように述べています:

‘線形画像を生成することは難しいです。事前トレーニングされたVAEは、潜在的な拡散モデルで極端なハイライトとシャドウを同時に保存するのに苦労するからです。ダイナミックレンジとビット深度が高いためです。

‘この目的のために、線形画像を露出ブラケットのシーケンスとして表現し、テキスト条件付き露出ブラケット生成のためのDiTベースのフローメッチングアーキテクチャを提案します。

‘さらに、テキストガイド付き線形画像編集やControlNetを介した構造条件付き生成を含むダウンストリームアプリケーションを示します。

新しい研究は、露出ブラケットの合成による線形画像生成と題されています。S-Lab at Nanyang Technological University、Adobe NextCam、Adobe Researchの4人の著者から来ています。プロジェクトページとYouTubeビデオのほか、現在は空ですが、GitHubリポジトリもあり、データセットのリリースも約束されています。

著者はプロジェクトページにシステムからの多くの例を提供していますが、読者がHDR対応モニターを持っていない場合、HDR出力の特性を区別する必要があります。ただし、研究者のYouTube概要は、この記事の末尾に埋め込まれています。ただし、表示される例の違いは、HDR対応モニターでなければ明確に表示されない可能性があります。

方法とデータ

著者は、データ収集がこの特定の追求における課題であることを強調しています:

‘大量の線形画像を取得することは、実践では非常に困難です。また、大多数のパブリックHDRデータセットは、パノラマ(ほとんど大規模なシーンコンテンツに焦点を当てている)であるか、真の線形画像を提供していないため、我々の目的には適していません。

‘したがって、我々は主にRAW画像データセットをトレーニングの基礎として使用します。

研究者は、利用可能な選択肢を創造的に活用し、RAISEデータセットを実際のトレーニングデータとして使用し、MIT-Adobe FiveKデータセットを評価データとして使用しました。

HDRトレーニングデータを構築するために、研究者はRAWカメラファイルを標準化されたパイプラインで処理して、カメラ固有の特性を取り除き、画像を一貫したシーン参照線形形式に変換しました。

システムのワークフローのスキーマ: システムは、同じシーンの4つの露出レベルのノイズ、テキストプロンプト、明るさトークンから開始します。これをスタック化されたトランスフォーマーブロックで処理して、露出を調整しながら、さまざまな露出を整列させます。すると、露出画像のセットと全体的な明るさスケールを予測し、後にそれらを単一のシーン参照画像に解码して組み合わせ、シャドウとハイライトの両方で詳細を保持します。

これには、フルRGBをセンサーデータから再構築し、カラーコレクションを適用し、ホワイトバランスを正規化し、ノイズ除去のために一時的に感覚色空間に移動し、そしてクリーンな線形シグナルに戻すことが含まれます。カメラの露出設定を使用して、シーンの実際の光を回復し、各ピクセルが実際の明るさを反映するようにします。

これらの値は広範囲にわたる可能性があるため、データは各画像の明るさ分布に基づいてスケーリングされて安定化され、ミッドレンジとハイライト統計を使用して、洗い出した画像と吹き飛んだハイライトの両方を避け、シーンの実際の明るさ範囲を保持しながらトレーニングに十分な安定した線形画像が得られました。

画像のテキストラベルは、Qwen2.5-VL 7Bモデルで生成され、プロンプトは生成時に使用されるFluxモデルと一致するように作成されました。

各画像は露出『スライス』に分割され、共有されたVAEエンコーダーを通過して、すべての露出を共通の潜在空間に変換し、完全な明るさ範囲を捉えるように設計されました。潜在的なものはノイズから精製され、画像に戻され、暗い地域と明るい地域の両方で一貫した再構築を可能にしました。

LoRAファインチューニングは、事前トレーニングされたFluxバックボーンを線形画像データに最小の追加パラメータで適応させるために使用され、Single-Diffusion Transformers(single-DiT)モデルが露出ブラケットが変化するにつれても安定していることを助けました。

露出制御セルフアテンション(上のスキーマイラストの中央列)が導入され、すべてのブラケットを共同で処理することができ、明るさを露出ごとに調整しながら、構造と細部を整列させました。

3Dロータリーポジショナル埋め込み(3D-R[o]PE)は、空間位置と露出IDの両方を符号化するために使用され、モデルが各トークンがどのブラケットに属するかを区別しながら、空間的一貫性を保持することができました。

研究で使用されたデータセットの概要。コンテンツタイプや室内/室外シーンの分布、データの明るさ値の分布が示されています。ヒストグラムは明るさと放射度スケールを対数空間でプロットし、現実世界の明るさがどれほど広範囲にわたるかを示し、高い放射度値は物理的に明るいシーンに対応し、モデルが処理する強いダイナミックレンジを強調しています。

3D-RoPEは、どこに特徴があるかと、どの露出から来ているかを別々の信号に分割し、明るさの変化を独立して調整できるようにしました。空間詳細を汚染することなく。

テスト

研究者は、Flux-devを生成フレームワークとして使用しました。トレーニングは、80GBのVRAMを備えた4つのNVIDIA A100 GPUで実行されました。バッチサイズは、1つのGPUあたり4に設定され、10,000イテレーションで実行されました。

LoRAファインチューニングには、ランク64が使用されました。 AdamWオプティマイザは、露出制御アスペクトの学習率2×102で使用されました。

著者は、スコープが似ている2つの先行研究があるが、どちらもテスト段階では明らかな候補ではなかったと述べています。マックスプランク研究所が主導する2022年の研究であるGlowGANは、特定の画像カテゴリの生成に限定されています。一方、2025年のブラケット拡散(マックスプランク研究所が主導)は、256x256pxのHDR画像のみを生成でき、処理に数分かかります。

元のGlowGAN論文からの、典型的な低ダイナミックレンジ(LDR)画像はシャドウとハイライトで詳細を失うが、モデルは明るさレベル全体で詳細を保持するHDRバージョンを生成し、逆トーンマッピングを介して飽和された領域の回復を可能にします。 ソース

したがって、線形画像生成の直接的なベースラインがないため、著者は、既存の強力なモデルを適応させたものと比較しました。

一連の実験(‘T2Iファインチューニング’)では、LoRAを使用して、テキストから画像への拡散モデルFluxをファインチューニングし、線形画像を直接生成するようにトレーニングし、T2Iモデルがこのドメインに適応する方法を評価しました。

2番目の比較(‘T2Vファインチューニング’)では、テキストからビデオへのモデルWan 2.1を使用しました。ここでは、VAEは複数のフレームを共有の潜在的な表現に圧縮します。ここでは、4つの露出ブラケットを単一の潜在的な表現に符号化し、テキストからビデオパイプラインが露出の変化をモデル化できるかどうかをテストしました。

3番目の実験(‘T2Iモデルインフレーション’)では、CameraCtrlとGenerative Photographyと比較しました。これらは、テンポラルモジュールを介して画像拡散モデルを拡張して、複数のフレーム出力を生成します。これらも同じデータでファインチューニングされ、比較のために一貫性があります。

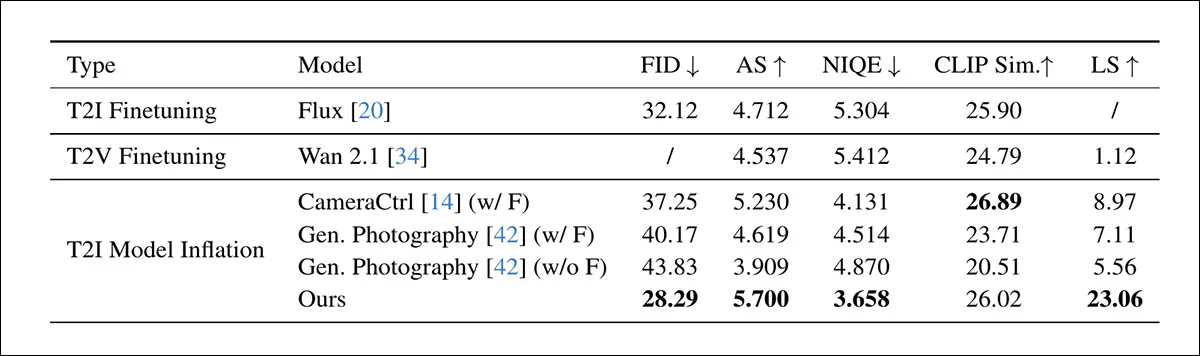

使用されたメトリックは、Fréchet Inception Distance(FID);美的スコア(AS);自然性画像品質評価器(NIQUE);CLIPシムスコア;および明るさ類似性(LS)でした。

著者が提案する方法と、線形シーン参照画像を生成するためのいくつかの適応ベースラインとの比較。テキストから画像(Flux)とテキストからビデオ(Wan 2.1)モデルは、LoRAでファインチューニングされてこの設定をテストするために使用され、CameraCtrlとGenerative Photographyは拡散モデルをテンポラルコンポーネントで拡張します。いくつかのスコアは欠けているため、特定のモデルは一貫した露出ブラケットを信頼性高く生成できないため、フルダイナミックレンジを回復する必要があります。報告されたメトリック全体で、提案された方法は、特に画像品質と明るさの再構築に関連するメトリックで最も強い結果を達成します。

著者は、これらの結果について次のように述べています:

‘線形データで直接T2Iモデルをファインチューニングすると、シャドウとハイライトの詳細のバランスを取るのが難しいです。T2Iモデルインフレーション方法は、ダイナミックレンジが限られているだけでなく、ファインチューニング後も画像品質が大きく低下します。

‘T2Vファインチューニングの場合、Wan 2.1の4倍のテンポラルダウンサンプリングにより、4つの露出ブラケットが単一の潜在的な表現に絡み合い、ファインチューニングのみでは解決できない重大な分布の不一致が生じます。

‘シーン参照特性を露出ブラケットを使用して直接モデル化することで、我々の方法は、すべてのベースラインで優れた視覚的な品質とダイナミックレンジを達成します。

LoRA適応FluxとWan 2.1と比較して、各方法が同じシーンに対する露出の変化をどのように処理するかを示す。競合するアプローチは、非常に暗いまたは非常に明るい領域で詳細を失う傾向がありますが、提案された方法は、露出の全範囲で一貫した構造と詳細を保持します。より高品質の結果例については、ソース論文とプロジェクトサイトを参照してください。

ソース論文の拡張実験と補足資料セクションにさらにテストが記載されています。

結論

メディアプロフェッショナル、たとえば映画やテレビ制作で働く人々にとって、世界を魅了し(そして、増加するほど)、怒らせている同じ出力は、彼らにとっては無関心です。なぜなら、彼らのほとんどのパイプラインは、ある程度、HDRキャプチャに依存しているからです。

したがって、このプロジェクトは適切なタイミングで実施されており、将来的には、新しいフレームワーク全体でオプションのスタンダードになる可能性があります。ただし、レンダリング時間は確実に2倍になるでしょう。明らかに、HDR AIコンテンツが『ポストプロダクション』ではなく『インカメラ』カテゴリに留まらないように、待ち時間は深刻に取り組む必要があります。

* 通常、例を示しますが、読者がHDR対応モニターを持っていない可能性があるため、この場合は省略します。

2026年4月26日、日曜日に初めて公開されました。