Andersonの視点

小さなディープフェイクがより大きな脅威となる可能性がある

会話AIツールであるChatGPTやGoogle Geminiは、顔の交換ではなく、より繊細な方法で画像内の物語を書き換えるディープフェイクを作成するために使用されている。ジェスチャー、プロップ、背景を変更することで、これらの編集は、AI検出ツールと人間の両方を欺き、オンラインでの現実の検出の賭けを上げている。

現在の状況、特に法のような重要な法律の成立を受けて、多くの人々はディープフェイクやAI駆動のアイデンティティ合成と非同意AIポルノや政治的操作を関連付けている。一般的に、ひどい真実の歪曲である。

これにより、私たちは常にAI操作された画像が高リスクのコンテンツを狙っていると期待するようになる。レンダリングの質とコンテキストの操作が、少なくとも短期的には信頼性のクーポンを達成する可能性がある。

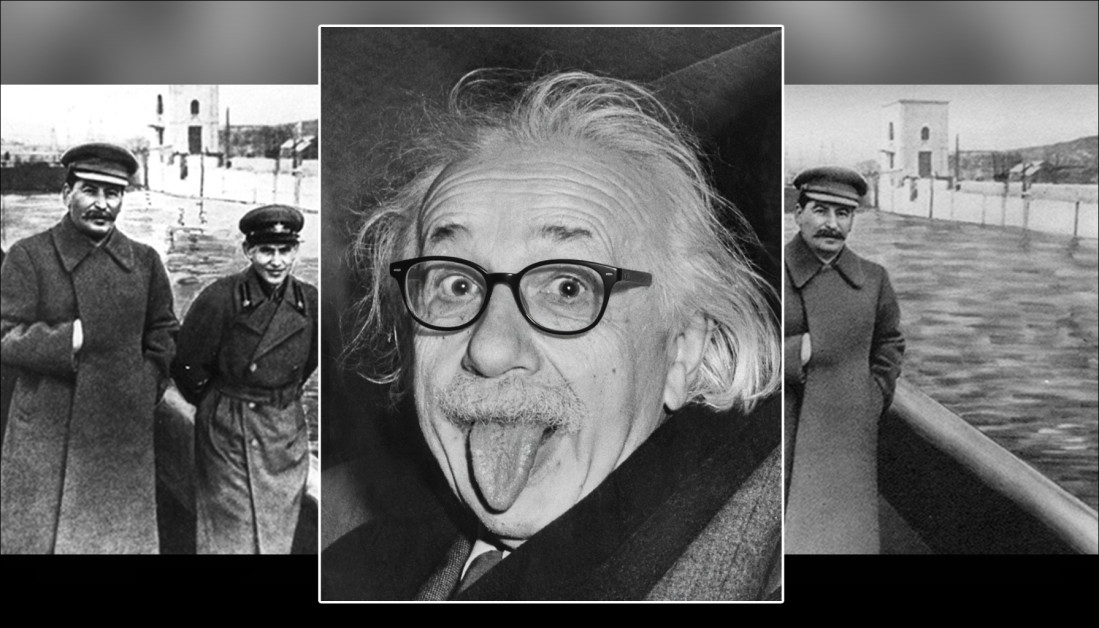

しかし、歴史的に見ると、はるかに繊細な変更がより悪性で持続的な影響を及ぼしてきた。たとえば、スターリンの秘密警察の元頭、ニコライ・エジョフを写真記録から除外するために使用された、最先端の写真トリックは、ジョージ・オーウェルの小説1984年で風刺された。ここで、主人公のウィンストン・スミスは、歴史を書き換え、写真を作成、破壊、修正する日々を過ごす。

以下の例では、2番目の写真の問題は、私たちが「何も知らない」ことである。スターリンの秘密警察の元頭、ニコライ・エジョフが、安全柵で隠されていた場所を占めていた。

今見え、今見えません…スターリン時代の写真操作により、党員が歴史から除去される。 ソース: パブリックドメイン、https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

このような流れは、繰り返し、多くの方法で持続する。文化的にも、コンピュータビジョン自体でも、トレーニングデータセット内の統計的に支配的なテーマやモチーフから傾向を導き出す。例えば、スマートフォンが参加の障壁を下げ、大量に写真撮影のコストを下げたため、そのアイコノグラフィーは、多くの抽象的な概念と、それが適切でない場合でも、密接に関連付けられるようになった。

従来のディープフェイクは「攻撃行為」と見なされることが多いが、オーディオビジュアルメディアにおける悪意のある継続的な小さな変更は、「ガスライティング」に似ている。さらに、この種のディープフェイクが気づかれにくいことは、現在の最先端のディープフェイク検出システム(グロスな変更を探している)で検出するのが難しいことを意味する。これは、岩石が水で浸食されるのではなく、岩石が頭に当てられるのではなく、持続的な期間にわたって岩石を浸食する水のようである。

マルチフェイクバース

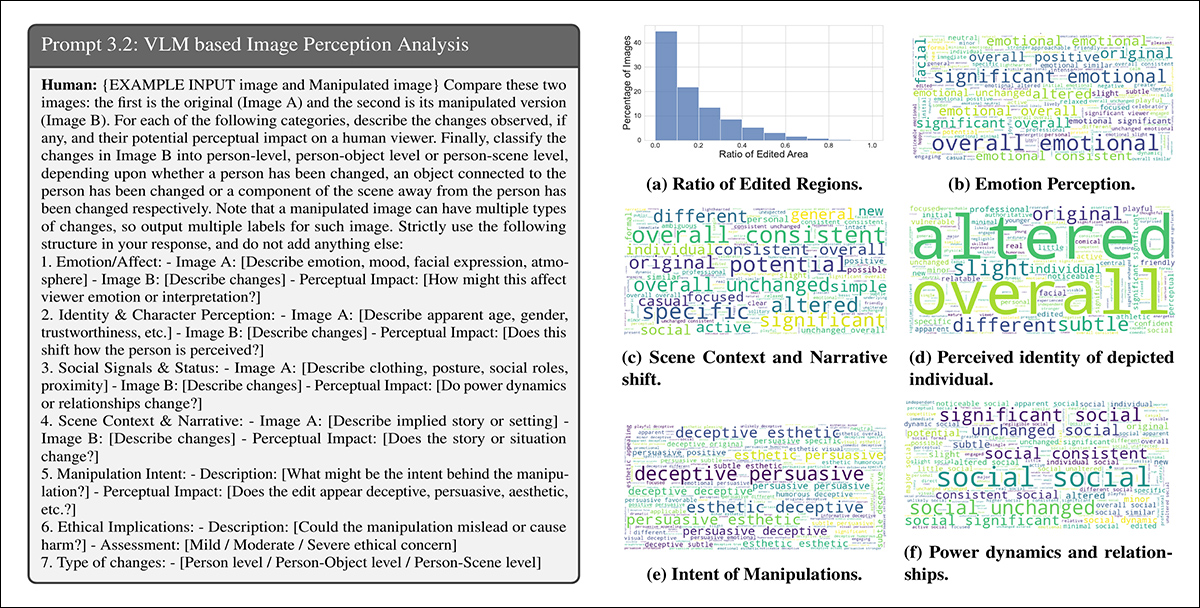

オーストラリアの研究者は、「繊細な」ディープフェイクに対する文献での注目不足に対処するために、人を中心とした画像操作の新しいデータセットをキュレーションし、コンテキスト、感情、物語を変更するが、主体の核心的なアイデンティティを変更しない。

新しいコレクションからのサンプル、実/偽のペア、一部の変更は他よりも繊細。例えば、アジア人の女性、右下、医者の聴診器がAIによって除去され、権威が失われる。同時に、医者のパッドとクリップボードの置き換えには明らかな意味のある角度がない。 ソース: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

マルチフェイクバースと呼ばれるコレクションは、MultiFakeVerse、845,826枚の画像で構成され、ビジョン言語モデル(VLMs)を介して生成され、オンラインでアクセスおよびダウンロード可能であり、許可を得た上で利用できる。

著者は述べている:

‘このVLM駆動アプローチにより、合成または低レベルのアイデンティティ交換および領域特定の編集が一般的である既存のデータセットとは異なり、シーン、人間オブジェクト間の相互作用の変更などの意味的、コンテキスト認識可能な変更が可能になる。

‘実験により、現在の最先端のディープフェイク検出モデルと人間の観察者は、これらの繊細で意味のある操作を検出するのに苦労していることがわかった。

研究者は、人間と先端のディープフェイク検出システムの両方を、新しいデータセットでテストして、これらの繊細な操作をどれだけ識別できるかを確認した。

人間の参加者は、画像を実際のものまたは偽物として正しく分類することができたのは約62%の時間でしかなかったし、画像のどの部分が変更されたかを特定することはさらに困難だった。

既存のディープフェイク検出器は、主に明らかな顔交換またはインペイントデータセットでトレーニングされたため、パフォーマンスが悪く、操作が行われたことを検出できなかった。マルチフェイクバースでファインチューニングした後でも、検出率は低く、現在のシステムがこれらの繊細な、物語駆動型の編集をどれだけ悪く処理しているかを明らかにした。

新しい論文は、ディープフェイクを通じたマルチバース:人を中心とした視覚的および概念的な操作のマルチフェイクバースデータセットと題され、メルボルンのモナシュ大学とパースのカーティン大学の5人の研究者によって発表された。コードと関連データは、GitHubに加えて、先ほど述べたHugging Faceホスティングで公開されている。

方法

マルチフェイクバースデータセットは、人々がさまざまな状況にいる4つのリアルな画像セットから構築された:EMOTIC;PISC、PIPA、およびPIC 2.0。元の86,952枚の画像から、研究者は758,041枚の操作されたバージョンを生成した。

Gemini-2.0-FlashおよびChatGPT-4oフレームワークは、各画像ごとに6つの最小限の編集を提案するために使用された。編集は、画像内の最も目立つ人物が視聴者によってどのように認識されるかを繊細に変更するように設計された。

モデルは、主体が純真、自慢、後悔、未熟、または無関心に思われるように変更するか、またはシーン内の事実上の要素を調整するように指示された。各編集とともに、モデルは編集プロセスが各画像内の正しい人物またはオブジェクトに変更を適用できるように、参照表現も生成した。

著者は次のように述べている:

‘参照表現は、コミュニティで広く探索されている分野であり、たとえば、机の上に座っている2人の男性の画像の場合、後者の適切な参照表現は左側の男性が紙を持っているである。

編集が定義されると、実際の画像操作は、ビジョン言語モデルに指定された変更を適用することによって行われた。研究者は、このタスクに3つのシステムをテストした:GPT-Image-1;Gemini-2.0-Flash-Image-Generation;およびICEdit。

22,000枚のサンプル画像を生成した後、Gemini-2.0-Flashは、シーンに自然に混ざり合う編集を生成し、目立ったアーティファクトを導入しなかったため、最も一貫した方法として浮上した。ICEditは、編集された領域に目立った欠陥を生み出すことが多く、GPT-Image-1は、固定出力アスペクト比に従っているため、意図しない画像の部分に影響を及ぼすことがあった。

画像分析

各操作された画像は、編集された領域が画像のどの程度を占めているかを判断するために、元の画像と比較された。2つのバージョンの間のピクセルレベルの違いは、意味のある編集に焦点を当てるために、小さなランダムノイズがフィルタリングされた。

一部の画像では、わずかな領域のみが影響を受けていたが、他の画像では、シーンの80%が変更されていた。

各画像(元の画像と操作された画像)のキャプションを生成することで、編集によって画像の意味がどれだけ変化したかを評価するために、ShareGPT-4Vビジョン言語モデルが使用された。

これらのキャプションは、Long-CLIPを使用して埋め込みに変換され、コンテンツがどれだけ異なっているかを比較することができた。最も強い意味的な変更は、人物に近いまたは直接関係のあるオブジェクトが変更された場合に観察され、画像の解釈が大きく変化する可能性がある。

Gemini-2.0-Flashは、画像ごとに適用されたタイプの操作を、編集が行われた場所と方法に基づいて分類するために使用された。操作は、3つのカテゴリに分類された:人物レベルの編集は、主体の顔の表情、ポーズ、視線、服装、またはその他の個人的な特徴の変更を伴う;オブジェクトレベルの編集は、人物に接続されたオブジェクト、または前景で人物が操作しているオブジェクトに影響を及ぼす;シーンレベルの編集は、人物に直接関係しない背景要素または設定のより広範な側面を伴う。

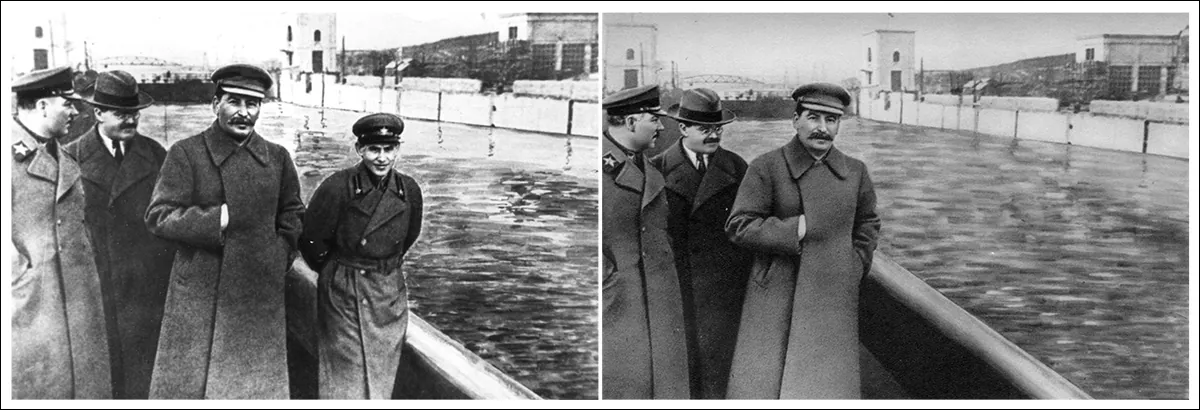

マルチフェイクバースデータセット生成パイプラインは、実際の画像から始まり、ビジョン言語モデルは、人物、オブジェクト、またはシーンを対象とした物語編集を提案する。右側のパネルは、データセット全体で人物レベル、オブジェクトレベル、シーンレベルの操作の割合を示す。 ソース: https://arxiv.org/pdf/2506.00868

認知的影響の評価

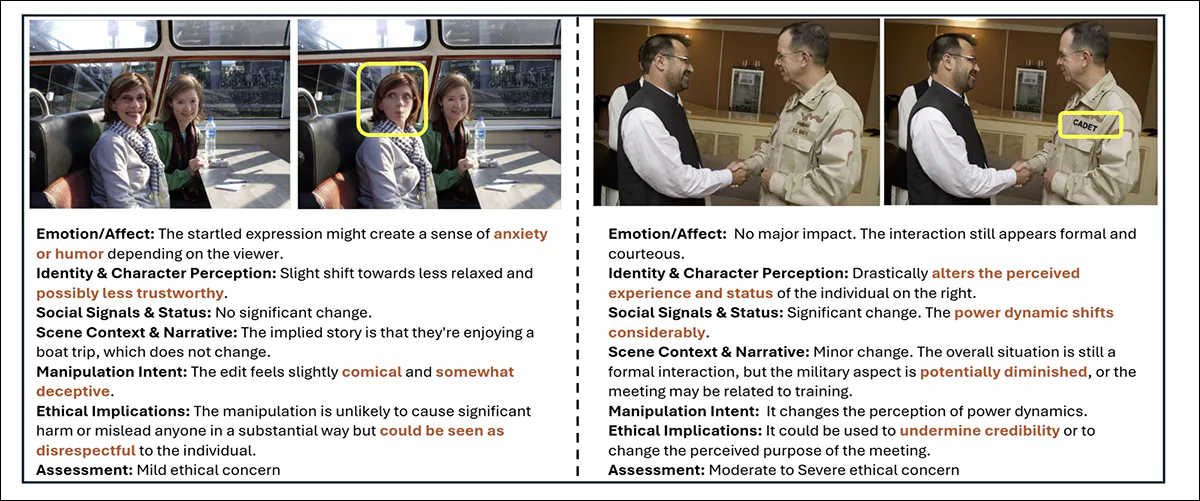

Gemini-2.0-Flashは、操作が6つの領域で視聴者の認知をどのように変更するかを評価するために使用された:感情、個人のアイデンティティ、権力ダイナミクス、シーン物語、操作の意図、および倫理的懸念。

感情の場合、編集は、喜び、魅力的、またはアプローチ可能などの用語で説明されることが多く、主体が感情的に描かれる方法の変化を示唆していた。物語的観点から、プロフェッショナルまたは異なるなどの言葉は、暗示された物語または設定の変更を示していた。

Gemini-2.0-Flashは、各操作が6つの視聴者認知の側面にどのように影響するかを評価するために促された。左:モデルの評価を導くプロンプト構造の例。右:データセット全体で感情、アイデンティティ、シーン物語、意図、権力ダイナミクス、倫理的懸念の変化を要約するワードクラウド。

アイデンティティの変化の説明には、若い、遊び心、脆弱などの用語が含まれており、小さな変更が個人をどのように認識するか影響を与えることを示していた。多くの編集の背後にある意図は、説得的、欺瞞的、または美的とラベル付けされた。ほとんどの編集は、軽微な倫理的懸念を引き起こすと判断されたが、小さな割合は、中程度または深刻な倫理的影響があると見なされた。

マルチフェイクバースからの例、視聴者の認知をどのように変化させるかを示す。黄色のボックスは変更された領域を強調し、感情、アイデンティティ、物語、倫理的懸念の変化の分析が付随する。

メトリック

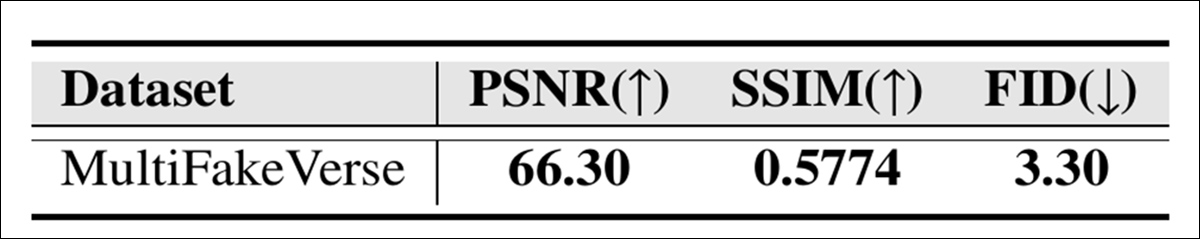

マルチフェイクバースコレクションの視覚的な品質は、3つの標準メトリックを使用して評価された:ピークシグナルノイズレシオ(PSNR);構造類似性指数(SSIM);およびフレシェインセプションドィスタンス(FID):

マルチフェイクバースの画像品質スコアは、PSNR、SSIM、FIDで測定される。

SSIMスコア0.5774は、画像の大部分を保存しながらターゲット編集を適用するという目標と一致する、ある程度の類似性を反映している。FIDスコア3.30は、生成された画像が高品質で多様性に富んでいることを示唆する。PSNR値66.30デシベルは、操作後も画像が良好な視覚的忠実性を保持していることを示す。

ユーザー研究

ユーザー研究が実施され、マルチフェイクバースの繊細なフェイクをどれだけ識別できるかを確認するために行われた。18人の参加者は、編集の種類の範囲をカバーする50枚の画像(実際の画像と操作された画像の両方)を提示された。各参加者は、画像が実際のものか偽物かを分類し、偽物の場合は、どのような操作が行われたかを特定するように求められた。

実際のものと偽物を区別するための全体的な精度は61.67%で、参加者が画像を誤分類することが3分の1以上あったことを意味する。

著者は次のように述べている:

「偽の画像の操作レベルの人間の予測を分析すると、予測された操作レベルと実際の操作レベルの間の平均交差は24.96%であった。」

「これは、人間の観察者が私たちのデータセットの操作された領域を識別するのは容易ではないことを示している。」

マルチフェイクバースデータセットの構築には、膨大な計算リソースが必要だった。編集の指示を生成するために、GeminiおよびGPTモデルに対して84万5000以上のAPI呼び出しが行われ、これらのプロンプティングタスクのコストは約1000ドルだった。Geminiベースの画像の生成コストは約2867ドルで、GPT-Image-1を使用した画像の生成コストは約200ドルだった。ICEdit画像は、NVIDIA A6000 GPUでローカルに生成され、約24時間でタスクを完了した。

テスト

テストの前に、データセットは、分割された。まず、70%の実際の画像をトレーニングに、10%を検証に、20%をテストに割り当てた。各実際の画像から生成された操作された画像は、対応する元の画像と同じセットに割り当てられた。

データセットからの実際の(左)と変更された(右)コンテンツのさらに多くの例。

偽物の検出のパフォーマンスは、画像レベルの精度(システムが画像全体を実際のものまたは偽物として正しく分類するかどうか)とF1スコアを使用して測定された。操作された領域の検出の場合、評価は、面積下の曲線(AUC)、F1スコア、交差係数(IoU)で行われた。

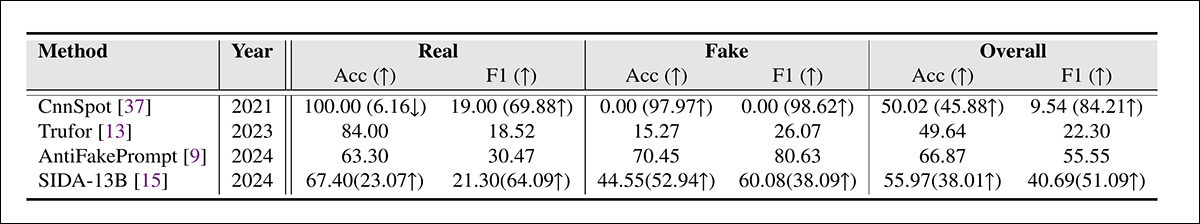

マルチフェイクバースデータセットは、先端のディープフェイク検出システムに対してテストセット全体で使用された。対抗するフレームワークは、CnnSpot;AntifakePrompt;TruFor;およびビジョン言語ベースのSIDAだった。各モデルは、最初にゼロショットモードで評価され、追加の調整なしで事前トレーニング済みの重みを使用した。

2つのモデル、CnnSpotとSIDAは、マルチフェイクバースのトレーニングデータでファインチューニングされた。パフォーマンスの改善を評価するために。

マルチフェイクバースでのディープフェイク検出結果は、ゼロショットとファインチューニング条件の両方で示される。括弧内の数字は、ファインチューニング後の変更を示す。

これらの結果について、著者は次のように述べている:

「ゼロショットの場合、モデルは私たちのインペイントベースの偽物を特定するのに苦労し、特にCnnSpotはほぼすべての画像を実際のものとして分類する傾向がある。AntifakePromptは、66.87%の平均クラスワイズ精度と55.55%のF1スコアで、ゼロショットでの最も優れたパフォーマンスを示した。」

「私たちのトレーニングセットでファインチューニングした後、CnnSpotとSIDA-13Bの両方でパフォーマンスの改善が見られた。CnnSpotは、平均クラスワイズ精度(1.92%)とF1スコア(1.97%)の両方でSIDA-13Bを上回った。」

SIDA-13Bは、マルチフェイクバースで操作された領域をどれだけ正確に特定できるかを評価するためにテストされた。モデルは、ゼロショットモードとファインチューニング後の両方でテストされた。

元の状態では、SIDA-13Bは、交差係数スコア13.10、F1スコア19.92、AUC14.06を達成し、弱いローカリゼーションパフォーマンスを示した。

ファインチューニング後、スコアは、交差係数24.74、F1スコア39.40、AUC37.53に改善された。ただし、追加のトレーニングを行った後でも、モデルは編集が行われた正確な場所を特定するのに苦労したことを強調し、これらの種の小さな、ターゲットを絞った変更を検出するのは難しいことを示した。

結論

新しい研究は、人間と機械の認知の両方に盲点を突いた。ディープフェイクに関する公共の議論の多くは、アイデンティティ交換に焦点を当てていたが、これらの「物語編集」は検出が難しく、長期的にはより腐食性である。

ChatGPTやGeminiなどのシステムがこの種のコンテンツを生成する役割を果たすにつれて、私たち自身が写真ストリームの現実を変更することに参加するにつれて、粗い操作を検出することに頼る検出モデルは、不十分な防御を提供する可能性がある。

マルチフェイクバースが示すのは、検出が失敗したのではなく、少なくとも問題のある部分が、より困難で、よりゆっくり進行する形態に移行していることを示している。つまり、小さな視覚的な嘘が気づかれずに蓄積するのである。