人工知能

ニューラルレンダリング: NeRFが新鮮な空気の中を歩く

Google Researchとハーバード大学の共同研究により、Neural Radiance Fields (NeRF)を使用して、完全なシーンの360度ニューラルビデオを作成する新しい方法が開発されました。この新しいアプローチにより、NeRFは、テーブルモデルや閉じた室内シナリオに制限されることなく、どの環境でもカジュアルに抽象的に使用できるようになりました。

記事の末尾にフルビデオを参照してください。 Source: https://www.youtube.com/watch?v=YStDS2-Ln1s

Mip-NeRF 360は、拡張バックグラウンドや「無限」のオブジェクト(例:空)を処理できるようになりました。なぜなら、従来のNeRFとは異なり、光線の解釈方法に制限を設け、長いトレーニング時間を合理化する注意の境界を作成するからです。この記事の末尾に埋め込まれた新しいビデオを参照して、より多くの例やプロセスについての詳細な洞察を得てください。

新しい論文のタイトルは、Mip-NeRF 360: Unbounded Anti-Aliased Neural Radiance Fieldsで、Google Researchのシニアスタッフ研究科学者であるJon Barronが主導しています。

このブレークスルーを理解するには、Neural Radiance Fieldベースの画像合成がどのように機能するかを基本的に理解する必要があります。

NeRFとは何か?

NeRFネットワークを「ビデオ」として説明することは難しいです。なぜなら、NeRFは、単一の写真(およびビデオフレーム)から複数の視点を使用してシーンを組み立てる、完全に3Dで実現されたが、AIベースの仮想環境に近いからです。この環境は、機械学習アルゴリズムの潜在的な空間でしか存在せず、しかし、そこから、多数の視点やビデオを自由に抽出することができます。

NeRFがニューラルシーン(右側の画像)を組み立てるためにデータを提供する複数のカメラキャプチャポイントの描写。

寄与写真から得られた情報は、伝統的なボクセルグリッドに似た行列にトレーニングされます。ここで、3D空間の各点には値が割り当てられ、シーンがナビゲーション可能になります。

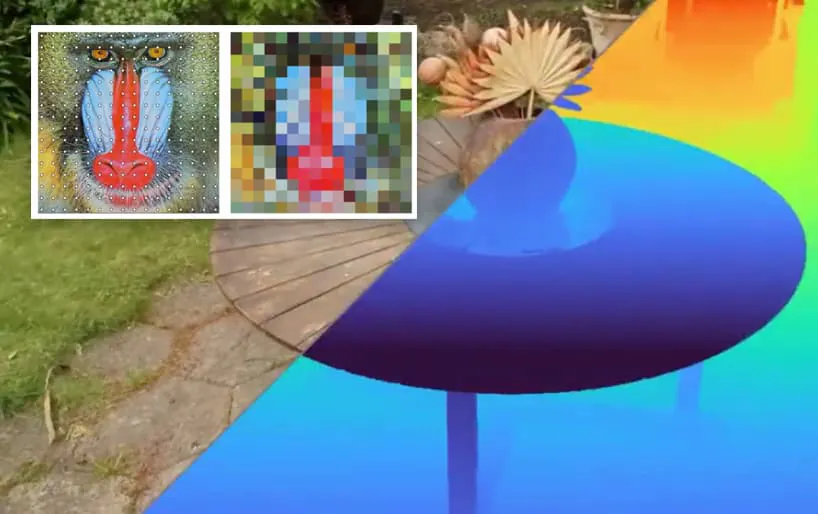

伝統的なボクセルマトリックスは、通常2Dコンテキスト(例:JPEGファイルのピクセルグリッド)にあるピクセル情報を3次元空間に配置します。 Source: ResearchGate

写真間の間隔空間(必要に応じて)を計算した後、各寄与写真の可能なピクセルのパスは、実質的に「レイトレース」され、色値(不透明度値を含む)が割り当てられます。

ボクセルグリッドと同様に、CGIベースの3D座標空間とは異なり、NeRFマトリックスには「閉じた」オブジェクトの「内部」は存在しません。CGIではドラムキットを割って内部を見ることができますが、NeRFでは、ドラムキットの表面の不透明度値が「1」に等しいときに、ドラムキットの存在は終了します。

ピクセルのより広い視点

Mip-NeRF 360は、2021年3月の研究の拡張であり、NeRFに効率的なアンチエイリアシングを導入しました。

従来のNeRFは、1つのピクセルパスのみを計算し、早期のインターネット画像形式や以前のゲームシステムで見られた「ジャギー」と呼ばれる現象を生み出す傾向があります。これらのジャギーは、通常、隣接するピクセルをサンプリングし、平均表現を見つけることによって解決されました。

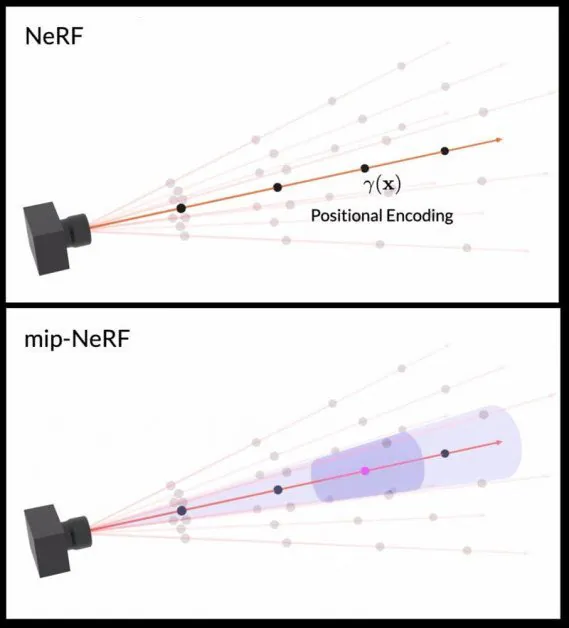

従来のNeRFは1つのピクセルパスのみをサンプリングするため、Mip-NeRFは、隣接するピクセルについて十分な情報を提供し、経済的なアンチエイリアシングで詳細を向上させる「円錐形」のキャッチメントエリアを導入しました。

Mip-NeRFが使用する円錐形キャッチメントは、円錐形フラストム(下の画像)に切り分けられ、さらに「ぼかして」ガウシアン空間を生成し、ピクセルの精度とエイリアシングを計算するために使用されます。 Source: https://www.youtube.com/watch?v=EpH175PY1A0

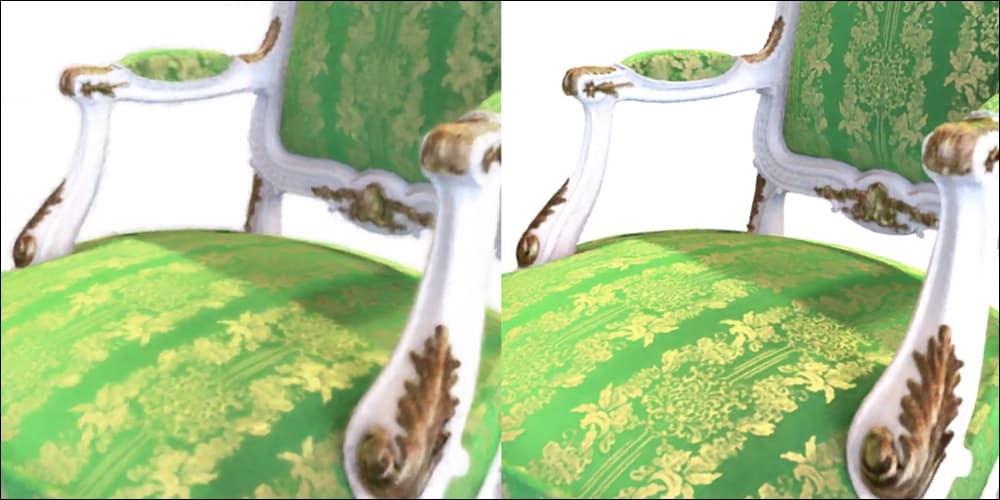

Mip-NeRFの改善は、標準的なNeRF実装と比較して顕著でした。

Mip-NeRF(右)、2021年3月にリリースされ、より包括的なが経済的なアンチエイリアシングパイプラインを提供し、ピクセルを「ぼかして」ジャギーを避けるのではなく、詳細を向上させます。 Source: https://jonbarron.info/mipnerf/

NeRF無制限

2021年3月の論文は、Mip-NeRFを無制限の環境で使用する際に、非常に遠いオブジェクト(例:空)を含む3つの問題を未解決のままにしました。新しい論文は、これらの問題を解決するために、Mip-NeRFのガウシアンにカルマンスタイルのワープを適用します。

2番目に、大きなシーンではより多くの処理能力と長いトレーニング時間が必要になりますが、Mip-NeRF 360は、シーンの幾何学を小さな「提案」多層パーセプトロン(MLP)で「蒸留」することで、これを解決します。このMLPは、標準的なNeRF MLPが予測する幾何学の境界を事前に設定し、トレーニングを3倍の速度で実行します。

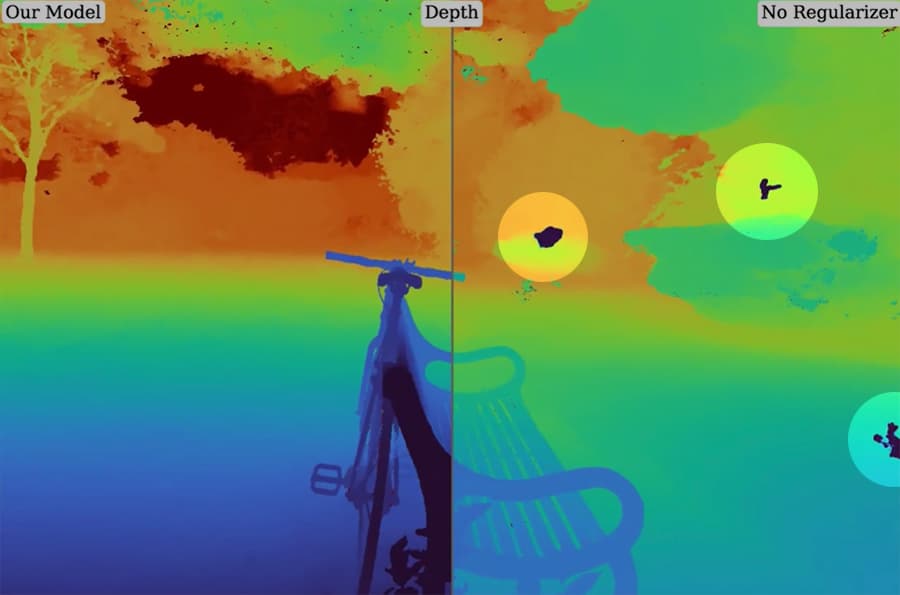

最後に、大きなシーンでは、解釈された幾何学の離散化が曖昧になり、ゲームプレイヤーが「ティアリング」と呼ばれる現象に遭遇する可能性があります。新しい論文は、Mip-NeRFのレイ間隔に新しい正則化項を導入することで、この問題に対処します。

右側では、大きなシーンを囲むのに困難により、Mip-NeRFに不要なアーティファクトが見られます。左側では、新しい正則化項がシーンを十分に最適化して、これらの乱れを除去しています。

新しい論文についてより多くの情報を得るには、以下のビデオを参照し、また、2021年3月のMip-NeRFのビデオ紹介も参照してください。また、NeRFの研究については、今までの報道を確認することもできます。

元の投稿: 2021年11月25日

2021年12月21日 12:25 – 死んだビデオを置き換えました。 – MA