人工知能

ST-NeRF: ビデオ合成のための合成と編集

中国の研究コンソーシアムは、開発した技術により、昨年の最もホットな画像合成研究分野の1つであるNeural Radiance Fields (NeRF)に編集と合成の機能を実現しました。このシステムは、ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field)と呼ばれています。

画像下のカメラパンは物理的なカメラパンのように見えますが、実際にはユーザーが4D空間内のビデオコンテンツをスクロールしているだけです。POVは、描かれた人の動作のパフォーマンスにロックされていません。その動作は、180度の半径のどの部分からでも見ることができます。

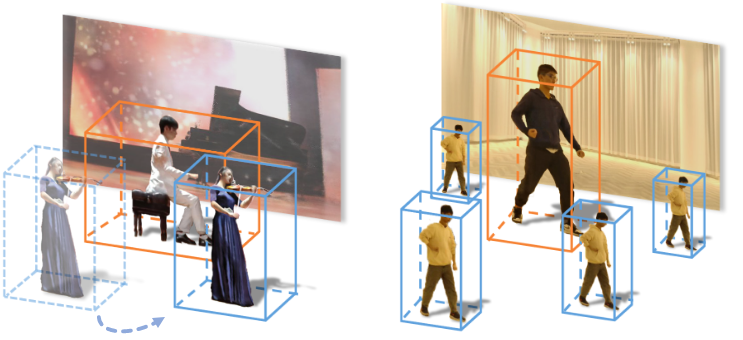

ビデオ内の各要素は、離散的にキャプチャされた要素であり、動的に探索できる一貫性のあるシーンに合成されています。

各要素は、シーン内で自由に複製またはリサイズできます。

さらに、各要素の時間的動作を簡単に変更できます。遅くする、逆に再生する、またはさまざまな方法で操作できます。これにより、フィルターアーキテクチャと非常に高いレベルの解釈可能性が可能になります。

2つの別々のNeRF要素が同じシーンで異なる速度で実行される。 ソース: https://www.youtube.com/watch?v=Wp4HfOwFGP4

パフォーマーまたは環境をロトスコープする必要はありません。パフォーマーは、意図されたシーンのコンテキストを無視して、盲目的に動作を実行する必要はありません。代わりに、16台のビデオカメラを使用して180度の範囲をカバーすることで、フッテージを自然にキャプチャします。

上記に描かれた3つの要素、2人の人と環境は、別個のものであり、説明のためにのみアウトラインされています。各要素は交換できます。また、各要素は個々のキャプチャタイムラインのより早いまたは後のポイントにシーンに挿入できます。

ST-NeRFは、Neural Radiance Fields (NeRF)の研究、つまり機械学習フレームワークによる多視点キャプチャの合成とナビゲーション可能な仮想空間の研究における革新です。

Neural Radiance Fieldsは、複数の視点キャプチャを1つの一貫性のあるナビゲーション可能な3D空間にまとめ、ギャップを推定してレンダリングするニューラルネットワークを使用します。ビデオ(静止画像ではなく)を使用する場合、必要なレンダリングリソースは多くの場合、かなり多くなります。 ソース: https://www.matthewtancik.com/nerf

NeRFへの関心は、過去9ヶ月で激しくなっています。Redditが維持しているリストには、現在60のNeRF派生プロジェクトが記載されています。

費用対効果の高いトレーニング

この論文は、上海科技大学とDGene Digital Technologyの研究者による共同研究であり、Open Reviewで熱烈に歓迎されています。

ST-NeRFは、以前の取り組みと比較して、いくつかの革新を提供しています。特に、16台のカメラのみで高いレベルのリアリズムを実現します。FacebookのDyNeRFは、2台以上のカメラを使用していますが、ナビゲーション可能なアークはかなり制限されています。

FacebookのDyNeRF環境の例。ナビゲーション可能なフィールドは制限されており、1平方フィートあたりのカメラが必要です。 ソース: https://neural-3d-video.github.io

DyNeRFは、個々の要素を編集および合成する機能が不足しているだけでなく、計算リソースの面で非常に高価です。中国の研究者は、自分のデータのトレーニングコストは約900ドルから3,000ドルであると述べています。これは、最先端のビデオ生成モデルであるDVDGANの30,000ドルや、DyNeRFのような集中型システムと比較して非常に低コストです。

レビュアーは、ST-NeRFが、モーションの学習プロセスと画像合成プロセスを切り離すという重要な革新を達成したことも注目しています。この切り離しにより、編集と合成が可能になります。以前のアプローチは比較的制限的で線形でした。

16台のカメラは、半円のビューのために非常に限られた配列ですが、研究者は、将来的に静的背景の事前スキャンプロキシとデータ駆動型シーンモデリングアプローチを使用して、この数をさらに減らすことを希望しています。また、再照明機能を組み込みたいと考えています。これは、NeRF研究における最近の革新です。

ST-NeRFの限界に対処する

学術的なCS論文では、実際の使用可能性を破壊する新しいシステムを最後の段落で捨て去る傾向がありますが、研究者が認めるST-NeRFの限界は、通常とは異なります。

彼らは、現在、特定のオブジェクトを個別にレンダリングできないことを観察しています。なぜなら、フッテージ内の人間は、人間を認識するように設計されたシステムを介して個別のエンティティにセグメント化されるからです。これは、YOLOや同様のフレームワークを使用して容易に解決できる問題のようです。人間のビデオの抽出はすでに達成されています。

研究者は、現在、スローモーションを生成できないことを指摘していますが、DAINやRIFEなどの既存のフレーム補間の革新を使用してこれを実装するには、ほとんど何もありません。

NeRFの実装と、コンピュータビジョン研究の他の多くの分野では、ST-NeRFは、被写体が別の人物またはオブジェクトによって一時的に遮蔽される場合に失敗する可能性があります。追跡または再取得が困難になる可能性があります。研究者は、これらの遮蔽されたフレームでは、手動介入が必要であることを認めています。

最後に、研究者は、人間のセグメンテーション手順は、現在、色の違いによって行われていることを観察しています。これは、2人の人間が1つのセグメンテーションブロックに意図せず結合される可能性があることを意味します。これは、ST-NeRFに限定されるものではなく、使用されているライブラリに固有のものであり、オプティカルフロー分析やその他の新しい技術によって解決できる可能性があります。

2021年5月7日に初めて公開されました。