人工知能

人間の注意を利用することで、AIによって生成された画像の品質を向上させることができる

中国からの新しい研究では、Latent Diffusion Models (LDMs)モデルであるStable Diffusionなどの画像生成の品質を向上させる方法を提案している。

この方法では、画像の目立つ領域、つまり人間の注意を引き付ける可能性が高い領域を最適化することに焦点を当てている。

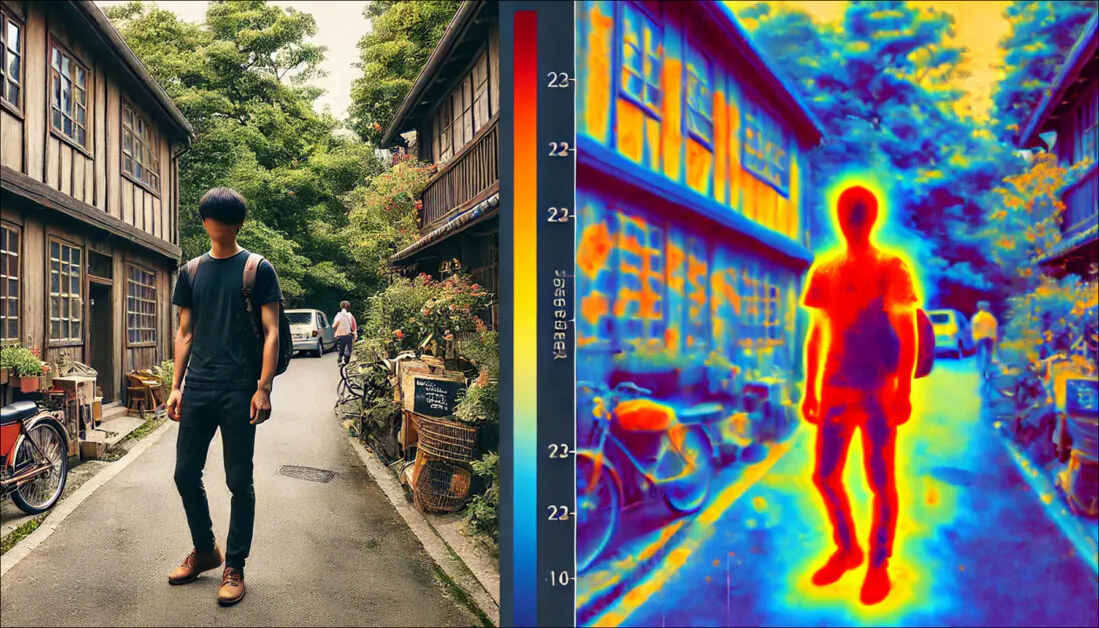

新しい研究では、注目度マップ(左から4列目)をフィルターや「マスク」として使用して、画像の人間が最も注意を払う領域に向けてノイズ除去プロセスの注目点を制御することができることがわかった。ソース: https://arxiv.org/pdf/2410.10257

従来の方法では、画像全体を均一に最適化するが、新しいアプローチでは、注目度検出器を使用して、より「重要」な領域を識別して優先順位を付ける。

量的および質的テストでは、研究者の方法は、画像の品質とテキストプロンプトへの忠実性の両方で、以前の拡散ベースのモデルを上回った。

新しいアプローチは、100人参加の人間認識試験でも最高得点を獲得した。

自然選択

注目度、つまり現実世界や画像での情報の優先順位付けは、人間の視覚の不可欠な部分である。

これの単純な例は、クラシックアートが、たとえば、肖像画における顔や、海をテーマにした絵画におけるマストなどの重要な領域に、詳細に焦点を当てていることである。そうした例では、芸術家的注意は中心的な主題に集まるため、背景や遠くの波などの広い詳細は、よりスケッチーで、より広く表現される。

人間の研究に基づいて、過去10年で、人間の関心領域を画像の中で複製または近似することができる機械学習方法が登場している。

オブジェクトセグメンテーション(セマンティックセグメンテーション)は、画像の側面を個別化し、対応する注目度マップを開発するのに役立つ。ソース: https://arxiv.org/pdf/1312.6034

研究文献の中で、過去5年で最も人気のある注目度マップ検出器は、2016年のグラディエント重み付きクラス活性化マッピング(Grad-CAM)イニシアチブであり、その後、改良されたGrad-CAM++システムやその他のバリエーションや改良が行われている。

Grad-CAMは、セマンティックトークン(「犬」または「猫」など)のグラディエント活性化を使用して、概念または注釈が画像で表現される可能性のある場所の視覚マップを生成する。

オリジナルのGrad-CAM論文からの例。2列目では、ガイド付きバックプロパゲーションがすべての寄与要素を個別化する。3列目では、2つの概念「犬」と「猫」のセマンティックマップが描かれる。4列目は、前の2つの推論の結合を表す。5列目は、推論に対応するオクルージョン(マスク)マップを表し、6列目は、ResNet-18層のGrad-CAMの視覚化を表す。ソース: https://arxiv.org/pdf/1610.02391

人間の調査結果は、これらの数学的な画像内の重要な関心点の個別化と人間の注意(画像をスキャンするとき)との対応関係を明らかにしている。

SGOOL

新しい論文では、注目度がテキストから画像(および、潜在的にテキストからビデオ)へのシステム such as Stable DiffusionとFluxに何をもたらすかを検討している。

ユーザーのテキストプロンプトを解釈するとき、潜在的拡散モデルは、学習済みの潜在空間を、使用された単語またはフレーズに対応する視覚的概念を探すために探索する。次に、これらの見つかったデータポイントをノイズ除去プロセスを通じて解析し、ランダムなノイズをユーザーのテキストプロンプトの創造的な解釈に徐々に進化させる。

しかし、この時点では、モデルは画像のすべての部分に同じ注意を与える。2022年に拡散モデルが普及し、OpenAIの利用可能なDall-E画像ジェネレーターが発売され、Stability.aiのStable Diffusionフレームワークがオープンソース化された後、ユーザーは、「重要」な画像のセクションがしばしば不足していることを発見した。

人間の描写の典型的な例では、人物の顔(これは、見る人にとって最大の重要性を持つ)は、画像の全体の10〜35%を占める可能性が高い。この民主的な注意の分散方法は、人間の認識と芸術および写真の歴史の両方に反する。

人物のジーンズのボタンがその目に同じ計算量を与えるとき、リソースの割り当ては最適ではないと言える。

したがって、著者が提案する新しい方法、注目度ガイドによる拡散潜在的な最適化(SGOOL)では、注目度マッパーを使用して、画像の無視された領域に注意を向け、人間の注意の周辺に残る可能性のあるセクションに少ないリソースを割り当てる。

方法

SGOOLパイプラインには、画像生成、注目度マッピング、最適化が含まれており、全体の画像と注目度の精製された画像が共同で処理される。

SGOOLの概念スキーマ。

拡散モデルの潜在的埋め込みは、ファインチューニングで直接最適化され、特定のモデルをトレーニングする必要性が除去される。Stable Diffusionを使用するユーザーに馴染みのあるスタンフォード大学のノイズ除去拡散暗黙的モデル(DDIM)サンプリング方法が、注目度マップによって提供される二次情報を組み込むために採用される。

論文では次のように述べられている。

‘我々はまず、人間の視覚的注意システムを模倣し、注目度の高い領域をマークするために注目度検出器を使用する。追加のモデルをトレーニングする必要性を避けるために、我々の方法は直接拡散潜在的な最適化を行う。 ‘

‘さらに、SGOOLは可逆的な拡散プロセスを利用し、それに定数メモリ実装の利点を与える。したがって、我々の方法は、パラメータ効率が良いファインチューニング方法となる。広範な実験が複数のメトリックと人間の評価で行われている。’

この方法では、ノイズ除去プロセスの複数のイテレーションが必要となるため、著者は拡散潜在的な直接最適化(DOODL)フレームワークを採用した。これは、可逆的な拡散プロセスを提供するが、まだ画像全体に注意を向けている。

注目度の高い領域を定義するために、研究者は、ダンディー大学の2022年のTransalNetフレームワークを採用した。

2022年のTransalNetプロジェクトからの注目度検出の例。ソース: https://discovery.dundee.ac.uk/ws/portalfiles/portal/89737376/1_s2.0_S0925231222004714_main.pdf

TransalNetによって処理された注目度の高い領域は、人間にとって最も関心があると考えられる結論的な注目度のセクションを生成するために切り抜かれた。

ユーザーのテキストと画像の違いは、プロセスが機能しているかどうかを判断することができる損失関数を定義する必要がある。ここで、OpenAIの対比的言語-画像事前トレーニング(CLIP)のバージョンが使用され、テキストプロンプトと画像の全体的な出力の間の推定セマンティック距離も考慮された。

著者は次のように主張する。

‘[最終的な] 損失関数は、同時に注目度の高い部分と全体的な画像の関係を考慮する。これにより、生成プロセスでローカルな詳細と全体的な一貫性のバランスを取ることができる。 ‘

‘この注目度を認識した損失は、画像の潜在的な最適化に使用される。勾配はノイズされた[潜在的な]で計算され、入力プロンプトの条件付効果を、生成された画像の元の画像の両方の注目度の高い側面と全体的な側面に強化するために使用される。’

データとテスト

SGOOLをテストするために、著者は、Stable Diffusion V1.4の「バニラ」配布(テスト結果では「SD」と表記)と、CLIPガイダンスを使用したStable Diffusion(結果では「ベースライン」と表記)を使用した。

システムは、3つのパブリックデータセットに対して評価された:CommonSyntacticProcesses(CSP)、DrawBench、およびDailyDallE*。

後者には、OpenAIのブログ投稿の1つに登場するアーティストからの99の詳細なプロンプトが含まれており、DrawBenchには11のカテゴリにわたる200のプロンプトが用意されている。CSPには、8つの多様な文法ケースに基づく52のプロンプトが含まれている。

SD、ベースライン、SGOOLのテストでは、CLIPモデルは画像とテキストの埋め込みを生成するために、ViT/B-32よりも使用された。

同じプロンプトとランダムシードが使用され、出力サイズは256×256で、TransalNetのデフォルトの重みと設定が使用された。

CLIPスコアメトリックに加えて、人間の好みスコア(HPS)が使用され、100人参加の実世界の研究も行われた。

SGOOLと以前の構成との比較による量的結果。

上記の表の量的結果について、論文では次のように述べられている。

‘私たちのモデルは、CLIPスコアとHPSの両方のメトリックで、すべてのデータセットでSDとベースラインを大幅に上回った。私たちのモデルのCLIPスコアとHPSの平均結果は、2位よりもそれぞれ3.05と0.0029高かった。’

著者は、以前のアプローチに対するHPSとCLIPスコアのボックスプロットも推定した。

テストで得られたHPSとCLIPスコアのボックスプロット。

彼らは次のようにコメントする。

‘私たちのモデルは他のモデルを上回っていることがわかり、画像がプロンプトと一致していることを示唆している。 ‘

‘しかし、ボックスプロットでは、評価メトリックのサイズが[0, 1]なので、比較を視覚化するのが難しい。したがって、対応する棒グラフをプロットする。 ‘

‘SGOOLは、CLIPスコアとHPSの両方のメトリックで、すべてのデータセットでSDとベースラインを上回った。量的結果は、画像がよりセマンティックに一貫性があり、人間が好む画像を生成できることを示している。’

研究者は、ベースラインモデルは画像の品質を向上させることができるが、画像の注目度の高い領域を考慮していないと主張する。SGOOLは、全体的な画像評価と注目度の高い画像評価の妥協点に到達することで、より良い画像を取得することができると主張する。

定性的(自動化された)比較では、SGOOLとDOODLの最適化の数は50に設定された。

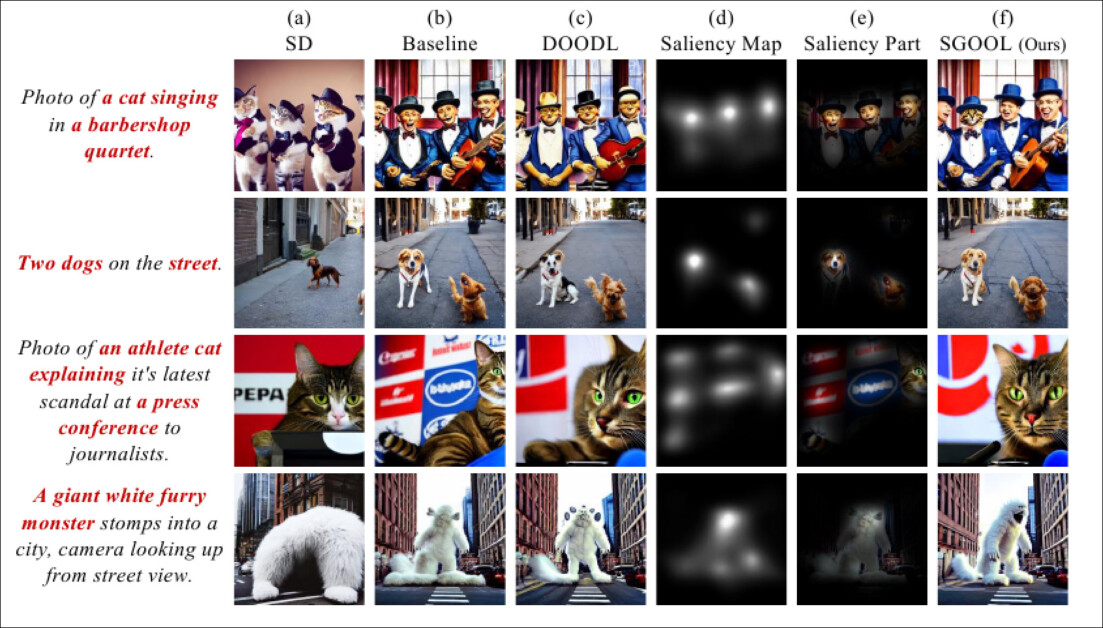

テストの定性的結果。ソース論文に記載されているより詳細な定義を参照してください。

ここで、著者は次のように観察する。

‘最初の行では、プロンプトの主題は「猫が歌う」と「バーバーショップクォート」となっている。SDによって生成された画像には4匹の猫がいて、画像の内容はプロンプトと悪く一致している。 ‘

‘ベースラインによって生成された画像では、猫が無視されており、顔や画像の詳細が不足している。DOODLは、プロンプトと一致した画像を生成しようとする。 ‘

‘しかし、DOODLは全体的な画像を直接最適化するため、画像の中の人々は猫に向けて最適化される。 ‘

彼らはさらに、SGOOLは、元のプロンプトとより一致した画像を生成することを指摘する。

人間の認識テストでは、100人のボランティアが、テスト画像の品質とセマンティック的一貫性(つまり、元のテキストプロンプトにどれだけ忠実であるか)を評価した。参加者は、選択を行うのに無制限の時間が与えられた。

人間の認識テストの結果。

論文では、著者の方法が以前のアプローチを大幅に上回ったことが示されている。

結論

Stable Diffusionのローカルインストールでこの論文で取り上げられている欠点が明らかになった直後、システムが人間の関心領域に追加の注意を与えるように強制するための様々な独自の方法(After Detailerなど)が登場した。

しかし、この種のアプローチでは、拡散システムが最初に、画像のすべての部分に等しい注意を与える通常のプロセスを通じて行き、増加した作業が追加のステージとして行われる必要がある。

SGOOLからの証拠は、画像のセクションへの優先順位付けに基本的な人間の心理学を適用することで、初期の推論を大幅に強化できることを示唆している。

* この論文では、CommonSyntacticProcessesと同じリンクが提供されている。

2024年10月16日水曜日に初めて公開された。