Inteligencia artificial

NeRF Avanza Otro Paso Hacia Reemplazar a CGI

Los investigadores del MIT y Google han dado un gran paso para resolver uno de los obstáculos más fundamentales para una tecnología emergente impulsada por IA que podría reemplazar eventualmente a CGI: separar la imagen de radiación neural (NeRF) en sus componentes visuales constituyentes, para que la imagen pueda ser retexturizada y reiluminada.

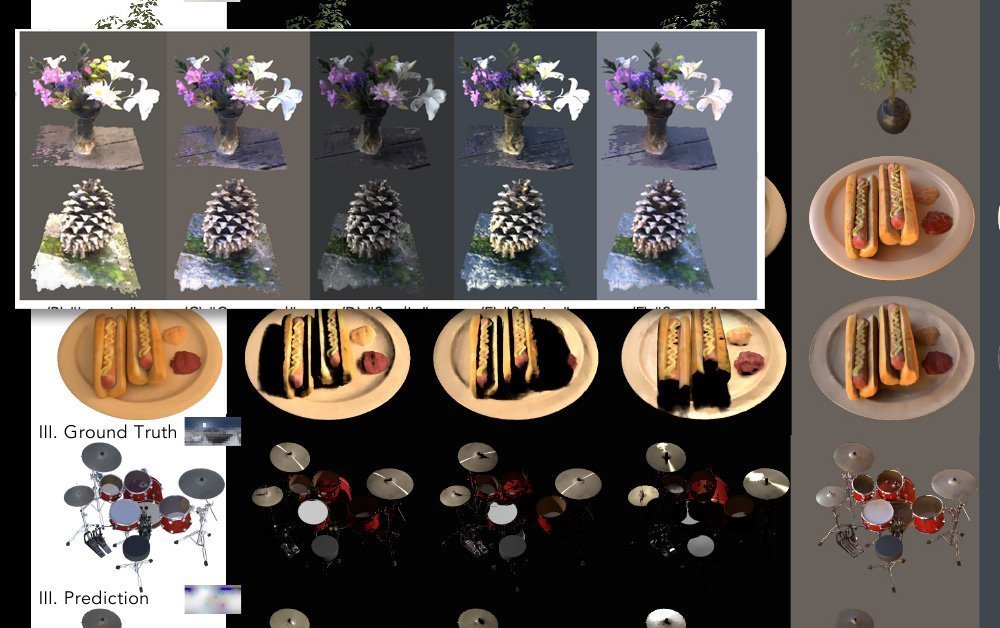

El nuevo enfoque, llamado NeRFactor, divide efectivamente la imagen capturada en normales por objeto (en los que se pueden asignar texturas), visibilidad de la luz, albedo (la proporción de luz incidental que se refleja lejos de una superficie) y Funciones de Distribución de Reflectancia Bidireccional (BRDF).

Con estos aspectos aislados, es posible no solo cambiar texturas para objetos o grupos de objetos individuales, sino también agregar fuentes de iluminación y sombras únicas y novedosas, descartando cualquier cosa que haya sido capturada por los arrays de cámaras múltiples que generan la entrada para la imagen de NeRF.

Normales, visibilidad, albedo y BRDF separados bajo NeRFactor. Source: https://www.youtube.com/watch?v=UUVSPJlwhPg

El modelo admite sombras suaves o duras de fuentes de iluminación arbitrarias y definidas por el usuario, y separa los cuatro aspectos de la video capturada de forma programática, utilizando una pérdida de reconstrucción, datos de cálculos anteriores de BRDF y una regularización de suavidad básica y simple.

Flujo de trabajo de NeRFactor, extrayendo facetas de la imagen derivadas de matrices de cámaras múltiples. Source: https://arxiv.org/pdf/2106.01970.pdf

NeRFactor utiliza una sonda de luz HDR, un enfoque bien establecido que ha permeado la escena industrial y artística visual desde su introducción en 1998, para evaluar posibles rutas para los rayos, lo que permite una iluminación arbitraria. Dado que esto genera un número ingobernable de parámetros posibles, la sonda de luz se filtra a través de un perceptrón multicapa (MLP), que asigna la geometría percibida a la sonda sin intentar calcular un mapa de volumen de iluminación completo para el espacio del modelo.

Dos modelos de campo de radiación neural se utilizan para demostrar cinco modelos de iluminación posibles bajo NeRFactor. Haga clic en la imagen para una resolución más alta.

Causa Para La Reflexión

La nueva investigación es quizás más significativa al separar las capas de la imagen capturada que controlan la reflexión. Esto sigue siendo uno de los mayores desafíos para la imagen de campo de radiación neural, ya que un sistema NeRF verdaderamente novedoso y flexible no solo necesitará poder sustituir texturas, sino también necesitará alguna forma de reflejar objetos en movimiento (además de solo el entorno fijo) que normalmente se contabilizarían en un flujo de trabajo de CGI.

Este problema se señaló recientemente en relación con la investigación impresionante de Intel sobre la transformación de imágenes de videojuegos en video fotorealista a través de redes neuronales convolucionales. En dichos flujos de trabajo, muchos aspectos “horneados” del material de origen necesitarían convertirse en discretos y canjeables, y esto es arguablemente más fácil de resolver para la reiluminación (que es una función de la geometría que se representa en NeRF) que para las reflexiones (que utilizan geometría “fuera de pantalla” que está completamente fuera del alcance del modelo).

Por lo tanto, aislar las capas en el video de NeRF que facilitan la reflexión acerca NeRF un paso más cerca de resolver su “desafío de reflexión”.

El uso de un entorno HDR ya resuelve el problema de generar reflexiones de entorno del mundo (es decir, cielos, paisajes y otros factores ambientales “fijos”), pero se necesitarán nuevos enfoques para introducir reflexiones dinámicas y en movimiento.

Fotogrametría Con NeRF

La imagen de campo de radiación neural utiliza el análisis de aprendizaje automático para desarrollar un espacio completamente volumétrico a partir de una escena o objeto que ha sido capturado desde varios ángulos.

Varios esquemas basados en NeRF que han surgido en el último año han utilizado una gran cantidad de dispositivos de cámara contribuyentes; algunos utilizan 16 o más cámaras, otros tan pocas como una o dos. En todos los casos, las vistas intermedias se “rellenan” (es decir, se interpretan) para que la escena o el objeto puedan ser navegados fluidamente.

La entidad resultante es un espacio completamente volumétrico, con una comprensión intrínseca de 3D que se puede explotar de muchas maneras, incluida la capacidad de generar mallas de CG tradicionales a partir de la suma de 3D de las imágenes de entrada.

NeRF En El Contexto De Un ‘Nuevo CGI’

La imagen de campo de radiación neural se dibuja directamente de imágenes del mundo real, incluidas imágenes en movimiento de personas, objetos y escenas. Por el contrario, una metodología de CGI “estudia” e interpreta el mundo, lo que requiere trabajadores capacitados para construir mallas, armaduras y texturas que aprovechan la imagen del mundo real (es decir, capturas faciales y ambientales). Esto sigue siendo un enfoque esencialmente interpretativo y artesanal que es costoso y laborioso.

Además, CGI ha tenido problemas continuos con el efecto del “valle inquietante” en sus esfuerzos por recrear similitudes humanas, lo que no supone una limitación para un enfoque impulsado por NeRF, que simplemente captura video o imágenes de personas reales y las manipula.

Además, NeRF puede generar geometría de malla de estilo de CGI tradicional directamente a partir de fotos según sea necesario, y en efecto suplanta muchos de los procedimientos manuales que siempre han sido necesarios en la imagen generada por computadora.

Desafíos Para NeRF

Esta investigación más reciente del MIT y Google llega en el contexto de una verdadera inundación de artículos de NeRF en el último año, muchos de los cuales han ofrecido soluciones a los varios desafíos que planteó el artículo inicial de 2020.

En abril, la innovación de un consorcio de investigación chino proporcionó una forma de aislar discretamente las líneas de tiempo individuales de los aspectos de una escena de NeRF, incluidas las personas.

La investigación china permite a los usuarios de fin copiar, pegar y cambiar el tamaño de los elementos capturados, desenredándolos de la línea de tiempo lineal del video de origen. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Este enfoque no solo permite reimaginear la escena desde cualquier ángulo capturado por la matriz de cámaras (y no solo la vista única representada en una captura de video típica), sino que también permite un compostaje versátil, e incluso la capacidad de representar dos aspectos de la misma filmación que se ejecutan en sus propios marcos de tiempo individuales (o incluso ejecutándose hacia atrás, según sea necesario).

La investigación china permite a los usuarios de fin copiar, pegar y cambiar el tamaño de los elementos capturados, desenredándolos de la línea de tiempo lineal del video de origen. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Uno de los mayores desafíos para NeRF es reducir los considerables recursos necesarios para entrenar una escena, y esto ha sido abordado en una serie de artículos recientes. Por ejemplo, el Instituto Max Planck para Sistemas Inteligentes recientemente introdujo KiloNeRF, que no solo acelera los tiempos de renderizado en un factor de 1000, sino que incluso permite que NeRF funcione de forma interactiva.

KiloNeRF ejecutando un entorno interactivo a 50fps en un GTX 1080ti. Source: https://github.com/creiser/kilonerf

Sin embargo, la innovación de velocidad de NeRF que realmente capturó la imaginación de los investigadores y del público en 2021 ha sido la colaboración de PlenOctrees, liderada por la Universidad de California en Berkeley, que ofrece renderizado en tiempo real de campos de radiación neural:

El efecto de las capacidades interactivas de PlenOctrees se ha reproducido en una interfaz web en vivo.

Movimiento interactivo de un objeto de PlenOctrees en Firefox (el movimiento es más suave y dinámico de lo que representa este GIF). Source: http://alexyu.net/plenoctrees/demo/

Además, Recursive-NeRF (de un artículo de mayo de 2021 de investigadores de la Universidad de Tsinghua) ofrece renderizado recursivo de alta calidad a demanda. En lugar de obligar al usuario a renderizar escenas enteras, incluidas partes que pueden no ser vistas, Recursive-NeRF proporciona algo similar a la compresión con pérdida de JPEG, y puede generar sub-NeRF discretos para manejar imágenes adicionales a demanda, logrando un ahorro enorme en recursos computacionales.

Manteniendo el detalle mientras se eliminan cálculos de renderizado innecesarios con Recursive-NeRF. Haga clic en la imagen para una resolución más alta. Source: https://arxiv.org/pdf/2105.09103.pdf

Otros enfoques incluyen FastNeRF, que afirma lograr renderizado neural de alta fidelidad a 200fps.

Se ha señalado que muchos de las técnicas de optimización para NeRF implican ‘hornear’ la escena, comprometiéndose con aspectos que se desean renderizar y descartando otros aspectos, lo que limita la exploración pero acelera enormemente la interactividad.

El inconveniente de esto es que el estrés se mueve desde la GPU al almacenamiento, porque las escenas horneadas ocupan un espacio de disco desproporcionado; hasta cierto punto, esto se puede mitigar mediante la reducción de muestreo de los datos horneados, aunque esto también implica un cierto compromiso, en términos de cerrar avenidas de exploración o interactividad.

En cuanto a la captura de movimiento y la armadura, un nuevo enfoque de las universidades de Zheijang y Cornell, revelado en mayo, ofreció un método para recrear humanos animables utilizando campos de peso de mezcla y estructuras de esqueleto interpretadas a partir de video de entrada:

Estructura de esqueleto derivada en Animatable NeRF. Source: https://www.youtube.com/watch?v=eWOSWbmfJo4

¿Cuándo Tendrá NeRF Su Momento ‘Parque Jurásico’?

A pesar del ritmo rápido de progreso con la síntesis de imágenes a través de campos de radiación neural, solo en este período se establecerá algún tipo de “ley de la termodinámica” para cómo puede desplegarse NeRF. En términos de una línea de tiempo análoga a la historia de CGI, NeRF está actualmente flotando alrededor de 1973, justo antes del primer uso de CGI en Westworld.

Eso no significa que NeRF necesariamente tenga que esperar nueve años para su hito equivalente Wrath Of Khan, o décadas para los avances similares que CGI logró bajo el entusiasta patrocinio de James Cameron en 1989 en The Abyss o 1991 en Terminator 2 – y luego, el momento de avance tecnológico verdaderamente revolucionario en 1993 en Parque Jurásico.

La escena de imagen ha cambiado mucho desde el largo período de estancamiento para los efectos visuales fotoquímicos, que dominaron la producción de cine y televisión desde el nacimiento del cine hasta los primeros años 90. El advenimiento de la revolución de la PC y la aceleración de la ley de Moore condujo a la revolución de CGI, que de otro modo podría haber tenido lugar tan temprano como en la década de 1960.

Queda por ver si hay alguna barrera tan imponente que pueda detener el progreso de NeRF durante tanto tiempo – y si las innovaciones posteriores en visión por computadora podrían no superar por completo a NeRF como el principal contendiente por la corona de CGI, caracterizando los campos de radiación neural como la “máquina de fax” de breve duración de la síntesis de imágenes neuronales.

Hasta ahora, NeRF no se ha utilizado en ningún contexto fuera de la investigación académica; pero es notable que actores importantes como Google Research, y muchos de los laboratorios de investigación de visión por computadora más prominentes estén compitiendo por el último avance de NeRF.

Muchos de los obstáculos más grandes de NeRF han comenzado a abordarse directamente este año; si la investigación posterior ofrece una solución al “problema de reflexión”, y los muchos hilos de investigación de optimización de NeRF se fusionan en una solución decisiva para las considerables demandas de procesamiento y/o almacenamiento de la tecnología, NeRF realmente tiene una oportunidad de convertirse en ‘el nuevo CGI’ en los próximos cinco años.