Vordenker

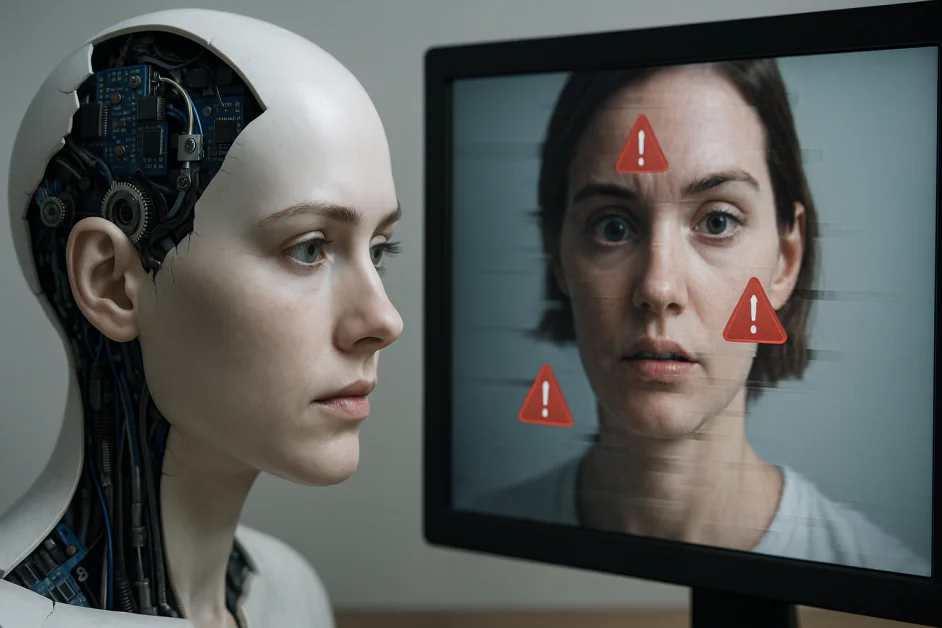

Warum Ihre KI-Bilder mit Fehlern behaftet sind – Und wie Sie sie verbessern können

KI-gesteuerte Text-Bild-Generierungsmodelle haben die digitale Kunst und Content-Erstellung auf den Kopf gestellt und ermöglichen es jedem Benutzer, unabhängig von seinem Hintergrund, hochwertige, anpassbare Visuelle in nur wenigen Worten in einem Bruchteil der Zeit zu produzieren, die ein menschlicher Profi mit klassischen Design- oder Foto-Tools benötigen würde.

Mit leistungsstarken technologischen Fortschritten wird die KI-gestützte Kreativität zunehmend integraler Bestandteil von Workflows in verschiedenen Branchen. Allerdings ist das Erstellen eines kommerziell einsetzbaren Stücks mit KI nicht darum, einen magischen Knopf zu drücken, da seine “voilà”-Wirkung nicht immer verwendbare Ergebnisse liefert, insbesondere für diejenigen, die sich auf sie verlassen, um professionelle Kunst- und Designstandards zu erfüllen.

In Wirklichkeit ist, während das Beherrschen des Prompt-Schreibens – die Sprache, die KI versteht – die primäre Voraussetzung für die Erreichung von Ausgaben, die mit der eigenen kreativen Vision übereinstimmen, KI-generierte Bilder immer noch einige gemeinsame frustrierende Mängel aufweisen können, die nicht nur Anfänger, sondern auch erfahrene Ersteller betreffen. Das Überwinden dieser Probleme erfordert oft zusätzliches Wissen und Fähigkeiten von beiden Benutzern und Entwicklern.

Unten werde ich die häufigsten Herausforderungen bei der KI-Bildgenerierung skizzieren und praktische Lösungen zur Umgehung dieser Herausforderungen teilen.

Prompt-Engineering-Komplexität

Der Kernappeal der KI-Bildgenerierung ist die Umwandlung von Ideen in Visuelle in fast einem Augenblick mithilfe von nur wenigen Worten. Allerdings ist die Komplexität des Prompt-Engineerings noch einer der größten Hindernisse für die Erzeugung von sinnvollen Bildern. Selbst geringe Variationen in der Wortwahl können zu drastisch unterschiedlichen Ausgaben führen. Prompt-Strukturen können auch je nach Modell variieren, sodass das, was in einem Modell gut funktioniert, in einem anderen schlechte Ergebnisse liefern kann. Dieses Fehlen von Standardisierung in der Prompt-Sprache zwingt Benutzer oft, durch Trial und Error zu gehen.

Prompt-Bibliotheken und -Datenbanken helfen, das Raten zu reduzieren, indem sie vorgetestete Prompts bereitstellen, auf die Benutzer zurückgreifen oder je nach Bedarf modifizieren können. Visuelle Prompt-Generatoren ermöglichen es Benutzern, Schlüsselwörter in einer strukturierten Weise einzugeben, Attribute auszuwählen, Schieberegler anzupassen und mehr, wodurch der Prozess des Erstellens eines effektiven Prompts intuitiver wird. Das Lernen von erfolgreichen Prompts, die von der Community geteilt werden, ist auch wertvoll, da diese realen Beispiele zeigen, was funktioniert.

Um die Konsistenz zu verbessern, schlagen standardisierte Prompt-Syntax-Leitfäden die besten Praktiken für die Strukturierung von Schlüsselwort-Eingaben über verschiedene Modelle hinweg vor. Die Verwendung von Prompt-Vorlagen fördert vorhersehbare Ergebnisse, wodurch Benutzer mehrere Bilder mit einem konsistenten Stil generieren können. Neuere Modelle wie FLUX sind insgesamt benutzerfreundlicher, da sie so konzipiert sind, dass sie weniger empfindlich auf Prompt-Komplexität reagieren, was es Benutzern ermöglicht, kohärente, komplexe Szenen aus einfacheren Anweisungen zu erstellen.

Anatomische Ungenauigkeit

Aufgrund der Art und Weise, wie neuronale Netze aus Daten lernen, erkennen Diffusionsmodelle keine Anatomie – sie generieren Bilder auf der Grundlage von Mustererkennung und nicht auf der Grundlage eines strukturierten biologischen Rahmens. Zum Beispiel betrachtet KI eine Hand nicht als eine Zusammensetzung von fünf verschiedenen Fingern, die sich unterschiedlich bewegen können. Stattdessen mischt es statistische Durchschnittswerte, die in den Trainingsbildern zu sehen sind. Als Ergebnis können Abweichungen von den erwarteten Posen oder Winkeln Verzerrungen verursachen. Obwohl moderne Modelle sich deutlich verbessert haben, bleiben Anomalien wie zusätzliche Finger, unnatürliche Gesichts- und Körperproportionen, unwirkliche Gliedmaßenverbindungen und Gelenkplatzierungen oder asymmetrische und fehlgeleitete Augen häufig.

Das Feinabstimmen von Modellen mit LoRas (Low-Rank-Adaptationstechnologie), die sich explizit auf anatomische Datensätze konzentrieren, hilft ihnen, ein umfassenderes Verständnis der menschlichen Struktur zu entwickeln. ControlNets, insbesondere solche, die Pose-Schätzung oder Kantenerkennung (wie Canny-Filter) verwenden, ermöglichen es KI, anatomischen Richtlinien zu folgen.

Prompts, die sich speziell auf realistische Körperdetails beziehen, können auch die anatomische Genauigkeit der generierten Figuren verbessern. Die Nachbearbeitung mit anatomiebewussten Korrekturwerkzeugen ermöglicht es Benutzern, fehlerhafte Bereiche zu korrigieren, ohne das gesamte Bild neu zu generieren.

Identitätsinkonsistenz über mehrere Generationen hinweg

Da KI jeden Generationsschritt als unabhängigen Prozess behandelt, bleibt die Aufrechterhaltung eines konsistenten Charakteraussehens über mehrere Bilder hinweg eine Herausforderung, insbesondere problematisch für Erzählungen oder serienbasierte Kunstwerke, bei denen Charakterkontinuität von entscheidender Bedeutung ist. Selbst bei Verwendung desselben Prompts können subtile Änderungen in Gesichtszügen, Kleidung oder Stil zwischen den Renderings auftreten. Das Problem kann sich noch verschärfen, wenn Batch-Generationen verwendet werden, bei denen Qualität und visuelle Merkmale unvorhersehbar schwanken.

Das Trainieren eines LoRA auf einem Satz von Bildern einer bestimmten Person oder eines bestimmten Objekts und die Verwendung eines Referenzbildes als Eingabe können die Identitätsbedingung, Konsistenz und Einheitlichkeit verbessern. Einbettungstechniken und Adapter (wie PuLID, IPAdapter, InstantID und EcomID) helfen, Charaktermerkmale über Generationen hinweg zu bewahren. Wenn Gesichtsgenauigkeit von entscheidender Bedeutung ist, bieten Gesichtsaustauschmodelle oder Nachbearbeitung eine feinere Verfeinerung, um sicherzustellen, dass Schlüsselmerkmale von Generation zu Generation identisch bleiben.

Hintergrundinkohärenz

KI-generierte Hintergründe neigen zu unrealistischen, strukturell und kontextuell inkohärenten Designs, was die Bilder weniger glaubwürdig aussehen lässt. Zum Beispiel kann die Perspektive falsch wirken oder Licht und Schatten können nicht mit dem Subjekt übereinstimmen. Dies liegt daran, dass Diffusionsmodelle den Hintergrund als sekundäres Element und nicht als integralen Bestandteil der Szene wahrnehmen, was zu Problemen mit der Tiefenwahrnehmung, Objektkorrelation und Umgebungscontext führt.

Tiefenkartierung hilft Modellen, räumliche Beziehungen genauer zu interpretieren, was eine realistischere Integration zwischen Vorder- und Hintergrund ermöglicht. Perspektivführungen erzwingen geometrische Ausrichtung, was hilft, architektonische Strukturen und Fluchtpunkte konsistent zu halten. Fokussierte Relighting-LoRas können lernen, Licht und Schatten zusammen mit dem Hintergrund zu generieren, was sicherstellt, dass die Reflexe sich natürlich über die gesamte Szene verhalten.

Das Feinabstimmen von Modellen auf Datensätze mit spezifischen Umgebungen (wie städtische Landschaften, Naturbilder oder Innenräume) kann die allgemeine Hintergrundrealistik verbessern. Referenz-Hintergrundbilder helfen auch, die Generation an realen Kompositionen zu verankern.

Textrendering-Probleme

Da sie hauptsächlich auf visuellen Daten trainiert werden und nicht auf strukturierten Sprache, kämpft KI mit der Generierung lesbarer Wörter und Phrasen innerhalb des Bildes. Der Text kann unvollständig, Unsinn, verwirrt oder unsinnig erscheinen, mit unregelmäßigen Schriftarten oder fehlgeleiteter Platzierung. Wenn lesbar, kann er immer noch stilistisch falsch oder unangenehm in den Hintergrund eingebettet aussehen.

Im Gegensatz zu Menschen erkennen die meisten KI-Modelle Text nicht als von den umgebenden Elementen getrennt, sodass sie ihn nicht als separates Objekt verarbeiten. Stattdessen behandeln sie Zeichenfolgen als ein weiteres visuelles Muster, das aus abstrakten Formen und nicht aus bedeutungsvollen semantischen Symbolen besteht.

Um die Textrendering-Qualität zu verbessern, trainieren Forscher Modelle auf speziellen Textdatensätzen, die ordnungsgemäß beschriftete Typografie-Beispiele enthalten, die KI helfen, Buchstabenbildung, Ausrichtung und Abstand besser zu verstehen. Textbewusste Maskierung ist eine weitere effektive Technik, wenn leere Bereiche während der Bildgenerierung für Text reserviert werden, was eine saubere Integration während der Nachbearbeitung ermöglicht.

Mangel an Kontrolle über die Ausgabe

Obwohl die Ergebnisse visuell beeindruckend sein können, resultiert eine signifikante Einschränkung der KI-Bildgenerierung aus dem Mangel an präziser Kontrolle über die Endausgabe. Benutzer können sich bemühen, das Modell in Richtung spezifischer Stile zu lenken, Realismus sicherzustellen oder feine Details zu verfeinern. Andere häufige Fehler umfassen unerwartete Elemente in der Szene, störende Farben und Layoutinkonsistenzen. Im Gegensatz zu menschlichen Künstlern, die mit Absicht anpassen, operiert KI probabilistisch, was manchmal überraschende oder unerwünschte Ergebnisse liefert.

Kontrollmechanismen wie ControlNets und LoRas ermöglichen es Benutzern, die Struktur durch Pose, Tiefen- oder Kantenguidance zu konditionieren. Für eine präzisere ästhetische Steuerung können benutzerdefinierte Modelle, die auf bestimmten Stilen trainiert sind, die Kohärenz in der künstlerischen Richtung erheblich verbessern. Darüber hinaus hilft die Referenzierung eines bestimmten Bildes durch Bild-zu-Bild-Generierung, die Relevanz der Ausgabe aufrechtzuerhalten.

Maskierungs- und Ausmalwerkzeuge ermöglichen die Bearbeitung bestimmter Teile eines Bildes, ohne den Rest zu beeinträchtigen. Nachbearbeitungstools wie Upscaler und Enhancer können der KI-Ausgabe den letzten Feinschliff verleihen, indem sie die Auflösung und Klarheit verbessern.

Insgesamt hat KI noch nicht eine sophisticatedere und nuanciertere Prompt-Interpretation entwickelt – eine Herausforderung, die eine der zentralen bleibt, um Kontrolle aufrechtzuerhalten. Viele Modelle neigen dazu, Anweisungen zu überinterpretieren, indem sie tiefere oder vielschichtigere Bedeutungen extrahieren, wo sie nicht beabsichtigt sind. Obwohl dies intelligent klingt, kann sogar ein detaillierter Prompt unvorhersehbare Ergebnisse liefern. Zum Beispiel kann KI betonen oder unerwartete Elemente auf der Grundlage der Assoziationen erfinden, die es gelernt hat. Dies erhöht die Komplexität der Prompt-Erstellung, was Benutzern erfordert, sich an die Art und Weise anzupassen, wie das Modell “denkt” (was nicht immer intuitiv ist) und mehr Zeit mit der Experimentierung mit der Wortwahl, um das gewünschte Ergebnis zu erzielen.

Schlussgedanken

Das Verständnis, wie KI visuelle Daten interpretiert – und die Anerkennung, wo sie tendenziell versagt – ermöglicht es, intelligente Entscheidungen bei der Prompt-Erstellung zu treffen, effektive Problemlösungsstrategien anzuwenden und die richtigen Werkzeuge auszuwählen, um auftretende Generierungsfehler zu umgehen. Letztendlich ermöglicht es Benutzern, mit KI als kreativem Partner zusammenzuarbeiten, anstatt auf Glück zu vertrauen oder ihre technischen Einschränkungen als Hindernisse für die Erstellung von verwendbaren Inhalten zu betrachten, die die Vision des Erstellers genau widerspiegeln.