Andersons Blickwinkel

Warum Konzeptverflechtung bedeutet, dass Sie AI-Videos nicht “Ihrer Way” haben können

AI-Video-Tools versprechen totale Kontrolle, aber die versteckte “Konzeptverflechtung” verbindet Identitäten, Ausdrucksformen und Verhaltensweisen miteinander, was zu Hacks und Template-Tricks führt, die den Mythos der mühelosen GenAI-Magie zerstören.

Meinung Seit ich mich das letzte Mal ausführlich mit dem Thema beschäftigt habe vor fünf Jahren, hat sich das Problem der Konzeptverflechtung in trainierten KI-Systemen auf eine viel breitere Benutzergruppe ausgedehnt, ohne dass es wirklich besser verstanden wird.

Damals waren Autoencoder-Deepfake-Systeme (also die inzwischen nicht mehr existierenden DeepFaceLab und die weniger pornografisch orientierte FaceSwap, die beide von dem 2017 veröffentlichten und sofort verbotenen Reddit-Code abgeleitet wurden) die einzigen Möglichkeiten, um relativ photorealistische Deepfakes von Personen zu erstellen.

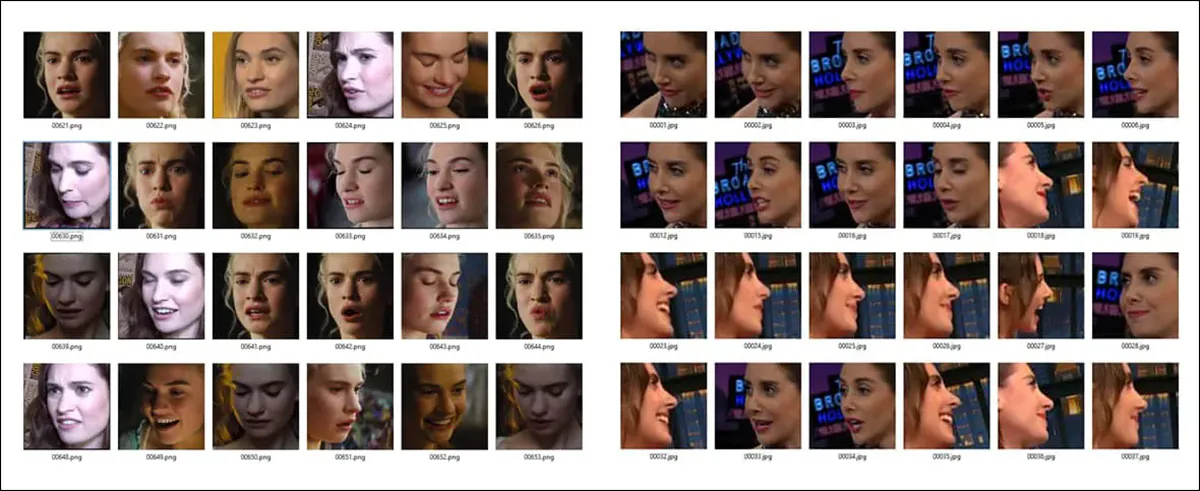

Diese Systeme basierten auf umfangreichen Gesichts-Trainingsdatensätzen, die dem KI-Modell Informationen über A) wie die Person in Ruhe aussah (eine kanonische Referenz-Einbettung) und B) wie sie unter den verschiedenen Situationen aussah, die ein Gesicht widerspiegeln kann, von Schlaf bis hin zu Lachen, Entsetzen, Langeweile, Zynismus, Traurigkeit usw.

Identität kommt nicht allein, sondern zusammen mit Gesichtsausdrücken. Zusätzlich können bestimmte Emotionen nur von bestimmten, extremen Winkeln aus verfügbar sein, was dazu tendiert, den Winkel mit der Emotion und umgekehrt zu assoziieren.

Das Problem war, dass die kanonische Identität normalerweise aus Gesichtsaufnahmen abgeleitet werden musste, die nicht neutral waren, so dass die Überzahl von Lächeln und Grinsen, die bei der Sammlung von Stock-Datensätzen erhalten wurden, die Verteilung in Richtung eines “Lächeln-Standard” verschieben würde. Dies lag daran, dass es in den web-gesammelten Trainingsdaten, die diese Modelle informierten, eine hohe Anzahl von roten Teppich-Paparazzi-Aufnahmen gab, sowie an anderen, gleichermaßen speziosen Gründen, warum ein Datensatz zu einer bestimmten Art von Bild tendieren könnte.

Mit anderen Worten, das Autoencoder-System musste versuchen, ein “neutrales” Identitätskonzept aus Tausenden von Bildern zu extrahieren, bei denen die Gesichtszüge durch normale Gesichtsausdrücke verformt wurden.

Es musste auch versuchen, semantische Gesichtskonzepte verschiedener Emotionen von den Winkeln, in denen die Gesichter aufgenommen wurden, zu entflechten. Dies bedeutete, dass, wenn die einzigen verfügbaren “entsetzten” Gesichtsausdrücke aus einem Profilwinkel aufgenommen wurden, das trainierte System nur in der Lage sein würde, diese Emotion optimal aus diesem Winkel zu reproduzieren.

Weiter nach vorne

Als diffusionsbasierte Ansätze ab 2022 die Gen-AI-Bild- (und später Video-) Szene übernahmen, wurden generative Systeme viel besser darin, genaue Gesichtsausdrücke zu extrapolieren, wenn sie mit begrenzten Gesichtsdaten versorgt wurden.

Selbst die sehr schwierige Herausforderung, überzeugende Profilansichten zu erstellen, wurde im aktuellen Stand der Technik nahezu überwunden, während Ausdrucksdaten sehr effektiv von der Identität abgekoppelt wurden – bis zu dem Punkt, an dem die Art von Live-Deepfake-Puppenkommunikation, die von dem autoencoder-getriebenen DeepFaceLive-Streaming-System entwickelt wurde, viele effektive Offline-Diffusionsanwendungen hat, wobei Echtzeit-Darstellung eine wahrscheinliche zukünftige Entwicklung ist:

Bitte klicken, um abzuspielen. Aus dem ‘FlashPortrait’-Projekt, diverse Beispiele für das Steuern von Avataren durch Quellvideos. In diesem Fall ist es nicht wichtig, auf welcher Seite das “realistische” Domäne sitzt, wenn überhaupt. Quelle

Jedoch, da die Leinwand der GenAI sich verbreitert und die Ausgabe sophistizierter wurde, hat sich das Problem der Verflechtung einfach auf mehrere andere Bereiche ausgedehnt – und wird derzeit durch einige billige und alte Tricks “behebt”. Wenn Sie nicht wissen, was diese Tricks sind, könnten Sie eine positivere Einschätzung darüber haben, wie schnell AI-Video und -Bild sich entwickelt und seine alten Fehler überwindet.

Plaudernde Katzen

Es sollte hoffentlich klar sein, warum Identität und Emotion für die alten Autoencoder-Systeme von 2017 schwer zu trennen waren. Es lag daran, dass a) Es zu viel Daten einer Art gab, ODER zu spezifische Versionen einer Art wichtiger Daten, was eine Verteilungsverzerrung verursachen würde; und/oder B) die Modellarchitektur nicht in der Lage war, diese Eigenschaften zu trennen, und tendenziell dazu neigte, sie bei der Inferenzzeit “zusammenzukleben”, es sei denn, der Benutzer nahm außergewöhnliche Sorgfalt darauf, um sicherzustellen, dass der Datensatz ausgewogen war.

Aus genau dem gleichen Grund sind ähnliche Probleme in einer Reihe von Open-Source- und proprietären Video-Modellen in den letzten Jahren aufgetreten, obwohl sie von größeren Kritiken an Halluzinationen, Mangel an Zensur und diverse andere Themen überlagert wurden.

Zum Beispiel haben viele Benutzer im Wan2.+-System festgestellt, dass es sehr schwierig ist, ihre generierten Charaktere davon abzuhalten, ununterbrochen zu sprechen, und oft auch schwierig, sie davon abzuhalten, in die Kamera zu schauen.

Das letztere Problem (in die Kamera schauen oder die vierte Wand durchbrechen) geht auf verschiedene Bild-Only-Diffusions-Systeme zurück, die aufgrund der Häufigkeit von “in die Kamera schauen”-Fotos in web-gesammelten Datensätzen wie LAION entstanden.

Das Problem mit “schwatzhaften” Charakteren entsteht durch die leichte Verfügbarkeit von “Influencer”-Videos auf YouTube, die natürlicherweise Tausende von Stunden von direkter Ansprache bieten, oft kuratiert in Datensätze, in denen Forschungswissenschaftler waschen können, indem sie einen akademischen Kontext bieten.

Aber es sei denn, die ursprünglichen oder nachfolgenden Kuratoren nehmen sich die Mühe, die Anzahl der Videos dieser Art zu begrenzen und sie gegen mehr unterschiedliche Arten von Footage auszugleichen, entwickelt sich ein schwerer Bias im Video-Modell, der durch promptbasierte Abhilfen und diverse Drittanbieter-Systeme angegangen werden muss.

Angesichts des “Schwatzhaftigkeits”-Problems von Wan kam der Reddit-Benutzer u/Several-Estimate-681 auf eine Umgehung, die eine Einstellung im Wan 2.1 Infinite Talk V2V-System nutzt – ein Framework, das darauf ausgelegt ist, influencer-ähnliche Gesprächigkeit zu fördern – das es dem Benutzer ermöglicht, den gerenderten Charakter zu verstummen:

Bitte klicken, um abzuspielen: Nur hören – eine Umgehung, um Charakter-Aufmerksamkeit in Wan2.+ zu erreichen. Quelle

Es ist offensichtlich, dass solche Abkürzungen nicht low-level-Architekturlösungen darstellen und, wenn wahrhafte Lösungen nicht von den Erstellern der Grundmodelle gefunden und implementiert werden (da Hobbyisten normalerweise nicht Millionen von Dollar haben, um solche Arbeiten zu rekreieren oder fein zu justieren), dies bedeutet, dass das Spiel der Verflechtung “Whac-A-Mole” wahrscheinlich bei der nächsten Version auf Null zurückgesetzt wird.

Billig und zerbrechlich

Es gibt nichts in der Diffusionsarchitektur selbst, was diese Probleme unvermeidlich macht; tatsächlich, wenn es eine Möglichkeit gäbe, wirklich effektive Kuratierung, Triage und hochwertige Beschriftung und Annotation auf Hyperscale-Datensätze mit Millionen von Datenpunkten anzuwenden, würden fast alle dieser Probleme wahrscheinlich verschwinden.

Jedoch würde diese Art von Aufmerksamkeit für Details einer Logistik ähneln, die dem Manhattan-Projekt entspricht, was Logistik, Umfang, benötigte Ressourcen und reine langfristige Anstrengung angeht. In einer Atmosphäre, in der eine neue Architektur oder sogar eine neue Architektur-Version den gesamten Umfang einer solchen Anstrengung zunichtemachen könnte, gibt es derzeit keinen Willen, sich zu diesem Engagement zu bekennen.

Folglich, solange es konform mit der Erlangung von verwendbaren Modellen ist, bleiben die billigsten Ansätze bevorzugt. Ein Beispiel für “Geiz” ist Data-Augmentation, das, wenn es liberal und auf die falschen Arten von Datensätzen angewendet wird, lachhafte Ergebnisse haben kann:

Da Data-Augmentation oft die Richtung von Quellvideos im Datensatz umkehrt, kann das KI-Modell gelegentlich “unmögliche” Bewegungen lernen. – Quelle

Jedoch neigen Felsbrocken, die bergauf rollen, und Menschen, die die Charaktere durchbrechen, indem sie “Influencer-Modus” aktivieren, dazu, als Kollateralschäden in generativen Systemen angesehen zu werden, die trotz solcher anhaltenden Fehler und Achillesferse coaxed werden können, um beeindruckende Ergebnisse und ausreichend beeindruckende Schlagzeilen zu produzieren.

Standardlösungen

In der aktuellen Periode genießen Hunderte von generativen Video-Domains, fast alle von denen auf eine oder andere Weise die neue Flut von Gesetzen und Gegenreaktionen gegen GenAI brechen, ihre Zeit an der Trough, bevor Strafverfolgung, Blocklisten oder andere Arten von Deplatforming diese kommerziellen Dienste entfernen.

Die größeren und bekannteren Sites dieser Art, wie Kling und Grok, neigen dazu, entweder einer Form von Selbstzensur (schließlich) zu folgen oder auf Kritik zu reagieren, indem sie die Arten von Inhalten ändern, die ihre Plattformen für Benutzer ermöglichen.

Aber hinter diesen großen Namen sind Hunderte von anderen flüchtigen Operationen, die ständig der Nachfrage nach neuen (und oft extremen) Arten von Inhalten nachkommen.

Diese Art von Low-Effort-Bereitstellung schließt den extrem hohen Kosten- und Aufwand für das Training von Grundmodellen von Grund auf aus. Sehr oft ist sogar Feinabstimmung, die erheblich weniger kostet, ausgeschlossen.

Daher bieten diese Sites “Vorlagen” an, die 100% identisch in der Praxis mit benutzerdefiniert trainierten LoRAs sind, die von KI-Hobbyisten bereits seit über vier Jahren verwendet werden, um jede gewünschte Identität, Stil, Objekt und (im Falle von Video-LoRAs) Bewegung oder Aktion in ein dediziertes LoRA-Add-On zu trainieren.

Mit dem LoRA zwischen dem Benutzer und dem Grundmodell werden die erzielten Ergebnisse sehr spezifisch für das sein, worauf der LoRA trainiert wurde, und normalerweise wird die breitere Leistung des Modells durch den gewichtsverzerrenden Einfluss des LoRA untergraben, der sein eigenes Thema sehr gut reproduzieren wird, aber auch dieses Material in jede Anfrage hineinprojizieren wird (wenn die flüchtigen GenAI-Video-Sites diese Art von Kontrolle zulassen – sie tun es nicht; sie bieten einfach eine [AKTION IHRER WAHL]-Vorlage an und interpretieren Ihre Eingabetexte/Bilder/Videos auf die Weise, die am wahrscheinlichsten zu einer erfolgreichen Anwendung der Vorlage führt).

Aus offensichtlichen Gründen kann ich in diesem Artikel keine Website-Beispiele einbetten; aber die Forschungsliteratur hat kürzlich einige analoge Beispiele angeboten. Hier zum Beispiel zeigt das EffectMaker-Projekt das Prinzip in Aktion, bei dem eine spezifische Aktion auf ein benutzerdefiniertes Bild angewendet wird:

Bitte klicken, um abzuspielen. In EffectMaker können fein abgestimmte spezifische Effekte auf benutzerdefinierte Eingaben angewendet werden. Quelle

Selbst in diesen hoch kuratierten und gezielten Umständen klagen Benutzer oft, dass mehrere, token-verbrennende Versuche unternommen werden müssen, um ein gutes Ergebnis zu erzielen, und wir sollten nicht vielleicht der Anbieter-Gier oder scharfen Praktiken zuschreiben, was eher das Verschulden der kongenital “hit-and-miss”-DiT-GenAI-Rahmenwerke ist.

Die breite Öffentlichkeit könnte argumentieren, dass sie ihre Vorstellung von den Fähigkeiten der GenAI aus ausgewählten Beispielen ableitet, die nicht repräsentativ für das sind, was ein gelegentlicher, unerfahrener Benutzer wahrscheinlich erzielen würde. Wenn ein Benutzer sechs Versuche mit einer Vorlage (d. h. einem LoRA, das von der KI-Website bereitgestellt wird) durchführt, wird er tendenziell das Beste davon veröffentlichen und loben, was den Eindruck vermittelt, dass man solche Ergebnisse durch Abfrage des Basis-Modells erzielen könnte – und den Eindruck vermittelt, dass generative Grundmodelle viel mehr entflochten sind, als sie es tatsächlich sind.

Schlussfolgerung

Die Literatur untersucht weiterhin das Problem der Verflechtung, das erstmals um 2020 ernsthaft in den Blick geriet, in der Max-Planck/Google-Zusammenarbeit Ein nüchterner Blick auf das unüberwachte Lernen von entflochtenen Darstellungen und ihre Bewertung.

Zusätzlich tauchen verschiedene Nachfolger von Entflechtung durch Kontrast (DisCo) regelmäßig auf, und die Szene bleibt lebendig mit einem Bewusstsein für das Problem, das die öffentliche Wahrnehmung von dem, was AI nicht kann, in dieser Hinsicht übertrifft.

Eine chinesische Studie aus 2024 legt nahe, dass eine Lösung für die Verflechtung nicht notwendig sein muss, um die Probleme zu lösen, die sie mit sich bringt. Historisch gesehen stimmt dies, da viele unüberwindliche Probleme in der Computer-Vision nicht gelöst, sondern durch völlig neue Techniken und Ansätze überwunden wurden.

Bis ein diskreter Nachfolger auftritt, scheint es, dass wir weiterhin Hot-Fixes und Pflaster auf die Mängel und Einschränkungen der GenAI anwenden müssen und die öffentliche Überschätzung der Flexibilität und Duktilität der Grundmodelle hinnehmen müssen.

Erstveröffentlichung am Montag, den 23. März 2026