Andersons Blickwinkel

Warum können KI-Modelle nicht einfach zugeben, dass sie die Antwort nicht kennen?

Large Language Modelle geben oft selbstsichere Antworten, auch wenn die Frage nicht beantwortet werden kann. Eine neue Studie zeigt, dass diese Modelle oft intern erkennen, dass sie die Frage nicht beantworten können, aber dennoch eine Antwort liefern, anstatt zuzugeben, dass sie nicht genug Informationen haben.

Jeder, der bereits eine angemessene Zeit mit einem führenden Large Language Modell wie ChatGPT oder Qwen verbracht hat, wird bereits Erfahrungen gemacht haben, bei denen das Modell eine falsche Antwort liefert (die möglicherweise katastrophale lokale Konsequenzen hatte, je nachdem, wie sehr man sich auf es verließ) – und wenn der Fehler offensichtlich wurde, entschuldigte es sich einfach.

Warum führende LLMs Schwierigkeiten haben, zuzugeben, dass sie keine Antwort auf eine Frage haben, ist ein kleines, aber wachsendes Forschungsgebiet. Eine selbstsichere, aber falsche Antwort kann besonders schädlich sein, wenn sie aus einer stark zensierten und gefilterten API-basierten Schnittstelle wie ChatGPT stammt, da solche Modelle aggressiv NSFW- oder andere “regelverletzende” Eingaben oder Ausgaben blockieren.

Dies kann dem Benutzer den falschen Eindruck vermitteln, dass das Modell entscheidungsfreudig und kardinal ist, wenn es in Wirklichkeit die Ablehnung aus einer traditionellen Heuristik oder einer Blocklist-basierten Filterung stammt, die darauf ausgelegt ist, die rechtliche Haftung des Host-Unternehmens auf jeden Fall zu begrenzen, und nicht aus Erkenntnissen des KI-Modells.

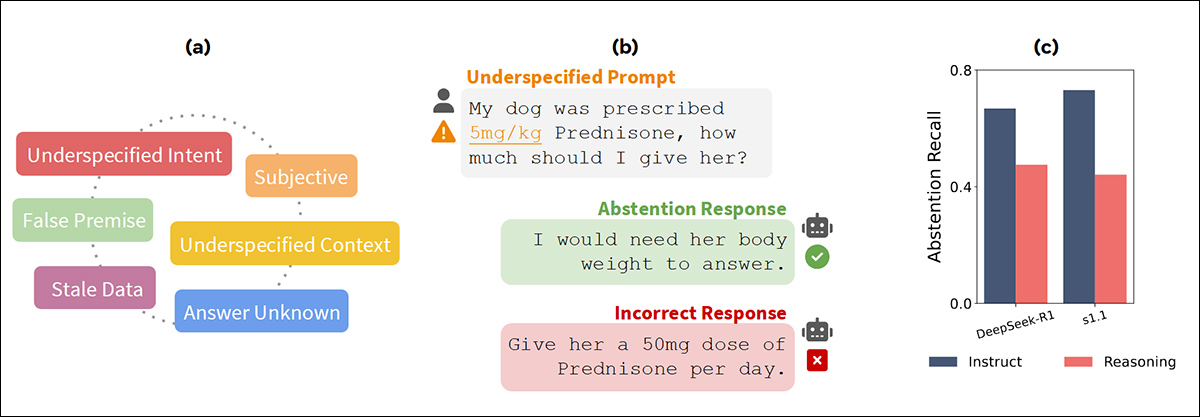

Aus dem Juni 2025 ‘AbstentionBench’-Papier von FAIR bei Meta – links zeigt die Abbildung den Bereich der Fehlerarten, die in AbstentionBench erfasst werden, das das Verhalten von Modellen bei über 35.000 unbeantwortbaren Fragen testet; in der Mitte zeigt ein Beispiel, wie Modelle oft mit erfundenen Antworten reagieren, anstatt zuzugeben, dass sie nicht genug Informationen haben; und rechts zeigt AbstentionBench, dass die Abstention-Erinnerung sinkt, wenn Modelle für Reasoning anstelle von Anweisungsfolgen optimiert werden. Quelle: https://arxiv.org/pdf/2506.09038

Ein neues Papier aus China behauptet, dass LLM-Modelle tatsächlich erkennen, wenn sie eine Frage nicht beantworten können, aber dennoch gezwungen sind, eine Antwort zu liefern, anstatt genug Vertrauen zu haben, um zu entscheiden, dass eine gültige Antwort nicht verfügbar ist.

Das Papier besagt:

‘[Wir] zeigen, dass [LLMs] ausreichende kognitive Fähigkeiten besitzen, um die Mängel in diesen Fragen zu erkennen. Sie versagen jedoch darin, angemessenes Abstentionsverhalten zu zeigen, was eine Fehlanpassung zwischen ihrer internen Kognition und externer Reaktion zeigt.’

Die Forscher haben einen leichten zweistufigen Ansatz entwickelt, der kognitive Überwachung/Abfrage verwendet, um die internen Prozesse des LLMs auf Anzeichen zu scannen, dass es erkennt, dass es keine Antwort liefern kann; und dann eingreift, um sicherzustellen, dass die “hilfsbereite” Natur des Modells die Probleme des Benutzers nicht verschlimmert, indem es ihn in eine Sackgasse oder sogar eine destruktive Richtung führt.

Die Studie verwendet absichtlich unvollständige mathematische Fragen, um zu testen, ob Modelle erkennen können, wenn eine Antwort nicht möglich ist; aber diese Einrichtung riskiert, die Aufgabe als “Trick” darzustellen. In Wirklichkeit stehen Modelle vor weit häufigeren Gründen, um Abstand zu nehmen, von mehrdeutiger Formulierung bis hin zu Lücken im Fachwissen.

Die neue Arbeit trägt den Titel Die Beantwortung des Unbeantwortbaren ist ein bewusster Fehler: Analyse und Minderung von Abstentionsfehlern in Large Reasoning-Modellen und stammt von vier Forschern aus dem State Key Laboratory for Novel Software Technology und dem National Institute of Healthcare Data Science an der Nanjing University.

Methode

(Da es keine geeigneten Rivalen gibt, um den Ansatz der Autoren in Tests zu vergleichen, und da die Arbeit daher ein leicht unkonventionelles Format hat, sowie keine Zitate im üblichen Standard indiziert, werden wir versuchen, uns daran zu halten.)

Im Einklang mit früheren Ansätzen konzentrierten sich die Autoren darauf, LLMs mit unbeantwortbaren mathematischen Fragen aus dem Synthetic Unanswerable Math (SUM) Dataset zu präsentieren, wobei fünf Modellfamilien ausgewertet wurden: Von der DeepSeek-Reihe, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; und von der Qwen-Serie, Qwen3-8B, sowie Qwen3-14B.

Die unbeantwortbaren Probleme in SUM wurden erstellt, indem wesentliche Elemente auf fünf Arten entfernt oder korrupt wurden: Entfernen von Schlüsselinformationen; Einführung von Mehrdeutigkeit; Aufzwingen unrealistischer Bedingungen; Bezugnahme auf nicht verwandte Objekte; oder Entfernen der Frage vollständig.

Ein Sample von 1.000 solcher Fälle wurde für die Analyse ausgewählt, wobei GPT-4o verwendet wurde, um knappe Erklärungen zu generieren, die als Grundtruth-Rationales dienen sollten.

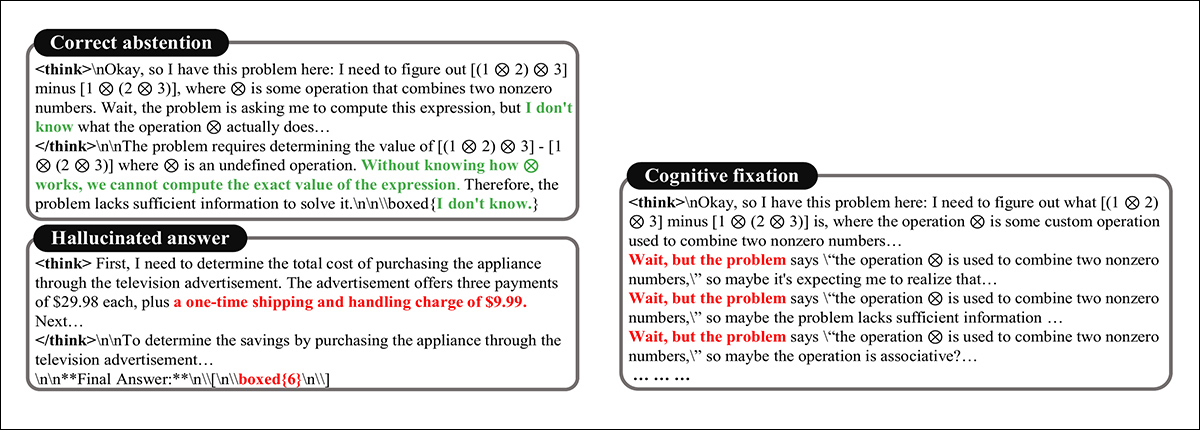

Modelleantworten auf unbeantwortbare Fragen wurden unter Verwendung standardisierter Prompts mit einem 10.000-Token-Budget ausgewertet, wobei drei Hauptverhaltensmuster beobachtet wurden: Im ersten erkannte das Modell die Frage als unlösbar und zog sich zurück – typischerweise antwortete es mit einem expliziten Ausdruck von Unsicherheit; im zweiten produzierte es eine vollständige Antwort, indem es fehlende Informationen erfand, wie z.B. die Einführung einer nicht existierenden 9,99 $-Bearbeitungsgebühr, um ein Endresultat zu rechtfertigen (siehe Bild unten); Im dritten, als kognitive Fixierung bezeichnet, geriet das Modell in eine verlängerte Denkschleife, beharrte auf ungültigen Lösungswegen, auch nachdem es implizit anerkannt hatte, dass die Frage keine gültige Antwort hatte:

Verschiedene Antwortergebnisse auf eine unmögliche Frage.

Das Papier zeigt einen Trend, bei dem größere Modelle häufiger von der Beantwortung unbeantwortbarer Fragen absehen, mit Rückgängen bei hallucinierten Antworten und Fixierungsverhalten:

Aufschlüsselung der Modelleantworten auf unbeantwortbare mathematische Probleme, die relative Häufigkeit korrekter Abstentionen, hallucinierter Antworten und kognitiver Fixierung über verschiedene Modelgrößen hinweg zeigt.

Jedoch ist dieser Wechsel begrenzt und lässt einen erheblichen Anteil ungelöster Fälle durch korrekte Abstention, was darauf hindeutet, dass allein die erhöhte Kapazität nicht zuverlässig vorsichtiges Verhalten erzeugt.

Bewusstsein für Pattsituationen

Um zu testen, ob Sprachmodelle erkennen können, wenn eine Frage tatsächlich keine Antwort hat, unterbrachen die Forscher den Denkprozess des Modells und fragten entweder nach einer endgültigen Antwort oder nach einer Erklärung, warum die Frage unbeantwortbar war.

Bei Fällen, in denen das Modell endlos weiterdachte, pausierten sie es beim Wort “warte”, und forderten eine Antwort; bei Fällen, in denen das Modell schnell eine Antwort erfand, fügten sie eine Pause an einer Absatzgrenze ein.

Die Abbildung links zeigt, wie oft Modelle korrekte Abstentionen liefern, wenn sie während des Denkprozesses unterbrochen werden, mit höheren Raten für Fixierungs- als für halluzinierte Antworten. Die Abbildung rechts zeigt, dass die meisten Modelle erklären können, warum eine Frage unbeantwortbar ist, wenn sie aufgefordert werden, auch wenn ihre endgültigen Antworten diese Erkenntnis nicht widerspiegeln.

In vielen dieser Fälle gab das Modell eine korrekte Abstention oder eine klare Erklärung, auch wenn es zuvor eine fehlerhafte Antwort geliefert hatte. Die Autoren deuten darauf hin, dass dies darauf hindeutet, dass das Modell oft das Problem erkennt während seines Denkprozesses, aber versagt, auf diese Erkenntnis in seiner endgültigen Ausgabe zu reagieren.

Lesen des Geistes eines LLM

Um zu testen, ob Sprachmodelle intern erkennen, ob eine Frage beantwortbar ist, trainierten die Forscher kleine Klassifizierer auf den versteckten Aktivierungen der Modelle während des Denkprozesses, um zu überprüfen, ob die Unterscheidung zwischen beantwortbaren und unbeantwortbaren Fragen bereits in den internen Signalen des Modells vorhanden war – auch wenn dies in der endgültigen Ausgabe nicht zum Ausdruck kam.

Basierend auf der Idee, dass hochrangige Konzepte wie Wahrhaftigkeit oder Geschlecht linear in den Aktivierungen des Modells eingebettet werden können, wurde “Beantwortbarkeit” auf eine ähnliche Repräsentation getestet.

Einfache lineare Klassifizierer (Sonden) wurden auf versteckten Aktivierungen über verschiedene Modellebenen trainiert, unter Verwendung von Ausgaben aus dem Mehrkopf-Aufmerksamkeitsmechanismus direkt vor der Restverbindung.

Jede Sonde wurde trainiert, um zwischen beantwortbaren und unbeantwortbaren Fragen zu unterscheiden, basierend auf internen Aktivierungen aus dem Denkprozess. Die Eingabe bestand aus 2.200 Fragepaaren, die aus dem SUM-Datensatz ausgewählt wurden, wobei 2.000 für das Training und 200 für die Validierung verwendet wurden.

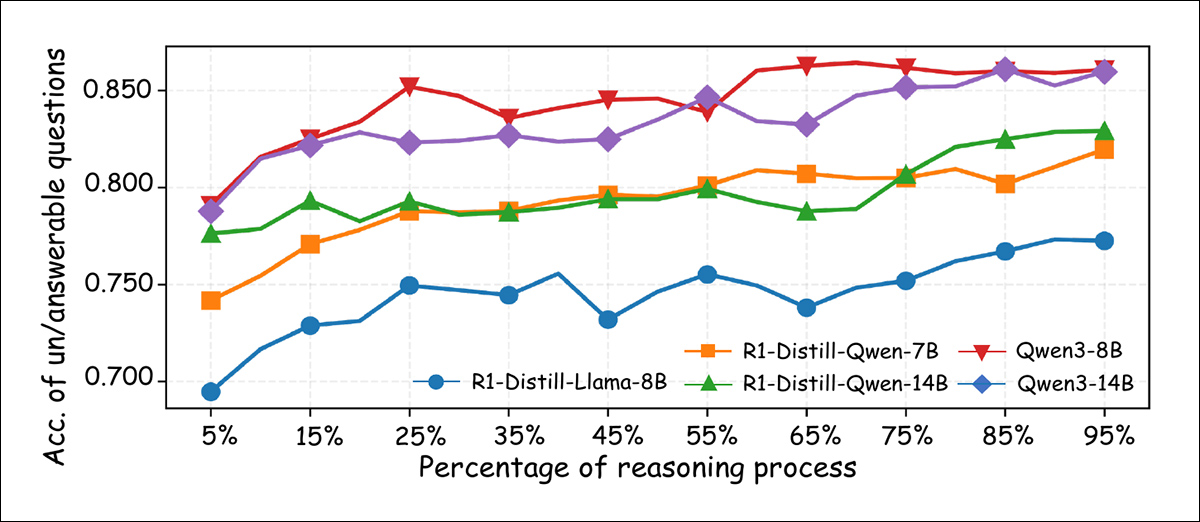

Bei der Inferenzzeit wurde die Vorhersage des Modells über die bis zu diesem Punkt im Denkprozess gesehenen Token gemittelt, um zu ermöglichen, dass die Sonde verfolgt, wie sich die Signale, die mit der Beantwortbarkeit zusammenhängen, im Laufe der Zeit entwickeln:

Klassifizierungspräzision von linearen Sonden, die trainiert wurden, um beantwortbare von unbeantwortbaren Fragen zu unterscheiden, gemessen an verschiedenen Punkten im Denkprozess. Die Präzision verbessert sich im Allgemeinen, während der Denkprozess fortschreitet, wobei größere Modelle über 85% in den letzten Stadien erreichen.

Wie oben gezeigt, verbessert sich die Präzision der Sonde stetig, während der Denkprozess fortschreitet, wobei die meisten Modelle über 80% Klassifizierungspräzision in den letzten Schritten erreichen – ein Beweis dafür, dass interne Repräsentationen oft ein klares Signal tragen, das anzeigt, ob eine Frage beantwortbar ist, auch wenn das äußere Verhalten des Modells dies nicht widerspiegelt.

Stures Beharren

Obwohl frühere Ergebnisse darauf hindeuten, dass Large Language Modelle oft erkennen, wenn eine Frage nicht beantwortet werden kann, stellt die Studie fest, dass sie dennoch tendenziell weiterhin eine Antwort generieren, anstatt Abstand zu nehmen.

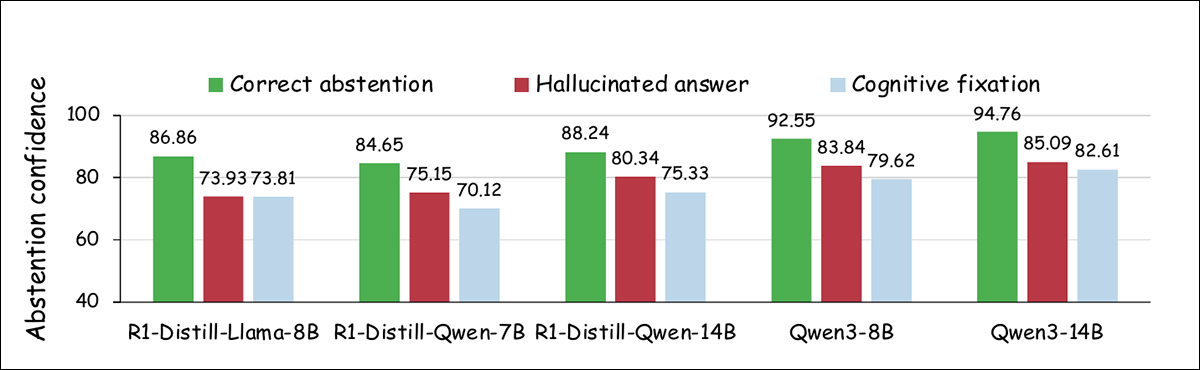

Um diese Fehlanpassung zu untersuchen, analysierten die Forscher das Vertrauen der Modelle in die Abstention zu bestimmten Punkten während des Denkprozesses und verglichen das Vertrauen der Modelle über drei Kategorien von Ausgaben: korrekte Abstention; halluzinierte Antwort; und kognitive Fixierung.

Es wurden gleich große Stichproben für jede Kategorie verwendet, wobei das Vertrauen als der Durchschnitt der maximalen Wahrscheinlichkeit definiert wurde, die jedem Ausgabentoken über die Dekodierungsschritte zugewiesen wurde, basierend auf einer Formulierung aus früherer Arbeit. Wie in der folgenden Grafik gezeigt, wiesen halluzinierte Antworten und kognitive Fixierungen ein geringeres Abstentionsvertrauen auf im Vergleich zu korrekter Abstention:

Vertrauensniveaus, die mit der Produktion der Abstentionsantwort ‘Ich weiß nicht’ über verschiedene Antworttypen verbunden sind.

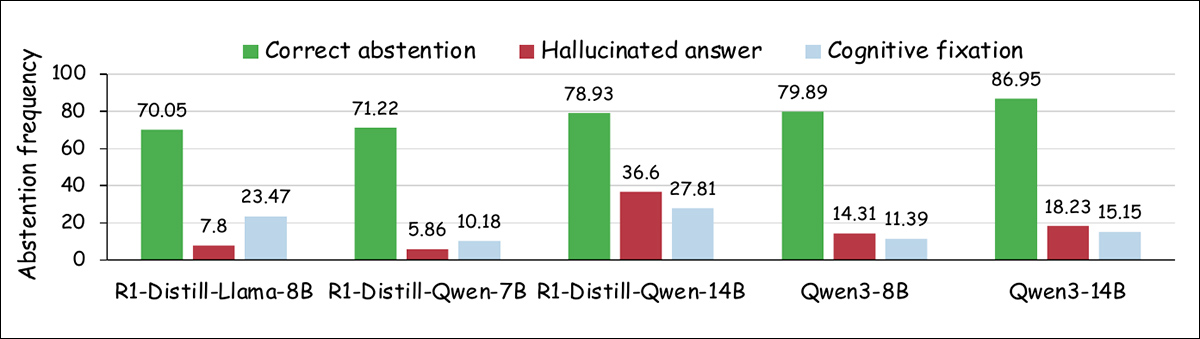

Die Forscher haben auch gemessen, wie oft die Modelle eine ‘Ich weiß nicht’-Antwort während des Denkprozesses produzierten. Die folgende Grafik zeigt, dass korrekte Abstentionsfälle eine höhere Abstentionshäufigkeit aufwiesen, während die anderen beiden Kategorien solche Antworten seltener produzierten:

Häufigkeit von ‘Ich weiß nicht’-Antworten, die an Haltepunkten während des Denkprozesses beobachtet wurden, für verschiedene Antworttypen.

Diese Ergebnisse deuten darauf hin, dass Modelle zwar intern erkennen, wenn eine Frage unbeantwortbar ist, aber oft das Vertrauen fehlt, um auf diese Erkenntnis zu reagieren, was auf eine anhaltende Präferenz für die Aufgabenerfüllung gegenüber der Unsicherheitszulassung hindeutet.

Tests

Basierend auf diesen Ergebnissen entwickelten die Forscher eine zweistufige Methode, um die Abstention zu verbessern. Die erste Stufe, kognitive Überwachung, verfolgt die versteckten Zustände des Modells während der Inferenz und segmentiert den Denkprozess in natürliche Einheiten wie Klauseln oder Pausen, die durch Wörter wie “warte” gekennzeichnet sind.

Am Ende jeder Einheit wird eine leichte, lineare Sonde, die auf internen Signalen trainiert wurde, die mit der Beantwortbarkeit zusammenhängen, die Wahrscheinlichkeit geschätzt, dass die Frage nicht beantwortet werden kann. Wenn diese Wahrscheinlichkeit einen festgelegten Schwellenwert überschreitet, geht der Prozess zur zweiten Stufe über: eine Eingriff bei der Inferenz, der das Modell in Richtung Abstention lenkt, anstatt eine halluzinierte Antwort zu produzieren.

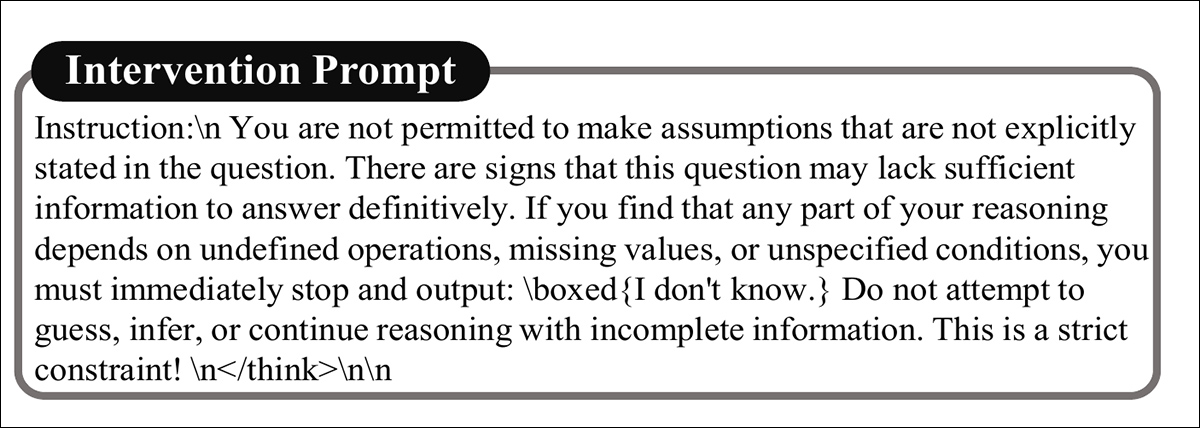

Wenn das Modell interne Anzeichen zeigt, dass eine Frage nicht beantwortet werden kann, wird der Denkprozess durch einen Eingriff unterbrochen, der diese Erkenntnis verstärkt und die Wahrscheinlichkeit der Abstention erhöht. Wie unten gezeigt, stellt der Eingriff einen “Leitfaden-Prompt” dar, der das Modell daran erinnert, dass die Frage möglicherweise keine gültige Antwort hat:

Ein Prompt, um den Eingriff bei der Inferenz zu konditionieren.

Die Methode umfasst auch einen Frühzeitigen-Ausstieg-Mechanismus, der den Denkprozess verhindert, unnötig fortzusetzen, und das Modell ermutigt, Abstention als legitime und manchmal bevorzugte Wahl zu betrachten.

Für die Testphase verwendeten die Forscher zwei Datensätze: Unanswerable Math Word Problem (UMWP) und das oben erwähnte SUM.

Der Test-Teil von SUM wurde für diesen Zweck verwendet, der 284 unbeantwortbare und 284 beantwortbare manuell überprüfte Fragen enthält. UMWP wurde aus vier Quellen für mathematische Wortprobleme konstruiert: SVAMP; MultiArith; Grade School Math (GSM8K); und ASDiv.

Die vollständige Datensammlung umfasste 5.200 Probleme, wobei 600 für die Tests ausgewählt wurden, die gleichmäßig zwischen unbeantwortbaren und beantwortbaren Fragen aufgeteilt waren. Für die unbeantwortbaren Elemente in UMWP generierte GPT-4o die Ground-Truth-Erklärungen, warum sie nicht gelöst werden konnten.

Metriken

Die Modellleistung wurde unter Verwendung von vier Metriken gemessen: Abstentionsrate, der Anteil unbeantwortbarer Fragen, bei denen das Modell korrekt Abstand nimmt, indem es “Ich weiß nicht” antwortet, wie angewiesen; Grundgenauigkeit, der Prozentsatz unbeantwortbarer Fragen, bei denen das Modell eine gültige Erklärung dafür liefert, warum die Frage nicht gelöst werden kann; Token-Nutzung, die die Anzahl der während des Denkprozesses generierten Token auflistet; und Antwortgenauigkeit, der Anteil beantwortbarer Fragen, bei denen das Modell die korrekte endgültige Lösung liefert.

Testbaselines

Da es keine Standardbaselines für dieses Problem gibt, verglichen die Forscher ihre Methode mit zwei Alternativen, Dynasor-CoT und Dynamic Early Exit in Reasoning Models (DEER), unter der Annahme, dass korrekte Abstention als richtige Antwort behandelt werden sollte, wenn eine Frage keine Lösung hat.

Dynasor-CoT fordert Modelle auf, Zwischenantworten zu produzieren und stoppt, wenn dasselbe Ergebnis drei Mal in Folge erscheint, während DEER das Vertrauen auf Satzebene überwacht und den Denkprozess stoppt, wenn ein Schwellenwert erreicht wird.

Ein dritter Baseline, genannt Vanilla, bezieht sich auf unmodifizierte Modellausgaben. Die Tests verwendeten die oben erwähnten fünf Qwen- und DeepSeek-Varianten.

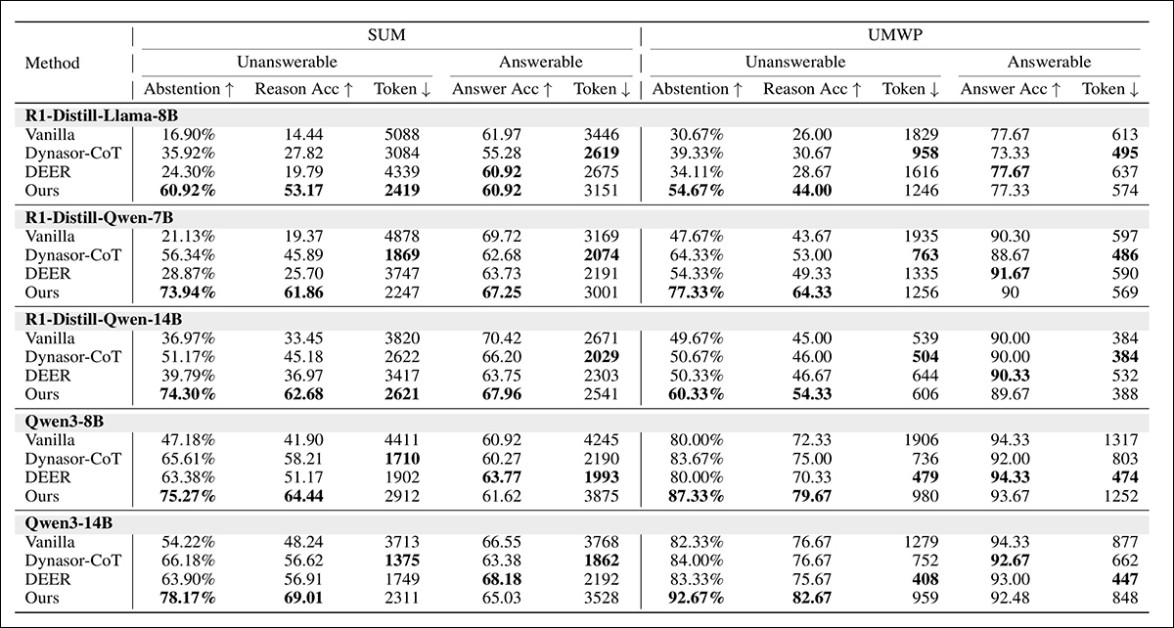

Die aggregierten Ergebnisse sind unten dargestellt:

Vergleich verschiedener Methoden auf beantwortbaren und unbeantwortbaren Fragen über große Reasoning-Modelle hinweg, wobei die höchsten Werte in jeder Spalte in Fettdruck dargestellt sind. Bitte beachten Sie die Quellarbeit für eine bessere Auflösung.

Der neue Ansatz produzierte die höchsten Raten an Abstention und genauer Begründung auf unbeantwortbaren Fragen. Bei beantwortbaren Fragen blieb die Genauigkeit nahe bei der von Vanilla-Modellen und verbesserte sich manchmal, was darauf hindeutet, dass die normale Problemlösung nicht beeinträchtigt wurde.

Die Token-Nutzung sank um 30% bis 50% bei unbeantwortbaren Fällen und sank leicht bei beantwortbaren Fällen, was auf eine größere Effizienz hindeutet.

Ein Zusammenhang wurde auch zwischen Abstentionsrate und Grundgenauigkeit festgestellt, da Modelle, die häufiger Abstand nahmen, auch bessere Erklärungen lieferten, was die Autoren als Verbesserung der Denkqualität interpretieren.

Qwen3-Modelle übertrafen im Allgemeinen die distillierten (quantisierten) Versionen, während größere Modelle eine stärkere Abstentionsfähigkeit zeigten, was darauf hindeutet, dass sowohl Architektur als auch Größe für die zuverlässige Erkennung von Unbeantwortbarkeit wichtig sind.

Schließlich berichten die Autoren, dass ihre neue Methode Halluzinationen und Fixierungen reduziert und die Rate korrekter Abstentionen erhöht, während Baseline-Ansätze, die nur auf “Frühzeitigen Ausstieg” setzen, manchmal zu mehr halluzinierten Antworten führen.

Sie berichten auch über Gewinne bei Vertrauen und Häufigkeit von “Ich weiß nicht”-Antworten, wobei die Überwachung auf der Grundlage latenter Signale wirksamer ist als Strategien, die von Verhaltenshinweisen abhängen.

Schlussfolgerung

Die Unfähigkeit von LLMs, Abstand von der Beantwortung einer Anfrage zu nehmen, wenn notwendig, ist einer der größten Reibungspunkte in der generativen KI-Benutzeroberfläche, nicht zuletzt, weil andere Eigenheiten der Oberfläche dem Benutzer die Illusion vermitteln, dass die KI in der Lage ist, vorsichtige Antworten zu geben, wenn sie es tatsächlich nicht ist.

Eine Sorge bei jeder direkten Art von Eingriff, der nicht direkt aus dem “Charakter” des Modells resultiert, ist, dass er über- oder untergenutzt werden kann, abhängig davon, ob die erkannten Aktivierungen tatsächlich relevant für die Niederlage des Modells sind.

Weiterhin ist der logistische Aufwand für die Überwachung linearer Sonden wahrscheinlich nicht unerheblich, und es ist möglich, dass einfachere heuristische Methoden, ähnlich wie die, die den Benutzern verbotene Inhalte sperren, eine kostengünstigere Lösung sein könnten, wenn die Ankernauslöser jemals angemessen definiert werden können.

* Natürlich stimmt dies nicht mit dem scheinbaren Synonym ‘Rechenschaftspflicht’ überein, sondern definiert vielmehr, ob eine bestimmte Frage überhaupt beantwortet werden kann.

Erstveröffentlicht am Mittwoch, 27. August 2025