Künstliche allgemeine Intelligenz

Die Rolle von Vektordatenbanken in modernen generativen KI-Anwendungen

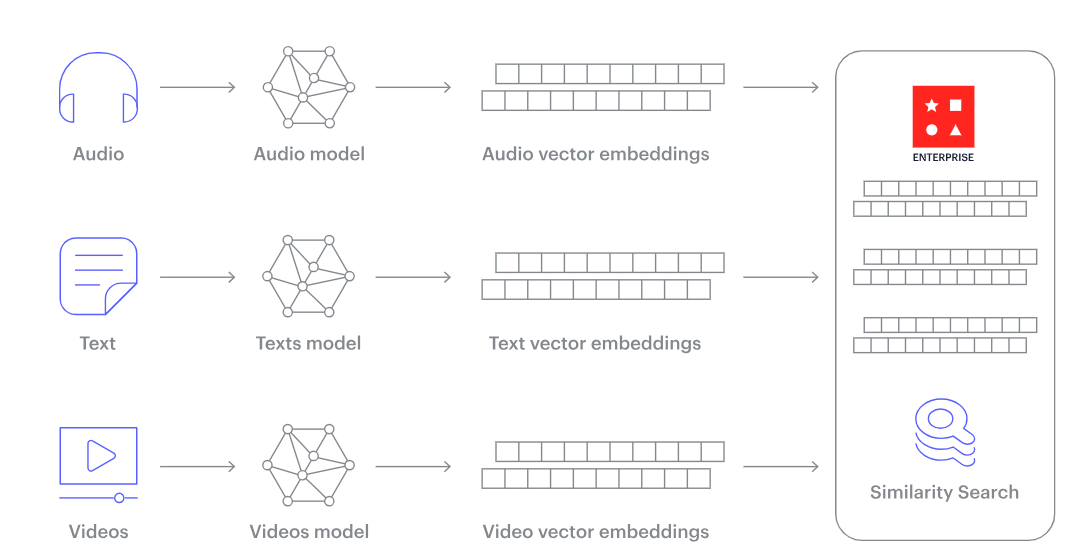

Damit groß angelegte generative KI-Anwendungen effektiv funktionieren, ist ein gutes System zur Verarbeitung großer Datenmengen erforderlich. Ein solches wichtiges System ist die Vektordatenbank. Was diese Datenbank auszeichnet, ist ihre Fähigkeit, viele Arten von Daten wie Text, Ton, Bilder und Videos in Zahlen-/Vektorform zu verarbeiten.

Was sind Vektordatenbanken?

Die Vektordatenbank ist ein spezielles Speichersystem, das für die effiziente Verarbeitung hochdimensionaler Vektoren entwickelt wurde. Diese Vektoren, die man sich als Punkte in einem mehrdimensionalen Raum vorstellen kann, stellen oft Einbettungen oder komprimierte Darstellungen komplexerer Daten wie Bilder, Text oder Ton dar.

Vektordatenbanken ermöglichen eine schnelle Suche nach Ähnlichkeiten zwischen diesen Vektoren und ermöglichen so den schnellen Abruf der ähnlichsten Elemente aus einem umfangreichen Datensatz.

Traditionelle Datenbanken vs. Vektordatenbanken

Vektordatenbanken:

- Verarbeitet hochdimensionale Daten: Vektordatenbanken dienen der Verwaltung und Speicherung von Daten in hochdimensionalen Räumen. Dies ist besonders nützlich für Anwendungen wie maschinelles Lernen, bei denen Datenpunkte (wie Bilder oder Text) als Vektoren in mehrdimensionalen Räumen dargestellt werden können.

- Optimiert für die Ähnlichkeitssuche: Ein herausragendes Merkmal von Vektordatenbanken ist ihre Fähigkeit, Ähnlichkeitssuchen durchzuführen. Anstatt Daten auf der Grundlage exakter Übereinstimmungen abzufragen, ermöglichen diese Datenbanken Benutzern das Abrufen von Daten, die einer bestimmten Abfrage „ähnlich“ sind, was sie für Aufgaben wie das Abrufen von Bildern oder Texten von unschätzbarem Wert macht.

- Skalierbar für große Datensätze: Da KI- und maschinelle Lernanwendungen weiter wachsen, wächst auch die Menge der von ihnen verarbeiteten Daten. Vector-Datenbanken sind skalierbar und stellen sicher, dass sie große Datenmengen ohne Leistungseinbußen verarbeiten können.

Traditionelle Datenbanken:

- Strukturierte Datenspeicherung: Herkömmliche Datenbanken sind wie relationale Datenbanken für die Speicherung strukturierter Daten konzipiert. Dies bedeutet, dass die Daten in vordefinierten Tabellen, Zeilen und Spalten organisiert sind, wodurch Datenintegrität und -konsistenz gewährleistet werden.

- Optimiert für CRUD-Operationen: Herkömmliche Datenbanken sind hauptsächlich für CRUD-Operationen optimiert. Das bedeutet, dass sie darauf ausgelegt sind, Dateneinträge effizient zu erstellen, zu lesen, zu aktualisieren und zu löschen, wodurch sie für eine Vielzahl von Anwendungen geeignet sind, von Webdiensten bis hin zu Unternehmenssoftware.

- Festes Schema: Eines der bestimmenden Merkmale vieler traditioneller Datenbanken ist ihr festes Schema. Sobald die Datenbankstruktur definiert ist, können Änderungen komplex und zeitaufwändig sein. Diese Starrheit stellt die Datenkonsistenz sicher, kann jedoch weniger flexibel sein als die schemalose oder dynamische Schemanatur einiger moderner Datenbanken.

Herkömmliche Datenbanken haben oft mit der Komplexität der Einbettungen zu kämpfen, eine Herausforderung, die Vektordatenbanken problemlos bewältigen können.

Vektordarstellungen

Zentral für die Funktionsweise von Vektordatenbanken ist das grundlegende Konzept, verschiedene Datenformen mithilfe numerischer Vektoren darzustellen. Nehmen wir als Beispiel ein Bild. Wenn Sie ein Katzenbild sehen, mag es für uns vielleicht nur ein niedliches Katzenbild sein, für eine Maschine kann es jedoch in einen einzigartigen 512-dimensionalen Vektor umgewandelt werden, wie zum Beispiel:

[0.23, 0.54, 0.32, …, 0.12, 0.45, 0.90]

Mit Vektordatenbanken bietet die generative KI-Anwendung mehr Möglichkeiten. Sie kann Informationen anhand ihrer Bedeutung finden und sich Dinge langfristig merken. Interessanterweise ist diese Methode nicht nur auf Bilder beschränkt. Auch Textdaten mit kontextuellen und semantischen Bedeutungen können in Vektorform gebracht werden.

Generative KI und der Bedarf an Vektordatenbanken

Generative KI beinhaltet oft Einbettungen. Nehmen wir zum Beispiel Worteinbettungen in der Verarbeitung natürlicher Sprache (NLP). Wörter oder Sätze werden in Vektoren umgewandelt, die semantische Bedeutung erfassen. Bei der Generierung von menschenähnlichem Text müssen Modelle relevante Einbettungen schnell vergleichen und abrufen, um sicherzustellen, dass der generierte Text seine kontextbezogene Bedeutung beibehält.

Ebenso spielen Einbettungen bei der Bild- oder Tonerzeugung eine entscheidende Rolle bei der Kodierung von Mustern und Merkmalen. Damit diese Modelle optimal funktionieren, benötigen sie eine Datenbank, die den sofortigen Abruf ähnlicher Vektoren ermöglicht, was Vektordatenbanken zu einem wesentlichen Bestandteil des generativen KI-Puzzles macht.

Das Erstellen von Einbettungen für natürliche Sprache erfordert normalerweise die Verwendung vorab trainierter Modelle wie:

- GPT-3 und GPT-4: GPA-3 von OpenAI (Generative Pre-trained Transformer 3) ist mit 175 Milliarden Parametern ein monumentales Modell in der NLP-Community. Anschließend verschiebt GPT-4 mit einer noch größeren Anzahl von Parametern weiterhin die Grenzen bei der Generierung hochwertiger Einbettungen. Diese Modelle werden auf verschiedenen Datensätzen trainiert und können so Einbettungen erstellen, die ein breites Spektrum sprachlicher Nuancen erfassen.

- BERT und seine Varianten: BERT (Bidirectional Encoder Representations from Transformers) von Google ist ein weiteres wichtiges Modell, das verschiedene Updates und Iterationen wie RoBERTa und DistillBERT erfahren hat. Das bidirektionale Training von BERT, das Text in beide Richtungen liest, ist besonders gut darin, den Kontext eines Wortes zu verstehen.

- ELEKTRA: Ein neueres Modell, das effizient ist und mit viel größeren Modellen wie GPT-3 und BERT gleichwertig ist und gleichzeitig weniger Rechenressourcen benötigt. ELEKTRA unterscheidet während des Vortrainings zwischen echten und gefälschten Daten, was dabei hilft, verfeinerte Einbettungen zu generieren.

Den obigen Prozess verstehen:

Zunächst wird ein Einbettungsmodell verwendet, um den gewünschten Inhalt in Vektoreinbettungen umzuwandeln. Nach der Generierung werden diese Einbettungen in einer Vektordatenbank gespeichert. Für eine einfache Rückverfolgbarkeit und Relevanz enthalten diese gespeicherten Einbettungen einen Link oder Verweis auf den ursprünglichen Inhalt, von dem sie abgeleitet wurden.

Wenn ein Benutzer oder ein System später eine Frage an die Anwendung stellt, wird dasselbe Embedding-Modell aktiv. Es wandelt die Abfrage in entsprechende Embeddings um. Diese neu gebildeten Embeddings durchsuchen dann die Vektordatenbank nach ähnlichen Vektordarstellungen. Die als Übereinstimmungen identifizierten Embeddings stehen in direktem Zusammenhang mit ihrem ursprünglichen Inhalt. So wird sichergestellt, dass die Benutzeranfrage relevante und genaue Ergebnisse liefert.

Wachsende Finanzierung für Vektordatenbank-Neulinge

Mit der zunehmenden Popularität von KI investieren viele Unternehmen mehr Geld in Vektordatenbanken, um ihre Algorithmen zu verbessern und zu beschleunigen. Dies zeigt sich an den jüngsten Investitionen in Vektordatenbank-Startups wie Tannenzapfen, Chroma DB und Weviate.

Auch große Kooperationen wie Microsoft verfügen über eigene Tools. Zum Beispiel, Kognitive Azure-Suche ermöglicht Unternehmen die Erstellung von KI-Tools mithilfe von Vektordatenbanken.

Oracle hat kürzlich auch neue Funktionen für seine angekündigt Datenbank 23c, Einführung einer integrierten Vektordatenbank. Unter dem Namen „AI Vector Search“ wird es über einen neuen Datentyp, Indizes und Suchtools zum Speichern und Durchsuchen von Daten wie Dokumenten und Bildern mithilfe von Vektoren verfügen. Es unterstützt Retrieval Augmented Generation (RAG), das große Sprachmodelle mit Geschäftsdaten kombiniert, um bessere Antworten auf Sprachfragen zu erhalten, ohne private Daten weiterzugeben.

Primäre Überlegungen zu Vektordatenbanken

Entfernungsmetriken

Die Effektivität einer Ähnlichkeitssuche hängt von der gewählten Distanzmetrik ab. Zu den gängigen Metriken gehören: Euklidische Entfernung und Kosinusähnlichkeit, die jeweils unterschiedliche Arten von Vektorverteilungen berücksichtigen.

Indizierung

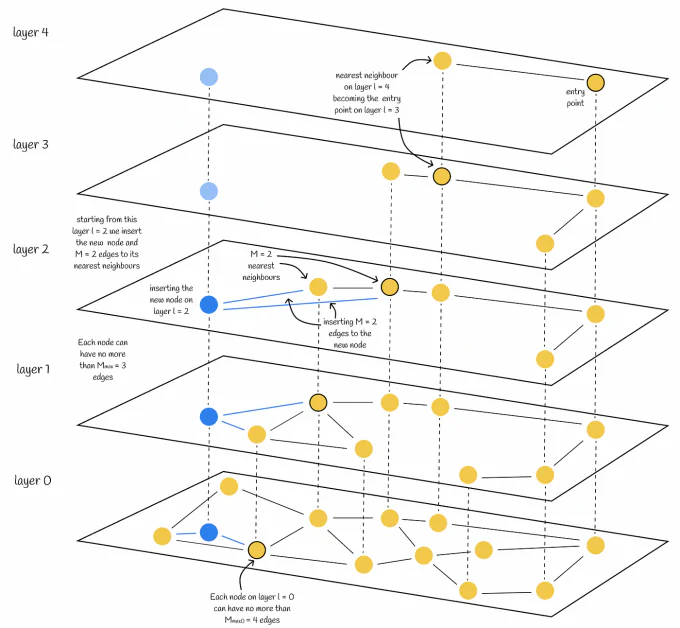

Angesichts der hohen Dimensionalität von Vektoren reichen herkömmliche Indexierungsmethoden nicht aus. Vektordatenbanken verwenden Techniken wie Hierarchische navigierbare kleine Welt (HNSW) Diagramme oder Ärgere BäumeDies ermöglicht eine effiziente Partitionierung des Vektorraums und eine schnelle Suche nach nächsten Nachbarn.

Baum ärgern (Quelle)

Annoy ist eine Methode, die sogenannte binäre Suchbäume verwendet. Es teilt unseren Datenraum viele Male auf und durchsucht nur einen Teil davon, um enge Nachbarn zu finden.

Hierarchical Navigable Small World (HNSW)-Diagramme (Quelle)

HNSW-Graphen hingegen sind wie Netzwerke. Sie verbinden Datenpunkte auf besondere Weise, um die Suche zu beschleunigen. Diese Diagramme helfen dabei, nahe Punkte in den Daten schnell zu finden.

Skalierbarkeit

Mit zunehmenden Datensätzen wächst auch die Herausforderung, schnelle Abrufzeiten aufrechtzuerhalten. Verteilte Systeme, GPU-Beschleunigung und optimierte Speicherverwaltung sind einige Möglichkeiten, wie Vektordatenbanken die Skalierbarkeit angehen.

Rolle von Vektordatenbanken: Implikationen und Chancen

1. Trainingsdaten für Cutting-Edge Generative KI-Modelle: Generative KI-Modelle wie DALL-E und GPT-3 werden mit riesigen Datenmengen trainiert. Diese Daten bestehen oft aus Vektoren, die aus einer Vielzahl von Quellen extrahiert wurden, darunter Bilder, Texte, Code und andere Domänen. Vektordatenbanken pflegen und verwalten diese Datensätze sorgfältig und ermöglichen es KI-Modellen, das Wissen der Welt zu verarbeiten und zu analysieren, indem sie Muster und Beziehungen innerhalb dieser Vektoren erkennen.

2. Weiterentwicklung des Few-Shot-Lernens: Few-Shot-Learning ist eine KI-Trainingstechnik, bei der Modelle mit begrenzten Daten trainiert werden. Vektordatenbanken verstärken diesen Ansatz, indem sie einen robusten Vektorindex pflegen. Wenn ein Modell nur einer Handvoll Vektoren – beispielsweise einigen Bildern von Vögeln – ausgesetzt wird, kann es schnell das umfassendere Konzept der Vögel extrapolieren, indem es Ähnlichkeiten und Beziehungen zwischen diesen Vektoren erkennt.

3. Empfehlungssysteme verbessern: Empfehlungssysteme nutzen Vektordatenbanken, um Inhalte vorzuschlagen, die den Präferenzen des Nutzers entsprechen. Durch die Analyse des Verhaltens, des Profils und der Suchanfragen eines Nutzers werden Vektoren extrahiert, die auf seine Interessen hinweisen. Anschließend durchsucht das System die Vektordatenbank nach Inhaltsvektoren, die diesen Interessenvektoren am nächsten kommen, und gewährleistet so präzise Empfehlungen.

4. Semantik Informationsrückgewinnung: Herkömmliche Suchmethoden basieren auf exakten Keyword-Übereinstimmungen. Vektordatenbanken ermöglichen es Systemen jedoch, Inhalte anhand semantischer Ähnlichkeiten zu verstehen und abzurufen. Das bedeutet, dass die Suche intuitiver wird und sich auf die tiefere Bedeutung der Abfrage konzentriert, anstatt nur auf übereinstimmende Wörter. Wenn Benutzer beispielsweise eine Abfrage eingeben, wird der entsprechende Vektor mit Vektoren in der Datenbank verglichen, um Inhalte zu finden, die der Absicht der Abfrage entsprechen, nicht nur der Formulierung.

5. Multimodale Suche: Multimodale Suche ist eine neue Technik, die Daten aus mehreren Quellen wie Text, Bildern, Audio und Video integriert. Vektordatenbanken dienen als Rückgrat dieses Ansatzes, indem sie die kombinierte Analyse von Vektoren verschiedener Modalitäten ermöglichen. Dies führt zu einem ganzheitlichen Sucherlebnis, bei dem Benutzer auf der Grundlage einer einzigen Abfrage Informationen aus einer Vielzahl von Quellen abrufen können, was zu umfassenderen Erkenntnissen und umfassenderen Ergebnissen führt.

Fazit

Die KI-Welt verändert sich rasant. Sie berührt viele Branchen und bringt sowohl positive Entwicklungen als auch neue Probleme mit sich. Die rasanten Fortschritte in der generativen KI unterstreichen die entscheidende Rolle von Vektordatenbanken bei der Verwaltung und Analyse multidimensionaler Daten.

Diese spezialisierten Speichersysteme, die in der Lage sind, hochdimensionale Vektoren aus unterschiedlichen Datenformen wie Bildern, Text oder Ton zu verarbeiten, sind der Dreh- und Angelpunkt für das effektive Funktionieren moderner KI-Anwendungen, insbesondere im Bereich der Ähnlichkeitssuche.