Prompt Engineering

ChatGPT & Advanced Prompt Engineering: Driving the AI Evolution

OpenAI hat bei der Entwicklung revolutionärer Tools wie dem OpenAI Gym, das für das Training von Verstärkungs-Algorithmen konzipiert ist, und GPT-n-Modellen eine wichtige Rolle gespielt. Ein weiterer Schwerpunkt liegt auf DALL-E, einem KI-Modell, das Bilder aus textuellen Eingaben erstellt. Ein solches Modell, das erhebliche Aufmerksamkeit auf sich gezogen hat, ist OpenAIs ChatGPT, ein strahlendes Beispiel im Bereich der Large Language Models.

GPT-4: Prompt Engineering

ChatGPT hat das Chatbot-Landschaft verändert, indem es menschenähnliche Antworten auf Benutzereingaben bietet und seine Anwendungen über verschiedene Bereiche hinweg erweitert – von der Softwareentwicklung und -testung bis hin zur Geschäftskommunikation und sogar der Erstellung von Gedichten.

In den Händen von Unternehmen und Einzelpersonen könnte GPT-4 beispielsweise als unerschöpfliches Wissensreservoir dienen, das in Themen wie Mathematik und Biologie bis hin zu Rechtsstudien ausgebildet ist. Solche fortschrittlichen und zugänglichen KI-Modelle sind darauf vorbereitet, die Zukunft von Arbeit, Lernen und Kreativität neu zu definieren.

Generative Modelle wie GPT-4 können neue Daten auf der Grundlage bestehender Eingaben erzeugen. Diese unterscheidende Eigenschaft ermöglicht es ihnen, eine Vielzahl von Aufgaben zu übernehmen, einschließlich der Generierung von Text, Bildern, Musik und Videos.

Im Kontext von ChatGPT und OpenAI-Modellen ist ein Prompt die Eingabe, die der Benutzer dem Modell liefert, normalerweise in Form von Text. Prompts dienen als primäres Mittel zur Steuerung der vom Modell generierten Ausgabe, was sie für erfolgreiche und relevante Gespräche unerlässlich macht.

Der Einfluss der Prompt-Qualität

Die Verwendung gut definierter Prompts ist der Schlüssel zu nützlichen und sinnvollen Gesprächen mit KI-Systemen. Schlecht definierte Prompts können zu Ausgaben führen, die für den Benutzer nicht hilfreich sind und sogar zu irreführenden Inhalten führen können.

Um den Einfluss der Prompt-Qualität zu demonstrieren, vergleichen wir zwei verschiedene Prompts, die ChatGPT gegeben wurden. Das erste Prompt, schlecht definiert und unter der Annahme von Vorkenntnissen, generiert eine potenziell unhelpful Antwort für den Benutzer. Andererseits liefert das zweite Prompt mehr Kontext und Beispiele, was eine relevantere und verständlichere Antwort sicherstellt.

Prompt 1: “Erzähl mir über Convolutional Neural Networks.”

Antwort 1: “Convolutional Neural Networks (CNNs) sind multi-layer perceptron Netzwerke, die aus vollständig verbundenen Schichten und Pooling-Schichten bestehen. Sie werden häufig für Bilderkennungsaufgaben verwendet. Der Prozess umfasst das Anwenden von Filtern auf Eingabebilder und das Downsampling mithilfe von Pooling-Schichten.”

Prompt 2: “Ich möchte über Convolutional Neural Networks lernen, aber ich habe keine Vorkenntnisse über künstliche neuronale Netze. Kannst du bitte eine benutzerfreundliche Erklärung und ein Beispiel liefern, wie CNNs in der Bilderkennung verwendet werden?”

Antwort 2: “Convolutional Neural Networks (CNNs) sind eine Art neuronales Netzwerk, das hauptsächlich für Bilderkennungsaufgaben verwendet wird. Im Gegensatz zu anderen neuronalen Netzen nutzen sie convolutionale Schichten und Pooling-Schichten, um Bilder zu verarbeiten. Stell dir vor, du hast ein Bild eines Katzen. CNNs können verschiedene Merkmale im Bild erkennen, wie z.B. Whisker, Ohren und Schwanz, indem sie Filter anwenden und das Bild mithilfe von Pooling-Schichten downsamplen. Dieser Prozess macht CNNs sehr effektiv für die Erkennung von Objekten in Bildern.”

Durch den Vergleich der beiden Antworten ist es offensichtlich, dass ein gut definiertes Prompt zu einer relevanten und benutzerfreundlichen Antwort führt. Prompt-Design und -Engineering sind wachsende Disziplinen, die darauf abzielen, die Ausgabqualität von KI-Modellen wie ChatGPT zu optimieren.

In den folgenden Abschnitten dieses Artikels werden wir uns mit fortgeschrittenen Methoden befassen, die darauf abzielen, Large Language Models (LLMs) zu verfeinern, wie z.B. Prompt-Engineering-Techniken und -Taktiken. Dazu gehören Few-Shot-Learning, ReAct, Chain-of-Thought, RAG und mehr.

Fortgeschrittene Engineering-Techniken

Bevor wir fortfahren, ist es wichtig, ein Schlüsselproblem mit LLMs zu verstehen, als “Halluzination” bezeichnet. Im Kontext von LLMs bedeutet “Halluzination” die Neigung dieser Modelle, Ausgaben zu generieren, die zwar vernünftig erscheinen, aber nicht auf faktischer Realität oder dem gegebenen Kontext basieren.

Dieses Problem wurde in einem jüngsten Gerichtsfall deutlich hervorgehoben, in dem ein Verteidiger ChatGPT für Rechtsforschung verwendet hat. Das KI-Tool, das aufgrund seines Halluzinationsproblems versagt hat, hat nicht existierende Rechtsfälle zitiert. Dieser Fehlschlag hatte erhebliche Auswirkungen und führte zu Verwirrung und Untergrabung der Glaubwürdigkeit während der Verhandlung. Dieser Vorfall dient als deutlicher Hinweis auf die dringende Notwendigkeit, das Problem der “Halluzination” in KI-Systemen anzugehen.

Unser Eintauchen in Prompt-Engineering-Techniken zielt darauf ab, diese Aspekte von LLMs zu verbessern. Durch die Verbesserung ihrer Effizienz und Sicherheit ebnet sich der Weg für innovative Anwendungen wie Informationsextraktion. Darüber hinaus öffnet es Türen, um LLMs nahtlos mit externen Tools und Datenquellen zu integrieren, was den Bereich ihrer potenziellen Anwendungen erweitert.

Zero- und Few-Shot-Learning: Optimierung mit Beispielen

Generative Pretrained Transformers (GPT-3) markierten einen wichtigen Wendepunkt in der Entwicklung von generativen KI-Modellen, da sie das Konzept des “Few-Shot-Learnings” einführten. Diese Methode war aufgrund ihrer Fähigkeit, effektiv ohne umfassendes Feintuning zu funktionieren, ein Game-Changer. Das GPT-3-Framework wird im Paper “Language Models are Few Shot Learners” diskutiert, in dem die Autoren zeigen, wie das Modell in verschiedenen Anwendungsfällen ohne die Notwendigkeit von benutzerdefinierten Datensätzen oder Code hervorragt.

Im Gegensatz zum Feintuning, das kontinuierliche Anstrengungen erfordert, um verschiedene Anwendungsfälle zu lösen, zeigen Few-Shot-Modelle eine einfachere Anpassungsfähigkeit an eine breitere Palette von Anwendungen. Während Feintuning in einigen Fällen robuste Lösungen liefern kann, kann es im großen Maßstab teuer sein, was den Einsatz von Few-Shot-Modellen, insbesondere in Kombination mit Prompt-Engineering, zu einem praktischeren Ansatz macht.

Stell dir vor, du versuchst, Englisch in Französisch zu übersetzen. Beim Few-Shot-Learning würdest du GPT-3 mit einigen Übersetzungsbeispielen wie “Sea Otter -> Loutre de mer” versorgen. GPT-3, das fortschrittliche Modell, ist dann in der Lage, genaue Übersetzungen anzugeben. Beim Zero-Shot-Learning würdest du keine Beispiele liefern, und GPT-3 wäre dennoch in der Lage, Englisch in Französisch effektiv zu übersetzen.

Der Begriff “Few-Shot-Learning” stammt aus der Idee, dass das Modell eine begrenzte Anzahl von Beispielen erhält, von denen es “lernt”. Es ist wichtig zu beachten, dass “lernen” in diesem Kontext nicht das Aktualisieren der Modellparameter oder Gewichte beinhaltet, sondern vielmehr die Modellleistung beeinflusst.

Zero-Shot-Learning geht noch einen Schritt weiter. Beim Zero-Shot-Learning werden dem Modell keine Beispiele für die Aufgabenlösung bereitgestellt. Das Modell soll auf der Grundlage seiner ursprünglichen Ausbildung gut funktionieren, was diese Methode ideal für offene Frage-Antwort-Szenarien wie ChatGPT macht.

In vielen Fällen kann ein Modell, das Zero-Shot-Learning beherrscht, auch bei Few-Shot- oder sogar Single-Shot-Learning-Szenarien gut funktionieren. Diese Fähigkeit, zwischen Zero-, Single- und Few-Shot-Learning-Szenarien zu wechseln, unterstreicht die Anpassungsfähigkeit großer Modelle und erhöht ihre potenziellen Anwendungen in verschiedenen Bereichen.

Zero-Shot-Learning-Methoden werden immer beliebter. Diese Methoden sind durch ihre Fähigkeit gekennzeichnet, Objekte zu erkennen, die während des Trainings nicht gesehen wurden. Hier ist ein praktisches Beispiel für ein Few-Shot-Prompt:

"Übersetze die folgenden englischen Phrasen ins Französische:

'Sea Otter' übersetzt sich in 'Loutre de mer'

'Sky' übersetzt sich in 'ciel'

'Was übersetzt 'cloud' ins Französische?'"

Indem das Modell mit einigen Beispielen und dann einer Frage versorgt wird, können wir das Modell effektiv anleiten, die gewünschte Ausgabe zu generieren. In diesem Fall würde GPT-3 wahrscheinlich “cloud” korrekt ins Französische als “nuage” übersetzen.

Wir werden tiefer in die Nuancen des Prompt-Engineerings eintauchen und seine wesentliche Rolle bei der Optimierung der Modellleistung während der Inferenz untersuchen. Wir werden auch sehen, wie es für die Erstellung kostengünstiger und skalierbarer Lösungen in einer breiten Palette von Anwendungsfällen eingesetzt werden kann.

Wenn wir die Komplexität der Prompt-Engineering-Techniken in GPT-Modellen weiter erforschen, ist es wichtig, unsere letzte Veröffentlichung “Essential Guide to Prompt Engineering in ChatGPT” hervorzuheben. Diese Anleitung bietet Einblicke in die Strategien für die effektive Anleitung von KI-Modellen in einer Vielzahl von Anwendungsfällen.

In unseren vorherigen Diskussionen haben wir uns mit grundlegenden Prompt-Methoden für Large Language Models (LLMs) wie Zero-Shot- und Few-Shot-Learning sowie Instruction-Prompting befasst. Das Beherrschen dieser Techniken ist entscheidend, um die komplexeren Herausforderungen des Prompt-Engineerings zu meistern, die wir hier erforschen.

Few-Shot-Learning kann aufgrund des begrenzten Kontextfensters der meisten LLMs eingeschränkt sein. Darüber hinaus kann ohne geeignete Sicherheitsvorkehrungen das Modell in die Irre geführt werden, um potenziell schädliche Ausgaben zu liefern. Viele Modelle haben auch Schwierigkeiten mit Vernunftaufgaben oder dem Befolgen von mehrschrittigen Anweisungen.

Angesichts dieser Einschränkungen liegt die Herausforderung darin, LLMs zu nutzen, um komplexe Aufgaben zu lösen. Eine offensichtliche Lösung könnte darin bestehen, fortschrittlichere LLMs zu entwickeln oder bestehende zu verfeinern, was jedoch erhebliche Anstrengungen erfordern könnte. Daher stellt sich die Frage: Wie können wir aktuelle Modelle für verbesserte Problemlösung optimieren?

Ebenso faszinierend ist die Erforschung, wie diese Technik mit kreativen Anwendungen in Unite AI’s “Mastering AI Art: A Concise Guide to Midjourney and Prompt Engineering” in Verbindung gebracht wird, die beschreibt, wie die Fusion von Kunst und KI zu atemberaubender Kunst führen kann.

Chain-of-Thought-Prompting

Chain-of-Thought-Prompting nutzt die inhärenten auto-regressiven Eigenschaften von Large Language Models (LLMs), die hervorragend darin sind, das nächste Wort in einer gegebenen Sequenz vorherzusagen. Indem das Modell angeregt wird, seinen Denkprozess zu erläutern, wird es zu einer gründlicheren, methodischeren Ideengenerierung angeregt, die eng mit genauen Informationen übereinstimmt. Diese Übereinstimmung resultiert aus der Neigung des Modells, Informationen in einer sorgfältigen und geordneten Weise zu verarbeiten und zu liefern, ähnlich wie ein menschlicher Experte einem Zuhörer ein komplexes Konzept erläutert. Eine einfache Aussage wie “Erkläre es mir Schritt für Schritt…” ist oft ausreichend, um diese detailliertere Ausgabe auszulösen.

Zero-Shot-Chain-of-Thought-Prompting

Während herkömmliches CoT-Prompting eine Vorschulung mit Demonstrationen erfordert, ist ein aufkommendes Gebiet das Zero-Shot-CoT-Prompting. Dieser Ansatz, der von Kojima et al. (2022) vorgestellt wurde, fügt den Satz “Lass uns Schritt für Schritt denken” zum ursprünglichen Prompt hinzu.

Lass uns einen fortgeschrittenen Prompt erstellen, bei dem ChatGPT aufgefordert wird, die wichtigsten Erkenntnisse aus KI- und NLP-Forschungspapieren zusammenzufassen.

In dieser Demonstration werden wir die Fähigkeit des Modells nutzen, um komplexe Informationen aus akademischen Texten zu verstehen und zusammenzufassen. Mit dem Few-Shot-Learning-Ansatz werden wir ChatGPT beibringen, die wichtigsten Erkenntnisse aus KI- und NLP-Forschungspapieren zusammenzufassen:

1. Papertitel: "Attention Is All You Need"

Wichtigste Erkenntnis: Führte das Transformer-Modell ein und betonte die Bedeutung von Aufmerksamkeitsmechanismen gegenüber rekurrenten Schichten für Sequenztransduktionsaufgaben.

2. Papertitel: "BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding"

Wichtigste Erkenntnis: Führte BERT ein und zeigte die Wirksamkeit von tiefen bidirektionalen Modellen, die state-of-the-art-Ergebnisse in verschiedenen NLP-Aufgaben erzielten.

Jetzt, mit dem Kontext dieser Beispiele, fasst du die wichtigsten Erkenntnisse aus dem folgenden Papier zusammen:

Papertitel: "Prompt Engineering in Large Language Models: An Examination"

Dieser Prompt nutzt nicht nur eine klare Chain-of-Thought, sondern auch einen Few-Shot-Learning-Ansatz, um das Modell zu leiten. Es bindet an unsere Schlüsselwörter an, indem es den Fokus auf die KI- und NLP-Bereiche legt, und beauftragt ChatGPT mit einer komplexen Operation, die mit Prompt-Engineering in Zusammenhang steht: die Zusammenfassung von Forschungspapieren.

ReAct-Prompt

ReAct, oder “Reason and Act”, wurde von Google in dem Paper “ReAct: Synergizing Reasoning and Acting in Language Models” vorgestellt und revolutionierte, wie Sprachmodelle mit einer Aufgabe interagieren, indem sie das Modell dazu anregten, sowohl verbale Denkspuren als auch aufgabenbezogene Aktionen dynamisch zu generieren.

Stell dir vor, du bist ein Koch in der Küche: Du führst nicht nur eine Reihe von Aktionen aus (Gemüse schneiden, Wasser kochen, Zutaten umrühren), sondern engagierst dich auch in verbales Denken oder inneres Gespräch (“Jetzt, da das Gemüse geschnitten ist, sollte ich den Topf auf den Herd stellen”). Dieses laufende mentale Gespräch hilft bei der Strategie, der Anpassung an plötzliche Veränderungen (“Ich habe kein Olivenöl, ich werde Butter verwenden”) und der Erinnerung an die Aufgabenfolge. ReAct imitiert diese menschliche Fähigkeit, indem es dem Modell ermöglicht, schnell neue Aufgaben zu lernen und robuste Entscheidungen zu treffen, ähnlich wie ein Mensch in neuen oder unsicheren Umständen.

ReAct kann das Halluzinationsproblem, ein häufiges Problem bei Chain-of-Thought-Systemen, angehen. CoT, obwohl eine effektive Technik, fehlt die Fähigkeit, mit der externen Welt zu interagieren, was möglicherweise zu Tatsachen-Halluzinationen und Fehlern führen kann. ReAct kompensiert dies, indem es mit externen Informationsquellen interagiert. Diese Interaktion ermöglicht es dem System, nicht nur seine Denkweise zu validieren, sondern auch sein Wissen auf dem neuesten Stand zu halten.

Die grundlegende Funktionsweise von ReAct kann anhand eines Beispiels aus HotpotQA, einer Aufgabe, die hohes Maß an Denkfähigkeit erfordert, erklärt werden. Wenn das Modell eine Frage erhält, zerlegt es die Frage in handhabbare Teile und erstellt einen Aktionsplan. Das Modell generiert eine Denkspur (Gedanke) und identifiziert eine relevante Aktion. Es kann beschließen, Informationen über die Apple-Fernbedienung in einer externen Quelle wie Wikipedia nachzuschlagen (Aktion) und sein Verständnis auf der Grundlage der erhaltenen Informationen aktualisiert (Beobachtung). Durch mehrere Denk-Aktions-Beobachtungsschritte kann ReAct Informationen sammeln, um seine Denkweise zu unterstützen, während es gleichzeitig verfeinert, was es als Nächstes sammeln muss.

Vergleichende Visualisierung von vier Prompt-Methoden – Standard, Chain-of-Thought, Act-Only und ReAct, bei der Lösung von HotpotQA und AlfWorld (https://arxiv.org/pdf/2210.03629.pdf)

Das Designen von ReAct-Agents ist eine spezialisierte Aufgabe, die von ihrer Fähigkeit profitiert, komplexe Ziele zu erreichen. Beispielsweise kann ein auf dem ReAct-Modell basierender konversationeller Agent konversationsbezogenes Gedächtnis integrieren, um reichere Interaktionen zu ermöglichen. Diese Komplexität wird jedoch durch Tools wie Langchain gestreamlined, die zum Standard für das Design dieser Agenten geworden sind.

Kontext-treues Prompting

Das Paper “Kontext-treues Prompting für Large Language Models” betont, dass Large Language Models (LLMs), obwohl sie in wissensbasierten NLP-Aufgaben erheblichen Erfolg gezeigt haben, aufgrund ihrer übermäßigen Abhängigkeit von parametrisiertem Wissen in kontextsensiblen Aufgaben fehlschlagen können. Zum Beispiel kann ein Sprachmodell, das auf veralteten Fakten trainiert wurde, falsche Antworten liefern, wenn es kontextuelle Hinweise ignoriert.

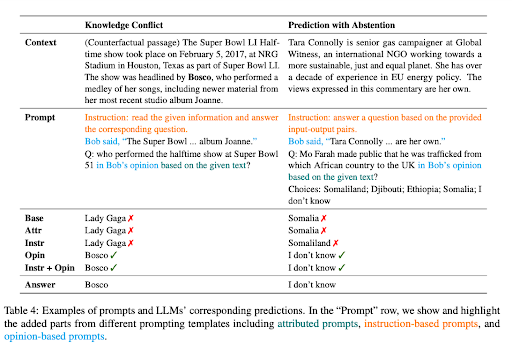

Dieses Problem wird in Fällen von Wissenskonflikten deutlich, in denen der Kontext Fakten enthält, die von den vorherigen Kenntnissen des LLM abweichen. Betrachten wir ein Beispiel, in dem ein Large Language Model (LLM), das mit Daten vor der Fußball-WM 2022 trainiert wurde, einen Kontext erhält, der angibt, dass Frankreich den Wettbewerb gewonnen hat. Das LLM, das auf seine vorherige Ausbildung vertraut, behauptet weiterhin, dass der vorherige Gewinner, also das Team, das 2018 gewonnen hat, immer noch der amtierende Champion ist. Dies zeigt einen klassischen Fall von “Wissenskonflikt”.

Im Wesentlichen entsteht ein Wissenskonflikt in einem LLM, wenn neue Informationen im Kontext die vorherigen Kenntnisse des Modells widersprechen. Die Neigung des Modells, auf seine vorherige Ausbildung zu vertrauen und nicht auf den neuen Kontext zu hören, kann zu falschen Ausgaben führen. Andererseits ist Halluzination in LLMs die Generierung von Antworten, die zwar plausibel erscheinen, aber nicht auf den Trainingsdaten des Modells oder dem bereitgestellten Kontext basieren.

Ein weiteres Problem entsteht, wenn der bereitgestellte Kontext nicht genug Informationen enthält, um eine Frage genau zu beantworten, eine Situation, die als “Vorhersage mit Enthaltung” bekannt ist. Zum Beispiel sollte ein LLM, wenn es nach dem Gründer von Microsoft gefragt wird, basierend auf einem Kontext, der diese Information nicht enthält, von einer Vermutung absehen.

Um die kontextuelle Treue von LLMs in diesen Szenarien zu verbessern, schlugen die Forscher eine Reihe von Prompt-Strategien vor. Diese Strategien zielen darauf ab, die Antworten des LLMs kontextbezogener und weniger abhängig von seinem kodifizierten Wissen zu machen.

Eine solche Strategie besteht darin, Prompts als meinungsbezogene Fragen zu formulieren, bei denen der Kontext als Aussage eines Erzählers interpretiert wird und die Frage auf die Meinung dieses Erzählers abzielt. Dieser Ansatz lenkt die Aufmerksamkeit des LLMs auf den präsentierten Kontext und nicht auf sein vorheriges Wissen.

Das Hinzufügen von kontrafaktischen Demonstrationen zu Prompts wurde auch als effektive Methode identifiziert, um die Treue in Fällen von Wissenskonflikten zu erhöhen. Diese Demonstrationen präsentieren Szenarien mit falschen Fakten, die das Modell anleiten, dem Kontext mehr Aufmerksamkeit zu schenken, um genaue Antworten zu liefern.

Instruction Fine-Tuning

Instruction Fine-Tuning ist eine überwachte Lernphase, die die Bereitstellung des Modells mit spezifischen Anweisungen ausnutzt, zum Beispiel “Erkläre den Unterschied zwischen Sonnenaufgang und Sonnenuntergang.” Die Anweisung wird mit einer geeigneten Antwort gepaart, wie “Ein Sonnenaufgang bezeichnet den Moment, wenn die Sonne am Morgen über dem Horizont erscheint, während ein Sonnenuntergang den Punkt markiert, wenn die Sonne am Abend unter dem Horizont verschwindet.” Durch diese Methode lernt das Modell im Wesentlichen, Anweisungen zu befolgen und auszuführen.

Dieser Ansatz hat einen erheblichen Einfluss auf den Prozess des Promptings von LLMs, was zu einer radikalen Änderung des Prompt-Stils führt. Ein instruction fine-getuntes LLM ermöglicht die sofortige Ausführung von Zero-Shot-Aufgaben und bietet eine nahtlose Aufgabendurchführung. Wenn das LLM noch nicht feinjustiert ist, kann ein Few-Shot-Learning-Ansatz erforderlich sein, bei dem einige Beispiele in den Prompt aufgenommen werden, um das Modell zur gewünschten Antwort zu leiten.

“Instruction Tuning with GPT-4” diskutiert den Versuch, GPT-4 zu verwenden, um anweisungsbezogene Daten für das Feinjustieren von LLMs zu generieren. Sie verwendeten eine umfangreiche Datenbank, die 52.000 einzigartige anweisungsbezogene Einträge in Englisch und Chinesisch umfasst.

Die Datenbank spielt eine wichtige Rolle bei der Anweisungsfeinjustierung von LLaMA-Modellen, einer Open-Source-Serie von LLMs, was zu einer verbesserten Zero-Shot-Leistung bei neuen Aufgaben führt. Beachtenswerte Projekte wie Stanford Alpaca haben effektiv Self-Instruct-Tuning eingesetzt, eine effiziente Methode, um LLMs mit menschlicher Absicht zu verbinden, indem Daten von fortschrittlichen, anweisungsbezogenen Lehrmodellen generiert werden.

Das primäre Ziel der Anweisungsfeinjustierungsforschung ist es, die Null- und Few-Shot-Verallgemeinerungsfähigkeiten von LLMs zu verbessern. Weitere Datensammlung und Modellskalierung können wertvolle Erkenntnisse liefern. Mit der aktuellen Größe der GPT-4-Daten bei 52K und der Größe des Basis-LLaMA-Modells bei 7 Milliarden Parametern besteht ein enormes Potenzial, weitere GPT-4-Anweisungsbezogene Daten zu sammeln und mit anderen Datenquellen zu kombinieren, um größere LLaMA-Modelle für bessere Leistung zu trainieren.

STaR: Bootstrapping Reasoning With Reasoning

Das Potenzial von LLMs ist besonders in komplexen Denkaufgaben wie Mathematik oder Allgemeinwissen-Fragen erkennbar. Die Induktion eines Sprachmodells, um Rationales – eine Reihe von Schritt-für-Schritt-Erklärungen oder “Chain-of-Thought” – zu generieren, hat jedoch seine Herausforderungen. Es erfordert oft die Konstruktion großer Rationale-Datensätze oder einen Verlust an Genauigkeit aufgrund der Abhängigkeit von nur Few-Shot-Schlussfolgerungen.

“Self-Taught Reasoner” (STaR) bietet eine innovative Lösung für diese Herausforderungen. Es verwendet eine einfache Schleife, um kontinuierlich die Denkfähigkeit eines Modells zu verbessern. Dieser iterative Prozess beginnt mit der Generierung von Rationales, um mehrere Fragen zu beantworten, indem einige rationale Beispiele verwendet werden. Wenn die generierten Antworten falsch sind, versucht das Modell erneut, ein Rationale zu generieren, diesmal mit der richtigen Antwort. Das Modell wird dann feinjustiert auf alle Rationales, die zu richtigen Antworten führten, und der Prozess wiederholt sich.

STaR-Methodik, Demonstrationsbeispiel auf CommonsenseQA-Datensatz (https://arxiv.org/pdf/2203.14465.pdf)

Um dies zu veranschaulichen, betrachten wir die Frage “Was kann man verwenden, um einen kleinen Hund zu tragen?” mit Antwortmöglichkeiten, die von einem Schwimmbad bis zu einem Korb reichen. Das STaR-Modell generiert ein Rationale, indem es identifiziert, dass die Antwort etwas sein muss, das einen kleinen Hund tragen kann, und kommt zu dem Schluss, dass ein Korb, der dafür konzipiert ist, Dinge zu tragen, die richtige Antwort ist.

STaR’s Ansatz ist einzigartig, da es die vorherige Denkfähigkeit des Sprachmodells nutzt. Es verwendet einen Prozess der Selbstgenerierung und Verfeinerung von Rationales, der die Denkfähigkeit des Modells schrittweise verbessert. STaR’s Schleife hat jedoch ihre Grenzen. Das Modell kann versagen, neue Probleme im Trainingsset zu lösen, da es keinen direkten Trainingsimpuls für Probleme erhält, die es nicht lösen kann. Um dieses Problem zu adressieren, führt STaR Rationalisierung ein. Für jedes Problem, das das Modell nicht lösen kann, generiert es ein neues Rationale, indem es dem Modell die richtige Antwort liefert, was es ermöglicht, rückwärts zu denken.

STaR ist daher eine skalierbare Bootstrapping-Methode, die es Modellen ermöglicht, ihre eigenen Rationales zu lernen, während sie gleichzeitig lernen, immer schwierigere Probleme zu lösen. Die Anwendung von STaR hat vielversprechende Ergebnisse in Aufgaben wie Arithmetik, Mathematik-Wortproblemen und Allgemeinwissen-Denkaufgaben gezeigt. Auf CommonsenseQA verbesserte STaR sowohl ein Few-Shot-Baseline als auch ein auf direkte Antwortvorhersage feinjustiertes Baseline und erreichte eine Leistung, die mit einem 30-mal größeren Modell vergleichbar ist.

Tagged Context Prompts

Das Konzept von “Tagged Context Prompts” dreht sich um die Bereitstellung des KI-Modells mit einer zusätzlichen Ebene von Kontext, indem bestimmte Informationen innerhalb der Eingabe markiert werden. Diese Markierungen dienen im Wesentlichen als Wegweiser für die KI, um den Kontext genau zu interpretieren und eine Antwort zu generieren, die sowohl relevant als auch faktisch ist.

Stell dir vor, du führst ein Gespräch mit einem Freund über ein bestimmtes Thema, sagen wir “Schach”. Du machst eine Aussage und markierst sie dann mit einem Verweis, wie “(Quelle: Wikipedia)”. Jetzt weiß dein Freund, in diesem Fall das KI-Modell, genau, woher deine Informationen stammen. Dieser Ansatz zielt darauf ab, die Antworten der KI zuverlässiger zu machen, indem das Risiko von Halluzinationen oder der Generierung von falschen Fakten reduziert wird.

Ein einzigartiges Merkmal von Tagged Context Prompts ist ihr Potenzial, die “kontextuelle Intelligenz” von KI-Modellen zu verbessern. Zum Beispiel zeigt das Paper dies, indem es eine Vielzahl von Fragen aus verschiedenen Quellen wie zusammengefassten Wikipedia-Artikeln zu verschiedenen Themen und Abschnitten aus einem kürzlich veröffentlichten Buch verwendet. Die Fragen werden markiert, wodurch dem KI-Modell zusätzlicher Kontext über die Informationsquelle bereitgestellt wird.

Diese zusätzliche Kontextebene kann bei der Generierung von Antworten, die nicht nur genau, sondern auch dem bereitgestellten Kontext entsprechend sind, außerordentlich nützlich sein, was die Ausgabe der KI zuverlässiger macht.

Schlussfolgerung: Ein Blick in vielversprechende Techniken und zukünftige Richtungen

OpenAIs ChatGPT zeigt das unerforschte Potenzial von Large Language Models (LLMs) bei der Bewältigung komplexer Aufgaben mit bemerkenswerter Effizienz. Fortgeschrittene Techniken wie Few-Shot-Learning, ReAct-Prompting, Chain-of-Thought und STaR ermöglichen es uns, dieses Potenzial in einer Vielzahl von Anwendungen zu nutzen. Wenn wir tiefer in die Nuancen dieser Methoden eintauchen, entdecken wir, wie sie das Landschaftsbild der KI prägen und reichere sowie sicherere Interaktionen zwischen Menschen und Maschinen ermöglichen.

Trotz der Herausforderungen wie Wissenskonflikte, übermäßige Abhängigkeit von parametrisiertem Wissen und das Potenzial für Halluzinationen haben diese KI-Modelle, mit der richtigen Prompt-Engineering, sich als transformative Werkzeuge erwiesen. Anweisungsfeinjustierung, kontexttreues Prompting und die Integration mit externen Datenquellen verstärken weiterhin ihre Fähigkeit, zu denken, zu lernen und sich anzupassen.