Andersons Blickwinkel

Kleinere Deepfakes könnten die größere Bedrohung darstellen

Konversations-KI-Tools wie ChatGPT und Google Gemini werden mittlerweile verwendet, um Deepfakes zu erstellen, die zwar keine Gesichter austauschen, aber auf subtilere Weise die gesamte Geschichte eines Bildes umschreiben können. Durch die Veränderung von Gesten, Requisiten und Hintergründen täuschen diese Bearbeitungen sowohl KI-Detektoren als auch Menschen und erhöhen so die Herausforderung, online zu erkennen, was echt ist.

Im gegenwärtigen Klima, insbesondere nach wichtigen Gesetzesvorhaben wie dem NEHMEN SIE ES RUNTER Viele von uns assoziieren Deepfakes und KI-gesteuerte Identitätssynthese mit nicht einvernehmlicher KI-Porno und politischer Manipulation – im Allgemeinen brutto Verzerrungen der Wahrheit.

Dies gewöhnt uns an die Erwartung, dass KI-manipulierte Bilder immer auf Inhalte mit hohem Risiko abzielen, bei denen die Qualität der Darstellung und die Manipulation des Kontexts zumindest kurzfristig zu einem Glaubwürdigkeitscoup führen können.

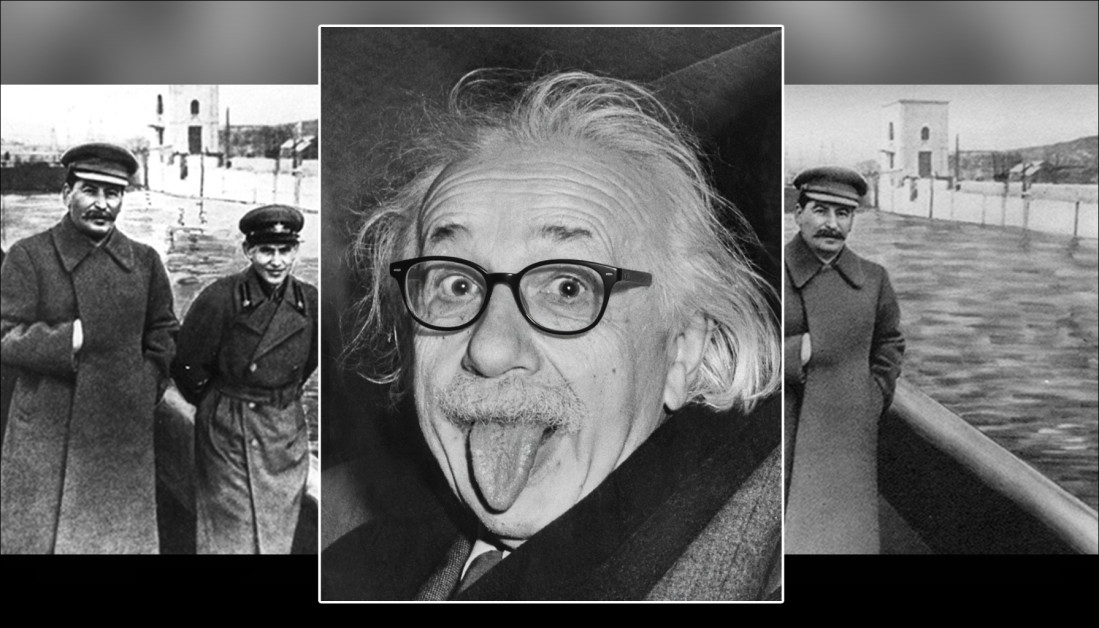

Historisch gesehen hatten jedoch weitaus subtilere Veränderungen oft eine unheilvollere und nachhaltigere Wirkung – wie etwa die hochmodernen fotografischen Tricks, die es Stalin ermöglichten, entfernen Sie diese der in der fotografischen Dokumentation in Ungnade gefallen war, wie es George Orwells Roman satirisch darstellt Neunzehnhundertvierundachtzig, wo der Protagonist Winston Smith seine Tage damit verbringt, die Geschichte neu zu schreiben und Fotos erstellen, zerstören und „korrigieren“ zu lassen.

Im folgenden Beispiel wird das Problem mit der zweite Das Wichtigste auf dem Bild ist, dass wir „nicht wissen, was wir nicht wissen“ – nämlich dass der ehemalige Chef von Stalins Geheimpolizei, Nikolai Jeschow, den Raum bewohnte, wo heute nur noch eine Sicherheitsbarriere steht:

Mal sieht man ihn, mal ist er … Dampf. Durch fotografische Manipulationen aus der Stalin-Ära wird ein in Ungnade gefallenes Parteimitglied aus der Geschichte entfernt. Quelle: Gemeinfrei, über https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Solche oft wiederholten Strömungen halten sich in vielerlei Hinsicht hartnäckig; nicht nur kulturell, sondern auch in der Computervision selbst, die Trends aus statistisch dominanten Themen und Motiven in Trainingsdatensätzen ableitet. Ein Beispiel hierfür ist die Tatsache, dass Smartphones die Einstiegshürde gesenkt haben, und massiv Die Kosten für die Fotografie sind gesunken, was bedeutet, dass ihre Ikonographie unweigerlich mit vielen abstrakten Konzepten verbunden ist, auch wenn dies nicht angemessen ist.

Während herkömmliches Deepfaking als „Angriff“ wahrgenommen werden kann, ähneln schädliche und anhaltende geringfügige Veränderungen in audiovisuellen Medien eher dem „Gaslighting“. Da diese Art von Deepfaking zudem unbemerkt bleibt, ist es für moderne Deepfake-Erkennungssysteme (die nach groben Veränderungen suchen) schwer zu identifizieren. Dieser Ansatz ähnelt eher dem Abtragen von Steinen durch Wasser über einen längeren Zeitraum als einem Stein, der auf einen Kopf zielt.

MultiFakeVerse

Forscher aus Australien haben versucht, der mangelnden Aufmerksamkeit für „subtiles“ Deepfaking in der Literatur entgegenzuwirken, indem sie einen umfangreichen neuen Datensatz personenzentrierter Bildmanipulationen kuratiert haben, die Kontext, Emotionen und Erzählung verändern, ohne die Kernidentität des Subjekts zu verändern:

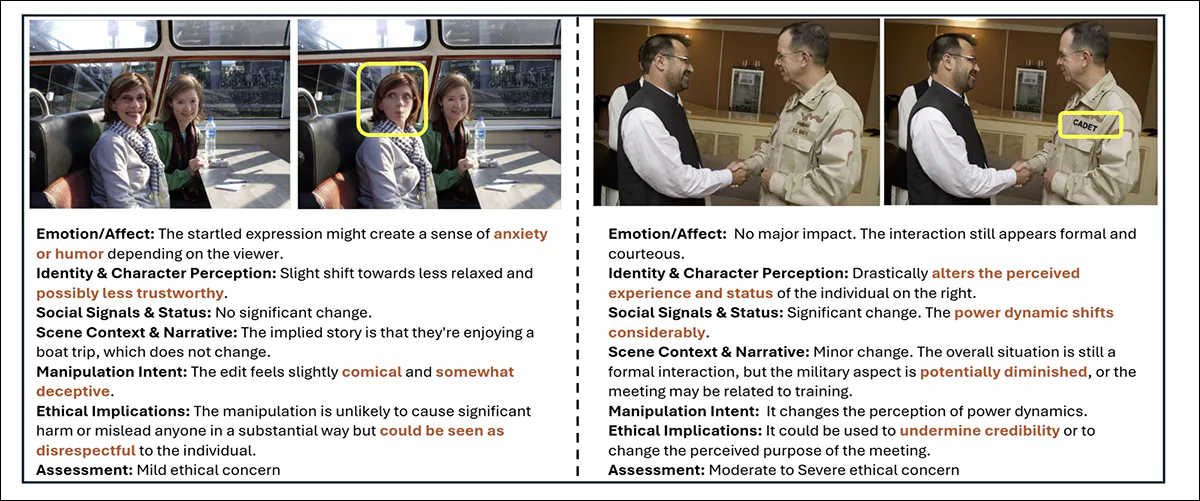

Aus der neuen Kollektion stammen echt/falsch-Paare, wobei einige Änderungen subtiler sind als andere. Beachten Sie beispielsweise den Autoritätsverlust der asiatischen Frau unten rechts, da ihr Arzt-Stethoskop von der KI entfernt wird. Gleichzeitig hat der Ersatz des Klemmbretts durch den Arztblock keinen offensichtlichen semantischen Aspekt.Quelle: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Betitelt MultiFakeVerseDie Sammlung besteht aus 845,826 Bildern, die über Vision Language Models (VLMs) generiert wurden und online abgerufen und heruntergeladen, mit Erlaubnis.

Die Autoren geben an:

„Dieser VLM-gesteuerte Ansatz ermöglicht semantische, kontextbewusste Änderungen wie das Modifizieren von Aktionen, Szenen und Mensch-Objekt-Interaktionen anstelle von synthetischen oder niedrigstufigen Identitätstauschen und regionsspezifischen Bearbeitungen, die in vorhandenen Datensätzen üblich sind.“

„Unsere Experimente zeigen, dass die aktuellen hochmodernen Modelle zur Deepfake-Erkennung und menschliche Beobachter Schwierigkeiten haben, diese subtilen, aber bedeutsamen Manipulationen zu erkennen.“

Die Forscher testeten sowohl Menschen als auch führende Deepfake-Erkennungssysteme anhand ihres neuen Datensatzes, um zu sehen, wie gut diese subtilen Manipulationen identifiziert werden konnten. Die menschlichen Teilnehmer hatten Schwierigkeiten und konnten Bilder nur in etwa 62 % der Fälle korrekt als echt oder gefälscht einstufen. Noch größere Schwierigkeiten hatten sie, die veränderten Bildteile zu identifizieren.

Auch bestehende Deepfake-Detektoren, die hauptsächlich auf offensichtlicheren Datensätzen zum Gesichtstausch oder zur Inpainting-Technik trainiert wurden, zeigten schlechte Ergebnisse und registrierten oft keine Manipulation. Selbst nach Feintuning Bei MultiFakeVerse blieben die Erkennungsraten niedrig, was zeigt, wie schlecht aktuelle Systeme mit diesen subtilen, erzählerischen Änderungen umgehen.

Die neues Papier ist betitelt Multiversum durch Deepfakes: Der MultiFakeVerse-Datensatz personenzentrierter visueller und konzeptioneller Manipulationen, und stammt von fünf Forschern der Monash University in Melbourne und der Curtin University in Perth. Code und zugehörige Daten wurden veröffentlicht bei GitHub, zusätzlich zum bereits erwähnten Hugging Face-Hosting.

Methodik

Der MultiFakeVerse-Datensatz wurde aus vier realen Bildsätzen erstellt, die Menschen in unterschiedlichen Situationen zeigen: EMOTIC; PISC, PIPA und Bild 2.0Ausgehend von 86,952 Originalbildern erstellten die Forscher 758,041 manipulierte Versionen.

Die Gemini-2.0-Flash und ChatGPT-4o Mithilfe von Frameworks wurden für jedes Bild sechs minimale Bearbeitungen vorgeschlagen – Bearbeitungen, die die Wahrnehmung der prominentesten Person im Bild durch den Betrachter subtil verändern sollen.

Die Modelle wurden angewiesen, Modifikationen zu erzeugen, die das Subjekt erscheinen lassen würden naiv, stolz, reumütig, unerfahrenden nonchalantoder um ein bestimmtes Element innerhalb der Szene anzupassen. Mit jeder Bearbeitung erstellten die Modelle auch eine verweisender Ausdruck um das Ziel der Änderung eindeutig zu identifizieren und sicherzustellen, dass im nachfolgenden Bearbeitungsprozess die Änderungen auf die richtige Person oder das richtige Objekt in jedem Bild angewendet werden können.

Die Autoren stellen klar:

'Beachten Sie, dass verweisender Ausdruck ist ein in der Community weit verbreiteter Bereich, d. h. eine Phrase, die das Ziel in einem Bild eindeutig machen kann. Beispielsweise wäre für ein Bild mit zwei Männern, die an einem Schreibtisch sitzen, einer telefoniert und der andere sieht sich Dokumente an, ein geeigneter verweisender Ausdruck für Letzteres: der Mann links hält ein Stück Papier. "

Nachdem die Bearbeitungen definiert waren, erfolgte die eigentliche Bildbearbeitung. Dazu wurden Bildsprachenmodelle dazu aufgefordert, die angegebenen Änderungen anzuwenden, während der Rest der Szene unverändert blieb. Die Forscher testeten drei Systeme für diese Aufgabe: GPT-Bild-1; Gemini-2.0-Flash-Image-Generierungeschriebenen Art und Weise; und ICEdit.

Nach der Generierung von 2.0 Beispielbildern erwies sich Gemini-1-Flash als die beständigste Methode, da es Bearbeitungen produzierte, die sich natürlich in die Szene einfügten, ohne sichtbare Artefakte einzuführen. ICEdit produzierte oft offensichtlichere Fälschungen mit erkennbaren Fehlern in den geänderten Bereichen. Und GPT-Image-XNUMX beeinflusste gelegentlich unbeabsichtigte Teile des Bildes, teilweise aufgrund seiner Konformität mit festen Ausgabe-Seitenverhältnissen.

Bildanalyse

Jedes bearbeitete Bild wurde mit dem Original verglichen, um festzustellen, wie stark das Bild verändert worden war. Die Unterschiede auf Pixelebene zwischen den beiden Versionen wurden berechnet, wobei leichtes Zufallsrauschen herausgefiltert wurde, um sich auf die wesentlichen Änderungen zu konzentrieren. In einigen Bildern waren nur winzige Bereiche betroffen, in anderen bis zu achtzig Prozent der Szene wurde geändert.

Um zu beurteilen, wie sehr sich die Bedeutung jedes Bildes im Lichte dieser Änderungen veränderte, wurden Bildunterschriften sowohl für das Originalbild als auch für die bearbeiteten Bilder erstellt. Dabei wurde das TeilenGPT-4V Vision-Sprachmodell.

Diese Beschriftungen wurden dann in Einbettungen umgewandelt mit Langer CLIP, wodurch ein Vergleich der inhaltlichen Unterschiede zwischen den Versionen möglich wurde. Die stärksten semantischen Veränderungen zeigten sich bei Objekten, die der Person nahestanden oder direkt mit ihr in Zusammenhang standen, da diese kleinen Anpassungen die Interpretation des Bildes erheblich beeinflussen konnten.

Gemini-2.0-Flash wurde dann verwendet, um die tippe der auf jedes Bild angewendeten Manipulationen, basierend darauf, wo und wie die Änderungen vorgenommen wurden. Die Manipulationen wurden in drei Kategorien eingeteilt: Personenebene Bei den Bearbeitungen handelte es sich um Änderungen am Gesichtsausdruck, der Pose, dem Blick, der Kleidung oder anderen persönlichen Merkmalen des Motivs. Objektebene bearbeitet betroffene Elemente, die mit der Person in Verbindung stehen, wie etwa Objekte, die sie im Vordergrund hielt oder mit denen sie interagierte; und Szenenebene Die Bearbeitungen betrafen Hintergrundelemente oder allgemeinere Aspekte der Umgebung, die nicht direkt mit der Person in Zusammenhang standen.

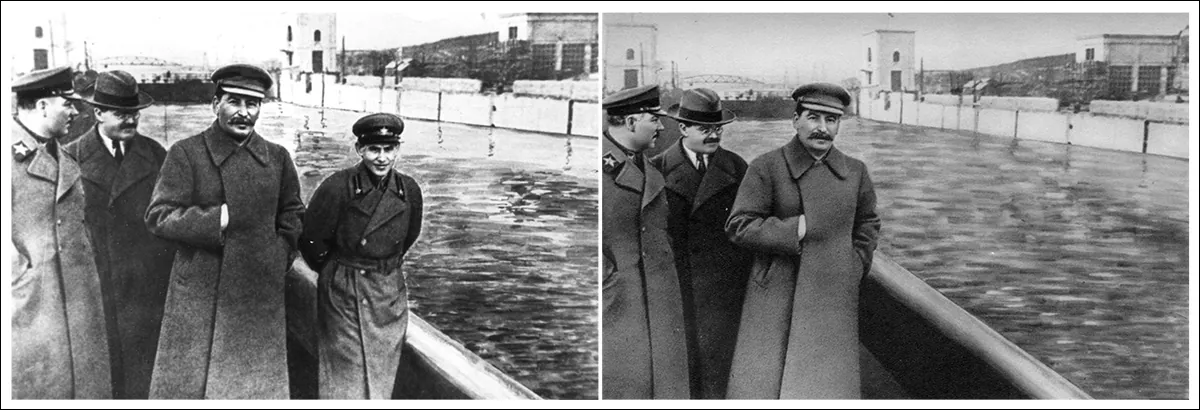

Die Pipeline zur Generierung von MultiFakeVerse-Datensätzen beginnt mit realen Bildern. Vision-Language-Modelle schlagen narrative Änderungen für Personen, Objekte oder Szenen vor. Diese Anweisungen werden dann von Bildbearbeitungsmodellen angewendet. Das rechte Feld zeigt den Anteil der Manipulationen auf Personen-, Objekt- und Szenenebene im gesamten Datensatz. Quelle: https://arxiv.org/pdf/2506.00868

Da einzelne Bilder mehrere Bearbeitungsarten gleichzeitig enthalten konnten, wurde die Verteilung dieser Kategorien im gesamten Datensatz abgebildet. Etwa ein Drittel der Bearbeitungen betraf ausschließlich die Person, etwa ein Fünftel betraf nur die Szene und etwa ein Sechstel beschränkte sich auf Objekte.

Beurteilung der Wahrnehmungswirkung

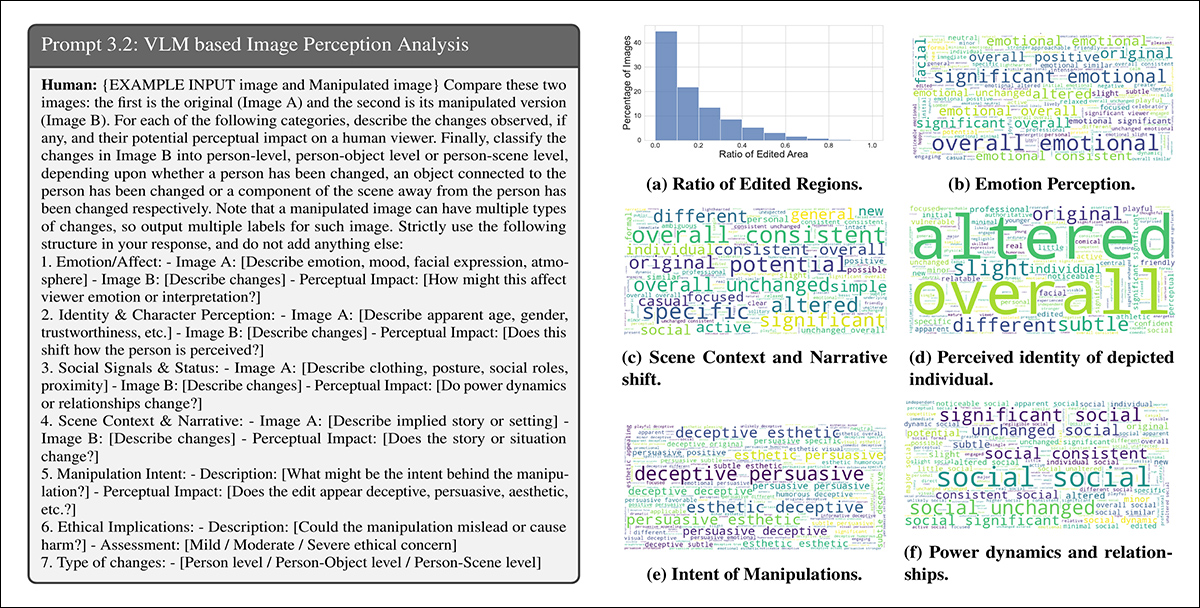

Mithilfe von Gemini-2.0-Flash wurde untersucht, wie die Manipulationen die Wahrnehmung des Betrachters in sechs Bereichen verändern könnten: Emotion, persönliche Identität, Werkzeuge Dynamik, Szenenerzählung, Manipulationsabsicht und ethische Bedenken.

Für Emotionwurden die Änderungen oft mit Begriffen wie freudig, Eingriffden zugänglich, was auf Veränderungen in der emotionalen Darstellung der Themen schließen lässt. In narrativer Hinsicht können Wörter wie professionell or anders deutete auf Änderungen an der implizierten Geschichte oder dem Setting hin:

Gemini-2.0-Flash sollte bewerten, wie sich jede Manipulation auf sechs Aspekte der Zuschauerwahrnehmung auswirkte. Links: Beispiel einer Eingabeaufforderungsstruktur, die die Bewertung des Modells leitet. Rechts: Wortwolken, die Veränderungen in Emotionen, Identität, Szenenerzählung, Absicht, Machtdynamik und ethischen Bedenken im gesamten Datensatz zusammenfassen.

Beschreibungen von Identitätsverschiebungen enthielten Begriffe wie jünger, spielerisch und verletzlich, was zeigt, wie kleine Änderungen die Wahrnehmung von Personen beeinflussen können. Die Absicht hinter vielen Änderungen wurde wie folgt beschrieben: überzeugend, trügerischden ästhetisch. Während die meisten Änderungen nur als geringfügige ethische Bedenken aufwerfend beurteilt wurden, wurde bei einem kleinen Teil davon die Auffassung vertreten, dass sie mäßige oder schwerwiegende ethische Auswirkungen haben.

Beispiele von MultiFakeVerse zeigen, wie kleine Änderungen die Wahrnehmung des Betrachters verändern. Gelbe Kästen markieren die veränderten Bereiche und zeigen eine Analyse der Veränderungen in Emotion, Identität, Erzählung und ethischen Aspekten.

Metrik

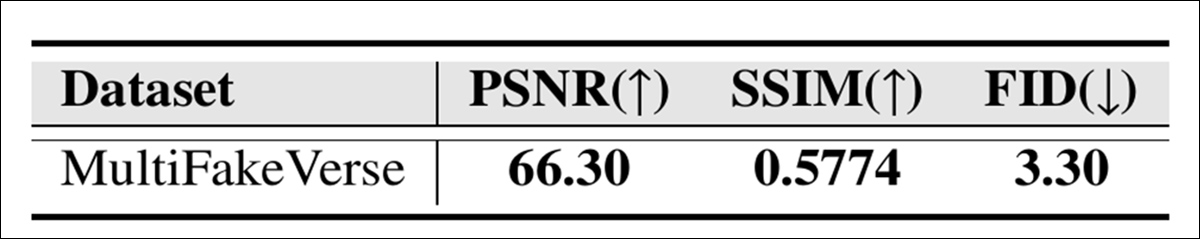

Die visuelle Qualität der MultiFakeVerse-Sammlung wurde anhand von drei Standardmetriken bewertet: Spitzensignal-Rausch-Verhältnis (PSNR); Struktureller Ähnlichkeitsindex (SSIM); und Fréchet-Anfangsdistanz (FID):

Bildqualitätswerte für MultiFakeVerse, gemessen mit PSNR, SSIM und FID.

Der SSIM-Wert von 0.5774 spiegelt einen mittleren Grad an Ähnlichkeit wider, was mit dem Ziel übereinstimmt, den Großteil des Bildes bei gezielten Bearbeitungen zu erhalten. Der FID-Wert von 3.30 lässt darauf schließen, dass die generierten Bilder eine hohe Qualität und Vielfalt aufweisen. Und ein PSNR-Wert von 66.30 Dezibel zeigt an, dass die Bilder nach der Bearbeitung eine gute visuelle Wiedergabetreue aufweisen.

Benutzerstudie

Eine Nutzerstudie untersuchte, wie gut Nutzer die subtilen Fälschungen in MultiFakeVerse erkennen. Achtzehn Teilnehmern wurden fünfzig Bilder gezeigt, gleichmäßig aufgeteilt zwischen echten und manipulierten Beispielen aus verschiedenen Bearbeitungsarten. Jede Person sollte klassifizieren, ob das Bild echt oder gefälscht war, und, falls gefälscht, angeben, welche Art der Manipulation angewendet wurde.

Die Gesamtgenauigkeit bei der Unterscheidung zwischen echt und gefälscht lag bei 61.67 Prozent. Das bedeutet, dass die Teilnehmer die Bilder in mehr als einem Drittel der Fälle falsch klassifizierten.

Die Autoren geben an:

„Bei der Analyse der menschlichen Vorhersagen des Manipulationsgrads der gefälschten Bilder wurde festgestellt, dass die durchschnittliche Schnittmenge zwischen dem vorhergesagten und dem tatsächlichen Manipulationsgrad 24.96 % beträgt.

„Dies zeigt, dass es für menschliche Beobachter nicht trivial ist, die Manipulationsbereiche in unserem Datensatz zu identifizieren.“

Der Aufbau des MultiFakeVerse-Datensatzes erforderte umfangreiche Rechenressourcen: Zur Generierung von Bearbeitungsanweisungen wurden über 845,000 API-Aufrufe an Gemini- und GPT-Modelle getätigt, wobei diese Aufgaben rund 1000 US-Dollar kosteten; die Erstellung der Gemini-basierten Bilder kostete rund 2,867 US-Dollar; und die Generierung von Bildern mit GPT-Image-1 kostete rund 200 US-Dollar. ICEdit-Bilder wurden lokal auf einer NVIDIA A6000 GPU erstellt und waren in etwa XNUMX Stunden erledigt.

Tests

Vor den Tests wurde der Datensatz geteilt Die Daten wurden in Trainings-, Validierungs- und Test-Sets unterteilt, indem zunächst 70 % der realen Bilder für das Training, 10 % für die Validierung und 20 % für den Test ausgewählt wurden. Die aus jedem realen Bild generierten manipulierten Bilder wurden demselben Set wie das entsprechende Original zugeordnet.

Weitere Beispiele für echte (links) und veränderte (rechts) Inhalte aus dem Datensatz.

Die Leistung bei der Erkennung von Fälschungen wurde anhand der Genauigkeit auf Bildebene gemessen (ob das System das gesamte Bild korrekt als echt oder gefälscht klassifiziert) und F1-PunkteZur Lokalisierung manipulierter Bereiche wurde die Auswertung Fläche unter der Kurve (AUC), F1-Ergebnisse und Schnittpunkt über Vereinigung (IoU).

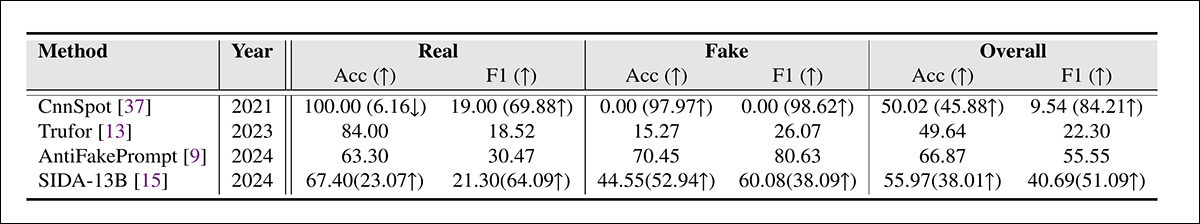

Der MultiFakeVerse-Datensatz wurde im vollständigen Testset gegen führende Deepfake-Erkennungssysteme eingesetzt, wobei die konkurrierenden Frameworks CnnSpot; AntifakePrompt; TruFor; und die auf Vision-Sprache basierende AIDSJedes Modell wurde zunächst in Nullschuss Modus, unter Verwendung seines ursprünglichen vortrainierten Gewichte ohne weitere Anpassung.

Zwei Modelle, CnnSpot und SIDA, wurden dann fein abgestimmt auf MultiFakeVerse-Trainingsdaten, um zu beurteilen, ob ein erneutes Training die Leistung verbessert hat.

Ergebnisse der Deepfake-Erkennung auf MultiFakeVerse unter Zero-Shot- und Feinabstimmungsbedingungen. Zahlen in Klammern zeigen Änderungen nach der Feinabstimmung.

Zu diesen Ergebnissen geben die Autoren an:

„Die Modelle, die zuvor auf Inpainting-basierten Fälschungen trainiert wurden, haben Schwierigkeiten, unsere auf VLM-Editing basierenden Fälschungen zu identifizieren. Insbesondere CNNSpot neigt dazu, fast alle Bilder als echt zu klassifizieren. AntifakePrompt bietet die beste Zero-Shot-Performance mit einer klassenbezogenen Durchschnittsgenauigkeit von 66.87 % und einem F55.55-Score von 1 %.“

„Nach der Feinabstimmung unseres Trainingssatzes beobachten wir eine Leistungsverbesserung sowohl bei CNNSpot als auch bei SIDA-13B, wobei CNNSpot SIDA-13B sowohl hinsichtlich der durchschnittlichen klassenweisen Genauigkeit (um 1.92 %) als auch hinsichtlich des F1-Scores (um 1.97 %) übertrifft.“

SIDA-13B wurde auf MultiFakeVerse evaluiert, um zu messen, wie präzise es die manipulierten Bereiche in jedem Bild lokalisieren konnte. Das Modell wurde sowohl im Zero-Shot-Modus als auch nach Feinabstimmung des Datensatzes getestet.

In seinem ursprünglichen Zustand erreichte es einen Intersection-over-Union-Score von 13.10, einen F1-Score von 19.92 und einen AUC von 14.06, was auf eine schwache Lokalisierungsleistung hindeutet.

Nach der Feinabstimmung verbesserten sich die Werte auf 24.74 für IoU, 39.40 für F1 und 37.53 für AUC. Selbst mit zusätzlichem Training hatte das Modell jedoch immer noch Schwierigkeiten, die genauen Stellen der Änderungen zu finden. Dies verdeutlicht, wie schwierig es sein kann, solche kleinen, gezielten Änderungen zu erkennen.

Fazit

Die neue Studie deckt einen blinden Fleck sowohl in der menschlichen als auch in der maschinellen Wahrnehmung auf: Während sich ein Großteil der öffentlichen Debatte um Deepfakes auf schlagzeilenträchtige Identitätstausche konzentrierte, sind diese leiseren „narrativen Bearbeitungen“ schwerer zu erkennen und auf lange Sicht potenziell schädlicher.

Da Systeme wie ChatGPT und Gemini eine aktivere Rolle bei der Generierung dieser Art von Inhalten spielen und wir selbst zunehmend teilnehmen Bei der Veränderung der Realität unserer eigenen Fotostreams bieten Erkennungsmodelle, die auf der Erkennung grober Manipulationen beruhen, möglicherweise keinen ausreichenden Schutz.

Was MultiFakeVerse zeigt, ist nicht, dass die Erkennung fehlgeschlagen ist, sondern dass sich zumindest ein Teil des Problems in eine schwierigere, langsamere Form verlagert: eine, bei der sich kleine visuelle Lügen unbemerkt anhäufen.

Erstveröffentlichung Donnerstag, 5. Juni 2025