Andersons Blickwinkel

Wiederherstellung und Bearbeitung von menschlichen Bildern mit KI

Eine neue Zusammenarbeit zwischen der University of California Merced und Adobe bietet einen Fortschritt im Bereich der menschlichen Bildvervollständigung – der viel studierten Aufgabe, verdeckte oder verborgene Teile von Bildern von Menschen “aufzudecken”, für Zwecke wie virtuelles Anprobieren, Animation und Bildbearbeitung.

Neben der Reparatur beschädigter Bilder oder der Änderung nach Belieben kann das menschliche Bildvervollständigungssystem CompleteMe neue Kleidung (über ein Nebenreferenzbild, wie in der mittleren Spalte in diesen beiden Beispielen) in bestehende Bilder einfügen. Diese Beispiele stammen aus dem umfangreichen ergänzenden PDF für den neuen Artikel. Quelle: https://liagm.github.io/CompleteMe/pdf/supp.pdf

Der neue Ansatz, betitelt CompleteMe: Referenzbasierte menschliche Bildvervollständigung, verwendet zusätzliche Eingabebilder, um dem System zu “sagen”, welcher Inhalt den verdeckten oder fehlenden Teil der menschlichen Darstellung ersetzen sollte (daher die Anwendbarkeit auf Mode-basierte Anprobeframeworks):

Das CompleteMe-System kann Referenzinhalte an den verdeckten oder verdeckten Teil eines menschlichen Bildes anpassen.

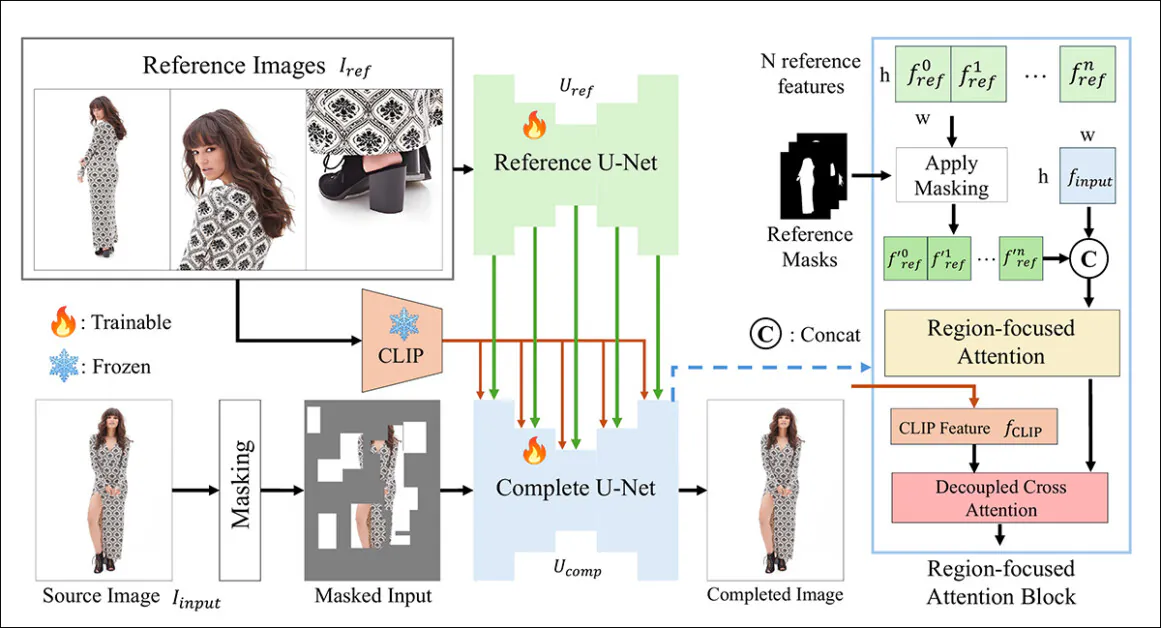

Das System verwendet eine duale U-Net-Architektur und einen Region-Focused Attention-Block (RFA), der Ressourcen auf den relevanten Bereich der Bildwiederherstellung marshals.

Die Forscher bieten auch ein neues und herausforderndes Benchmark-System, das zur Bewertung von referenzbasierten Vervollständigungsaufgaben entwickelt wurde (da CompleteMe Teil eines bestehenden und laufenden Forschungsstrangs in der ComputerVision ist, aber bisher kein Benchmark-Schema hatte).

In Tests und in einer gut skalierten Benutzerstudie lag die neue Methode in den meisten Metriken vorne und insgesamt vorne. In bestimmten Fällen waren rivalisierende Methoden von dem referenzbasierten Ansatz völlig überfordert:

Aus dem ergänzenden Material: Die AnyDoor-Methode hat besondere Schwierigkeiten, eine Referenzbild zu interpretieren.

Das Papier besagt:

‘Umfangreiche Experimente auf unserem Benchmark demonstrieren, dass CompleteMe die State-of-the-Art-Methoden, sowohl referenzbasiert als auch nicht-referenzbasiert, in Bezug auf quantitative Metriken, qualitative Ergebnisse und Benutzerstudien übertrifft.

‘Insbesondere in herausfordernden Szenarien mit komplexen Posen, intrikaten Kleidungsmustern und auffälligen Accessoires erreicht unser Modell konsistent eine überlegene visuelle Treue und semantische Kohärenz.’

Leider enthält die GitHub-Präsenz des Projekts keinen Code und macht auch keine Versprechungen, und die Initiative, die auch eine bescheidene Projektseite hat, scheint als proprietäre Architektur konzipiert zu sein.

Weitere Beispiele für die subjektive Leistung des neuen Systems im Vergleich zu vorherigen Methoden. Weitere Details später im Artikel.

Methode

Das CompleteMe-Framework basiert auf einem Reference-U-Net, das die Integration des Nebenmaterials in den Prozess handhabt, und einem kohärenten U-Net, das eine breitere Palette von Prozessen zur Erzielung des Endergebnisses aufnimmt, wie in dem folgenden Konzeptschema dargestellt:

Das Konzeptschema für CompleteMe. Quelle: https://arxiv.org/pdf/2504.20042

Das System kodiert zunächst das maskierte Eingabebild in eine latente Darstellung. Gleichzeitig verarbeitet das Reference-U-Net mehrere Referenzbilder – jedes zeigt unterschiedliche Körperregionen –, um detaillierte räumliche Merkmale zu extrahieren.

Diese Merkmale werden durch einen Region-focused Attention-Block im “vollständigen” U-Net verarbeitet, wo sie selektiv maskiert werden, indem entsprechende Regionenmasken verwendet werden, um sicherzustellen, dass das Modell nur auf relevante Bereiche in den Referenzbildern achtet.

Die maskierten Merkmale werden dann mit globalen CLIP-abgeleiteten semantischen Merkmalen durch dekoppelte Cross-Attention integriert, was es dem Modell ermöglicht, fehlenden Inhalt mit feinen Details und semantischer Kohärenz wiederherzustellen.

Um Realismus und Robustheit zu verbessern, kombiniert der Eingabemaskierungsprozess zufällige gridbasierte Verdeckungen mit Körperkonturmasken, die jeweils mit gleicher Wahrscheinlichkeit angewendet werden, um die Komplexität der fehlenden Regionen zu erhöhen, die das Modell vervollständigen muss.

Nur für Referenz

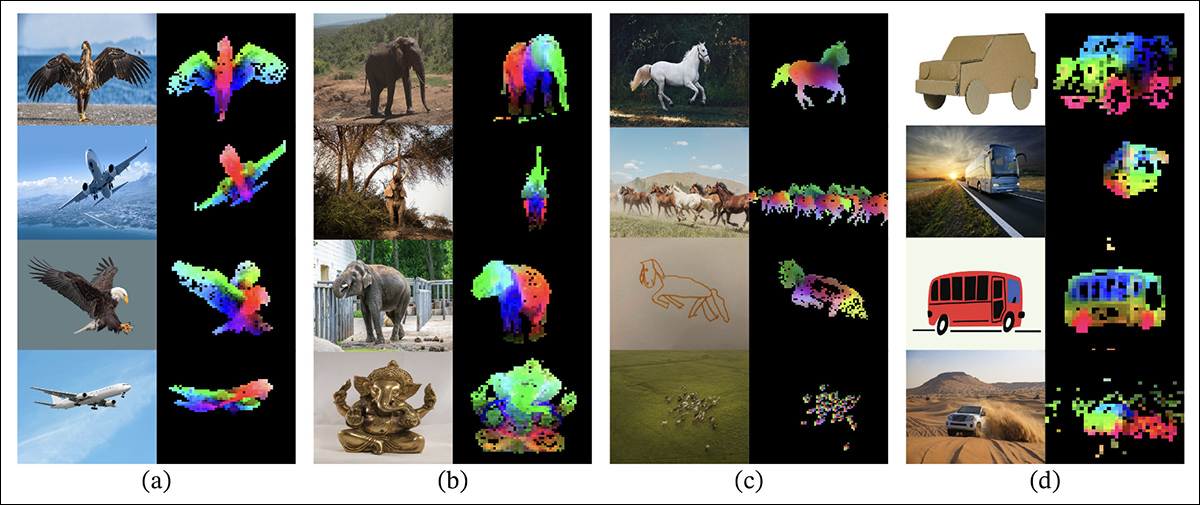

Frühere Methoden für referenzbasierte Bildinpainting basierten typischerweise auf semantischen-Level-Encodern. Projekte dieser Art umfassen CLIP selbst und DINOv2, die globale Merkmale aus Referenzbildern extrahieren, aber oft die feinen räumlichen Details verlieren, die für eine genaue Identitätsbewahrung erforderlich sind.

Aus dem Veröffentlichungspapier für den älteren DINOv2-Ansatz, der in den Vergleichstests des neuen Artikels enthalten ist: Die farbigen Überlagerungen zeigen die ersten drei Hauptkomponenten aus der Hauptkomponentenanalyse (PCA), die auf Bildstücken innerhalb jeder Spalte angewendet werden, um zu zeigen, wie DINOv2 ähnliche Objektteile über verschiedene Bilder hinweg zusammenfasst. Trotz Unterschiede in Pose, Stil oder Darstellung werden entsprechende Regionen (wie Flügel, Gliedmaßen oder Räder) konsistent abgestimmt, was die Fähigkeit des Modells zeigt, eine teilbasierte Struktur ohne Aufsicht zu erlernen. Quelle: https://arxiv.org/pdf/2304.07193

CompleteMe behandelt diesen Aspekt durch ein spezialisiertes Reference-U-Net, das von Stable Diffusion 1.5 initialisiert wird, aber ohne den Diffusionsrauschen-Schritt*.

Jedes Referenzbild, das unterschiedliche Körperregionen zeigt, wird in detaillierte latente Merkmale durch dieses U-Net kodiert. Globale semantische Merkmale werden auch separat mit CLIP extrahiert und beide Merkmalsätze werden für eine effiziente Verwendung während der attentionbasierten Integration zwischengespeichert. So kann das System mehrere Referenzeingaben flexibel handhaben, während es die feinen Erscheinungsmerkmale bewahrt.

Orchestrierung

Das kohärente U-Net verwaltet die Endstadien des Vervollständigungsprozesses. Es basiert auf der Inpainting-Variante von Stable Diffusion 1.5 und nimmt die maskierte Quellbild in latenter Form sowie detaillierte räumliche Merkmale aus den Referenzbildern und globale semantische Merkmale, die von dem CLIP-Encoder extrahiert werden, als Eingabe.

Diese verschiedenen Eingaben werden durch den RFA-Block zusammengeführt, der eine entscheidende Rolle bei der Steuerung der Modellfokussierung auf die relevantesten Bereiche des Referenzmaterials spielt.

Bevor sie in den Attention-Mechanismus eingegeben werden, werden die Referenzmerkmale explizit maskiert, um nicht relevante Regionen zu entfernen, und dann mit der latenten Darstellung des Quellbildes verkettet, um sicherzustellen, dass die Aufmerksamkeit so genau wie möglich gerichtet wird.

Um diese Integration zu verbessern, integriert CompleteMe einen dekoppelten Cross-Attention-Mechanismus, der von dem IP-Adapter-Framework adaptiert wurde:

IP-Adapter, der Teil von CompleteMe ist, ist eines der erfolgreichsten und oft genutzten Projekte der letzten drei turbulenten Jahre der Entwicklung von latenten Diffusionsmodell-Architekturen. Quelle: https://ip-adapter.github.io/

Dies ermöglicht es dem Modell, räumlich detaillierte visuelle Merkmale und breitere semantische Kontexte durch separate Attention-Ströme zu verarbeiten, die später kombiniert werden, was zu einer kohärenten Rekonstruktion führt, die, wie die Autoren behaupten, sowohl Identität als auch feine Details bewahrt.

Benchmarking

Da es an einem geeigneten Datensatz für referenzbasierte menschliche Vervollständigung fehlt, haben die Forscher ihren eigenen vorgeschlagen. Der (unbenannte) Benchmark wurde durch die Kuration von ausgewählten Bildpaaren aus dem WPose-Datensatz entwickelt, der für das Adobe Research-Projekt UniHuman 2023 konzipiert wurde.

Beispiele für Posen aus dem Adobe Research-Projekt UniHuman 2023. Quelle: https://github.com/adobe-research/UniHuman?tab=readme-ov-file#data-prep

Die Forscher haben manuell Quellmasken gezeichnet, um die Inpainting-Bereiche zu markieren, und letztendlich 417 tripartite Bildgruppen erhalten, die ein Quellbild, eine Maske und ein Referenzbild umfassen.

Zwei Beispiele für Gruppen, die ursprünglich aus dem Referenz-WPose-Datensatz stammen und von den Forschern des neuen Artikels umfassend kuratiert wurden.

Die Autoren verwendeten das LLaVA-Large-Language-Modell (LLM), um Textprompts zu generieren, die die Quellbilder beschreiben.

Die verwendeten Metriken waren umfangreicher als üblich; neben dem üblichen Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM) und Learned Perceptual Image Patch Similarity (LPIPS, in diesem Fall für die Bewertung von maskierten Regionen) verwendeten die Forscher DINO für Ähnlichkeitsscores; DreamSim für die Bewertung der Generierungsergebnisse; und CLIP.

Daten und Tests

Um die Arbeit zu testen, verwendeten die Autoren sowohl das Standard-Stable-Diffusion-V1.5-Modell als auch das 1.5-Inpainting-Modell. Der Bildencoder des Systems verwendete das CLIP Vision-Modell, zusammen mit Projektionslayern – bescheidenen neuronalen Netzen, die die CLIP-Ausgaben umformen oder an die internen Merkmalsdimensionen anpassen, die vom Modell verwendet werden.

Das Training fand über 30.000 Iterationen auf acht NVIDIA-A100†-GPUs statt, überwacht von Mittlerem quadratischem Fehler (MSE), bei einer Batch-Größe von 64 und einer Lernrate von 2×10-5. Verschiedene Elemente wurden während des Trainings zufällig entfernt, um zu verhindern, dass das System überfittet auf den Daten.

Das Datenset wurde von dem Parts to Whole-Datenset modifiziert, das selbst auf dem DeepFashion-MultiModal-Datenset basiert.

Beispiele aus dem Parts to Whole-Datenset, das für die Entwicklung der kuratierten Daten für CompleteMe verwendet wurde. Quelle: https://huanngzh.github.io/Parts2Whole/

Die Autoren stellen fest:

‘Um unsere Anforderungen zu erfüllen, haben wir die Trainingspaare durch die Verwendung von verdeckten Bildern mit mehreren Referenzbildern, die verschiedene Aspekte des menschlichen Erscheinungsbildes erfassen, sowie ihre kurzen textuellen Labels neu aufgebaut.

‘Jedes Beispiel in unseren Trainingsdaten umfasst sechs Erscheinungstypen: Oberkörper-Kleidung, Unterkörper-Kleidung, gesamte Körper-Kleidung, Haare oder Kopfbedeckung, Gesicht und Schuhe. Für die Maskierungsstrategie wenden wir 50% zufällige Grid-Maskierung zwischen 1 und 30 Mal an, während wir für die anderen 50% eine Körperkonturmaske verwenden, um die Maskierkomplexität zu erhöhen.

‘Nach dem Konstruktionsprozess haben wir 40.000 Bildpaare für das Training erhalten.’

Rivalisierende vorherige nicht-referenzielle Methoden, die getestet wurden, waren Large occluded human image completion (LOHC) und das Plug-and-Play-Bildinpainting-Modell BrushNet; referenzielle Modelle, die getestet wurden, waren Paint-by-Example; AnyDoor; LeftRefill; und MimicBrush.

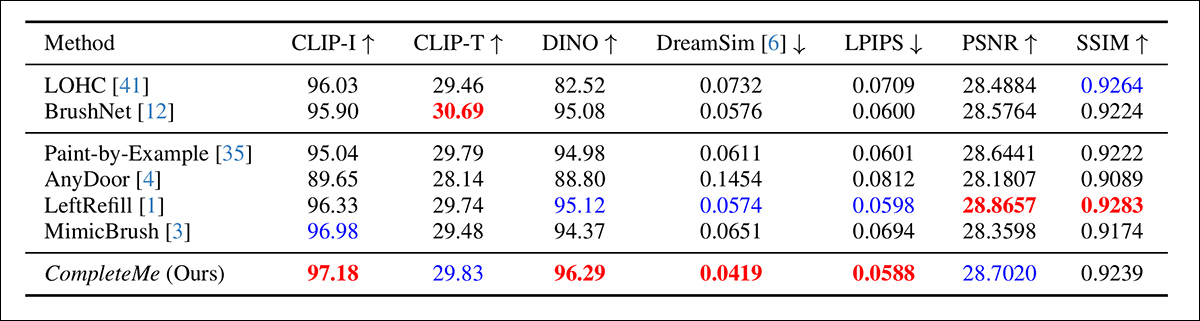

Die Autoren begannen mit einem quantitativen Vergleich auf den vorher genannten Metriken:

Ergebnisse für den initialen quantitativen Vergleich.

In Bezug auf die quantitative Bewertung stellen die Autoren fest, dass CompleteMe die höchsten Punktzahlen in den meisten wahrgenommenen Metriken erreicht, einschließlich CLIP-I, DINO, DreamSim und LPIPS, die darauf abzielen, semantische Ausrichtung und Erscheinungstreue zwischen der Ausgabe und dem Referenzbild zu erfassen.

Allerdings übertrifft das Modell nicht alle Baselines in allen Metriken. Insbesondere erzielt BrushNet die höchste Punktzahl bei CLIP-T, LeftRefill führt bei SSIM und PSNR, und MimicBrush übertrifft leicht bei CLIP-I.

Während CompleteMe konsistent starke Ergebnisse zeigt, sind die Leistungsunterschiede in einigen Fällen bescheiden, und bestimmte Metriken bleiben von konkurrierenden vorherigen Methoden geführt. Vielleicht nicht ungerechtfertigt, betrachten die Autoren diese Ergebnisse als Beweis für die ausgewogene Stärke von CompleteMe in beiden strukturellen und wahrgenommenen Dimensionen.

Illustrationen für die qualitativen Tests, die für die Studie durchgeführt wurden, sind zu zahlreich, um hier reproduziert zu werden, und wir verweisen den Leser nicht nur auf das Quellenpapier, sondern auch auf das umfangreiche ergänzende PDF, das viele zusätzliche qualitative Beispiele enthält.

Wir heben die primären qualitativen Beispiele hervor, die im Hauptpapier präsentiert werden, zusammen mit einer Auswahl von zusätzlichen Fällen, die aus dem ergänzenden Bildpool stammen, der zu Beginn dieses Artikels eingeführt wurde:

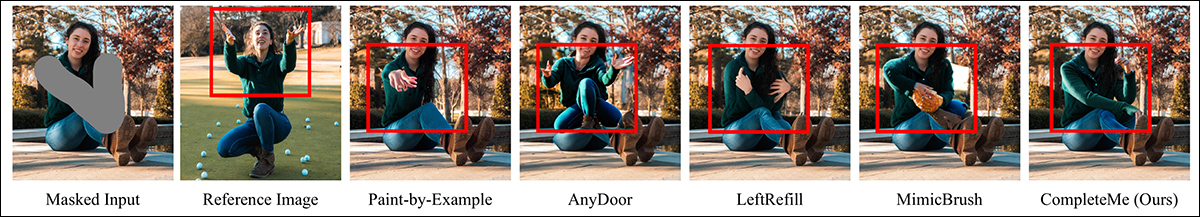

Erste qualitative Ergebnisse, die im Hauptpapier präsentiert werden. Bitte verweisen Sie auf das Quellenpapier für eine bessere Auflösung.

Zu den qualitativen Ergebnissen, die oben dargestellt sind, bemerken die Autoren:

‘Gegeben maskierte Eingaben, generieren diese nicht-referenziellen Methoden plausiblen Inhalt für die maskierten Regionen mithilfe von Bildprioren oder Textprompts.

‘Allerdings können sie, wie im roten Kasten angegeben, keine spezifischen Details wie Tätowierungen oder einzigartige Kleidungsmuster reproduzieren, da sie keine Referenzbilder haben, um die Rekonstruktion identischer Informationen zu leiten.’

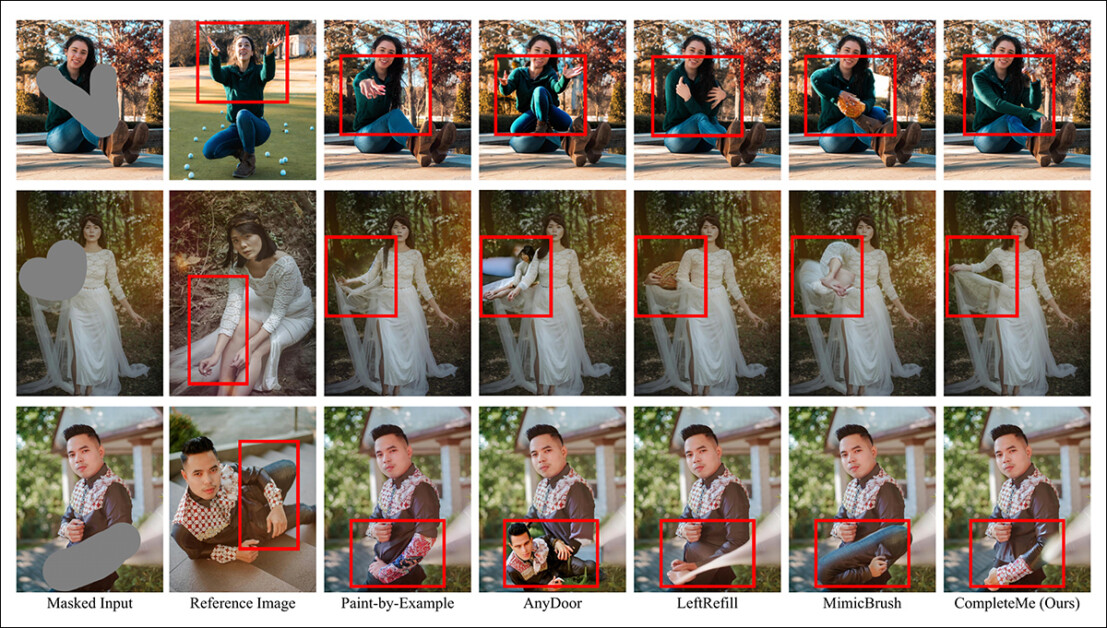

Ein zweiter Vergleich, der teilweise unten gezeigt wird, konzentriert sich auf die vier referenziellen Methoden Paint-by-Example, AnyDoor, LeftRefill und MimicBrush. Hier wurde nur ein Referenzbild und ein Textprompt bereitgestellt.

Qualitativer Vergleich mit referenziellen Methoden. CompleteMe produziert realistischere Vervollständigungen und bewahrt spezifische Details aus dem Referenzbild besser. Die roten Kästchen heben Bereiche von besonderem Interesse hervor.

Die Autoren stellen fest:

‘Gegeben ein maskiertes menschliches Bild und ein Referenzbild, können andere Methoden plausiblen Inhalt generieren, aber oft die kontextuelle Information aus dem Referenzbild nicht genau bewahren.

‘In einigen Fällen generieren sie irrelevanten Inhalt oder ordnen entsprechende Teile aus dem Referenzbild falsch zu. Im Gegensatz dazu vervollständigt CompleteMe die maskierte Region, indem es identische Informationen genau bewahrt und entsprechende Körperteile aus dem Referenzbild korrekt zuordnet.’

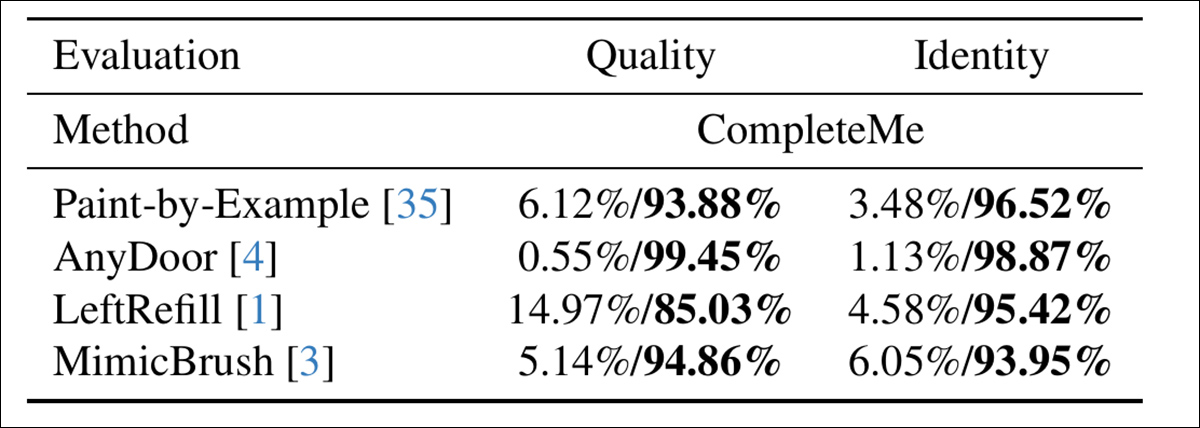

Um zu bewerten, wie gut die Modelle mit der menschlichen Wahrnehmung übereinstimmen, führten die Autoren eine Benutzerstudie mit 15 Annotatoren und 2.895 Beispiel-Paaren durch. Jedes Paar verglich die Ausgabe von CompleteMe mit einer der vier referenziellen Baselines: Paint-by-Example, AnyDoor, LeftRefill oder MimicBrush.

Die Annotatoren bewerteten jedes Ergebnis basierend auf der visuellen Qualität der vervollständigten Region und dem Ausmaß, in dem es Identitätsmerkmale aus dem Referenzbild bewahrte – und hier, bei der Bewertung der Gesamtqualität und Identität, erzielte CompleteMe ein deutlicheres Ergebnis:

Ergebnisse der Benutzerstudie.

Schlussfolgerung

Wenn überhaupt, werden die qualitativen Ergebnisse in dieser Studie durch ihre schiere Menge untergraben, da eine genauere Untersuchung zeigt, dass das neue System ein sehr effektiver Eintrag in diesem relativ speziellen, aber heiß umkämpften Bereich der neuronalen Bildbearbeitung ist.

Allerdings erfordert es ein wenig mehr Sorgfalt und Zoomen auf das Original-PDF, um zu erkennen, wie gut das System das Referenzmaterial an die verdeckte Region anpasst, im Vergleich (in fast allen Fällen) zu vorherigen Methoden.

Wir empfehlen dem Leser dringend, die anfänglich verwirrenden, wenn nicht überwältigenden Ergebnisse, die im ergänzenden Material präsentiert werden, sorgfältig zu untersuchen.