Gesundheitswesen

Erkennung von Mitarbeiterstress durch Gesichtsanalyse am Arbeitsplatz

Im Kontext der verändernden Kultur um Zoom-Meeting-Etikette und dem Aufkommen von Zoom-Erschöpfung, haben Forscher von Cambridge eine Studie veröffentlicht, die maschinelles Lernen verwendet, um unsere Stresslevel über AI-aktivierte Webcam-Aufnahmen unserer Gesichtsausdrücke am Arbeitsplatz zu bestimmen.

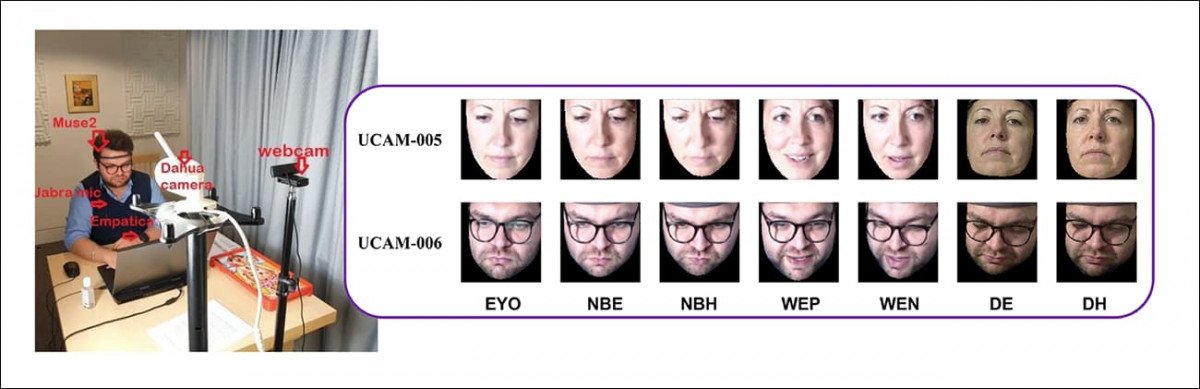

Auf der linken Seite, die Datenerfassungsumgebung, mit mehreren Überwachungsgeräten, die entweder auf einen Freiwilligen gerichtet sind oder an diesen angebracht sind; auf der rechten Seite, Beispielgesichtsausdrücke, die von Testpersonen bei verschiedenen Schwierigkeitsgraden der Aufgaben erzeugt wurden. Quelle: https://arxiv.org/pdf/2111.11862.pdf

Die Forschung ist für die Affektanalyse (d. h. Emotionserkennung) in “Ambient Assistive Living”-Systemen gedacht und soll offensichtlich video-basierte AI-Gesichtsausdrucks-Überwachungsframeworks in solchen Systemen ermöglichen; obwohl die Veröffentlichung diesen Aspekt nicht erweitert, ergibt sich die Forschungsanstrengung in keinem anderen Kontext.

Der spezifische Umfang des Projekts ist es, Gesichtsausdrucksmuster in Arbeitsumgebungen zu erlernen – einschließlich Remote-Arbeitsvereinbarungen – und nicht in “Freizeit”- oder “passiven” Situationen, wie z. B. Reisen.

Gesichtsbasierte Emotionserkennung am Arbeitsplatz

Während “Ambient Assistive Living” wie ein Schema für die Altenpflege klingen mag, ist das weit von der Sache entfernt. In Bezug auf die beabsichtigten “Endnutzer” erklären die Autoren*:

‘Systeme, die für ambient assistive living-Umgebungen erstellt werden, [†] zielen darauf ab, sowohl automatische Affektanalyse als auch Reaktionen durchzuführen. Ambient assistive living basiert auf der Nutzung von Informationstechnologie und Kommunikation (IKT), um die tägliche Lebens- und Arbeitsumgebung einer Person zu unterstützen, um sie gesünder und länger aktiv zu halten und es ihnen zu ermöglichen, unabhängig zu leben, während sie älter werden. Daher zielt ambient assistive living darauf ab, Gesundheitspersonal, Krankenpfleger, Ärzte, Fabrikarbeiter, Fahrer, Piloten, Lehrer sowie verschiedene Branchen durch Sensing, Bewertung und Intervention zu unterstützen.

‘Das System soll den physischen, emotionalen und mentalen Stress bestimmen und reagieren und anpassen, wenn und wie erforderlich, zum Beispiel kann ein mit einem Müdigkeitserkennungssystem ausgestatteter Wagen den Fahrer auffordern, aufmerksam zu bleiben und ihm vorschlagen, eine kurze Pause einzulegen, um Unfälle zu vermeiden [††].’

Die Veröffentlichung trägt den Titel Inferring User Facial Affect in Work-like Settings und stammt von drei Forschern des Affective Intelligence & Robotics Lab in Cambridge.

Testbedingungen

Da frühere Arbeiten in diesem Bereich größtenteils auf ad-hoc-Sammlungen von Bildern basieren, die aus dem Internet gesammelt wurden, führten die Cambridge-Forscher lokale Datenerfassungsexperimente mit 12 Freiwilligen durch, 5 Männer und 7 Frauen. Die Freiwilligen kamen aus neun Ländern und waren zwischen 22 und 41 Jahren alt.

Das Projekt zielte darauf ab, drei potenziell stressige Arbeitsumgebungen nachzubilden: ein Büro; eine Fabrikproduktionslinie; und eine Videokonferenz – wie z. B. die Art von Zoom-Gruppenchat, die seit der Pandemie zu einem häufigen Feature von Homeoffice geworden ist.

Die Testpersonen wurden durch verschiedene Mittel überwacht, darunter drei Kameras, ein Jabra-Halsmikrofon, ein Empatica-Armband (ein drahtloses Multisensor-Trägergerät, das Echtzeit-Biofeedback bietet) und ein Muse 2-Kopfband-Sensor (der auch Biofeedback bietet). Zusätzlich wurden die Freiwilligen gebeten, Umfragen auszufüllen und ihre Stimmung regelmäßig selbst zu bewerten.

Jedoch bedeutet dies nicht, dass zukünftige Ambient Assistive Living-Geräte Sie in diesem Umfang “anschließen” (wenn auch nur aus Kostengründen); alle nicht-kamera-basierten Überwachungsgeräte und -methoden, die bei der Datenerfassung verwendet wurden, einschließlich der schriftlichen Selbstbewertungen, sind dazu gedacht, die gesichtsbasierten Affekt-Erkennungssysteme zu überprüfen, die durch Kamera-Aufnahmen ermöglicht werden.

Den Druck erhöhen: Das Büroszenario

In den ersten beiden Szenarien (“Büro” und “Fabrik”) wurden die Freiwilligen mit einem leichten Tempo begonnen, wobei der Druck allmählich über vier Phasen hinweg erhöht wurde, mit verschiedenen Arten von Aufgaben für jede.

Auf dem höchsten Level des induzierten Stresses mussten die Freiwilligen auch den “Weiße-Kittel-Effekt” von jemandem ertragen, der über ihre Schulter schaute, plus 85 dB zusätzlichen Lärms, was gerade fünf Dezibel unter der gesetzlichen Grenze für ein Büroumfeld in den USA liegt und der exakte Höchstwert ist, der vom National Institute for Occupational Safety and Health (NIOSH) festgelegt wird.

In der büroähnlichen Datenerfassungsphase wurden die Testpersonen aufgefordert, vorherige Buchstaben zu erinnern, die auf ihrem Bildschirm aufgetaucht waren, mit zunehmenden Schwierigkeitsgraden (wie z. B. zwei Buchstabenfolgen, die zwei Bildschirme zuvor aufgetaucht waren).

Das Fabrikszenario

Um eine manuelle Arbeitsumgebung zu simulieren, wurden die Testpersonen aufgefordert, das Spiel Operation zu spielen, das die Benutzerhandhabung herausfordert, indem es vom Spieler verlangt, kleine Gegenstände aus einer Platte durch enge, metallgeränderte Öffnungen zu entfernen, ohne die Ränder zu berühren, was einen “Fehler”-Summer auslöst.

Als die schwierigste Phase kam, wurde der Freiwillige herausgefordert, alle 12 Gegenstände ohne Fehler innerhalb von einer Minute zu entfernen. Im Vergleich dazu liegt der Weltrekord für diese Aufgabe, der 2019 im Vereinigten Königreich aufgestellt wurde, bei 12,68 Sekunden.

Das Videokonferenzszenario

Schließlich wurden die Freiwilligen in der Homeoffice-/Videokonferenz-Testphase von einem Experimentator über einen MS-Teams-Anruf aufgefordert, ihre eigenen positiven und negativen Erinnerungen zu erinnern. Für die stressigste Phase dieses Szenarios musste der Freiwillige eine sehr negative oder traurige Erinnerung aus seiner jüngsten Vergangenheit erinnern.

Die verschiedenen Aufgaben und Szenarien wurden in zufälliger Reihenfolge durchgeführt und in eine benutzerdefinierte Datenbank mit dem Titel Working-Environment-Context-Aware Dataset (WECARE-DB) zusammengefasst.

Methode und Training

Die Ergebnisse der Selbstbewertungen der Testpersonen hinsichtlich ihrer Stimmung wurden als Grundwahrheit verwendet und auf Valenz- und Erregungsdimensionen abgebildet. Die aufgenommenen Videos der Experimente wurden durch ein Gesichtsmerkmaldetektions-Netzwerk geführt, und die ausgerichteten Bilder wurden einem ResNet-18-Netzwerk zugeführt, das auf dem AffectNet-Datensatz trainiert wurde.

450.000 Bilder aus AffectNet, alle aus dem Internet gezogen und mit Emotions-bezogenen Abfragen annotiert, wurden von Hand annotiert, so die Veröffentlichung, mit Valenz- und Erregungsdimensionen.

Als Nächstes verfeinerten die Forscher das Netzwerk ausschließlich auf der Grundlage ihrer eigenen WECARE-Datenbank, während spektrale Repräsentationscodierung verwendet wurde, um framebasierte Vorhersagen zusammenzufassen.

Ergebnisse

Die Leistung des Modells wurde anhand von drei Metriken bewertet, die häufig mit automatisierter Affekterkennung in Verbindung gebracht werden: Concordance-Koeffizient-Korrelation; Pearson-Koeffizient-Korrelation; und Root-Mean-Square-Fehler (RMSE).

Die Autoren bemerken, dass das Modell, das auf ihrer eigenen WECARE-Datenbank fein abgestimmt wurde, ResNet-18 übertraf und daraus schließen, dass die Art und Weise, wie wir unsere Gesichtsausdrücke steuern, in einer Arbeitsumgebung sehr unterschiedlich ist als in den abstrakteren Kontexten, aus denen frühere Studien Material aus dem Internet bezogen haben.

Sie erklären:

‘Wenn wir uns die Tabelle ansehen, stellen wir fest, dass das Modell, das auf WECARE-DB fein abgestimmt wurde, das ResNet-18-Modell übertraf, das auf [AffectNet] vorab trainiert wurde, was darauf hinweist, dass die Gesichtsverhaltensweisen, die in arbeitsähnlichen Umgebungen gezeigt werden, sich von denen in den Internet-Szenarien unterscheiden, die in der AffectNet-Datenbank verwendet werden. Es ist daher notwendig, Datenbanken zu erwerben und Modelle für die Erkennung von Gesichtsausdrücken in arbeitsähnlichen Umgebungen zu trainieren.’

In Bezug auf die Zukunft der Affekterkennung am Arbeitsplatz, die durch Netze von Kameras ermöglicht wird, die ständig Vorhersagen über den emotionalen Zustand der Mitarbeiter machen, kommen die Autoren zu dem Schluss*:

‘Das ultimative Ziel ist es, die trainierten Modelle in Echtzeit und in realen Arbeitsumgebungen zu implementieren und zu verwenden, um Entscheidungsunterstützungssysteme zu liefern, die die Gesundheit und das Wohlbefinden der Menschen während ihres Arbeitslebens im Rahmen des EU-Arbeitsalter-Projekts fördern.’

* Meine Betonung.

† Hier zitieren die Autoren drei Quellen:

Automatische, dimensionale und kontinuierliche Emotionserkennung – https://ibug.doc.ic.ac.uk/media/uploads/documents/GunesPantic_IJSE_2010_camera.pdf

Erkundung des Ambient-Assistive-Living-Bereichs: Eine systematische Übersicht – https://link.springer.com/article/10.1007/s12652-016-0374-3

Überblick über Internet-of-Things-Technologien für Ambient-Assistive-Living-Umgebungen – https://mdpi-res.com/d_attachment/futureinternet/futureinternet-11-00259/article_deploy/futureinternet-11-00259-v2.pdf

†† Hier zitieren die Autoren zwei Quellen:

Echtzeit-Erkennung von Fahrermüdigkeit für eingebettete Systeme unter Verwendung von Modellkomprimierung von Deep-Neural-Netzwerken – https://openaccess.thecvf.com/content_cvpr_2017_workshops/w4/papers/Reddy_Real-Time_Driver_Drowsiness_CVPR_2017_paper.pdf

Echtzeit-System zur Erkennung von Fahrermüdigkeit unter Verwendung von Gesichtsmerkmalen – https://www.semanticscholar.org/paper/Real-Time-Driver-Drowsiness-Detection-System-Using-Deng-Wu/1f4b0094c9e70bf7aa287234e0fdb4c764a5c532