Partnerschaften

Opentrons & NVIDIA starten eine neue Ära von künstlicher Intelligenz-gesteuerten Labors, indem sie Roboter in lernende Wissenschaftler verwandeln

Für den größten Teil des vergangenen Jahrzehnts konzentrierte sich die künstliche Intelligenz in den Lebenswissenschaften auf Vorhersagen. Modelle schlagen Arzneimittelziele vor, generieren molekulare Strukturen oder analysieren massive biologische Datensätze. Doch während die Erkenntnisse schnell voranschreiten, bleibt die experimentelle Ausführung ein Engpass. Die Umsetzung von durch künstliche Intelligenz generierten Hypothesen in reale, reproduzierbare Laborversuche ist immer noch langsam, teuer und fragmentiert über Instrumente und Workflows.

Diese Lücke wird nun geschlossen. Opentrons hat eine tiefe Integration mit NVIDIA angekündigt, die direkt auf die Lösung dieses Problems abzielt, indem sie physische künstliche Intelligenz direkt in den täglichen Laborbetrieb integriert.

Ein globales Netzwerk von realen Labor-Robotern

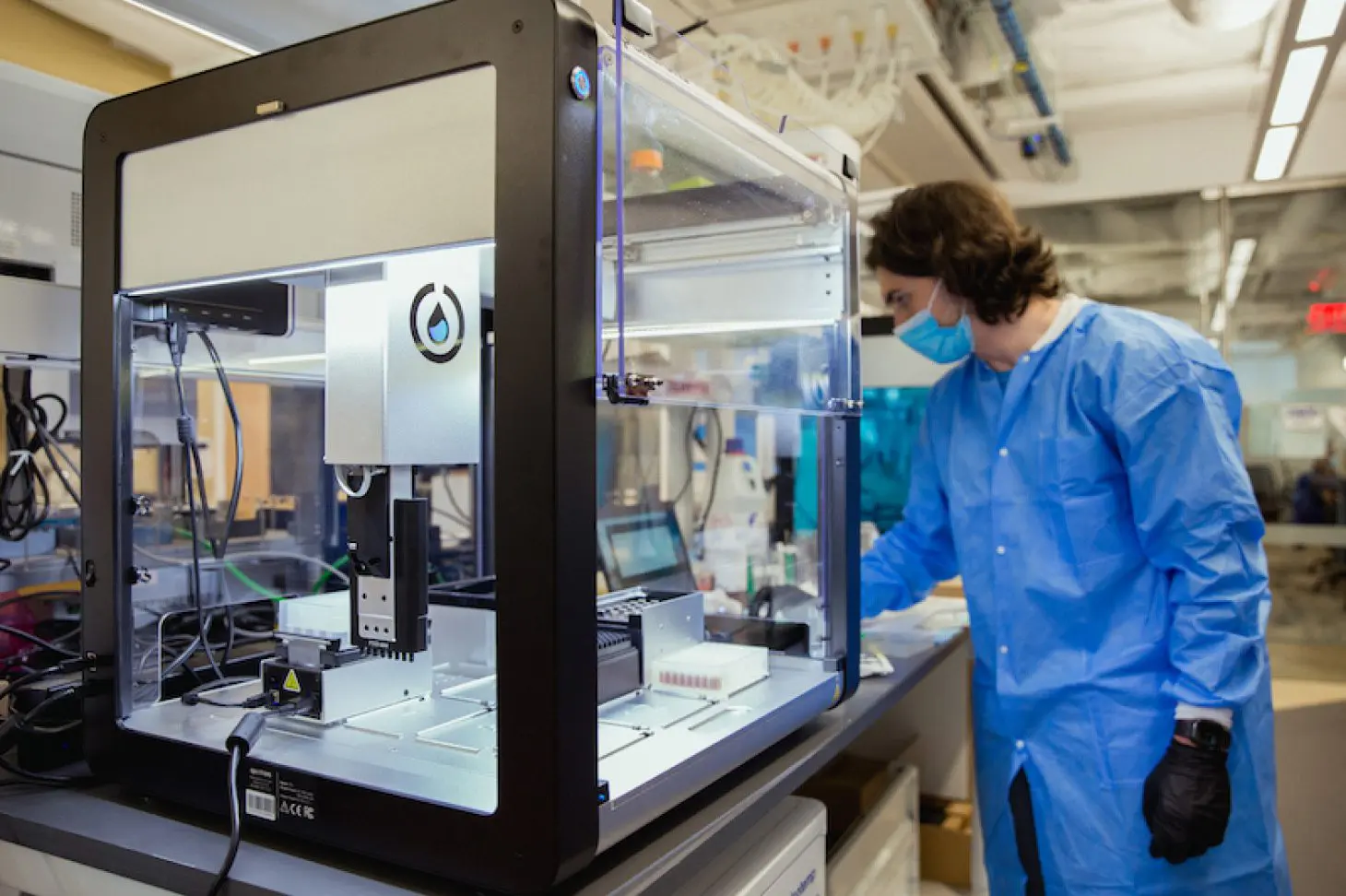

Was Opentrons einzigartig positioniert, ist die Skalierbarkeit. Das Unternehmen betreibt eine globale Flotte von mehr als 10.000 standardisierten Labor-Robotern, die in führenden Forschungsuniversitäten und Biopharma-Organisationen eingesetzt sind. Diese Systeme automatisieren bereits kritische Workflows in der Genomik, Proteomik, Antikörperentdeckung und Diagnostik.

Durch die Integration von NVIDIA’s physischen künstlichen Intelligenz-Plattformen — NVIDIA Isaac und NVIDIA Cosmos — verwandelt Opentrons diese installierte Basis in ein lebendiges Trainingsfeld für künstliche Intelligenz-Systeme. Anstatt sich hauptsächlich auf simulierte Daten zu verlassen, können physische künstliche Intelligenz-Modelle nun direkt aus realen experimentellen Ausführungen in nassen Labors auf der ganzen Welt lernen.

Brückenschlag zwischen Simulation und Realität

Simulationen sind seit langem für die Entwicklung von Robotik und künstlicher Intelligenz unerlässlich, aber Labors bringen eine einzigartige Komplexität mit sich. Biologische Variabilität, Instrumentenunterschiede, Reagenzverhalten und Umgebungsbedingungen beeinflussen alle Ergebnisse. Durch die Kombination von Simulationen mit standardisierter realer Ausführung schließen Opentrons und NVIDIA die Lücke zwischen digitaler Planung und physischen Ergebnissen.

In der Praxis können künstliche Intelligenz-Systeme ein experimentelles Design vorschlagen, Ergebnisse simulieren, das Experiment auf Opentrons-Robotern ausführen und die Ergebnisse zurück in die Modellierung einfließen lassen. Im Laufe der Zeit entstehen so künstliche Intelligenz-Systeme, die nicht nur vorhersagen, was funktionieren sollte, sondern auch verstehen, was in realen Laborumgebungen funktioniert.

Schließung der Lücke auf dem Gebiet der autonomen Wissenschaft

Ein wichtiger Teil dieses Bemühens ist NVIDIA’s biologischer künstlicher Intelligenz-Stack, einschließlich BioNeMo, der die Grundlage für die Ausbildung und Bereitstellung von künstlichen Intelligenz-Modellen für biologische Entdeckungen bildet. Opentrons liefert die fehlende Ausführungsebene — standardisierte, reproduzierbare und programmierbare physische Experimente.

Zusammen ermöglicht dies einen kontinuierlichen Lernzyklus. Künstliche Intelligenz-Modelle generieren Hypothesen und experimentelle Pläne. Roboter führen diese Experimente konsistent über Tausende von Labors hinweg aus. Ergebnisse werden als hochwertige Trainingsdaten erfasst und zurück in die künstlichen Intelligenz-Systeme eingespeist, um die nächste Iteration zu verfeinern. Wenn dies skaliert wird, hat dieser Feedback-Schleife das Potenzial, Entdeckungszeiträume von Jahren auf Wochen zu komprimieren.

Warum Standardisierung wichtig ist

Labors sind historisch gesehen heterogene Umgebungen. Benutzerdefinierte Automatisierungssetup, proprietäre Instrumente und manuelle Prozesse machen es schwierig, Ergebnisse zu vergleichen oder Daten im großen Maßstab wiederzuverwenden. Opentrons’ Ansatz dreht diese Dynamik um, indem er die Ausführung standardisiert und gleichzeitig offen und API-getrieben bleibt.

Diese Standardisierung ermöglicht es physischen künstlichen Intelligenz-Modellen, sich über Labors hinweg zu verallgemeinern. Wenn Experimente in New York, Boston oder Basel auf die gleiche Weise durchgeführt werden, können künstliche Intelligenz-Systeme Muster lernen, die über Umgebungen hinweg Gültigkeit haben, anstatt sich auf eine einzelne Einrichtung zu spezialisieren.

Auswirkungen auf die Arzneimittelentdeckung und darüber hinaus

Der unmittelbare Einfluss wird wahrscheinlich in der Arzneimittelentdeckung zu spüren sein, wo experimentelle Durchlaufzahl und Reproduzierbarkeit direkt die Geschwindigkeit und Kosten beeinflussen. Doch die Auswirkungen reichen weiter. Autonome experimentelle Ausführung könnte die Art und Weise verändern, wie Diagnosen entwickelt, biologische Forschung validiert und wie schnell neue Therapien vom Konzept zur Klinik gelangen.

Im weiteren Sinne signalisiert diese Partnerschaft eine Verschiebung in der Anwendung von künstlicher Intelligenz in der Wissenschaft. Anstatt bei Empfehlungen zu stoppen, beginnen künstliche Intelligenz-Systeme zu handeln — Experimente durchzuführen, aus Ergebnissen zu lernen und sich autonom zu verbessern. Dies markiert einen frühen, aber bedeutungsvollen Schritt in Richtung selbstfahrender Labors, in denen menschliche Wissenschaftler sich auf Strategie und Interpretation konzentrieren, während künstliche Intelligenz und Robotik die Ausführung im großen Maßstab übernehmen.

Ein Blick auf das, was kommt

Opentrons und NVIDIA werden diese Vision auf der bevorstehenden SLAS International Conference and Exhibition öffentlich vorstellen, wo sie diskutieren werden, wie AI-gesteuerte Planung und robotische Ausführung konvergieren. Teilnehmer werden auch die Gelegenheit haben, reale experimentelle Ausführungsdaten beizutragen, um die nächste Generation von physischen künstlichen Intelligenz-Modellen zu trainieren.

Wenn physische künstliche Intelligenz von der Theorie in die Praxis übergeht, heben Partnerschaften wie diese einen größeren Trend hervor: Die Zukunft der künstlichen Intelligenz in der Wissenschaft wird nicht nur durch bessere Vorhersagen definiert, sondern durch Systeme, die in der Lage sind, ihre eigenen Experimente zu entwerfen, durchzuführen und zu lernen — kontinuierlich, autonom und im globalen Maßstab.