Partnerschaften

Infineon Technologies und d-Matrix kooperieren bei Low-Latency-AI-Infrastruktur

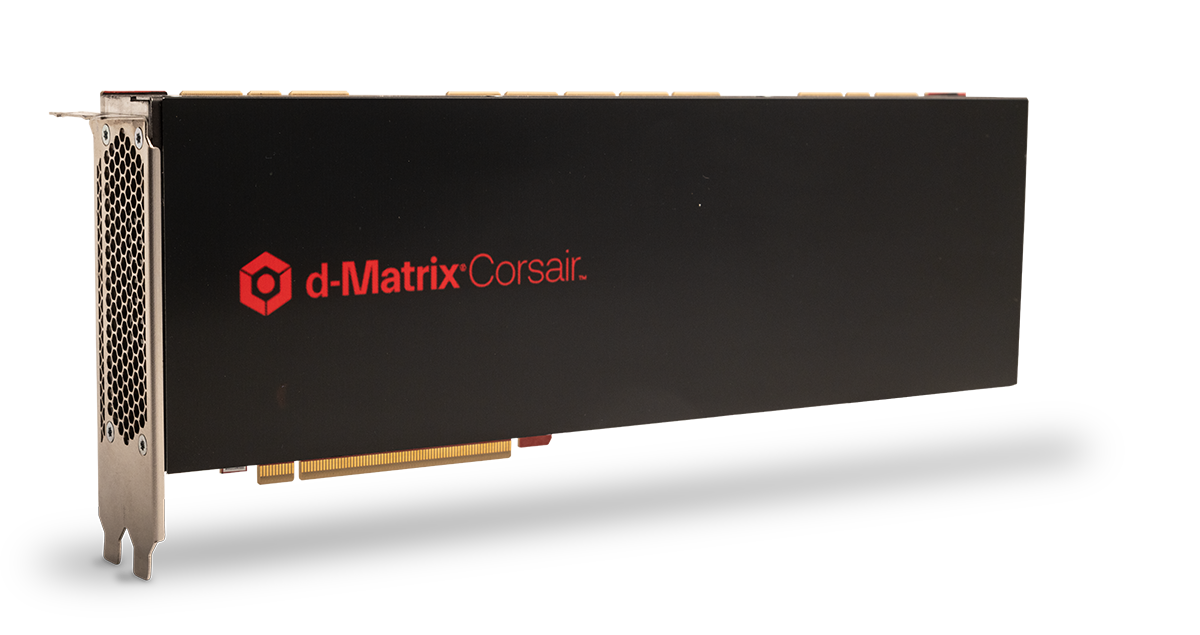

Infineon Technologies hat eine Zusammenarbeit mit d-Matrix bekannt gegeben, die auf die Verbesserung der Leistung und Energieeffizienz von AI-Inferenzsystemen abzielt, die in modernen Rechenzentren verwendet werden. Die Partnerschaft konzentriert sich auf d-Matrix’ Corsair-AI-Inferenz-Beschleuniger-Plattform und Infineons OptiMOS-Dual-Phase-Leistungsmodulen, die für hochdichte Rechenumgebungen für interaktive AI-Workloads konzipiert sind.

Die Ankündigung unterstreicht eine wachsende Verschiebung innerhalb der AI-Hardware-Industrie. Während sich der größte Teil des Infrastruktur-Booms in den letzten Jahren auf die Ausbildung immer größerer AI-Modelle konzentrierte, expandiert die Industrie nun schnell in die Inferenz – den Prozess des tatsächlichen Ausführens von Modellen in realen Anwendungen wie Chatbots, agierenden AI-Systemen, Copiloten, Suchfunktionen, Finanzanalysen und Entscheidungsunterstützung im Gesundheitswesen. Diese Workloads stellen andere Anforderungen an die Hardware, insbesondere im Hinblick auf Latenz, Responsivität und Energieverbrauch.

Warum AI-Inferenz zu einem wichtigen Hardware-Schlachtfeld wird

AI-Inferenz ist zu einem der am schnellsten wachsenden Segmente des AI-Infrastrukturmarktes geworden, da interaktive AI-Systeme Antworten in Millisekunden und nicht in Sekunden benötigen. d-Matrix hat Corsair speziell für diese Workloads positioniert, wobei der Schwerpunkt auf ultraniedriger Latenz und energieeffizienter Inferenz für große Sprachmodelle und AI-Agents liegt.

Laut d-Matrix wurde Corsair um eine digitale In-Memory-Compute-Architektur herum entwickelt, die darauf abzielt, die Speicherengpässe zu reduzieren, die oft die generative AI-Inferenz verlangsamen. Das Unternehmen behauptet, dass die Plattform die Latenz erheblich senken und die Durchsatzrate im Vergleich zu herkömmlichen GPU-zentrierten Inferenzsystemen verbessern kann, insbesondere für interaktive Anwendungen.

Die Partnerschaft mit Infineon adressiert eine weitere zunehmend kritische Herausforderung: die Stromversorgung.

Da AI-Server weiterhin an Dichte zunehmen, ist die effiziente Stromversorgung von Beschleunigern zu einem limitierenden Faktor für die Skalierung der Infrastruktur geworden. Infineons OptiMOS-TDM2254xx-Module sind für vertikale Stromversorgungsarchitekturen konzipiert, die helfen, elektrische Verluste zu reduzieren und die Leistungsdichte in kompakten Serversystemen zu verbessern.

Der Wechsel zu Echtzeit-AI-Systemen

Die Unternehmen haben die Zusammenarbeit um den Aufstieg von “interaktiver AI” herum aufgebaut, bei der Inferenzsysteme kontinuierlich Ausgaben mit extrem niedriger Verzögerung generieren müssen. Dazu gehören konversationale AI, AI-Agents, Echtzeit-Reasoning-Systeme und Anwendungen, die eine schnelle Token-Generierung aus großen Sprachmodellen erfordern.

d-Matrix-Gründer und CEO Sid Sheth sagte, dass die Architektur hinter Corsair speziell für eine Token-Latenz von unter 2 Millisekunden entwickelt wurde, ein Maß, das immer wichtiger wird, da Unternehmen AI-Systeme von Experimenten in kundenorientierte Umgebungen verlagern.

Die breitere AI-Industrie beginnt auch zu erkennen, dass Inferenz-Infrastruktur möglicherweise anders als Trainings-Infrastruktur entwickelt wird. Während GPU-Cluster die erste Phase der generativen AI-Expansion dominierten, belohnt Inferenz zunehmend Architekturen, die auf Speicherbandbreite, Latenz, Netzwerk und Energieeffizienz optimiert sind, anstatt nur auf rohe Rechenleistung.

Energieeffizienz wird zum zentralen Aspekt der AI-Skalierung

Eine der größten Einschränkungen, mit denen Hyperscaler und AI-Cloud-Anbieter konfrontiert sind, ist der Strombedarf. AI-Inferenz-Workloads können kontinuierlich über Millionen von Anfragen pro Tag laufen, was die Betriebseffizienz für die Bereitstellungskosten kritisch macht.

Infineon hat seine Position innerhalb der AI-Infrastruktur durch Halbleitertechnologien auf der Basis von Silizium, Siliziumcarbid (SiC) und Galliumnitrid (GaN) aggressiv ausgebaut. Das Unternehmen hat sich zunehmend auf die Versorgung der Stromversorgungsschicht unter AI-Beschleunigern und Server-Infrastruktur konzentriert.

Die Zusammenarbeit mit d-Matrix spiegelt wider, wie Halbleiterunternehmen enger mit AI-Beschleuniger-Startups integriert werden, da die Industrie nach Alternativen zu herkömmlichen GPU-lastigen Architekturen sucht.

AI-Infrastruktur expandiert jenseits traditioneller GPUs

Die Partnerschaft kommt während einer breiteren Welle von Experimenten in der AI-Hardware. Eine wachsende Anzahl von Startups entwickelt spezialisierte Beschleuniger, die speziell auf Inferenz, memory-zentrierte Computing oder AI-Netzwerke ausgerichtet sind.

d-Matrix hat sich durch seinen Schwerpunkt auf Compute-in-Memory-Technologien und low-latency-Inferenz-Systeme für generative AI abgehoben. Das Unternehmen hat auch seine Infrastrukturstrategie über Beschleuniger-Chips hinaus erweitert und kürzlich Netzwerke, komponierbare Infrastruktur und vollständige Systemoptimierung für Inferenz-Cluster betont.

Da AI-Anwendungen immer interaktiver und agenter werden, werden Infrastrukturanbieter erwartet, einen größeren Schwerpunkt auf die Reduzierung der Latenz, die Senkung des Energieverbrauchs und die Verbesserung der Systemeffizienz über den gesamten Rechenzentrums-Stack hinweg legen, anstatt sich ausschließlich auf die rohe Rechenleistung zu konzentrieren.