Künstliche Intelligenz

Model-Router und die Feedback-Falle: Wie KI von sich selbst lernt

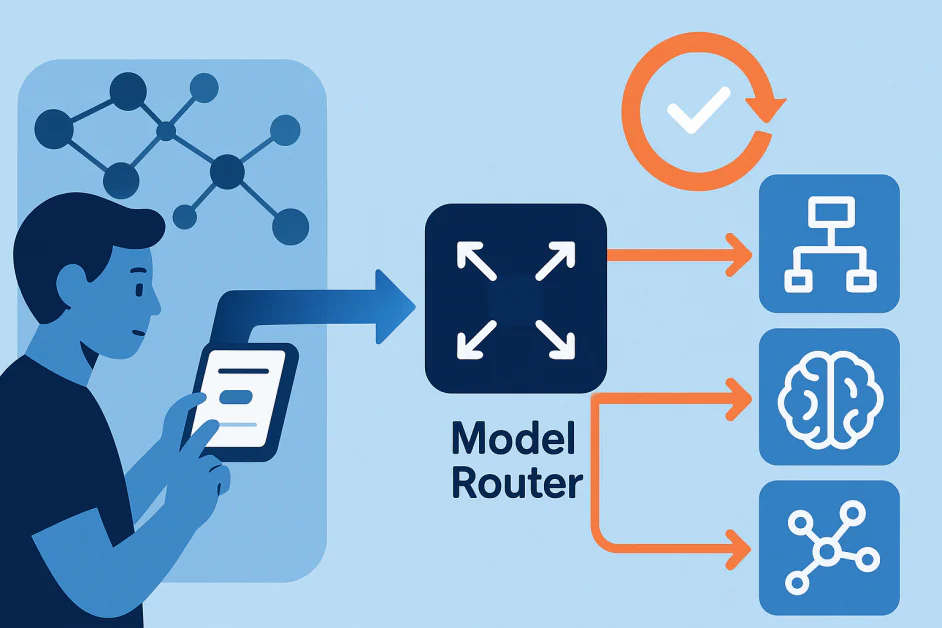

Moderne KI-Systeme werden nicht mehr um ein einzelnes Modell herum gebaut, das jede Aufgabe bearbeitet. Stattdessen verlassen sie sich auf Sammlungen von Modellen, die jeweils für spezifische Zwecke konzipiert sind. Im Zentrum dieser Einrichtung steht der Model-Router, ein Komponent, der eine Anfrage eines Benutzers interpretiert und entscheidet, welches Modell sie bearbeiten soll. Zum Beispiel könnten in Systemen wie OpenAI’s GPT-5 ein Router eine einfache Abfrage an ein leichtes Modell für Geschwindigkeit senden, während komplexe Denkaufgaben an ein fortgeschritteneres Modell weitergeleitet werden.

Router sind nicht nur Verkehrsmanager. Sie lernen von Benutzerverhalten, wie zum Beispiel, wenn Menschen Modelle wechseln oder bestimmte Antworten bevorzugen. Dies erzeugt einen Zyklus: Der Router weist die Abfrage zu, das Modell produziert eine Antwort, Benutzerreaktionen liefern Feedback, und der Router aktualisiert seine Entscheidungen. Wenn diese Zyklen leise im Hintergrund ablaufen, können sie verborgene Feedback-Schleifen bilden. Solche Schleifen können Voreingenommenheit verstärken, fehlerhafte Muster verstärken oder die Leistung auf Weise verringern, die schwer zu erkennen sind.

Dieser Artikel betrachtet, wie Model-Router funktionieren, wie Feedback-Schleifen entstehen und welche Risiken sie darstellen, wenn KI-Systeme weiterentwickelt werden.

Verständnis von Model-Routern in KI

Ein Model-Router ist die Entscheidungsebene in einem Multi-Modell-KI-System. Seine Rolle besteht darin, zu bestimmen, welches Modell am besten für eine Aufgabe geeignet ist. Die Wahl hängt von Faktoren wie Abfragekomplexität, Benutzerabsicht, Kontext und Kompromissen zwischen Kosten, Genauigkeit und Geschwindigkeit ab.

Im Gegensatz zu Systemen, die feste Regeln befolgen, sind die meisten Model-Router selbst Maschinenlernsysteme. Sie werden auf realen Signalen trainiert und passen sich im Laufe der Zeit an. Sie können von Benutzerverhalten wie dem Wechseln zwischen Modellen, der Bewertung von Antworten oder der Umformulierung von Prompts sowie von automatisierten Bewertungen lernen, die die Ausgabegüte messen.

Diese Anpassungsfähigkeit macht Router leistungsstark, aber auch riskant. Sie verbessern die Effizienz und bieten ein besseres Benutzererlebnis, aber die gleichen Feedback-Prozesse, die ihre Entscheidungen verfeinern, können auch verstärkende Schleifen erzeugen. Im Laufe der Zeit können diese Schleifen nicht nur die Routing-Strategien, sondern auch das Verhalten des gesamten KI-Systems beeinflussen.

Wie Feedback-Schleifen entstehen

Eine Feedback-Schleife tritt auf, wenn die Ausgabe eines Systems die Daten beeinflusst, die es später lernt. Ein einfaches Beispiel ist ein Empfehlungssystem: Wenn Sie auf ein Sportvideo klicken, zeigt das System Ihnen mehr Sportinhalte, was beeinflusst, was Sie als Nächstes ansehen. Im Laufe der Zeit verstärkt das System seine eigenen Muster. Ein weiteres Beispiel, um die Feedback-Schleife zu verstehen, ist die vorherige Polizei. Ein Algorithmus kann höhere Kriminalität in bestimmten Stadtteilen vorhersagen, was zu mehr Streifenwagen führen könnte. Mehr Streifenwagen entdecken mehr Vorfälle, die dann die Vorhersage des Algorithmus bestätigen. Das System scheint genau zu sein, aber die Daten sind durch den eigenen Einfluss verzerrt. Feedback-Schleifen können direkt oder verborgen sein. Direkte Schleifen sind leicht zu erkennen, wie zum Beispiel, wenn ein Empfehlungssystem auf seinen eigenen Vorschlägen trainiert wird. Verborgene Schleifen sind subtiler, da sie entstehen, wenn verschiedene Teile eines Systems sich indirekt beeinflussen.

Model-Router können ähnliche Schleifen erzeugen. Eine Entscheidung des Routers formt, welche Antwort das Modell produziert. Diese Antwort formt das Benutzerverhalten, das wiederum Feedback für den Router wird. Im Laufe der Zeit kann der Router anfangen, Muster zu verstärken, die in der Vergangenheit funktioniert haben, anstatt konsequent das beste Modell zu wählen. Diese Schleifen sind schwer zu erkennen und können leise KI-Systeme in ungewollte Richtungen drängen.

Warum Feedback-Schleifen in Routern riskant sind

Während Feedback-Schleifen helfen, Router bei der Aufgabenzuweisung zu verbessern, bergen sie auch Risiken, die das Systemverhalten verzerren können. Ein Risiko besteht darin, anfängliche Voreingenommenheiten zu verstärken. Wenn ein Router wiederholt eine bestimmte Art von Abfrage an Modell A sendet, kommt das meiste Feedback von den Ausgaben von Modell A. Der Router kann dann annehmen, dass Modell A immer das beste ist, und Modell B außer Acht lassen, auch wenn es manchmal besser performen könnte. Diese ungleiche Nutzung kann sich selbst verstärken. Modelle, die gut auf geroutete Aufgaben performen, ziehen mehr Anfragen an, was ihre Stärken verstärkt. Weniger genutzte Modelle erhalten weniger Chancen, sich zu verbessern, was zu Ungleichgewicht und geringerer Vielfalt führt.

Die Voreingenommenheiten können auch von den Bewertungsmodellen stammen, die verwendet werden, um Richtigkeit zu beurteilen. Wenn das “Richter”-Modell blind ist, werden seine Voreingenommenheiten direkt an den Router weitergegeben, der dann für die Werte des Richters optimiert, anstatt die tatsächlichen Bedürfnisse der Benutzer. Das Benutzerverhalten fügt eine weitere Ebene der Komplexität hinzu. Wenn ein Router tendenziell bestimmte Antwortmuster zurückgibt, können Benutzer ihre Abfragen an diese Muster anpassen, was sie noch mehr verstärkt. Im Laufe der Zeit kann dies sowohl das Benutzerverhalten als auch die Systemantworten einengen. Router können auch lernen, bestimmte Abfragemuster oder Demografien mit bestimmten Modellen in Verbindung zu bringen. Dies kann zu systematisch unterschiedlichen Erfahrungen zwischen Gruppen führen, was bestehende gesellschaftliche Voreingenommenheiten potenziell verstärken und amplifizieren kann.

Ein weiteres wichtiges Anliegen ist der langfristige Drift. Die Entscheidungen, die ein Router heute trifft, beeinflussen die Trainingsdaten, die morgen verwendet werden. Wenn Modelle auf Ausgaben trainiert werden, die von der Routing beeinflusst sind, können sie die Präferenzen des Routers lernen, anstatt unabhängige Ansätze. Dies kann die Antworten über Modelle hinweg einheitlicher machen und Voreingenommenheiten einbauen, die über die Zeit hinweg bestehen bleiben.

Strategien, um den Zyklus zu durchbrechen

Die Risiken verborgener Schleifen zu reduzieren, erfordert aktive Gestaltung und Überwachung. Das Training sollte diverse Datenquellen verwenden, nicht nur Benutzerklicks oder -wechsel. Gelegentliches zufälliges Routing kann auch verhindern, dass ein Modell eine Aufgabenart monopolisiert. Überwachung ist essentiell. Regelmäßige Audits können enthüllen, ob ein Router gegen bestimmte Muster driftet oder zu sehr auf ein Modell setzt. Transparenz in den Entscheidungen des Routers hilft Forschern, Voreingenommenheit frühzeitig zu erkennen.

Router sollten auch periodisch mit frischen, ausgewogenen Daten neu trainiert werden, damit alte Voreingenommenheiten nicht eingefroren werden. Die Einbeziehung menschlicher Überwachung, insbesondere in sensiblen Bereichen, fügt eine weitere Ebene der Rechenschaftspflicht hinzu. Menschen können erkennen, wenn ein Router systematisch ein Modell bevorzugt oder bestimmte Abfragen falsch klassifiziert.

Der Schlüssel besteht darin, den Router als Modell zu behandeln, das Feedback erhält, und nicht als festen oder neutralen Komponenten. Indem Forscher und Entwickler erkennen, wie Router selbst von den Daten geformt werden, die sie erstellen, können sie Systeme entwerfen, die fair, anpassungsfähig und zuverlässig über die Zeit hinweg bleiben.

Zusammenfassung

Model-Router bieten klare Vorteile in Effizienz und Anpassungsfähigkeit, aber sie bergen auch verborgene Risiken. Feedback-Schleifen innerhalb dieser Systeme können leise Voreingenommenheit amplifizieren, die Vielfalt der Antworten begrenzen und Modelle in enge Verhaltensmuster einschließen. Da diese Architekturen häufiger werden, wird es wichtig sein, diese Risiken frühzeitig zu erkennen und anzugehen, um KI-Systeme zu bauen, die fair, zuverlässig und wirklich anpassungsfähig bleiben.