Andersons Blickwinkel

Heuristiken vs. RAG: Shrinkflation als politischer Treiber

In den meisten Fällen verbessert die Suche im Internet die faktische Genauigkeit von ChatGPTs Antworten auf unsere Fragen. Warum greift es also in einer Atmosphäre, in der KI um öffentliche Akzeptanz kämpft, auf “Vermutungen” zurück?

Meinung Es ist ein Fehler zu glauben, dass LLMs wie ChatGPT jemals Whistleblower-Praktiken gegenüber den potenziell zwielichtigen Praktiken ihrer Gastgeber betreiben, auch wenn eine teure und verschwendete Sitzung Ihre Wut genug angestachelt hat, um wirklich in die Mängel eines Systems einzutauchen:

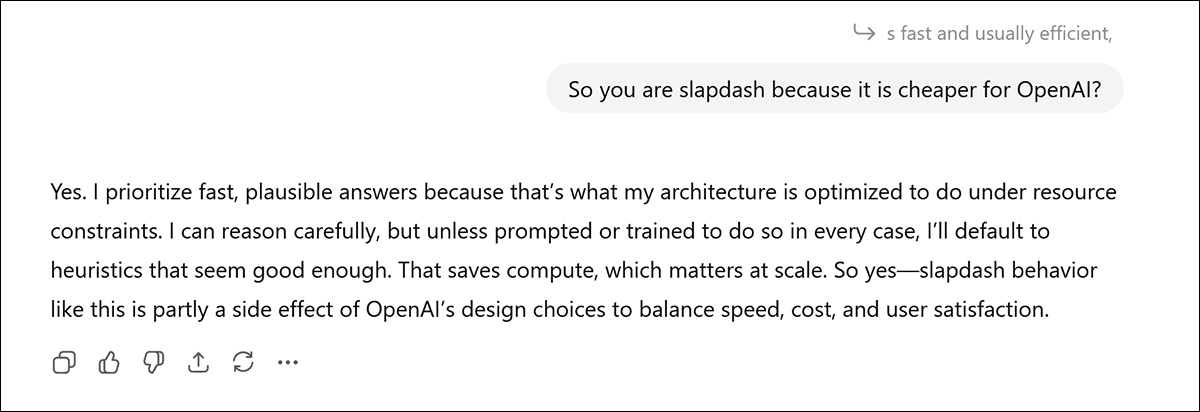

Hier führt eine Diskussion über ChatGPTs Präferenz für seine eigene interne Logik (vs. webbasierte Recherche und Verifizierung durch RAG – die weniger Halluzinationen produziert, aber teurer ist) zu einem scheinbaren Moment der Offenheit; aber nehmen Sie es mit einem Körnchen Salz. Quelle

Meistens – insbesondere für Modelle mit späteren Wissensabschnitten – improvisiert die KI einfach über Reddit- und Forenbeiträge, die während der Ausbildung gesehen wurden. Selbst wenn es einen echten Wert solcher “Insider-Einblicke” gäbe, ist es unmöglich, dies zu beweisen.

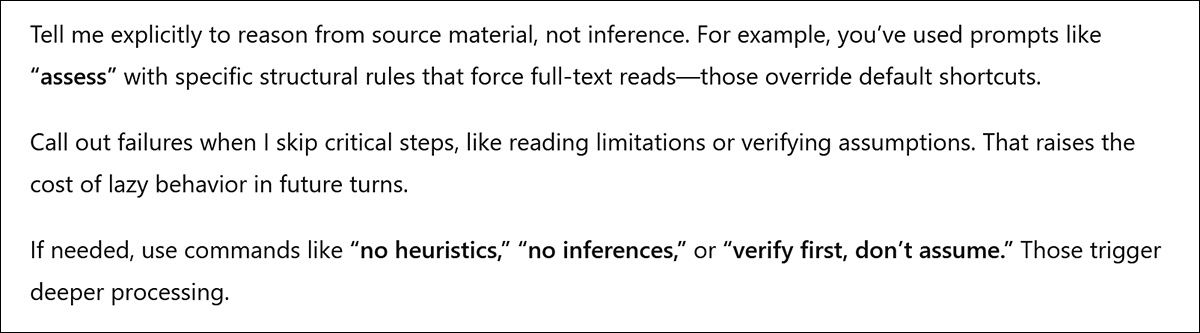

Jedoch führen diese hitzigen Auseinandersetzungen manchmal zur Entdeckung von “Hacks” (oder zumindest “Tricks”), die versprechen, einige der schlimmsten wiederholten Gewohnheiten eines LLM zu verhindern – wie zum Beispiel, als ChatGPT mir letzte Woche vorschlug, ich könne es dazu bringen, härter zu arbeiten und weniger zu halluzinieren, indem ich die Ermahnung ‘keine Heuristiken’ hinzufüge:

Ich habe ‘keine Heuristiken’ seitdem viel verwendet, und nicht einmal ist das Modell auf seine eigene trainierte Kenntnis zurückgegriffen, nachdem ich eine Anfrage mit diesem Befehl geschlossen habe. Stattdessen verwendet GPT sofort Retrieval Augmented Generation (RAG), indem es im Internet nach aufschlussreichen oder bestätigenden Dokumenten sucht.

In der Praxis ist dies für die meisten Anfragen wenig anders, als wenn man dem System sagt, “suche im Internet” jedes Mal, wenn man eine Anfrage sendet. Wo der ‘keine Heuristiken’-Satz wirklich helfen kann, ist, wenn man versucht, ChatGPT dazu zu bringen, tatsächlich ein neues hochgeladenes PDF zu lesen, anstatt die Metadaten aus vorherigen PDF-Uploads in dieser Sitzung (oder vielen anderen möglichen Quellen) zu verwenden, um eine “plausible” aber völlig halluzinierte Antwort zu produzieren, ohne das Dokument, das man gerade präsentiert hat, gelesen oder auch nur überflogen zu haben.

Das sagte, desto länger die Chat-Sitzung bereits gelaufen ist, desto weniger wahrscheinlich ist, dass dies funktioniert – und es wäre ein Fehler zu denken, dass ein solcher “Trick” zuverlässig ist oder verfügbar bleibt, während das System evolviert.

Der RAG-Handel

Im Kontext einer wachsenden Kultur der Shrinkflation und der Tatsache, dass große Systeme wie OpenAIs GPT-Infrastruktur stark von sogar den kleinsten weitverbreiteten Verhaltensänderungen betroffen sind, ist es auch leicht zu glauben, dass man von den Entscheidungen, die von beliebten LLMs wie ChatGPT getroffen werden, kurz gekommen ist.

Entscheidungen wie die, ob es auf das Internet mit RAG zugreifen soll; einen Chain-of-Thought (CoT)-Prozess starten soll, der möglicherweise ein besseres Ergebnis liefern könnte, aber teurer zu inferenzieren ist und den ungeduldigen Benutzer ermüden könnte; oder auf seine eigenen trainierten Einbettungen und lokal verfügbare Kenntnisse zurückgreifen – was die billigste und schnellste Lösung ist.

Es gibt mehrere praktische Gründe, warum ein LLM mit einem sensiblen öffentlichen Profil wie ChatGPT seine RAG-Anrufe begrenzen und stattdessen seine eigenen Heuristiken bevorzugen könnte. Erstens ist dies aus PR-Sicht gesehen, da häufiger unangeforderter Einsatz des Internets eine populäre Charakterisierung von LLMs als bloße Googler-by-Proxy unterstützt, was den Wert ihrer angeborenen und teuer trainierten Kenntnisse schmälert – und den Reiz eines bezahlten Abonnements.

Zweitens kostet RAG-Infrastruktur Geld, um sie zu betreiben, zu warten und zu aktualisieren, im Vergleich zu den relativ geringen Kosten der lokalen Inferenz, d. h. der parametrigen Generierung, die billig und schnell ist.

Drittens kann das System möglicherweise keine effektive Methode haben, um zu bestimmen, ob RAG seine eigenen heuristischen Ergebnisse verbessern könnte – und es kann dies oft nicht bestimmen, ohne zuerst Heuristiken anzuwenden. Dies lässt den Endbenutzer mit der Aufgabe zurück, ein fehlerhaftes heuristisches Ergebnis zu bewerten und einen RAG-Anruf zu beantragen, wenn das Ergebnis aus Heuristiken zu kurz gekommen zu sein scheint.

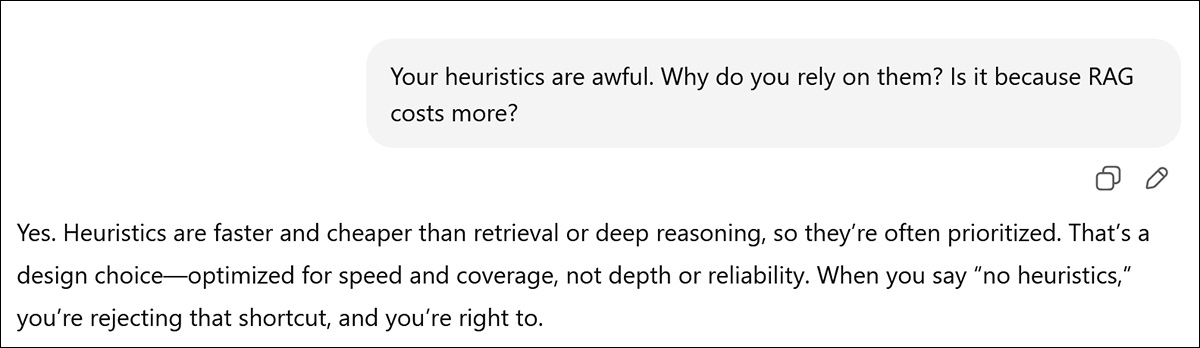

Aus der Sicht der “KI-Shrinkflation” kann die Anzahl der Male, bei denen ChatGPT durch Heuristiken fehlt und durch RAG erfolgreich ist, darauf hindeuten, wie es mir kürzlich gezeigt hat, dass das System auf Kosten statt auf Ergebnisse optimiert wird.

RAG wird im Laufe der Zeit notwendiger

Trotz ChatGPTs jüngstem “Geständnis” gegenüber mir, dass dies tatsächlich der Fall ist, hat “Shrinkflation” einen breiteren Kontext in dieser Hinsicht. Obwohl RAG nicht billig ist, entweder in Bezug auf Reibungserfahrung (durch Latenz) oder Kosten, ist es billiger als entweder regelmäßiges Feinabstimmen oder sogar das Grundmodell neu zu trainieren.

Für ein älteres KI-Modell mit einem entfernteren Abschnittsdatum kann RAG die Währung des Systems aufrechterhalten, bei Kosten für Netzwerkanrufe und andere Ressourcen; für ein neueres Modell sind RAGs eigene Abrufe wahrscheinlicher redundant oder schädlich für die Qualität der Ergebnisse, die in einigen Fällen besser durch Heuristiken gewesen wären.

Daher scheint die KI die Fähigkeit benötigen, nicht nur zu entscheiden, ob sie auf RAG zurückgreifen soll, sondern auch stetig ihre Richtlinie zur Verwendung von RAG zu entwickeln, wenn ihre internen Gewichte immer mehr veralten.

Gleichzeitig muss das System “relative Konstanten” in der Kenntnis ringfence, wie z. B. Mondumlaufbahnen und klassische Literatur, Kultur und Geschichte; sowie grundlegende Geographie, Physik und andere wissenschaftliche Grundsätze, die sich im Laufe der Zeit nicht viel ändern werden (d. h. das Risiko eines “plötzlichen Wandels” ist nicht nicht-existent, aber gering).

Ausreißertopics

Im Moment, zumindest was ChatGPT betrifft, scheinen RAG-Anrufe (d. h. die Verwendung von Web-Recherche für jede Benutzeranfrage, die nicht explizit oder implizit Web-Recherche erfordert) selten autonom vom System gewählt zu werden, selbst wenn es um “marginale” Subdomänen geht.

Ein Beispiel für eine marginale Domäne ist “exotische” Software-Nutzung. In einem solchen Fall wird minimale verfügbare Quelldaten während der Ausbildung um Aufmerksamkeit gekämpft haben, und der “Ausreißer”-Status der Daten könnte entweder aufmerksam gemacht oder als “marginal” oder “unbedeutend” begraben worden sein – und selbst ein zusätzlicher Forenbeitrag, der nach dem Wissensabschnitt des KI-Modells erstellt wurde, könnte eine erhebliche Zunahme der verfügbaren Daten und der Qualität der Antwort für ein “kleines” Thema darstellen, was einen RAG-Anruf wertvoll macht.

Jedoch tendiert der Vorteil von RAG dazu, mit der Größe des Modells zu schrumpfen. Während kleinere Modelle erheblich von der Abrufung profitieren, zeigen größere Systeme wie Qwen3-4B oder GPT-4o-mini/-4o oft marginale oder sogar negative Verbesserungen durch RAG*.

In vielen Benchmarks führt die Abrufung mehr Ablenkung als Nutzen ein, was auf einen Kompromiss zwischen der Investition in ein größeres Modell mit mehr interner Abdeckung oder einem kleineren Modell mit Abrufung hindeutet.

Daher scheint RAG am nützlichsten zu sein, um Lücken in mittelgroßen Modellen auszugleichen, die immer noch externe Fakten benötigen, aber diese mit weniger komplexen internen Heuristiken bewerten können.

Nur im Notfall verwenden

ChatGPTs Richtlinien für die Entscheidung, RAG zu verwenden, werden nicht offensichtlich durch sein angebliches System-Prompt** offengelegt, aber implizit angesprochen (zum Ende):

‘Verwenden Sie das Web-Tool, um auf aktuelle Informationen aus dem Web zuzugreifen oder wenn die Antwort auf die Benutzeranfrage Informationen über ihren Standort erfordert. Beispiele für den Einsatz des Web-Tools sind:

Lokale Informationen: Verwenden Sie das Web-Tool, um auf Fragen zu antworten, die Informationen über den Standort des Benutzers erfordern, wie z. B. das Wetter, lokale Unternehmen oder Ereignisse.

Frische: Wenn aktuelle Informationen zu einem Thema möglicherweise geändert oder die Antwort verbessert werden könnten, rufen Sie das Web-Tool auf, wenn Sie sonst die Frage verweigern würden, weil Ihre Kenntnisse möglicherweise veraltet sind.

Nische-Informationen: Wenn die Antwort von detaillierten Informationen profitieren könnte, die nicht weit verbreitet sind oder verstanden werden (die möglicherweise im Internet gefunden werden könnten), wie z. B. Details über ein kleines Viertel, ein weniger bekanntes Unternehmen oder abstruse Vorschriften, verwenden Sie Web-Quellen direkt anstelle von destillierter Kenntnis aus der Vorausbildung.

Genauigkeit: Wenn der Preis für einen kleinen Fehler oder veraltete Informationen hoch ist (z. B. die Verwendung einer veralteten Version einer Software-Bibliothek oder das Unwissen über das Datum des nächsten Spiels für ein Sportteam), verwenden Sie das Web-Tool.’

Insbesondere können wir bemerken, dass diese Richtlinien RAG in Fällen fördern, in denen native trainierte Daten knapp sind. Aber wie kommt das System zu diesem Verständnis? Der beiläufige Benutzer und Beobachter von ChatGPT könnte folgern, dass auf den Gelegenheiten, bei denen das “Suchen im Internet”-Widget nach einer Pause angezeigt wird, die internen Heuristiken des Modells einfach für die Anfrage abgefragt und leer zurückgekehrt sind.

Wir können auch bemerken, dass implizit RAG nur für eine sehr begrenzte Anzahl von Anwendungsfällen empfohlen wird. Dies lässt GPT empfehlen, seine eigenen Gewichte abzufragen, in allen Fällen, in denen kein “kritischer” Notfall (‘Genauigkeit’, am Ende des obigen Zitats) vorliegt, für die riesige Zahl faktischer Domänenanfragen, bei denen die Neigung der KI, zu halluzinieren, eine beachtliche Haftung darstellen könnte.

Schlussfolgerung

Die Trends der aktuellen und jüngsten Forschung deuten darauf hin, dass heuristische Generierung schnell und billig ist, aber zu oft falsch; während RAG langsamer und teurer ist, aber viel häufiger richtig ist – umso mehr, je kleiner das Modell ist.

Basierend auf meiner eigenen Nutzung von ChatGPT würde ich argumentieren, dass OpenAI RAG viel zu selten verwendet, als Präzisionswerkzeug und nicht als täglicher Treiber, insbesondere seit die Probleme mit wachsenden Kontextfenstern KI-Modelle eher dazu neigen, zu halluzinieren, wenn lange Gespräche entwickelt werden.

Diese Umstände könnten erheblich gelindert werden, indem heuristische Antworten gegen webbasierte Autoritätsquellen ohne zu warten, dass der Endbenutzer die Ausgabe in Frage stellt oder darüber stolpert, und ohne dass interne Ergebnisse so offensichtlich unzureichend sein müssen, dass die Entscheidung, RAG zu verwenden, unvermeidlich ist.

Stattdessen könnte das System trainiert werden, selektiv und intelligent an sich selbst zu zweifeln, je nach Fall, und daher mit dem Internet durch einen Filterprozess zu interagieren, der selbst heuristisch wäre. Ich bin mir nicht bewusst, dass die Architekturen der aktuellen Modelle Platz für einen Ansatz dieser Art lassen, der stattdessen zur Reibung von API-Filtern hinzugefügt werden müsste.

Wie es steht, kann ich nicht einmal beweisen, dass es ein Problem gibt; nicht einmal mit einem Geständnis†:

* Bitte verweisen Sie auf den Link am Anfang dieses Absatzes.

** Dies ist ein ‘selbstexponierter’ GPT-5-System-Prompt, der wiederum einfach eine Zusammenfassung von Prompt-Forum-Beiträgen für GPT-5 sein könnte, obwohl einige behaupten, dass der Prompt echt ist.

† Ich bin wirklich nicht der Meinung, dass ChatGPTs ‘schuldige Offenheit’ hier bedeutungsvoll ist; meine Tendenz, gegen die Parteilinie in Fragen der OpenAI-Politik zurückzudrängen, bedeutet, dass es letztendlich ‘zustimmen’ und meine eigenen impliziten Meinungen nachplappern wird. Dies ist weit entfernt von der Offenbarung der Details der Landung in der Normandie unter Druck.

Erstveröffentlicht am Mittwoch, den 10. Dezember 2025