Künstliche Intelligenz

HD-Painter: Hochauflösendes textgesteuertes Bild-Inpainting mit Diffusionsmodellen

Diffusionsmodelle haben zweifellos die KI- und ML-Branche revolutioniert, da ihre Anwendungen in Echtzeit zu einem festen Bestandteil unseres Alltags geworden sind. Nachdem Text-zu-Bild-Modelle ihre bemerkenswerten Fähigkeiten unter Beweis gestellt hatten, erwiesen sich diffusionsbasierte Bildmanipulationstechniken wie kontrollierbare Erzeugung, spezialisierte und personalisierte Bildsynthese, Bildbearbeitung auf Objektebene, prompt-konditionierte Variationen und Bearbeitung als aktuelle Forschungsthemen zu ihren Anwendungen in der Computer-Vision-Branche.

Trotz ihrer beeindruckenden Fähigkeiten und außergewöhnlichen Ergebnisse bieten Text-zu-Bild-Frameworks, insbesondere Text-zu-Bild-Inpainting-Frameworks, immer noch Potenzial für die Entwicklung. Dazu gehört die Fähigkeit, globale Szenen zu verstehen, insbesondere wenn das Bild in Zeitschritten mit hoher Diffusion entrauscht wird. Um dieses Problem anzugehen, führten die Forscher HD-Painter ein, ein völlig schulungsfreies Framework, das präzise Anweisungen befolgt und kohärent auf hochauflösendes Bildinpainting skaliert. Das HD-Painter-Framework verwendet eine PAIntA-Schicht (Prompt Aware Introverted Attention), die Prompt-Informationen nutzt, um die Selbstaufmerksamkeitswerte zu verbessern, was zu einer besseren Textausrichtung führt.

Um die Kohärenz der Eingabeaufforderung weiter zu verbessern, führt das HD-Painter-Modell einen RASG-Ansatz (Reweighting Attention Score Guidance) ein. Dieser Ansatz integriert eine Post-hoc-Sampling-Strategie nahtlos in die allgemeine Form der DDIM-Komponente und verhindert so latente Verschiebungen außerhalb der Verteilung. Darüber hinaus verfügt das HD-Painter-Framework über eine spezielle, auf Inpainting zugeschnittene Super-Resolution-Technik, die es ermöglicht, auf größere Maßstäbe zu erweitern und fehlende Bereiche im Bild mit Auflösungen von bis zu 2K zu vervollständigen.

HD-Painter: Textgesteuertes Bild-Inpainting

Text-zu-Bild-Diffusionsmodelle waren in den letzten Monaten tatsächlich ein wichtiges Thema in der KI- und ML-Branche, wobei die Modelle beeindruckende Echtzeitfähigkeiten in verschiedenen praktischen Anwendungen demonstrierten. Vorab trainierte Modelle zur Text-zu-Bild-Generierung wie DALL-E, Imagen und Stable Diffusion haben ihre Eignung für die Bildvervollständigung gezeigt, indem sie entrauschte (generierte) unbekannte Regionen mit diffundierten bekannten Regionen während des Rückwärtsdiffusionsprozesses zusammenführen. Obwohl sie optisch ansprechende und gut harmonisierte Ergebnisse liefern, haben bestehende Modelle Schwierigkeiten, die globale Szene zu verstehen, insbesondere im Rahmen des Zeitschritt-Rauschunterdrückungsprozesses mit hoher Diffusion. Durch Modifizieren vorab trainierter Text-zu-Bild-Diffusionsmodelle zur Einbeziehung zusätzlicher Kontextinformationen können diese für die textgesteuerte Bildvervollständigung optimiert werden.

Darüber hinaus sind innerhalb von Diffusionsmodellen textgesteuertes Inpainting und textgesteuerte Bildvervollständigung wichtige Interessengebiete für Forscher. Dieses Interesse wird durch die Tatsache angetrieben, dass textgesteuerte Inpainting-Modelle Inhalte in bestimmten Bereichen eines Eingabebilds basierend auf Textaufforderungen generieren können, was zu potenziellen Anwendungen wie der Retusche bestimmter Bildbereiche, der Änderung von Motivattributen wie Farben oder Kleidung und dem Hinzufügen von oder führt Ersetzen von Objekten. Zusammenfassend lässt sich sagen, dass Text-zu-Bild-Diffusionsmodelle aufgrund ihrer außergewöhnlich realistischen und optisch ansprechenden Generierungsfähigkeiten in letzter Zeit einen beispiellosen Erfolg erzielt haben.

Allerdings zeigt die Mehrheit der bestehenden Frameworks in zwei Szenarien eine sofortige Vernachlässigung. Das erste ist Hintergrunddominanz wenn das Modell den unbekannten Bereich vervollständigt, indem es die Eingabeaufforderung im Hintergrund ignoriert, während dies im zweiten Szenario der Fall ist Dominanz von Objekten in der Nähe wenn das Modell die bekannten Regionsobjekte mithilfe der visuellen Kontextwahrscheinlichkeit und nicht der Eingabeaufforderung an die unbekannte Region weitergibt. Es besteht die Möglichkeit, dass diese beiden Probleme auf die Fähigkeit von Vanilla Inpainting Diffusion zurückzuführen sind, die Textaufforderung genau zu interpretieren oder sie mit den aus der bekannten Region erhaltenen Kontextinformationen zu vermischen.

Um diese Hindernisse zu beseitigen, führt das HD-Painter-Framework die Schicht „Prompt Aware Introverted Attention“ oder PAIntA ein, die Prompt-Informationen verwendet, um die Selbstaufmerksamkeitswerte zu verbessern, was letztendlich zu einer besseren Generierung der Textausrichtung führt. PAIntA verwendet die gegebene Textkonditionierung, um das zu verbessern Selbstaufmerksamkeit punktet mit dem Ziel, den Einfluss nicht-promptrelevanter Informationen aus der Bildregion zu reduzieren und gleichzeitig den Beitrag der bekannten Pixel, die mit dem Prompt ausgerichtet sind, zu erhöhen. Um die Textausrichtung der generierten Ergebnisse weiter zu verbessern, implementiert das HD-Painter-Framework eine Post-hoc-Anleitungsmethode, die die Cross-Attention-Scores nutzt. Allerdings kann die Implementierung des Vanilla-Post-hoc-Leitmechanismus aufgrund des zusätzlichen Gradiententerms in der Diffusionsgleichung zu Verschiebungen außerhalb der Verteilung führen. Die Verschiebung außerhalb des Vertriebs führt letztendlich zu einer Qualitätsverschlechterung der erzeugten Produktion. Um dieses Hindernis zu überwinden, implementiert das HD-Painter-Framework eine Reweighting Attention Score Guidance oder RASG, eine Methode, die eine Post-hoc-Sampling-Strategie nahtlos in die allgemeine Form der DDIM-Komponente integriert. Es ermöglicht dem Framework, visuell plausible Inpainting-Ergebnisse zu generieren, indem es die Probe zu den prompt ausgerichteten latenten Elementen führt und sie in ihrem trainierten Bereich enthält.

Durch den Einsatz sowohl der RASH- als auch der PAIntA-Komponenten in seiner Architektur bietet das HD-Painter-Framework einen erheblichen Vorteil gegenüber bestehenden, einschließlich modernster Inpainting- und Text-zu-Bild-Diffusionsmodellen, da es das bestehende Problem der sofortigen Vernachlässigung löst. Darüber hinaus bieten sowohl die RASH- als auch die PAIntA-Komponenten Plug-and-Play-Funktionalität, sodass sie mit Diffusionsbasis-Inpainting-Modellen kompatibel sind, um die oben genannten Herausforderungen zu bewältigen. Darüber hinaus durch die Implementierung einer zeititerativen Mischtechnologie und durch die Nutzung der Fähigkeiten von hochauflösende Diffusionsmodellekann die HD-Painter-Pipeline effektiv für Inpainting mit einer Auflösung von bis zu 2K eingesetzt werden.

Zusammenfassend möchte der HD-Painter folgende Beiträge auf diesem Gebiet leisten:

- Ziel ist es, das Problem der sofortigen Vernachlässigung des Hintergrunds und der Dominanz benachbarter Objekte zu lösen, das bei textgesteuerten Bild-Inpainting-Frameworks auftritt, indem die Schicht „Prompt Aware Introverted Attention“ oder PAIntA in ihrer Architektur implementiert wird.

- Ziel ist es, die Textausrichtung der Ausgabe zu verbessern, indem die Reweighting Attention Score Guidance oder RASG-Schicht in ihrer Architektur implementiert wird, die es dem HD-Painter-Framework ermöglicht, Post-hoc-geführte Stichproben durchzuführen und gleichzeitig Verteilungen außerhalb der Schicht zu verhindern.

- Entwurf einer effektiven, schulungsfreien, textgesteuerten Bildvervollständigungspipeline, die in der Lage ist, die vorhandenen, hochmodernen Frameworks zu übertreffen, und Verwendung des einfachen, aber effektiven, auf Inpainting spezialisierten Super-Resolution-Frameworks zur Durchführung von textgesteuertem Bild-Inpainting mit einer Auflösung von bis zu 2K.

HD-Painter: Methode und Architektur

Bevor wir einen Blick auf die Architektur werfen, ist es wichtig, die drei grundlegenden Konzepte zu verstehen, die die Grundlage des HD-Painter-Frameworks bilden: Image Inpainting, Post-hoc-Anleitung in Diffusions-Frameworks, und Bemalung spezifischer Architekturblöcke.

Image Inpainting ist ein Ansatz, der darauf abzielt, die fehlenden Bereiche innerhalb eines Bildes zu füllen und gleichzeitig die visuelle Attraktivität des erzeugten Bildes sicherzustellen. Traditionelle Deep-Learning-Frameworks implementierten Methoden, die bekannte Regionen nutzten, um Deep-Features zu verbreiten. Die Einführung von Diffusionsmodellen hat jedoch zur Weiterentwicklung von Inpainting-Modellen geführt, insbesondere der textgesteuerten Bild-Inpainting-Frameworks. Traditionell ersetzt ein vorab trainiertes Text-zu-Bild-Diffusionsmodell den unmaskierten Bereich des Latents durch die Verwendung der verrauschten Version des bekannten Bereichs während des Sampling-Prozesses. Obwohl dieser Ansatz bis zu einem gewissen Grad funktioniert, verschlechtert er die Qualität der generierten Ausgabe erheblich, da das Entrauschungsnetzwerk nur die verrauschte Version der bekannten Region sieht. Um diese Hürde zu überwinden, zielten einige Ansätze darauf ab, das vorab trainierte Text-zu-Bild-Modell zu verfeinern, um textgesteuertes Bild-Inpainting zu erreichen. Durch die Implementierung dieses Ansatzes ist das Framework in der Lage, durch Verkettung eine zufällige Maske zu generieren, da das Modell in der Lage ist, das Rauschunterdrückungs-Framework auf den nicht maskierten Bereich zu konditionieren.

Im weiteren Verlauf implementierten die traditionellen Deep-Learning-Modelle spezielle Designebenen für effizientes Inpainting, wobei einige Frameworks in der Lage waren, Informationen effektiv zu extrahieren und optisch ansprechende Bilder zu erzeugen, indem sie spezielle Faltungsebenen einführten, um die bekannten Bereiche des Bildes zu verarbeiten. Einige Frameworks haben ihrer Architektur sogar eine kontextbezogene Aufmerksamkeitsschicht hinzugefügt, um den unerwünschten hohen Rechenaufwand für die Selbstaufmerksamkeit aller Beteiligten für qualitativ hochwertiges Inpainting zu reduzieren.

Schließlich handelt es sich bei den Post-hoc-Leitmethoden um Rückwärtsdiffusions-Stichprobenmethoden, die den nächsten Schritt der latenten Vorhersage in Richtung eines bestimmten Funktionsminimierungsziels leiten. Post-hoc-Anleitungsmethoden sind eine große Hilfe bei der Generierung visueller Inhalte, insbesondere wenn zusätzliche Einschränkungen vorliegen. Die Post-hoc-Anleitungsmethoden haben jedoch einen großen Nachteil: Sie führen bekanntermaßen zu einer Verschlechterung der Bildqualität, da sie dazu neigen, den Prozess der latenten Erzeugung um einen Gradiententerm zu verschieben.

Was die Architektur von HD-Painter betrifft, so formuliert das Framework zunächst das Problem der textgesteuerten Bildvervollständigung und führt dann zwei Diffusionsmodelle ein, nämlich das Stable Inpainting und Stable Diffusion . Das HD-Painter-Modell führt dann die Blöcke PAIntA und RASG ein, und schließlich gelangen wir zur Inpainting-spezifischen Superauflösungstechnik.

Stabile Diffusion und stabiles Inpainting

Stable Diffusion ist ein Diffusionsmodell, das im latenten Raum eines Autoencoders arbeitet. Für die Text-zu-Bild-Synthese implementiert das Stable Diffusion-Framework eine Textaufforderung, die den Prozess leitet. Die Leitfunktion hat eine ähnliche Struktur wie die UNet-Architektur und wird durch die Queraufmerksamkeitsschichten auf die Textaufforderungen abgestimmt. Darüber hinaus kann das Stable Diffusion-Modell mit einigen Modifikationen und Feinabstimmungen das Inpainting von Bildern durchführen. Um dies zu erreichen, werden die Merkmale des vom Encoder erzeugten maskierten Bildes mit der herunterskalierten Binärmaske zu den latenten Bildern verkettet. Der resultierende Tensor wird dann in die UNet-Architektur eingegeben, um das geschätzte Rauschen zu erhalten. Das Framework initialisiert dann die neu hinzugefügten Faltungsfilter mit Nullen, während der Rest des UNet mithilfe vorab trainierter Prüfpunkte aus dem Stable Diffusion-Modell initialisiert wird.

Die obige Abbildung zeigt den Überblick über das HD-Painter-Framework, das aus zwei Phasen besteht. In der ersten Stufe implementiert das HD-Painter-Framework die textgesteuerte Bildmalerei, während in der zweiten Stufe das Modell eine spezifische Superauflösung der Ausgabe einmalt. Um die Missionsbereiche auszufüllen und mit der Eingabeaufforderung konsistent zu bleiben, verwendet das Modell ein vorab trainiertes Inpainting-Diffusionsmodell, ersetzt die Selbstaufmerksamkeitsschichten durch PAIntA-Schichten und implementiert den RASG-Mechanismus, um einen Rückwärtsdiffusionsprozess durchzuführen. Das Modell dekodiert dann die endgültige geschätzte latente Menge, was zu einem eingefärbten Bild führt. HD-Painter implementiert dann das superstabile Diffusionsmodell, um das Bild in Originalgröße einzumalen, und implementiert den Diffusions-Rückwärtsprozess des Stable Diffusion-Frameworks, abhängig vom Eingabebild mit niedriger Auflösung. Das Modell mischt die entrauschten Vorhersagen nach jedem Schritt in der bekannten Region mit der Codierung des Originalbilds und leitet die nächste Latenz ab. Schließlich dekodiert das Modell die Latenz und implementiert die Poisson-Mischung, um Kantenartefakte zu vermeiden.

Prompt Aware Introverted Attention oder PAIntA

Bestehende Inpainting-Modelle wie Stable Inpainting verlassen sich tendenziell mehr auf den visuellen Kontext rund um den Inpainting-Bereich und ignorieren die Eingabeaufforderungen des Benutzers. Basierend auf der Benutzererfahrung kann dieses Problem in zwei Klassen eingeteilt werden: Dominanz von Objekten in der Nähe und Dominanz von Hintergrundobjekten. Das Problem der Dominanz des visuellen Kontexts gegenüber den Eingabeaufforderungen könnte auf die ausschließlich räumliche und aufforderungsfreie Natur der Selbstaufmerksamkeitsebenen zurückzuführen sein. Um dieses Problem anzugehen, führt das HD-Painter-Framework die Prompt Aware Introverted Attention oder PAIntA ein, die Kreuzaufmerksamkeitsmatrizen und eine Inpainting-Maske verwendet, um die Ausgabe der Selbstaufmerksamkeitsebenen im unbekannten Bereich zu steuern.

Die Komponente „Prompt Aware Introverted Attention“ wendet zunächst Projektionsebenen an, um den Schlüssel, die Werte und Abfragen zusammen mit der Ähnlichkeitsmatrix zu erhalten. Das Modell passt dann den Aufmerksamkeitswert der bekannten Pixel an, um den starken Einfluss der bekannten Region auf die unbekannte Region abzuschwächen, und definiert eine neue Ähnlichkeitsmatrix, indem es die Textaufforderung nutzt.

Reweighting Attention Score Guidance oder RASG

Das HD-Painter-Framework verwendet eine Post-hoc-Sampling-Anleitungsmethode, um die Ausrichtung der Generierung an den Textaufforderungen noch weiter zu verbessern. Neben einer objektiven Funktion zielt der Post-hoc-Sampling-Anleitungsansatz darauf ab, die Segmentierungseigenschaften des offenen Vokabulars der Queraufmerksamkeitsschichten zu nutzen. Dieser Ansatz der einfachen Post-hoc-Anleitung birgt jedoch das Potenzial, den Bereich der latenten Diffusion zu verschieben, was die Qualität des erzeugten Bildes beeinträchtigen könnte. Um dieses Problem zu lösen, implementiert das HD-Painter-Modell den Reweighting Attention Score Guidance- oder RASG-Mechanismus, der einen Gradienten-Neugewichtungsmechanismus einführt, der zur Erhaltung der latenten Domäne führt.

HD-Painter: Experimente und Ergebnisse

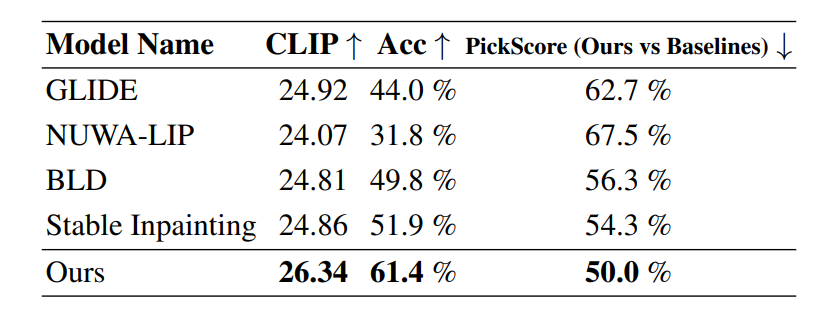

Um seine Leistung zu analysieren, wird das HD-Painter-Framework mit aktuellen Modellen auf dem neuesten Stand der Technik verglichen, einschließlich Stable Inpainting, GLIDE und BLD oder Blended Latent Diffusion über 10000 Zufallsstichproben, wobei die Eingabeaufforderung als Bezeichnung der ausgewählten Instanzmaske ausgewählt wird.

Wie zu beobachten ist, übertrifft das HD-Painter-Framework bestehende Frameworks bei drei verschiedenen Metriken deutlich, insbesondere durch die Verbesserung um 1.5 Punkte bei der CLIP-Metrik und den Unterschied in der generierten Genauigkeitsbewertung von etwa 10 % gegenüber anderen Methoden auf dem neuesten Stand der Technik .

Die folgende Abbildung zeigt im weiteren Verlauf den qualitativen Vergleich des HD-Painter-Frameworks mit anderen Inpainting-Frameworks. Wie zu beobachten ist, rekonstruieren andere Basismodelle entweder die fehlenden Regionen im Bild als Fortsetzung der bekannten Regionsobjekte unter Missachtung der Eingabeaufforderungen oder sie erzeugen einen Hintergrund. Andererseits ist das HD-Painter-Framework aufgrund der Implementierung der PAIntA- und RASG-Komponenten in seiner Architektur in der Lage, die Zielobjekte erfolgreich zu generieren.

Fazit

In diesem Artikel haben wir über HD-Painter gesprochen, einen freitextgesteuerten, hochauflösenden Inpainting-Trainingsansatz, der sich mit den Herausforderungen bestehender Inpainting-Frameworks befasst, einschließlich der sofortigen Vernachlässigung sowie der Dominanz von Objekten in der Nähe und im Hintergrund. Das HD-Painter-Framework implementiert eine Prompt Aware Introverted Attention- oder PAIntA-Schicht, die Prompt-Informationen verwendet, um die Selbstaufmerksamkeitswerte zu verbessern, was letztendlich zu einer besseren Generierung der Textausrichtung führt.

Um die Kohärenz der Eingabeaufforderung noch weiter zu verbessern, führt das HD-Painter-Modell einen Reweighting Attention Score Guidance- oder RASG-Ansatz ein, der eine Post-hoc-Sampling-Strategie nahtlos in die allgemeine Form der DDIM-Komponente integriert, um latente Verschiebungen außerhalb der Verteilung zu verhindern. Darüber hinaus führt das HD-Painter-Framework eine spezielle, auf Inpainting zugeschnittene Superauflösungstechnik ein, die eine Erweiterung auf größere Maßstäbe ermöglicht und es dem HD-Painter-Framework ermöglicht, die fehlenden Bereiche im Bild mit einer Auflösung von bis zu 2K zu vervollständigen.