Künstliche Intelligenz

GOTCHA – Ein CAPTCHA-System für Live-Deepfakes

Neue Forschungsergebnisse der New York University deuten darauf hin, dass wir bald den Deepfake-Äquivalent eines “Betrunkenentests” durchführen müssen, um uns zu authentifizieren, bevor wir ein sensibles Videoanruf wie ein Arbeitstreffen oder ein anderes sensibles Szenario beginnen, das von Betrügern mit Echtzeit-Deepfake-Streaming-Software angegriffen werden könnte.

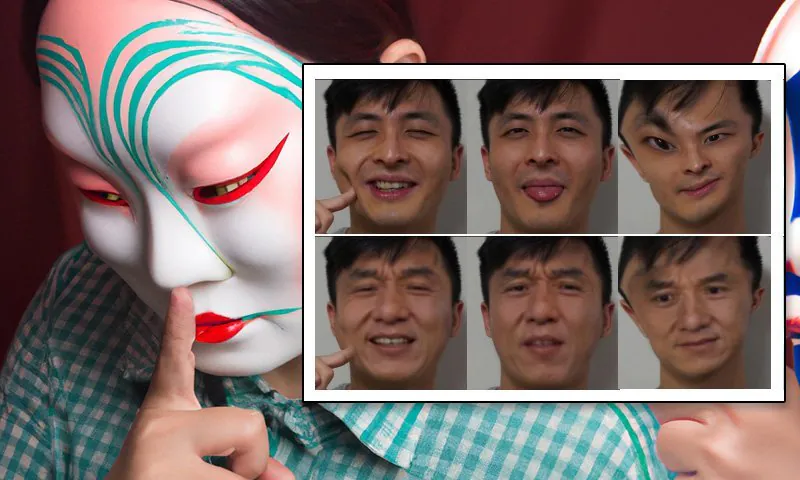

Einige der aktiven und passiven Herausforderungen, die in Videoanruf-Szenarien in GOTCHA angewendet werden. Der Benutzer muss den Herausforderungen gehorchen und sie bestehen, während zusätzliche ‘passive’ Methoden (wie das Überlasten eines potenziellen Deepfake-Systems) verwendet werden, auf die der Teilnehmer keinen Einfluss hat. Quelle: http://export.arxiv.org/pdf/2210.06186

Das vorgeschlagene System heißt GOTCHA – eine Hommage an die CAPTCHA-Systeme, die in den letzten 10-15 Jahren zu einem zunehmenden Hindernis für das Surfen im Internet geworden sind, bei dem automatisierte Systeme den Benutzer auffordern, Aufgaben auszuführen, die Maschinen schlecht können, wie z.B. das Identifizieren von Tieren oder das Entschlüsseln von unleserlichem Text (und ironischerweise machen diese Herausforderungen oft den Benutzer zu einem kostenlosen AMT-ähnlichen Outsourcer).

Im Wesentlichen erweitert GOTCHA den Beitrag vom August 2022 DF-Captcha der Ben-Gurion-Universität, der als Erster vorschlug, die Person am anderen Ende des Anrufs durch einige visuell semantische Hürden springen zu lassen, um ihre Echtheit zu beweisen.

Der Beitrag vom August 2022 der Ben-Gurion-Universität schlug eine Reihe interaktiver Tests für den Benutzer vor, einschließlich des Verdeckens seines Gesichts oder sogar des Einsinkens seiner Haut – Aufgaben, die sogar von gut trainierten Live-Deepfake-Systemen möglicherweise nicht antizipiert oder photorealistisch bewältigt werden können. Quelle: https://arxiv.org/pdf/2208.08524.pdf

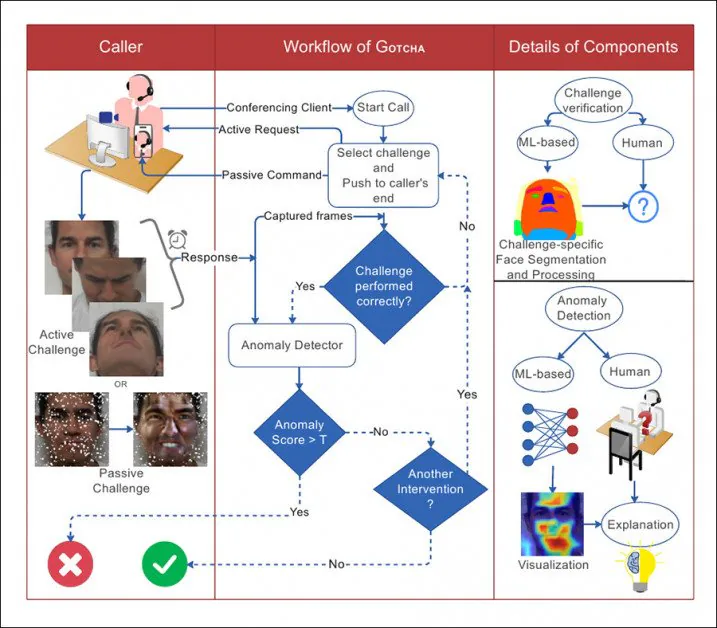

Bemerkenswerterweise fügt GOTCHA ‘passive’ Methoden zu einer ‘Kaskade’ von vorgeschlagenen Tests hinzu, einschließlich der automatischen Überlagerung von unrealen Elementen über das Gesicht des Benutzers und der ‘Überlastung’ von Frames, die durch das Quellsystem gehen. Allerdings können nur die benutzerreaktiven Aufgaben ohne spezielle Berechtigungen zum Zugriff auf das lokale System des Benutzers ausgewertet werden – was wahrscheinlich in Form von lokalen Modulen oder Erweiterungen für beliebte Systeme wie Skype und Zoom oder sogar in Form von spezieller proprietärer Software erfolgen würde, die speziell dafür entwickelt wurde, Betrüger auszufiltern.

Aus dem Paper, eine Darstellung der Interaktion zwischen dem Anrufer und dem System in GOTCHA, mit gestrichelten Linien als Entscheidungsflüsse.

Die Forscher validierten das System anhand eines neuen Datensatzes, der über 2,5 Millionen Video-Frames von 47 Teilnehmern enthält, die jeweils 13 Herausforderungen von GOTCHA durchführen. Sie behaupten, dass das Framework eine ‘konsistente und messbare’ Reduzierung der Qualität von Deepfake-Inhalten für betrügerische Benutzer induziert, die das lokale System belasten, bis offensichtliche Artefakte für das bloße Auge sichtbar werden (obwohl GOTCHA auch einige subtilere algorithmische Analysemethode enthält).

Das neue Paper trägt den Titel Gotcha: A Challenge-Response System for Real-Time Deepfake Detection (der Name des Systems ist im Text großgeschrieben, aber nicht im Titel der Veröffentlichung, obwohl es sich nicht um ein Akronym handelt).

Eine Reihe von Herausforderungen

Meistens in Übereinstimmung mit dem Beitrag der Ben-Gurion-Universität, sind die tatsächlichen benutzerorientierten Herausforderungen in mehrere Arten von Aufgaben unterteilt.

Für Verdeckung wird der Benutzer aufgefordert, sein Gesicht entweder mit seiner Hand oder mit anderen Objekten zu verdecken oder sein Gesicht in einem Winkel zu präsentieren, der wahrscheinlich nicht in ein Deepfake-Modell trainiert wurde (in der Regel wegen mangelnder Trainingsdaten für ‘unübliche’ Posen – siehe Bildbereich in der ersten Abbildung oben).

Neben Aktionen, die der Benutzer selbst gemäß den Anweisungen ausführen kann, kann GOTCHA zufällige Gesichtsausschnitte, Aufkleber und erweiterte Realitätsfilter überlagern, um den ‘Face-Stream’ zu ‘korruptieren’, den ein lokales trainiertes Deepfake-Modell erwarten könnte, und es zum Scheitern zu bringen. Wie bereits erwähnt, ist dies ein ‘passiver’ Prozess für den Benutzer, aber ein invasiver für die Software, die in der Lage sein muss, direkt in den Endkorrespondenten-Stream einzugreifen.

Als Nächstes kann der Benutzer aufgefordert werden, sein Gesicht in ungewöhnliche Gesichtsausdrücke zu verzerren, die wahrscheinlich entweder fehlen oder unterrepräsentiert sind in jedem Trainingsdatensatz, was zu einer Verringerung der Qualität des Deepfake-Ausgangs führt (Bild ‘b’, zweite Spalte von links, in der ersten Abbildung oben).

Als Teil dieser Reihe von Tests kann der Benutzer aufgefordert werden, Text vorzulesen oder ein Gespräch zu führen, das ein lokales Live-Deepfake-System herausfordern soll, das möglicherweise nicht über einen ausreichenden Bereich von Phonemen oder anderen Arten von Munddaten verfügt, um genaue Lippenbewegungen unter solcher Überwachung zu rekonstruieren.

Schließlich (und dies scheint die schauspielerischen Fähigkeiten des Endkorrespondenten herauszufordern) kann der Benutzer aufgefordert werden, eine ‘Mikro-Expression’ auszuführen – einen kurzen und unwillkürlichen Gesichtsausdruck, der eine Emotion verrät. Dazu sagt das Paper: ‘[es] dauert normalerweise 0,5-4,0 Sekunden und ist schwer zu fälschen’.

Obwohl das Paper nicht beschreibt, wie man eine Mikro-Expression extrahiert, legt die Logik nahe, dass der einzige Weg, dies zu tun, darin besteht, eine geeignete Emotion beim Endbenutzer zu erzeugen, vielleicht durch eine Art von schockierendem Inhalt, der als Teil des Testroutins präsentiert wird.

Gesichtsverzerrung, Beleuchtung und unerwartete Gäste

Zusätzlich schlägt die neue Arbeit vor, den Endbenutzer aufzufordern, ungewöhnliche Gesichtsverzerrungen und Manipulationen auszuführen, wie z.B. den Finger in die Wange zu drücken, mit dem Gesicht und/oder den Haaren zu interagieren und andere Bewegungen auszuführen, die kein aktuelles Live-Deepfake-System gut handhaben kann, da diese marginale Aktionen sind – selbst wenn sie im Trainingsdatensatz vorhanden wären, wäre ihre Reproduktion wahrscheinlich von schlechter Qualität, im Einklang mit anderen ‘Outlier’-Daten.

Ein Lächeln, aber dieses ‘deprimierte Gesicht’ wird von einem lokalen Live-Deepfake-System nicht gut übersetzt.

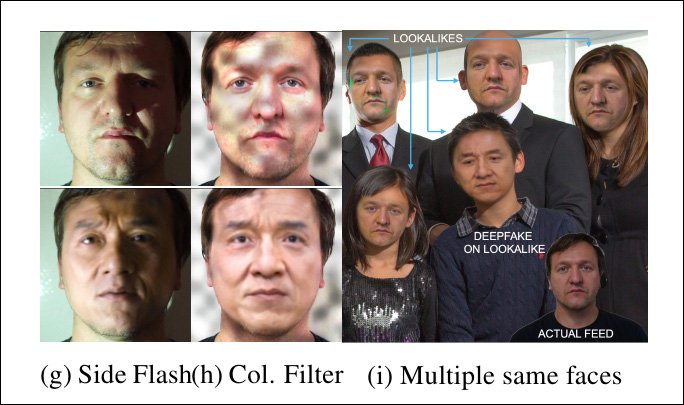

Eine weitere Herausforderung liegt in der Änderung der Beleuchtungsbedingungen, in denen sich der Endbenutzer befindet, da es möglich ist, dass die Ausbildung eines Deepfake-Modells auf Standard-Videoconferencing-Beleuchtungssituationen oder sogar auf die genauen Beleuchtungsbedingungen, unter denen der Anruf stattfindet, optimiert wurde.

Daher kann der Benutzer aufgefordert werden, den Scheinwerfer seines Mobiltelefons auf sein Gesicht zu richten oder auf andere Weise die Beleuchtung zu ändern (und es ist erwähnenswert, dass dies der zentrale Vorschlag eines anderen Live-Deepfake-Erkennungspapiers ist, das diesen Sommer veröffentlicht wurde).

Live-Deepfake-Systeme werden durch unerwartete Beleuchtung – und sogar durch mehrere Personen im Stream, wo sie nur eine einzelne Person erwartet hatten – herausgefordert.

Im Falle des vorgeschlagenen Systems, das in der Lage ist, in den lokalen Benutzer-Stream einzugreifen (der verdächtigt wird, einen Deepfake-Zwischenhändler zu beherbergen), kann das Hinzufügen unerwarteter Muster (siehe mittlere Spalte in der Abbildung oben) die Fähigkeit des Deepfake-Algorithmus beeinträchtigen, eine Simulation aufrechtzuerhalten.

Zusätzlich kann das System, obwohl es unvernünftig ist, von einem Korrespondenten zu erwarten, dass er zusätzliche Personen zur Hand hat, um ihn zu authentifizieren, zusätzliche Gesichter einfügen (rechte Abbildung oben) und prüfen, ob ein lokales Deepfake-System den Fehler macht, die Aufmerksamkeit zu wechseln – oder sogar versucht, alle zu deepfaken (Autoencoder-Deepfake-Systeme haben keine ‘Identitäts-Erkennungsfähigkeiten’, die die Aufmerksamkeit auf eine Person in diesem Szenario konzentrieren könnten).

Steganographie und Überlastung

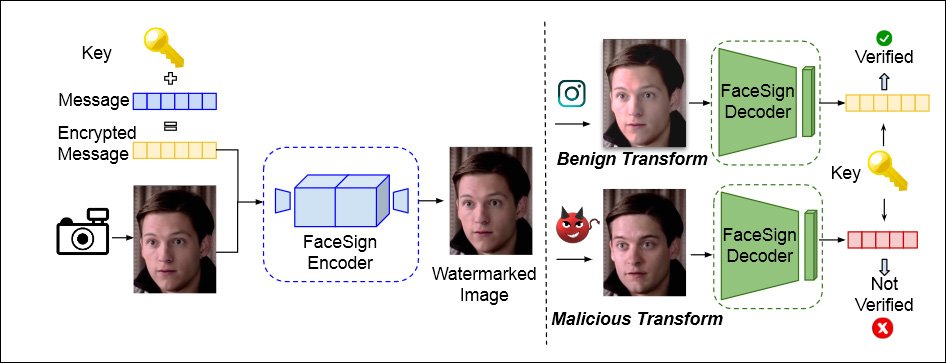

GOTCHA umfasst auch einen Ansatz , der zuerst von der UC San Diego im April dieses Jahres vorgeschlagen wurde, und der die Steganographie verwendet, um eine Nachricht in den lokalen Video-Stream des Benutzers zu verschlüsseln. Deepfake-Routinen werden diese Nachricht völlig zerstören, was zu einem Authentifizierungsfehler führt.

Aus einem Paper vom April 2022 der University of California, San Diego und der San Diego State University, eine Methode, um die authentische Identität zu bestimmen, indem man prüft, ob ein steganographisches Signal, das in den Video-Stream des Benutzers gesendet wird, den lokalen Loop intakt übersteht – wenn es nicht, kann Deepfake-Schwindel vorliegen. Quelle: https://arxiv.org/pdf/2204.01960.pdf

Zusätzlich ist GOTCHA in der Lage, das lokale System zu überlasten (bei Zugriff und Erlaubnis), indem es einen Stream dupliziert und ‘exzessive’ Daten an jedes lokale System präsentiert, die dazu bestimmt sind, ein lokales Deepfake-System zum Scheitern zu bringen.

Das System enthält weitere Tests (siehe Paper für Details), einschließlich einer Herausforderung, bei der der Benutzer aufgefordert wird, sein Telefon umzudrehen, was ein lokales Deepfake-System durcheinanderbringen würde:

Auch dies würde nur mit einem überzeugenden Anwendungsfall funktionieren, bei dem der Benutzer gezwungen wird, lokalen Zugriff auf den Stream zu gewähren, und kann nicht durch einfache passive Bewertung des Benutzer-Videos implementiert werden, im Gegensatz zu den interaktiven Tests (wie dem Drücken eines Fingers in das Gesicht).

Praktikabilität

Das Paper berührt kurz die Frage, inwieweit Tests dieser Art den Endbenutzer stören oder ihn auf andere Weise behindern könnten – zum Beispiel, indem sie den Benutzer zwingen, eine Reihe von Objekten griffbereit zu haben, die für die Tests benötigt werden, wie z.B. Sonnenbrillen.

Es erkennt auch an, dass es schwierig sein kann, mächtige Korrespondenten dazu zu bringen, den Test-Routinen zu folgen. In Bezug auf den Fall eines Videoanrufs mit einem CEO sagen die Autoren:

‘Benutzerfreundlichkeit kann hier der Schlüssel sein, also können informelle oder frivole Herausforderungen (wie Gesichtsverzerrungen oder Ausdrücke) nicht angemessen sein. Herausforderungen, die externe physische Artikel verwenden, können nicht wünschenswert sein. Der Kontext hier ist entsprechend modifiziert und GOTCHA passt seine Reihe von Herausforderungen entsprechend an.’

Daten und Tests

GOTCHA wurde gegen vier Stämme von lokalen Live-Deepfake-Systemen getestet, einschließlich zwei Variationen des sehr beliebten Autoencoder-Deepfakes-Erstellungsprogramms DeepFaceLab (‘DFL’, obwohl das Paper überraschenderweise nicht DeepFaceLive erwähnt, das seit August 2021 die ‘Live’-Implementierung von DeepFaceLab ist und das wahrscheinlichste anfängliche Ressourcen für einen potenziellen Fälscher ist).

Die vier Systeme waren DFL, das ‘leicht’ auf einer nicht berühmten Person trainiert wurde, die an den Tests teilnahm, und ein Paar von Celebrities; DFL, das umfassender trainiert wurde, bis zu 2 Millionen Iterationen oder Schritte, bei denen man ein viel leistungsfähigeres Modell erwarten würde; Latent Image Animator (LIA); und Face Swapping Generative Adversarial Network (FSGAN).

Für die Daten haben die Forscher Video-Clips aufgenommen und kuratiert, die 47 Benutzer zeigen, die 13 aktive Herausforderungen durchführen, wobei jeder Benutzer etwa 5-6 Minuten von 1080p-Video bei 60fps ausgibt. Die Autoren sagen auch, dass diese Daten schließlich öffentlich verfügbar gemacht werden.

Die Anomalie-Erkennung kann entweder von einem menschlichen Beobachter oder algorithmisch durchgeführt werden. Für die letztere Option wurde das System auf 600 Gesichtern aus dem FaceForensics-Datensatz trainiert. Die Regressionsverlustfunktion war die leistungsstarke Learned Perceptual Image Patch Similarity (LPIPS), während binäres Kreuzentropie verwendet wurde, um den Klassifizierer zu trainieren. EigenCam wurde verwendet, um die Gewichte des Detektors zu visualisieren.

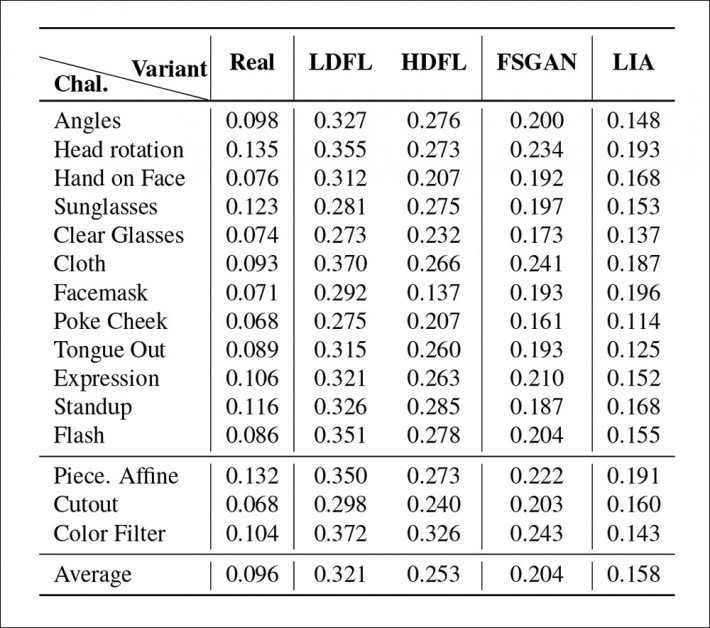

Primäre Ergebnisse der Tests für GOTCHA.

Die Forscher fanden heraus, dass für die vollständige Kaskade von Tests über die vier Systeme die geringste Anzahl und Schwere von Anomalien (d.h. Artefakte, die die Anwesenheit eines Deepfake-Systems verraten würden) durch die höher trainierte DFL-Verteilung erzielt wurden. Die weniger trainierte Version hatte insbesondere Schwierigkeiten, komplexe Lippenbewegungen (die sehr wenig des Rahmens einnehmen, aber die menschliche Aufmerksamkeit erhalten) nachzubilden, während FSGAN den mittleren Boden zwischen den beiden DFL-Versionen einnahm und LIA sich als völlig unzureichend für die Aufgabe erwies, wobei die Forscher meinten, LIA würde in einer realen Bereitstellung versagen.

Erstveröffentlichung 17. Oktober 2022.