Andersons Blickwinkel

Objekte und Personen mithilfe von KI aus Videos entfernen

Nein, das Kind bleibt nicht im Bild, wenn es nach der KI geht.

Das Entfernen von Personen und Objekten aus Bildern und Videos ist ein beliebtes Teilgebiet der Forschung im Bereich der KI-gestützten VFX-Forschung, wobei immer mehr Datensätze und Frameworks speziell für diese Herausforderung entwickelt werden. Das neueste dieser Frameworks stammt vom Institut für Big Data der Fudan-Universität in China. EffectErase, ein „effektbewusstes“ Videoobjektentfernungssystem, das nach Ansicht der Autoren in Tests den Stand der Technik deutlich verbessert:

Zusammengestellt aus Material von der Projektwebsite, Beispiele der EffectErase-Methode (bitte beachten Sie, dass die verlinkte Webseite so viele hochauflösende und nicht optimierte Autoplay-Videos enthält, dass die Stabilität Ihres Webbrowsers beeinträchtigt werden kann. Das zugehörige YouTube-Video ist eine einfachere und umfassendere Referenz und ist am Ende dieses Artikels eingebettet). Quelle

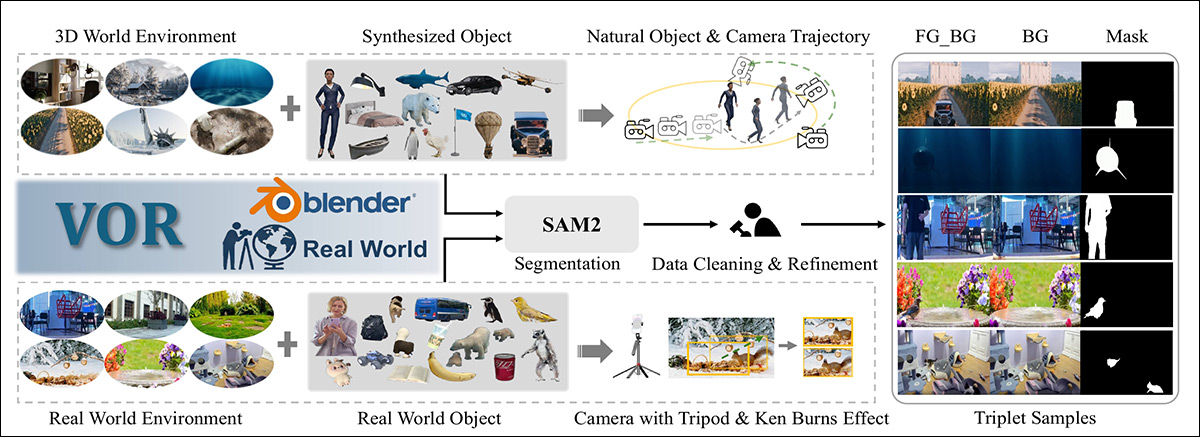

Die neue Arbeit umfasste die Erstellung/Kuration eines semi-neuartigen Datensatzes mit fast 350 originalen realen und auch synthetisierten Szenen (unter Verwendung öffentlicher Repositories*), die entweder mit spezieller Ausrüstung aufgenommen oder für einen Workflow um das Open-Source-Blender-3D-Framework herum bezogen und wiederverwendet wurden.

Der hybride Video Object Removal (VOR)-Datensatz bildet die Grundlage für die EffectErase die Anwendung selbst, die auf der Wan2.1 Videogenerierungssystem. Das System definiert außerdem zwei neue, damit zusammenhängende Benchmarks: VOR-Bewertung und VOR Wild – bzw. für Proben mit und ohne Grund Wahrheit.

(Obwohl das Papier einen zugehöriges ProjektgeländeDie Seite ist mit zahlreichen hochauflösenden Videos überladen und lädt daher nur schwer. Sollten Sie Schwierigkeiten mit der Projektseite haben, schauen Sie sich bitte die von mir zusammengestellten Ausschnitte im oben eingebetteten Video an.

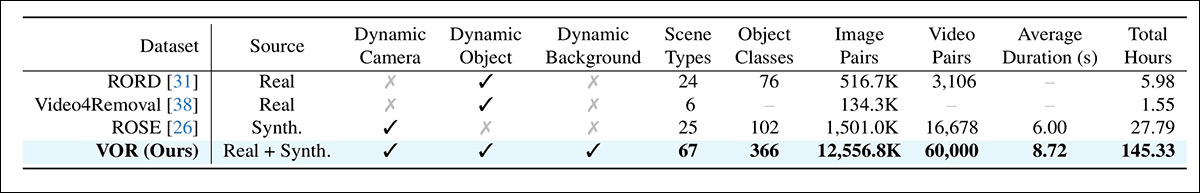

Ein Vergleich der Mengen in vergleichbaren früheren Datensätzen im Hinblick auf das neue Angebot. Quelle

Die Forscher behaupten, dass ihr Ansatz sowohl bei quantitativen Kennzahlen als auch bei qualitativen Ergebnissen, die in einer Humanstudie überprüft wurden, zu Spitzenleistungen führt.

Sie weisen darauf hin, dass es früheren Arbeiten nicht immer gelungen ist, Begleiteffekte eines Objekts, wie Schatten und Spiegelungen, zu entfernen, und dass ihr Datensatz sorgfältig erstellt wurde, um diesen Mangel zu beheben:

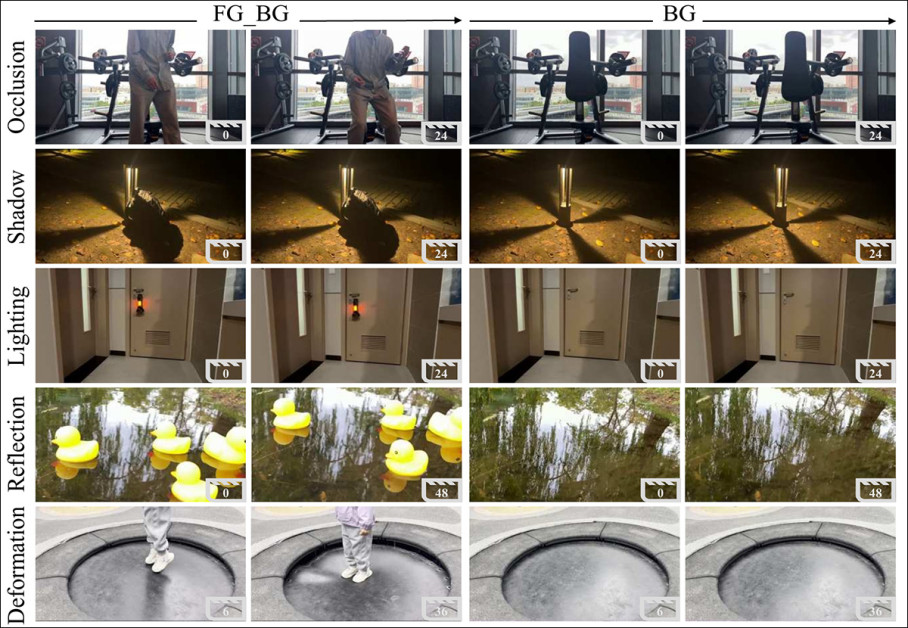

Beispiele für das Versagen bisheriger Ansätze, über das zu entfernende Objekt hinauszublicken und sekundäre Hinweise wie Spiegelungen und Schatten zu berücksichtigen.

Die neues Papier ist betitelt EffectErase: Gemeinsames Entfernen und Einfügen von Videoobjekten für hochwertige Effektlöschungund stammt von vier Forschern des College für Informatik und Künstliche Intelligenz der Fudan-Universität.

Methodik

Der hybride VOR-Datensatz wurde so konzipiert, dass er ein ausreichend breites Spektrum an Szenarien abdeckt, um alle Implikationen des Versuchs, eine Person oder ein Objekt aus einem Video zu entfernen, zu erfassen:

Die gepaarten Bilder aus dem VOR-Datensatz veranschaulichen, dass die Objektentfernung über das sichtbare Objekt hinaus auch dessen Auswirkungen berücksichtigen muss. Beispiele zeigen Verdeckung, Schatten, Lichtveränderungen, Spiegelungen und physikalische Deformationen. Jedes Beispiel wird als Eingabe (Objekt vorhanden) zusammen mit dem entsprechenden, nach der Entfernung bereinigten Hintergrund dargestellt. Weitere Beispiele finden Sie im zugehörigen YouTube-Video am Ende dieses Artikels.

Die fünf repräsentativen Arten von „Interferenzen“, die es zu behandeln gilt, werden von den Autoren wie folgt definiert: Okklusioneinschließlich verschiedener Arten von Glas- und Rauchschutzvorrichtungen; Schatten; Beleuchtung (zum Beispiel, wenn ein zu entfernendes Objekt den Lichtweg erzeugt oder verändert); Betrachtungeschriebenen Art und Weise; und Verformung (zum Beispiel der Abdruck eines Benutzers auf einem Kissen, der nach dem Entfernen der Person nicht mehr sichtbar sein sollte).

Die Pipeline zur Erstellung von Datensätzen für VOR kombiniert in Blender generierte synthetische Szenen mit realen Aufnahmen. Die synthetischen Daten basieren auf sorgfältig ausgewählten 3D-Umgebungen, Objekten und Kamerabewegungen sowie realem Filmmaterial aus verschiedenen Szenen, das mit Ken Burns Motion angereichert wird. SAM2-Segmentierung und manuelle Nachbearbeitung erzeugen anschließend ausgerichtete Vorder- und Hintergrund-Videotripletts mit entsprechenden Masken.

Für die realen Originaldaten verwendeten die Forscher fest installierte Kameras, um Szenen mit und ohne Umgebung, Tageszeit und Wetterbedingungen aufzuzeichnen.

Für die synthetisierten Daten wurden mehrere Blickwinkel gerendert und Szenarien mit mehreren Objekten erstellt, die bewusst komplexe und anspruchsvolle Kamerabewegungen beinhalteten, wie sie in realen Aufnahmen vorkommen können. Die Forscher stellen fest, dass dieser Ansatz anspruchsvoller und aufwändiger ist als derjenige, der für die ansonsten ähnliche Methode verwendet wurde. Objekte mit Nebenwirkungen in Videos entfernen (ROSE) Datensatz.

Um die Bewegungsvielfalt zu erhöhen, Ken Burns-Effekt wurde auf mit der Kamera aufgenommene Bildpaare angewendet, wobei kontrollierte Schwenks, Zooms und leichte Handbewegungen gemäß vierzehn vordefinierten Regeln hinzugefügt wurden. Pro Bildpaar wurden fünf Bewegungsmuster abgetastet, wobei der Bildausschnitt innerhalb des ursprünglichen Bildausschnitts blieb.

Skalierung und Diversität wurden durch die Kombination synthetischer Objekte mit mehreren Kameraeinstellungen weiter ausgebaut. Masken wurden generiert, indem manuelle Punktmarkierungen auf Schlüsselbildern platziert und die Segmentierung fortgeführt wurde. Segmentieren Sie alles 2 (SAM2), Bereinigung und Verfeinerung der Ergebnisse sowie Zusammenstellung validierter Vordergrund-, Hintergrund- und Maskentripletts für das Training.

Die finale Sammlung umfasst 145 Stunden Videomaterial, verteilt auf 60,000 Videopaare aus realen und synthetischen Aufnahmen, die 366 Objektklassen in 443 Szenen abdecken.

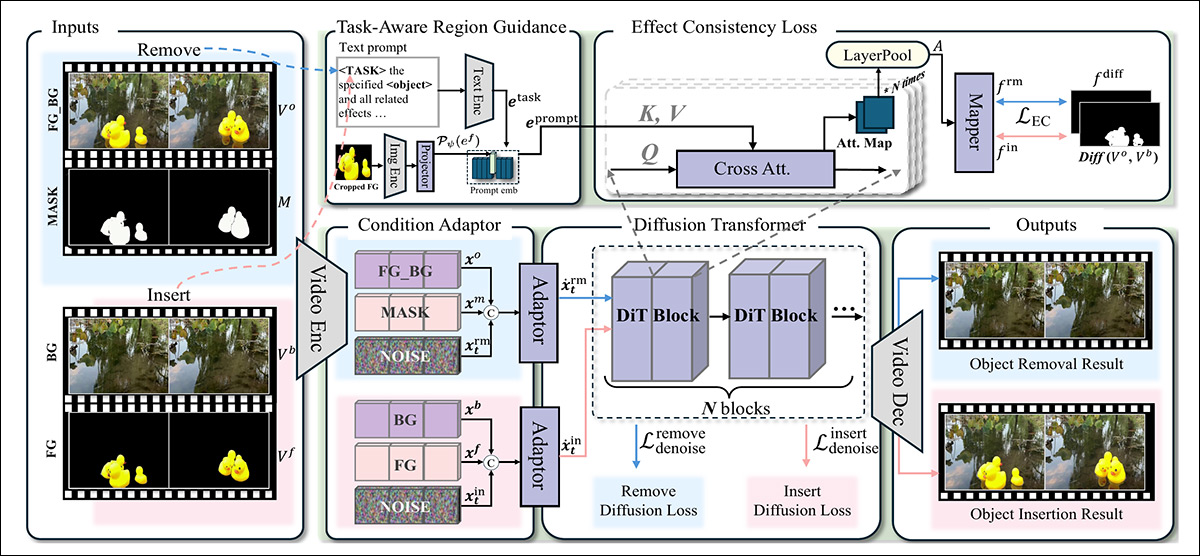

Das EffectErase-Netzwerk selbst verarbeitet Material über einen Variational Auto-Encoder (VAE†), wobei die latente Rauschunterdrückung von Wan2.1 übernommen wird. Auf dieser Grundlage läuft EffectErase. Gemeinsames Lernen beim Entfernen und Einsetzen, wodurch beide Aufgaben gleichzeitig in denselben Regionen trainiert werden; Aufgabenorientierte Regionsführung (TARG), das Objekt- und Aufgabentoken mit Queraufmerksamkeit um raumzeitliche Zusammenhänge zwischen Objekten und ihren Auswirkungen zu modellieren und Aufgabenwechsel zu ermöglichen; und Verlust der Effektkonsistenz, wodurch Effektregionen über Entfernungs- und Einfügeaufgaben hinweg ausgerichtet werden:

Schema für das EffectErase-Framework. Während des Trainings werden gepaarte Videos in einen gemeinsamen latenten Raum kodiert, mit Rauschen fusioniert und von einem Diffusionstransformator verarbeitet, der durch aufgabenbewusste Kreuzaufmerksamkeit gesteuert wird, während ein Effektkonsistenzverlust die Entfernungs- und Einfügebereiche so ausrichtet, dass sich beide Aufgaben auf denselben Bereich konzentrieren.

Die Entfernungs- und Einfügeprozesse werden gemeinsam trainiert, indem ein gemeinsames Diffusionsgerüst verwendet wird, sodass das Modell lernt, sich auf die gleichen betroffenen Regionen und strukturellen Merkmale zu konzentrieren.

Videos mit Objekten, Videos nur mit Hintergrund und Masken werden zunächst in ein kodiertes Format umgewandelt. latenter RaumAnschließend wird Rauschen für das Diffusionstraining hinzugefügt, und das Modell lernt, unter aufgabenspezifischer Anleitung saubere Repräsentationen wiederherzustellen. Ein schlanker Adapter fusioniert dann die verrauschten Merkmale mit Entfernungs- oder Einfügebedingungen, sodass beide Aufgaben gemeinsam überwacht werden können und gleichzeitig steuerbar bleiben.

Aufgabenorientierte Regionsführung erzeugt ein aufgabenspezifisches Signal, indem es Sprachbausteine mit visuellen Merkmalen kombiniert, die aus dem Vordergrundobjekt extrahiert werden, indem es CLIPDabei wird ein generisches Objekttoken durch eine aus dem tatsächlichen Bildinhalt abgeleitete Einbettung ersetzt. Diese fusionierte Repräsentation wird mittels Cross-Attention in das Backbone eingespeist, wodurch das Modell die räumliche und zeitliche Entwicklung eines Objekts und seiner visuellen Effekte verfolgen und gleichzeitig flexibel zwischen Entfernen und Einfügen umschalten kann.

Verlust der Effektkonsistenz Die Prozesse zum Entfernen und Einfügen konzentrieren sich auf dieselben veränderten Bereiche, da beide Aufgaben dasselbe Objekt und seine visuellen Effekte betreffen. Die Aufmerksamkeitskarten der einzelnen Zweige werden dann zu Soft-Region-Karten kombiniert und mit einem Differenzkarte Die Berechnung erfolgt aus den Objekt- und Hintergrundvideos, sodass subtile Veränderungen wie Beleuchtung und Schatten erhalten bleiben. Verlust erleichtert das Einführen und Entfernen und sorgt für gleichbleibende Ergebnisse beider Arbeitsschritte.

Daten und Tests

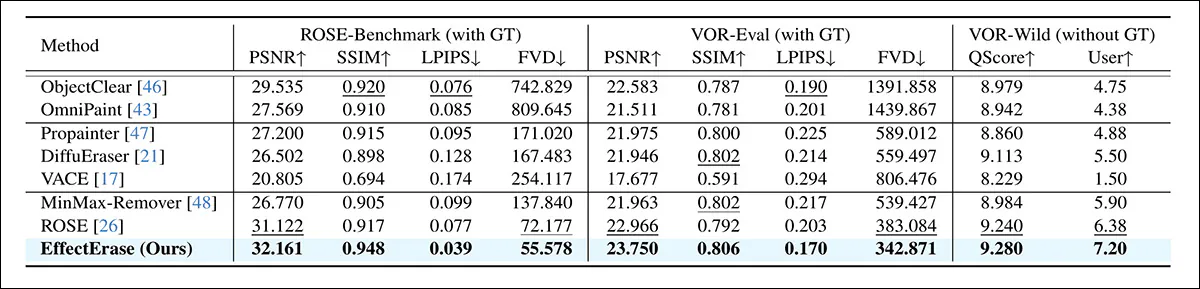

Die Forscher testeten ihren Ansatz anhand verschiedener Inpainting-, Video-Inpainting- und Objektentfernungsmethoden: OmniPaint; Objekt löschen; VACE; DiffuEraser; ProPainter; ROSEeschriebenen Art und Weise; und MiniMax-Entferner.

Wan2.1 wurde feinabgestimmt mit LoRA†† Verwendung des VOR-Datensatzes mit einer Auflösung von 832x480px. 81 aufeinanderfolgende Frames (die effektive Grenze (für WAN, ab dem tendenziell Fehler auftreten) wurden zufällig für das Training ausgewählt, das über 129,000 Iterationen mit einer Losgröße von 8, auf acht H100-GPUs, jede mit 80 GB VRAM. Lernrate wurde auf 1×10 eingestellt2und die LoRA-Rang um 256.

Die ROSE-Benchmark Die synthetische Sammlung war der einzige getestete externe Datensatz; die beiden anderen waren VOR-Eval, hat das VOR Datensatztest gespalten; und VOR-Wild, ein Testset bestehend aus 195 echten Videos, die aus dem Internet gesammelt wurden und „dynamische Objekte“ zeigen.

Verwendete Metriken waren Spitzensignal-Rausch-Verhältnis (PSNR); Struktureller Ähnlichkeitsindex (SSIM); Erlernte perzeptuelle Bildfeldähnlichkeit (LPIPS); und Fréchet Video Entfernung (FVD). Es wurde auch eine Nutzerstudie mit 195 von VOR-Wild generierten Videos berücksichtigt, wobei die durchschnittlichen Bewertungen von 20 Freiwilligen einbezogen wurden.

Darüber hinaus entwickelten die Autoren QScore, eine Kennzahl, die die Qwen-VL multimodales Modell zur Bewertung der Qualität des objektentfernten Videomaterials hinsichtlich verbleibender Artefakte oder nicht entfernter Umgebungselemente wie Schatten und Lichteffekte:

Quantitativer Vergleich anhand der ROSE- und VOR-Benchmarks, wobei die besten und zweitbesten Ergebnisse fett bzw. unterstrichen dargestellt sind.

Zu diesen Ergebnissen merken die Autoren an:

Die [gegenwärtigen] Bildrekonstruktionsverfahren arbeiten mit einzelnen Frames unter Verwendung von 2D-Modellen ohne zeitliche Modellierung und können daher die zeitliche Konsistenz in Videos nicht aufrechterhalten.

Neuere Video-Inpainting-Verfahren modellieren Objekt-Nebeneffekte nicht explizit, was zu unnatürlichen Ergebnissen bei der Objektentfernung führt. Bestehende Video-Objektentfernungsverfahren berücksichtigen keine räumlich-zeitliche Korrelation zwischen dem Objekt und seinen Nebeneffekten und erzeugen daher häufig Artefakte und Restspuren der entfernten Objekte.

„Insgesamt erzielt EffectErase über alle Datensätze und Bewertungsmetriken hinweg Bestleistungen. Es erzielt die besten Ergebnisse bei der Videoqualitätsmetrik FVD und beweist damit eine überragende zeitliche Glätte und Konsistenz der generierten Videos.“

„Unsere Methode erzielt zudem die höchsten QScore- und Nutzerbewertungen, was ihre Wirksamkeit bei der Erzielung visuell überzeugender Entfernungsergebnisse weiter unterstreicht.“

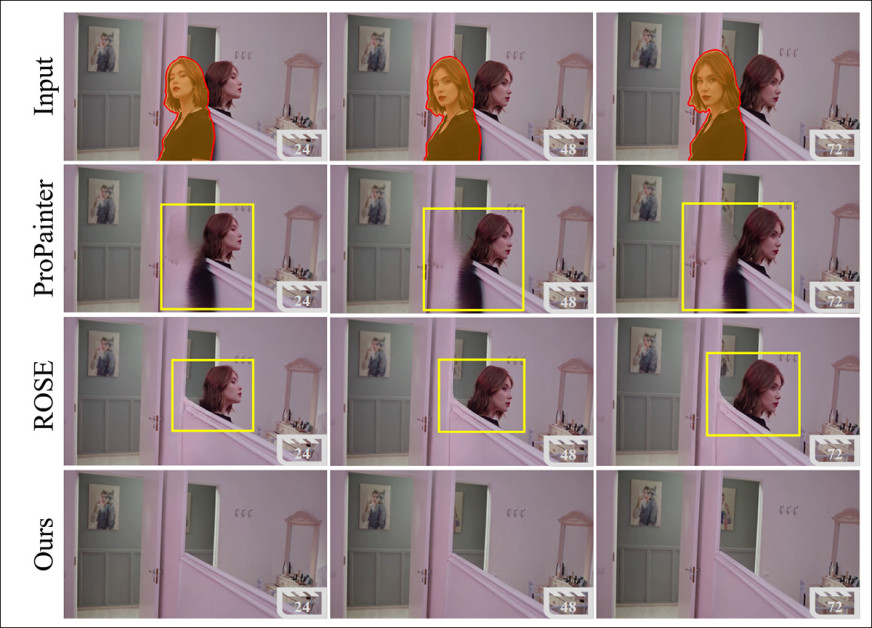

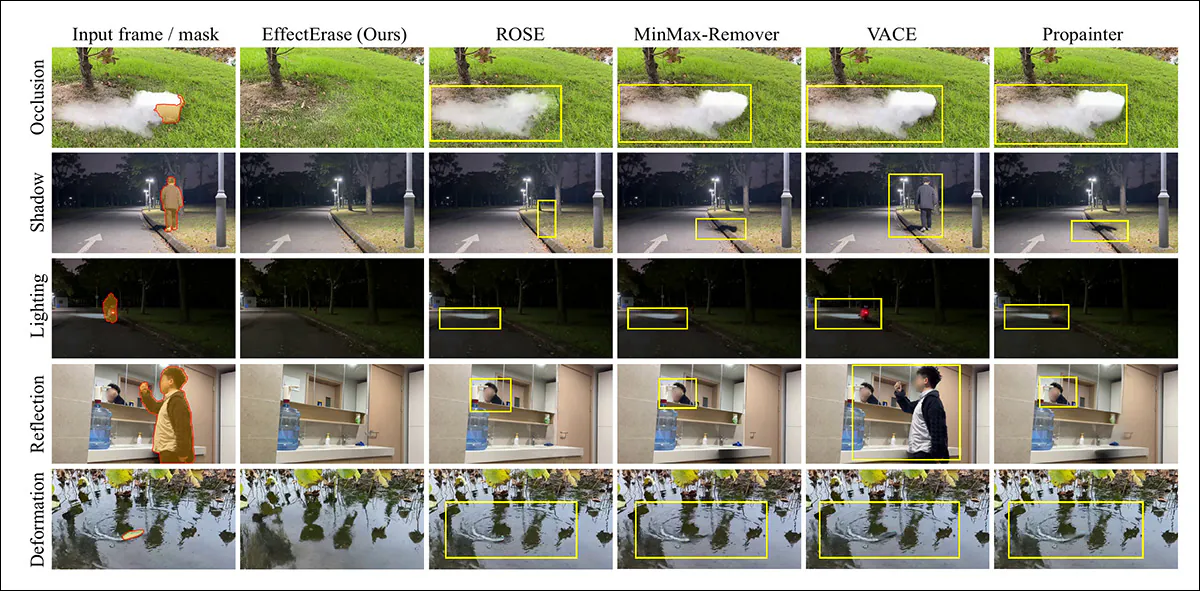

Für die qualitative Auswertung werden statische Ergebnisse im untenstehenden Dokument (siehe unten) präsentiert, während dynamische Ergebnisse auf der Projektwebsite und in der zugehörigen Dokumentation verfügbar sind. YouTube-Videopräsentation:

Qualitativer Vergleich von VOR-Eval anhand von Okklusion, Schatten, Beleuchtung, Reflexion und Deformation. Inpainting-Methoden haben Schwierigkeiten, Effekte außerhalb der Maske zu entfernen, während Entfernungsmodelle oft sichtbare Artefakte hinterlassen. EffectErase entfernt sowohl die Zielobjekte als auch die zugehörigen Effekte sauberer. Eine höhere Auflösung finden Sie in der Originalveröffentlichung, Videobeispiele auf der Projektwebsite.

Wir verweisen den Leser außerdem auf diverse verwandte Beispiele auf der Projektseite, die unten kurz vorgestellt werden, sowie auf das offizielle YouTube-Video, das am Ende dieses Artikels eingebettet ist:

Anklicken um abzuspielen. Ein Beispielvergleich von der Projektseite von EffectErase. Für eine höhere Auflösung (unter Berücksichtigung der oben genannten Einschränkungen) und weitere Beispiele besuchen Sie bitte die Website.

Die Autoren kommentieren:

Video-Inpainting-Verfahren erzeugen häufig Artefakte in maskierten Bereichen und beseitigen die durch die entfernten Objekte verursachten Nebeneffekte nicht vollständig. Frühere Ansätze zur Objektentfernung, wie ROSE und MinMax-Remover, entfernen zwar Zielobjekte gut, haben aber weiterhin Probleme mit Nebeneffekten, insbesondere bei Verdeckung, Schatten, Beleuchtung, Reflexionen und Deformationen.

„Im Gegensatz dazu entfernt EffectErase sowohl die Zielobjekte als auch die zugehörigen Effekte effektiv, was zu sauberen, kohärenten und qualitativ hochwertigen Ergebnissen führt.“

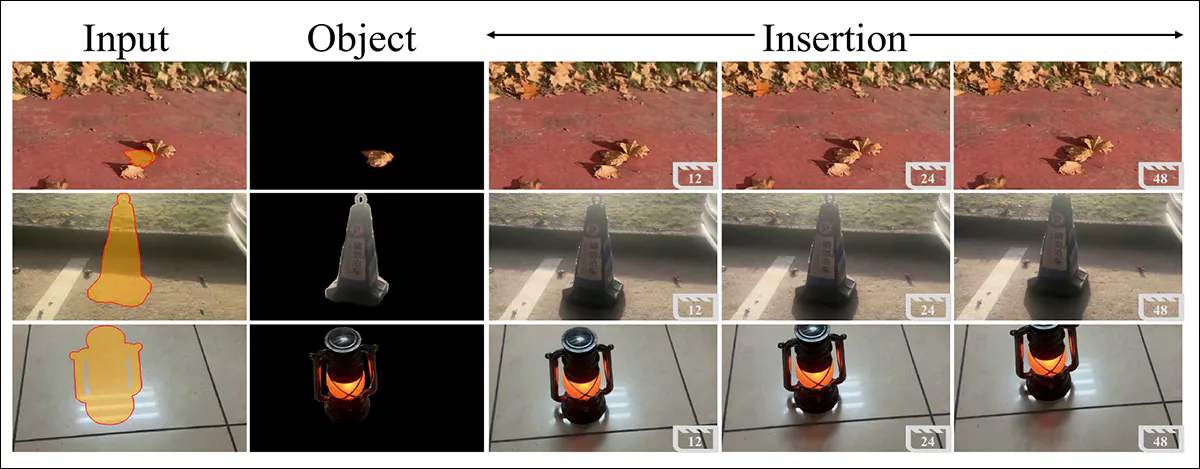

Abschließend stellen die Forscher fest, dass ihre Methode auch für Einfügeaufgaben anstelle von Entnahmeaufgaben angepasst werden kann, ohne dass eine zusätzliche Schulung erforderlich ist:

Ergebnisse der Videoobjekteinfügung. EffectErase fügt Objekte ein, wobei der Hintergrundinhalt erhalten bleibt und konsistente objektbedingte Effekte wie Schatten und Spiegelungen über mehrere Frames hinweg erzeugt werden.

Die Videoergebnisse für die Einfügeaufgabe können im folgenden Abschnitt eingesehen werden: (zeitlich begrenztes) YouTube-Video Beispiele (ebenfalls ohne Zeitstempel am Ende des Artikels eingebettet).

Fazit

Ein Blick auf ähnliche Projekte in der Fachliteratur zeigt, dass viele immer noch hoffen, dass universelle VFX-Modelle irgendwann in der Lage sein werden, diese Art von Funktionalität in ein allgemeines „Toolkit“-Modell zu integrieren, das für eine Reihe von Effekten ausgelegt ist, und nicht nur für diese spezielle Aufgabe.

Nach dem Prinzip „Alleskönner“ erscheint es jedoch vernünftig anzunehmen, dass spezialisierte Systeme wie EffectErase auch weiterhin einen Vorteil gegenüber allgemeineren Ansätzen haben werden; allerdings mit der Einschränkung, dass sich der Unterschied irgendwann so weit verringern könnte, dass sich der zusätzliche Aufwand für das Training eines diskreten Modells nicht mehr lohnt.

* Man würde hoffen, dass angesichts der zunehmenden Bedenken hinsichtlich der Herkunftsnachweise des geistigen Eigentums alle diese Quellen angegeben würden; doch wenn die verfügbaren Materialien aus der neuen Arbeit die Quelle der 3D-Modelle auflisten, konnte ich diese Referenz nicht finden.

† Die angegebene Referenz scheint eine zu sein. allgemeiner Erläuterungstext ab 2013, wobei die spezifische VAE nicht näher spezifiziert wird.

†† Aus dem Artikel entnommen, ist diese Beschreibung semantisch unklar, da Feinabstimmung und LoRA unterschiedliche Prozesse mit sehr unterschiedlichen Anforderungen sind.

Erstveröffentlichung: Samstag, 21. März 2026