Künstliche Intelligenz

AnomalyGPT: Erkennung von industriellen Anomalien mit LVLMs

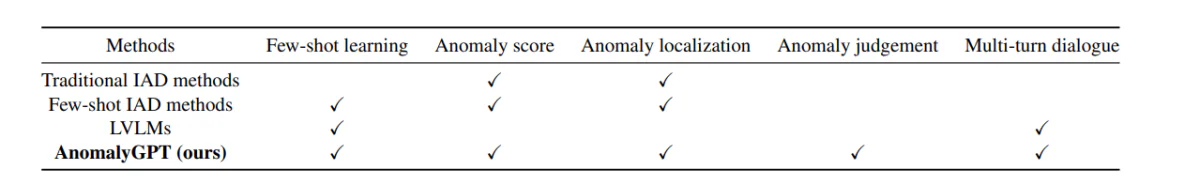

Kürzlich haben Large Vision Language Models (LVLMs) wie LLava und MiniGPT-4 gezeigt, dass sie in der Lage sind, Bilder zu verstehen und eine hohe Genauigkeit und Effizienz in verschiedenen visuellen Aufgaben zu erzielen. Während LVLMs aufgrund ihrer umfangreichen Trainingsdatensätze hervorragend darin sind, alltägliche Objekte zu erkennen, fehlt es ihnen an spezifischem Fachwissen und sie haben ein begrenztes Verständnis von lokalen Details innerhalb von Bildern. Dies begrenzt ihre Wirksamkeit bei der industriellen Anomalieerkennung (IAD). Andererseits können bestehende IAD-Frameworks nur die Quellen von Anomalien identifizieren und erfordern manuelle Schwellenwerteinstellungen, um normale von anormalen Proben zu unterscheiden, was ihre praktische Umsetzung einschränkt.

Die primäre Aufgabe eines IAD-Frameworks besteht darin, Anomalien in industriellen Szenarien und Produktbildern zu erkennen und zu lokalisieren. Allerdings werden Modelle aufgrund der Unvorhersehbarkeit und Seltenheit von Echtzeit-Bildproben typischerweise nur mit normalen Daten trainiert. Sie unterscheiden anormale Proben von normalen auf der Grundlage von Abweichungen von den typischen Proben. Derzeit liefern IAD-Frameworks und -Modelle in erster Linie Anomalie-Scores für Testproben. Darüber hinaus erfordert die Unterscheidung zwischen normalen und anormalen Instanzen für jede Klasse von Artikeln die manuelle Festlegung von Schwellenwerten, was sie für Echtzeit-Anwendungen unzureichend macht.

Um die Verwendung und Implementierung von Large Vision Language Models bei der Bewältigung der Herausforderungen von IAD-Frameworks zu untersuchen, wurde AnomalyGPT, ein neuer IAD-Ansatz auf der Grundlage von LVLM, vorgestellt. AnomalyGPT kann Anomalien erkennen und lokalisieren, ohne dass manuelle Schwellenwerteinstellungen erforderlich sind. Darüber hinaus kann AnomalyGPT auch relevante Informationen über das Bild bereitstellen, um interaktiv mit Benutzern zu kommunizieren, sodass diese Follow-up-Fragen auf der Grundlage der Anomalie oder ihrer spezifischen Bedürfnisse stellen können.

Industrielle Anomalieerkennung und Large Vision Language Models

Bestehende IAD-Frameworks können in zwei Kategorien eingeteilt werden.

- Rekonstruktionsbasierte IAD.

- Feature-Embedding-basierte IAD.

In einem rekonstruktionsbasierten IAD-Framework besteht das primäre Ziel darin, Anomalieproben in ihre entsprechenden normalen Gegenstücke zu rekonstruieren und Anomalien durch Rekonstruktionsfehler zu erkennen. SCADN, RIAD, AnoDDPM und InTra nutzen unterschiedliche Rekonstruktionsframeworks, die von Generative Adversarial Networks (GAN) und Autoencodern bis hin zu Diffusionsmodellen und Transformern reichen.

Andererseits besteht in einem feature-embedding-basierten IAD-Framework das primäre Ziel darin, sich auf die Modellierung der Feature-Embedding von Normaldaten zu konzentrieren. Methoden wie PatchSSVD versuchen, eine Hypersphäre zu finden, die normale Proben eng umschließt, während Frameworks wie PyramidFlow und Cfl normale Proben auf eine Gauß-Verteilung mithilfe von Normalisierungsflüssen projizieren. CFA- und PatchCore-Frameworks haben eine Speicherbank mit normalen Proben aus Patch-Embeddings eingerichtet und verwenden den Abstand zwischen der Testprobe-Embedding-Normal-Embedding, um Anomalien zu erkennen.

Beide Methoden folgen dem „one class one model“-Lernparadigma, das eine große Menge an Normalproben erfordert, um die Verteilungen jeder Objektklasse zu erlernen. Die Anforderung einer großen Menge an Normalproben macht es für neue Objektkategorien unpraktisch und begrenzt die Anwendungen in dynamischen Produktumgebungen. Andererseits ermöglicht das AnomalyGPT-Framework die Verwendung eines in-context-Lernparadigmas für Objektkategorien, sodass es nur mit einer Handvoll Normalproben interferieren kann.

Wenn wir weitermachen, haben wir Large Vision Language Models oder LVLMs. LLMs oder Large Language Models haben im NLP-Bereich enormen Erfolg gehabt und werden nun für ihre Anwendungen in visuellen Aufgaben erforscht. Das BLIP-2-Framework nutzt Q-former, um visuelle Features von Vision Transformer in das Flan-T5-Modell einzugeben. Darüber hinaus verbindet das MiniGPT-Framework den Bildsegment des BLIP-2-Frameworks und das Vicuna-Modell mit einer linearen Schicht und führt einen zweistufigen Feinabstimmungsprozess mit Bild-Text-Daten durch. Diese Ansätze zeigen, dass LLM-Frameworks möglicherweise einige Anwendungen für visuelle Aufgaben haben. Allerdings wurden diese Modelle auf allgemeine Daten trainiert und verfügen nicht über die erforderliche domänen-spezifische Expertise für umfassende Anwendungen.

Wie funktioniert AnomalyGPT?

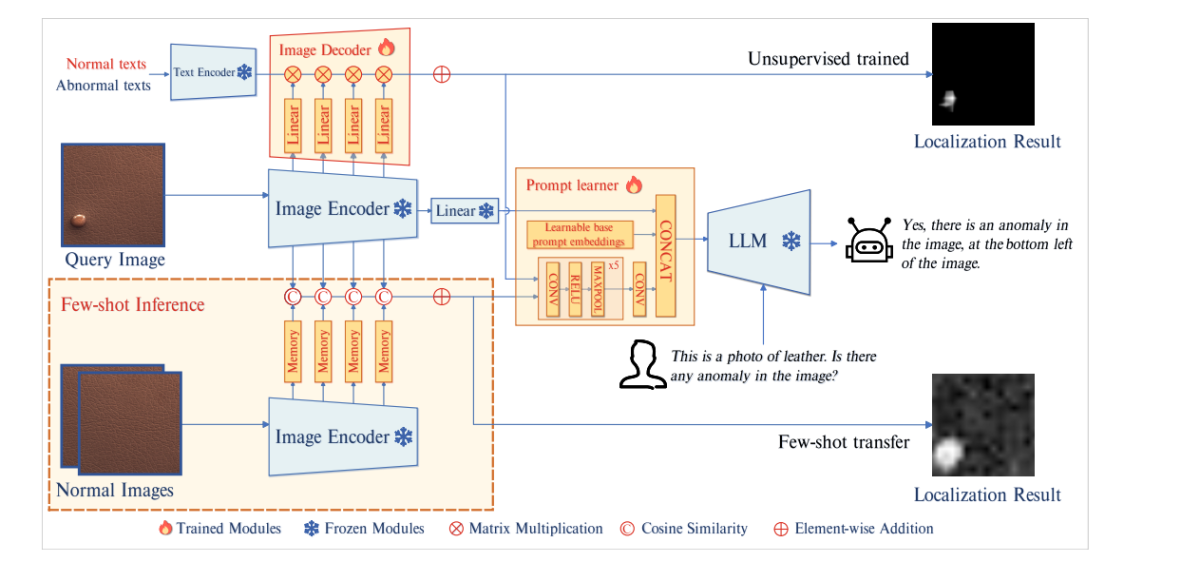

AnomalyGPT ist im Kern ein neues konversationales IAD-Großvisionssprachmodell, das primär für die Erkennung von industriellen Anomalien und die Lokalisierung ihrer genauen Position mithilfe von Bildern konzipiert ist. Das AnomalyGPT-Framework verwendet ein LLM und einen vorgefertigten Bildencoder, um Bilder mit ihren entsprechenden textlichen Beschreibungen unter Verwendung von stimulierten Anomaliedaten auszurichten. Das Modell führt ein Dekodiermodul und ein Prompt-Lernmodul ein, um die Leistung von IAD-Systemen zu verbessern und pixelgenaue Lokalisierungsergebnisse zu erzielen.

Modellarchitektur

Das obige Bild zeigt die Architektur von AnomalyGPT. Das Modell gibt das Abfragebild zunächst an den gefrorenen Bildencoder aus. Das Modell extrahiert dann patchbasierte Features aus den Zwischenlagen und gibt diese an einen Bilddecoder aus, um ihre Ähnlichkeit mit anormalen und normalen Texten zu berechnen und so die Ergebnisse für die Lokalisierung zu erhalten. Der Prompt-Learner wandelt diese dann in Prompt-Embeddings um, die als Eingaben in das LLM neben den Benutzertexteingaben geeignet sind. Das LLM-Modell nutzt dann die Prompt-Embeddings, Bild-Eingaben und Benutzertexteingaben, um Anomalien zu erkennen, ihre Position zu bestimmen und Endantworten für den Benutzer zu erstellen.

Dekoder

Um eine pixelgenaue Anomalie-Lokalisierung zu erreichen, setzt das AnomalyGPT-Modell einen leichten feature-basierten Bilddecoder ein, der sowohl few-shot-IAD-Frameworks als auch unsupervised-IAD-Frameworks unterstützt. Das Design des Decoders, der in AnomalyGPT verwendet wird, ist von den WinCLIP-, PatchCore- und APRIL-GAN-Frameworks inspiriert. Das Modell unterteilt den Bildencoder in 4 Stufen und extrahiert die Zwischenfeatures aus jeder Stufe.

Allerdings wurden diese Zwischenfeatures noch nicht durch die endgültige Bild-Text-Ausrichtung geführt, weshalb sie nicht direkt mit Features verglichen werden können. Um dieses Problem zu lösen, führt das AnomalyGPT-Modell zusätzliche Schichten ein, um die Zwischenfeatures zu projizieren und sie mit Textfeatures auszurichten, die normale und anormale Semantik repräsentieren.

Prompt-Learner

Das AnomalyGPT-Framework führt einen Prompt-Learner ein, der versucht, das Lokalisierungsergebnis in Prompt-Embeddings umzuwandeln, um feingranulare Semantik aus Bildern zu nutzen und auch die semantische Konsistenz zwischen den Dekoder- und LLM-Ausgaben aufrechtzuerhalten. Darüber hinaus integriert das Modell lernbare Prompt-Embeddings, die nicht mit den Dekoder-Ausgaben verbunden sind, in den Prompt-Learner, um zusätzliche Informationen für die IAD-Aufgabe bereitzustellen. Schließlich gibt das Modell die Embeddings und die ursprünglichen Bildinformationen an das LLM aus.

Der Prompt-Learner besteht aus lernbaren Basis-Prompt-Embeddings und einem konvolutiven neuronalen Netzwerk. Das Netzwerk wandelt das Lokalisierungsergebnis in Prompt-Embeddings um und bildet eine Menge von Prompt-Embeddings, die dann mit den Bild-Embeddings in das LLM kombiniert werden.

Anomalie-Simulation

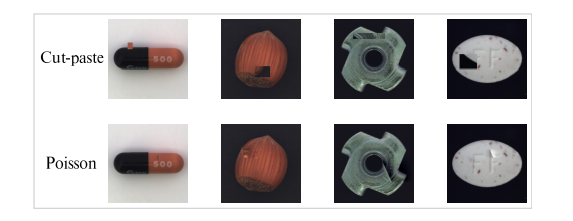

Das AnomalyGPT-Modell verwendet die NSA-Methode, um anormale Daten zu simulieren. Die NSA-Methode verwendet die Cut-paste-Technik mit der Poisson-Bildbearbeitungsmethode, um die durch das Einsetzen von Bildsegmenten eingeführte Unstetigkeit zu mildern. Cut-paste ist eine häufig verwendete Technik in IAD-Frameworks, um simulierte Anomalie-Bilder zu generieren.

Die Cut-paste-Methode beinhaltet das Zuschneiden einer Blockregion aus einem Bild und das Einsetzen in eine zufällige Position in einem anderen Bild, wodurch ein Teil eines simulierte Anomalie entsteht. Diese simulierte Anomalieproben können die Leistung von IAD-Modellen verbessern, aber es gibt einen Nachteil, da sie oft auffällige Unstetigkeiten erzeugen. Die Poisson-Bearbeitungsmethode zielt darauf ab, ein Objekt aus einem Bild in ein anderes Bild nahtlos zu klonen, indem sie die Poisson-Teil differentialgleichungen löst.

Das obige Bild zeigt den Vergleich zwischen Poisson und Cut-paste-Bildbearbeitung. Wie man sehen kann, gibt es sichtbare Unstetigkeiten in der Cut-paste-Methode, während die Ergebnisse der Poisson-Bearbeitung natürlicher erscheinen.

Fragen- und Antwort-Inhalt

Um eine Prompt-Tuning auf dem Large Vision Language Model durchzuführen, generiert das AnomalyGPT-Modell eine entsprechende textliche Abfrage auf der Grundlage des Anomalie-Bildes. Jede Abfrage besteht aus zwei Hauptkomponenten. Der erste Teil der Abfrage besteht aus einer Beschreibung des Eingabebildes, die Informationen über die im Bild vorhandenen Objekte und ihre erwarteten Attribute bereitstellt. Der zweite Teil der Abfrage besteht darin, die Anwesenheit von Anomalien innerhalb des Objekts oder die Überprüfung, ob es eine Anomalie im Bild gibt.

Das LVLM antwortet zunächst auf die Abfrage, ob es eine Anomalie im Bild gibt? Wenn das Modell Anomalien erkennt, gibt es die Position und die Anzahl der anormalen Bereiche an. Das Modell teilt das Bild in ein 3×3-Raster aus unterschiedlichen Regionen auf, um es dem LVLM zu ermöglichen, die Position der Anomalien verbal anzugeben, wie in der folgenden Abbildung gezeigt.

Das LVLM-Modell erhält die beschreibenden Kenntnisse des Eingabebildes mit grundlegenden Kenntnissen des Eingabebildes, die die Verständlichkeit des Modells für Bildkomponenten verbessern.

Datensätze und Bewertungsmetriken

Das Modell führt seine Experimente hauptsächlich auf den VisA- und MVTec-AD-Datensätzen durch. Der MVTec-AD-Datensatz umfasst 3629 Bilder für Trainingszwecke und 1725 Bilder für Tests, die auf 15 verschiedene Kategorien aufgeteilt sind, was ihn zu einem der beliebtesten Datensätze für IAD-Frameworks macht. Die Trainingsbilder enthalten nur normale Bilder, während die Testbilder sowohl normale als auch anormale Bilder enthalten. Andererseits umfasst der VisA-Datensatz 9621 normale Bilder und etwa 1200 anormale Bilder, die auf 12 verschiedene Kategorien aufgeteilt sind.

Weiterhin, wie bei bestehenden IAD-Frameworks, verwendet das AnomalyGPT-Modell die AUC oder die Fläche unter der Receiver-Operating-Characteristics-Kurve als Bewertungsmetrik, wobei die pixelgenaue und bildbasierte AUC verwendet wird, um die Anomalie-Lokalisierungsleistung und die Anomalie-Erkennung zu bewerten. Allerdings verwendet das Modell auch die bildbasierte Genauigkeit, um die Leistung des vorgeschlagenen Ansatzes zu bewerten, da es einzigartig ermöglicht, die Anwesenheit von Anomalien ohne die Notwendigkeit manueller Schwellenwerteinstellungen zu bestimmen.

Ergebnisse

Quantitative Ergebnisse

Few-Shot-Industrielle Anomalieerkennung

Das AnomalyGPT-Modell vergleicht seine Ergebnisse mit vorherigen few-shot-IAD-Frameworks, einschließlich PaDiM, SPADE, WinCLIP und PatchCore als Baseline.

Das obige Bild vergleicht die Ergebnisse des AnomalyGPT-Modells mit few-shot-IAD-Frameworks. Über beide Datensätze hinweg übertrifft die Methode, die von AnomalyGPT verfolgt wird, die Ansätze, die von vorherigen Modellen verfolgt werden, in Bezug auf die bildbasierte AUC und liefert auch eine gute Genauigkeit.

Unsupervised-Industrielle Anomalieerkennung

In einer unsupervised-Trainingsumgebung mit einer großen Anzahl von Normalproben trainiert AnomalyGPT ein einzelnes Modell auf Proben, die aus allen Klassen innerhalb eines Datensatzes stammen. Die Entwickler von AnomalyGPT haben sich für das UniAD-Framework entschieden, da es unter der gleichen Einrichtung trainiert wird und als Baseline für den Vergleich dienen wird. Darüber hinaus vergleicht das Modell auch mit JNLD- und PaDim-Frameworks unter der gleichen einheitlichen Einrichtung.

Das obige Bild vergleicht die Leistung von AnomalyGPT im Vergleich zu anderen Frameworks.

Qualitative Ergebnisse

Das obige Bild zeigt die Leistung des AnomalyGPT-Modells bei der unsupervised-Anomalieerkennung, während die folgende Abbildung die Leistung des Modells bei der 1-Shot-in-Context-Lernmethode zeigt.

Das AnomalyGPT-Modell ist in der Lage, die Anwesenheit von Anomalien anzuzeigen, ihre Position zu markieren und pixelgenaue Lokalisierungsergebnisse bereitzustellen. Wenn das Modell in der 1-Shot-in-Context-Lernmethode ist, ist die Lokalisierungsleistung des Modells slightly niedriger im Vergleich zur unsupervised-Lernmethode aufgrund des Fehlens von Training.

Schlussfolgerung

AnomalyGPT ist ein neues konversationales IAD-Großvisionssprachmodell, das darauf ausgelegt ist, die leistungsstarken Fähigkeiten von Large Vision Language Models zu nutzen. Es kann nicht nur Anomalien in einem Bild erkennen, sondern auch ihre genaue Position bestimmen. Darüber hinaus ermöglicht AnomalyGPT mehrstufige Dialoge, die auf die Anomalieerkennung fokussiert sind, und zeigt eine hervorragende Leistung bei der few-shot-in-Context-Lernmethode. AnomalyGPT erforscht die potenziellen Anwendungen von LVLMs in der Anomalieerkennung und stellt neue Ideen und Möglichkeiten für die IAD-Industrie vor.