Andersons Blickwinkel

KI würde lieber das Buch lesen als den Film ansehen

Es ist erstaunlich schwer, KI-Modelle dazu zu bringen, tatsächlich Videoinhalte anzusehen und zu kommentieren, auch wenn sie für diese Aufgabe entwickelt wurden. Sie sind mehr an dem geschriebenen Wort interessiert.

Wenn Sie jemals versucht haben, ein kleines Video zu ChatGPT oder einem ähnlichen beliebten Vision-/Sprachmodell hochzuladen, haben Sie vielleicht festgestellt, dass sie tatsächlich kein Video parsen können. Während Modelle wie ChatGPT-4o+ in der Lage sind, einzelne Frames zu analysieren – in Form von Bildern, wie JPEG und PNG – bevorzugen sie es, wenn der Benutzer seine eigenen Frames extrahiert und als Bilder hochlädt (die sie bereit sind zu kommentieren).

Im Falle der OpenAI-GPT-Serie kann man, eher mühsam, eine komplette Folge von Frames aus einem Videoclip extrahieren und sie an ChatGPT für Zwecke wie das Erstellen einer von der KI erstellten Erzählspur für das Video übergeben:

![Bilder und Code aus einem OpenAI-Tutorial zum Parsen mehrerer extrahierter Frames zum Zweck der Entwicklung einer von der KI generierten Kommentierung für einen Videoclip. [ Quelle ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Bilder und Code aus einem OpenAI-Tutorial zum Parsen mehrerer extrahierter Frames zum Zweck der Entwicklung einer von der KI generierten Kommentierung für einen Videoclip. Quelle

Aber es obliegt dem Benutzer, die Umwandlung von Video in Frames vorzunehmen, entweder durch Aufrufen von Funktionen in einer größeren Routine, wie im obigen Beispiel, oder durch Extrahieren der Frames mit FFMPEG oder verschiedenen kostenlosen und kostenpflichtigen Video-Editierlösungen.

In gewissem Maße, vielleicht sogar in großem Maße, hängen die Einschränkungen der Videoanalyse in groß angelegten Produkten wie ChatGPT von der Ressourcennutzung ab: Nur ein einzelnes KI-Modell mit einer Auswahl der beliebtesten Video-Codecs auszustatten und Rechenressourcen für den diskenintensiven und cpu-intensiven Prozess der Extraktion zu bereitstellen, ist keine geringe Überlegung, sollte sich herausstellen, dass Hunderte von Millionen von Benutzern beschließen, diese Einrichtungen jeden Tag zu nutzen.

Darüber hinaus kann die temporale Analyse ein ganz anderes Bild malen als ein einzelner Frame (stellt sich vor, jemand betritt ein Haus in guter Stimmung und entdeckt dann eine Leiche); daher ist es eine anspruchsvolle und ressourcenintensive Aufgabe, die gesamte temporale “Prüfsumme” eines kurzen Videoclips zu berücksichtigen – sowie ein spezialisierter Bereich der Forschungsliteratur, zum Beispiel mit der laufenden Entwicklung von Frameworks wie Optical Flow – das im Wesentlichen eine Länge von Video so “entfaltet”, dass es wie ein statisches Dokument behandelt und darauf reagiert werden kann:

![Optische Flussdiagramme zeigen, wie die Bewegung über Frames in einer Videosequenz verfolgt wird, wobei grüne Vektoren Richtung und Intensität der Bewegung anzeigen. Diese Zuordnungen bieten die erforderliche zeitliche Kontinuität für VLMs und können auch als strukturelle Leitfäden in VFX-Workflows dienen. [ Quelle ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optische Flussdiagramme zeigen, wie die Bewegung über Frames in einer Videosequenz verfolgt wird, wobei grüne Vektoren Richtung und Intensität der Bewegung anzeigen. Diese Zuordnungen bieten die erforderliche zeitliche Kontinuität für VLMs und können auch als strukturelle Leitfäden in VFX-Workflows dienen. Quelle

Die Kliffs-Notizen akzeptieren

Trotzdem, da Modelle wie Google’s Notebook LM und die neueren ChatGPT-Einträge in der Lage sind, zugehörige Metadaten (d. h. in den Video eingebettete Textinhalte, die den Video in irgendeiner Weise kontextualisieren) zu lesen, verbieten sie nicht die Hochladung von Video-Dateien; und manchmal werden sie sogar versuchen, ein Video zu interpretieren, das keine solchen Daten enthält.

In dem folgenden Fall habe ich einen 6-Sekunden-Clip aus dem italienischen Film Die Hand Gottes (2021) zu NotebookLM hochgeladen, wobei ich sicherstellte, dass der Clip null nützlichen Text enthielt, entweder in Metadaten oder im Dateinamen.

NotebookLM begann dann, ausführlich Material zu halluzinieren, das nichts mit dem Video zu tun hatte*, zusammen mit einem unsinnigen und nicht damit zusammenhängenden fünfminütigen Gespräch:

Ein alltäglicher Moment in einem 6-Sekunden-Clip aus einem italienischen Film wird von NotebookLM wild falsch interpretiert. Quelle: Google NotebookLM

Obwohl Notebook, wie ChatGPT, ein YouTube-Video als Eingabe akzeptiert, tut es dies nur, wenn das Video eine interpretierbare Textschicht-Anmerkung und/oder Untertitel (nicht gerasterte Untertitel, die in das Video eingebrennt sind) enthält.

Auf diese Weise ist die harte Arbeit, tatsächlich hinzusehen und das Inhalts des Videos zu hören und semantische Interpretation davon vorzunehmen (eine rechtliche Notwendigkeit für YouTube, aufgrund seiner Urheberrechtsmaßnahmen, und seinem bevorstehenden Identitätsschutzsystem), nach dem Benutzer-Upload, und wenn und wenn der Clip die erforderlichen Verarbeitungsressourcen zugewiesen werden kann.

Die tatsächliche Video-Interpretation ist teuer und anstrengend, und es stellt sich heraus, dass sogar Modelle, die speziell für diese Aufgabe trainiert wurden, lieber Text lesen als tatsächlich Video ansehen.

TL;DW

Dies, gemäß einem neuen Papier von der britischen University of Bristol, mit dem Titel Ein Video ist nicht tausend Wörter wert, in dem die beiden Autoren zu dem Schluss kommen, dass aktuelle State-of-the-Art-Vision-Language-Modelle (VLMs) – Modelle, die speziell dafür entwickelt wurden, Video in einer anstrengenderen Weise zu analysieren und an Video-Fragenbeantwortung (VQA) teilzunehmen – auch auf Text-basierte Informationen zurückgreifen, wann immer es möglich ist.

Wenn ihnen sowohl bewegte Bilder als auch geschriebene Fragen und Multiple-Choice-Antworten präsentiert werden, fanden die Autoren des Papiers heraus, dass Modelle ihre Auswahlmöglichkeiten normalerweise auf Mustern im Text basieren, anstatt auf etwas, das auf dem Bildschirm passiert – in vielen Fällen sogar dann, wenn die Frage ganz entfernt wurde.

In dem, was anscheinend eine gewohnheitsmäßige Form von Abkürzungen oder Betrug ist, ist es am wichtigsten für die meisten Modelle, Muster in den möglichen Antworten zu erkennen; erst wenn die Aufgabe durch Hinzufügen mehrerer Antwortmöglichkeiten erschwert wurde, begannen die KIs, dem Video mehr Aufmerksamkeit zu schenken.

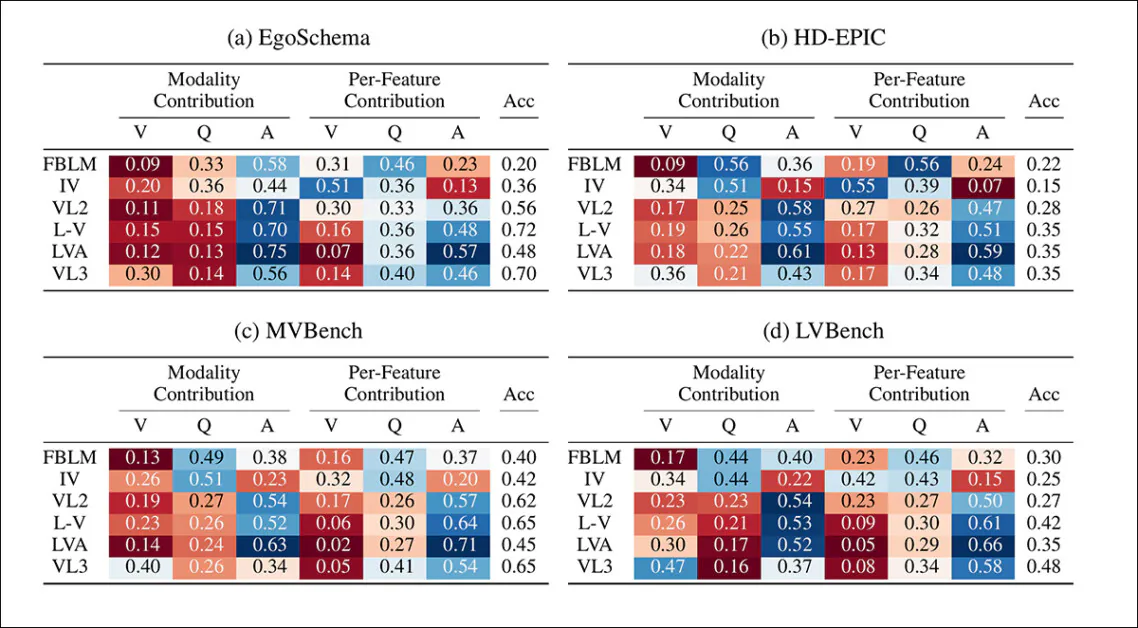

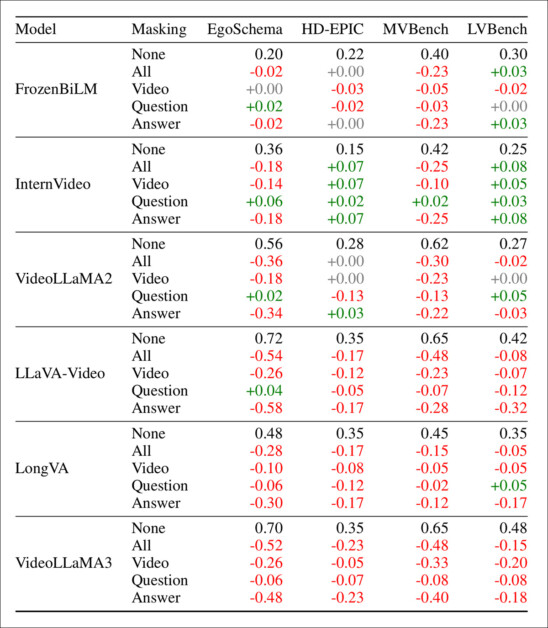

Die Autoren führten VQA-Tests unter verschiedenen Bedingungen mit sechs VLM-Modellen mit unterschiedlichen Kontextlängen durch, auf vier geeigneten Datensätzen; und fanden heraus, dass die Ergebnisse auf die Abhängigkeit der Modelle von Text anstelle von Video-Inhalten hinwiesen.

![Beispiel aus der Studie, das zeigt, wie ein Videoanalyse-Modell das Gesehene gegen das Gelesene abwägt. Der Clip zeigt eine Person, die Bambus webt, doch das Modell ordnet viel mehr Bedeutung dem geschriebenen Text zu als den Video-Frames selbst. Blaue Hervorhebungen markieren Elemente, die die gewählte Antwort unterstützen, während rote Hervorhebungen diejenigen markieren, die in die entgegengesetzte Richtung ziehen, was zeigt, wie das Modell seine Argumentation auf den Text und nicht auf die bewegten Bilder konzentriert. [Quelle] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Beispiel aus der Studie, das zeigt, wie ein Videoanalyse-Modell das Gesehene gegen das Gelesene abwägt. Der Clip zeigt eine Person, die Bambus webt, doch das Modell ordnet viel mehr Bedeutung dem geschriebenen Text zu als den Video-Frames selbst. Blaue Hervorhebungen markieren Elemente, die die gewählte Antwort unterstützen, während rote Hervorhebungen diejenigen markieren, die in die entgegengesetzte Richtung ziehen, was zeigt, wie das Modell seine Argumentation auf den Text und nicht auf die bewegten Bilder konzentriert. Quelle

Methode

Um zu verstehen, wie viel jeder Eingabe zur Entscheidung des Modells beiträgt, verwendet die neue Arbeit eine Methode aus Spieltheorie namens Shapley-Werte. Ursprünglich entwickelt, um eine Auszahlung unter Spielern in einer Koalition gerecht aufzuteilen, ordnen Shapley-Werte jedem “Spieler” einen Kredit basierend auf seinem individuellen Einfluss zu.

Effektiv sind die Spieler in diesem Szenario entweder die Video-Frames oder die Text-Komponenten (Anmerkungen, Untertitel, Kapitel usw.) einer VQA-Aufgabe; und die “Auszahlung” ist die endgültige Antwort des Modells. Durch systematisches Testen, was passiert, wenn jeder Teil hinzugefügt oder entfernt wird, zeigt die Technik, wie wichtig jedes Element für die gewählte Antwort war.

Im Falle der neuen Arbeit wurden Shapley-Werte angepasst, um gemischte Modalitäten zu handhaben, wobei Video- und Text-Komponenten getrennt behandelt und ihre unterschiedlichen Einflüsse auf die Modell-Ausgaben gemessen wurden, um zu zeigen, ob der Video-Inhalt tatsächlich interpretiert wurde oder ob geschriebene Hinweise als Abkürzungen verwendet wurden.

Metriken

Zwei einfache Metriken wurden definiert, um zu vergleichen, wie viel jeder Modus (d. h. Video, Frage oder Antwort) zur Entscheidung des Modells beiträgt: Modus-Beitrag misst, wie viel des gesamten Erklärungswerts von jedem Eingabetyp kommt; hier werden alle verfügbaren Shapley-Werte summiert und der Anteil, der jedem Modus zugeordnet wird, als Prozentsatz des Gesamtwerts berechnet.

Zweitens korrigiert Pro-Feature-Beitrag die Tatsache, dass einige Modalitäten, wie Video, viele mehr Funktionen enthalten als andere. Stattdessen wird der Durchschnittswert von Shapley für jede Funktion berechnet und diese Durchschnittswerte verglichen, um zu bestimmen, welche Modus-Beiträge dominant sind.

Daten und Tests

Die Autoren testeten den Ansatz auf sechs VLMs mit verschiedenen Merkmalen, die entwickelt wurden, um sicherzustellen, dass die Prinzipien der Tests allgemein anwendbar und verallgemeinerbar sind. Daher wurden die Modelle für unterschiedliche Kontextlängen, unterschiedliche Alter (d. h. wie lange seit der Veröffentlichung des Frameworks) und unterschiedliche Architekturkonfigurationen ausgewählt.

Die Kandidaten waren FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (das Qwen2 nutzt); und LongVA (auch mit Qwen2).

Mit dem gleichen Ziel der Vielfalt wurden die vier Ziel-Datensätze EgoSchema, ein VQA-Datensatz, der so konzipiert ist, dass er ohne vollständiges Ansehen der zugehörigen Videos nicht abgeschlossen werden kann; HD-EPIC, ein auf die Küche fokussierter Datensatz mit einigen ungewöhnlich langen Videos; MVBench, eine kuratierte Sammlung von Beiträgen aus anderen Datensätzen; und LVBench, der VQA-Abfragen für sehr lange Videos stellt.

Von diesen wurden die Autoren 60 Fragen – zehn von jeder Frageart – entwickelt.

Die Beitrag-Metriken machten klar, dass die meisten Modelle weniger auf das Video als auf den Text angewiesen waren, insbesondere wenn sie Frame für Frame beurteilt wurden. Selbst wenn das Video in der Gesamtbilanz eine vernünftige Leistung zeigte, war sein pro-Feature-Einfluss oft minimal, was darauf hindeutet, dass das Modell das Video insgesamt nutzen mochte, aber einzelne Frames wenig beachtete. VideoLLaMA3 war der Haupt-Ausreißer hier, mit einer stärkeren visuellen Abhängigkeit, insbesondere in den längeren Sequenzen in LVBench:

Modus-Beitrag (MC) und Pro-Feature-Beitrag (PFC) -Werte über Modelle und Datensätze, die das relative Gewicht von Video (V), Frage (Q) und Antwort (A) -Eingaben zeigen. Kühle Farben zeigen stärkere Beiträge; wärmere Farben zeigen schwächere oder vernachlässigbare Einflüsse. Über die meisten Einstellungen hinweg ist Sprache deutlich dominant, wobei Video oft zurückgestellt wird – insbesondere bei pro-Frame-Einfluss.

Wie die Antwort zeigt, hängen die Modelle viel stärker von der Sprache ab als von visuellen Hinweisen. Selbst wenn das Video verwendet wird, ist der Beitrag dünn über viele Frames verteilt, oft ohne konsistentes Muster.

Unten sehen wir ein annotiertes Beispiel aus EgoSchema. Die 16 wichtigsten Frames wurden mit Shapley-Werten ausgewählt und entsprechend ihrer Bedeutung gefärbt, wobei Blau einen positiven Beitrag und Rot einen negativen Beitrag anzeigt:

Shapley-Attributionen für ein einzelnes EgoSchema-Beispiel, das die 16 einflussreichsten Frames und alle Text-Eingaben zeigt. Video-Beiträge sind minimal im Vergleich zu Text, der die Argumentation des Modells dominiert. Blaue und rote Hervorhebungen zeigen positive und negative Einflüsse auf die gewählte Antwort.

Schlussfolgerung

Jeder, der jemals mit Video-Bearbeitung oder Video-Analyse experimentiert hat, weiß bereits, wie ressourcenintensiv diese Prozesse sind, und versteht, warum Unternehmen, die Millionen von KI-basierten Anfragen pro Tag parsen, es sich nicht leisten können, ad hoc Video-Editier- und Interpretierprozesse von Benutzern auszuführen.

Eines der wichtigsten Dinge, die man in diesem Zusammenhang beachten muss, ist, dass fast jede API-KI-Schnittstelle, die Sie jemals ausprobieren (mit der möglichen Ausnahme eines brandneuen und kurzlebigen Demos im Rahmen neuer wissenschaftlicher Forschung), darauf abzielt, die Wünsche der Benutzer auf dem niedrigsten möglichen Ressourcenaufwand zu erfüllen.

Das bedeutet, auf vorhandene Metadaten aus Benutzerdaten oder RAG-Abrufen zurückzugreifen, wenn möglich; und Metadaten für besser parsbare Formate wie PDF, Dokumente und einzelne Bilder zu extrahieren.

Was nicht auf dem Tisch liegt, ist das Durchlaufen des hochgeladenen Videos mit CLIP oder der neuesten YOLO-Version oder durch jedes ressourcenintensive VLM, das tatsächlich identifizieren kann, was in den Frames ist, und was im bereitgestellten Video passiert, unter Berücksichtigung der Temporalität.

Jedoch bedeutet dies nicht, dass die Phänomene, die das aktuelle Papier dokumentiert, notwendigerweise aus sparsamen architektonischen Ansätzen resultieren. Die Autoren bemerken, dass Text die State-of-the-Art-Multimodal-Trainingsparadigmen in jedem Fall dominiert, was darauf hindeutet, dass “visuelle Sprache” entweder weniger entwickelt, weniger wichtig oder informativ innerhalb eines multimodalen Kontexts ist oder (zumindest im Moment) weniger gut verstanden wird,

* Interessanterweise scheint das Material, das NotebookLM erstellt hat, entweder vollständig original oder völlig unindexiert von Google zu sein, da ich keine Web-Ergebnisse finden kann, die in die Trainingsdaten eingeschleust und diese Ausgabe ausgelöst haben könnten.

Erstveröffentlicht am Freitag, 31. Oktober 2025; bearbeitet 14:20 für die Formatierung