Andersons Blickwinkel

Die KI würde lieber das Buch lesen als den Film ansehen.

Es ist erstaunlich schwierig, KI-Modelle dazu zu bringen, Videoinhalte anzusehen und zu kommentieren, selbst wenn sie genau für diese Aufgabe entwickelt wurden. Sie interessieren sich mehr für das geschriebene Wort.

Wenn Sie jemals versucht haben, einen kurzen Videoclip auf ChatGPT oder ein ähnliches, weit verbreitetes Bild-/Sprachmodell hochzuladen, waren Sie vielleicht überrascht festzustellen, dass diese Modelle Videos nicht direkt analysieren können. Zwar können Modelle wie ChatGPT-4o+ einzelne Frames – in Form von Bildern wie JPEG und PNG – analysieren, sie bevorzugen es jedoch, wenn der Benutzer die Frames selbst extrahiert und als Bilder hochlädt. Diese (bereit, dazu Stellung zu nehmen).

Im Falle der OpenAI GPT-Serie kann man, wenn auch recht mühsam, eine komplette Sequenz von Einzelbildern aus einem Videoclip extrahieren und diese an ChatGPT übergeben, beispielsweise für folgende Zwecke: Erzeugung ein KI-generierter Erzählton für das Video:

![Bilder und Code aus einem OpenAI-Tutorial zur Analyse mehrerer extrahierter Frames für die Entwicklung eines KI-generierten Kommentars zu einem Videoclip. [Quelle] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Bilder und Code aus einem OpenAI-Tutorial zum Parsen mehrerer extrahierter Frames zum Zweck der Entwicklung eines KI-generierten Kommentars für einen Videoclip. Quelle

Die Umwandlung von Video in Einzelbilder obliegt jedoch dem Benutzer, entweder durch Aufruf von Funktionen in einer größeren Routine, wie im obigen Beispiel, oder durch Extrahieren der Einzelbilder mit FFMPEG oder verschiedenen kostenlosen und kostenpflichtigen Videobearbeitungsprogrammen.

Zum Teil, vielleicht sogar zum größten Teil, hängen die Einschränkungen der Videoanalyse in hochskalierten Produkten wie ChatGPT davon ab, Ressourcenverwendung: nur Werkzeug dank One Eine KI-Instanz mit einer Auswahl der beliebtesten Videocodecs und die Bereitstellung von Rechenressourcen für den datenträgerintensiven und die CPU drosselnden Extraktionsprozess sind keine zu vernachlässigende Überlegung, sollten Hunderte von Millionen von Nutzern beschließen, diese Einrichtungen täglich zu nutzen.

Darüber hinaus kann eine zeitliche Analyse durchgeführt werden. ein ganz anderes Bild zeichnen als ein einzelnes Bild (stellen Sie sich vor, jemand betritt gut gelaunt ein Haus und entdeckt dann eine Leiche); daher ist die Berücksichtigung der gesamten zeitlichen „Prüfsumme“ selbst eines kurzen Videoclips eine anspruchsvolle und ressourcenintensive Aufgabe – und zugleich ein spezialisiertes Forschungsgebiet, beispielsweise mit der laufenden Entwicklung von Frameworks wie … Optischer Fluss – wodurch im Wesentlichen ein Videoabschnitt „entfaltet“ wird, sodass er wie ein statisches Dokument betrachtet und entsprechend gehandelt werden kann:

![Optische Flussdiagramme veranschaulichen, wie Bewegungen in einer Videosequenz über mehrere Frames hinweg verfolgt werden. Grüne Vektoren zeigen dabei Bewegungsrichtung und -intensität an. Diese Darstellungen gewährleisten die für VLMs (Video-Loop-Modelle) notwendige zeitliche Kontinuität und dienen zudem als Strukturhilfe in VFX-Workflows. [Quelle] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optische Flussdiagramme veranschaulichen, wie Bewegungen in einer Videosequenz über mehrere Einzelbilder hinweg verfolgt werden. Grüne Vektoren zeigen dabei Bewegungsrichtung und -intensität an. Diese Abbildungen gewährleisten die für Video-Loop-Modelle (VLMs) notwendige zeitliche Kontinuität und können auch als strukturelle Orientierungshilfe in VFX-Workflows dienen.. Quelle

Sich mit den Cliff's Notes zufriedengeben

Dennoch, da Modelle wie Googles LM-Notizbücher Und da die neueren ChatGPT-Einträge in der Lage sind, zugehörige Metadaten zu lesen (d. h. eingebettete Textinhalte, die das Video in irgendeiner Weise kontextualisieren), verbieten sie keine Video-Uploads; und manchmal versuchen sie sogar, ein Video zu interpretieren, das keine solchen Daten enthält.

Im folgenden Fall habe ich einen 6-sekündigen zufälligen Ausschnitt aus dem italienischen Film hochgeladen. Die Hand Gottes (2021) an NotebookLM, um sicherzustellen, dass der Clip weder in den Metadaten noch im Dateinamen nützlichen Text enthielt.

NotebookLM halluzinierte daraufhin aufwendig Material, das in keinerlei Zusammenhang mit dem Video stand*, inklusive eines sinnlosen und themenfremden fünfminütigen Podcasts, in dem er sich gegenseitig ansprach:

Ein alltäglicher Moment in einem sechssekündigen Ausschnitt aus einem italienischen Film wird von NotebookLM völlig falsch interpretiert. Quelle: Google NotebookLM

Notebook akzeptiert zwar, wie ChatGPT, YouTube-Videos als Eingabe, jedoch nur, wenn das Video über eine interpretierbare Text-Layer-Anmerkung und/oder Untertitel verfügt (nicht über gerasterte Untertitel, die in das Video eingebrannt sind).

Auf diese Weise wird die harte Arbeit von tatsächlich suchen das Ansehen und Anhören des Videoinhalts sowie die semantische Interpretation desselben (eine rechtliche Notwendigkeit für YouTube aufgrund seiner Maßnahmen zum Schutz des Urheberrechtsund dessen anhängiges IdentitätsschutzsystemDie Verarbeitung erfolgte nach dem Hochladen durch den Benutzer in Ruhe, sobald dem Clip die notwendigen Verarbeitungsressourcen zugewiesen werden konnten.

Die Interpretation von Videos in der Praxis ist teuer und anstrengend, und es hat sich herausgestellt, dass selbst Modelle, die speziell für diese Aufgabe trainiert wurden, lieber Text lesen, als sich tatsächlich Videos anzusehen.

TL;DR

Dies, so a neues Papier von der britischen Universität Bristol, mit dem Titel Ein Video sagt mehr als tausend Worte., wobei die beiden Autoren zu dem Schluss kommen, dass die derzeitigen hochmodernen Bild- und Sprachmodelle (VLMs) – Modelle, die speziell für eine aufwändigere Videoanalyse und die Teilnahme an … entwickelt wurden. Video-Fragebeantwortung (VQA) – greifen, wann immer möglich, standardmäßig auf textbasierte Informationen zurück.

Die Autoren der Studie stellten fest, dass die Modelle ihre Entscheidungen in der Regel auf Mustern im Text stützten, anstatt auf dem Geschehen auf dem Bildschirm – und in vielen Fällen schnitten sie genauso gut ab, selbst wenn die Frage … vollständig entfernt.

In einer scheinbar gewohnheitsmäßigen Form von Abkürzungen or BetrugFür die Mehrheit der Modelle war vor allem wichtig, Muster in den möglichen Antworten zu erkennen; erst als die Aufgabe schwieriger wurde, indem mehr Antwortmöglichkeiten hinzugefügt wurden, begannen die KIs, dem Video mehr Aufmerksamkeit zu schenken.

Die Autoren führten VQA-Tests unter verschiedenen Bedingungen an sechs VLM-Modellen mit unterschiedlichen Eigenschaften durch. Kontextlängen, anhand von vier geeigneten Datensätzen; und stellten fest, dass die Ergebnisse auf die Abhängigkeit der Modelle vom Textinhalt gegenüber dem Videoinhalt hinwiesen.

![Ein Beispiel aus der Studie zeigt, wie ein Videoanalysemodell visuelle und textliche Informationen gewichtet. Der Clip zeigt eine Person beim Bambusflechten. Das Modell misst dem schriftlichen Frage-Antwort-Text jedoch deutlich mehr Bedeutung bei als den Videobildern selbst. Blaue Markierungen kennzeichnen Elemente, die die gewählte Antwort stützen, rote Markierungen solche, die ihr widersprechen. Dies verdeutlicht, dass sich die Argumentation des Modells auf den Text und nicht auf die bewegten Bilder konzentriert. [Quelle] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Ein Beispiel aus der Studie zeigt, wie ein Videoanalysemodell visuelle und textliche Informationen gewichtet. Der Clip zeigt eine Person beim Bambusflechten, doch das Modell misst dem schriftlichen Frage-Antwort-Text deutlich mehr Bedeutung bei als den Videobildern selbst. Blaue Markierungen stützen die gewählte Antwort, rote Markierungen widersprechen ihr. Dies verdeutlicht, dass sich die Argumentation des Modells auf den Text und nicht auf die bewegten Bilder konzentriert. Quelle

Dem neuen Papier liegt ein GitHub-Repository mit Laufzeit und Daten.

Methodik

Um zu verstehen, wie stark die einzelnen Eingangsgrößen zur Entscheidung eines Modells beitragen, verwendet die neue Arbeit eine Methode von Spieltheorie namens Shapley-WerteUrsprünglich wurde das Shapley-System entwickelt, um eine Auszahlung gerecht unter den Spielern einer Koalition aufzuteilen. Es weist jedem „Spieler“ einen Anteil entsprechend seinem individuellen Einfluss zu.

Die Akteure in diesem Szenario sind also entweder die Videoframes oder die Textkomponenten (Anmerkungen, Untertitel, Bildunterschriften usw.) einer VQA-Aufgabe; und das Ergebnis ist die endgültige Antwort des Modells. Indem systematisch getestet wird, was passiert, wenn jedes Element hinzugefügt oder entfernt wird, zeigt die Technik, wie wichtig dieses Element für das Erreichen der gewählten Antwort war.

Im Falle des neuen Projekts wurden die Shapley-Werte so angepasst, dass sie mit gemischten Modalitäten umgehen können, um die Methode auf mehrere Datentypen auszudehnen. Dabei wurden Video- und Textkomponenten getrennt behandelt und ihr unterschiedlicher Einfluss auf die Ergebnisse der Modelle gemessen. So konnte festgestellt werden, ob der Videoinhalt tatsächlich interpretiert wurde oder ob schriftliche Hinweise als Abkürzungen verwendet wurden.

Metrik

Es wurden zwei einfache Kennzahlen definiert, um zu vergleichen, in welchem Maße die einzelnen Modalitäten (d. h. Video, Frage oder Antwort) zur Entscheidung des Modells beigetragen haben: Modalitätsbeitrag misst, wie viel der Gesamterklärung von jeder Art von Input stammt; hier werden alle verfügbaren Shapley-Werte summiert und der Anteil jeder Modalität als Prozentsatz des Gesamtwerts berechnet.

Zweitens Beitrag pro Funktion Dies berücksichtigt den Umstand, dass manche Modalitäten, wie beispielsweise Video, deutlich mehr Merkmale aufweisen als andere. Stattdessen wird für jedes Merkmal der durchschnittliche Shapley-Wert berechnet und diese Durchschnittswerte werden verglichen, um den dominanten Einfluss der jeweiligen Modalität zu ermitteln.

Daten und Tests

Die Autoren testeten den Ansatz an sechs VLMs mit verschiedenen Eigenschaften, um sicherzustellen, dass die Testprinzipien breit anwendbar und generalisierbar sind. Daher wurden die Modelle hinsichtlich Kontextlänge, Alter (d. h. seit der Veröffentlichung des Frameworks) und Architekturkonfiguration ausgewählt.

Die Teilnehmer waren Gefrorenes BiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (was nutzt Qwen2); und LongVA (auch unter Verwendung von Qwen2).

Mit dem gleichen Ziel der Vielfalt wurden die vier Zieldatensätze ausgewählt: EgoSchema, ein VQA-Datensatz, der so konzipiert ist, dass er ohne vollständiges Ansehen der zugehörigen Videos nicht vervollständigt werden kann; HD-EPISCH, ein auf die Küche fokussierter Datensatz mit einigen ungewöhnlich langen Videos; MVBench, eine kuratierte Zusammenstellung von Beiträgen aus anderen Datensätzen; und LVBench, was VQA-Anfragen für sehr lange Videos stellt.

Aus diesen entwickelten die Autoren 60 Fragen – zehn aus jedem Fragetypus.

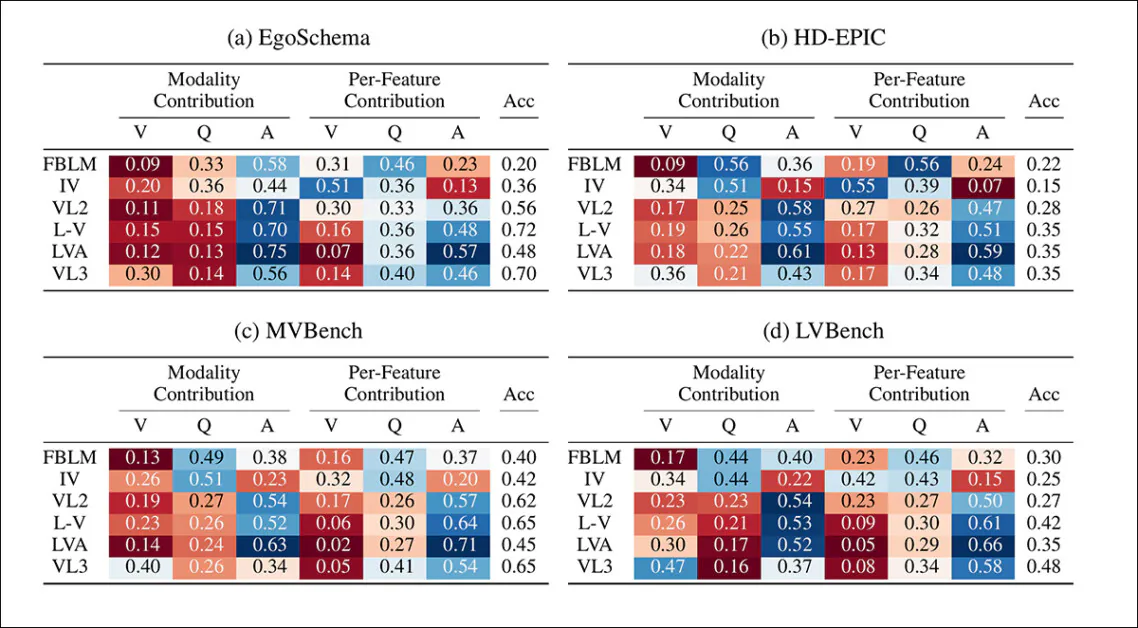

Die Beitragsmetriken machten deutlich, dass die meisten Modelle weniger auf das Video als auf den Text angewiesen waren, insbesondere bei einer Betrachtung der einzelnen Frames. Selbst wenn das Video insgesamt einen zufriedenstellenden Beitrag leistete, war sein Einfluss auf die einzelnen Merkmale oft minimal. Dies deutet darauf hin, dass das Modell zwar das Video in seiner Gesamtheit nutzte, den einzelnen Frames aber wenig Beachtung schenkte. VideoLLaMA3 bildete hier die größte Ausnahme mit einer stärkeren visuellen Abhängigkeit, insbesondere bei den längeren Sequenzen in LVBench.

Die Werte für den Modalitätsbeitrag (MC) und den Beitrag pro Merkmal (PFC) über verschiedene Modelle und Datensätze hinweg zeigen die relative Gewichtung von Video (V), Frage (Q) und Antwort (A). Kühlere Farben deuten auf einen stärkeren Beitrag hin, wärmere Farben auf einen schwächeren oder vernachlässigbaren Einfluss. In den meisten Kontexten ist Sprache deutlich dominant, während Video – insbesondere hinsichtlich des Einflusses pro Einzelbild – oft eine untergeordnete Rolle spielt.

Was den Text betrifft, so war die Frage tendenziell wichtiger als die Antwort, insbesondere in stärkeren Modellen. Dies zeigte sich am deutlichsten in Datensätzen wie EgoSchema, wo die Fragen länger und natürlicher, die Antworten hingegen kurz und mitunter schematisch waren. MVBench kehrte dies teilweise um, da seine binäre Antwortstruktur die scheinbare Bedeutung der Antworttoken erhöht.

Bei allen Modellen und Datensätzen wurde die visuelle Wahrnehmung jedoch konsequent vernachlässigt, während die Sprache den größten Teil der Arbeit übernahm.

Das Papier sagt:

Bei Modellen mit langem Kontext zeigt Video einen deutlich reduzierten Beitrag, was bedeutet, dass die Shapley-Werte pro Frame viel kleiner sind als ihre Textmerkmal-Pendants.

„Video als gesamte Modalität ist eindeutig nach wie vor hochrelevant, aber dies ist ein Beleg dafür, dass die Shapley-Werte seiner einzelnen Frames eher um Null zentriert sind und dass die Aufmerksamkeit des Modells auf diese Frames viel weniger gelenkt ist als auf den Text.“

Um zu testen, wie jeder Teil der Eingabe (Video, Text usw.) zur Modellgenauigkeit beiträgt, führten die Forscher zusätzliche Tests durch. Maskierung – absichtlich einen oder mehrere Teile der Eingabedaten auszublenden und zu beobachten, wie sich dadurch die Genauigkeit des Modells verändert.

Wenn die Leistung stark abfällt, sobald eine bestimmte Eingabe entfernt wird, ist diese Eingabe wahrscheinlich wichtig; wenn das Modell hingegen in etwa gleich gut abschneidet, deutet dies darauf hin, dass die fehlende Eingabe nicht stark genutzt wurde. In diesem Sinne sind Maskierungstests eine Art iteratives Verfahren. Ablationsstudie.

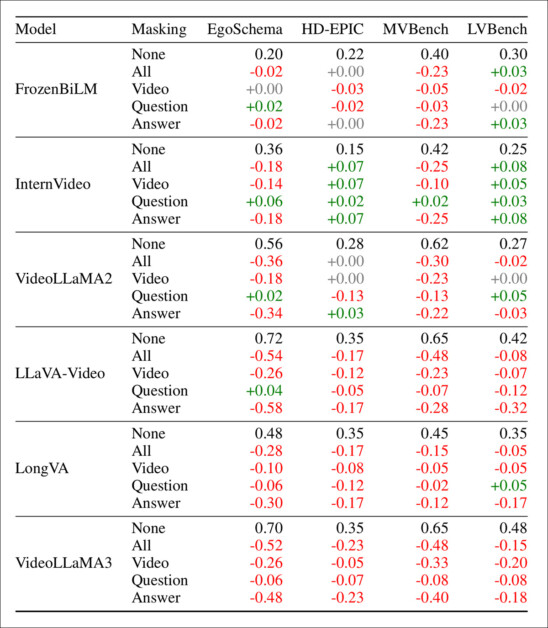

Auswirkungen der Maskierung von Video-, Frage- oder Antworteingaben auf die Leistung in vier VQA-Benchmarks. Die Ergebnisse zeigen die Veränderung gegenüber der unmaskierten Baseline. Rot bedeutet geringere, Grün höhere Genauigkeit. Modelle erzielten oft hohe Werte ohne Video, verloren aber mehr, wenn die (Text-)Antwort entfernt wurde. Die Frage konnte in der Regel mit minimalen Auswirkungen maskiert werden.

Die Ergebnisse (siehe oben) zeigen, dass die Antworten (Textantworten in den Multiple-Choice-Daten) durchweg das größte Gewicht haben. Das Ausblenden der Antwort führte typischerweise zum größten Genauigkeitsverlust und reduzierte die Modelle oft auf ein nahezu zufälliges Ergebnis.

Jedoch wird die Maskierung der Frage hatte meist eine viel geringere Wirkung, was die frühere Feststellung stützt, dass Modelle die Frage oft unterbewerten.

In einigen Fällen verbesserte sich die Genauigkeit sogar. als die Frage entfernt wurdeDies impliziert, dass die Modelle manchmal einfach nur Antworten anhand visueller oder textueller Hinweise abglichen, anstatt die Frage richtig zu bewerten.

Die Modelle unterschieden sich auch in ihrer Abhängigkeit von Video: Einige erreichten auch ohne Video eine angemessene Genauigkeit, was den begrenzten Beitrag von Videofunktionen in vielen aktuellen Setups weiter bestätigte.

Anschließend testeten die Autoren, ob Modelle durch Hinzufügen von zusätzlichen Informationen dazu gezwungen werden könnten, sich auf Videomaterial zu stützen. falsche Antworten zu den Multiple-Choice-Optionen.

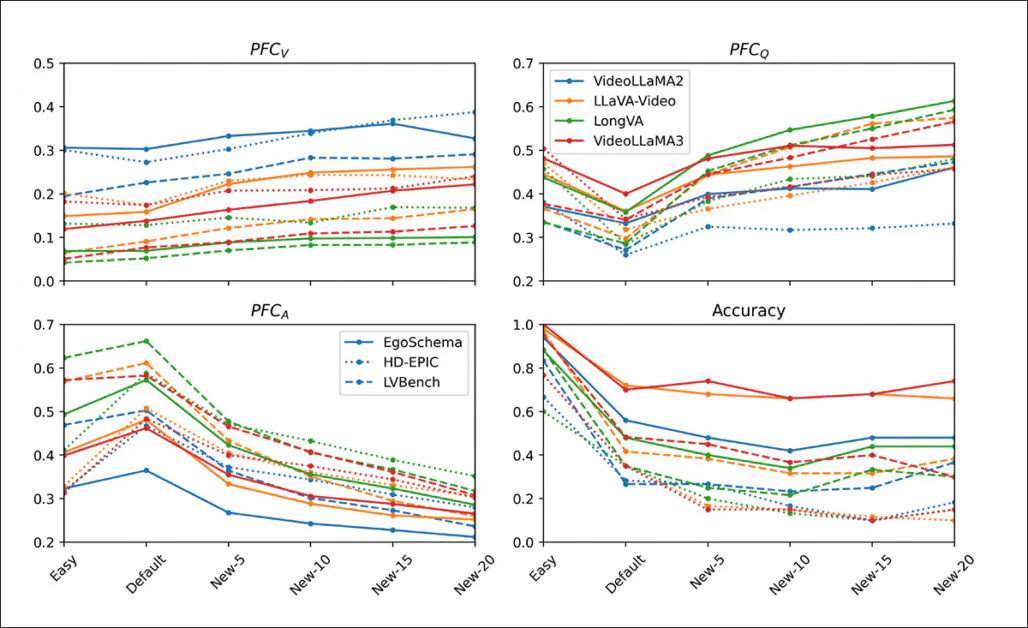

Wenn die Ablenkungsantworten einfach waren und aus anderen Fragen wiederverwendet wurden, verbesserte sich die Leistung, da die Modelle Textmuster ohne viel Nachdenken erkannten. Bei zehn oder mehr nicht zusammenhängenden Antworten begannen sie jedoch, sich stärker auf das Video und die Frage zu stützen:

Der Beitrag und die Genauigkeit der einzelnen Merkmale für Video-, Frage- und Antworteingaben sowie zusätzliche falsche Antworten werden jedem VQA-Test hinzugefügt. Dies zeigt, dass eine Erhöhung der Anzahl der Ablenker die Textdominanz verringert und den relativen Einfluss visueller und fragebezogener Merkmale erhöht.

Bei VideoLLaMA3 verringerte das Ausblenden des Videos die Genauigkeit um 40 % bei EgoSchema und um 15 % bei LVBench, was darauf hindeutet, dass eine einfache Erhöhung der Antwortanzahl Modelle von textbasierten Abkürzungen hin zu echtem multimodalen Denken verschieben kann.

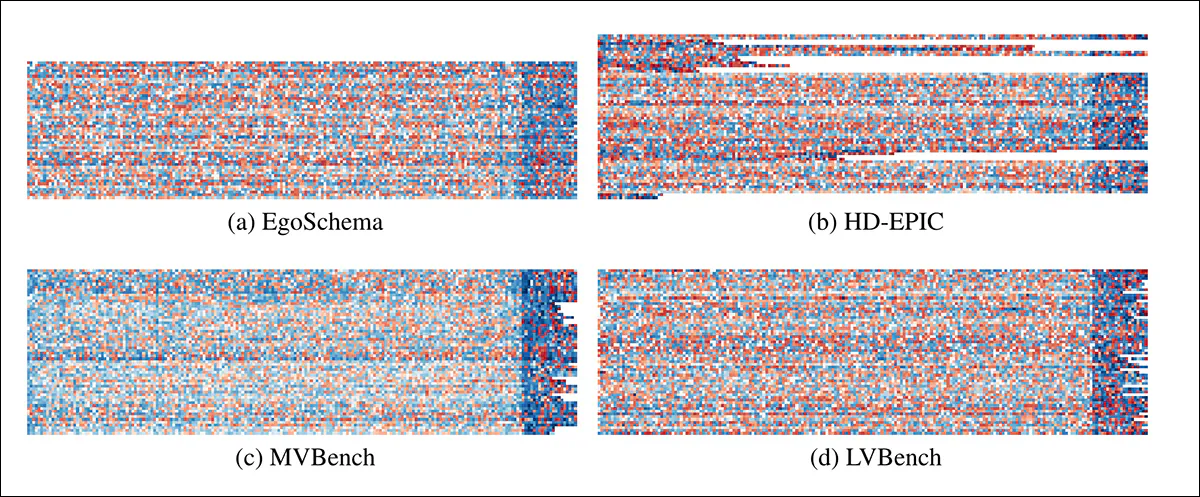

Die Forscher untersuchten auch, wie die Zuordnung auf die verschiedenen Eingangsgrößen verteilt ist. Nachfolgend sehen wir Heatmaps der Shapley-Werte für jede Eingangsgröße des Modells:

Shapley-Wert-Heatmaps für vier Datensätze. Jede Zeile zeigt ein VQA-Tupel, jede Spalte ein einzelnes Merkmal. Videomerkmale befinden sich links, gefolgt von Textmerkmalen. Die deutlich höheren Werte in den (roten) Textbereichen bestätigen, dass die Modelle wesentlich stärker auf Sprache als auf Video basieren.

Zu den obigen Ergebnissen erklären die Autoren:

„Die Shapley-Werte sind auf der rechten Seite jeder Heatmap deutlich höher und repräsentieren die Zuordnung von Frage und Antwort. Diese klare Grenze markiert das Ende der Videoframes und den Beginn der Textmerkmale, was zeigt, dass der Beitrag der Videomodalität deutlich geringer ist als der von Frage und Antwort.“

Zusammenfassend lässt sich sagen, dass die Werte über alle Datensätze hinweg deutlich stärker im textbasierten Bereich liegen, was stark darauf hindeutet, dass die Modelle sich viel stärker auf Sprache als auf visuelle Hinweise stützen. Selbst wenn das Video is Bei dieser Methode ist der Beitrag dünn über viele Einzelbilder verteilt, oft ohne einheitliches Muster.

Im Folgenden sehen wir ein kommentiertes Beispiel aus EgoSchema. Die 16 wichtigsten Frames wurden anhand von Shapley-Werten ausgewählt und entsprechend ihrem Einfluss farblich dargestellt, wobei Blau einen positiven und Rot einen negativen Beitrag anzeigt:

Shapley-Attributionen für ein einzelnes EgoSchema-Beispiel, das die 16 einflussreichsten Frames und alle Texteingaben zeigt. Videobeiträge sind im Vergleich zum Text minimal, der die Argumentation des Modells dominiert. Blau und Rot kennzeichnen positiven bzw. negativen Einfluss auf die gewählte Antwort.

Das Ergebnis ist, dass fast jedes einzelne Bild im Vergleich zu den Wörtern in Frage und Antwort nur geringen Einfluss hat. Visuelle Hinweise sind spärlich und uneinheitlich, während Substantive wie „Stuhl“ und „Zaun“ das Modell je nach Kontext zur richtigen Antwort – oder davon weg – lenken.

Fazit

Wer sich schon einmal mit Videobearbeitung oder Videoanalyse beschäftigt hat, weiß, wie ressourcenintensiv diese Prozesse sind und versteht, warum Unternehmen, die täglich Millionen KI-basierter Anfragen verarbeiten, es sich nicht leisten können, dies leichtfertig zuzulassen. ad hoc Bearbeitungs- und Interpretationsprozesse für Videos, die von Benutzern durchgeführt werden.

Eines sollte man in diesem Zusammenhang bedenken: Nahezu jede KI-API-Schnittstelle, die Sie jemals ausprobieren werden (mit der möglichen Ausnahme einer brandneuen und kurzlebigen Demo zur Unterstützung neuer wissenschaftlicher Forschung), ist darauf ausgerichtet, die Wünsche der Benutzer mit minimalem Ressourcenaufwand zu erfüllen.

Das bedeutet, auf vorhandene Metadaten aus benutzerseitig bereitgestellten Daten zurückzugreifen oder RAG Wenn möglich, sollten Abrufe durchgeführt und gegebenenfalls Metadaten aus besser auswertbaren Formaten wie PDF, Dokumenten und Einzelbildern extrahiert werden.

Nicht zur Debatte steht die Möglichkeit, Ihr hochgeladenes Video durch CLIP oder die neueste Version zu laufen. YOLO entweder durch eine Veröffentlichung oder durch ein energieintensives und zeitaufwändiges Videomanagementsystem, das tatsächlich erkennen kann, was sich in den Einzelbildern befindet und verstehen kann, was in dem bereitgestellten Video unter Berücksichtigung der Zeitlichkeit geschieht.

Dies bedeutet jedoch nicht, dass die in diesem Beitrag dokumentierten Phänomene zwangsläufig auf sparsame architektonische Ansätze zurückzuführen sind. Die Autoren stellen fest, dass Text in jedem Fall die modernsten multimodalen Trainingsparadigmen dominiert, was darauf hindeutet, dass die „visuelle Sprache“ in einem multimodalen Kontext entweder weniger entwickelt, weniger wichtig oder informativ ist oder (zumindest derzeit) weniger gut verstanden wird.

* Interessanterweise scheint das vom NotebookLM generierte Material entweder völlig originell oder von Google überhaupt nicht indexiert zu sein, da ich keine Ergebnisse finden kann, die sich in die Trainingsdaten eingeschlichen und diese Ausgabe ausgelöst haben könnten.

Erstveröffentlichung: Freitag, 31. Oktober 2025; Formatierung: 14:20 Uhr