Vordenker

Von Code zu Heilung: Die nächste AI-Revolution benötigt eine Hand (und Augen)

Wie agente Systeme, XR-Smart-Glasses und Robotik Menschen ermächtigen – anstatt sie zu ersetzen

Wir leben in einem Paradoxon der künstlichen Intelligenz.

Auf Bildschirmen ist die künstliche Intelligenz übermenschlich. Große Sprachmodelle schreiben funktionierenden Python-Code in Sekunden. Generative Systeme produzieren photorealistische Bilder und Videos in Minuten. Nobelpreis-Systeme wie AlphaFold haben die Strukturen fast aller bekannten Proteine vorhergesagt. Die digitalen Siege häufen sich.

Doch in der physischen Welt der biomedizinischen Forschung bleibt der Prozess der Entdeckung schmerzlich manuell. Wir spüren nicht wirklich, wie die künstliche Intelligenz die Wissenschaft oder Medizin beschleunigt, zumindest noch nicht. Die Zahlen zeigen die Tiefe des Problems. Eine wegweisende Nature-Umfrage unter über 1.500 Wissenschaftlern ergab, dass mehr als 70% versucht und gescheitert sind, die Experimente eines anderen Forschers zu reproduzieren. Noch besorgniserregender: Mehr als die Hälfte konnte ihre eigene Arbeit nicht reproduzieren. In der Krebsbiologie insbesondere fand ein achtjähriges Reproduzierbarkeitsprojekt heraus, dass nur 40% der hochwertigen Ergebnisse repliziert werden konnten und 68% der Experimente nicht ausreichend dokumentiert waren, um eine Replikation zu versuchen.

Dies ist das schmutzige Geheimnis der modernen Wissenschaft: Wir haben ein Wissensaufnahmeproblem, nicht nur ein Entdeckungsproblem. Kritische experimentelle Details leben in den Köpfen der Forscher, nicht in Papieren. Protokolle driften ab. Tacites Wissen geht aus der Tür, wenn Trainees abschließen. KI-Systeme, die auf veröffentlichter Literatur trainiert werden, erben all diese Lücken.

Das grundlegende Problem ist, dass eine KI, obwohl sie ein neues Protein für die Krebstherapie in einer digitalen Simulation entwerfen kann, nicht in der Lage ist, eine Pipette aufzunehmen, um es zu testen. Sie kann nicht durch das chaotische, unvorhersehbare Umfeld eines nassen Labors navigieren, um ihre eigene Hypothese zu validieren. Sie kann nicht die Hände eines erfahrenen Wissenschaftlers beobachten und die subtilen Techniken lernen, die Experimente zum Erfolg führen.

Diese “Ausführungslücke” ist das größte Hindernis, das die KI-Revolution daran hindert, zu einer medizinischen Revolution zu werden. Während die meisten Roboterunternehmen noch damit beschäftigt sind, Maschinen das Falten von Wäsche oder das Laden von Geschirrspülern beizubringen, bleiben sie hinter den wirklich transformierenden Fähigkeiten dieser Fortschritte in Bereichen wie der Medizin zurück.

Um dies zu lösen, müssen wir über Chatbots hinausgehen und uns auf KI-Co-Wissenschaftler konzentrieren, agente Systeme, die die digitale und physische Welt verbinden, über Planung und Codierung hinausgehen und in die reale Ausführung eintauchen. An der Stanford University entwickeln wir LabOS, ein digitales-physisches KI-Rahmenwerk, das zeigt, wie KI-Agenten, Extended Reality (XR)-Smart-Glasses und kooperative Robotik zusammenarbeiten können, um diese Lücke zu schließen und wissenschaftliche Experimente in ein kollaboratives Gespräch zwischen Mensch und Maschine zu verwandeln, während sie automatisch das Wissen erfassen, das derzeit verloren geht.

Die große Kluft: Warum KI “Augen” und “Hände” benötigt

Viele der sichtbarsten KI-Erfolge sind in Bereichen erzielt worden, in denen die Umgebung vollständig digital ist: Code-Repositorys, kuratierte Datensätze oder simulierte Benchmarks (wo KI im Wettbewerb mit virtuellen Unternehmen oder digitalen Investitionen in Aktien steht).

Nasse Labore sind anders. Biologie und im Allgemeinen wissenschaftliche Entdeckung sind ein sehr lauter Prozess. Instrumente driften ab, Bediener improvisieren und “das Protokoll” lebt oft teilweise in den Köpfen der Menschen. Der Unterschied zwischen einem sauberen Ergebnis und einem fehlgeschlagenen Lauf kann ein Pipettierwinkel, ein Vortexmuster, ein Reagenzsubstitutions- oder ein Inkubationszeitraum sein, der 10 Minuten zu lang war. Diese kontextuellen Details machen es selten in ein Papier und sind genau das, was ein KI-Modell benötigt, wenn es über einen Datensatz hinaus verallgemeinern soll.

Das ist der Grund, warum Lab-Grade-KI “Augen” (um zu erkennen, was im Kontext passiert) und “Hände” (um die Standardisierung und sichere Automatisierung von Schritten mit hohem Variationskoeffizienten zu ermöglichen) und Gedächtnis (um aufzuzeichnen, was tatsächlich passiert ist) benötigt. Ohne diese Fähigkeiten können Modelle empfehlen, was zu tun ist, aber sie können nicht zuverlässig Empfehlungen in validierte physische Ausführung übersetzen oder Misserfolge erklären, wenn die Realität von der Planung abweicht.

Jenseits von Chatbots: Von Copiloten zu Co-Wissenschaftlern

Der Begriff “agente KI” wird manchmal locker verwendet. In biomedizinischen Umgebungen sollte er etwas Präzises bedeuten: ein System, das ein Ziel (z. B. “Optimieren Sie die Effizienz der CRISPR-Genschere unter Minimierung von Off-Target-Effekten”) in eine Folge von Aufgaben zerlegen, diese Aufgaben über Instrumente hinweg ausführen, Ergebnisse bewerten und den Plan unter Einschränkungen und mit auditablem Entscheidungsprozess anpassen kann.

Dies ist wichtig, weil Forschungsworkflows nicht nur ein einzelner Modellaufruf sind. Sie sind End-to-End-Pipelines, die die Formulierung von Hypothesen, experimentelles Design, Datenverarbeitung, statistische Tests und Interpretation umfassen. Aktuelle Überlegungen in der Arzneimittelentdeckung haben begonnen, agente Systeme zu betonen, die diese Pipelines skalieren können, anstatt nur einzelne Schritte zu beschleunigen (z. B. Unite.AI-Diskussion über Agenten in small-molecule discovery).

In der Softwareentwicklung haben wir bereits erste empirische Beweise dafür gesehen, dass KI-Copiloten die Produktivität von Entwicklern steigern können. In der Biomedizin ist die analoge Gelegenheit nicht nur das Schreiben von Code, sondern das Schreiben und Validieren von Protokollen, das Strukturieren von Daten, das Überwachen der Ausführung und das Schließen der Schleife zwischen Vorhersage und Messung, um KI mit menschlichen Wissenschaftlern in Labors zu verbinden.

LabOS: Wenn KI auf einem Betriebssystem für die Labore von morgen läuft

In unserer Arbeit an der Stanford University auf AI4Science, das CRISPR-GPT und AI-XR-Co-Execution-Systeme wie LabOS umfasst, die Wissenschaftlern in biomedizinischen und Materialwissenschaftslabors helfen, haben wir eine architektonische Verschiebung erforscht:

1. Entwurf eines End-to-End-“Lab-Betriebssystems”, das ein digitales (trockenes) Labor mit einem physischen (nassen) Labor verbindet.

Die Prämisse ist einfach: Wenn ein Labornotizbuch das Gedächtnis der Wissenschaft ist, sollte ein Lab-OS die Ausführungsebene sein, die Absicht erfassen, sie in Aktionen übersetzen, Ergebnisse beobachten und jeden Lauf in strukturiertes Wissen verwandeln.

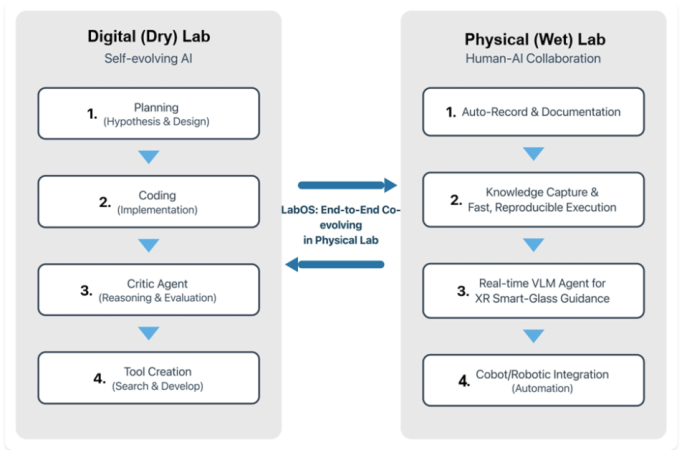

Abbildung. Eine konzeptionelle Ansicht von LabOS, die eine selbstentwickelnde digitale Lab-Schleife (Planung, Codierung, Kritik, Werkzeugerstellung) mit einer menschlichen KI-Wet-Lab-Schleife (Auto-Dokumentation, Wissensaufnahme, XR-Anleitung und robotische Integration) verbindet.

2. KI im digitalen Labor – Selbstentwickelnde Planung und Werkzeugbau

Im digitalen (trockenen) Labor können wir die KI das tun lassen, was sie bereits gut kann: suchen, synthetisieren und vorschlagen. Aber wir wollen auch, dass sie sich selbst verbessert. Nicht, indem sie “neue Wissenschaft halluziniert”, sondern indem sie bessere Werkzeuge und Workflows aus Feedback lernt.

Eine praktische digitale Lab-Schleife kann als vier wiederkehrende Stadien gerahmt werden:

- Planung (Hypothese + Design): Hypothesen vorschlagen, experimentelle Variablen auswählen, Störfaktoren antizipieren und messbare Endpunkte spezifizieren.

- Codierung (Implementierung): Analyse-Skripte, Simulations-Pipelines und Instrumenten-Steuerungsvorlagen generieren oder anpassen, wo angebracht.

- Kritik-Agent (Argumentation + Bewertung): Annahmen testen, statistische Power überprüfen, Kontrollen vorschlagen und wahrscheinliche Fehlermodi flaggen.

- Werkzeugerstellung (Suche + Entwicklung): Wenn der Workflow ein Komponentenfehl hat (ein Parser, ein QC-Routine, ein Dashboard), es bauen und es zurück zum Werkzeugkasten hinzufügen.

3. KI im physischen Labor – KI mit “Augen” (XR-Brille) und “Händen” (Robotik)

Das physische (nasse) Labor ist der Ort, an dem das System entweder Vertrauen gewinnt – oder es verliert. Das Ziel ist nicht, den Wissenschaftler zu ersetzen, sondern Reibung und Fehler zu reduzieren, während die Beobachtbarkeit erhöht wird.

Wir betrachten die physische Lab-Schleife als vier komplementäre Fähigkeiten:

- Auto-Aufzeichnung und Dokumentation: Aktionen, Zeitstempel, Instrumenteneinstellungen und Abweichungen automatisch erfassen, so dass Dokumentation nicht nachträglich erfolgt.

- Wissensaufnahme für schnelle, reproduzierbare Ausführung: Läufe in strukturierte, abfragbare Artefakte (Protokollversionen, Parametersätze, QC-Ergebnisse) umwandeln, die mit den Grundsätzen der Datenverwaltung wie FAIR übereinstimmen.

- Echtzeit-Vision-Sprach-Anleitung via XR-Smart-Glasses: multimodale Modelle verwenden, um die Szene zu interpretieren (was der Bediener tut, welches Reagenz in der Hand ist) und schrittweise Anleitung und Sicherheitschecks bereitzustellen. AR/XR hat bereits seinen Wert in hochriskanten physischen Workflows wie experimenteller Anleitung (LabOS, Stanford, Princeton, in Zusammenarbeit mit NVIDIA) demonstriert.

- Kooperation/Roboter-Integration für Automatisierung: repetitive Schritte standardisieren, sichere Übergaben ermöglichen und Variabilität reduzieren. Plattformen für Simulation-zu-Real-Workflows (z. B. NVIDIA Isaac) und Echtzeit-KI-Verarbeitung am Rand wie die Live-Streaming- und Mensch-KI-Interaktion in LabOS sind wichtige Aktivierungsschichten.

Diese Architektur stimmt mit einer breiteren Richtung im Feld überein: “selbstfahrende” oder autonome Labore, die Automatisierung mit maschinellem Lernen kombinieren, um das nächste Experiment zu planen. Was LabOS hinzufügt, ist eine engere menschliche Schnittstelle, so dass Autonomie nicht auf Kosten von Transparenz geht.

Warum Lab-Grade-KI nicht nur “KI auf einem Datensatz” ist

KI-Systeme für biomedizinische/wissenschaftliche Superintelligenz sehen oft beeindruckend aus, wenn sie in retrospektiver Bewertung oder bei Prüfungen abschneiden, und unterperformen dann im physischen Labor. Der Grund ist selten ein einzelner Bug. Es ist normalerweise eine Fehlpassung zwischen den Annahmen des Modells und der Realität des Labors.

Drei Lücken zeigen sich wiederholt:

- Kontextlücke: Datensätze enthalten typischerweise nicht die kontextuellen Variablen, die Bediener wissen, dass sie wichtig sind (Temperatur-Exkursionen, Reagenz-Losnummern, subtile Protokoll-Abweichungen).

- Aktionslücke: Viele KI-Systeme können empfehlen, was zu tun ist, aber können nicht zuverlässig Empfehlungen in validierte physische Schritte übersetzen.

- Rückkopplungslücke: Ohne strukturierte, hochwertige Rückkopplung von der Ausführung können Modelle nicht lernen, wo sie fehlschlagen – und Wissenschaftler können nicht überprüfen, warum.

Das Schließen dieser Lücken ist weniger daran gelegen, eine neue neuronale Netzwerktopologie zu erfinden, sondern vielmehr daran, die Instrumentierung, Schnittstellen und Datenverträge aufzubauen, die das Labor für Maschinen lesbar machen und es der KI ermöglichen, mit Menschen zusammenzuarbeiten.

Vertrauen durch Design: Sicherheit und Governance für KI, die handeln kann

Agente KI in der Entdeckungsforschung wirft nicht nur bekannte Bedenken hinsichtlich der Genauigkeit auf. Sie introduceiert neue Fehlermodi, weil sie handeln kann. In einem Labor bedeutet Handeln das Potenzial für Verschwendung, Schaden oder irreführende Schlussfolgerungen, insbesondere wenn Experimente in klinische Hypothesen münden.

Eine nützliche Denkweise ist, einen KI-aktivierte Lab-Stack als soziotechnisches System zu betrachten, das Sicherheit benötigt. Mehrere bestehende Rahmenbedingungen helfen, aber sie müssen in die Laborrealität übersetzt werden:

- Risikomanagement als kontinuierliche Praxis: NISTs KI-Risikomanagement-Rahmenwerk (AI RMF 1.0) bietet eine praktische Vokabular für die Kartierung, Messung und Steuerung von KI-Risiken über den Lebenszyklus hinweg.

- Regulatorische Ausrichtung für medizinnahe KI: Die FDA-Arbeit an KI/ML-Software als medizinisches Gerät (SaMD), einschließlich ihres Aktionsplans und zugehöriger Richtlinien, bietet einen konkreten Blick darauf, was “gute Praxis” in der KI-Anwendung aussieht, die Patientenversorgung beeinflusst.

Für Gentechnik und andere Hochkonsequenz-Domänen ist Governance bereits ein globales Gespräch. Empfehlungen werden zur menschlichen Genom-Editierung diskutiert, um die Notwendigkeit angemessener Aufsichtsmechanismen und verantwortungsvoller Governance zu betonen, wie sie von der American Society for Gene and Cell Therapy oder ASGCT vorgeschlagen werden. Systeme wie LabOS sollten so konzipiert werden, dass sie die Einhaltung von Vorschriften erleichtern, nicht erschweren.

Checkliste: Kontrollen für sichere KI-Co-Wissenschaftler für wissenschaftliche Entdeckung

Unsere Meinung nach sollte ein sicherheitsbewusstes Lab-OS mindestens die folgenden Designs implementieren:

- Herstellerangaben standardmäßig: Jeder Datensatz, jede Protokollversion und jedes Modellergebnis sollte auf Eingaben und Zeitstempel zurückverfolgbar sein.

- Eingeschränkte Autonomie: Das System sollte ausdrückliche Genehmigungen (was es ohne Bestätigung tun kann) und Eskalationsregeln (wann es fragen muss) haben.

- Menschliche Übernahme und sanfte Degradation: Wenn Sensoren oder Datenströme ausfallen oder Unsicherheit hoch ist, sollte das System in einen sichereren, einfacheren Modus zurückfallen.

- Kontinuierliche Validierung: In-silico-Vorhersagen sollten mit physischer Lab-Validierung gepaart werden; physische Lab-Läufe sollten QC-Tore enthalten, bevor Schlussfolgerungen downstream zu den KI-Modellen/Agenten in der digitalen Welt propagieren.

- Sicherheit und Bewusstsein für Doppelverwendung: Lab-Infrastruktur vor Manipulation schützen.

Menschliche Ermächtigung überall: Kann KI-Co-Wissenschaftler das Spielfeld ebnen?

Eines der überzeugendsten Versprechen eines KI-XR-“Co-Wissenschaftlers” ist nicht nur Geschwindigkeit für Elite-Institutionen, sondern auch Zugänglichkeit für alle. Betrachten Sie, was derzeit kleinere Labore, Start-ups und entfernte/regionale Kliniken einschränkt:

- Begrenzter Zugang zu spezialisiertem Fachwissen für Gold-Standard-Protokolle und Instrumente.

- Höhere relative Kosten für Schulung, Fehler und Nacharbeit.

- Fragmentierte Werkzeuge: Notizbücher, Tabellenblätter, Instrumentenprotokolle und Analyse-Skripte verbinden sich selten sauber.

Ein System, das die Ausführung im Kontext leiten kann (über XR-Brille), automatisch aufzeichnen, was passiert ist, und den nächsten besten Schritt basierend auf vorherigen Läufen vorschlagen kann, könnte fortgeschrittene Assays über Standorte hinweg wiederholbarer machen. Im Prinzip könnte es auch verteilte klinische Forschung unterstützen, bei der Protokolle konsistent ausgeführt werden müssen, auch wenn Ressourcen variieren.

Zeitplan: Wann bekommt jeder Wissenschaftler und Klinikarzt einen Co-Wissenschaftler?

Kurz gesagt, wir sind näher, als viele denken, für einige hochwertige, hochfrequente Aufgaben (wie die zuverlässige Herstellung eines Medikaments im Labor) und weiter entfernt, als die meisten Demos implizieren, für andere (wie KI, die komplexe Probleme wie Krebs oder Alzheimer vollständig löst). Ein realistischer Zeitplan sieht so aus:

- Kurzfristig (innerhalb von 1 Jahr): Workflow-Copiloten, die die administrative Belastung reduzieren: Protokollentwurf, Literatursynthese, Analyse-Vorlagen und automatische QC-Berichte. Der limitierende Faktor ist die Integration, nicht die Modellfähigkeit.

- Mittelfristig (1-2 Jahre): Co-Execution-Systeme im Labor: XR-Brillen-Anleitung, automatische Dokumentation und selektive Robotik für Schritte mit hohem Variationskoeffizienten. Vertrauen wird von Audit-Trails und enger menschlicher Einbindung abhängen.

- Langfristig (3+ Jahre): Cross-Domain-Co-Forscher, die Entdeckung mit Translation verbinden: Lab-Daten mit klinischen Endpunkten verbinden, Sicherheitssignale überwachen und Studienentwurf unterstützen – unter Einhaltung regulatorischer und ethischer Erwartungen.

Von Code zu Heilung: Der Weg nach vorne zu 1000x wissenschaftlicher Entdeckung

LabOS ist ein Versuch, eine einfache Frage zu beantworten: Was, wenn ein Experiment als Gespräch durchgeführt werden könnte, bei dem Absicht, Ausführung und Beweis end-to-end verbunden sind? Wenn wir diese Systeme gut bauen, können sie dazu beitragen, die Übersetzungs-Lücke zu schließen, die die Biomedizin und viele physikalische Wissenschaften (z. B. Materialwissenschaft) behindert. Wenn wir sie schlecht bauen, werden sie Irreproducibility verstärken und neue Sicherheitsrisiken schaffen.

Die wichtigste Arbeit in den nächsten Jahren wird grundlegend sein: Standardisierte Daten- und Geräteschnittstellen über den Aufbau des Betriebssystems (ähnlich wie iOS alle Arten von Apps ausführt), den Aufbau von KI-Benchmarks, die Ausführung und Unsicherheit einschließen (wie der LabSuperVision-Benchmark in LabOS), und den Beginn der Bereitstellung in der realen Welt, die Innovation fördern, während sie Patienten und Forschungsintegrität schützen.

Für Forscher und Kliniker ist die Frage nicht, ob KI in das Labor kommen wird. Sie ist bereits da. Die Frage ist, ob wir sie als Sammlung von nicht verbundenen Werkzeugen integrieren oder als vertrauenswürdiges, überprüfbares System, das für die Realitäten der biomedizinischen Wissenschaft konzipiert ist.